Identificar as fontes de dados

Dependendo de seus requisitos específicos, muitas opções estão disponíveis para ajudar a trazer seus dados de log de atividades para o Power Automate Process Mining. Você pode se conectar diretamente à fonte de dados, usar um modelo existente ou importar os dados de um arquivo CSV. Você também pode se conectar ao seu próprio Microsoft Azure Data Lake Storage Gen 2 que contém os dados do log de eventos.

Para avaliar a melhor opção, você deve se familiarizar com os diferentes modelos e conectores disponíveis. Além disso, você deve considerar de onde seus dados estão vindo e que tipo de transformação eles podem exigir.

Identificar o intervalo de tempo ideal dos dados

A equipe geral de mineração de processos deve discutir qual intervalo de tempo é ideal para fazer o monitoramento do processo. Esse intervalo de tempo pode influenciar seus esforços para extrair dados de vários sistemas. Por exemplo, se você estiver considerando apenas os últimos 90 dias, é contraproducente extrair além desse intervalo de tempo de qualquer um dos sistemas.

Geralmente, a mineração de processos funciona melhor quando você tem uma visão completa de todos os dados de um caso. Executar a análise usando casos que contêm apenas um subconjunto de eventos pode levar a desafios na análise. Embora seja possível filtrar esses eventos no momento da análise, pode ser mais eficiente tentar ingerir um log de eventos completo.

Uma causa comum de dados ausentes acontece quando um sistema em um processo de vários sistemas começou recentemente a coletar dados. Nesse exemplo, você pode limitar sua análise aos últimos 30 dias ou qualquer que seja a data de início da coleta de dados.

Em situações em que há uma melhoria contínua acontecendo, a solicitação de dados pode ser para os últimos 30 a 60 dias de forma contínua.

Identificar a fonte e avaliar

A primeira etapa de colocar os dados do log de atividades no Power Automate Process Mining é identificar a fonte de dados para cada sistema de registro envolvido no processo e, em seguida, avaliar os dados disponíveis. Em muitos casos, as tabelas no banco de dados do sistema com as quais você está familiarizado mantêm o estado atual dos dados e não o log histórico do que aconteceu. Muitas vezes, o sistema usa uma tabela ou mecanismo separado para armazenar sua atividade até que você precise localizá-la. Por exemplo, muitos aplicativos do Microsoft Dynamics 365 rastreiam essa atividade na tabela Atividades. Outros aplicativos, como SAP ou Salesforce, têm conceitos semelhantes, mas podem diferir nos nomes das tabelas.

Localizar os dados da atividade é apenas parte do trabalho. Lembre-se das seguintes considerações para cada fonte:

Se todos os dados de atividade são relevantes ou se alguns dados não são relevantes para mineração de processos: com frequência, esses logs contêm dados além do início e do fim de um evento de processo.

Se o log contém todos os dados necessários: por exemplo, talvez seja necessário associar os dados de log aos dados de estado atual para obter atributos em nível de log de eventos e casos. Além disso, você pode identificar que o sistema não rastreia todos os eventos necessários. Nesse caso, você precisará modificar o sistema para começar a rastrear os dados de evento ausentes.

Usar modelos para integração simplificada da fonte de dados

O Power Automate Process Mining tem muitos modelos internos que você pode usar para começar rapidamente com várias fontes de dados. Usando os modelos, você pode ingerir dados no Power Automate Process Mining rapidamente sem precisar transformar ou mapear os dados do log de eventos dessas fontes.

O Power Automate Process Mining tem modelos para as seguintes fontes de dados:

Modelos do Azure: os modelos estão disponíveis para Microsoft Azure DevOps, Aplicativos Lógicos do Microsoft Azure e o recurso Durable Functions do Microsoft Azure Functions. Esses modelos permitem que você use mineração de processos para identificar e otimizar seus processos de desenvolvimento.

Modelos de aplicativos de finanças e operações: esses modelos podem fornecer um início rápido quando você está trazendo dados de um sistema SAP. Há modelos disponíveis para oferecer suporte aos processos de contas a pagar e da compra ao pagamento. Uma vantagem do modelo da compra ao pagamento é que ele vem com muitos KPIs e visualizações extras criados com base no relatório de mineração de processos padrão.

Modelos do Microsoft Power Platform: com esses modelos, você pode ingerir rapidamente dados de fluxos da área de trabalho do Power Automate para desktop, bots do Microsoft Copilot Studio e insights do Microsoft Power Apps.

Quando você usa um modelo, ele começa com um fluxo de dados do Microsoft Power Platform e um relatório personalizado do Microsoft Power BI para o processo empresarial do modelo. De maneira semelhante a como você começaria com espaços em branco do Power Automate Process Mining, você pode personalizar o fluxo de dados e o relatório para acomodar outros requisitos que o modelo com o qual você começou não processa.

Conectar-se diretamente à fonte de dados

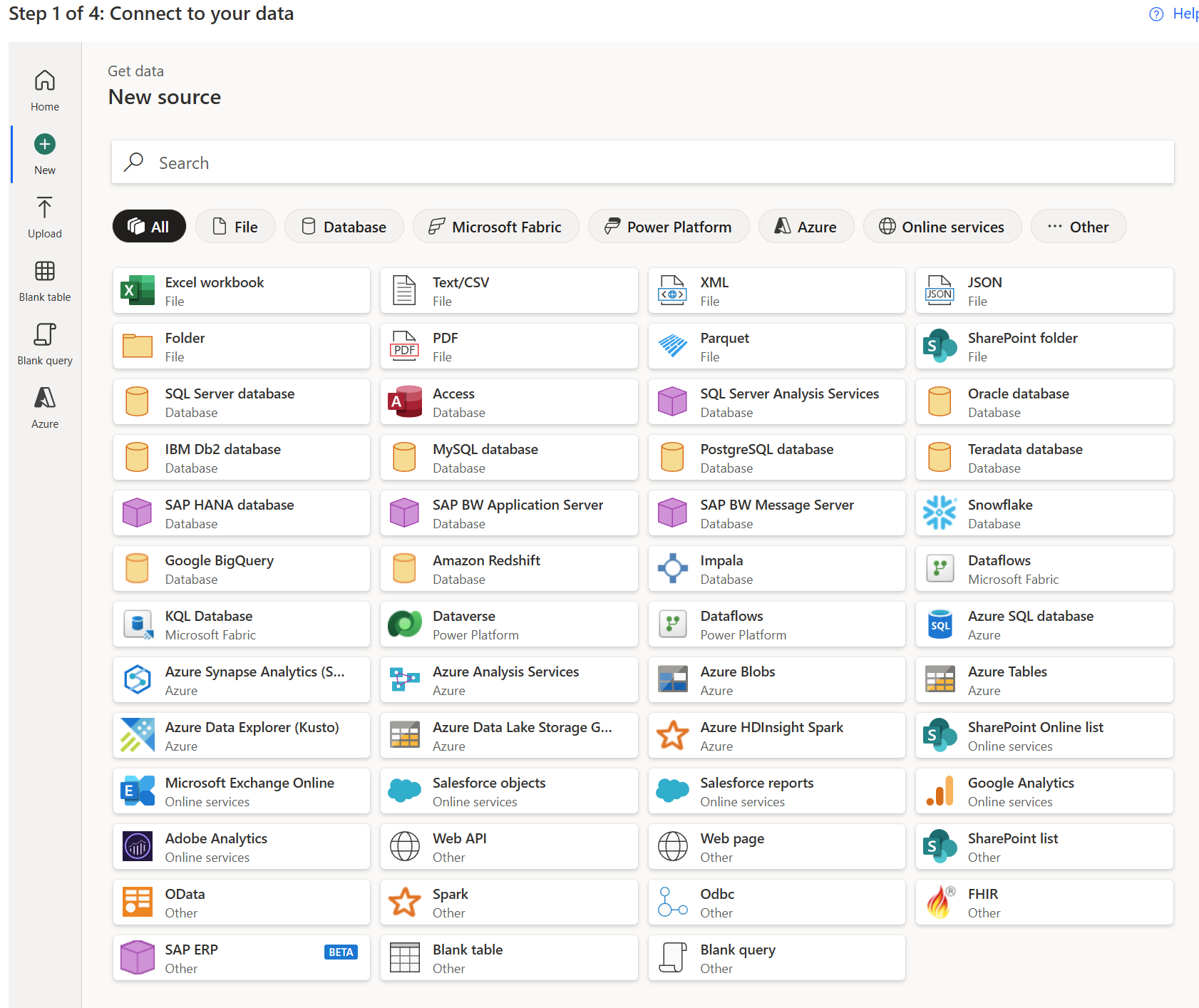

Usando a opção Começar do zero, você pode se conectar a uma das várias fontes de dados usando os conectores fornecidos.

Depois de se conectar à fonte de dados, você pode usar o Power Query para transformar os dados do log de eventos antes do mapeamento dos dados no Power Automate Process Mining.

Conectar-se diretamente ao seu próprio Azure Data Lake Storage Gen2

Com o Azure Data Lake Storage Gen2, você pode trazer diretamente seus dados de log de eventos para dentro do Power Automate Process Mining com a menor quantidade de sobrecarga para ingerir os dados.

Ao usar essa opção, você escolhe um único arquivo ou uma pasta que contenha os dados do log de eventos. Os arquivos devem usar o formato CSV. Quando você usa vários arquivos, todos os arquivos devem ter os mesmos cabeçalhos e formato. Além disso, os dados nos arquivos precisam estar no formato final do log de eventos e não devem exigir transformações adicionais antes de mapeá-los para o Power Automate Process Mining.

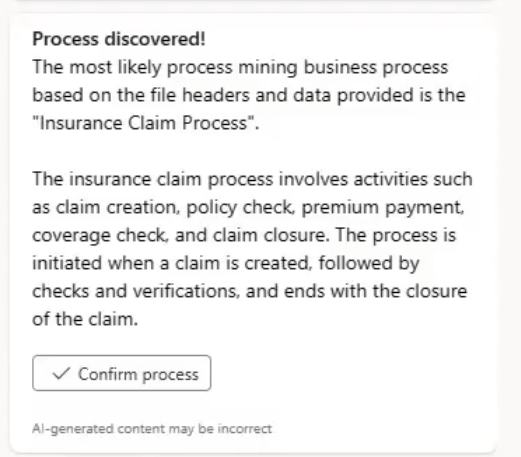

Quando você se conecta à fonte de dados, o Microsoft Copilot no Power Automate Process Mining executa a descoberta de processos e tenta identificar o tipo de processo ao qual os dados do log de eventos está relacionado.

O Copilot pode ser útil para uma análise mais aprofundada e para o mapeamento automático dos dados a fim de prepará-los para uso com a mineração de processos.

Essa abordagem para ingerir dados é ideal quando você conclui qualquer transformação ou combinação necessária dos dados e, em seguida, carrega esses dados no Azure Data Lake Storage Gen1. Por exemplo, para uma análise de processo de sinistros de seguros, uma organização pode precisar obter dados de um CRM, um sistema interno de gerenciamento de sinistros e um SAP. Usando suas ferramentas padrão de extração, carregamento e transformação (ETL), a organização poderia extrair os dados relevantes do log de eventos diariamente dos três sistemas e, em seguida, gravar os dados transformados e combinados na conta de armazenamento. Em seguida, o Power Automate Process Mining poderia ingerir esses dados depois que a organização os mapeasse no espaço de trabalho de análise de processo. A Video a seguir analisa esse exemplo em detalhes.