Modelos multimodal para análise de imagem

Observação

Consulte a guia Texto e imagens para obter mais detalhes!

Cada vez mais, novos modelos de IA são multimodais. Em outras palavras, eles dão suporte a vários tipos de dados de entrada, incluindo imagens e texto. Modelos multimodal são modelos de IA que podem entender e trabalhar com mais de um tipo de dados ao mesmo tempo, como texto, imagens, áudio ou vídeo. Por exemplo, o modelo multimodal pode descrever uma imagem em linguagem natural ou responder a uma pergunta sobre uma foto.

Modelos multimodal são comumente usados como parte de:

- Aplicativos de IA, em que o reconhecimento de imagem aprimora os fluxos de trabalho do usuário

- Agentes de IA, em que a entrada visual ajuda o agente a tomar melhores decisões

Os exemplos incluem:

- Um agente que revisa documentos e capturas de tela carregados

- Um aplicativo de suporte que analisa as fotos enviadas pelos clientes

- Uma ferramenta de aprendizado que explica diagramas ou gráficos em linguagem simples

Como os modelos multimodal aceitam texto e imagens, eles reduzem a necessidade de pipelines de visão separados e facilitam a criação de experiências inteligentes de ponta a ponta.

A capacidade dos modelos de combinar compreensão visual com respostas de linguagem natural é conhecida como modelos GPT habilitados para visão ou GPT com visão. Modelos equipados com visão são projetados para raciocínio visual flexível e de uso geral. Eles podem analisar a entrada visual e responder em linguagem natural, facilitando a criação de aplicativos inteligentes sem precisar de experiência profunda em pesquisa visual computacional.

Modelos multimodais no Microsoft Foundry

O Microsoft Foundry inclui muitos modelos que aceitam entrada baseada em imagem, permitindo que você crie soluções inteligentes baseadas em visão. Modelos multimodal no Microsoft Foundry permitem que aplicativos e agentes entendam, analisem e raciocinam sobre imagens e conteúdo visual.

Por exemplo, modelos GPT habilitados para visão no Foundry podem:

- Descrever o conteúdo de uma imagem em linguagem natural

- Responder perguntas sobre objetos, texto ou cenas em uma imagem

- Extrair significado de gráficos, capturas de tela, documentos ou fotos

- Combinar compreensão de imagem com instruções de texto em um único prompt

O catálogo de modelos da Foundry contém muitos modelos multimodal, incluindo:

GPT-4.1 / GPT-4.1-mini / GPT-4.1-nano: esses modelos gpt multimodal de uso geral podem processar texto e imagens juntos. Eles são comumente usados para descrição da imagem e resposta a perguntas visuais, análise de documento e captura de tela e interpretação de gráfico e diagrama.

A Série GPT-5 (por exemplo, GPT-5.1, GPT-5.2): A família GPT-5 disponível na Foundry inclui modelos multimodais avançados projetados para cenários empresariais e agenciais. Esses modelos dão suporte a entradas multimodal (incluindo texto e imagens), saídas estruturadas e uso de ferramentas, raciocínio de contexto grande entre modalidades. Os modelos da série GPT-5 normalmente são usados em agentes de IA de nível de produção e aplicativos multimodal complexos.

A Foundry também hospeda modelos multimodal fornecidos pelo parceiro em seu catálogo de modelos, incluindo modelos de provedores como o Antropic e outros que dão suporte à compreensão de texto e imagem.

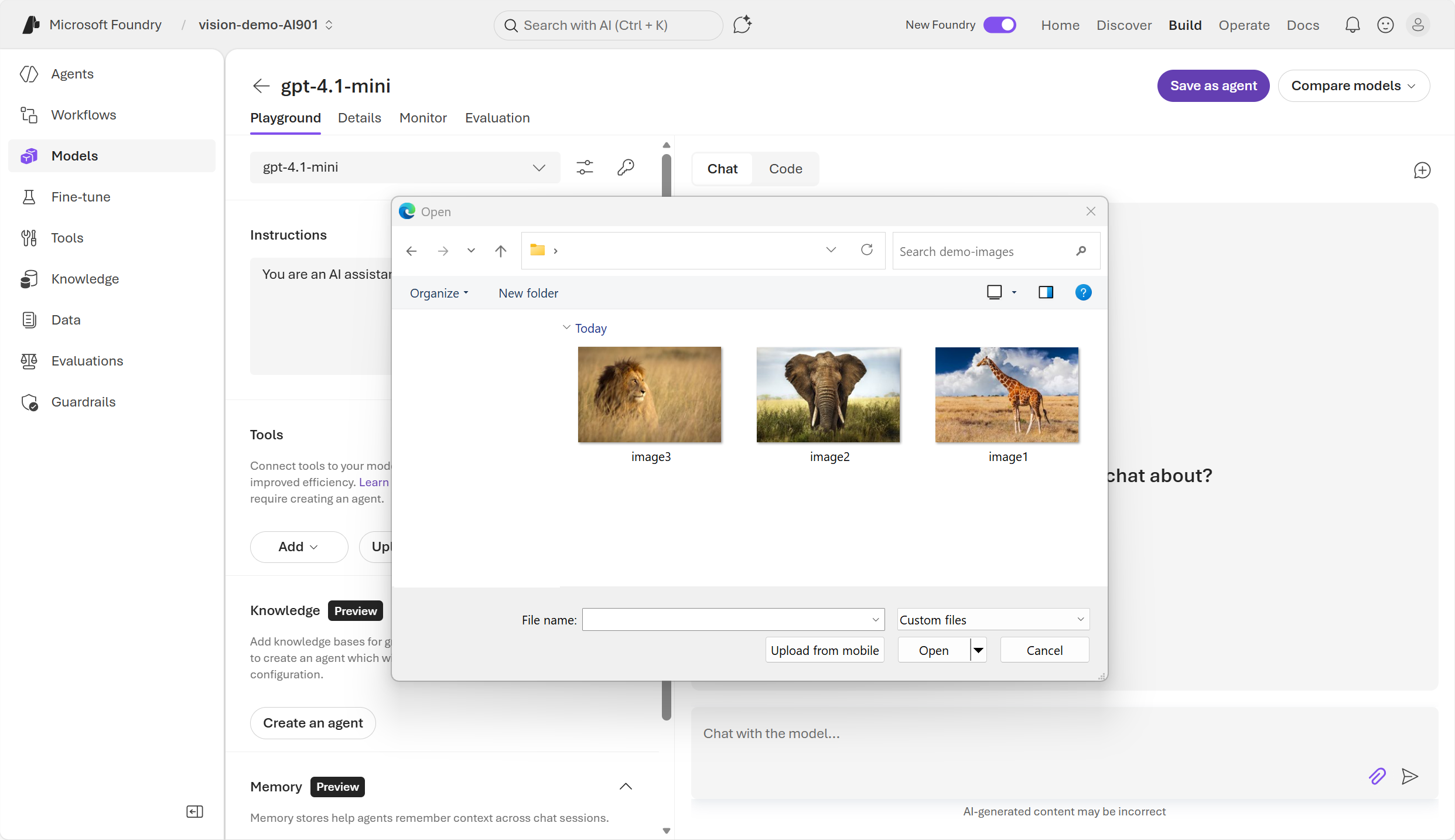

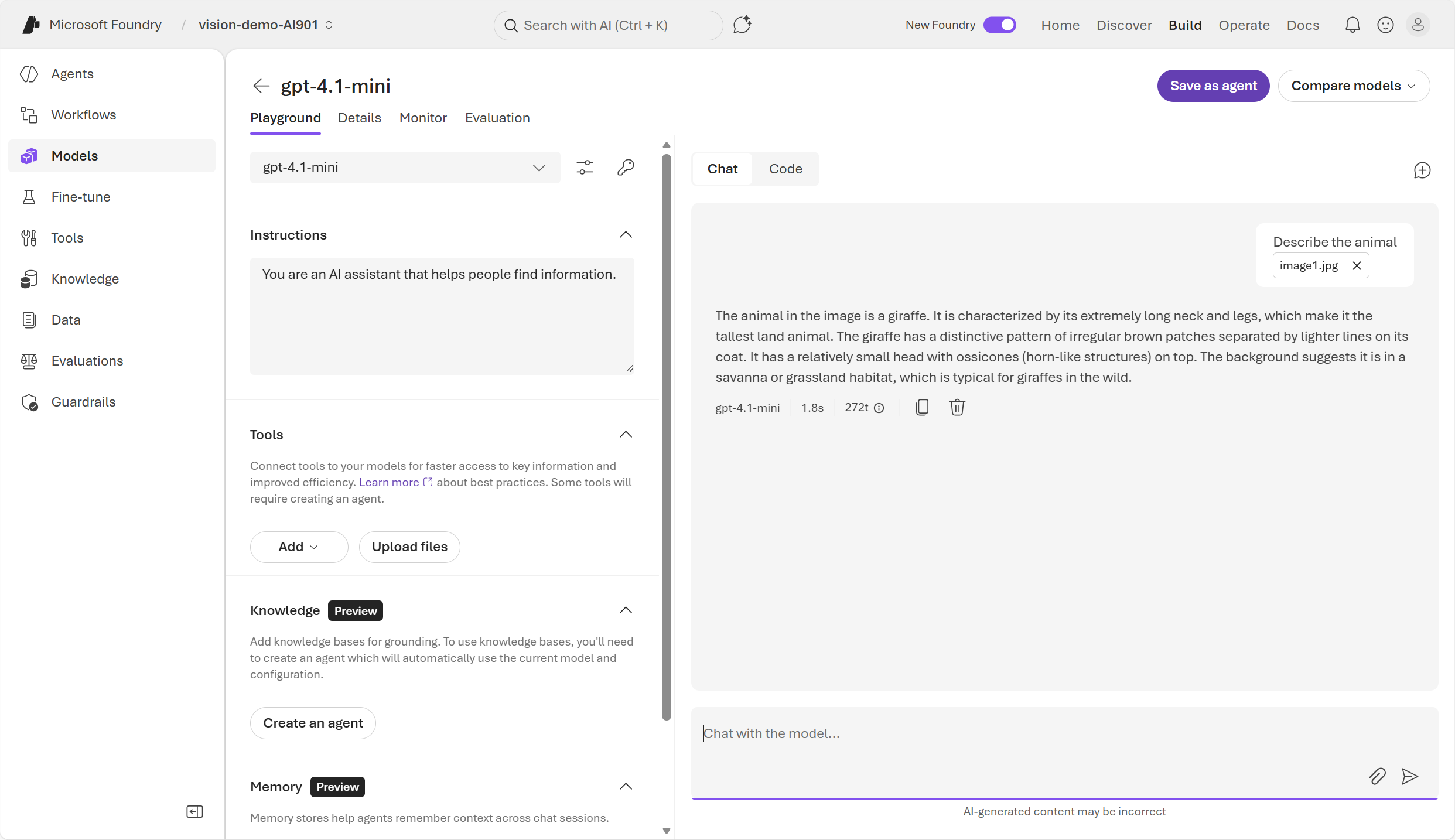

Análise de imagens no playground do Foundry

Observação

O portal do Foundry tem uma interface do usuário (interface do usuário) clássica e uma nova interface do usuário.

No novo portal do Microsoft Foundry, você pode usar o playground de modelos para conversar com um modelo implantado. Você pode selecionar um modelo habilitado para visão, carregar imagens e testar prompts interativamente para entender como o modelo interpreta informações visuais.

Por exemplo, você pode anexar um arquivo de imagem e obter o modelo multimodal (como gpt-4.1 mini) para analisá-lo e descrevê-lo.

Depois de validados, os mesmos recursos podem ser acessados programaticamente usando APIs, permitindo que as imagens sejam enviadas junto com prompts de texto no código do aplicativo.

Usando a API openai do Azure para análise de imagem

Para desenvolver um aplicativo, é necessário partir do playground do Foundry e passar para o código. Em um editor de código, você pode escrever o código do aplicativo usando a API de Respostas OpenAI no Foundry. A API de Respostas OpenAI foi projetada para aplicativos agente e dá suporte a entradas multimodal nativas (incluindo imagens).

Em um alto nível:

- Uma única solicitação pode incluir entrada de texto e entrada de imagem em conjunto

- As imagens podem ser fornecidas como URLs ou como dados de imagem codificados em base64

- O modelo processa ambas as entradas simultaneamente para gerar uma resposta

Conceitualmente, a estrutura do prompt tem a seguinte aparência:

- Uma instrução de texto (por exemplo, quais objetos são visíveis nesta imagem?)

- Uma ou mais entradas de imagem anexadas à mesma solicitação

Essa abordagem permite que os desenvolvedores criem aplicativos em que os usuários carregam imagens e façam perguntas sobre elas em tempo real.

Usando o SDK do Python do Azure OpenAI

Você pode usar um recurso do Microsoft Foundry utilizando a API OpenAI para realizar a análise de imagens — incluindo o envio de imagens em prompts e a obtenção de respostas em texto — através do uso da API de Respostas com uma implantação de modelo que possui capacidade de visão.

O SDK do Python pode ser instalado no terminal do Visual Studio Code usando:

pip install openai

No editor de código, podemos criar um arquivo Python, que contém o código do aplicativo. É importante ressaltar que você precisa da chave de recurso do Foundry, do endpoint e do nome do modelo implantado.

Observação

Quando você implanta um modelo na Foundry, ele tem um nome base ou original e um nome de implantação original que você atribui a ele. O Foundry hospeda o modelo implantado (por exemplo, modelos da classe GPT com visão) e fornece um ponto de extremidade.

No exemplo de código, você cria o cliente, aponta-o para o ponto de extremidade e passa o nome da implantação do modelo (o nome que deu ao modelo) como o MODEL_NAME.

import os

from openai import OpenAI

# Environment variables you set locally or in your app service:

FOUNDRY_KEY = "... your key ..."

ENDPOINT = "https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/"

MODEL_NAME = "your-model-deployment-name" # e.g., "gpt-4.1-mini" deployed as "my-vision-deploy"

client = OpenAI(

api_key=os.getenv("FOUNDRY_KEY"),

base_url=os.getenv("ENDPOINT"),

)

image_url = ""

response = client.responses.create(

model=os.getenv("MODEL_NAME"), # your deployment name

input=[

{

"role": "user",

"content": [

{"type": "input_text", "text": "What is in this image? Provide 3 bullet points."},

{"type": "input_image", "image_url": image_url}

],

}

],

)

print(response.output_text)

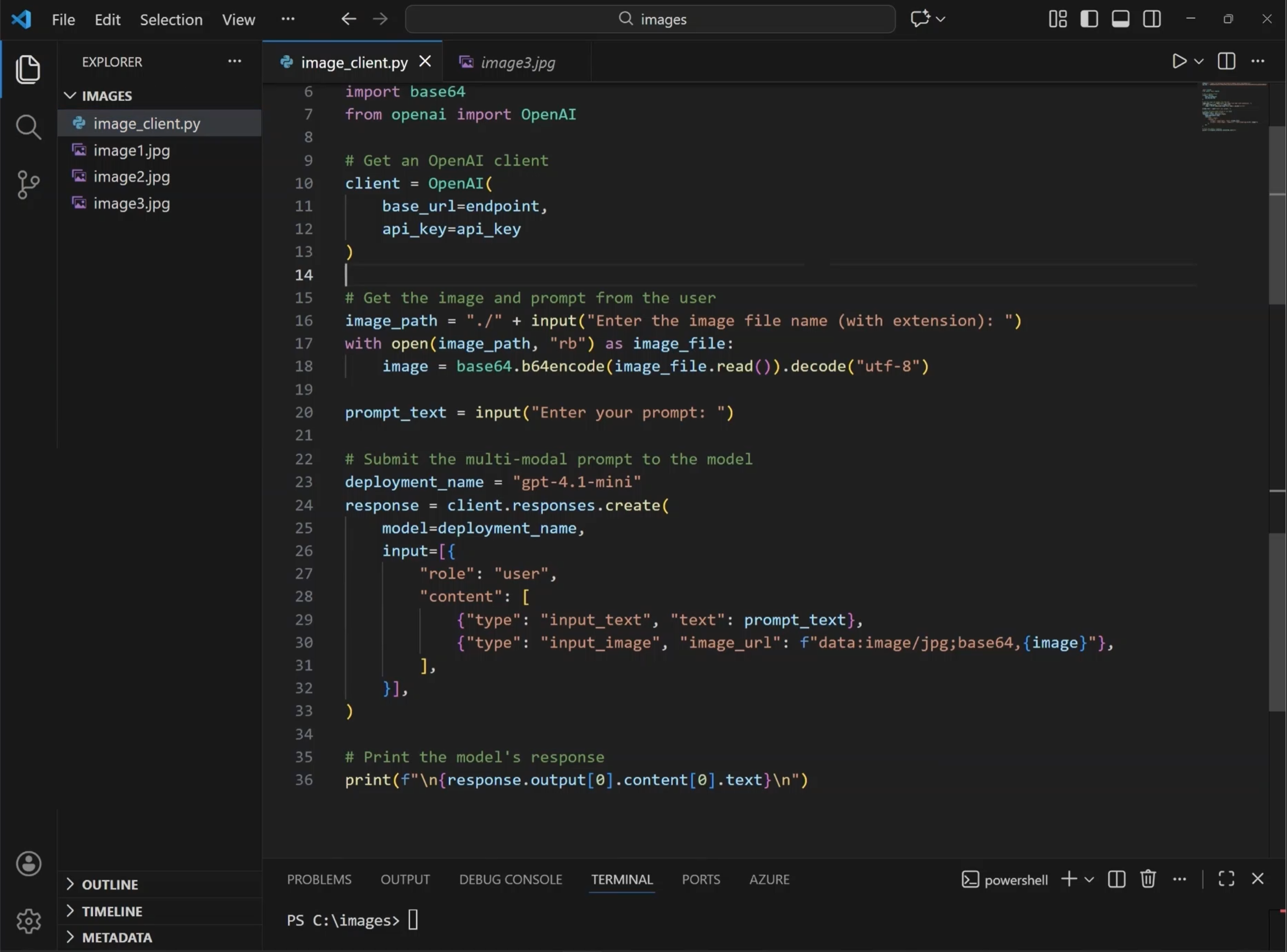

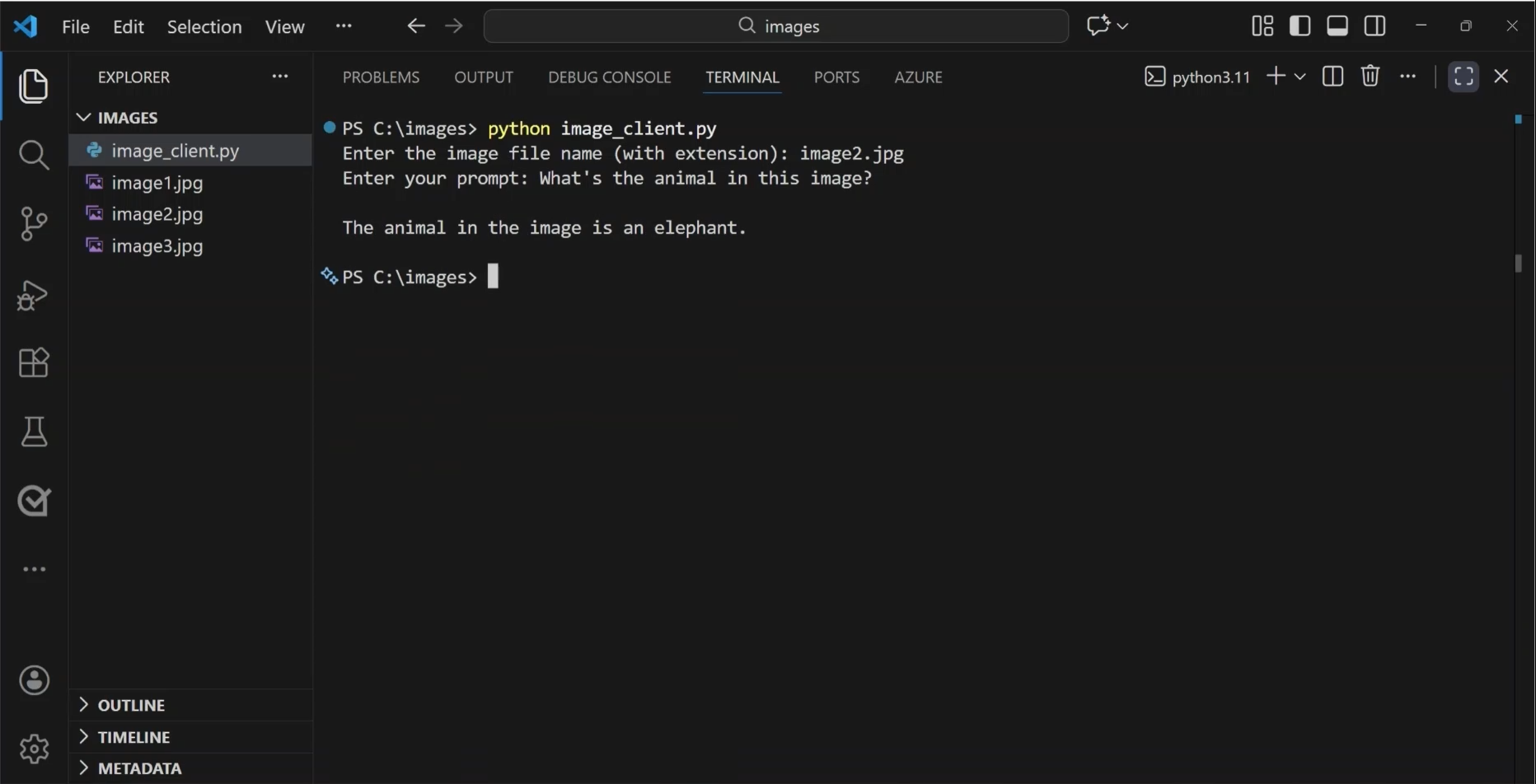

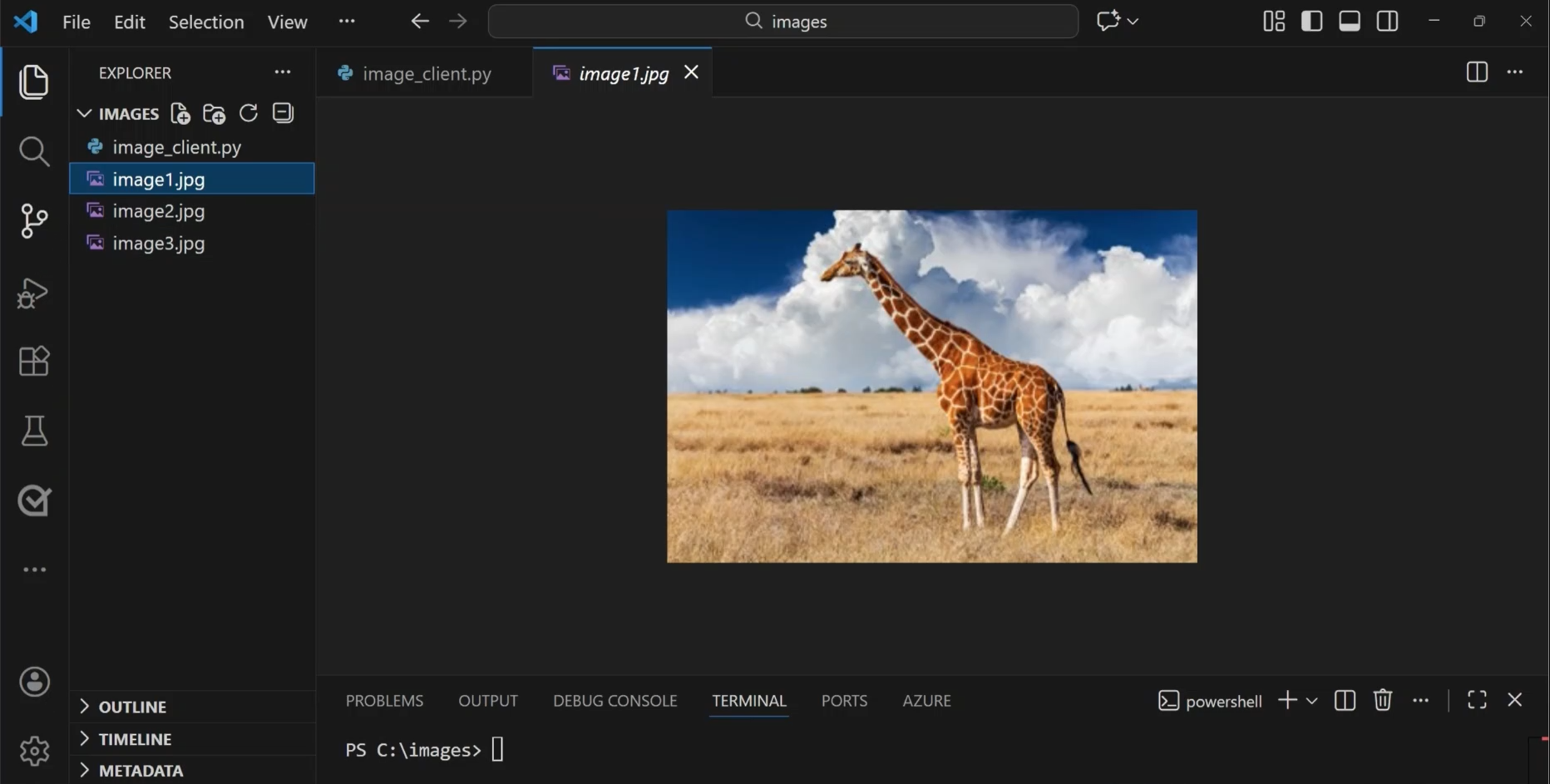

Exemplo de aplicativo cliente

Você pode criar um aplicativo personalizado que usa um modelo habilitado para visão para analisar uma imagem com o SDK do Python OpenAI. Por exemplo, suponha que você queira criar um aplicativo que possa identificar animais fotografados no Safari. Você pode carregar suas fotos e criar um arquivo Python em seu editor de código.

Em seguida, você pode escrever o código do aplicativo que usa a API OpenAI para se conectar ao endpoint do seu modelo no Foundry.

O código do aplicativo precisa carregar os dados da imagem e obter um prompt de linguagem natural de um usuário. Para enviar a entrada para o modelo, você precisa criar uma mensagem de várias partes que inclua os dados de imagem e de texto. O modelo pode responder com uma saída apropriada com base no texto e na imagem no prompt.

Em seguida, saiba como usar modelos do Foundry e o SDK do Azure OpenAI para geração de imagem.