Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Este tópico descreve como começar rapidamente com o acompanhamento ocular no MRTK, baseando-se em exemplos de acompanhamento ocular do MRTK (Assets/MRTK/Examples/Demos/EyeTracking). Esses exemplos permitem que você experimente uma de nossas novas funcionalidades mágicas de entrada: acompanhamento ocular! A demonstração inclui vários casos de uso, desde ativações implícitas baseadas em olhos até como combinar perfeitamente informações sobre o que você está olhando com entrada de voz e mão . Isso permite que os usuários selecionem e movam conteúdo holográfico rapidamente e sem esforço em sua exibição simplesmente olhando para um destino e dizendo "Selecionar" ou executando um gesto de mão. As demonstrações também incluem um exemplo de rolagem direcionada ao olhar, painel e zoom de texto e imagens em uma ardósia. Por fim, um exemplo é fornecido para gravar e visualizar a atenção visual do usuário em um slate 2D. Na seção a seguir, você encontrará mais detalhes sobre o que cada um dos diferentes exemplos no pacote de exemplo de acompanhamento ocular do MRTK (Assets/MRTK/Examples/Demos/EyeTracking) inclui:

![]()

A seção a seguir é uma visão geral rápida do que são as cenas de demonstração individuais de rastreamento ocular. As cenas de demonstração de acompanhamento ocular do MRTK são carregadas de forma aditiva, o que explicaremos abaixo como configurar.

Visão geral dos exemplos de demonstração de acompanhamento ocular

Seleção de destino com suporte para olhos

Este tutorial mostra a facilidade de acessar dados de foco ocular para selecionar destinos. Ele inclui um exemplo de comentários sutis, mas poderosos, para fornecer ao usuário a confiança de que um destino está focado sem ser esmagador. Além disso, há um exemplo simples de notificações inteligentes que desaparecem automaticamente após serem lidas.

Resumo: seleções de destino rápidas e sem esforço usando uma combinação de olhos, entrada de voz e mão.

Navegação com suporte para olhos

Imagine que você está lendo algumas informações sobre uma exibição distante ou seu e-reader e quando você chega ao final do texto exibido, o texto rola automaticamente para cima para revelar mais conteúdo. Ou que tal magicamente ampliar diretamente para onde você estava olhando? Esses são alguns dos exemplos mostrados neste tutorial sobre a navegação com suporte ocular. Além disso, há um exemplo para a rotação de mãos livres de hologramas 3D, fazendo com que eles girem automaticamente com base no foco atual.

Resumo: Rolagem, painel, zoom, rotação 3D usando uma combinação de olhos, entrada de voz e mão.

Posicionamento com suporte para olhos

Este tutorial mostra um cenário de entrada chamado Put-That-There que remonta à pesquisa do MIT Media Lab no início dos anos 1980 com entrada de olho, mão e voz. A ideia é simples: beneficie-se de seus olhos para seleção e posicionamento rápidos de destino. Basta olhar para um holograma e dizer 'coloque isso', olhe onde você quer colocá-lo e diga 'lá!'. Para posicionar o holograma com mais precisão, você pode usar entradas adicionais de suas mãos, voz ou controladores.

Resumo: posicionamento de hologramas usando olhos, entrada de voz e mão (arrastar e soltar). Controles deslizantes com suporte para os olhos usando olhos + mãos.

Visualização da atenção visual

Os dados baseados na aparência dos usuários são uma ferramenta imensamente poderosa para avaliar a usabilidade de um design e identificar problemas em fluxos de trabalho eficientes. Este tutorial discute diferentes visualizações de acompanhamento ocular e como elas se encaixam em diferentes necessidades. Fornecemos exemplos básicos para registro em log e carregamento de dados de rastreamento ocular e exemplos de como visualizá-los.

Resumo: mapa de atenção bidimensional (heatmaps) em ardósias. Gravando & reproduzindo dados de rastreamento ocular.

Configurando os exemplos de acompanhamento ocular do MRTK

Pré-requisitos

Observe que o uso dos exemplos de acompanhamento ocular no dispositivo requer um HoloLens 2 e um pacote de aplicativo de exemplo criado com a funcionalidade "Entrada de Foco" no AppXManifest do pacote.

Para usar esses exemplos de rastreamento ocular no dispositivo, siga estas etapas antes de criar o aplicativo no Visual Studio.

1. Carregar EyeTrackingDemo-00-RootScene.unity

O EyeTrackingDemo-00-RootScene é a cena base (raiz) que tem todos os componentes principais do MRTK incluídos. Esta é a cena que você precisa carregar primeiro e da qual você executará as demonstrações de rastreamento ocular. Ele apresenta um menu de cena gráfica que permite alternar facilmente entre os diferentes exemplos de acompanhamento ocular que serão carregados de forma aditiva.

![]()

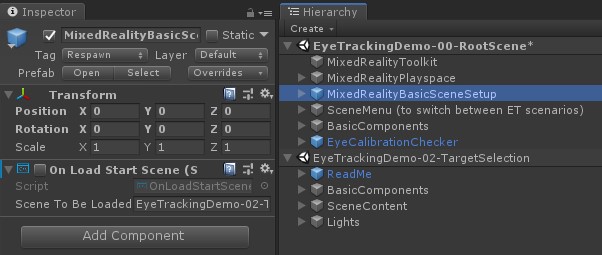

A cena raiz inclui alguns componentes principais que persistirão nas cenas carregadas aditivamente, como os perfis configurados do MRTK e a câmera de cena. O MixedRealityBasicSceneSetup (veja a captura de tela abaixo) inclui um script que carregará automaticamente a cena referenciada na inicialização. Por padrão, isso é EyeTrackingDemo-02-TargetSelection.

![]()

2. Adicionar cenas ao menu de build

Para carregar cenas aditivas durante o runtime, você deve adicionar essas cenas ao menu Configurações de Build –> Cenas no menu Compilar primeiro. É importante que a cena raiz seja mostrada como a primeira cena na lista:

![]()

3. Reproduzir os exemplos de acompanhamento ocular no editor do Unity

Depois de adicionar as cenas de rastreamento ocular às Configurações de Build e carregar o EyeTrackingDemo-00-RootScene, há uma última coisa que talvez você queira marcar: o script 'OnLoadStartScene' está anexado ao MixedRealityBasicSceneSetup GameObject habilitado? Isso é para que a cena raiz saiba qual cena de demonstração carregar primeiro.

![]()

Vamos rolar! Clique em "Reproduzir"! Você deve ver várias gemas aparecerem e o menu de cena na parte superior.

![]()

Você também deve observar um pequeno círculo semitransparente no centro da exibição do jogo. Isso atua como um indicador (cursor) do seu olhar simulado: basta pressionar o botão direito do mouse e mover o mouse para alterar sua posição. Quando o cursor estiver pairando sobre as gemas, você observará que ele será ajustado para o centro da joia exibida no momento. Essa é uma ótima maneira de testar se os eventos são disparados conforme o esperado ao "olhar" para um destino. Lembre-se de que o olhar simulado por meio do controle do mouse é um suplemento bastante ruim para nossos movimentos oculares rápidos e não intencionais. No entanto, é ótimo testar a funcionalidade básica antes de iterar no design implantando-a no dispositivo HoloLens 2. Voltando à nossa cena de exemplo de rastreamento ocular: a joia gira desde que seja vista e pode ser destruída por "olhar" para ela e ...

- Pressionando Enter (que simula dizer "select")

- Dizendo "selecionar" no microfone

- Ao pressionar Espaço para mostrar a entrada de mão simulada, clique no botão esquerdo do mouse para executar uma pitada simulada

Descrevemos com mais detalhes como você pode obter essas interações em nosso tutorial seleção de destino com suporte para olhos .

Ao mover o cursor para cima até a barra de menus superior na cena, você observará que o item focalizado no momento será realçado sutilmente. Você pode selecionar o item realçado no momento usando um dos métodos de commit descritos acima (por exemplo, pressionando Enter). Dessa forma, você pode alternar entre as diferentes cenas de exemplo de acompanhamento ocular.

4. Como testar sub-cenas específicas

Ao trabalhar em um cenário específico, talvez você não queira passar pelo menu de cena todas as vezes. Em vez disso, talvez você queira começar diretamente da cena em que está trabalhando no momento ao pressionar o botão Reproduzir . Sem problemas. Aqui está o que você pode fazer:

Carregar a cena raiz

Na cena raiz, desabilite o script 'OnLoadStartScene'

Arraste e solte uma das cenas de teste de acompanhamento ocular descritas abaixo (ou qualquer outra cena) para o modo de exibição Hierarquia , conforme mostrado na captura de tela abaixo.

Pressione Play

Observe que carregar a sub-cena como essa não é persistente: isso significa que, se você implantar seu aplicativo no dispositivo HoloLens 2, ele carregará apenas a cena raiz (supondo que ela apareça na parte superior das configurações de build). Além disso, quando você compartilha seu projeto com outras pessoas, as sub-cenas não são carregadas automaticamente.

Agora que você sabe como fazer com que as cenas de exemplo de acompanhamento ocular do MRTK funcionem, vamos continuar aprofundando-se em como selecionar hologramas com seus olhos: seleção de destino com suporte para olhos.