Примечание

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Внимание

Azure Content Moderator устарел по состоянию на февраль 2024 г. и будет прекращен 15 марта 2027 г. Она заменена безопасностью содержимого ИИ Azure, которая предлагает расширенные функции ИИ и улучшенную производительность.

Безопасность контента Azure AI — это комплексное решение, предназначенное для обнаружения вредного пользовательского и сгенерированного искусственным интеллектом контента в рамках приложений и служб. Безопасность содержимого ИИ Azure подходит для многих сценариев, таких как интернет-магазины, игровые компании, платформы социальных сообщений, корпоративные медиа-компании и поставщики решений для образования K-12. Ниже приведен обзор ее функций и возможностей.

- API обнаружения текста и изображений: сканировать текст и изображения для сексуального содержимого, насилия, ненависти и самоповредения с несколькими уровнями серьезности.

- Content Safety Studio: онлайн-инструмент, предназначенный для обработки потенциально оскорбительного, рискованного или нежелательного контента с помощью наших последних моделей машинного обучения для модерации контента. Этот инструмент предоставляет шаблоны и настраиваемые рабочие процессы, позволяющие пользователям разрабатывать собственные системы модерации контента.

- Поддержка языка: Безопасность контента ИИ Azure поддерживает более 100 языков и специально обучена для работы с английским, немецким, японским, испанским, французским, итальянским, португальским и китайским языками.

Служба безопасности содержимого Azure AI предоставляет надежное и гибкое решение для ваших потребностей в модерации контента. Переключившись с Content Moderator на безопасность содержимого ИИ Azure, вы можете воспользоваться новейшими инструментами и технологиями, чтобы гарантировать, что содержимое всегда модерировано до ваших точных спецификаций.

Узнайте больше о безопасности содержимого Azure ИИ и изучите, как она может повысить вашу стратегию модерации контента.

Azure Content Moderator — это служба ИИ, позволяющая управлять контентом, который может носить оскорбительный характер или представлять опасность либо нежелательным контентом иного рода. Она включает службу модерации контента на основе ИИ, которая позволяет проверять текст, изображения и видео, а также автоматически применять флаги содержимого.

Возможно, вы хотите создать программное обеспечение фильтрации содержимого в приложении, чтобы соответствовать нормативным требованиям или поддерживать предназначенную среду для пользователей.

Эта документация включает статьи следующих типов:

- Краткие руководства — инструкции по началу работы и отправке запросов в службу.

- Руководства — содержат инструкции для более специфического или специализированного использования службы.

- Статьи с основными понятиями — здесь подробно описываются функциональность и возможности службы.

Для более структурированного подхода следуйте модулю Обучения для Content Moderator.

- Общие сведения о Content Moderator

- Классифицируйте и модерируйте текст с помощью Azure Content Moderator

Где используется

Ниже приведены несколько сценариев, в которых разработчику программного обеспечения или команде требуется служба модерации контента:

- интернет-магазины с модерацией каталогов продукции и создаваемого пользователями содержимого;

- компании-разработчики игр, которые модерируют создаваемые пользователями игровые артефакты и чаты;

- социальные платформы для обмена сообщениями с модерацией изображений, текста и видео, добавляемых пользователями;

- корпоративные медиакомпании, внедряющие централизованную модерацию своего содержимого;

- поставщики образовательных решений K-12, фильтрующие неуместное содержимое для учащихся и преподавателей.

Внимание

Вы не можете использовать Content Moderator для проверки изображений на наличие сцен противозаконной эксплуатации детей. Уполномоченные организации могут использовать Облачную службу PhotoDNA для проверки такого рода контента.

Компоненты

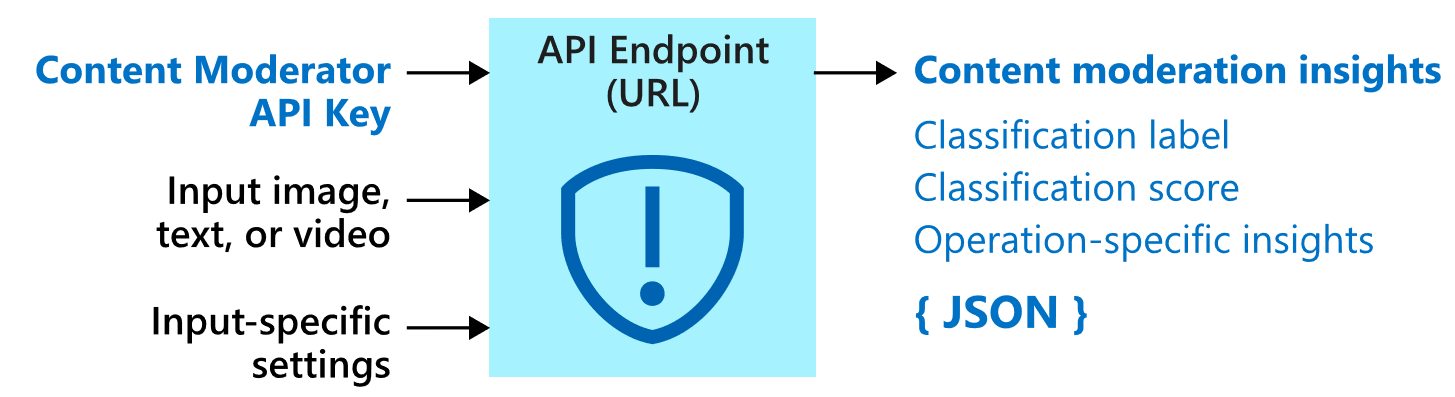

Служба Content Moderator состоит из нескольких API веб-службы, доступных через вызовы REST и пакет SDK для .NET.

API модерации

В службу Content Moderator входят API модерации, которые проверяют содержимое на наличие потенциально неприемлемых или нежелательных материалов.

Различные типы API модерации описаны в следующей таблице.

| Группа API | Описание |

|---|---|

| Модерация текста | Просматривает текст на наличие оскорбительного содержимого, содержимого сексуального или непристойного характера, содержимого с ненормативной лексикой и персональными данными. |

| Пользовательские списки терминов | Проверяет текст с использованием настраиваемого списка терминов наряду со встроенным списком. Используйте пользовательские списки для блокировки или разрешения содержимого в соответствии с собственными политиками содержимого. |

| Модерация изображений | Проверяет изображения на наличие непристойного содержимого или содержимого для взрослых, выявляет в изображениях текст с помощью функции распознавания текста, а также распознает лица. |

| Пользовательские списки изображений | Проверяет изображения с использованием пользовательского списка изображений. Используйте пользовательский список изображений для фильтрации экземпляров часто встречающегося содержимого, которое вы не хотите классифицировать еще раз. |

| Модерация видео | Проверяет видео на наличие непристойного содержимого или содержимого для взрослых и возвращает метки времени для указанного содержимого. |

Конфиденциальность и безопасность данных

Как и во всех службах ИИ Azure, разработчики, использующие службу Content Moderator, должны учитывать политики Майкрософт по данным клиентов. Дополнительные сведения см. на странице служб ИИ Azure в Центре управления безопасностью Майкрософт.

Следующие шаги

- Выполните краткое руководство по клиентской библиотеке или REST API, чтобы реализовать основные сценарии в коде.