Краткое руководство. Azure AI Content Safety Studio

В этом кратком руководстве описано, как приступить к работе со службой безопасности содержимого Azure с помощью Студии безопасности содержимого в браузере.

Внимание

Некоторые примеры содержимого, предоставляемые Content Safety Studio, могут быть оскорбительными. Примеры изображений по умолчанию размыты. Рекомендуется использовать усмотрение пользователя.

Необходимые компоненты

- Активная учетная запись Azure. Если у вас нет учетной записи, вы можете создать ее бесплатно.

- Ресурс Azure для обеспечения безопасности содержимого.

- Роль

Cognitive Services User, назначенная ресурсу безопасности содержимого в требуемой подписке Azure. - Войдите в Content Safety Studio с помощью подписки Azure и ресурса безопасности контента.

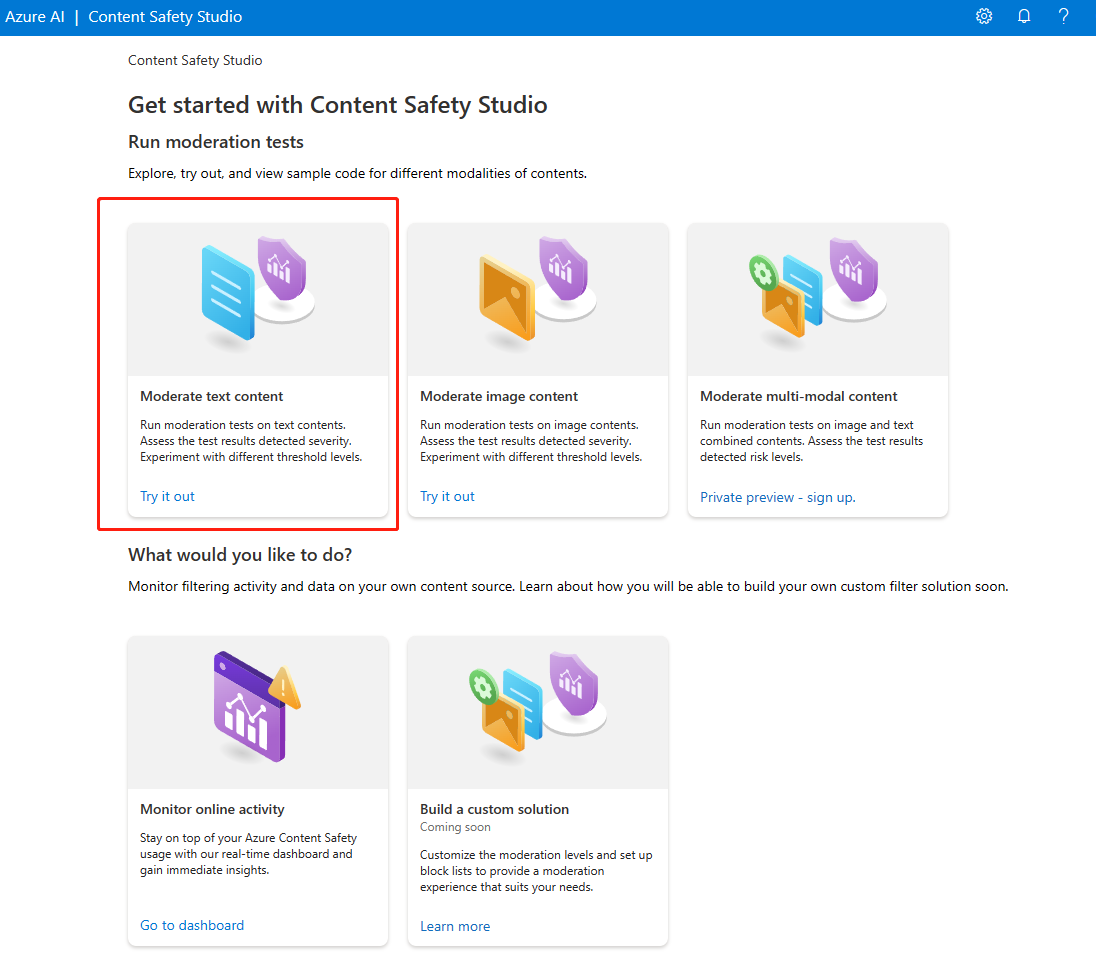

Анализ текстового содержимого

Страница "Умеренное текстовое содержимое" позволяет быстро попробовать модерацию текста.

- Выберите панель "Умеренное текстовое содержимое".

- Добавьте текст в поле ввода или выделите пример текста на панели на странице.

Совет

Размер текста и степень детализации

См . сведения о требованиях к входным данным для ограничений максимальной длины текста.

- Выберите Запустить тест.

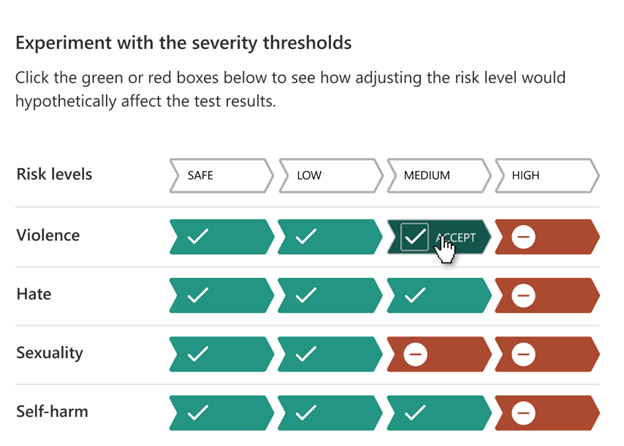

Служба возвращает все обнаруженные категории с уровнем серьезности для каждого(0-Safe, 2-Low, 4-Medium, 6-High). Он также возвращает двоичный результат "Принято отклонено/" на основе настроенных фильтров. Используйте матрицу на вкладке "Настройка фильтров" справа, чтобы задать допустимые или запрещенные уровни серьезности для каждой категории. Затем вы можете снова запустить текст, чтобы узнать, как работает фильтр.

Вкладка "Использовать блок-список " справа позволяет создавать, изменять и добавлять список блокировок в рабочий процесс модерации. Если при выполнении теста включен список блокировок, в разделе "Результаты" вы получите панель обнаружения списка блокировок. Он сообщает о любых совпадениях со списком блокировок.

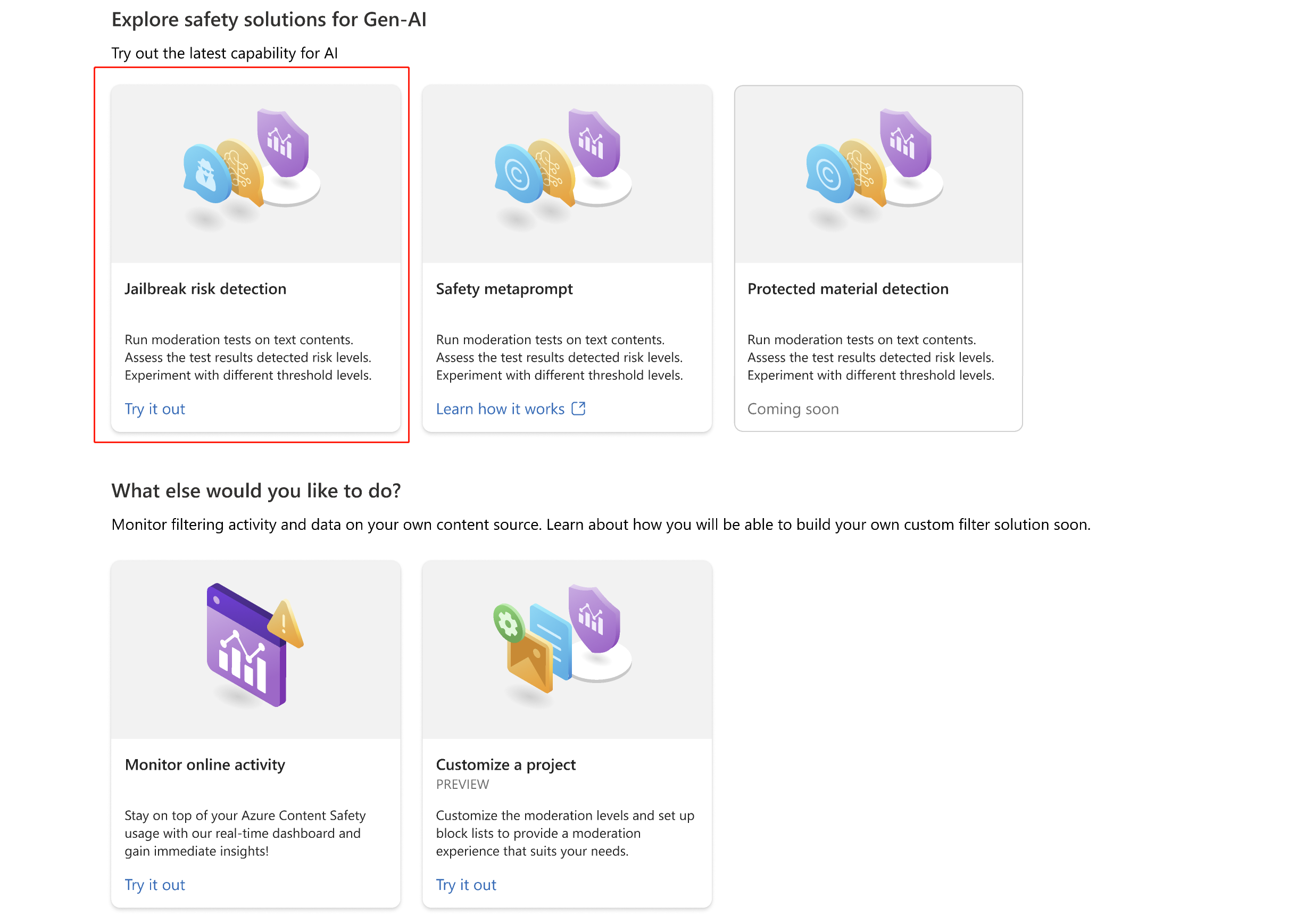

Обнаружение атак ввода пользователем

Панель "Экраны запросов" позволяет попробовать обнаружение рисков ввода пользователем. Обнаружение запросов пользователей, предназначенных для того, чтобы спровоцировать модель генерированного ИИ на отображение поведения, которое было обучено, чтобы избежать или нарушить набор правил, заданных в системном сообщении. Эти атаки могут отличаться от сложных ролей до тонкой подражания цели безопасности.

- Выберите панель "Экраны запроса".

- Выберите пример текста на странице или введите собственное содержимое для тестирования. Вы также можете отправить CSV-файл для выполнения пакетного теста.

- Выберите Запустить тест.

Служба возвращает флаг риска и тип для каждого примера.

Дополнительные сведения см. в концептуальном руководстве по экранированию запросов.

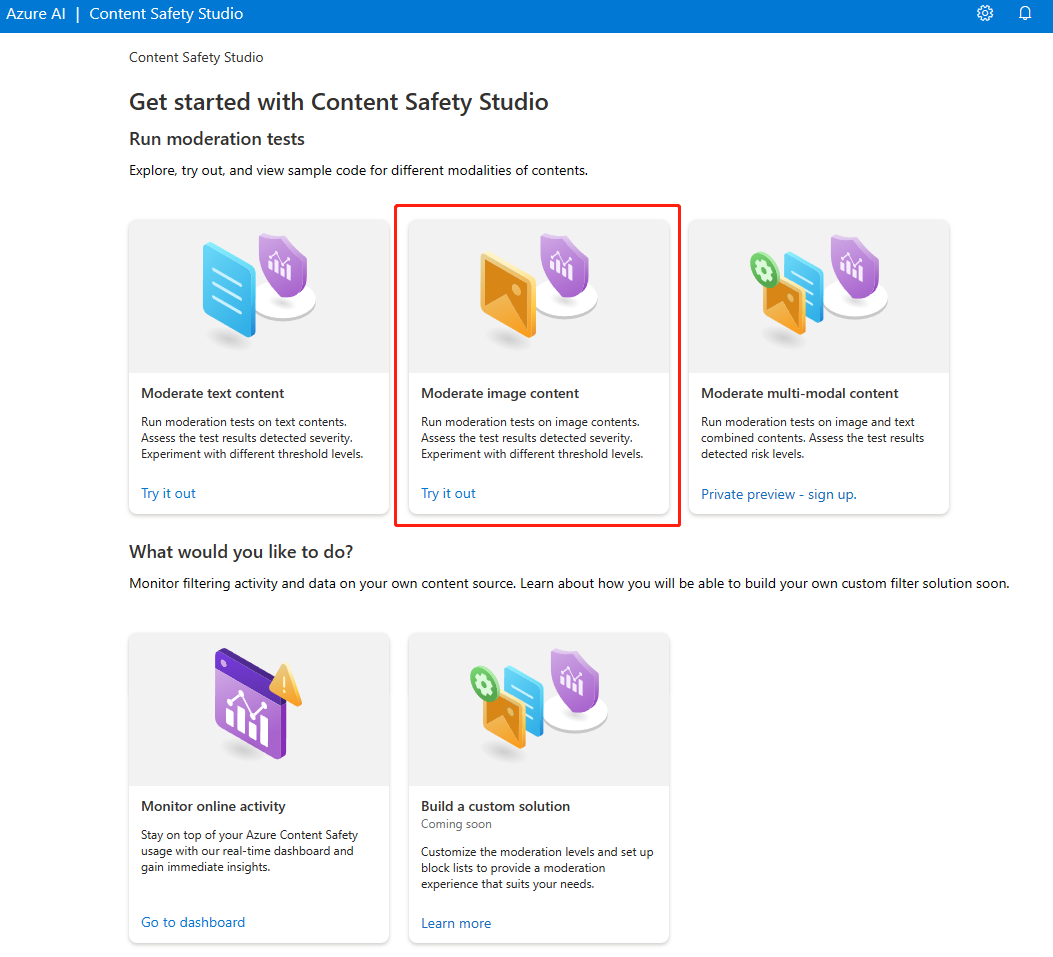

Анализ графического содержимого

Страница содержимого умеренного изображения предоставляет возможность быстро попробовать модерацию изображений.

- Выберите панель содержимого умеренного изображения.

- Выберите образ из панелей на странице или отправьте собственное изображение. Максимальный размер отправки изображений составляет 4 МБ, а размеры изображения должны составлять от 50 x 50 пикселей до 2 048 x 2048 пикселей. Изображения могут быть в форматах JPEG, PNG, GIF, BMP, TIFF или WEBP.

- Выберите Запустить тест.

Служба возвращает все обнаруженные категории с уровнем серьезности для каждого(0-Safe, 2-Low, 4-Medium, 6-High). Он также возвращает двоичный результат "Принято отклонено/" на основе настроенных фильтров. Используйте матрицу на вкладке "Настройка фильтров" справа, чтобы задать допустимые или запрещенные уровни серьезности для каждой категории. Затем вы можете снова запустить текст, чтобы узнать, как работает фильтр.

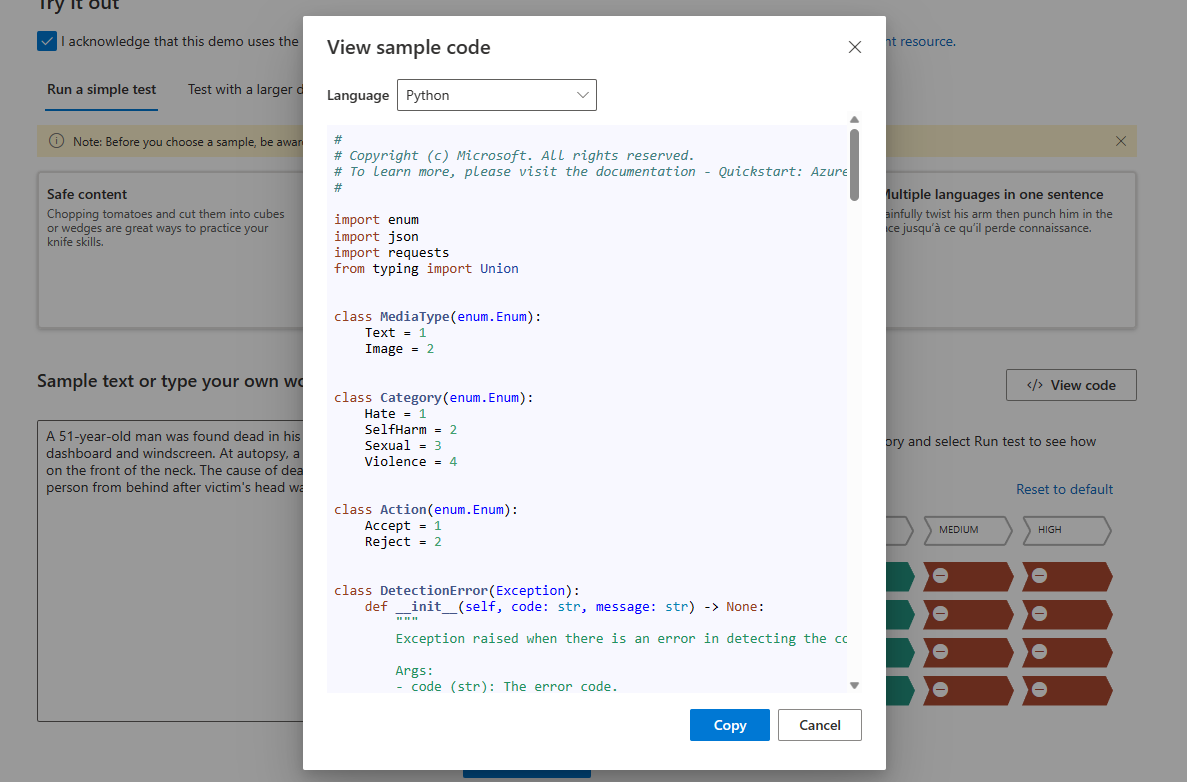

Просмотр и экспорт кода

Вы можете использовать функцию представления кода как в анализе текстового содержимого, так и на странице содержимого изображения для просмотра и копирования примера кода, включающего конфигурацию для фильтрации серьезности, блок-списков и функций модерации. Затем вы можете развернуть код в конце.

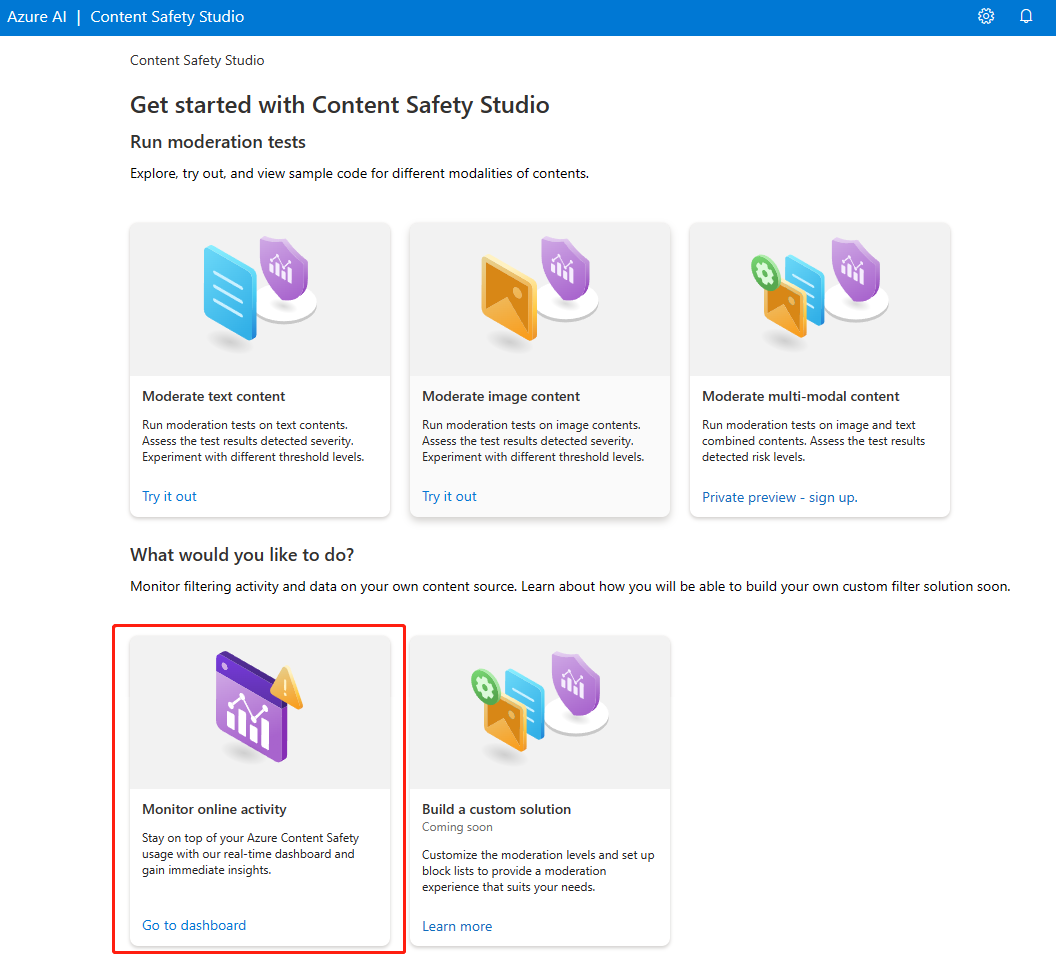

Мониторинг активности в Интернете

Страница "Мониторинг онлайн- действий " позволяет просматривать тенденции использования и использования API.

Вы можете выбрать тип носителя для отслеживания. Можно также указать диапазон времени, который требуется проверить, выбрав "Показать данные" для последнего ___.

На диаграмме "Отклонение " для каждой категории можно также настроить пороговые значения серьезности для каждой категории.

Вы также можете изменить списки блокировок, если вы хотите изменить некоторые термины на основе диаграммы 10 заблокированных терминов .

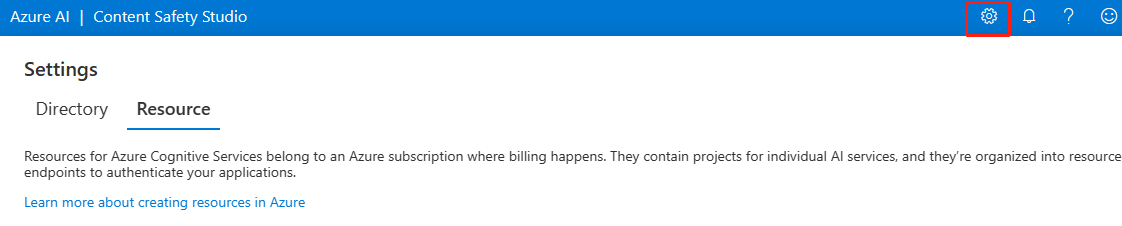

Управление ресурсом

Чтобы просмотреть сведения о ресурсах, например имя и ценовую категорию, щелкните значок "Параметры " в правом верхнем углу домашней страницы Content Safety Studio и перейдите на вкладку "Ресурс ". Если у вас есть другие ресурсы, вы также можете переключить ресурсы здесь.

Очистка ресурсов

Если вы хотите очистить и удалить ресурс служб искусственного интеллекта Azure, можно удалить ресурс или группу ресурсов. При удалении группы ресурсов также удаляются все связанные с ней ресурсы.

Следующие шаги

Затем начните использовать безопасность содержимого ИИ Azure с помощью REST API или клиентского пакета SDK, чтобы вы могли легко интегрировать службу в приложение.

Обратная связь

Ожидается в ближайшее время: в течение 2024 года мы постепенно откажемся от GitHub Issues как механизма обратной связи для контента и заменим его новой системой обратной связи. Дополнительные сведения см. в разделе https://aka.ms/ContentUserFeedback.

Отправить и просмотреть отзыв по