Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Из этой статьи вы узнаете, какие параметры доступны для записи запросов к базовым моделям и их отправки в конечную точку обслуживания модели. Вы можете запросить базовые модели, размещенные в Databricks и базовых моделях, размещенных за пределами Databricks.

Для традиционных запросов к моделям машинного обучения или Python см. конечные точки обслуживания запросов для пользовательских моделей.

Мозаичная служба моделей ИИ поддерживает API-интерфейсы ивнешние модели для доступа к базовым моделям. Служба моделей использует унифицированный API, совместимый с OpenAI, и пакет SDK для их запроса. Это позволяет экспериментировать с настройкой базовых моделей для использования в производственной среде в поддерживаемых облаках и у поставщиков.

Параметры запроса

Служба модели ИИ мозаики предоставляет следующие варианты отправки запросов конечным точкам, которые служат базовым моделям:

| Метод | Сведения |

|---|---|

| Клиент OpenAI | Выполните запрос к модели, размещенной на конечной точке обслуживания модели ИИ Mosaic, используя клиент OpenAI. Укажите имя конечной точки службы модели в качестве входных model данных. Поддерживается для чата, внедрения и завершения моделей, предоставляемых API-интерфейсами модели Foundation или внешними моделями. |

| Функции ИИ | Вызов вывода модели непосредственно из SQL с помощью ai_query функции SQL.

См. пример. Запрос базовой модели. |

| Обслуживающий пользовательский интерфейс | Выберите конечную точку запроса на странице конечной точки обслуживания . Вставьте входные данные модели формата JSON и нажмите кнопку "Отправить запрос". Если в модели есть входной пример, используйте команду Show Example для загрузки. |

| REST API | Вызов и запрос модели с помощью REST API. Дополнительные сведения см. в разделе POST /обслуживающие конечные точки/{name}/invocations . Сведения о оценке запросов к конечным точкам, обслуживающим несколько моделей, см. в разделе "Запрос отдельных моделей" за конечной точкой. |

| Пакет SDK для развертываний MLflow | Используйте функцию predict() из SDK MLflow Deployments для запроса модели. |

| SDK Databricks для Python | Пакет SDK для Python Databricks — это слой на вершине REST API. Он обрабатывает низкоуровневые сведения, такие как проверка подлинности, что упрощает взаимодействие с моделями. |

Требования

- Конечная точка обслуживания модели.

- Рабочая область Databricks в поддерживаемом регионе.

- Чтобы отправить запрос оценки через клиент OpenAI, REST API или SDK для развертывания MLflow, необходимо иметь токен API Databricks.

Внимание

В качестве передовой практики безопасности для производственных сценариев Databricks рекомендует использовать машинные OAuth токены для проверки подлинности в производственной среде.

Для тестирования и разработки Databricks рекомендует использовать личный маркер доступа, принадлежащий субъектам-службам , а не пользователям рабочей области. Сведения о создании маркеров для субъектов-служб см. в разделе "Управление маркерами" для субъекта-службы.

Установка пакетов

После выбора метода запроса необходимо сначала установить соответствующий пакет в кластер.

Клиент OpenAI

Чтобы использовать клиент OpenAI, в вашем кластере необходимо установить пакет databricks-openai. Этот пакет предоставляет клиент OpenAI с автоматической настройкой авторизации, чтобы запрашивать генеративные модели ИИ. Выполните следующую команду в записной книжке или локальном терминале:

pip install -U databricks-openai

Дальнейшие шаги необходимы только если пакет устанавливается в тетради Databricks.

dbutils.library.restartPython()

REST API

Доступ к REST API Сервиса предоставляется в Databricks Runtime для машинного обучения.

Пакет SDK для развертываний MLflow

!pip install mlflow

Дальнейшие шаги необходимы только если пакет устанавливается в тетради Databricks.

dbutils.library.restartPython()

Пакет SDK Python Databricks

Пакет SDK Databricks для Python уже установлен во всех кластерах Azure Databricks, использующих Databricks Runtime 13.3 LTS или более поздней версии. Для кластеров Azure Databricks, использующих Databricks Runtime 12.2 LTS и ниже, сначала необходимо установить пакет SDK Databricks для Python. См. пакет SDK Databricks для Python.

Типы моделей Foundation

В следующей таблице перечислены поддерживаемые базовые модели на основе типа задачи.

Внимание

Мета-Ллома-3.1-405B-Instruct будет выведен из эксплуатации,

- Начиная с 15 февраля 2026 г. для рабочих нагрузок с оплатой за токен.

- Для рабочих нагрузок с заданной пропускной способностью начиная с 15 мая 2026 г.

Ознакомьтесь с моделями, снятыми с производства для получения рекомендаций по выбору модели замены и миграции в процессе вывода из эксплуатации.

| Тип задачи | Описание | Поддерживаемые модели | Когда использовать? Рекомендуемые варианты использования |

|---|---|---|---|

| Общее назначение | Модели, предназначенные для понимания и участия в естественных, многоэтапных беседах. Они настраиваются на больших наборах данных человеческого диалога, что позволяет им создавать контекстно релевантные ответы, отслеживать историю общения и обеспечивать согласованное, человеческое взаимодействие по различным темам. | Ниже приведены поддерживаемые базовые модели Databricks:

Ниже поддерживаются внешние модели:

|

Рекомендуется для сценариев, когда необходимы естественный, многоэтапный диалог и контекстное понимание.

|

| Внедрение | Модели внедрения — это системы машинного обучения, которые преобразуют сложные данные, такие как текст, изображения или звук, в компактные числовые векторы, называемые внедрением. Эти векторы фиксируют основные функции и связи в данных, позволяя эффективно сравнивать, кластеризировать и семантический поиск. | Ниже перечислены поддерживаемые Databricks модели основного уровня: Ниже поддерживаются внешние модели:

|

Рекомендуется для приложений, где необходимо понимать семантику, сравнение сходства и эффективное извлечение или кластеризацию сложных данных:

|

| Зрение | Модели, предназначенные для обработки, интерпретации и анализа визуальных данных, таких как изображения и видео, чтобы компьютеры могли "видеть" и понимать визуальный мир. | Ниже приведены поддерживаемые базовые модели Databricks:

Ниже поддерживаются внешние модели:

|

Рекомендуется, когда требуется автоматизированный, точный и масштабируемый анализ визуальных сведений:

|

| Рассуждение | Расширенные системы искусственного интеллекта, предназначенные для имитации логического мышления человека. Модели рассуждений интегрируют такие методы, как символьная логика, вероятностная логика и нейронные сети для анализа контекста, разбиения задач и объяснения их принятия решений. | Ниже перечислены поддерживаемые Databricks модели основного уровня:

Ниже поддерживаются внешние модели:

|

Рекомендуется, когда требуется автоматизированный, точный и масштабируемый анализ визуальных сведений:

|

Вызов функции

Вызов функций Databricks совместим с OpenAI и доступен только во время работы модели в рамках API-интерфейсов модели Foundation и обслуживания конечных точек, которые служат внешним моделям. Дополнительные сведения см. в разделе "Функция", вызываемая в Azure Databricks.

Структурированные выходные данные

Структурированные выходные данные совместимы с OpenAI и доступны только во время работы модели в рамках API-интерфейсов модели Foundation. Дополнительные сведения см. в разделе "Структурированные выходные данные" в Azure Databricks.

Кэширование запросов

Кэширование запросов поддерживается для моделей Claude, размещенных в Databricks, в рамках API-интерфейсов модели Foundation.

Вы можете указать параметр cache_control в запросах, чтобы кэшировать следующее:

- Сообщения с текстовым содержанием в массиве

messages.content. - Анализ содержания сообщений в массиве

messages.content. - Блоки содержимого изображений в массиве

messages.content. - Использование инструментов, результаты и определения в массиве

tools.

См. справочник по REST API модели Foundation.

ТекстовоеСодержимое

{

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "What's the date today?",

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

ПричинаКонтент

{

"messages": [

{

"role": "assistant",

"content": [

{

"type": "reasoning",

"summary": [

{

"type": "summary_text",

"text": "Thinking...",

"signature": "[optional]"

},

{

"type": "summary_encrypted_text",

"data": "[encrypted text]"

}

]

}

]

}

]

}

ImageContent

Содержимое сообщения изображения должно использовать закодированные данные в качестве источника. URL-адреса не поддерживаются.

{

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "What’s in this image?"

},

{

"type": "image_url",

"image_url": {

"url": "data:image/jpeg;base64,[content]"

},

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

Содержимое вызова инструмента

{

"messages": [

{

"role": "assistant",

"content": "Ok, let’s get the weather in New York.",

"tool_calls": [

{

"type": "function",

"id": "123",

"function": {

"name": "get_weather",

"arguments": "{\"location\":\"New York, NY\"}"

},

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

Замечание

REST API Databricks совместим с OpenAI и отличается от anthropic API. Эти различия также влияют на объекты отклика, как показано ниже.

- Вывод возвращается в поле

choices. - Формат блока потоковой передачи. Все блоки соответствуют одному и тому же формату, где

choicesсодержит ответdeltaи информация об использовании возвращается в каждом блоке. - Причина остановки возвращается в поле

finish_reason.- Anthropic использует:

end_turn,stop_sequence,max_tokens, иtool_use - Соответственно, Databricks использует:

stop,stopиlengthtool_calls

- Anthropic использует:

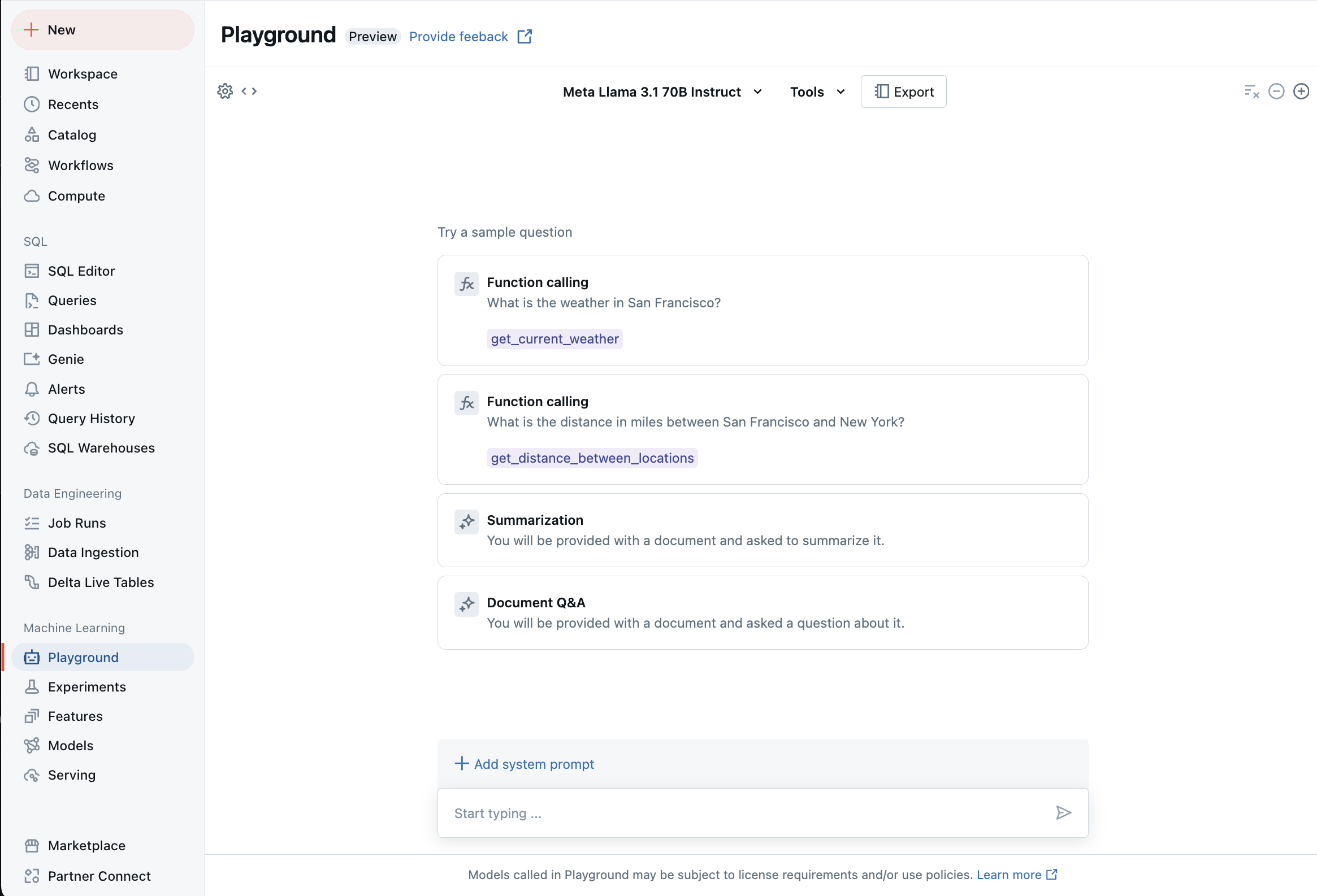

Чат с поддерживаемыми LLM с помощью ИИ-площадки

Вы можете взаимодействовать с поддерживаемыми крупными языковыми моделями с помощью игровой площадки ИИ. Платформа искусственного интеллекта — это среда чата, в которой можно тестировать, запрашивать и сравнивать LLM из рабочей области Azure Databricks.

Дополнительные ресурсы

- Следите за обслуживаемыми моделями с помощью таблиц инференции, поддерживающих шлюз Unity AI

- Развернуть конвейеры пакетного вывода

- API модели Databricks Foundation

- Внешние модели в Mosaic AI Model Serving

- Руководство. Создание конечных точек внешней модели для запроса моделей OpenAI

- Модели баз данных, размещенные в Databricks, доступные в API-интерфейсах модели Foundation

- Справочник по REST API модели Foundation