Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

ОБЛАСТЬ ПРИМЕНЕНИЯ: Расширение машинного обучения Azure CLI версии 2 (current)

Расширение машинного обучения Azure CLI версии 2 (current) Python SDK azure-ai-ml версии 2 (current)

Python SDK azure-ai-ml версии 2 (current)

Ответственный искусственный интеллект (ответственный ИИ) — это подход к разработке, оценке и развертыванию систем искусственного интеллекта безопасно, этически и с доверием. Системы искусственного интеллекта результаты многих решений, принятых их создателями. Ответственный ИИ помогает управлять этими решениями — от определения системного назначения к взаимодействию с пользователем— к более полезным и справедливым результатам. Он держит людей и их цели в центре проектирования и уважает такие ценности, как справедливость, надежность и прозрачность.

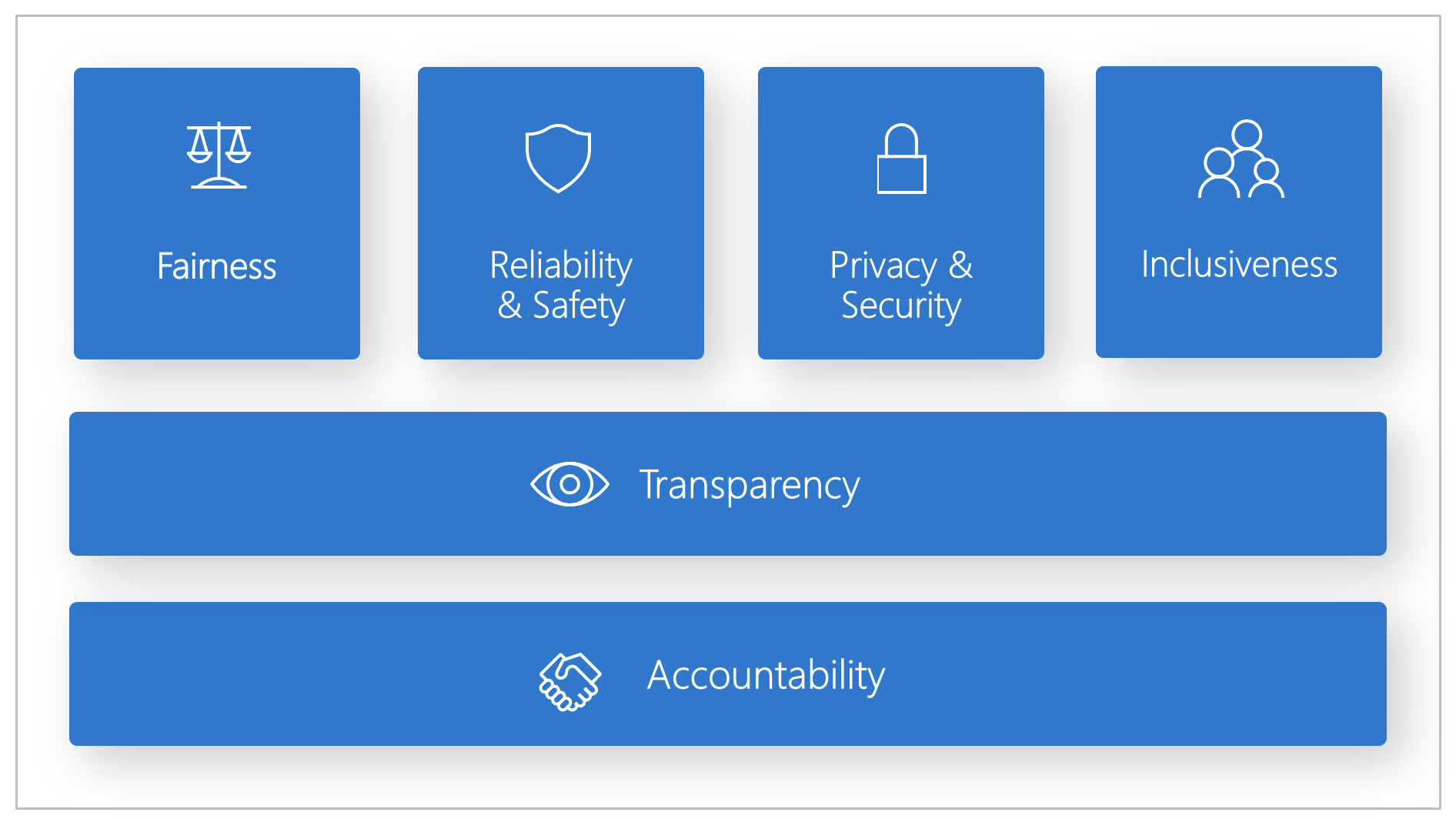

Корпорация Майкрософт создала ответственный стандарт ИИ, платформу для создания систем ИИ на основе шести принципов: справедливости, надежности и безопасности, конфиденциальности и безопасности, инклюзивности, прозрачности и подотчетности. Эти принципы являются основой ответственного и надежного подхода к ИИ, особенно поскольку интеллектуальная технология становится более распространенной в повседневной продукции и услугах.

В этой статье объясняется, как Машинное обучение Azure предоставляет средства, помогающие разработчикам и специалистам по обработке и анализу данных реализовать и реализовать эти шесть принципов.

Справедливость и инклюзивность

Системы искусственного интеллекта должны справедливо относиться ко всем и не влиять на аналогичные группы по-разному. Например, если системы искусственного интеллекта предоставляют рекомендации по медицинскому лечению, заявкам на кредит или трудоустройству, они должны делать те же рекомендации для людей с похожими симптомами, финансовыми обстоятельствами или квалификацией.

Справедливость и инклюзивность в Машинном обучении Azure: компонент оценки справедливостипанели мониторинга ответственного искусственного интеллекта помогает оценить справедливость модели в таких группах, как пол, этнический характер, возраст и другие характеристики.

Надежность и защита

Для создания доверия системы ИИ должны работать надежно, безопасно и согласованно. Они должны функционировать как разработанные, безопасно реагировать на непредвиденные условия и противостоять вредной манипуляции. Их поведение и способность обрабатывать различные условия отражают диапазон ситуаций, ожидаемых разработчикам во время проектирования и тестирования.

Надежность и безопасность в Машинном обучении Azure: компонент анализа ошибок панели мониторинга ответственного искусственного интеллекта помогает вам:

- получить глубокое представление о распределении сбоев для модели;

- определить когорты (подмножества) данных с более высокой частотой ошибок, чем определяет общий тест производительности.

Эти несоответствия могут возникать, когда система или модель недоимки для определенных демографических групп или для редко наблюдаемых условий ввода в обучающих данных.

Прозрачность

Когда системы искусственного интеллекта сообщают о решениях, влияющих на жизнь людей, очень важно, чтобы люди понимали, как эти решения принимаются. Например, банк может использовать систему искусственного интеллекта, чтобы решить, является ли человек кредитоспособным, или компания может использовать его для выбора кандидатов на работу.

Важной частью прозрачности является интерпретация: предоставление полезных объяснений поведения системы ИИ. Улучшение интерпретации помогает заинтересованным лицам понять, как и почему работают системы искусственного интеллекта, чтобы они могли выявлять проблемы с производительностью, проблемы справедливости, практики исключения или непредвиденные результаты.

Прозрачность в машинном обучении Azure: интерпретируемость модели и контрфакционная функция,что если компоненты панели мониторинга ответственного искусственного интеллекта помогают создавать понятные для человека описания прогнозов моделей.

Компонент интерпретируемости модели предоставляет несколько представлений в поведении модели:

- Глобальные объяснения. Например, какие признаки влияют на общее поведение модели распределения кредита?

- Локальные объяснения. Например, почему заявление о кредите клиента утверждено или отклонено?

- Объяснения по модели для выбранной когорты или выбранных точек данных. Например, какие признаки влияют на общее поведение модели распределения кредита для лиц с низким доходом?

Компонент counterfactual what-if помогает понять и отладить модель машинного обучения, показывая, как она реагирует на изменения функций и возмущения.

Машинное обучение Azure также поддерживает систему показателей ответственного ИИ. Системы показателей — это настраиваемый PDF-отчет, который разработчики могут настраивать, создавать, скачивать и делиться ими с техническими и не техническими заинтересованными лицами. Это помогает обучить заинтересованным лицам сведения о наборе данных и работоспособности модели, достичь соответствия требованиям и доверия к сборке. Схема показателей также может поддерживать проверки аудита, показыв характеристики модели машинного обучения.

Конфиденциальность и безопасность

По мере того как ИИ становится более распространенным, защита конфиденциальности и защита личной и бизнес-информации является более важной и сложной. Конфиденциальность и безопасность данных требуют пристального внимания, так как системам искусственного интеллекта требуются данные для принятия точных прогнозов и решений. Системы ИИ должны соответствовать законам о конфиденциальности, которые:

- требуют прозрачности сбора, использования и хранения данных;

- требуют, чтобы у потребителей имелись соответствующие средства, позволяющие контролировать выбор способа использования своих данных.

Конфиденциальность и безопасность в Машинном обучении Azure. Машинное обучение Azure позволяет администраторам и разработчикам создавать безопасные конфигурации , соответствующие политикам компании. С помощью Машинного обучения Azure и платформы Azure вы можете:

- ограничение доступа к ресурсам и операциям по учетным записям или группам пользователей;

- ограничение входящих и исходящих сетевых подключений;

- шифрование передаваемых и неактивных данных;

- проверка на уязвимости;

- применение политик конфигурации и их аудит.

Корпорация Майкрософт также создала два пакета с открытым кодом для реализации принципов конфиденциальности и безопасности:

SmartNoise: Дифференциальная конфиденциальность — это набор систем и рекомендаций, которые помогают обеспечить безопасность и конфиденциальность данных частных лиц. В решениях машинного обучения для обеспечения соответствия нормативным требованиям может потребоваться дифференциальная конфиденциальность. SmartNoise — это проект с открытым кодом (в разработке которого также участвует корпорация Майкрософт), содержащий компоненты для создания глобальных систем с дифференциальной конфиденциальностью.

Counterfit — это проект с открытым кодом, который включает в себя средство командной строки и универсальный уровень автоматизации, позволяющие разработчикам моделировать кибератаки на системы ИИ. Любой пользователь может скачать это средство и развернуть его с помощью Azure Cloud Shell для запуска в браузере или развернуть его локально в среде Python Anaconda. Это средство может оценивать модели ИИ, размещенные в различных облачных средах, локальной среде или в пограничной среде. Оно не зависит от моделей ИИ и поддерживает различные типы данных, включая текст, изображения и универсальные входные данные.

Отчетность

Люди, которые разрабатывают и развертывают системы ИИ, должны отвечать за то, как эти системы работают. Организации должны использовать отраслевые стандарты для разработки норм подотчетности. Эти нормы помогают гарантировать, что системы ИИ не являются окончательным органом по решениям, влияющим на жизнь людей, и что люди поддерживают значимый контроль над высоко автономными системами.

Подотчетность в Машинном обучении Azure: операции машинного обучения (MLOps) основаны на принципах и методиках DevOps, которые повышают эффективность рабочего процесса ИИ. Машинное обучение Azure предоставляет следующие возможности MLOps для повышения подотчетности:

- Регистрация, создание пакетов и развертывание моделей из любого места. Также можно отслеживать связанные метаданные, необходимые для использования модели.

- Фиксация данных управления для комплексного жизненного цикла машинного обучения. Записанные в журнал данные о происхождении могут включать пользователей, которые публикуют модели, причины внесения изменений и время развертывания или использования моделей в рабочей среде.

- Уведомление и оповещение о событиях в жизненном цикле машинного обучения, Примеры включают выполнение эксперимента, регистрацию модели, развертывание модели и обнаружение смещения данных.

- Отслеживайте приложения на наличие операционных проблем и проблем, связанных с машинным обучением. Сравнивайте входные данные модели при обучении и выводе, изучайте метрики, зависящие от модели, и предоставляйте возможности мониторинга и оповещения в инфраструктуре машинного обучения.

Кроме того, система показателей ответственного искусственного интеллекта в Машинном обучении Azure создает ответственность, обеспечивая взаимодействие между заинтересованными лицами. В системе показателей разработчики могут настраивать, скачивать и обмениваться аналитическими сведениями о работоспособности моделей как с техническими, так и не техническими заинтересованными лицами. Совместное использование этих аналитических сведений помогает создавать доверие.

Машинное обучение Azure также поддерживает принятие решений путем информирования бизнес-решений с помощью:

- Аналитические сведения, управляемые данными, которые помогают заинтересованным лицам понимать причинно-следственные последствия для результатов, использующих только исторические данные. Например, "Как бы медицина повлияла на кровяное давление пациента?" Эти аналитические сведения получены из компонента причинного выводапанели мониторинга ответственного искусственного интеллекта.

- Аналитические сведения, управляемые моделью, которые отвечают на вопросы пользователей (например, "Что можно сделать, чтобы получить другой результат от вашего ИИ в следующий раз?"), чтобы они могли принять меры. Эти аналитические сведения предоставляются с помощью компонента counterfactual what-ifпанели мониторинга ответственного искусственного интеллекта.

Следующие шаги

- Дополнительные сведения о реализации принципов ответственного применения ИИ в Машинном обучении Azure см. в разделе Панель мониторинга ответственного применения ИИ.

- Узнайте, как создать панель мониторинга ответственного ИИ с помощью CLI и пакета SDK или пользовательского интерфейса Студии Машинного обучения Azure.

- Узнайте, как создать систему показателей ответственного ИИ на основе аналитических сведений, наблюдаемых на панели мониторинга ответственного ИИ.

- Узнайте о стандарте ответственного ИИ для создания систем ИИ в соответствии с шестью ключевыми принципами.