Not

Bu sayfaya erişim yetkilendirme gerektiriyor. Oturum açmayı veya dizinleri değiştirmeyi deneyebilirsiniz.

Bu sayfaya erişim yetkilendirme gerektiriyor. Dizinleri değiştirmeyi deneyebilirsiniz.

Önemli

Bu özellik artık kullanım dışıdır. 31 Mart 2025'te Azure AI Görüntü Analizi 4.0 Özel Görüntü Sınıflandırması, Özel Nesne Algılama ve Ürün Tanıma önizleme API'si kullanımdan kaldırılacaktır. Bu tarihten sonra bu hizmetlere yapılan API çağrıları başarısız olur.

Modellerinizin sorunsuz çalışmasını sağlamak için genel kullanıma sunulan Azure AI Özel Görüntü İşleme geçişini sağlayın. Custom Vision, emekliye ayrılan özelliklere benzer işlevler sunar.

Görüntü Analizi 4.0, kendi eğitim görüntülerinizi kullanarak özel bir model eğitmeye olanak tanır. Görüntülerinizi el ile etiketleyerek, bir modeli görüntülere özel etiketler uygulayacak (görüntü sınıflandırması) veya özel nesneleri (nesne algılama) algılayan eğitebilirsiniz. Görüntü Analizi 4.0 modelleri özellikle az çekim öğrenmede etkilidir, bu nedenle daha az eğitim verileriyle doğru modeller elde edebilirsiniz.

Bu kılavuzda özel görüntü sınıflandırma modeli oluşturma ve eğitme gösterilmektedir. Görüntü sınıflandırma modelini eğitme ile nesne algılama modeli arasındaki birkaç farka dikkat edilir.

Önkoşullar

- Azure aboneliği. Ücretsiz bir tane oluşturabilirsiniz.

- Azure aboneliğinizi aldıktan sonra anahtarınızı ve uç noktanızı almak için Azure portalında bir Görüntü İşleme kaynağı oluşturun. Vision Studio'yu kullanarak bu kılavuzu izliyorsanız kaynağınızı Doğu ABD bölgesinde oluşturmanız gerekir. Dağıtıldıktan sonra Kaynağa git'i seçin. Anahtarı ve uç noktayı daha sonra kullanmak üzere geçici bir konuma kopyalayın.

- Azure Depolama kaynağı. Depolama kaynağı oluşturun.

- Sınıflandırma modelinizi eğitmek için kullanabileceğiniz bir görüntü kümesi. GitHub'da örnek görüntü kümesini kullanabilirsiniz. İsterseniz kendi görüntülerinizi de kullanabilirsiniz. Sınıf başına yalnızca 3-5 görüntüye ihtiyacınız vardır.

Not

Olası yüksek gecikme süresi nedeniyle iş açısından kritik ortamlar için özel modeller kullanmanızı önermiyoruz. Müşteriler Vision Studio'da özel modelleri eğittiğinde, bu özel modeller eğitildiği Görüntü İşleme kaynağına aittir ve müşteri Görüntü Analizi API'sini kullanarak bu modellere çağrı yapabilir. Bu çağrıları yaptıklarında özel model belleğe yüklenir ve tahmin altyapısı başlatılır. Bu durumda müşteriler tahmin sonuçlarını almak için beklenenden daha uzun gecikme süresiyle karşılaşabilir.

Yeni bir özel model oluşturma

Vision Studio'ya gidip Görüntü analizi sekmesini seçerek başlayın. Ardından Modelleri özelleştir kutucuğunu seçin.

Ardından Azure hesabınızla oturum açın ve Görüntü İşleme kaynağınızı seçin. Eğer hesabınız yoksa, bu ekrandan bir tane oluşturabilirsiniz.

Eğitim görüntülerini hazırlama

Eğitim görüntülerinizi bir Azure Blob Depolama kapsayıcısına yüklemeniz gerekir. Azure portalında depolama kaynağınıza gidin ve Depolama tarayıcısı sekmesine gidin. Burada bir blob kapsayıcısı oluşturabilir ve görüntülerinizi karşıya yükleyebilirsiniz. Tümünü kapsayıcının köküne yerleştirin.

Veri kümesi ekleme

Özel bir modeli eğitmek için, görüntüleri ve bunların etiket bilgilerini eğitim verileri olarak sağladığınız bir Veri Kümesi ile ilişkilendirmeniz gerekir. Vision Studio'da veri kümelerinizi görüntülemek için Veri Kümeleri sekmesini seçin.

Yeni veri kümesi oluşturmak için Yeni veri kümesi ekle'yi seçin. Açılan pencerede bir ad girin ve kullanım örneğiniz için bir veri kümesi türü seçin. Görüntü sınıflandırma modelleri görüntünün tamamına içerik etiketleri uygularken , Nesne algılama modelleri görüntüdeki belirli konumlara nesne etiketleri uygular. Ürün tanıma modelleri, perakende ürünleri algılamak için iyileştirilmiş nesne algılama modellerinin bir alt kategorisidir.

Ardından, eğitim görüntülerini depoladığınız Azure Blob Depolama hesabından kapsayıcıyı seçin. Vision Studio'ya blob depolama kapsayıcısını okuma ve yazma izni vermek için kutuyu işaretleyin. Bu, etiketlenmiş verileri içeri aktarmak için gerekli bir adımdır. Veri kümesini oluşturun.

Azure Machine Learning etiketleme projesi oluşturma

Etiketleme bilgilerini iletmek için bir COCO dosyası gerekir. COCO dosyası oluşturmanın kolay bir yolu, veri etiketleme iş akışıyla birlikte gelen bir Azure Machine Learning projesi oluşturmaktır.

Veri kümesi ayrıntıları sayfasında Yeni Veri Etiketleme projesi ekle'yi seçin. Adı verin ve Yeni çalışma alanı oluştur'u seçin. Bu, Azure Machine Learning projesini oluşturabileceğiniz yeni bir Azure portalı sekmesi açar.

Azure Machine Learning projesi oluşturulduktan sonra Vision Studio sekmesine dönün ve Çalışma Alanı'nın altında bunu seçin. Ardından Azure Machine Learning portalı yeni bir tarayıcı sekmesinde açılır.

Etiket oluşturma

Etiketlemeye başlamak için, Lütfen etiket sınıfları ekleyin mesajını takip ederek etiket sınıfları ekleyin.

Tüm sınıf etiketlerini ekledikten sonra bunları kaydedin, projede Başlat'ı seçin ve ardından en üstteki Verileri etiketle'yi seçin.

Eğitim verilerini el ile etiketleme

Etiketlemeyi başlat'ı seçin ve tüm görüntülerinizi etiketlemek için yönlendirmeleri izleyin. İşiniz bittiğinde tarayıcınızda Vision Studio sekmesine dönün.

Şimdi COCO dosyası ekle'yi ve ardından Azure ML Veri Etiketleme projesinden COCO dosyasını içeri aktar'ı seçin. Bu, etiketlenmiş verileri Azure Machine Learning'den içeri aktarır.

Oluşturduğunuz COCO dosyası artık bu projeye bağladığınız Azure Depolama kapsayıcısında depolanır. Artık bunu model özelleştirme iş akışına aktarabilirsiniz. Açılan listeden seçin. COCO dosyası veri kümesine aktarıldıktan sonra, veri kümesi modeli eğitmesi için kullanılabilir.

Not

İçeri aktarmak istediğiniz hazır bir COCO dosyanız varsa Veri Kümeleri sekmesine gidin ve Bu veri kümesine COCO dosyaları ekle'yi seçin. Blob depolama hesabından belirli bir COCO dosyası eklemeyi veya Azure Machine Learning etiketleme projesinden içeri aktarmayı seçebilirsiniz.

Şu anda Microsoft, Coco dosyası içeri aktarma işleminin Vision Studio'da başlatıldığında büyük veri kümelerinde başarısız olmasına neden olan bir sorunu çözmektedir. Büyük bir veri kümesi kullanarak eğitmek için bunun yerine REST API kullanılması önerilir.

COCO dosyaları hakkında

COCO dosyaları, belirli gerekli alanlara sahip JSON dosyalarıdır: "images", "annotations"ve "categories". Örnek bir COCO dosyası şöyle görünür:

{

"images": [

{

"id": 1,

"width": 500,

"height": 828,

"file_name": "0.jpg",

"absolute_url": "https://blobstorage1.blob.core.windows.net/cpgcontainer/0.jpg"

},

{

"id": 2,

"width": 754,

"height": 832,

"file_name": "1.jpg",

"absolute_url": "https://blobstorage1.blob.core.windows.net/cpgcontainer/1.jpg"

},

...

],

"annotations": [

{

"id": 1,

"category_id": 7,

"image_id": 1,

"area": 0.407,

"bbox": [

0.02663142641129032,

0.40691584277841153,

0.9524163571731749,

0.42766634515266866

]

},

{

"id": 2,

"category_id": 9,

"image_id": 2,

"area": 0.27,

"bbox": [

0.11803319477782331,

0.41586723392402375,

0.7765206955096307,

0.3483334397217212

]

},

...

],

"categories": [

{

"id": 1,

"name": "vegall original mixed vegetables"

},

{

"id": 2,

"name": "Amy's organic soups lentil vegetable"

},

{

"id": 3,

"name": "Arrowhead 8oz"

},

...

]

}

COCO dosya alanı referansı

Sıfırdan kendi COCO dosyanızı oluşturuyorsanız tüm gerekli alanların doğru ayrıntılarla doldurulduğundan emin olun. Aşağıdaki tablolarda BIR COCO dosyasındaki her alan açıklanmaktadır:

"resimler"

| Anahtar | Türü | Açıklama | Gerekli mi? |

|---|---|---|---|

id |

tamsayı | 1'den başlayarak benzersiz görüntü kimliği | Evet |

width |

tamsayı | Görüntünün piksel cinsinden genişliği | Evet |

height |

tamsayı | Görüntünün piksel cinsinden yüksekliği | Evet |

file_name |

Dizgi | Görüntü için benzersiz bir ad | Evet |

absolute_url veya coco_url |

Dizgi | Blob kapsayıcısında bir bloba mutlak URI olarak görüntü yolu. Vision kaynağının ek açıklama dosyalarını ve atıfta bulunulan tüm görüntü dosyalarını okuma izni olmalıdır. | Evet |

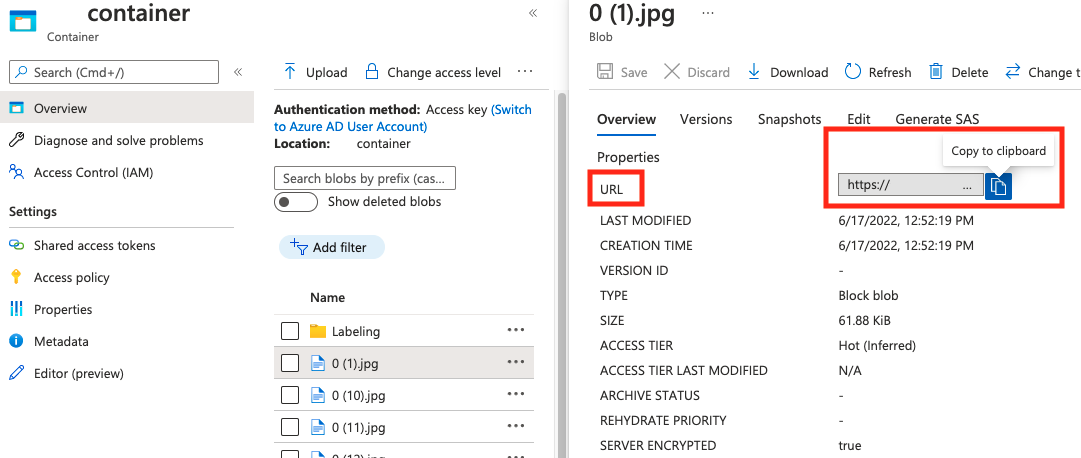

absolute_url değerini blob kapsayıcınızın özelliklerinde bulabilirsiniz.

"ek açıklamalar"

| Anahtar | Türü | Açıklama | Gerekli mi? |

|---|---|---|---|

id |

tamsayı | Açıklamanın Kimliği | Evet |

category_id |

tamsayı |

categories bölümünde tanımlanan kategorinin kimliği |

Evet |

image_id |

tamsayı | Görüntünün kimliği | Evet |

area |

tamsayı | 'Genişlik' x 'Yükseklik' değeri (bbox içindeki üçüncü ve dördüncü değerler) |

Hayır |

bbox |

liste[float] | Sınırlayıcı kutunun göreli koordinatları (0 - 1), 'Sol', 'Üst', 'Genişlik', 'Yükseklik' sırasına göre | Evet |

"kategoriler"

| Anahtar | Türü | Açıklama | Gerekli mi? |

|---|---|---|---|

id |

tamsayı | Her kategori için benzersiz kimlik (etiket sınıfı). Bunlar annotations bölümünde bulunmalıdır. |

Evet |

name |

Dizgi | Kategorinin adı (etiket sınıfı) | Evet |

COCO dosya doğrulaması

Coco dosyasının biçimini denetlemek için Python örnek kodumuzu kullanabilirsiniz.

Özel modeli eğitin

COCO dosyanızla bir modeli eğitmeye başlamak için Özel modeller sekmesine gidin ve Yeni model ekle'yi seçin. Model için bir ad girin ve model türü olarak Image classification veya Object detection seçin.

Artık etiketleme bilgilerini içeren COCO dosyasıyla ilişkili olan veri kümenizi seçin.

Ardından bir zaman bütçesi seçin ve modeli eğitin. Küçük örnekler için bütçe kullanabilirsiniz 1 hour .

Eğitimin tamamlanması biraz zaman alabilir. Görüntü Analizi 4.0 modelleri yalnızca küçük bir eğitim verileri kümesiyle doğru sonuçlar verebilir, ancak eğitim süreci, önceki modellerden daha uzun sürer.

Eğitilen modeli değerlendir.

Eğitim tamamlandıktan sonra modelin performans değerlendirmesini görüntüleyebilirsiniz. Aşağıdaki ölçümler kullanılır:

- Görüntü sınıflandırması: Ortalama Duyarlık, Doğruluk İlk 1, Doğruluk İlk 5

- Nesne algılama: Ortalama Ortalama Duyarlık @ 30, Ortalama Ortalama Duyarlık @ 50, Ortalama Ortalama Duyarlık @ 75

Modeli eğitirken bir değerlendirme kümesi sağlanmazsa, bildirilen performans eğitim kümesinin bir bölümüne göre tahmin edilir. Model performansınızı güvenilir bir şekilde tahmin etmek için bir değerlendirme veri kümesi (yukarıdakiyle aynı işlemi kullanarak) kullanmanızı kesinlikle öneririz.

Vision Studio'da özel modeli test etme

Özel bir model derledikten sonra, model değerlendirme ekranındaki Deneyin düğmesini seçerek test edebilirsiniz.

Bu sizi Resimlerden ortak etiketleri ayıkla sayfasına götürür. Açılan menüden özel modelinizi seçin ve bir test görüntüsü yükleyin.

Tahmin sonuçları doğru sütunda görünür.

İlgili içerik

Bu kılavuzda, Görüntü Analizini kullanarak özel bir görüntü sınıflandırma modeli oluşturdunuz ve eğittiniz. Ardından, REST kullanarak bir uygulamadan özel modelinizi çağırabilmeniz için Görüntü Analizi 4.0 API'si hakkında daha fazla bilgi edinin.