Azure Content Moderator nedir?

Önemli

Azure Content Moderator Şubat 2024 itibarıyla kullanımdan kaldırılmıştır ve Şubat 2027'ye kadar kullanımdan kaldırılacaktır. Gelişmiş yapay zeka özellikleri ve gelişmiş performans sunan Azure AI content Safety ile değiştirilmiştir.

Azure AI İçerik Güvenliği, uygulama ve hizmetlerde kullanıcı tarafından oluşturulan ve yapay zeka tarafından oluşturulan zararlı içerikleri algılamak için tasarlanmış kapsamlı bir çözümdür. Azure AI İçerik Güvenliği çevrimiçi marketler, oyun şirketleri, sosyal mesajlaşma platformları, kurumsal medya şirketleri ve K-12 eğitim çözümü sağlayıcıları gibi birçok senaryo için uygundur. Özelliklerine ve özelliklerine genel bir bakış aşağıdadır:

- Metin ve Görüntü Algılama API'leri: Birden çok önem düzeyiyle cinsel içerik, şiddet, nefret ve kendine zarar verecek metin ve görüntüleri tarayın.

- Content Safety Studio: En son con çadır modu ration ML modellerimizi kullanarak rahatsız edici, riskli veya istenmeyen içeriği işlemek için tasarlanmış çevrimiçi bir araç. Kullanıcıların kendi con çadır modu ration sistemlerini oluşturmasını sağlayan şablonlar ve özelleştirilmiş iş akışları sağlar.

- Dil desteği: Azure AI Content Safety 100'den fazla dili destekler ve özellikle İngilizce, Almanca, Japonca, İspanyolca, Fransızca, İtalyanca, Portekizce ve Çince üzerinde eğitilir.

Azure AI content Safety, con çadır modu ration gereksinimleriniz için sağlam ve esnek bir çözüm sağlar. Content Moderator'dan Azure AI Content Safety'ye geçerek, içeriğinizin her zaman tam belirtimlerinize göre denetlendiğinden emin olmak için en son araçlardan ve teknolojilerden yararlanabilirsiniz.

Azure AI İçerik Güvenliği hakkında daha fazla bilgi edinin ve con çadır modu ration stratejinizi nasıl yükseltebileceğini keşfedin.

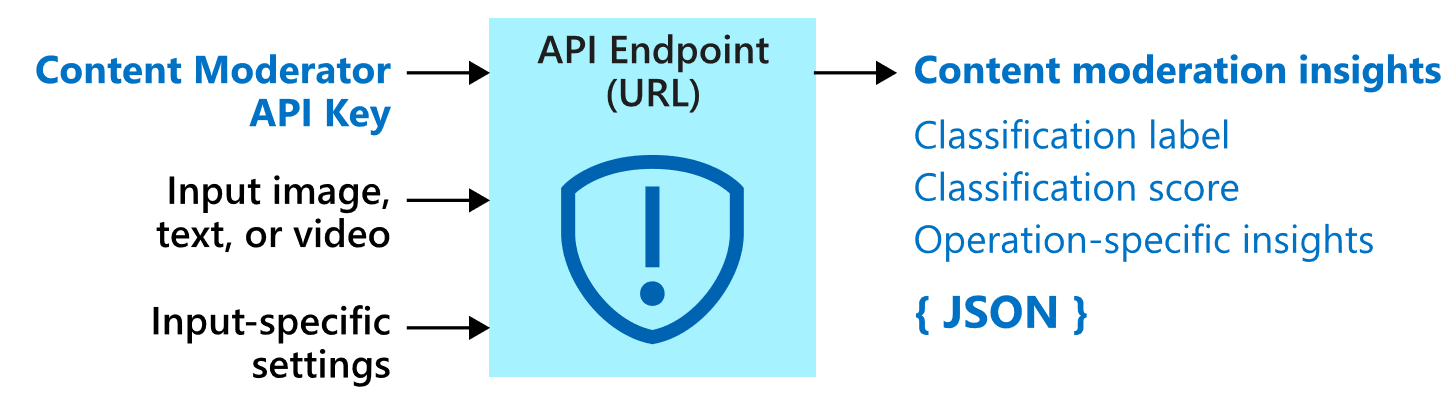

Azure Content Moderator rahatsız edici, riskli veya başka bir şekilde istenmeyen içeriği işlemenizi sağlayan bir yapay zeka hizmetidir. Metin, görüntü ve videoları tarayan ve içerik bayraklarını otomatik olarak uygulayan yapay zeka destekli con çadır modu ration hizmetini içerir.

Düzenlemelere uymak veya kullanıcılarınız için hedeflenen ortamı korumak için uygulamanıza içerik filtreleme yazılımı oluşturmak isteyebilirsiniz.

Bu belge aşağıdaki makale türlerini içerir:

- Hızlı başlangıçlar , hizmete istekte bulunma konusunda size yol gösteren başlangıç yönergeleridir.

- Nasıl yapılır kılavuzları , hizmeti daha belirli veya özelleştirilmiş yollarla kullanmaya yönelik yönergeler içerir.

- Kavramlar , hizmet işlevselliği ve özellikleri hakkında ayrıntılı açıklamalar sağlar.

Daha yapılandırılmış bir yaklaşım için Content Moderator eğitim modülünü izleyin.

Kullanıldığı yer

Aşağıda, bir yazılım geliştiricisinin veya ekibin con çadır modu ration hizmetine ihtiyaç duyması gereken birkaç senaryo vardır:

- Ürün kataloglarını ve kullanıcı tarafından oluşturulan diğer içeriği ortalayan çevrimiçi marketler.

- Kullanıcı tarafından oluşturulan oyun yapıtlarını ve sohbet odalarını ortalayan oyun şirketleri.

- Kullanıcıları tarafından eklenen görüntüleri, metinleri ve videoları ortalayan sosyal mesajlaşma platformları.

- İçerikleri için merkezi denetim uygulayan kurumsal medya şirketleri.

- Öğrenciler ve eğitimciler için uygun olmayan içeriği filtreleyen K-12 eğitim çözümü sağlayıcıları.

Önemli

Content Moderator'ı geçersiz çocuk istismarı görüntülerini algılamak için kullanamazsınız. Ancak, nitelikli kuruluşlar bu tür içeriği görüntülemek için PhotoDNA Bulut Hizmeti'ni kullanabilir.

Neleri içerir

Content Moderator hizmeti hem REST çağrıları hem de .NET SDK'sı ile sunulan çeşitli web hizmeti API'lerinden oluşur.

Yönetim API’leri

Content Moderator hizmeti, içeriği uygunsuz veya uygunsuz olabilecek malzemeler için denetleyen Moderation API'lerini içerir.

Aşağıdaki tabloda farklı denetim API'leri türleri açıklanmaktadır.

| API grubu | Açıklama |

|---|---|

| Metin denetimi | Rahatsız edici içerik, cinsel içerik veya müstehcen içerik, küfür ve kişisel veriler için metni tarar. |

| Özel terim listeleri | Metni, yerleşik terimlerle birlikte özel bir terim listesine göre tarar. İçerik ilkelerinize göre içerik engellemek veya izin vermek için özel listeler kullanabilirsiniz. |

| Görüntü denetimi | Görüntülerde yetişkinlere yönelik veya müstehcen görüntü taraması yapar, Optik Karakter Tanıyıcı (OCR) ile görüntüdeki metinleri tanır ve yüzleri algılar. |

| Özel görüntü listeleri | Görüntüleri özel görüntü listesine göre tarar. Özel görüntü listelerini kullanarak tekrar tekrar sınıflandırmak istemediğiniz yaygın içerik örneklerini filtreleyebilirsiniz. |

| Video denetimi | Videolarda yetişkinlere yönelik veya müstehcen içerik taraması yapar ve bu içeriklerle ilgili zaman işaretçilerini döndürür. |

Veri gizliliği ve güvenliği

Tüm Azure yapay zeka hizmetlerinde olduğu gibi Content Moderator hizmetini kullanan geliştiriciler de Microsoft'un müşteri verileriyle ilgili ilkelerinin farkında olmalıdır. Daha fazla bilgi edinmek için Microsoft Güven Merkezi'nin Azure AI hizmetleri sayfasına bakın.

Sonraki adımlar

- Koddaki temel senaryoları uygulamak için bir istemci kitaplığını veya REST API hızlı başlangıcını tamamlayın.