GitHub Copilot Büyük Dil Modelleri (LLM'ler)

GitHub Copilot, sorunsuz bir şekilde kod yazmanıza yardımcı olmak için Büyük Dil Modelleri (LLM' ler) tarafından desteklenir. Bu ünitede GitHub Copilot'ta LLM'lerin tümleştirmesini ve etkisini anlamaya odaklanacağız. Şimdi aşağıdaki konuları gözden geçirelim:

- LLM'ler nedir?

- GitHub Copilot'ta LLM'lerin rolü ve istem

- LLM'lerde ince ayar

- LoRA ince ayarı

LLM'ler nedir?

Büyük Dil Modelleri (LLM'ler), insan dilini anlamak, oluşturmak ve işlemek için tasarlanmış ve eğitilmiş yapay zeka modelleridir. Bu modeller, eğitilen çok miktarda metin verisi sayesinde metin içeren çok çeşitli görevleri işleme özelliğine sahiptir. LLM'ler hakkında anlaşılması gereken bazı temel yönler şunlardır:

Eğitim verilerinin hacmi

LLM'ler çeşitli kaynaklardan gelen çok miktarda metne maruz kalarak. Bu durum, onları çeşitli iletişim biçimlerinde yer alan dil, bağlam ve inceliklerle ilgili geniş bir anlayışla donatmaktadır.

Bağlamsal anlama

Bağlamsal olarak ilgili ve tutarlı metin oluşturma konusunda üstündür. Bağlamı anlama yetenekleri, cümleleri, paragrafları tamamlamaları ve hatta bağlamsal olarak apt olan belgelerin tamamını oluşturmaları gibi anlamlı katkılar sağlamalarını sağlar.

Makine öğrenmesi ve yapay zeka tümleştirmesi

LLM'ler makine öğrenmesi ve yapay zeka ilkelerine dayandırılır. Bunlar, metinleri etkili bir şekilde anlamak ve tahmin etmek için eğitim sürecinde ince ayarlanmış milyonlarca, hatta milyarlarca parametreye sahip sinir ağlarıdır.

Çok yönlü -lük

Bu modeller belirli bir metin veya dil türüyle sınırlı değildir. Özel görevleri gerçekleştirmek için uyarlanabilir ve ince ayar yapılabilir, böylece bunları çeşitli etki alanları ve dillerde son derece çok yönlü ve uygulanabilir hale getirir.

GitHub Copilot'ta LLM'lerin rolü ve istem

GitHub Copilot, bağlama duyarlı kod önerileri sağlamak için LLM'leri kullanır. LLM, doğru ve ilgili kod tamamlamaları oluşturmak için yalnızca geçerli dosyayı değil, IDE'deki diğer açık dosyaları ve sekmeleri de dikkate alır. Bu dinamik yaklaşım, özel öneriler sağlayarak üretkenliğinizi artırır.

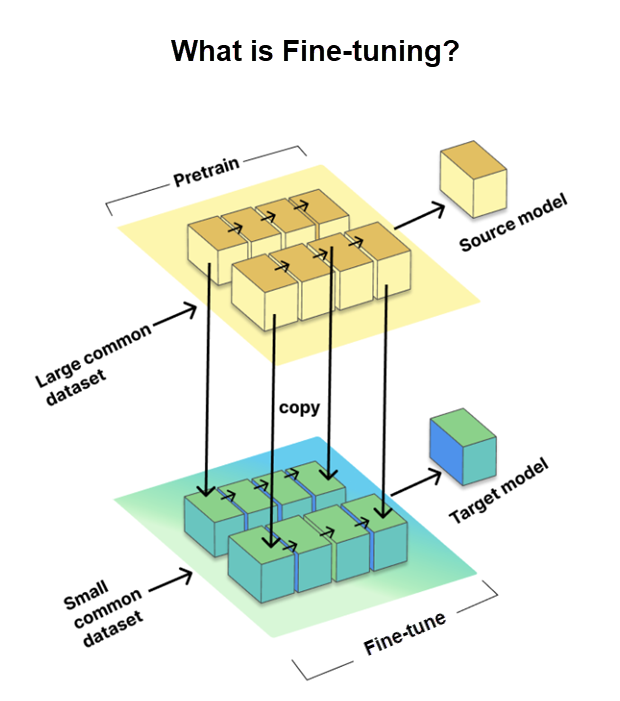

LLM'lerde ince ayar

hassas ayarlama, önceden eğitilmiş büyük dil modellerini (LLM) belirli görevler veya etki alanları için uyarlamamıza olanak tanıyan kritik bir işlemdir. Modeli hedef veri kümesi olarak bilinen daha küçük, göreve özgü bir veri kümesinde eğitirken, kaynak model olarak adlandırılan önceden eğitilmiş büyük bir veri kümesinden elde edilen bilgileri ve parametreleri kullanmayı içerir.

belirli görevler için LLM'leri uyarlamak ve performanslarını geliştirmek için ince ayar yapmak önemlidir. Ancak GitHub, bundan sonra ele aldığımız LoRA ince ayarlama yöntemini kullanarak bunu bir adım ileri götürdü.

LoRA ince ayarı

Geleneksel tam ince ayarlama, sinir ağının yavaş ve kaynaklara yoğun bir şekilde bağlı olabilecek tüm bölümlerini eğitmek anlamına gelir. Ancak LoRA (Düşük Dereceli Uyarlama) ince ayar akıllı bir alternatiftir. Büyük önceden eğitilmiş dil modellerinin (LLM) tüm eğitimi yinelemeden belirli görevler için daha iyi çalışmasını sağlamak için kullanılır.

LoRA şu şekilde çalışır:

- LoRA, önceden eğitilmiş modelin her katmanına her şeyi değiştirmek yerine daha küçük eğitilebilir parçalar ekler.

- Özgün model aynı kalır ve bu da zaman ve kaynak tasarrufu sağlar.

LoRA'nın harikalığı:

- Bağdaştırıcılar ve ön ek ayarlama gibi diğer uyarlama yöntemlerini yenir.

- Daha az hareketli parçayla harika sonuçlar elde etmeye benzer.

Basit bir ifadeyle LoRA ince ayarı, LLM'leri Copilot kullanırken belirli kodlama gereksinimleriniz için daha iyi hale getirmek için daha akıllı, daha zor değil çalışmayla ilgili.