執行 Spark 作業定義活動來轉換資料

適用於 Microsoft Fabric 的 Data Factory 中的 Spark 作業定義活動可讓您建立 Spark 作業定義的連線,並從數據管線執行它們。

必要條件

若要開始使用,您必須完成下列必要條件:

- 具有作用中訂用帳戶的租用戶帳戶。 免費建立帳戶。

- 建立工作區。

使用UI將Spark作業定義活動新增至管線

在您的工作區中建立新的數據管線。

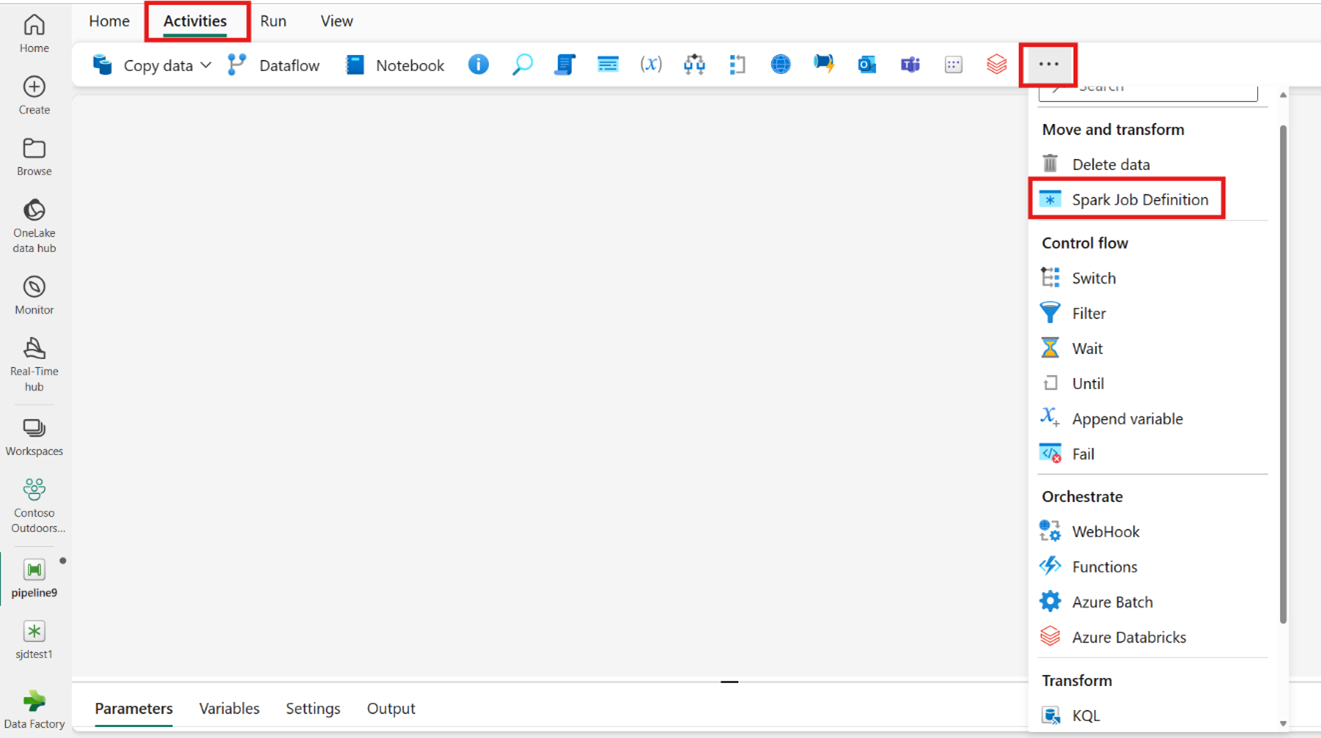

從主畫面卡片搜尋 Spark 作業定義,然後選取它,或從活動列選取活動,將其新增至管線畫布。

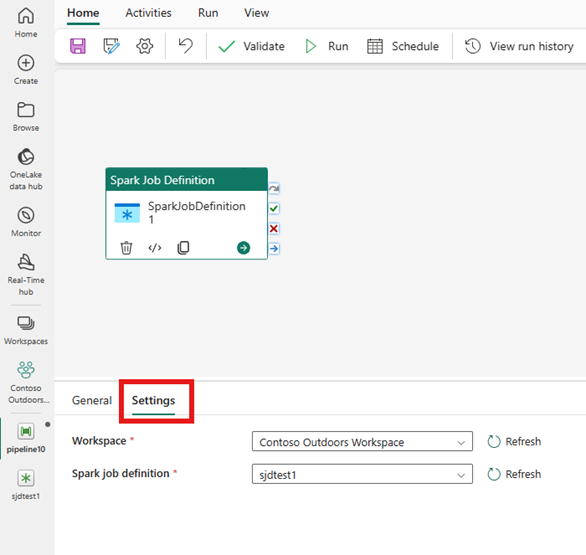

如果尚未選取,請在管線編輯器畫布上選取新的Spark作業定義活動。

請參閱 [一般設定] 指引,以設定 [一般設定] 索引標籤中找到的選項。

Spark 作業定義活動設定

選取活動屬性窗格中的 [設定] 索引卷標,然後選取包含您要執行的Spark作業定義的 [網狀架構工作區]。

已知的限制

此處列出 Fabric Data Factory Spark 作業定義活動的目前限制。 本節可能會變更。

- 我們目前不支援在活動內建立新的Spark作業定義活動(在 設定下)

- 參數化支持無法使用。

- 雖然我們支援透過 [輸出] 索引標籤監視活動,但您仍無法在更細微的層級監視 Spark 作業定義。 例如,無法直接在 Data Factory 中使用監視頁面、狀態、持續時間和先前的 Spark 作業定義執行連結。 不過,您可以在Spark作業定義監視頁面中看到更細微的詳細數據。

儲存並執行或排程管線

設定管線所需的任何其他活動之後,請切換至管線編輯器頂端的 [首頁] 索引標籤,然後選取 [儲存] 按鈕以儲存管線。 選取 [執行] 以直接執行,或選取 [排程] 來排程它。 您也可以在這裡檢視執行歷程記錄,或設定其他設定。

![顯示管線編輯器 [首頁] 索引標籤的螢幕快照,其中醒目提示 [儲存]、[執行] 和 [排程] 按鈕。](media/spark-job-definition-activity/save-run-schedule.png)

相關內容

意見反應

即將登場:在 2024 年,我們將逐步淘汰 GitHub 問題作為內容的意見反應機制,並將它取代為新的意見反應系統。 如需詳細資訊,請參閱:https://aka.ms/ContentUserFeedback。

提交並檢視相關的意見反應