使用捷徑轉換將結構化檔案轉換成可查詢的 Delta 表格。 如果你的來源資料已經是像 CSV、Parquet 或 JSON 這類表格格式,檔案轉換會自動將資料複製並轉換成 Delta Lake 格式,讓你可以用 SQL、Spark 或 Power BI 查詢,而不必建立 ETL 管線。

對於需要 AI 處理的非結構化文字檔,如摘要、翻譯或情感分析,請參見捷徑轉換(AI 驅動)。

捷徑轉換會始終與來源資料 同步 。 Fabric Spark 計算 執行轉換,並將 OneLake 捷徑所參考的資料複製到受管理的 Delta 資料表中。 透過自動架構處理、深度扁平化功能,以及支援多種壓縮格式,捷徑轉換消除了建立與維護 ETL 管線的複雜性。

備註

捷徑轉換目前處於 公開預覽 階段,可能會有所變動。

為什麼要使用快捷方式轉換?

- 自動轉換 – Fabric 複製並轉換原始檔案至 Delta 格式,無需手動管線協調。

- 頻繁同步 ——Fabric 每兩分鐘輪詢一次捷徑並同步變更。

- 遞迴資料夾發現 – Fabric 自動遍歷子資料夾,以偵測並轉換整個目錄階層中的檔案。

- Delta Lake 輸出 – 所得表格與任何 Apache Spark 引擎相容。

- 繼承治理 – 捷徑繼承 OneLake 的血統、權限及 Microsoft Purview 政策。

先決條件

| 需求 | 詳細資料 |

|---|---|

| Microsoft Fabric 產品庫存單位 (SKU) | 支援 Lakehouse 工作負載的容量或試用版本。 |

| 源數據 | 一個包含同質 CSV、Parquet 或 JSON 檔案的資料夾。 |

| 工作區角色 | 貢獻者或更高。 |

支援的來源、格式與目的地

OneLake 支援的所有資料來源皆有支援。

| 原始碼檔案格式 | 目的地 | 支援的擴充功能 | 支援的壓縮類型 | Notes |

|---|---|---|---|---|

| CSV(UTF-8,UTF-16) | Lakehouse / Tables 資料夾中的三角洲湖表格 | .csv、.txt(分隔符)、.tsv(分界符)、.psv(管子分離) | .csv.gz,.csv.bz2 | .csv.zip 和 .csv.snappy 都不被支援。 |

| Parquet | Lakehouse / Tables 資料夾中的三角洲湖表格 | .parquet | .parquet.snappy、.parquet.gzip、.parquet.lz4、.parquet.brotli、.parquet.zstd | |

| JSON | Lakehouse / Tables 資料夾中的三角洲湖表格 | .json, .jsonl, .ndjson | .json.gz, .json.bz2, .jsonl.gz, .ndjson.gz, .jsonl.bz2, .ndjson.bz2 | .json.zip 和 .json.snappy 都不被支援。 |

建立帶有資料轉換的捷徑

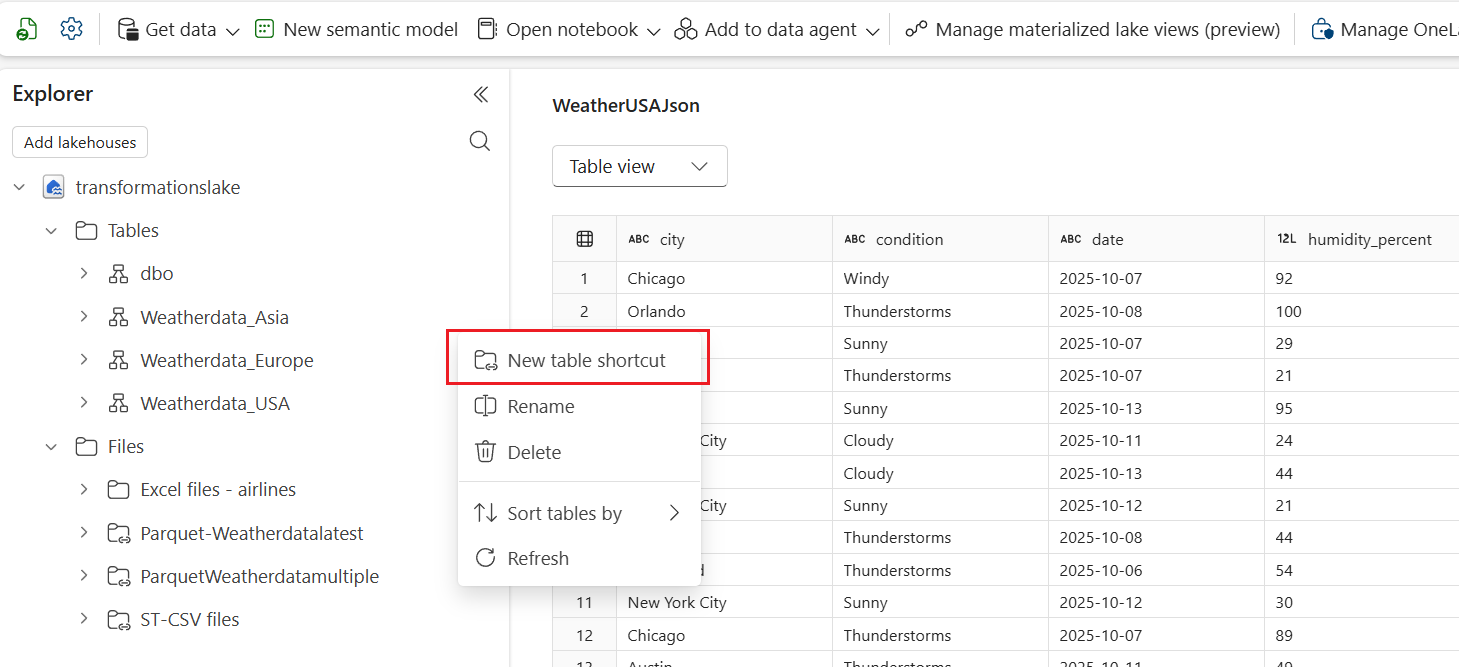

在你的 Lakehouse 裡,右鍵點擊 表格 區塊中的一個表格,然後選擇 新增表格捷徑。 選擇你的捷徑來源(例如 Azure Data Lake、Azure Blob Storage、Dataverse、Amazon S3、GCP、SharePoint、OneDrive 等等)。

選擇包含 CSV、Parquet 或 JSON 檔案的資料夾。

在轉換步驟中,設定 Delta 轉換的設定:

- CSV 檔案中的分隔符——選擇用來分隔欄位的字元(逗號、分號、管道、制表符、和號、空格)。

- 第一個數據列做為標頭 – 指出第一個數據列是否包含數據行名稱。

檢視快捷鍵設定。 在審查階段,您也可以在選擇 建立前設定以下設定:

- 包含子資料夾 – 啟用巢狀子目錄中檔案的遞迴處理。 此選項預設為新變換選項。 如果你只想處理頂層資料夾,請清除勾選框。

在 「管理捷徑監控中心」中追蹤刷新並查看日誌以保持透明度。

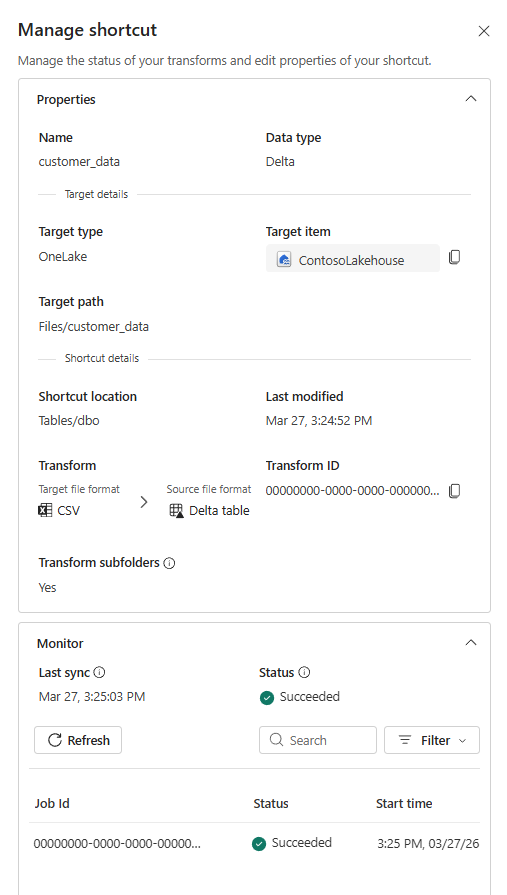

Fabric Spark 的運算會將資料複製到 Delta 表格,並在 管理捷徑 面板中顯示進度。

同步處理的運作方式

初始載入之後,Fabric Spark 會計算:

- 每 兩分鐘輪詢捷徑目標。

- 偵測 新的或修改過的檔案 ,並據以附加或覆寫數據列。

- 偵測 已刪除的檔案 並移除相應的列。

啟用子資料夾支援後,系統會遞迴地發現並處理目標資料夾內所有巢狀子目錄的檔案。

監控和故障排除

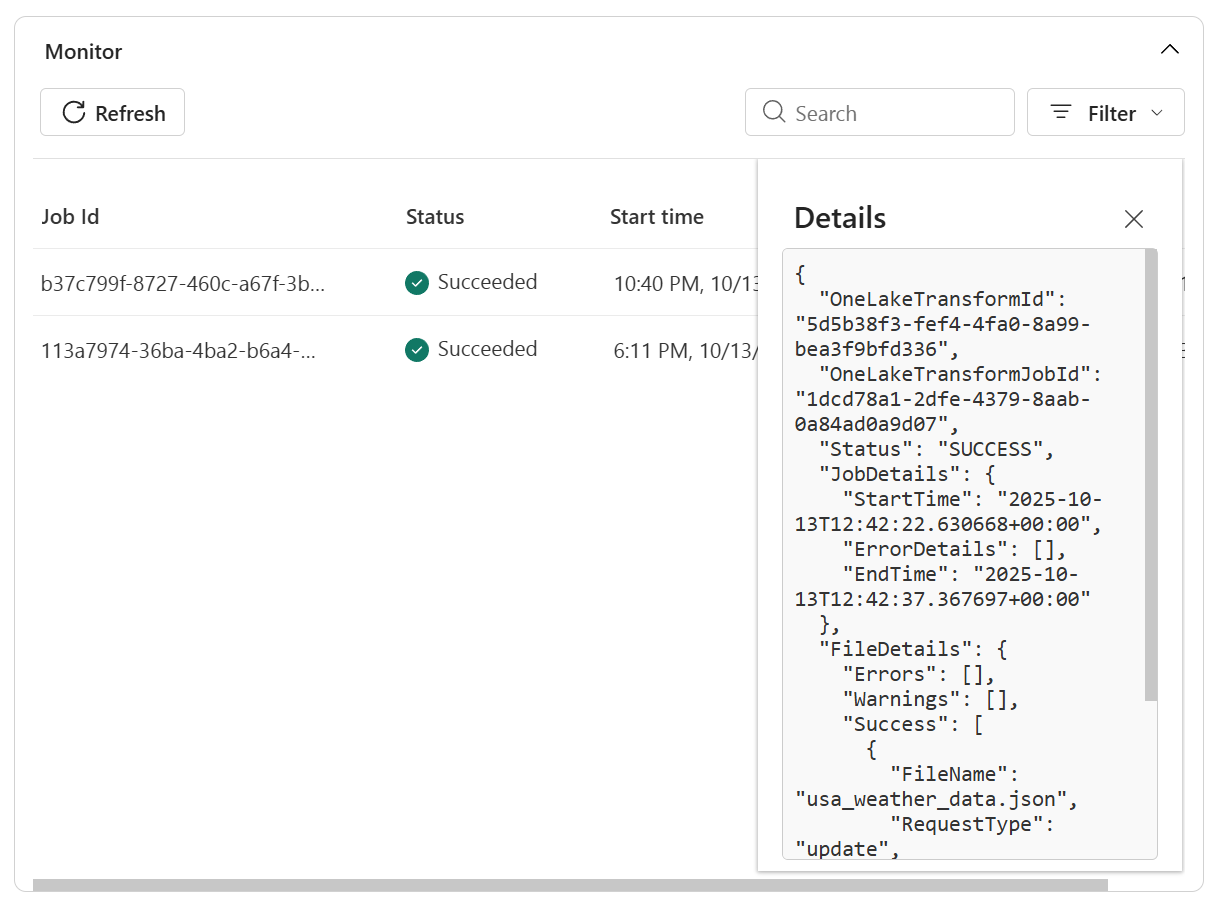

捷徑變換包括監控與錯誤處理,以幫助您追蹤資料擷取狀態並診斷問題。

打開湖屋,右鍵點擊能餵養你變身的捷徑。

選擇 管理捷徑。

在詳細選區,您可以查看:

狀態 – 最後掃描結果及目前同步狀態。

刷新歷史 – 同步操作的時間順序清單,包含列數及錯誤細節。

包含子資料夾 – 指示子資料夾轉換是否啟用(是 或 否)。

請查看更多詳細紀錄以進行故障排除。

局限性

目前捷徑轉換有以下限制:

-

資料來源格式: 僅支援 CSV、JSON 和 Parquet 檔案。

- CSV 不支援的資料類型: 混合資料型別欄位、Timestamp_Nanos、複雜邏輯型態 - MAP/LIST/STRUCT、原始二進位

- Parquet 不支援的資料型態: Timestamp_nanos、十進位(含 INT32/INT64、INT96)、未指派整數型別 - UINT_8/UINT_16/UINT_64、複雜邏輯型別 - MAP/LIST/STRUCT

- JSON 不支援的資料型態: 陣列中的混合資料型態,JSON 中的原始二進位大型物件,Timestamp_Nanos

- 檔案結構一致性: 檔案必須共享相同的結構。

- 工作空間可用性: 僅在 Lakehouse 項目中取得(不包含 Data Warehouses 或 KQL 資料庫)。

- 寫入操作: 轉換已被優化以提高讀取效率。 不支援在轉換目標資料表上直接執行 MERGE INTO 或 DELETE 語句。

- JSON 中陣列資料型態的扁平化:陣列資料型別保留在 Delta 資料表中,並可透過 Spark SQL 與 PySpark 存取。 進一步變身時,可以使用Fabric Materialized Lake Views作為銀色層。

- JSON 中平整深度: 巢狀結構會被壓平至五層深。 較深層次的嵌套結構需要預處理。

-

巢狀資料夾支援: 子資料夾處理有以下限制:

- 僅適用於新的轉換。 現有的轉換無法啟用子資料夾支援。

- 一旦啟用子資料夾支援,就無法關閉。

- 目標資料夾中巢狀的捷徑不會被遵守。 只會處理實體資料夾和檔案。

- 不支援選擇性包含或排除特定子資料夾。

- 巢狀資料夾無法搭配 SharePoint 捷徑使用。

使用 Fabric 路線圖 與 Fabric 更新部落格 ,了解新功能與新版本。

清除

要停止同步,請刪除 Lakehouse Explorer 的捷徑轉換。

刪除轉換並不會移除底層檔案。