إشعار

يتطلب الوصول إلى هذه الصفحة تخويلاً. يمكنك محاولة تسجيل الدخول أو تغيير الدلائل.

يتطلب الوصول إلى هذه الصفحة تخويلاً. يمكنك محاولة تغيير الدلائل.

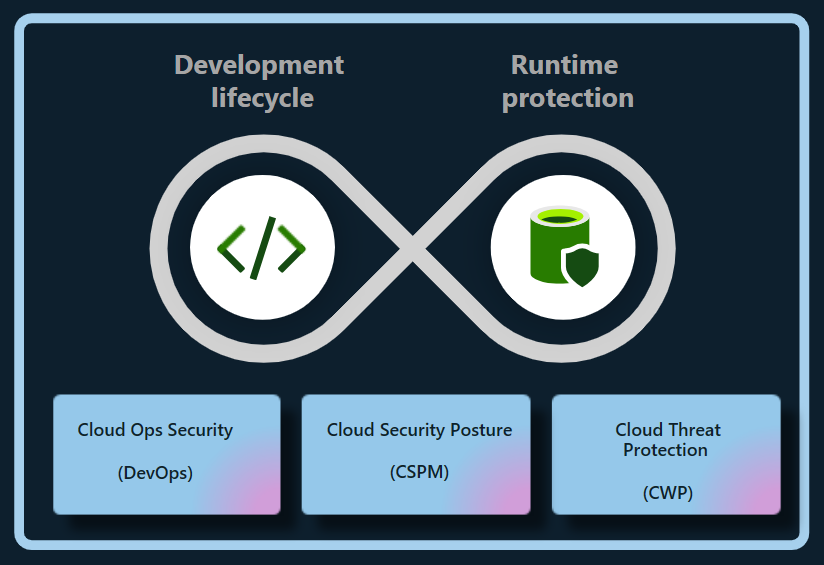

تؤمن خطة Defender Cloud Security Posture Management (CSPM) في Microsoft Defender for Cloud بيئات سحابية متعددة السحابة أو متعددة السحابات مبنية على مستوى المؤسسة. تشمل هذه البيئات Azure، وخدمات أمازون ويب (AWS)، ومنصة Google Cloud (GCP) Vertex الذكاء الاصطناعي. تؤمن خطة ديفندر CSPM تطبيقات الذكاء الاصطناعي التوليدي ووكلاء الذكاء الاصطناعي (المعاينة) طوال دورة حياتها بأكملها.

يقلل Defender for Cloud من المخاطر على أحمال عمل الذكاء الاصطناعي عبر السحابة من خلال:

- اكتشاف قائمة المواد الذكاء الاصطناعي التوليدي (الذكاء الاصطناعي BOM)، والتي تشمل مكونات التطبيقات، البيانات، وقطع الذكاء الاصطناعي من الكود إلى السحابة.

- تعزيز وضع أمان التطبيقات الذكاء الاصطناعي التوليدي من خلال التوصيات المضمنة واستكشاف المخاطر الأمنية ومعالجتها.

- استخدام تحليل مسار الهجوم لتحديد المخاطر ومعالجتها.

هام

لتمكين قدرات إدارة وضع الأمان الذكاء الاصطناعي على حساب AWS الذي بالفعل:

- متصل بحساب Azure الخاص بك.

- تم تمكين إدارة وضع الأمان السحابي في Defender.

- تم تعيين نوع الأذونات كأقل وصول امتياز.

يجب عليك إعادة تكوين الأفويضات على ذلك الموصل لتمكين الأذونات ذات الصلة باستخدام هذه الخطوات:

- في بوابة Azure، اذهب إلى صفحة إعدادات البيئة واختر موصل AWS المناسب.

- حدد تكوين الوصول.

- تأكد من تعيين نوع الأذونات إلى الوصول الأقل امتيازا.

- اتبع الخطوات 7 - 11 لإكمال التكوين.

اكتشاف تطبيقات الذكاء الاصطناعي التوليدية

يكتشف Defender for Cloud الذكاء الاصطناعي أحمال العمل ويحدد تفاصيل الذكاء الاصطناعي BOM لمؤسستك. تتيح لك هذه الرؤية تحديد ومعالجة الثغرات الأمنية وحماية تطبيقات الذكاء الاصطناعي التوليدية من التهديدات المحتملة.

يكتشف Defender for Cloud تلقائيا ومستمرا أحمال العمل الذكاء الاصطناعي الموزعة عبر الخدمات التالية:

- خدمة Azure OpenAI

- Azure الذكاء الاصطناعي foundry

- Azure Machine Learning

- صخور الأمازون الأساسية

- جوجل Vertex الذكاء الاصطناعي

يمكن ل Defender for Cloud أيضا اكتشاف الثغرات الأمنية داخل تبعيات مكتبة الذكاء الاصطناعي التوليدية مثل TensorFlow وPyTorch وLangchain عن طريق فحص التعليمات البرمجية المصدر للتكوينات الخاطئة للبنية الأساسية كتعليمة برمجية (IaC) وصور الحاوية للثغرات الأمنية. يمكن أن يؤدي تحديث المكتبات أو تصحيحها بانتظام إلى منع عمليات الاستغلال وحماية تطبيقات الذكاء الاصطناعي التوليدية والحفاظ على تكاملها.

مع هذه الميزات، يوفر Defender for Cloud رؤية كاملة لأحمال العمل الذكاء الاصطناعي من التعليمات البرمجية إلى السحابة.

اكتشف وكلاء الذكاء الاصطناعي (معاينة)

يكتشف Defender for Cloud أعباء عمل وكلاء الذكاء الاصطناعي ويحدد تفاصيل قائمة كتاب الذكاء الاصطناعي لمؤسستك. تتيح لك هذه الرؤية تحديد ومعالجة الثغرات وحماية تطبيقات وكلاء الذكاء الاصطناعي التوليدي من التهديدات المحتملة.

هام

هذه الميزة حاليا في مرحلة المعاينة ومدرجة مع Microsoft Defender الخاص بك ل CSPM دون أي تكلفة إضافية. قد تتغير متطلبات الترخيص عندما تصبح الميزة متاحة بشكل عام. إذا حدث تغيير في التسعير، يتم تعطيل الميزة تلقائيا، وستتلقى إشعارا. للاستمرار في استخدام الميزة، قد تحتاج إلى ترخيص جديد لإعادة تفعيل الميزة.

يكتشف Defender for Cloud تلقائيا وبشكل مستمر وكلاء الذكاء الاصطناعي المنتشرين عبر الخدمات التالية:

- عملاء Azure Foundry الذكاء الاصطناعي (يتطلب الوصول إلى Defender for Cloud مع تفعيل خطة CSPM الخاصة ب Defender)

- وكلاء الذكاء الاصطناعي Copilot Studio (يتطلب ترخيص Microsoft Defender for Cloud Apps )

عند تفعيل خطة Defender CSPM في اشتراكك في Azure، تكتشف البوابة تلقائيا وكلاء الذكاء الاصطناعي المنشورين في Azure الذكاء الاصطناعي وتملأ مخزون الذكاء الاصطناعي بقائمة وكلاء الذكاء الاصطناعي المكتشفين.

إشعار

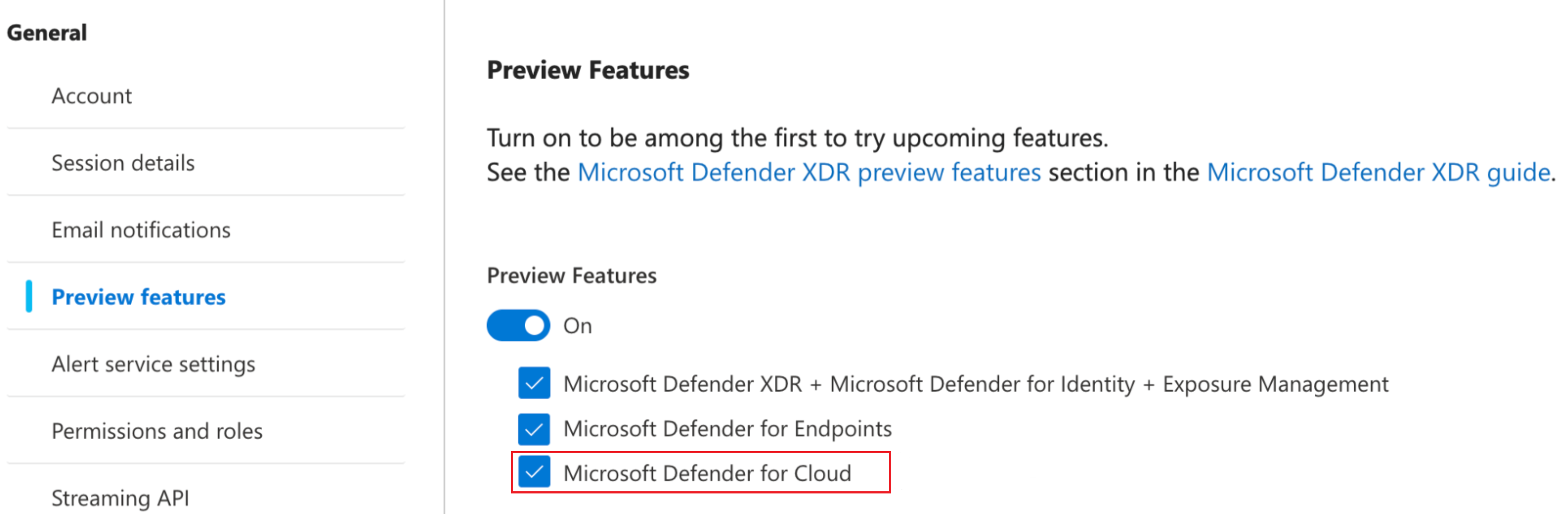

لعرض ميزات المعاينة في بوابة ديفندر، تحتاج إلى تفعيل ميزات معاينة Microsoft Defender for Cloud في بوابة ديفندر..

تعلم كيفية حماية وكلاء الذكاء الاصطناعي لديك (معاينة).

تقليل المخاطر على تطبيقات الذكاء الاصطناعي التوليدية

يوفر إدارة وضع الأمان السحابي في Defender رؤى سياقية حول الوضع الأمني الذكاء الاصطناعي لمؤسستك. يمكنك تقليل المخاطر ضمن أعباء العمل الذكاء الاصطناعي باستخدام توصيات الأمان وتحليل مسار الهجوم.

استكشف المخاطر باستخدام التوصيات

يقيم Defender for Cloud الذكاء الاصطناعي أحمال العمل. تصدر توصيات حول الهوية، وأمن البيانات، والتعرض للإنترنت لمساعدتك في تحديد وتحديد أولويات قضايا الأمن الحرجة.

الكشف عن التكوينات الخاطئة ل IaC

يكتشف أمان DevOps أخطاء في تكوين IaC، مما قد يعرض تطبيقات الذكاء الاصطناعي التوليدية لثغرات أمنية، مثل ضوابط الوصول المكشوفة بشكل مفرط أو الخدمات التي تكشف عن غير قصد. قد تؤدي هذه التكوينات الخاطئة إلى خرق البيانات والوصول غير المصرح به ومشكلات التوافق، خاصة عند التعامل مع لوائح خصوصية البيانات الصارمة.

يقوم Defender for Cloud بتقييم إعدادات تطبيقات الذكاء الاصطناعي التوليدي لديك ويقدم توصيات أمنية لتحسين وضعك الذكاء الاصطناعي الأماني.

لمنع المشاكل المعقدة لاحقا، قم بالمعالجة التي تم الكشف عن تكوينات خاطئة في وقت مبكر من دورة التطوير.

تتضمن عمليات التحقق من الأمان الحالية الذكاء الاصطناعي IaC ما يلي:

- استخدام نقاط النهاية الخاصة لخدمة Azure الذكاء الاصطناعي

- تقييد نقاط نهاية خدمة Azure الذكاء الاصطناعي

- استخدام الهوية المدارة لحسابات خدمة Azure الذكاء الاصطناعي

- استخدام المصادقة المستندة إلى الهوية لحسابات خدمة Azure الذكاء الاصطناعي

استكشاف المخاطر باستخدام تحليل مسار الهجوم

يكشف تحليل مسار الهجوم عن المخاطر التي تتعرض لها أحمال العمل الذكاء الاصطناعي ويخفف منها. قد تتعرض البيانات أثناء تأريض نماذج الذكاء الاصطناعي على بيانات محددة وضبط نموذج مدرب مسبقا على مجموعة بيانات محددة لتحسين أدائه في مهمة ذات صلة.

من خلال المراقبة المستمرة لأعباء العمل الذكاء الاصطناعي، يمكن لتحليل مسار الهجوم تحديد نقاط الضعف والثغرات المحتملة والمتابعة بتوصيات. بالإضافة إلى ذلك، فإنه يمتد إلى الحالات التي يتم فيها توزيع البيانات وموارد الحوسبة عبر Azure وAWS وGCP.