Poznámka:

Přístup k této stránce vyžaduje autorizaci. Můžete se zkusit přihlásit nebo změnit adresáře.

Přístup k této stránce vyžaduje autorizaci. Můžete zkusit změnit adresáře.

PLATÍ PRO: Všechny úrovně služby správy rozhraní API

Koncové body jazykového modelu kompatibilní s OpenAI můžete importovat do instance služby API Management nebo importovat nekompatibilní modely jako předávací rozhraní API. Můžete například spravovat místní llmy nebo ty, které jsou hostované na jiných poskytovatelích odvozování než Foundry Tools. Pomocí zásad brány AI a dalších funkcí služby API Management můžete zjednodušit integraci, zlepšit pozorovatelnost a zlepšit kontrolu nad koncovými body modelu.

Další informace o správě rozhraní API AI ve službě API Management:

- Funkce brány AI v Azure API Management

Typy rozhraní API jazykového modelu

API Management podporuje dva typy rozhraní API jazykového modelu. Zvolte možnost, která odpovídá vašemu nasazení modelu, která určuje, jak klienti volají rozhraní API a jak se požadavky dostanou do služby AI.

Kompatibilní s OpenAI – koncové body jazykového modelu kompatibilní s rozhraním API OpenAI Mezi příklady patří Hugging Face Text Generation Inference (TGI) a Google Gemini API.

Služba API Management konfiguruje koncový bod dokončení chatu.

Passthrough – Koncové body jazykového modelu nejsou kompatibilní s rozhraním API OpenAI. Mezi příklady patří modely nasazené v Amazon Bedrocku nebo jiných poskytovatelích.

Služba API Management konfiguruje operace se zástupnými znaky pro běžné příkazy HTTP. Klienti můžou přidávat cesty k operacím se zástupnými znaky a služba API Management předává požadavky do backend systému.

Požadavky

- Existující instance služby API Management. Vytvořte ho, pokud jste to ještě neudělali.

- Nasazení jazykového modelu v místním prostředí nebo bez Azure s koncovým bodem rozhraní API.

Import rozhraní API jazykového modelu pomocí portálu

Importováním API rozhraní LLM se automaticky konfiguruje:

- Back-endový prostředek a zásady nastavení back-endové služby, které směrují požadavky na koncový bod LLM.

- (volitelně) Přístup pomocí přístupového klíče (chráněný jako tajný kód pojmenované hodnoty)

- (volitelně) Zásady pro monitorování a správu rozhraní API

Chcete-li importovat rozhraní API jazykového modelu:

Na portálu Azure přejděte do instance služby API Management.

V nabídce vlevo v části APIs vyberte APIs>+ Přidat API.

V části Definovat nové rozhraní API vyberte rozhraní API jazykového modelu.

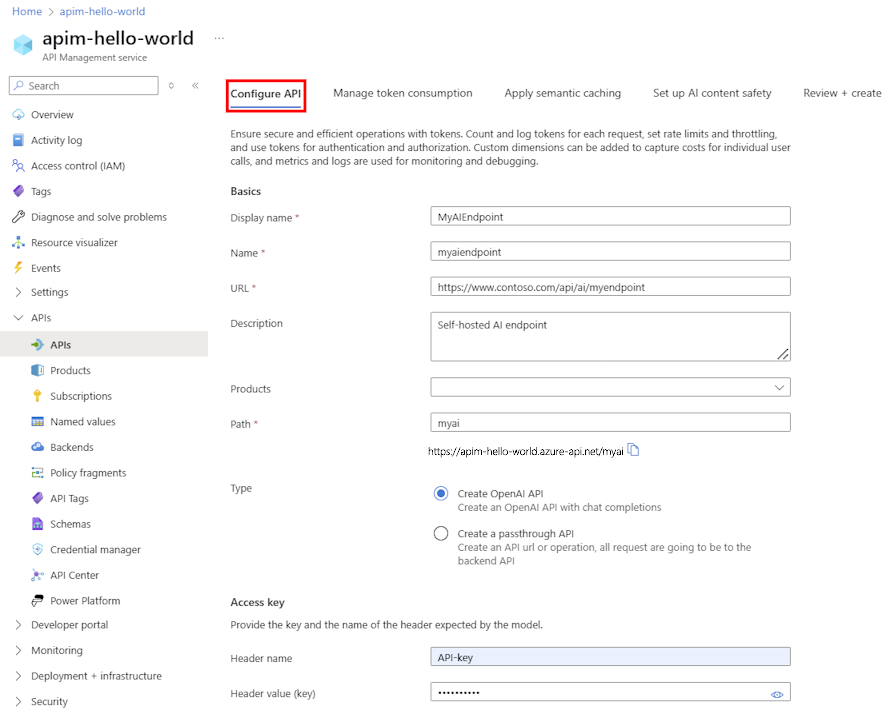

Na kartě Konfigurovat rozhraní API :

- Zadejte zobrazovaný název a popis (volitelné).

- Zadejte adresu URL rozhraní API LLM.

- Vyberte jeden nebo více produktů , které chcete přidružit k rozhraní API (volitelné).

- V cestě připojte cestu pro přístup k rozhraní LLM API.

- Vyberte buď vytvořit rozhraní API OpenAI, nebo vytvořit propojovací rozhraní API. Viz typy rozhraní API jazykového modelu.

- Zadejte název autorizační hlavičky a klíč rozhraní API (v případě potřeby).

- Vyberte Další.

Na kartě Správa spotřeby tokenů zadejte nastavení nebo přijměte výchozí hodnoty pro následující zásady:

Na kartě Použít sémantické ukládání do mezipaměti zadejte nastavení nebo přijměte výchozí hodnoty zásad pro optimalizaci výkonu a snížení latence:

Na kartě AI zabezpečení obsahu zadejte nastavení nebo přijměte výchozí hodnoty pro konfiguraci Azure AI Content Safety pro blokování nebezpečného obsahu:

Vyberte Zkontrolovat.

Po ověření vyberte Vytvořit.

API Management vytvoří rozhraní API a nakonfiguruje operace pro koncové body LLM. Ve výchozím nastavení rozhraní API vyžaduje předplatné služby API Management.

Testování rozhraní LLM API

Ověřte své rozhraní LLM API v testovací konzole.

Vyberte rozhraní API, které jste vytvořili.

Vyberte kartu Test.

Vyberte operaci kompatibilní s nasazením modelu. Zobrazí se pole pro parametry a záhlaví.

Zadejte parametry a záhlaví. V závislosti na operaci podle potřeby nakonfigurujte nebo aktualizujte text požadavku .

Poznámka:

Testovací konzole automaticky přidá hlavičku Ocp-Apim-Subscription-Key (použitím integrovaného předplatného se všemi přístupy), což umožňuje přístup ke všem rozhraním API. Pokud ho chcete zobrazit, vyberte ikonu oka vedle požadavku HTTP.

Vyberte Odeslat.

Pokud je test úspěšný, back-end vrátí data, včetně metrik využití tokenů pro monitorování spotřeby jazykového modelu.

Související obsah

- Funkce brány AI v Azure API Management