Integrace s klientskou aplikací pomocí sady Speech SDK

Důležité

Vlastní příkazy budou vyřazeny 30. dubna 2026. Od 30. října 2023 nemůžete v sadě Speech Studio vytvářet nové aplikace Vlastních příkazů. V souvislosti s touto změnou bude služba LUIS vyřazena 1. října 2025. Od 1. dubna 2023 nemůžete vytvářet nové prostředky LUIS.

V tomto článku se dozvíte, jak provádět požadavky na publikovanou aplikaci Custom Commands ze sady Speech SDK spuštěné v aplikaci pro UPW. Pokud chcete vytvořit připojení k aplikaci Vlastní příkazy, potřebujete:

- Publikování aplikace Vlastních příkazů a získání identifikátoru aplikace (ID aplikace)

- Vytvoření klientské aplikace pro Univerzální platforma Windows (UPW) pomocí sady Speech SDK, která vám umožní komunikovat s aplikací Custom Commands

Požadavky

K dokončení tohoto článku se vyžaduje aplikace Vlastní příkazy. Vyzkoušejte rychlý start k vytvoření vlastní aplikace příkazů:

Budete také muset:

- Visual Studio 2019 nebo novější Tato příručka je založená na sadě Visual Studio 2019.

- Klíč a oblast prostředku Azure AI Speech: Vytvořte prostředek služby Speech na webu Azure Portal. Další informace najdete v tématu Vytvoření prostředku s více službami.

- Povolení vývoje zařízení

Krok 1: Publikování aplikace Vlastních příkazů

Otevřete dříve vytvořenou aplikaci Custom Commands.

Přejděte na Nastavení a vyberte prostředek SLUŽBY LUIS.

Pokud není přiřazen prostředek predikce, vyberte klíč předpovědi dotazu nebo vytvořte nový.

Před publikováním aplikace se vždy vyžaduje prediktivní klíč dotazu. Další informace o prostředcích SLUŽBY LUIS najdete v tématu Vytvoření prostředku SLUŽBY LUIS.

Vraťte se k úpravám příkazů a vyberte Publikovat.

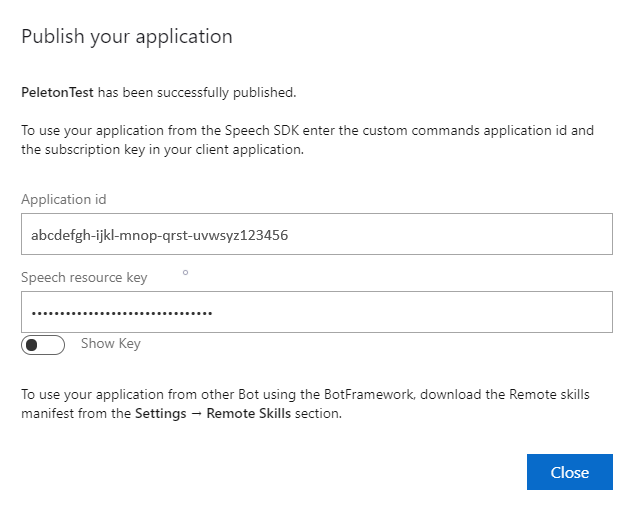

Zkopírujte ID aplikace z oznámení publikovat pro pozdější použití.

Zkopírujte klíč prostředku služby Speech pro pozdější použití.

Krok 2: Vytvoření projektu sady Visual Studio

Vytvořte projekt sady Visual Studio pro vývoj pro UPW a nainstalujte sadu Speech SDK.

Krok 3: Přidání ukázkového kódu

V tomto kroku přidáme kód XAML, který definuje uživatelské rozhraní aplikace, a přidáme implementaci kódu jazyka C#.

Kód XAML

Vytvořte uživatelské rozhraní aplikace přidáním kódu XAML.

V Průzkumník řešení otevřete

MainPage.xamlV zobrazení XAML návrháře nahraďte celý obsah následujícím fragmentem kódu:

<Page x:Class="helloworld.MainPage" xmlns="http://schemas.microsoft.com/winfx/2006/xaml/presentation" xmlns:x="http://schemas.microsoft.com/winfx/2006/xaml" xmlns:local="using:helloworld" xmlns:d="http://schemas.microsoft.com/expression/blend/2008" xmlns:mc="http://schemas.openxmlformats.org/markup-compatibility/2006" mc:Ignorable="d" Background="{ThemeResource ApplicationPageBackgroundThemeBrush}"> <Grid> <StackPanel Orientation="Vertical" HorizontalAlignment="Center" Margin="20,50,0,0" VerticalAlignment="Center" Width="800"> <Button x:Name="EnableMicrophoneButton" Content="Enable Microphone" Margin="0,10,10,0" Click="EnableMicrophone_ButtonClicked" Height="35"/> <Button x:Name="ListenButton" Content="Talk" Margin="0,10,10,0" Click="ListenButton_ButtonClicked" Height="35"/> <StackPanel x:Name="StatusPanel" Orientation="Vertical" RelativePanel.AlignBottomWithPanel="True" RelativePanel.AlignRightWithPanel="True" RelativePanel.AlignLeftWithPanel="True"> <TextBlock x:Name="StatusLabel" Margin="0,10,10,0" TextWrapping="Wrap" Text="Status:" FontSize="20"/> <Border x:Name="StatusBorder" Margin="0,0,0,0"> <ScrollViewer VerticalScrollMode="Auto" VerticalScrollBarVisibility="Auto" MaxHeight="200"> <!-- Use LiveSetting to enable screen readers to announce the status update. --> <TextBlock x:Name="StatusBlock" FontWeight="Bold" AutomationProperties.LiveSetting="Assertive" MaxWidth="{Binding ElementName=Splitter, Path=ActualWidth}" Margin="10,10,10,20" TextWrapping="Wrap" /> </ScrollViewer> </Border> </StackPanel> </StackPanel> <MediaElement x:Name="mediaElement"/> </Grid> </Page>

Návrhové zobrazení se aktualizuje tak, aby zobrazoval uživatelské rozhraní aplikace.

Zdrojový kód jazyka C#

Přidejte zdroj kódu za kódem, aby aplikace fungovala podle očekávání. Zdroj kódu za kódem zahrnuje:

- Požadované

usingpříkazy pro oborySpeechnázvů aSpeech.Dialogobory názvů. - Jednoduchá implementace, která zajistí přístup k mikrofonu, drátové připojení k obslužné rutině tlačítka.

- Základní pomocné rutiny uživatelského rozhraní k prezentování zpráv a chyb v aplikaci

- Cílový bod pro inicializační cestu kódu.

- Pomocná rutina pro přehrání textu na řeč (bez podpory streamování)

- Obslužná rutina prázdného tlačítka, která začne naslouchat.

Přidejte zdroj kódu následujícím způsobem:

V Průzkumník řešení otevřete zdrojový soubor

MainPage.xaml.cskódu (seskupený podMainPage.xaml)Obsah souboru nahraďte následujícím kódem:

using Microsoft.CognitiveServices.Speech; using Microsoft.CognitiveServices.Speech.Audio; using Microsoft.CognitiveServices.Speech.Dialog; using System; using System.IO; using System.Text; using Windows.UI.Xaml; using Windows.UI.Xaml.Controls; using Windows.UI.Xaml.Media; namespace helloworld { public sealed partial class MainPage : Page { private DialogServiceConnector connector; private enum NotifyType { StatusMessage, ErrorMessage }; public MainPage() { this.InitializeComponent(); } private async void EnableMicrophone_ButtonClicked( object sender, RoutedEventArgs e) { bool isMicAvailable = true; try { var mediaCapture = new Windows.Media.Capture.MediaCapture(); var settings = new Windows.Media.Capture.MediaCaptureInitializationSettings(); settings.StreamingCaptureMode = Windows.Media.Capture.StreamingCaptureMode.Audio; await mediaCapture.InitializeAsync(settings); } catch (Exception) { isMicAvailable = false; } if (!isMicAvailable) { await Windows.System.Launcher.LaunchUriAsync( new Uri("ms-settings:privacy-microphone")); } else { NotifyUser("Microphone was enabled", NotifyType.StatusMessage); } } private void NotifyUser( string strMessage, NotifyType type = NotifyType.StatusMessage) { // If called from the UI thread, then update immediately. // Otherwise, schedule a task on the UI thread to perform the update. if (Dispatcher.HasThreadAccess) { UpdateStatus(strMessage, type); } else { var task = Dispatcher.RunAsync( Windows.UI.Core.CoreDispatcherPriority.Normal, () => UpdateStatus(strMessage, type)); } } private void UpdateStatus(string strMessage, NotifyType type) { switch (type) { case NotifyType.StatusMessage: StatusBorder.Background = new SolidColorBrush( Windows.UI.Colors.Green); break; case NotifyType.ErrorMessage: StatusBorder.Background = new SolidColorBrush( Windows.UI.Colors.Red); break; } StatusBlock.Text += string.IsNullOrEmpty(StatusBlock.Text) ? strMessage : "\n" + strMessage; if (!string.IsNullOrEmpty(StatusBlock.Text)) { StatusBorder.Visibility = Visibility.Visible; StatusPanel.Visibility = Visibility.Visible; } else { StatusBorder.Visibility = Visibility.Collapsed; StatusPanel.Visibility = Visibility.Collapsed; } // Raise an event if necessary to enable a screen reader // to announce the status update. var peer = Windows.UI.Xaml.Automation.Peers.FrameworkElementAutomationPeer.FromElement(StatusBlock); if (peer != null) { peer.RaiseAutomationEvent( Windows.UI.Xaml.Automation.Peers.AutomationEvents.LiveRegionChanged); } } // Waits for and accumulates all audio associated with a given // PullAudioOutputStream and then plays it to the MediaElement. Long spoken // audio will create extra latency and a streaming playback solution // (that plays audio while it continues to be received) should be used -- // see the samples for examples of this. private void SynchronouslyPlayActivityAudio( PullAudioOutputStream activityAudio) { var playbackStreamWithHeader = new MemoryStream(); playbackStreamWithHeader.Write(Encoding.ASCII.GetBytes("RIFF"), 0, 4); // ChunkID playbackStreamWithHeader.Write(BitConverter.GetBytes(UInt32.MaxValue), 0, 4); // ChunkSize: max playbackStreamWithHeader.Write(Encoding.ASCII.GetBytes("WAVE"), 0, 4); // Format playbackStreamWithHeader.Write(Encoding.ASCII.GetBytes("fmt "), 0, 4); // Subchunk1ID playbackStreamWithHeader.Write(BitConverter.GetBytes(16), 0, 4); // Subchunk1Size: PCM playbackStreamWithHeader.Write(BitConverter.GetBytes(1), 0, 2); // AudioFormat: PCM playbackStreamWithHeader.Write(BitConverter.GetBytes(1), 0, 2); // NumChannels: mono playbackStreamWithHeader.Write(BitConverter.GetBytes(16000), 0, 4); // SampleRate: 16kHz playbackStreamWithHeader.Write(BitConverter.GetBytes(32000), 0, 4); // ByteRate playbackStreamWithHeader.Write(BitConverter.GetBytes(2), 0, 2); // BlockAlign playbackStreamWithHeader.Write(BitConverter.GetBytes(16), 0, 2); // BitsPerSample: 16-bit playbackStreamWithHeader.Write(Encoding.ASCII.GetBytes("data"), 0, 4); // Subchunk2ID playbackStreamWithHeader.Write(BitConverter.GetBytes(UInt32.MaxValue), 0, 4); // Subchunk2Size byte[] pullBuffer = new byte[2056]; uint lastRead = 0; do { lastRead = activityAudio.Read(pullBuffer); playbackStreamWithHeader.Write(pullBuffer, 0, (int)lastRead); } while (lastRead == pullBuffer.Length); var task = Dispatcher.RunAsync( Windows.UI.Core.CoreDispatcherPriority.Normal, () => { mediaElement.SetSource( playbackStreamWithHeader.AsRandomAccessStream(), "audio/wav"); mediaElement.Play(); }); } private void InitializeDialogServiceConnector() { // New code will go here } private async void ListenButton_ButtonClicked( object sender, RoutedEventArgs e) { // New code will go here } } }Poznámka:

Pokud se zobrazí chyba Typu Object je definován v sestavení, na které není odkazováno.

- Řešení se chytá správně.

- Zvolte Spravovat balíčky NuGet pro řešení, vyberte Aktualizace

- Pokud se v seznamu aktualizací zobrazí Microsoft.NETCore.UniversalWindowsPlatform , aktualizujte Microsoft.NETCore.UniversalWindowsPlatform na nejnovější verzi.

Do textu metody přidejte následující kód:

InitializeDialogServiceConnector// This code creates the `DialogServiceConnector` with your resource information. // create a DialogServiceConfig by providing a Custom Commands application id and Speech resource key // The RecoLanguage property is optional (default en-US); note that only en-US is supported in Preview const string speechCommandsApplicationId = "YourApplicationId"; // Your application id const string speechSubscriptionKey = "YourSpeechSubscriptionKey"; // Your Speech resource key const string region = "YourServiceRegion"; // The Speech resource region. var speechCommandsConfig = CustomCommandsConfig.FromSubscription(speechCommandsApplicationId, speechSubscriptionKey, region); speechCommandsConfig.SetProperty(PropertyId.SpeechServiceConnection_RecoLanguage, "en-us"); connector = new DialogServiceConnector(speechCommandsConfig);Nahraďte řetězce

YourApplicationIdaYourSpeechSubscriptionKeyYourServiceRegionvlastními hodnotami pro vaši aplikaci, klíč řeči a oblast.Na konec textu metody připojte následující fragment kódu.

InitializeDialogServiceConnector// // This code sets up handlers for events relied on by `DialogServiceConnector` to communicate its activities, // speech recognition results, and other information. // // ActivityReceived is the main way your client will receive messages, audio, and events connector.ActivityReceived += (sender, activityReceivedEventArgs) => { NotifyUser( $"Activity received, hasAudio={activityReceivedEventArgs.HasAudio} activity={activityReceivedEventArgs.Activity}"); if (activityReceivedEventArgs.HasAudio) { SynchronouslyPlayActivityAudio(activityReceivedEventArgs.Audio); } }; // Canceled will be signaled when a turn is aborted or experiences an error condition connector.Canceled += (sender, canceledEventArgs) => { NotifyUser($"Canceled, reason={canceledEventArgs.Reason}"); if (canceledEventArgs.Reason == CancellationReason.Error) { NotifyUser( $"Error: code={canceledEventArgs.ErrorCode}, details={canceledEventArgs.ErrorDetails}"); } }; // Recognizing (not 'Recognized') will provide the intermediate recognized text // while an audio stream is being processed connector.Recognizing += (sender, recognitionEventArgs) => { NotifyUser($"Recognizing! in-progress text={recognitionEventArgs.Result.Text}"); }; // Recognized (not 'Recognizing') will provide the final recognized text // once audio capture is completed connector.Recognized += (sender, recognitionEventArgs) => { NotifyUser($"Final speech to text result: '{recognitionEventArgs.Result.Text}'"); }; // SessionStarted will notify when audio begins flowing to the service for a turn connector.SessionStarted += (sender, sessionEventArgs) => { NotifyUser($"Now Listening! Session started, id={sessionEventArgs.SessionId}"); }; // SessionStopped will notify when a turn is complete and // it's safe to begin listening again connector.SessionStopped += (sender, sessionEventArgs) => { NotifyUser($"Listening complete. Session ended, id={sessionEventArgs.SessionId}"); };Do těla

ListenButton_ButtonClickedmetody veMainPagetřídě přidejte následující fragment kódu.// This code sets up `DialogServiceConnector` to listen, since you already established the configuration and // registered the event handlers. if (connector == null) { InitializeDialogServiceConnector(); // Optional step to speed up first interaction: if not called, // connection happens automatically on first use var connectTask = connector.ConnectAsync(); } try { // Start sending audio await connector.ListenOnceAsync(); } catch (Exception ex) { NotifyUser($"Exception: {ex.ToString()}", NotifyType.ErrorMessage); }V řádku nabídek zvolte Uložit vše,>aby se změny uložily.

Vyzkoušejte si to.

Na řádku nabídek zvolte Sestavit>řešení a sestavte aplikaci. Kód by se měl zkompilovat bez chyb.

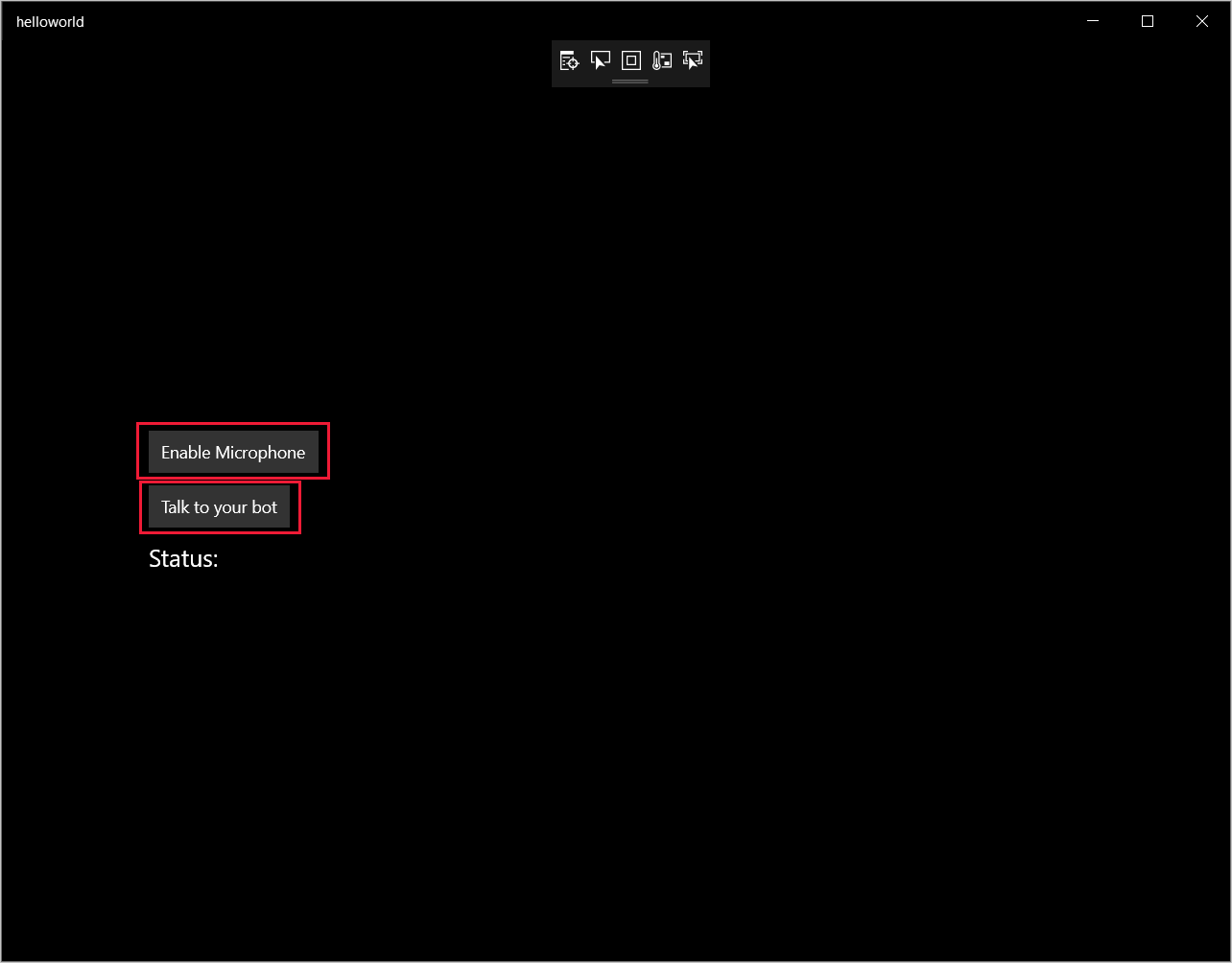

Zvolte Spustit ladění (nebo stiskněte klávesu F5) a spusťte aplikaci.> Zobrazí se okno helloworld .

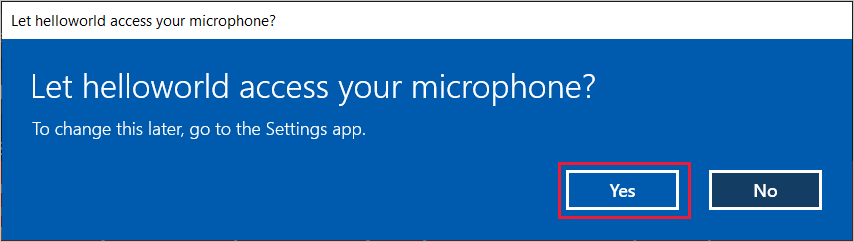

Vyberte Povolit mikrofon. Pokud se zobrazí žádost o přístupová oprávnění, vyberte Ano.

Vyberte Talk (Talk) a mluvte anglicky frázi nebo větu do mikrofonu zařízení. Vaše řeč se přenese do kanálu Direct Line Speech a přepíše se na text, který se zobrazí v okně.

Další kroky

Váš názor

Připravujeme: V průběhu roku 2024 budeme postupně vyřazovat problémy z GitHub coby mechanismus zpětné vazby pro obsah a nahrazovat ho novým systémem zpětné vazby. Další informace naleznete v tématu: https://aka.ms/ContentUserFeedback.

Odeslat a zobrazit názory pro