Poznámka:

Přístup k této stránce vyžaduje autorizaci. Můžete se zkusit přihlásit nebo změnit adresáře.

Přístup k této stránce vyžaduje autorizaci. Můžete zkusit změnit adresáře.

Tento článek navrhuje podrobný proces migrace velkých objemů dat. Při přenosu dat z výkonného cloudového CRM je důležité pečlivě naplánovat kvůli složitému nastavení – jako jsou vlastní objekty, propojení mezi daty a jedinečné ID záznamů. Musíte se zamyslet nad technickými kroky a s tím, jak migrace funguje v praxi.

- Technický přístup: Popisuje klíčové kroky migrace – extrakci, transformaci a načítání dat do služby Dataverse – a zároveň zajišťuje integritu, zachování vztahů a optimalizaci výkonu prostřednictvím ověřování a zpracování chyb.

- Funkční přístup: Řeší úlohy funkční migrace, jako jsou segmentace dat a archivace, a zdůrazňuje nutnost zapojit obchodní účastníky, aby data splňovala jejich potřeby.

Technický přístup k migraci dat

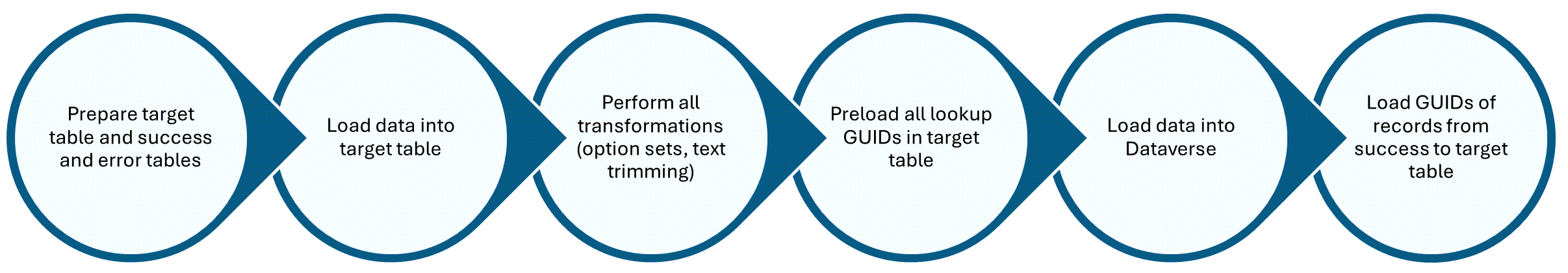

Zajištění bezproblémové migrace pomocí strukturovaného přístupu – extrakce, transformace a načítání dat při zachování integrity a minimalizace přerušení.

Extrakce dat ze zdroje do přechodové databáze

Pro složité migrace dat doporučujeme připravit data v samostatné databázi (například SQL Server). Tato pracovní oblast zachycuje snímek zdrojového systému bez přerušení probíhajících obchodních operací.

Klíčové aspekty:

- Úplná vs. přírůstková zátěž: Uspořádejte data jako úplné nebo přírůstkové zátěže. Pomocí automaticky vygenerovaných časových razítek můžete sledovat doručení dat a identifikovat změny pro budoucí načtení.

- Zpracování převzetí služeb při selhání: Navrhněte proces tak, aby přeskočil neúspěšné záznamy (například kvůli délce pole, neplatné vyhledávání) bez zastavení migrace. Protokolujte a vyřešte problémy před opětovnou úpravou.

- Mapování polí: Před migrací dat do služby Dataverse převeďte zdrojové hodnoty tak, aby odpovídaly cílovým formátům v pracovní vrstvě a rozsahech hodnot v pracovní databázi, aby se zlepšila efektivita.

- Ověření dat: Spusťte kontroly integrity a zachyťte problémy, jako jsou chybějící odkazy. Vzhledem k tomu, že extrakce dat může přesahovat hodiny nebo dny, použijte přípravnou vrstvu k filtrování neúplných záznamů a zajištění konzistence.

- Vizualizace dat: Před dokončením migrace použijte přípravnou databázi k auditování a analýze dat , například spočítat záznamy nebo součet finančních polí.

Transformace dat do cílové stagingové databáze

Po extrakci dat ze zdrojového systému je transformujte do cílové pracovní databáze, která zrcadlí schéma Dataverse a obsahuje hodnoty připravené pro přímé vložení nebo aktualizaci.

Klíčové kroky transformace:

Mapování polí: Namapovat zdrojové sloupce na cílové sloupce Dataverse. Pomocí skriptů můžete v případě potřeby spojit a sloučit tabulky.

Převod sady možností: Převeďte textové hodnoty sady možností na celá čísla Dataverse pomocí tabulky mapování (například OptionSetMapping) a hromadných aktualizačních dotazů. Vytvořte tabulku pro standardizaci a automatizaci transformace hodnot sady možností ze zdroje do cílových systémů.

Tabulka: OptionSetMapping

Název sloupce Datový typ Název zdrojové tabulky řetězec Název cílové tabulky řetězec Zdrojový text řetězec Cílový text řetězec Cílová hodnota řetězec Pomocí tabulky OptionSetMapping můžete efektivně transformovat a aktualizovat hodnoty sady možností hromadně. Chcete-li například aktualizovat všechny hodnoty sady možností v tabulce Kontaktů na základě odpovídajících textových hodnot:

Update C.\<OptionsetValue\> = M.\<TargetValue\> FROM Contact C JOIN OptionsetMapping M ON C.OptionsetText = M.TargetText AND M.TargetTableName = 'Contact'Vyhněte se vlastním identifikátorům GUID: Nechte Dataverse generovat identifikátory GUID, aby se zabránilo problémům s fragmentací a výkonem.

Kontroly délky řetězců: Zajistěte, aby hodnoty řetězců odpovídaly omezením dataverse. Ořízněte nebo upravte podle potřeby.

Počítaná pole: Přidejte odvozená pole (například Název pro vyhledávání), pokud ve zdroji chybí.

Další aspekty: Při navrhování tabulek tak, aby odpovídaly schématu Dataverse, zvažte následující klíčové sloupce a podpůrné tabulky.

- DataMigration_CreatedDateTime: Automaticky vyplněný časový záznam pro sledování náložů dat.

- Příznak akce: Označuje vložení (I), aktualizaci (U) nebo odstranění (D).

- Příznak zpracování: Sleduje stav – Zpracováno (P), Nezpracované (U), Chyba (E) nebo Úspěch (S).

- Jedinečný sloupec: K mapování záznamů použijte jedinečné ID (například jedinečné ID ze zdrojového systému).

- Tabulky success/Error: Udržujte samostatné tabulky (například Contact_Success, Contact_Error) pro protokolování výsledků a podporu opakování.

Sekvenční tabulky a přednačítání vyhledávání

Po statických transformacích můžete tabulky uspořádat tak, aby se snížily cyklické závislosti – případy, kdy tabulky vzájemně odkazují a znemožňují izolované importy. Použijte tento přístup:

- Zobrazí seznam všech tabulek způsobilých k migraci.

- Počet jedinečných vyhledávání pro jednotlivé tabulky (ignorujte standardní pole jako

Created Bya další dotazy na tabulky, pokud nemigrujete). - Seřaďte tabulky vzestupně podle počtu vyhledávání.

- Zahrňte tabulky relací N:N, které počítají obě vyhledávání.

- Vylučte vyhledávání s více tabulkami (například pole týkající se).

Tento přístup definuje sekvenci zatížení migrace dat a ve většině scénářů dobře funguje. Složitější případy:

- K porovnání záznamů mezi přípravou a Dataverse při generování identifikátorů GUID během vložení použijte jedinečný identifikátor (například importsequencenumber).

- Oddělte protokoly úspěšnosti a chyb, abyste se vyhnuli problémům s uzamčením a zlepšili výkon.

- Předem načtěte identifikátory GUID vyhledávání z již migrovaných tabulek pro řešení odkazů během vkládání.

- Řešte cyklické závislosti pomocí:

- Vkládání záznamů bez závislých vyhledávání

- Aktualizace těchto vyhledávání po načtení souvisejících záznamů.

Načtení dat do Služby Dataverse

Dalším krokem je určení a implementace přístupu k načítání dat do služby Dataverse.

Nástroje: Výběr nástroje na základě velikosti a složitosti dat:

- Nástroj pro migraci konfigurace sady SDK

- Azure Data Factory

- KingswaySoft

- Písař

- Datový transportér XrmToolBox

Klíčové aspekty (nezávislé na nástrojích):

Zpracování cyklické závislosti: Načtení sekvenční tabulky pro minimalizaci cyklických vyhledávání. Vložte záznamy bez závislých vyhledávání a aktualizujte je později.

Sledování ID záznamů: Zachytávání identifikátorů GUID služby Dataverse v tabulce úspěchu a následné aktualizace hlavní tabulky pomocí jedinečného identifikátoru (například importequencenumber).

Optimalizace velikosti dávky a počtu vláken: Projděte si pokyny pro optimalizaci výkonu pro hromadné operace. Aplikace, kterou používáte, musí spravovat chyby ochrany služeb, ke kterým dochází, když se do služby Dataverse odesílají mimořádné počty požadavků. Pokud napíšete vlastní kód a použijete webové rozhraní API Dataverse, ujistěte se, že opakujete chyby 429, jak je popsáno v omezeních rozhraní API ochrany služeb. Pokud používáte sadu Dataverse SDK, spravuje tyto chyby za vás.

Pokud chcete dosáhnout optimálního výkonu, vylaďte velikost dávky a počet vláken na základě složitosti tabulky:

- Předem vytvořené tabulky (například Contact, Account, Lead): Tyto tabulky jsou pomalejší kvůli vestavěným pluginům a úlohám. Doporučeno: Velikost dávky 200–300, až 30 vláken (pokud je ≤10 vyhledávání a 50–70 sloupců).

- Jednoduché tabulky (málo nebo žádné vyhledávání): Doporučeno: velikost dávky ≤10, až 50 vláken.

- Středně složité vlastní tabulky (některé vyhledávání): Doporučeno: Velikost dávky ≤100 až 30 vláken.

- Velké/složité tabulky (>100 sloupců, >20 vyhledávání): Doporučeno: Velikost dávky 10–20, až 10–20 vláken, aby se snížily chyby.

Tipy pro infrastrukturu: Pokud chcete maximalizovat výkon migrace dat, spusťte migraci z virtuálního počítače umístěného ve stejné oblasti jako prostředí Dataverse. Tento přístup výrazně snižuje latenci a urychluje celý proces. Zjistěte, jak určit oblast prostředí Dataverse.

Zpracování chyb: Neignorujte chyby – vyřešte je, abyste zabránili kaskádovým selháním. Pomocí výchozích hodnot (například prázdných vyhledávání, výchozích hodnot v sadě možností) můžete vkládat zástupné záznamy a zachytit identifikátory GUID.

Aktualizace stavu: Aktivní stav nastavte pouze během počátečního vložení záznamu. U neaktivních záznamů nebo vlastních stavových kódů je po ověření dat aktualizujte. U většiny vlastních tabulek můžou aktualizace stavu následovat hned po vložení. U speciálních tabulek, jako jsou Případ, Příležitost nebo Zájemce, se ale aktualizace stavu zpozdí až do konce migrace. Po zavření těchto záznamů není možné je upravovat, pokud se znovu neotevře – časově náročný proces, který riskuje integritu dat.

Vlastnictví a zabezpečení: Nastavení správného vlastníka záznamu během vkládání dat, protože zabezpečení uživatelských i obchodních jednotek v Dataverse jsou svázané s organizační jednotkou vlastníka. Přiřaďte správnou organizační jednotku při vytváření – aktualizování této jednotky poté odebere všechny role zabezpečení.

-

Použijte zástupné uživatele:

- Dataverse podporuje zástupné uživatele (nelicencované), kteří jsou užiteční pro rozsáhlé nebo historické migrace. Uživatelům šablon se automaticky přiřadí role zabezpečení prodejce – tuto roli nepřejmenovávejte ani neupravujte. Uživatelé typu 'stub' mohou vlastnit záznamy, pokud mají práva ke čtení na uživatelské úrovni k příslušným tabulkám.

-

Doporučení:

- Během migrace vytvořte všechny nelicencované uživatele se správnou obchodní jednotkou nastavenou při vložení.

- Po vytvoření neměňte organizační jednotku – odeberete tak všechny role, včetně prodejce.

- Ujistěte se, že má role obchodníka přístup pro čtení ke všem tabulkám vhodným pro migraci.

- I uživatelé zakázaní v prostředí Dataverse s touto rolí můžou vlastnit záznamy.

-

Použijte zástupné uživatele:

Zpracování měny: Nastavení kurzů měnového převodu během vložení pomocí pluginu předběžného ověření, protože Dataverse nepodporuje historické sazby.

Publikování načtení dat do Dataverse

Po načtení dat do služby Dataverse postupujte podle těchto kroků, abyste zajistili integritu dat a minimalizovali podřízené problémy:

Aktualizujte hlavní tabulku pomocí identifikátorů GUID:

- Po úspěšném načtení zkopírujte identifikátory GUID záznamu Dataverse z tabulky Success do hlavní tabulky pomocí jedinečného identifikátoru, například

importsequencenumber. - Aktualizujte příznak zpracování, aby označoval záznamy jako:

- P – zpracováno

- E – Chyba

- U – Nezpracovaná Tato strategie umožňuje efektivní opakované spuštění přeskočením již zpracovaných záznamů a podporuje vyřešení vyhledávání v následných zátěžích.

- Po úspěšném načtení zkopírujte identifikátory GUID záznamu Dataverse z tabulky Success do hlavní tabulky pomocí jedinečného identifikátoru, například

Opakování neúspěšných záznamů: Pokud chcete omezit opakování a zachovat referenční integritu, zvažte tyto akce:

- Oříznout řetězcové hodnoty, pokud překročí povolené délky.

- Pokud mapování chybí, použijte výchozí hodnoty sady možností.

- Pokud není původní vlastník k dispozici (ani jako náhradní uživatel), přiřaďte náhradního vlastníka.

- Pro nevyřešené vyhledávání použijte prázdné nebo výchozí hodnoty.

- I zástupné záznamy můžou pomoct generovat identifikátory GUID potřebné pro vyhledávání v souvisejících tabulkách.

Použití elastických tabulek pro migraci dat

Elastické tabulky jsou navržené tak, aby zpracovávaly velké objemy dat v reálném čase. S elastickými tabulkami můžete importovat, ukládat a analyzovat velké objemy dat bez problémů se škálovatelností, latencí nebo výkonem.

Elastické tabulky nabízejí jedinečné možnosti pro flexibilní schéma, horizontální škálování a automatické odebrání dat po určitém časovém období.

Elastické tabulky se ukládají ve službě Azure Cosmos DB a podporují:

- Data bez schématu prostřednictvím sloupců JSON

- Automatické horizontální škálování

- Hodnota TTL (Time to Live) pro automatické odstranění zastaralých dat

- Dělení pro optimalizaci výkonu

Elastické tabulky jsou nejvhodnější pro hromadné importy se schématem proměnných.

Doporučené datové typy pro elastické tabulky během migrace dat

Elastické tabulky jsou ideální pro konkrétní datové typy.

| Datový typ | Description |

|---|---|

| Nezpracovaná data ingestace | Zdrojové protokoly, informační kanály senzorů nebo hromadné exporty ze starších systémů. Například protokoly interakce zákazníků ze starší verze ERP, starých e-mailových vláken a lístků podpory z předchozího systému. |

| Částečně strukturované záznamy | Data s volitelnými nebo vyvíjejícími poli, která neodpovídají pevnému schématu. Formuláře zpětné vazby zákazníků s nepovinnými poli nebo formuláře registrace událostí s vlastními poznámkami nebo značkami. |

| Přípravná data pro ověření | Dočasná zóna uchovávání před synchronizací dat s relačními tabulkami. Importovaná data potenciálních zákazníků například čekající na odstranění duplicitních dat a ověření před tím, než se přidají do hlavní tabulky potenciálních zákazníků. |

| Data citlivá na čas nebo vypršení platnosti | K automatickému odstranění dočasných záznamů CRM použijte hodnotu TTL (Time-to-Live). Například propagační slevové kódy vázané na kampaň, jednorázové přístupové odkazy pro průzkumy zákazníků nebo portály onboardingu a dočasné odpovědi na průzkumy. |

| Dělená objemová data | Rozdělení dat podle ID nebo kategorie za účelem zlepšení výkonu a škálovatelnosti Můžete například rozdělit oddíl podle ID účtu nebo ID oblasti během hromadné migrace dat nebo segmentovat protokoly aktivit zákazníků podle ID kampaně pro analýzu. |

Datové typy nevhodné pro elastické tabulky

Elastické tabulky jsou optimalizované pro flexibilní a vysoce škálovatelné scénáře, ale ne pro každý datový typ. V této části jsou zvýrazněny běžné vzory dat CRM, které jsou lépe uložené jinde, aby se zajistil výkon, nákladová efektivita a udržovatelnost. Další informace o funkcích, které v současné době nejsou u elastických tabulek podporované

| Datový typ | Důvod |

|---|---|

| Vysoce relační data | Elastické tabulky nepodporují spojení ani vyhledávání |

| Důležité obchodní záznamy | Žádná podpora transakční integrity nebo modulu plug-in |

| Data vyžadující komplexní ověření | Lepší zpracování ve standardních tabulkách pomocí obchodních pravidel |

Segmentace funkčních dat a archivní architektura

Efektivní technické plánování zahrnuje výběr správných nástrojů a infrastruktury, sladění zdrojových a cílových objemů dat a nastavení procesů auditování a odsouhlasení. Mnoho migrací se stává složitým z důvodu nedostatku počáteční analýzy, zejména ohledně toho, jaká data je potřeba přesunout a kam patří. Tato část popisuje základní principy analýzy dat, které podporují úspěšnou migraci.

Segmentace dat

Segmentace dat je klíčovým krokem při migraci z jednoho systému CRM do Služby Dataverse. Uspořádejte tabulky dat podle obchodních funkcí, jako je prodej, služba nebo marketing, a zjednodušte tak plánování a provádění migrace.

Segmentace tabulek

Začněte výpisem všech tabulek, které mají nárok na migraci, seskupené podle obchodní oblasti (například prodej, marketing, služba). Potom:

- Zdokumentujte schéma v Excelu nebo podobném nástroji.

- Spuštěním základních dotazů ve zdrojovém systému zkontrolujte využití sloupců.

- Označte sloupce s nízkým použitím. Pokud méně než 5% záznamů obsahuje hodnoty, obraťte se na obchodní zúčastněné strany a rozhodněte se, jestli je mají zachovat nebo zahodit.

Tato jednoduchá analýza může významně snížit rozsah migrace. V dlouhotrvajících systémech CRM je běžné eliminovat 30–40% sloupců a až 20% tabulek, zvyšovat proces a zlepšovat výkon.

Relevance sloupců

Některé zdrojové systémové sloupce se mapují přímo do Dataverse, zatímco jiné se promění na počítaná pole. Oddělte tyto sloupce a obraťte se na obchodní účastníky a rozhodněte se, jestli jsou potřeba úlohy migrace.

Ignorujte sloupce, které jsou relevantní pouze ve zdrojovém systému nebo ne smysluplné v cíli. To zahrnuje řadu předem zadaných polí, jako je Vytvoření uživatelem, Autor změny nebo Číslo verze řádku, pokud v migraci neslouží ke konkrétnímu účelu.

Data typu souboru

Pokud váš zdrojový systém obsahuje data typu souboru, označte tato pole včas a naplánujte samostatnou strategii migrace. Vezměte v úvahu následující typy souborů:

- Dokumenty Office (například Word, Excel, PowerPoint):: Až 20 000 souborů migrujte na platformu pro spolupráci, jako je SharePoint, aby bylo možné přístup více uživatelů.

- Multimediální soubory (například obrázky, videa): Vyberte platformu, která podporuje přehrávání. Mezi možnosti patří SharePoint, streamovací služby nebo jiná řešení úložiště vhodná pro média.

- Velké svazky nebo velikosti souborů: Pokud se jedná o náklady na úložiště, použijte Azure Blob Storage nebo nativní sloupec souborů ve službě Dataverse, který používá objekt blob Azure na pozadí.

- Ochrana před malwarem: Před migrací spusťte soubory prostřednictvím nástroje pro detekci malwaru (například Azure Advanced Threat Protection), abyste zajistili zabezpečení.

Po kontrole relevance souborů často zjistíte, že celkový objem dat výrazně klesá – zejména v dlouhotrvajících systémech CRM – a tím se migrace zefektivňuje.

Strategie archivace dat

Některá data, jako jsou staré e-maily, uzavřené případy nebo nekvalifikované zájemce, zůstávají důležitá, ale zřídka se k němu přistupuje. Pokud chcete snížit objem migrace bez narušení obchodních operací, vytvořte inteligentní strategii archivace.

Krok 1: Identifikace archivovatelných dat

Mezi běžné kandidáty patří:

- E-maily starší než tři roky

- Uzavřené případy

- Ztracené příležitosti

- Diskvalifikovaní zájemci

- Marketingové e-maily, příspěvky a protokoly auditu

Zkontrolujte systém a identifikujte další tabulky, které můžete archivovat.

Krok 2: Volba archivačního přístupu

- Uchovávejte data ve zdrojovém systému. Zachovejte několik licencí správce pro přístup a deaktivujte ostatní, abyste snížili náklady.

- Přesunutí do externího úložiště K ukládání archivovaných záznamů použijte místní databáze, Azure Blob Storage nebo tabulky Azure. Tento přístup snižuje náklady na úložiště a migraci, ale vyžaduje samostatnou strategii migrace.

- Použijte samostatné prostředí Dataverse. Tato možnost je méně běžná, ale je užitečná, pokud chcete izolovat archivovaná data. Toto prostředí můžete později vyřadit, abyste zjednodušili plánování přechodu.

Doporučená infrastruktura migrace dat

Zajištění rychlé a spolehlivé migrace dat do služby Dataverse:

- Ke snížení latence a zvýšení rychlosti migrace použijte virtuální počítač ve stejné oblasti jako prostředí Dataverse.

- Zvolte vysoce výkonný virtuální počítač. Virtuální počítač D4 s osmi jádry, 28 GB paměti RAM a 500 GB úložiště používejte k efektivnímu zpracování velkých objemů dat.

- Upřednostněte místní databázi na virtuálním počítači. Vyhněte se vzdáleným připojením během migrace. Pokud používáte Azure Data Factory, nasaďte ji ve stejné oblasti jako prostředí Dataverse, abyste mohli dosáhnout optimálního výkonu.