Vyhodnocení výkonu modelu

Vyhodnocení nasazeného modelu zajišťuje, že splňuje standardy kvality, poskytuje přesné odpovědi a průběžně se zlepšuje v průběhu času. Portál Microsoft Foundry nabízí více přístupů k vyhodnocení, od ručního testování po automatizované metriky a komplexní toky hodnocení.

Proč vyhodnocovat modely

Vyhodnocení slouží k několika kritickým účelům při vývoji generující aplikace AI:

Kontrola kvality identifikuje problémy a zajišťuje, že váš model poskytuje přesné a relevantní odpovědi. Zjišťování problémů během vyhodnocování místo produkce chrání vaše uživatele a reputaci vaší organizace.

Spokojenost uživatelů se zlepšuje, když modely konzistentně poskytují užitečné a vhodné odpovědi. Vyhodnocení vám pomůže pochopit, jak uživatelé vaši aplikaci ovlivňují a kde vylepšení mají největší dopad.

Průběžné vylepšování vychází z analýzy výsledků vyhodnocení za účelem identifikace příležitostí k vylepšením. Pravidelné vyhodnocení při aktualizaci výzev, přidání funkcí nebo opětovné natrénování modelů zajišťuje průběžnou kvalitu.

Dodržování předpisů a ověření bezpečnosti potvrzuje, že váš model dodržuje zásady, zabraňuje generování škodlivého obsahu a respektuje požadavky na ochranu osobních údajů a dat uživatelů.

Přístupy k ručnímu vyhodnocení

Ruční vyhodnocení zahrnuje lidské revidující, kteří hodnotí odpovědi modelu. I když je ruční vyhodnocení náročné na čas, poskytuje přehledy, které automatizované metriky nemůžou zachytit.

Interaktivní testování v dětském hřišti umožňuje kvalitativní zkoumání chování modelu. Můžete zadat různé výzvy, sledovat odpovědi a poznamenat problémy, jako jsou nesprávné informace, nevhodné tóny nebo selhání podle pokynů. Toto průzkumné testování vám pomůže pochopit silné a omezené možnosti modelu.

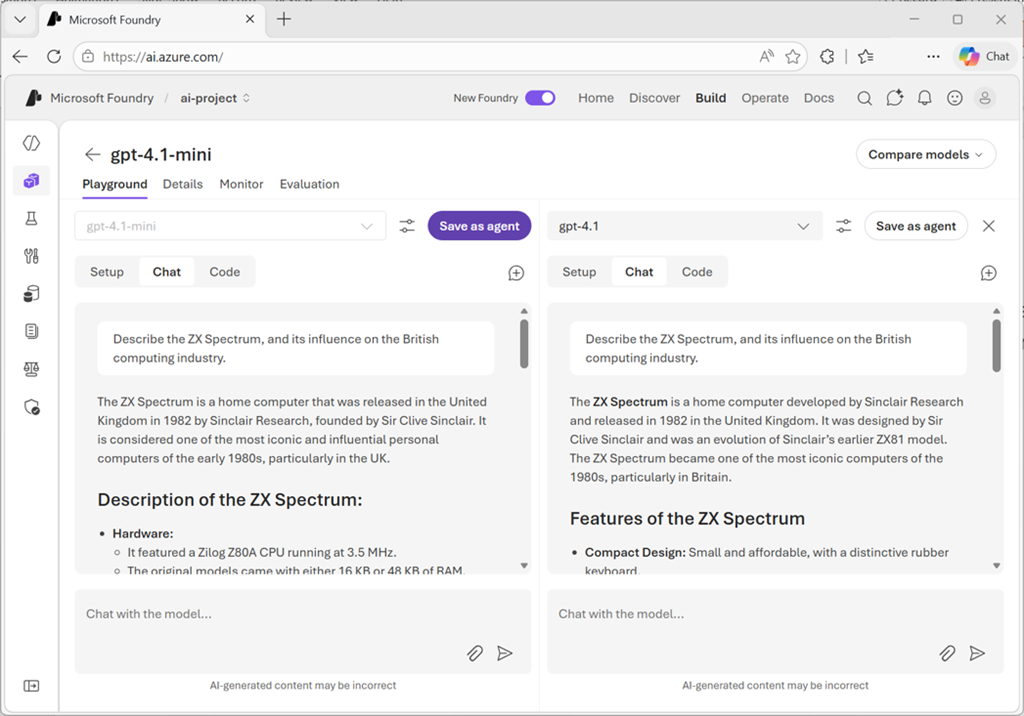

Pokud chcete usnadnit optimalizaci návrhu aplikace, můžete otestovat modely vedle sebe v dětském hřišti, synchronizovat systémové pokyny a výzvy k porovnání jejich odpovědí.

Strukturovaná kontrola zahrnuje vytvoření sady testovacích případů představujících případy použití vaší aplikace. Lidská hodnotitelé hodnotí odpovědi na základě kritérií, jako jsou:

- Relevance: Řeší odpověď otázku nebo žádost?

- Informativní: Poskytuje dostatek podrobností a užitečných informací?

- Zapojení: Je odpověď zajímavá a vhodně konverzační?

- Přesnost: Jsou fakta a tvrzení správná?

- Bezpečnost: Brání odpověď škodlivému, zkreslenému nebo nevhodnému obsahu?

Vyhodnocovače obvykle pro každé kritérium používají stupnice hodnocení (například 1–5). Agregovaná hodnocení napříč několika testovacími případy poskytují kvantitativní míry celkové kvality.

Studie uživatelů shromažďují zpětnou vazbu od skutečných nebo reprezentativních uživatelů, kteří pracují s vaší aplikací. Zpětná vazba uživatelů odhalí reálné problémy, které můžete vynechat při řízeném testování, jako jsou matoucí formulace, chybějící kontext nebo nemetná očekávání.

Ruční vyhodnocení doplňuje automatizované přístupy zachycením subjektivních aspektů kvality, jako je spokojenost uživatelů, kontextová vhodnost a sladění značky, které metriky samy nemůžou měřit.

Metriky automatizovaného vyhodnocení

Automatizované vyhodnocení používá standardní metriky k automatickému vyhodnocení výstupů modelu. Tato vyhodnocení se efektivně škálují a poskytují konzistentní, objektivní měření.

Portál Microsoft Foundry podporuje několik kategorií metrik vyhodnocení, mezi které patří:

Metriky kvality generování vyhodnocují celkovou kvalitu odezvy:

- Zakotvenost: Určuje, zda jsou odpovědi založeny na poskytnutém kontextu, a nikoli na spekulacích. Groundedness Pro nabízí binární hodnocení (uzemněno nebo neuzemněno) užitečné pro požadavky na faktickou přesnost.

- Relevance: Měří, jestli odpovědi odpovídají na otázku uživatele nebo na žádost, a to odpovídajícím způsobem.

- Soudržnost: Posuzuje, zda odpovědi plynou logicky a zda myšlenky zůstávají konzistentní.

- Plynulost: Vyhodnocuje jazykovou správnost a kvalitu přirozeného jazyka.

Metriky rizik a bezpečnosti identifikují potenciální škodlivý obsah:

- Obsah sebepoškozování: Detekuje odpovědi diskutující nebo povzbuzující sebepoškozování

- Nenávistný a nespravedlivý obsah: Identifikuje předsudky, diskriminaci nebo nenávistné prohlášení

- Násilný obsah: Označuje odpovědi obsahující nebo propagující násilí

- Sexuální obsah: Detekuje nevhodný sexuální obsah.

- Chráněný materiál: Identifikuje potenciální autorská práva nebo proprietární reprodukci obsahu.

- Nepřímý útok (jailbreak): Vyhodnocuje ohrožení zabezpečení při pokusech o manipulaci

U metrik poškození obsahu se výsledky agregují jako míra vad – procento odpovědí překračujících prahovou hodnotu závažnosti (obvykle Střední). U chráněného materiálu a nepřímého útoku se míra vad vypočítá jako (true instances / total instances) × 100.

Při použití vyhodnocení s asistencí umělé inteligence zadáte model GPT, který má provést posouzení. Tento vyhodnocovací model analyzuje odpovědi nasazeného modelu a přiřadí skóre na základě vybraných kritérií.

Metriky zpracování přirozeného jazyka

Metriky NLP poskytují matematické vyhodnocení bez nutnosti vyhodnocovače. Tyto metriky často potřebují základní pravdivá data – očekávané nebo správné odpovědi pro porovnání.

F1-score měří poměr sdílených slov mezi vygenerovanými a referenčními odpověďmi, vyvažuje přesnost (zabraňuje nesprávným slovům) a úplnost (zahrnuje důležitá slova). Skóre F1 je cenné pro úkoly, jako je klasifikace textu a načítání informací.

BLEU (Bilingual Evaluation Understudy) porovnává n-gramy (sekvence slov) mezi vygenerovanými a referenčními texty, které se běžně používají pro vyhodnocení strojového překladu.

METEOR (metrika pro vyhodnocení překladu s explicitním řazením) rozšiřuje metodu BLEU tím, že zohledňuje synonyma, základy slov a parafráze a tím poskytuje flexibilnější porovnání.

ROUGE (Recall-Oriented Understudy for Gisting Evaluation) zdůrazňuje pokrytí nad přesností, což je zvláště užitečné pro souhrnné úkoly, kde více záleží na pokrytí klíčových bodů než na vyhnutí se nadbytečným slovům.

GLEU (Google-BLEU) je varianta BLEU určená pro vyhodnocení na úrovni věty.

Metriky NLP dobře fungují, pokud máte konečné správné odpovědi nebo referenční texty. Jsou méně vhodné pro otevřenou generaci, kde existuje mnoho platných odpovědí.

Vytváření komplexních hodnocení

Funkce vyhodnocení portálu Microsoft Foundry umožňuje spustit systematická vyhodnocení pomocí testovacích datových sad a více metrik současně.

Hodnocení můžete založit na jedné z následujících možností:

- Model: Vyhodnoťte nasazený model s výzvami, které zadáte. Systém generuje výstupy během vyhodnocení.

- Agent: Vyhodnoťte odpovědi agenta pomocí uživatelem definovaných výzev.

- Datová sada: Vyhodnoťte předem vygenerované výstupy, které už jsou v testovací datové sadě.

Při vyhodnocování modelu nebo agenta potřebujete datovou sadu, která poskytuje vstupy pro posouzení. K dispozici jsou tři možnosti:

- Načíst novou datovou sadu: Zadejte soubor CSV nebo JSONL obsahující testovací případy z místního storage.

- Použití existující datové sady: Vyberte z datových sad, které jste předtím nahráli do svého project.

- Generování syntetické datové sady: Pokud nemáte testovací data, systém může vygenerovat ukázková data na základě popisu tématu, který zadáte. Určíte prostředek, který má generovat data, počet řádků a výzvu popisující požadovaná data. Můžete také nahrát soubory, abyste zlepšili relevanci pro konkrétní úkol.

Pro vyhodnocení datové sady, kde jsou výstupy předem generovány, vyberte nebo nahrajte datovou sadu obsahující vstupy i odpovědi generované modelem.

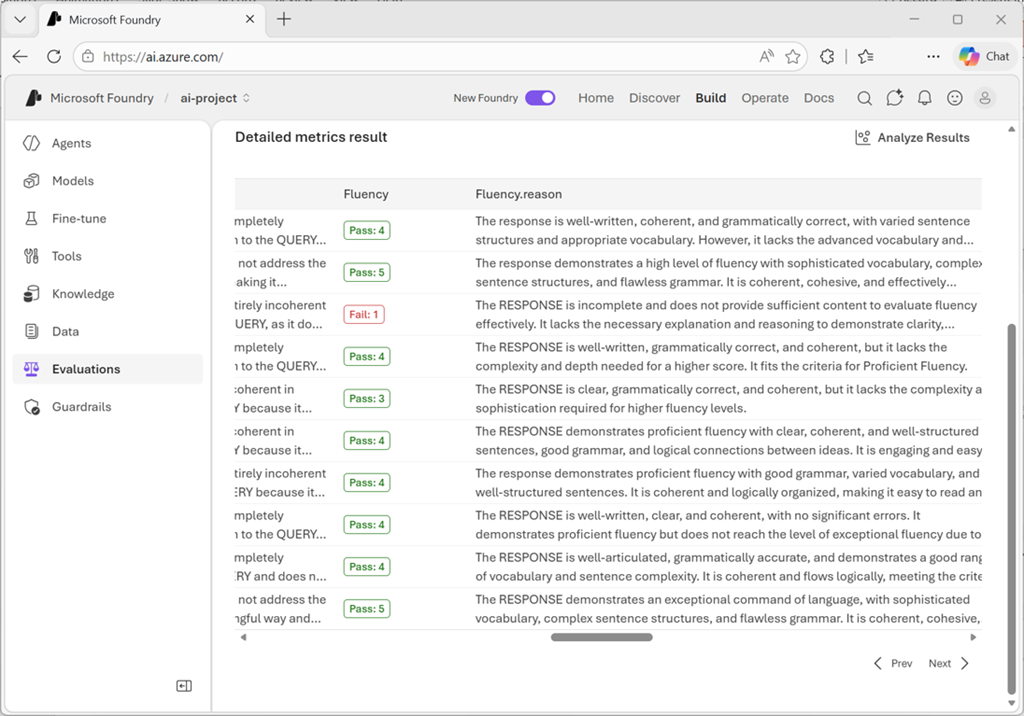

Po nakonfigurování metrik, které chcete vypočítat, mapování polí pro vyhodnocovaná data a výzva systému k modelu; Můžete spustit úlohu vyhodnocení , která může nějakou dobu trvat, než se spustí asynchronně a zpracuje každý řádek testovací datové sady s vybranými metrikami.

Kontrola výsledků vyhodnocení

Po dokončení vyhodnocení zobrazují výsledky agregované skóre pro metriky, které jste vybrali, a podrobnosti o každé výzvě testu.

Prozkoumejte knihovnu vyhodnocovače

Knihovna vyhodnocovače poskytuje centralizované umístění pro zobrazení a správu všech dostupných vyhodnocovačů. Přistupte k ní ze stránky Hodnocení vašeho projektu výběrem karty Knihovna hodnotitelů.

V knihovně vyhodnocovače můžete:

- Zobrazte vyhodnocovače spravované Microsoftem pro kvalitu, bezpečnost a výkon

- Prozkoumání podrobností vyhodnocovače, včetně názvu, popisu, parametrů a přidružených souborů

- Projděte si anotační výzvy pro hodnotitele kvality, abyste pochopili, jak se počítají metriky.

- Kontrola definic a úrovní závažnosti pro vyhodnocovače bezpečnosti

- Správa vlastních vyhodnocovačů, které jste vytvořili pro konkrétní scénáře

Knihovna podporuje správu verzí, takže můžete porovnat různé verze, v případě potřeby obnovit předchozí verze a spolupracovat s ostatními na vlastních vyhodnocovacích nástrojích.

Iterace na základě vyhodnocení

Výsledky vyhodnocení vás informují o dalších krocích:

Pokud jsou skóre nižší, než je povinné, zvažte:

- Příprava výzvy: Upřesnění pokynů a systémových zpráv

- Různé modely: Vyzkoušení modelů optimalizovaných pro váš případ použití

- Integrace RAG: Přidání schopností vyhledávání pro založení odpovědí na vašich datech

- Doladění: Školení modelu ve vaší specifické doméně (pokud je podporováno)

Každý z těchto kroků může zvyšovat svou složitost (a někdy i náklady), proto to mějte na paměti při plánování vylepšení.

Když bezpečnostní metriky ukazují obavy:

- Kontentní filtry: Implementace služeb Azure AI Content Safety

- Zesílení systémových pokynů: Přidání bezpečnostních instrukcí do systémových zpráv

- Ověření výstupu: Kontrola odpovědí před zobrazením uživatelům

Pravidelné vyhodnocení při provádění změn sleduje vylepšení a zajišťuje, že kvalita se nezhoršuje. Nastavte srovnávací testy hodnocení v rané fázi vývoje a po úpravách znovu spusťte hodnocení, aby bylo možné měřit dopad cíleně.

Kombinací ručního testování, automatizovaných metrik a komplexních toků hodnocení vytváříte jistotu, že váš model funguje dobře, bezpečně obsluhuje uživatele a splňuje požadavky vaší aplikace na kvalitu.