Nástroje pro zkoumání dat v Azure Databricks

Po ingestování dat z vašich zdrojů můžete pomocí platformy Azure Databricks spolupracovat na prozkoumání a analýze dat.

Pojďme prozkoumat nástroje, které používáte při práci s daty v Azure Databricks.

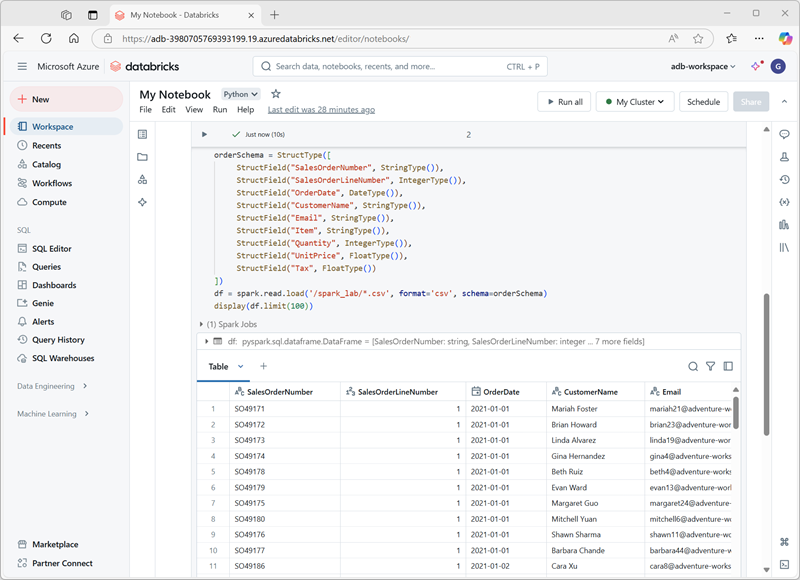

Spolupráce a spouštění kódu pomocí poznámkových bloků

Poznámkové bloky v Azure Databricks můžete použít k psaní kódu Python, SQL, Scala nebo R k prozkoumání a vizualizaci dat. Poznámkové bloky podporují interaktivní zkoumání dat a dají se sdílet mezi členy týmu. Podporuje také možnosti profilace dat pro datové vědce, aby porozuměli tvaru a obsahu dat.

Pomocí předdefinovaných vizualizací můžete rychle porozumět distribucím dat, trendům a vzorům. Vedle integrovaných funkcí umožňuje Azure Databricks integraci s běžně používanými opensourcovými knihovnami, jako jsou Matplotlib, Seaborn nebo D3.js pro složitější vizualizace.

Práce s datovými rámci Sparku

Při práci s daty v poznámkových blocích využíváte datové rámce Spark, které jsou založené na Apache Sparku. Datové rámce umožňují efektivně manipulovat s velkými datovými sadami.

Pokud například chcete vytvořit jednoduchý datový rámec, můžete spustit následující kód:

data = [("Alice", 34), ("Bob", 45), ("Cathy", 29)]

columns = ["Name", "Age"]

df = spark.createDataFrame(data, columns)

Datové rámce podporují operace, jako je filtrování, agregace a spojování, které jsou pro zkoumání dat zásadní.

Můžete například filtrovat datový rámec:

filtered_df = df.filter(df["Age"] > 30)

Azure Databricks také podporuje SQL tím, že umožňuje přepínat mezi operacemi datového rámce a dotazy SQL, aby s daty interagovali způsobem, který je nejpřirozenější.

Pokud chcete datový rámec filtrovat pomocí dotazu SQL, nejprve vytvoříte dočasné zobrazení:

df.createOrReplaceTempView("people")

sql_df = spark.sql("SELECT Name, Age FROM people WHERE Age > 30")

Návod

Další informace o datových rámcích najdete v tématu Kurz: Načtení a transformace dat pomocí datových rámců Apache Spark.

Zkoumání dat pomocí knihoven a rozhraní API

V závislosti na tom, co chcete se svými daty dělat, musíte použít konkrétní knihovny a rozhraní API, abyste měli k dispozici funkce pro provedení požadovaných kroků zpracování dat.

Instalace opensourcových knihoven

Jako datový analytik, datový inženýr nebo datový vědec můžete k prozkoumání a zpracování dat použít upřednostňované opensourcové knihovny. Azure Databricks umožňuje nainstalovat knihovny Pythonu, jako jsou Pandas, NumPy nebo Scikit-learn, pro další možnosti analýzy dat.

Návod

Další informace o práci s knihovnami v Azure Databricks najdete v tématu Knihovny.

Použití knihovny MLlib pro úlohy strojového učení

Modely strojového učení můžete trénovat, abyste mohli zkoumat a zpracovávat data. Pomocí knihovny MLlib Sparku můžete optimálně využít distribuované výpočetní clustery, které jsou připojené k poznámkovým blokům. S knihovnou MLlib můžete použít techniky strojového učení, jako je clustering, regrese a klasifikace, které vám pomůžou odhalit skryté a složité vzory ve vašich datech.

Vizualizace dat pomocí nástrojů pro externí vizualizaci

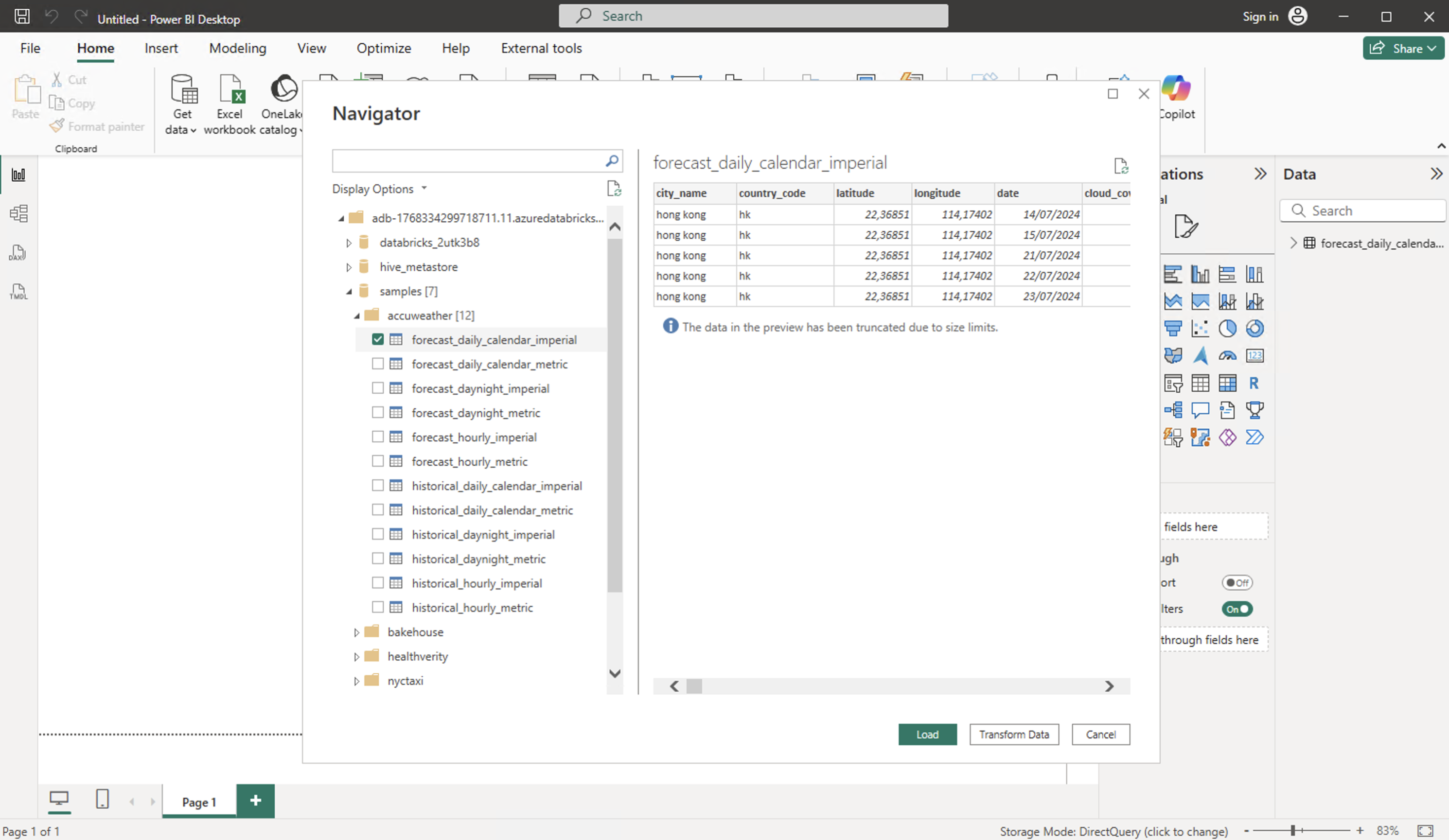

Kromě předdefinovaných možností grafu se Azure Databricks integruje s externími nástroji pro vizualizaci, jako je Tableau nebo Power BI, a nabízí vylepšené možnosti řídicího panelu.

Power BI Desktop můžete připojit ke clusterům Azure Databricks a datovým skladům SQL Databricks. Sestavy Power BI můžete publikovat také do služby Power BI a umožnit uživatelům přístup k podkladovým datům Azure Databricks pomocí jednotného přihlašování (SSO), a předávat při tom stejné přihlašovací údaje Microsoft Entra ID, které používají pro přístup k sestavě.

Azure Databricks můžete připojit z Power BI Desktopu několika způsoby:

Připojení k Azure Databricks pomocí Partnerského připojení: Nastavení s asistencí v Databricks, které automaticky nakonfiguruje Power BI pro připojení ke službě Databricks SQL Warehouse s minimálními ručními kroky.

Připojte se k Azure Databricks ručně: Ruční proces, kdy používáte konektor Power BI Databricks, zadejte koncový bod SQL Warehouse pracovního prostoru a ověřte připojení.

Konektor Power BI Delta Sharing: Konektor, který umožňuje Power BI dotazovat sdílené tabulky Delta prostřednictvím technologie Delta Sharing, aniž by byl nutný přímý přístup k pracovnímu prostoru nebo clusteru Databricks.

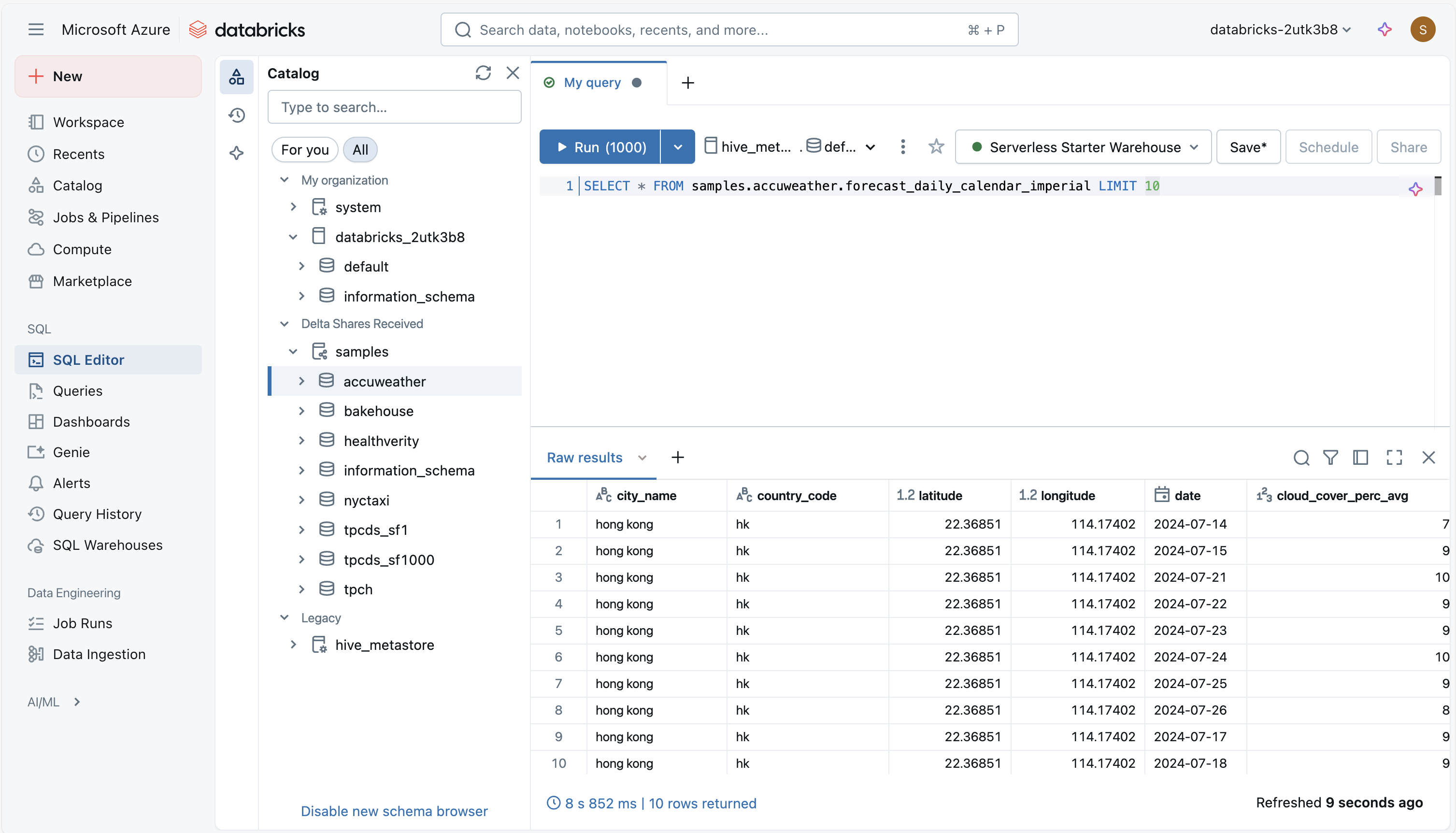

Prozkoumání dat v editoru SQL

Editor SQL v Azure Databricks je pracovní prostor, ve kterém můžete zapisovat a spouštět dotazy SQL na data ve vašem lakehouse. Podporuje standardní příkazy SQL a obsahuje užitečné funkce, jako je zvýrazňování syntaxe, automatické dokončování a historie minulých dotazů. To usnadňuje vyzkoušení dotazů, jejich upřesnění a sledování toho, co jste už prozkoumali.

Pokud chcete začít zkoumat, můžete pomocí podokna Průzkumník katalogu zobrazit dostupné databáze, schémata a tabulky. Když vyberete tabulku, zobrazí se její sloupce a datové typy, abyste před spuštěním dotazů pochopili strukturu. Odtud můžete psát dotazy pro zobrazení ukázkových řádků, filtrování výsledků nebo použití agregací, abyste získali rychlý přehled o obsahu a kvalitě dat. Výsledky se ve výchozím nastavení zobrazují ve formátu tabulky, ale můžete je také zobrazit jako jednoduché grafy, abyste mohli odhalit vzory nebo trendy.

Editor SQL také umožňuje ukládat dotazy pro pozdější použití a uspořádat je pro opakovatelný průzkum. Uložené dotazy můžete přizpůsobit přidáním parametrů nebo jejich sdílením se členy týmu, kteří pracují na stejných datech. Pokud potřebujete výsledky pravidelně, můžete naplánovat dotazy nebo je přidat do řídicích panelů, abyste k nim měli snadnější přístup. Díky těmto možnostem poskytuje Editor SQL praktický způsob, jak kontrolovat, dotazovat a analyzovat data bez opuštění Databricks.

Díky těmto nástrojům je Azure Databricks flexibilní platformou pro zkoumání dat, která zpracovává vše od základního čištění dat až po pokročilé projekty strojového učení.