Gennemse Apache Spark-programmerne i Fabric-overvågningshubben

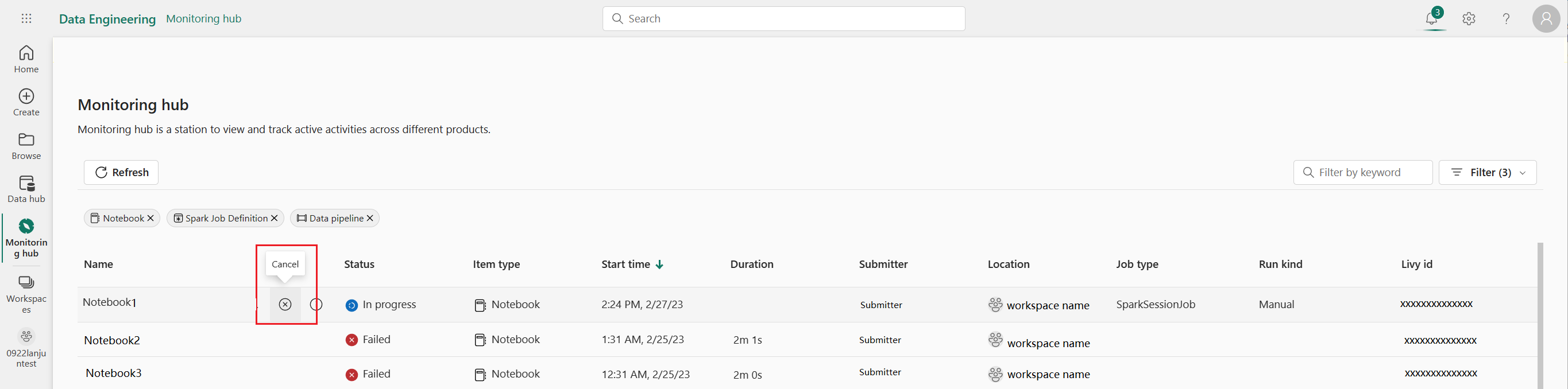

Overvågningshubben fungerer som en centraliseret portal til gennemsyn af Apache Spark-aktiviteter på tværs af elementer. Når du er i Dataudvikler- eller datavidenskabsoplevelsen, kan du få vist igangværende Apache Spark-programmer, der udløses fra notesbøger, Apache Spark-jobdefinitioner og pipelines. Du kan også søge efter og filtrere Apache Spark-programmer baseret på forskellige kriterier. Derudover kan du annullere dine igangværende Apache Spark-programmer og foretage detailudledning for at få vist flere detaljer om udførelse af et Apache Spark-program.

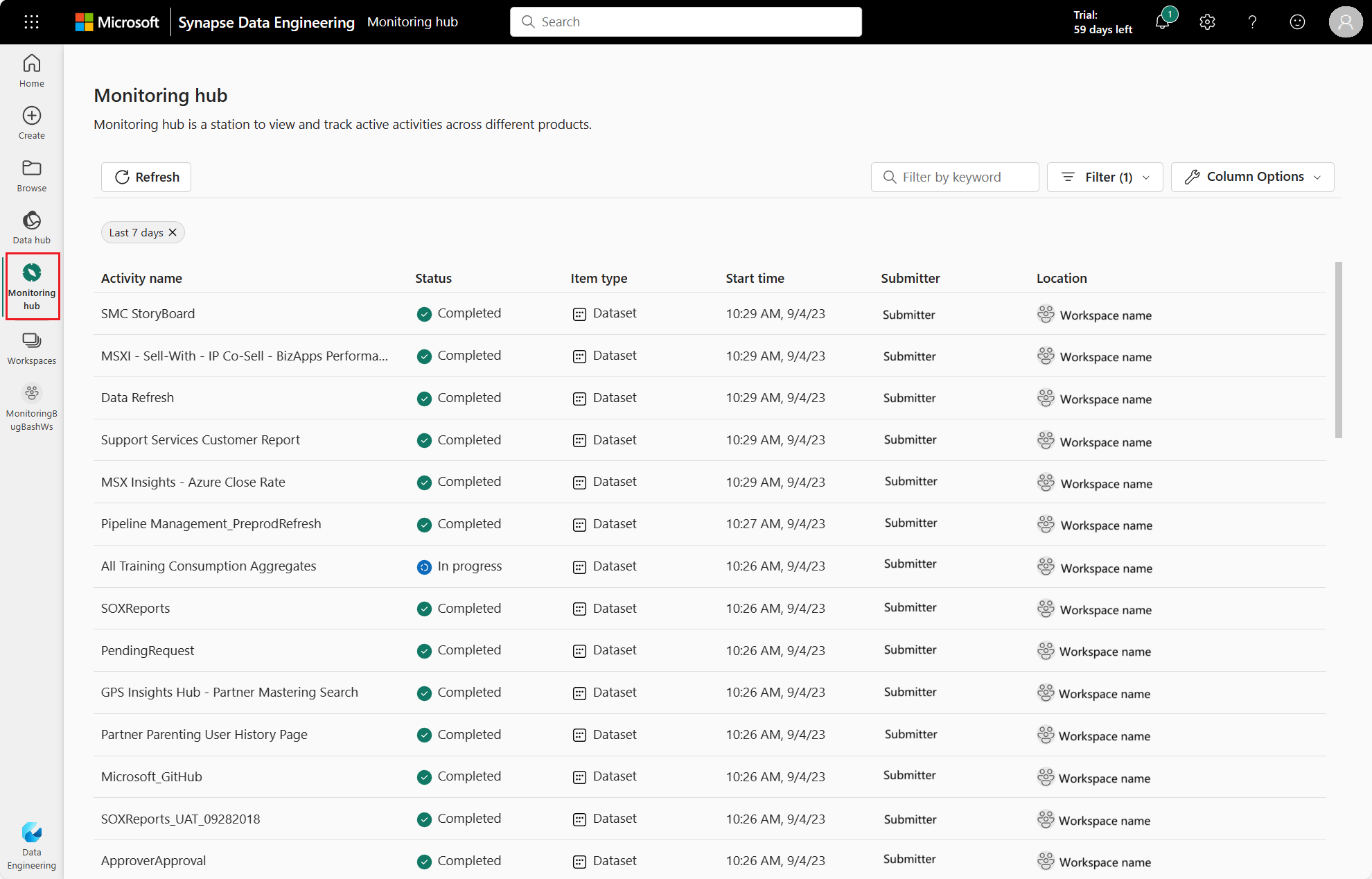

Få adgang til overvågningshubben

Du kan få adgang til overvågningshubben for at få vist forskellige Apache Spark-aktiviteter ved at vælge Overvågningshub i navigationslinkene til venstre.

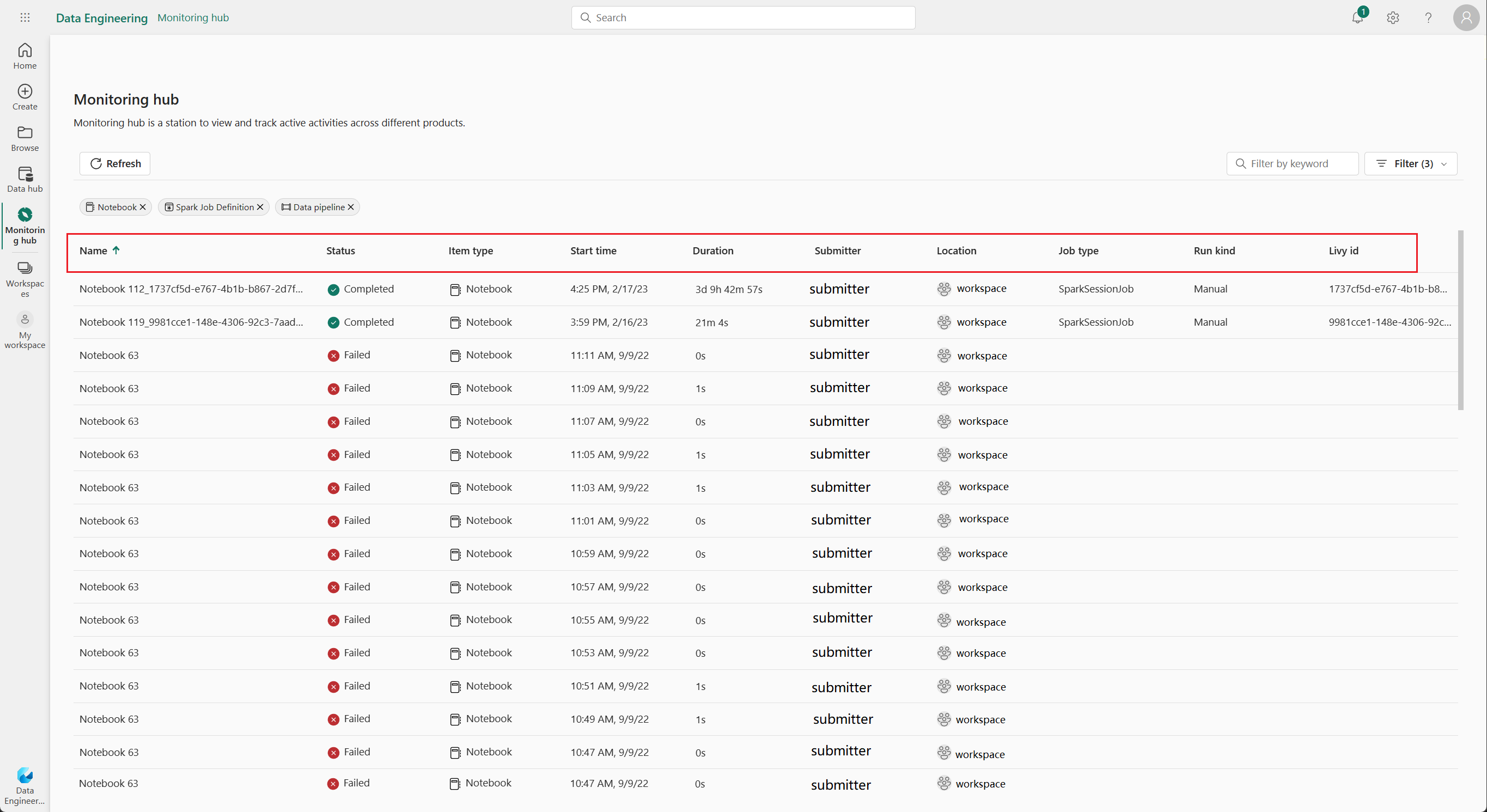

Sortér, søg, filtrer og kolonneindstillinger Apache Spark-programmer

For at opnå bedre anvendelighed og registrering kan du sortere Apache Spark-programmerne ved at vælge forskellige kolonner i brugergrænsefladen. Du kan også filtrere programmerne baseret på forskellige kolonner og søge efter bestemte programmer. Du kan også justere visnings- og sorteringsrækkefølgen af kolonnerne uafhængigt af hinanden via kolonneindstillingerne.

Sortér Apache Spark-programmer

Hvis du vil sortere Apache Spark-programmer, kan du vælge i hver kolonneoverskrift, f.eks . Navn, Status, Elementtype, Starttidspunkt, Placering osv.

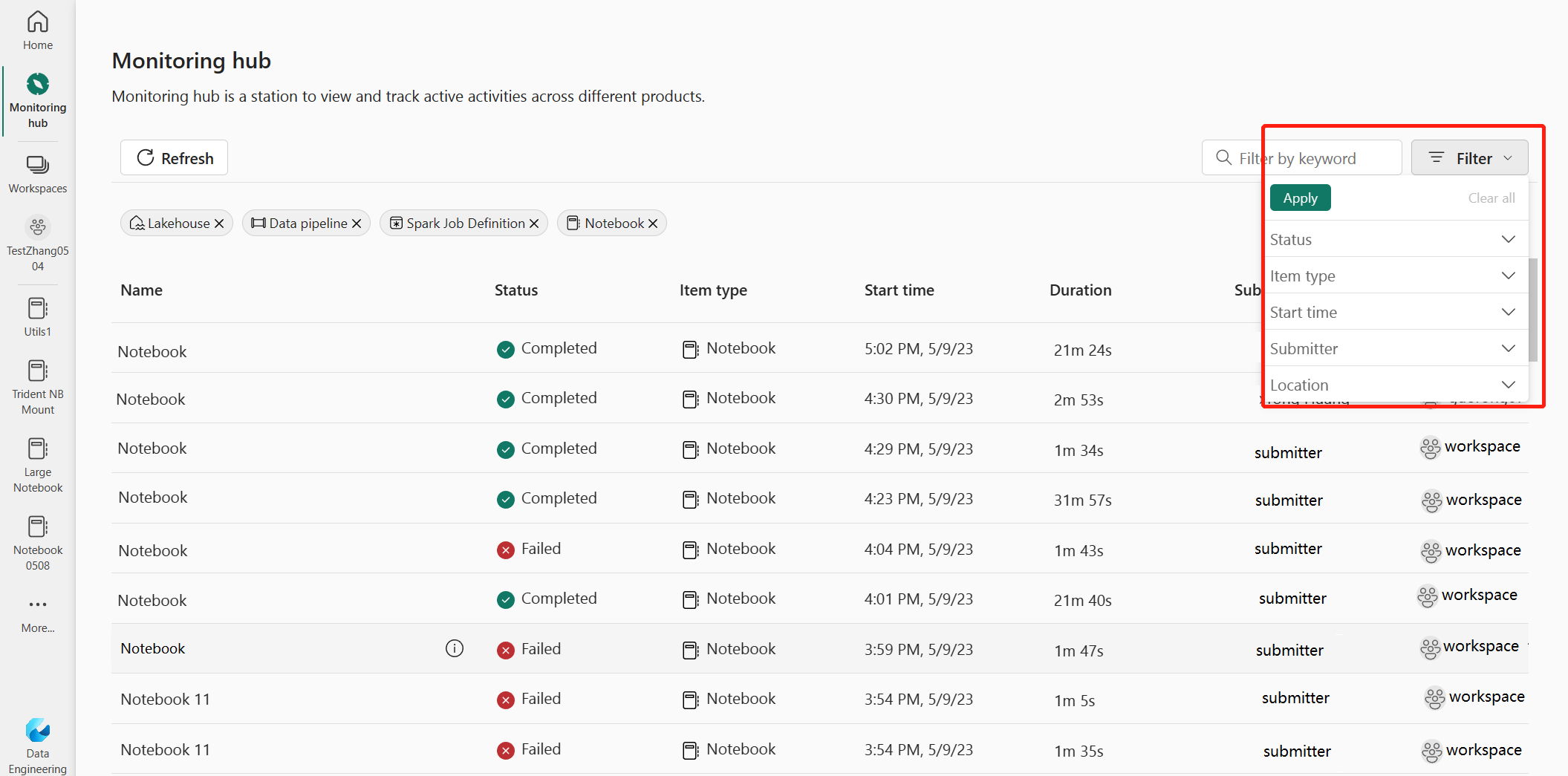

Filter Apache Spark-programmer

Du kan filtrere Apache Spark-programmer efter Status, Elementtype, Starttidspunkt, Indsender og Placering ved hjælp af ruden Filter i øverste højre hjørne.

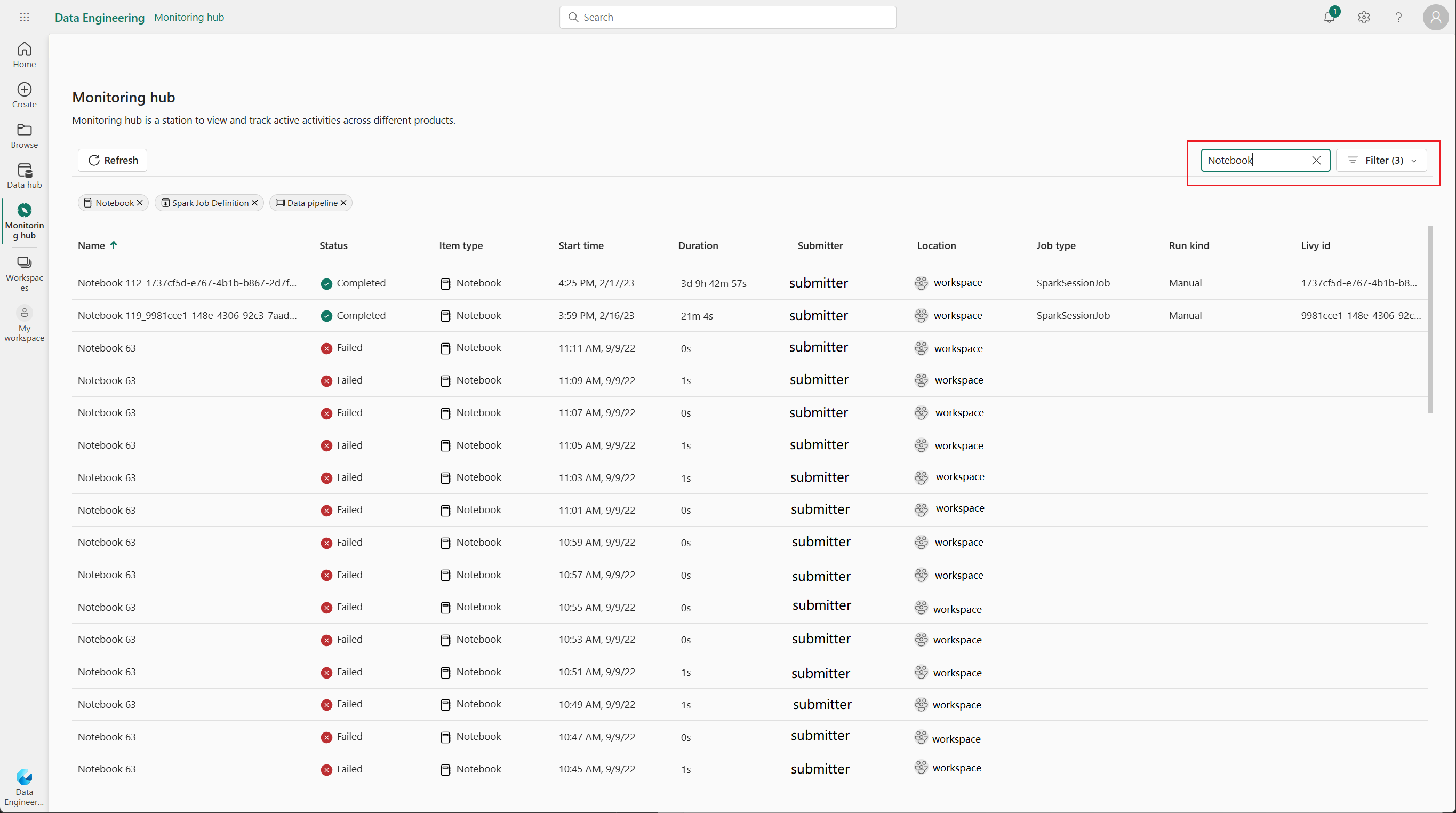

Søg i Apache Spark-programmer

Hvis du vil søge efter bestemte Apache Spark-programmer, kan du angive bestemte nøgleord i søgefeltet i øverste højre hjørne.

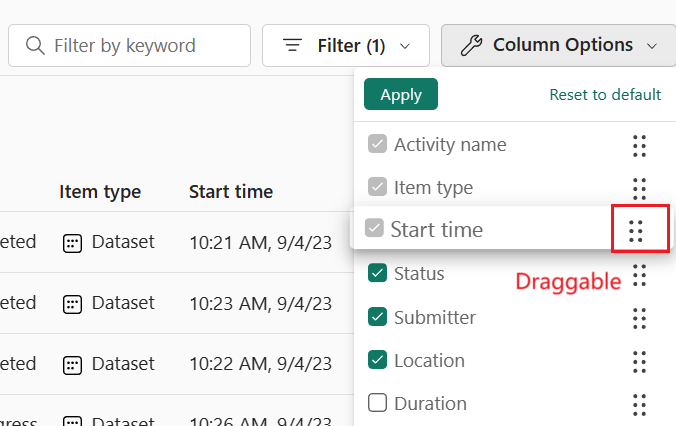

Kolonneindstillinger Apache Spark-programmer

Du kan ændre den rækkefølge, som listerne vises i, ved at vælge den liste, du vil have vist, og derefter trække listeindstillingerne.

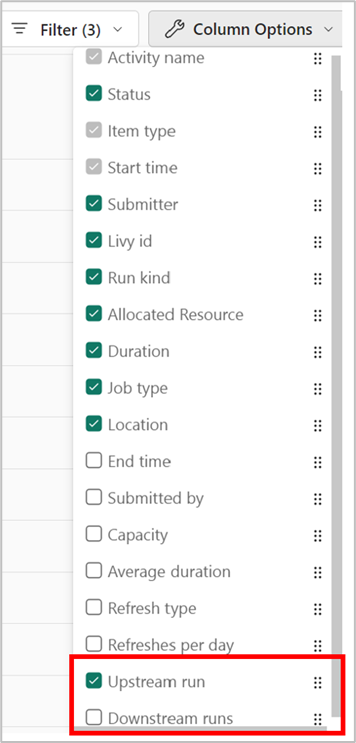

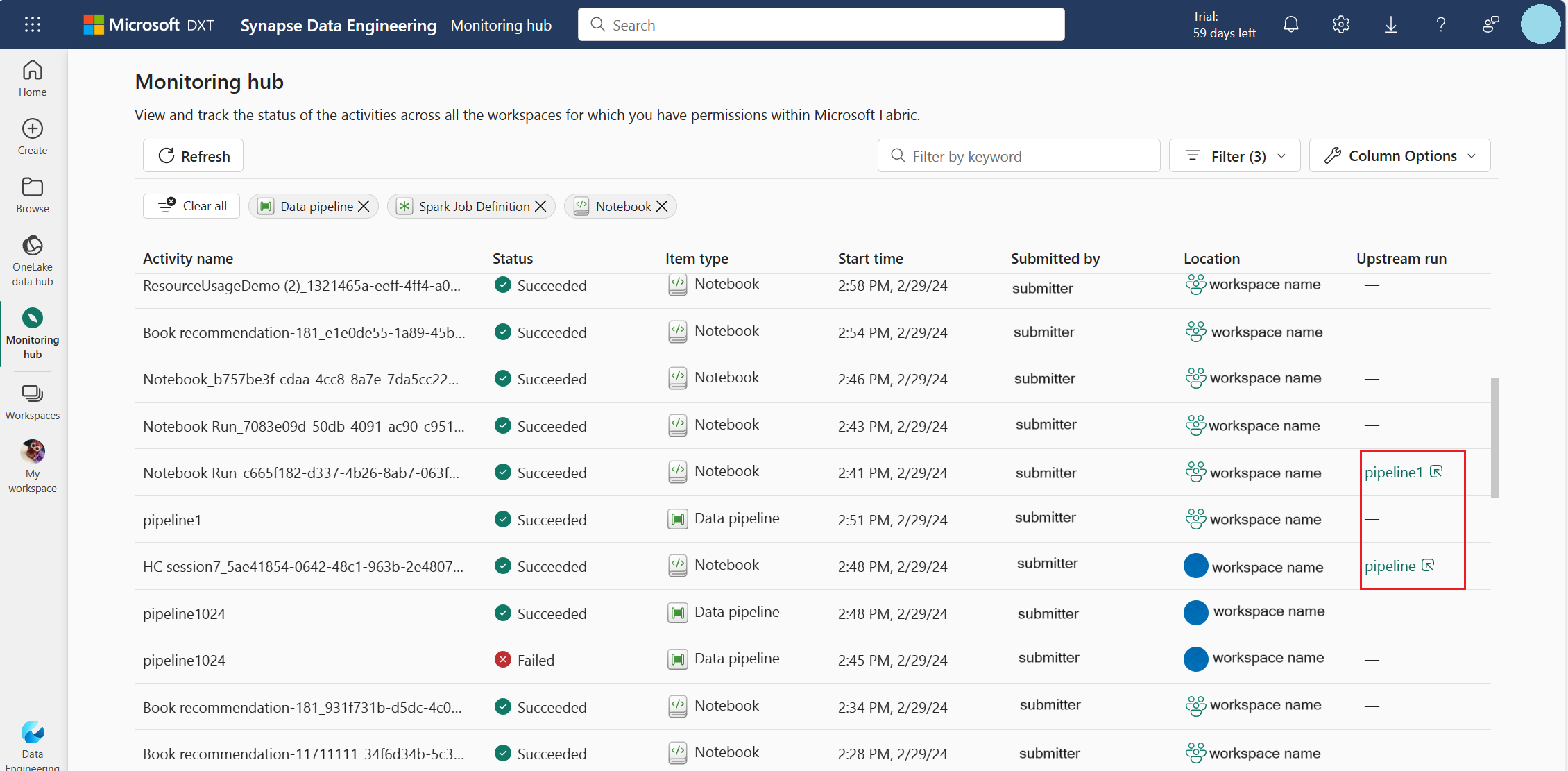

Aktivér upstreamvisning for relaterede pipelines

Hvis du har planlagte definitioner af notesbøger og spark-job, der skal køre i pipelines, kan du få vist spark-aktiviteter fra disse notesbøger og definitioner af spark-job i overvågningshubben. Derudover kan du også se den tilsvarende overordnede pipeline og alle dens aktiviteter i overvågningshubben.

- Vælg indstillingen Kør upstream-kolonne .

- Få vist den relaterede overordnede pipelinekørsel i kolonnen Upstream-kørsel , og klik på pipelinekørslen for at få vist alle dens aktiviteter.

Administrer et Apache Spark-program

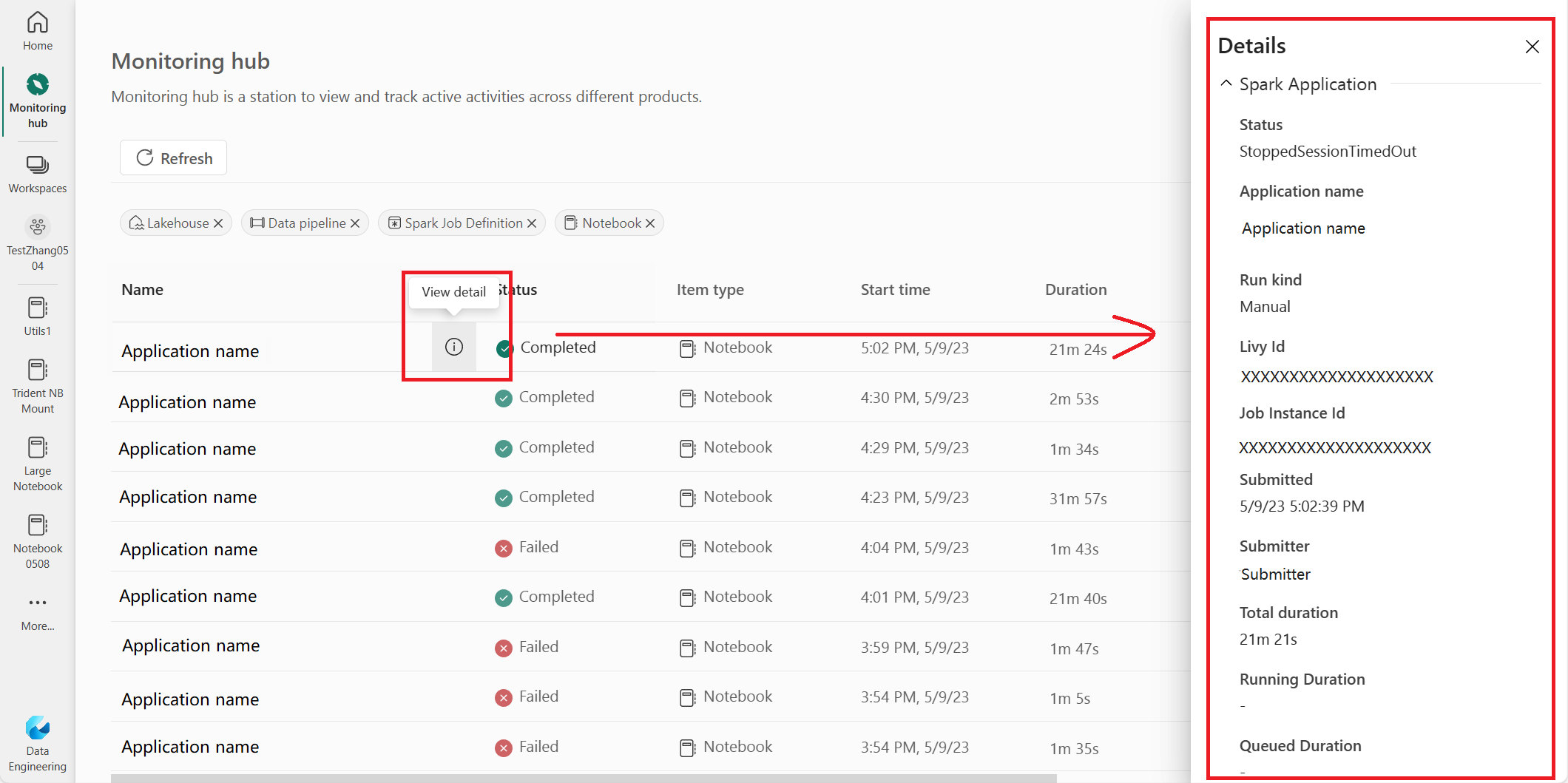

Når du holder markøren over en Apache Spark-programrække, kan du se forskellige handlinger på rækkeniveau, der gør det muligt for dig at administrere et bestemt Apache Spark-program.

Vis detaljeruden for Apache Spark-programmet

Du kan holde markøren over en Apache Spark-programrække og klikke på ikonet Vis detaljer for at åbne ruden Detaljer og få vist flere oplysninger om et Apache Spark-program.

Annuller et Apache Spark-program

Hvis du har brug for at annullere et igangværende Apache Spark-program, skal du holde markøren over rækken og klikke på ikonet Annuller .

Gå til detaljevisning af Apache Spark-program

Hvis du har brug for flere oplysninger om Apache Spark-udførelsesstatistik, adgang til Apache Spark-logge eller kontrol af input- og outputdata, kan du klikke på navnet på et Apache Spark-program for at navigere til den tilsvarende Side med oplysninger om Apache Spark-programmet.

Relateret indhold

Feedback

Kommer snart: I hele 2024 udfaser vi GitHub-problemer som feedbackmekanisme for indhold og erstatter det med et nyt feedbacksystem. Du kan få flere oplysninger under: https://aka.ms/ContentUserFeedback.

Indsend og få vist feedback om