Bemærk

Adgang til denne side kræver godkendelse. Du kan prøve at logge på eller ændre mapper.

Adgang til denne side kræver godkendelse. Du kan prøve at ændre mapper.

Brug Kernel SHAP (SHapley Additive exPlanations) til at forklare en tabelklassifikationsmodel. Kernel SHAP er en model-agnostisk metode, der estimerer bidraget fra hver funktion til en models forudsigelse. Du træner en logistisk regressionsmodel på Adult Census Income-datasættet og bruger derefter SynapseML-transformeren TabularSHAP til at beregne funktionsniveau-forklaringer.

Forudsætninger

Få et Microsoft Fabric-abonnement. Du kan også tilmelde dig en gratis Prøveversion af Microsoft Fabric.

Log på Microsoft Fabric.

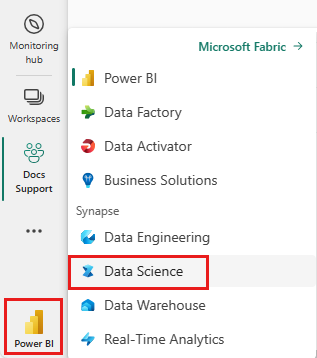

Skift til Fabric ved at bruge experience-switcheren nederst til venstre på din startside.

- Opret en ny notesbog i dit arbejdsområde og vedhæft den til et sommerhus. For mere information, se Opret en notesbog.

SynapseML, PySpark, pandas og plotly er forudinstalleret i Fabric-notebook-miljøer. Der kræves ingen ekstra pakkeinstallation.

Importer pakker og definer hjælper-UDF'er

I din Fabric-notesbog indsætter du følgende kode i en celle og kører den. Dette trin importerer de nødvendige biblioteker og definerer to brugerdefinerede funktioner (UDF'er) til senere udtredelse af vektorelementer.

import pyspark

from synapse.ml.explainers import TabularSHAP

from pyspark.ml import Pipeline

from pyspark.ml.classification import LogisticRegression

from pyspark.ml.feature import StringIndexer, OneHotEncoder, VectorAssembler

from pyspark.sql.types import FloatType, ArrayType

from pyspark.sql.functions import col, lit, rand, broadcast, udf

import pandas as pd

vec_access = udf(lambda v, i: float(v[i]), FloatType())

vec2array = udf(lambda vec: vec.toArray().tolist(), ArrayType(FloatType()))

Verificer: Kør følgende kode i en ny celle. Du burde se outputtet TabularSHAP imported successfully.

print("TabularSHAP imported successfully")

print(f"PySpark version: {pyspark.__version__}")

Belast data og træn en klassifikationsmodel

Indlæs datasættet Adult Census Income fra Azure Blob Storage, indekser mållabelen, og træn en logistisk regressionspipeline.

df = spark.read.parquet(

"wasbs://publicwasb@mmlspark.blob.core.windows.net/AdultCensusIncome.parquet"

)

labelIndexer = StringIndexer(

inputCol="income", outputCol="label", stringOrderType="alphabetAsc"

).fit(df)

print("Label index assignment: " + str(set(zip(labelIndexer.labels, [0, 1]))))

training = labelIndexer.transform(df).cache()

categorical_features = [

"workclass",

"education",

"marital-status",

"occupation",

"relationship",

"race",

"sex",

"native-country",

]

categorical_features_idx = [feat + "_idx" for feat in categorical_features]

categorical_features_enc = [feat + "_enc" for feat in categorical_features]

numeric_features = [

"age",

"education-num",

"capital-gain",

"capital-loss",

"hours-per-week",

]

strIndexer = StringIndexer(

inputCols=categorical_features, outputCols=categorical_features_idx

)

onehotEnc = OneHotEncoder(

inputCols=categorical_features_idx, outputCols=categorical_features_enc

)

vectAssem = VectorAssembler(

inputCols=categorical_features_enc + numeric_features, outputCol="features"

)

lr = LogisticRegression(featuresCol="features", labelCol="label", weightCol="fnlwgt")

pipeline = Pipeline(stages=[strIndexer, onehotEnc, vectAssem, lr])

model = pipeline.fit(training)

Verificer: Kør følgende celle. Du bør se rækketælling for træningsdata og bekræftelse af pipeline-faser.

print(f"Training rows: {training.count()}")

print(f"Pipeline stages: {[type(s).__name__ for s in model.stages]}")

assert training.count() > 30000, "Dataset should contain over 30,000 rows"

print("Model trained successfully")

# Expected output:

#Training rows: 32561

#Pipeline stages: ['StringIndexerModel', 'OneHotEncoderModel', #'VectorAssembler', 'LogisticRegressionModel']

#Model trained successfully

Vælg observationer til at forklare

Vælg tilfældigt fem observationer fra de scorede træningsdata. Disse observationer er de tilfælde, hvor du genererer SHAP-forklaringer.

explain_instances = (

model.transform(training).orderBy(rand()).limit(5).repartition(200).cache()

)

display(explain_instances)

Bekræft: Bekræft stikprøvestørrelsen.

count = explain_instances.count()

print(f"Explain instances: {count}")

assert count == 5, f"Expected 5 rows, got {count}"

print("Sample selected successfully")

Konfigurer og kør TabularSHAP

Lav en TabularSHAP forklaring og anvend den på de valgte observationer. De vigtigste parametre er:

| Parameter | Beskrivelse |

|---|---|

inputCols |

Feature-kolonner, som modellen bruger til forudsigelse. |

outputCol |

Navnet på kolonnen, der indeholder SHAP-outputværdier. |

numSamples |

Antal perturbationsprøver til Kernel SHAP-estimering. Højere værdier er mere præcise, men langsommere. |

model |

Den trænede pipeline-model for at forklare. |

targetCol |

Modeloutput-kolonnen for at forklare. I dette eksempel er kolonnen .probability |

targetClasses |

Klasseindeks til forklaring.

[1] forklarer kun klasse 1-sandsynlighed. Bruger den til [0, 1] at forklare begge. |

backgroundData |

Et udvalg af træningsdata, der bruges som referencefordeling til integration af vores funktioner. |

shap = TabularSHAP(

inputCols=categorical_features + numeric_features,

outputCol="shapValues",

numSamples=5000,

model=model,

targetCol="probability",

targetClasses=[1],

backgroundData=broadcast(training.orderBy(rand()).limit(100).cache()),

)

shap_df = shap.transform(explain_instances)

Bemærkning

Dette trin kan tage flere minutter afhængigt af numSamples klyngens størrelse. Med numSamples=5000 og fem observationer kan du forvente 3-10 minutter på en standard Fabric Spark-klynge.

Verificer: Tjek at SHAP-outputkolonnen findes.

assert "shapValues" in shap_df.columns, "shapValues column missing"

print(f"SHAP output columns: {shap_df.columns}")

print("TabularSHAP transform completed")

Udtræk SHAP-værdier

Udtræk klasse 1 sandsynligheds- og SHAP-værdierne fra resultatdatarammen. For hver observation starter SHAP-værdivektoren med basisværdien (gennemsnitligt output fra baggrundsdatasættet), efterfulgt af én værdi pr. funktion.

shaps = (

shap_df.withColumn("probability", vec_access(col("probability"), lit(1)))

.withColumn("shapValues", vec2array(col("shapValues").getItem(0)))

.select(

["shapValues", "probability", "label"] + categorical_features + numeric_features

)

)

shaps_local = shaps.toPandas()

shaps_local.sort_values("probability", ascending=False, inplace=True, ignore_index=True)

pd.set_option("display.max_colwidth", None)

display(shaps_local)

Bekræft: Bekræft pandas DataFrame-struktur.

expected_cols = len(categorical_features) + len(numeric_features) + 3

print(f"DataFrame shape: {shaps_local.shape}")

print(f"Expected columns: {expected_cols}, Actual: {shaps_local.shape[1]}")

assert shaps_local.shape == (5, expected_cols), f"Unexpected shape: {shaps_local.shape}"

print("SHAP values extracted successfully")

Visualiser SHAP-værdier

Lav et søjlediagram for hver observation, der viser, hvordan hver egenskab bidrager til den forudsagte sandsynlighed.

from plotly.subplots import make_subplots

import plotly.graph_objects as go

features = categorical_features + numeric_features

features_with_base = ["Base"] + features

rows = shaps_local.shape[0]

fig = make_subplots(

rows=rows,

cols=1,

subplot_titles="Probability: "

+ shaps_local["probability"].apply("{:.2%}".format)

+ "; Label: "

+ shaps_local["label"].astype(str),

)

for index, row in shaps_local.iterrows():

feature_values = [0] + [row[feature] for feature in features]

shap_values = row["shapValues"]

list_of_tuples = list(zip(features_with_base, feature_values, shap_values))

shap_pdf = pd.DataFrame(list_of_tuples, columns=["name", "value", "shap"])

fig.add_trace(

go.Bar(

x=shap_pdf["name"],

y=shap_pdf["shap"],

hovertext="value: " + shap_pdf["value"].astype(str),

),

row=index + 1,

col=1,

)

fig.update_yaxes(range=[-1, 1], fixedrange=True, zerolinecolor="black")

fig.update_xaxes(type="category", tickangle=45, fixedrange=True)

fig.update_layout(height=400 * rows, title_text="SHAP explanations")

fig.show()

Bekræft: Bekræft at plotobjektet blev oprettet.

print(f"Figure traces: {len(fig.data)}")

print(f"Figure height: {fig.layout.height}px")

assert len(fig.data) == 5, f"Expected 5 traces, got {len(fig.data)}"

print("Visualization created successfully")

Fortolk resultaterne

Hver delhistorie repræsenterer én observation. Barerne viser:

- Base: Den gennemsnitlige modeloutput på baggrundsdatasættet (baseline sandsynlighed).

- Positive SHAP-værdier: Egenskaber, der skubber forudsigelsen mod klasse 1 (indkomst over 50K).

- Negative SHAP-værdier: Egenskaber, der skubber forudsigelsen mod klasse 0 (indkomst mindre end eller lig med 50K).

Summen af basisværdien og alle feature-SHAP-værdier er lig med modellens forudsagte sandsynlighed for den observation.

Fejlfinding

| Spørgsmål | Årsag | Løsning |

|---|---|---|

OutOfMemoryError under TabularSHAP |

numSamples er for stor til tilgængelig hukommelse. |

Reducer numSamples, for eksempel til 1.000, eller øg Spark-executorhukommelsen. |

| SHAP-transformen er langsom | Højt numSamples med mange funktioner øger regnetiden. |

Reducer numSamples til 1.000-2.000 for hurtigere undersøgelsesresultater. Stigning til slutanalyse. |

FileNotFoundException til parket |

Netværksadgang til mmlspark.blob.core.windows.net er blokeret. |

Tjek at din Fabric-arbejdsplads har udgående internetadgang. Alternativt kan du uploade datasættet til dit sommerhus ved søen. |

shapValues kolonnen indeholder nuller |

Nogle observationer kan fejle, hvis feature-værdierne ligger uden for træningsfordelingen. | Tjek for null- eller uventede værdier i inputfunktionerne. Filtrer nullpunkter fra resultaterne. |

display() viser ingen output |

Koden kører uden for et Fabric-notebook-miljø. | Brug shaps_local.head() eller print(shaps_local) i standard Python-miljøer. |

Ryd op

Hvis du uploadede datasættet til et søhus til denne vejledning, fjern det til fri lagring:

# Remove cached DataFrames from memory

training.unpersist()

explain_instances.unpersist()

print("Cached DataFrames released")