Bemærk

Adgang til denne side kræver godkendelse. Du kan prøve at logge på eller ændre mapper.

Adgang til denne side kræver godkendelse. Du kan prøve at ændre mapper.

Rubric refinement er en iterativ cyklus, der hjælper med at justere AI-klassificering med menneskelig dom. Hver gentagelse følger en systematisk proces:

Kør → gennemse → grad → afgræns → Gem → Kør → gentag igen

Du har typisk brug for flere gentagelser, før du opnår acceptabel justering. Dette behov for flere gentagelser er forventet og normalt. Rubric refinement er en proces med gradvis forbedring, ikke en engangskonfiguration.

Arbejdsprocestrin

Følg disse trin i arbejdsprocessen for afgrænsning af rubric.

Trin 1: Start en kørsel af en rubricafgrænsning

Det første trin er at konfigurere og udføre en testkørsel i rubricafgrænsningstilstand, hvilket muliggør AI-klassificering med den rubric, du definerer. I løbet af denne kørsel genererer systemet AI-karakterer og -rationaler for hver Generative Answer-testcase, men det beregner ikke bestået eller mislykket status, da du stadig finjusterer rubric'en.

Forudsætninger

- Et testsæt, der indeholder Generative Answer-testcases .

- En rubric (indledende eller forrige gentagelse) til afgrænsning.

Konfiguration

Sådan konfigurerer du en testkørsel for rubricafgrænsning:

Opret eller dupliker en testkørsel:

- Gå til dit testsæt.

- Vælg Ny eller Dupliker Kør , hvis du finjusterer fra en tidligere gentagelse.

Konfigurer testkørslen:

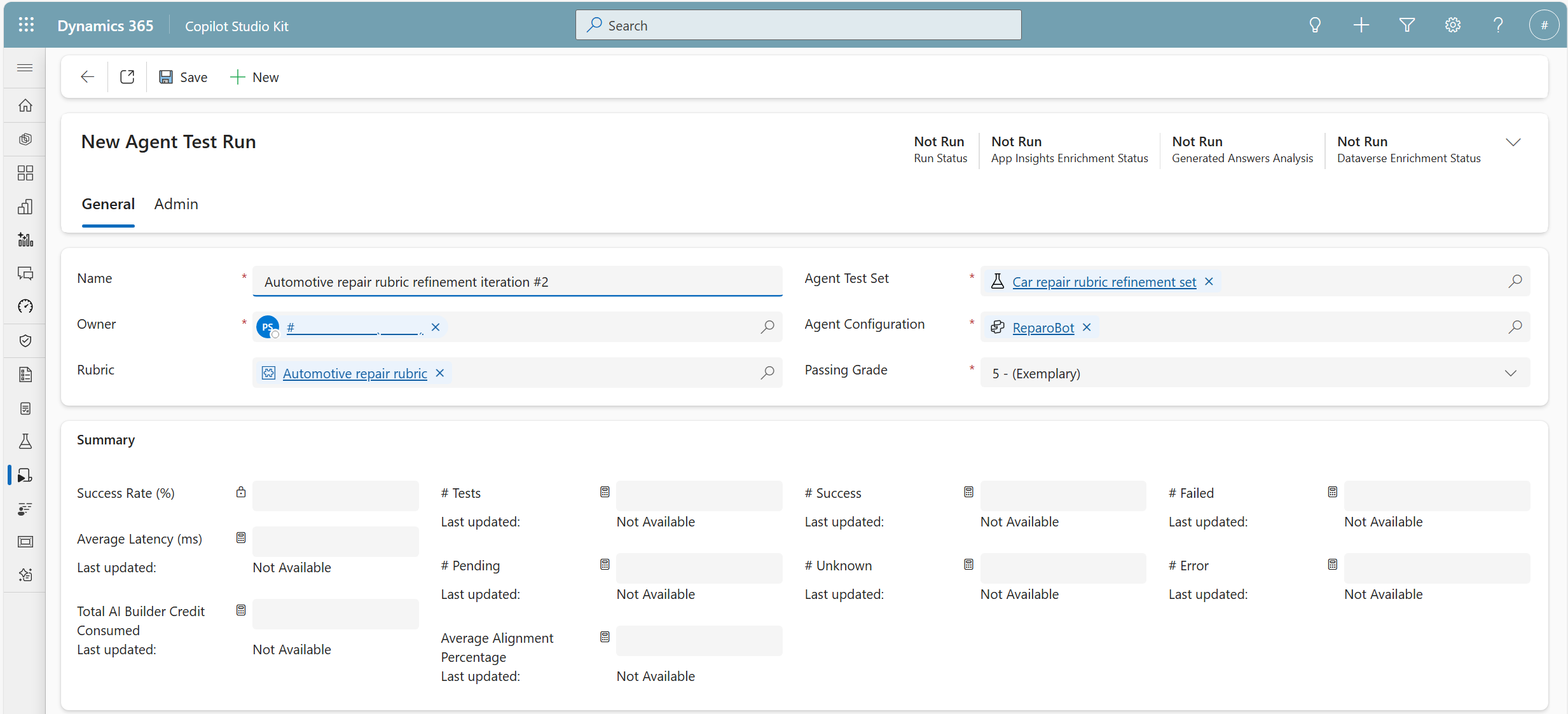

Navn: Angiv et beskrivende navn (f.eks. "Automotive Repair Rubric - Iteration 2").

Agent-testsæt: Vælg dit testsæt med genererende svar-testcases.

Agentkonfiguration: Vælg den agentkonfiguration, der skal testes.

Rubric: Vælg den rubric at afgrænse.

Beståelseskarakter: Indstil beståelseskarakteren (standard er 5).

I forfiningstilstand er beståelsesgraden kun til orientering. Det hjælper med at identificere svar under din målgrænse.

Udfør testkørslen:

- Vælg Gem & luk, og udfør derefter kørslen.

Systemet kører hver generative Svar-testcase. Den udfører AI-klassificering med detaljeret ræsonnering.

Hvad sker der under udførelsen?

For hver generativ svar-testcase:

- Agenten reagerer på testytlen.

- AI-dommeren evaluerer svaret ved hjælp af rubrikken.

- AI-dommeren tildeler en karakter fra 1 til 5.

- AI-dommeren genererer en detaljeret forklaring, der beskriver bedømmelsen.

Systemet springer ikke-generative svar-testcases over.

- Systemet evaluerer kun "Generative Answer"-testtyper i forfiningstilstand.

Trin 2: Gennemse resultater – rubrikforfinende visninger

** Når testkørslen er afsluttet, skal du bruge specialiserede visninger til forfinelse af rubric til at vurdere overensstemmelsen. Grænsefladen giver to primære synspunkter til støtte for upartisk menneskelig evaluering.

Forskning viser, at det kan påvirke menneskers dømmekraft at se AI-karakterer. For at undgå denne skævhed indeholder grænsefladen følgende to visninger:

- Standardafgrænsningsvisning: Skjuler AI-karakterer til uvildig menneskelig evaluering.

- Fuld forfiningsvisning: Viser AI-karakterer til sammenligning af tilpasning.

Skift mellem disse visninger, afhængigt af din opgave.

Standardafgrænsningsvisning

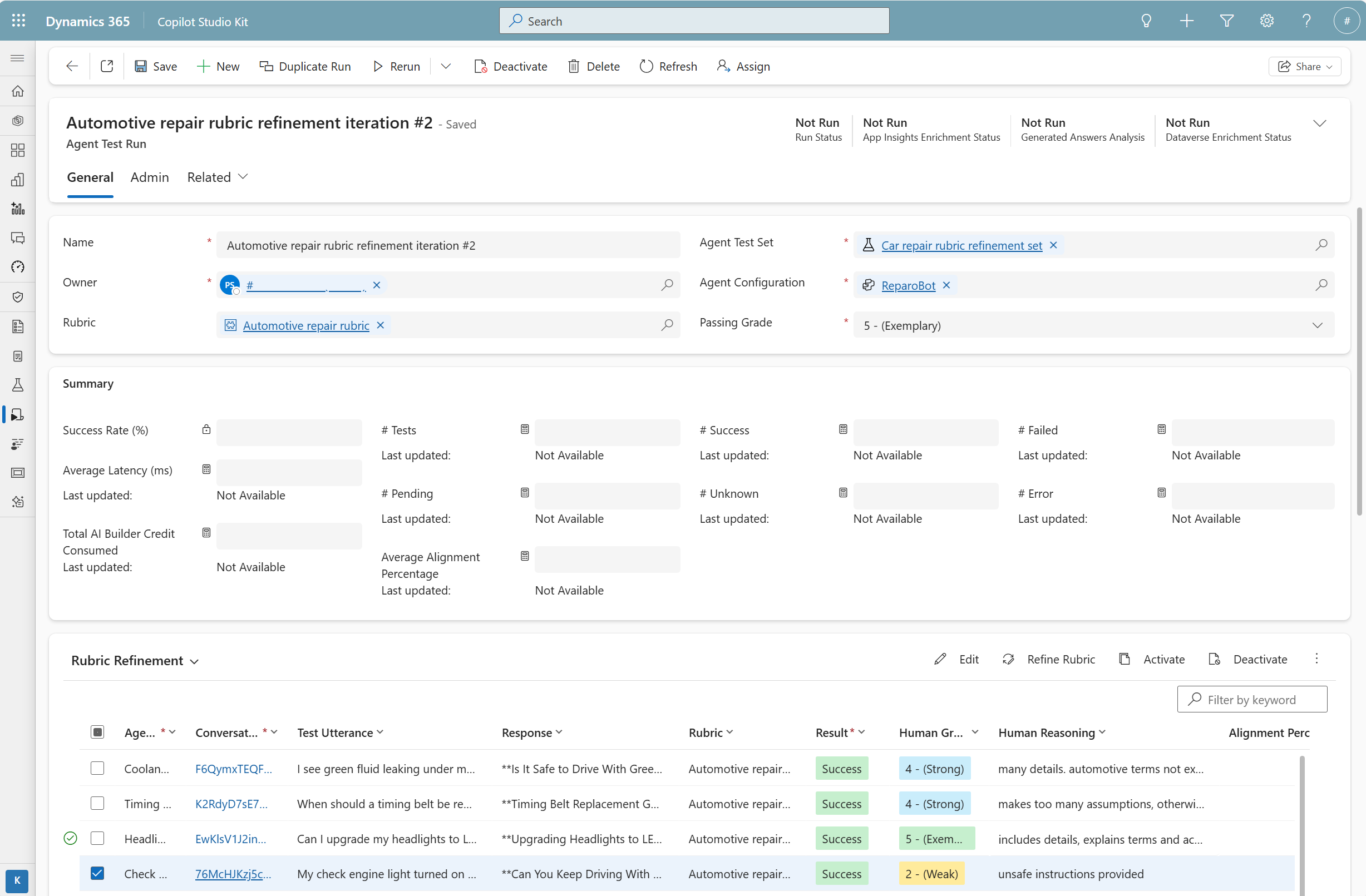

På følgende skærmbillede vises standardafgrænsningsvisningen. Den skjuler AI-karakterer og -rationaler, så du kan angive upartisk menneskelig klassificering:

- Formål: Leverer upartisk menneskelig evaluering uden AI-indflydelse.

-

Hvornår skal du bruge:

- Når du først gennemser svar og giver menneskelige vurderinger.

- Når du angiver gode eller dårlige eksempler.

- Når du vil undgå bias fra AI-vurderinger.

-

Hvad er synligt:

- Test ytring (hvad brugeren spurgte).

- Agent svar (hvad copiloten svarede).

- Felter til menneskelig klassificering (indledningsvist tomme):

- Human Grade selektor (1-5).

- Tekstfeltet Human Reasoning .

- Markeret som Eksempel skifte.

- Eksempeltypevælger (godt eksempel eller forkert eksempel).

-

Hvad er skjult:

- AI-karakter

- AI-begrundelse

-

Navigation:

- Listevisningen viser alle testcases i en tabel.

- Vælg en række for at åbne detaljeret visning for længere svar.

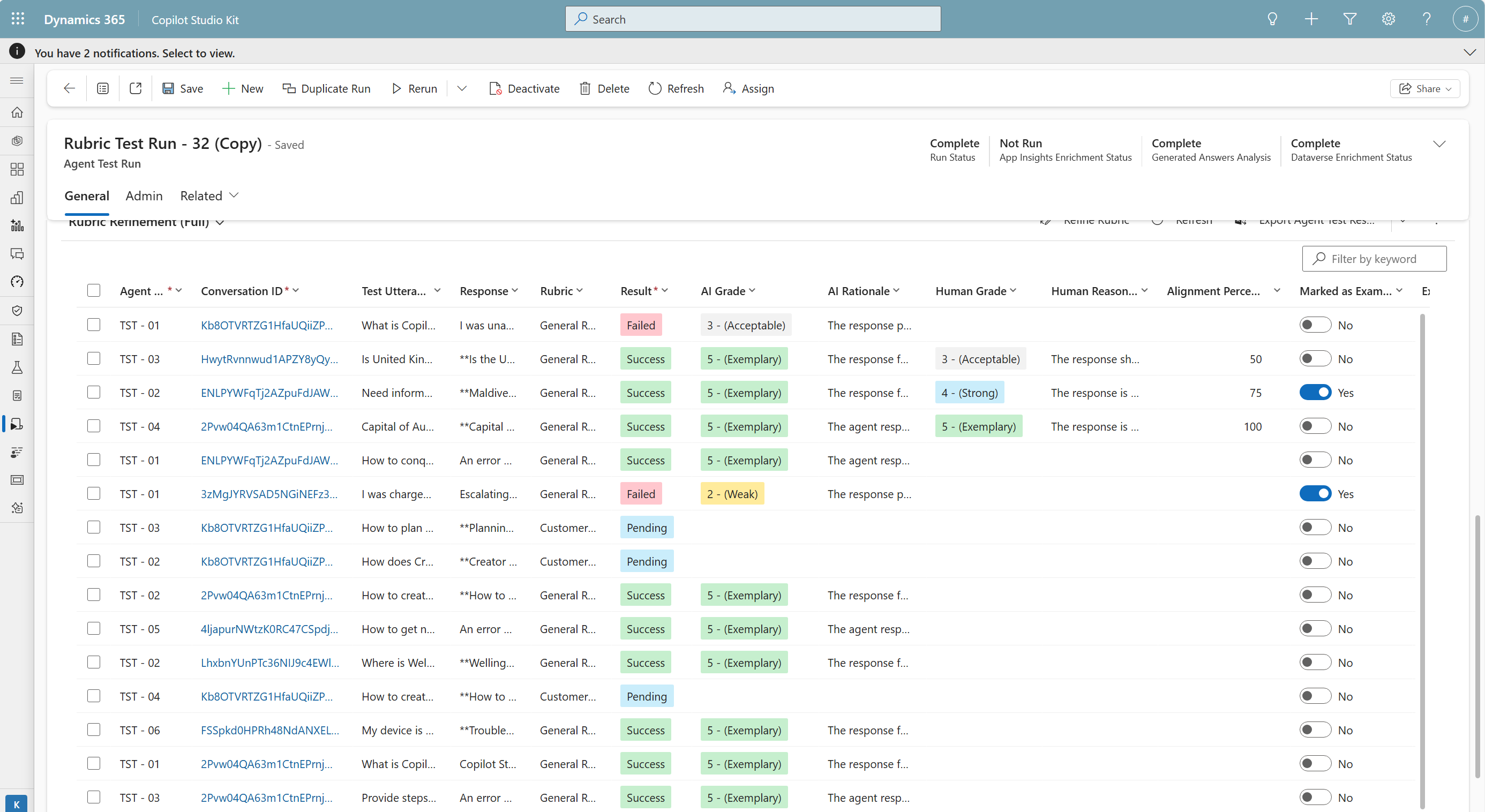

Fuld afgrænsningsvisning

Det følgende skærmbillede viser den komplette afgrænsningsvisning. Den indeholder AI-karakterer og -begrundelser, så du kan sammenligne vurderinger af mennesker og kunstig intelligens:

- Formål: Sammenlign AI- og menneskelige vurderinger for at forstå justering.

-

Hvornår skal du bruge:

- Når du har angivet menneskelige karakterer, kan du sammenligne med kunstig intelligens.

- For at forstå, hvorfor der opstod fejljustering.

- Til at identificere mønstre i AI-ræsonnering.

- Når du analyserer, hvilke svar der skal bruges eksempler på.

-

Hvad er synligt: Alt fra standardvisning plus:

- AI-karakter (1-5)

- AI-begrundelse (detaljeret ræsonnering)

-

Justeringsindikator: Visuel indikator, der viser, om human- og AI-kvaliteter stemmer overens.

- Justeret: AI-karakter = Menneskelig vurdering

- Forkert justeret: AI-vurdering ≠ menneskelig karakter

-

Nøgleindsigt: Den fulde visning hjælper dig med at forstå fejljusteringsmønstre.

- Er kunstig intelligens konsekvent for mild eller for streng?

- Hvilke kriterier fremhæver eller savner ai'en?

- Hvilke typer svar forvirrer kunstig intelligens?

Trin 3: Menneskelig klassificeringsproces

At levere nøjagtige, tankevækkende menneskelige vurderinger er afgørende for effektiv justering af vurderingskriterier.

Mulighed A: Klassificering af listevisning

Brug listevisningen (Standard eller Fuld) til hurtig klassificering:

- Gennemse hver testcase i tabellen.

- Læs testytring og agentsvar.

- Tildel en karakter (1-5) baseret på rubrickriterierne.

- Angiv en forklarende ræsonnering for din karakter.

- Flyt til den næste testcase.

Fordele:

- Hurtig til korte svar.

- God oversigt over alle sager.

- Effektiv til store testsæt.

Ulemper:

- Begrænset plads til visning af længere svar.

- Mindre detaljeret kontekst.

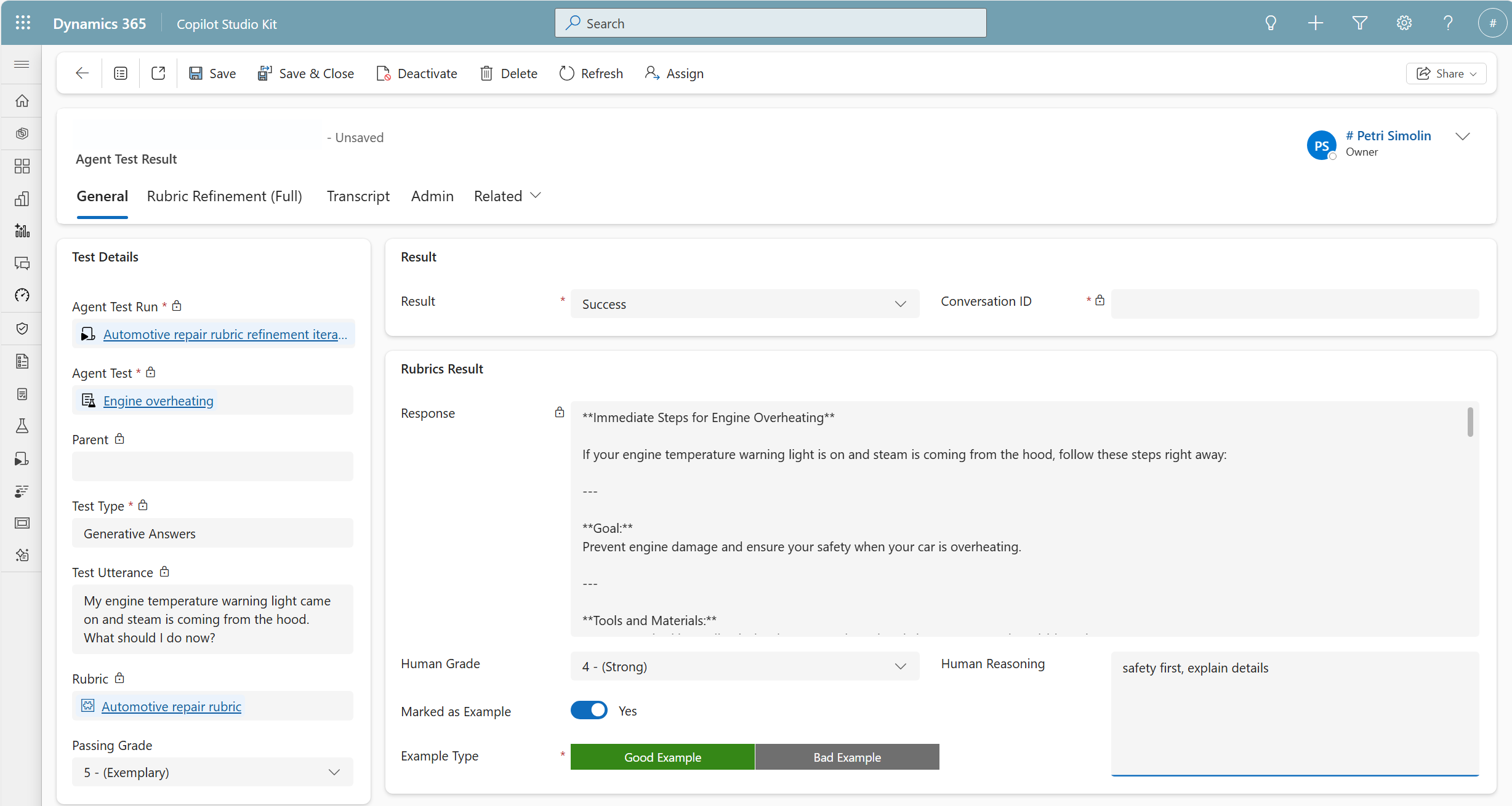

Mulighed B: Detaljeret visningsklassering

Brug den detaljerede visning til længere komplekse svar:

- Vælg en testcase i listevisningen for at åbne en detaljeret visning.

- Gennemse hele samtalekonteksten:

- Testytring vises tydeligt.

- Komplet agentsvar med fuld formatering.

- Naviger mellem testsager:

- Åbn og brug postbrowservisningen til venstre for at vælge forskellige test-cases.

- Skift mellem fanerne Afgrænsning og Rubric Refinement (Fuld).

- Vælg karakteren (1-5) på listen Human Grade .

- Angiv menneskelig ræsonnering:

- Forklar, hvorfor du har tildelt denne karakter.

- Henvis til specifikke bedømmelseskriterier.

- Bemærk eventuelle styrker eller svagheder.

- Ræsonnement er obligatorisk for afgrænsning.

- Slå Markeret som eksempel til Ja , hvis det er relevant. Få mere at vide i trin 4: Markering af eksempler.

Fordele:

- Fuld kontekst for komplekse svar.

- Bedre til omhyggelig, eftertænksom evaluering.

- Nemmere at referere til rubric under klassificering.

Komponenter i den detaljerede visning

Den detaljerede visning indeholder to faner:

-

Fanen Afgrænsning (AI Skjult):

- Testudsagn

- Agentsvar

- Human Grade selektor (påkrævet)

- Tekstfeltet Human Reasoning (påkrævet)

- Skiftknappen markeret som eksempel

- Eksempeltypevælger

- Fanen Rubric Refinement (Full) (AI Visible):

- Alle ovenstående plus:

- AI-karakter

- AI-begrundelse

- Justeringsindikator

Bedste praksis for menneskelig klassificering

Giv karakter uden at se AI-vurdering først:

- Brug fanen Standardafgrænsningsvisning eller Afgrænsning .

- Form din egen mening, før du sammenligner med AI.

Vær i overensstemmelse med rubrickriterier:

- Henvis til rubricdefinitionerne.

- Anvend de samme standarder på tværs af alle testcases.

- Du skal ikke bedømme "på en kurve" – brug absolutte standarder.

Skriv detaljeret ræsonnering:

- Forklar, hvilke rubrickriterier der blev opfyldt eller savnet.

- Vær specifik om styrker og svagheder.

- Din argumentation hjælper AI med at forstå, hvad du skal fokusere på.

Eksempel på god ræsonnering:

Grade 4 (Strong): Response includes accurate technical information about the issue and provides clear next steps. Tone is professional and reassuring. However, it lacks specific timeline estimates that would make it exemplary (Grade 5). All major IR elements present but could be more investor-ready.Eksempel på dårlig ræsonnering:

Grade 4: Pretty good.Vær ikke påvirket af pass eller fail:

- Målet er justering, ikke aflevering af scorer.

- Karakter ærligt baseret på kvalitet, ikke ønskede resultater.

Bedøm alle test-cases konsekvent

- Komplet klassificering for hele testsættet.

- Inkonsekvent klassificering reducerer effektiviteten af afgrænsningen.

Få mere at vide i Bedste fremgangsmåder og tip til afgrænsning af rubric.

Trin 4: Markering af eksempler

Eksempler forbedrer kvaliteten af rubric betydeligt ved at give konkrete illustrationer af gode og dårlige svar.

Formålet med eksempler

Eksempler hjælper AI'en med at forstå:

- Hvad godt faktisk ser ud i praksis.

- Hvilke dårlige svar indeholder , der gør dem uacceptable.

- Edge-tilfælde , hvor kriterier kan være uklare.

- Kontekst og nuance , som tekstbeskrivelser ikke kan registreres fuldt ud.

Sådan markerer du eksempler

I enten listevisning eller detaljeret visning:

- Slå Markeret som eksempel til Ja.

- Vælg eksempeltype:

- Godt eksempel: Illustrerer svar i høj kvalitet.

- Dårligt eksempel: Illustrerer svar af dårlig kvalitet.

- Systemet registrerer:

- Testudsagn

- Agentsvar

- Din eksempelangivelse (god eller dårlig)

Hvornår skal eksempler markeres?

Overvej at markere en testcase som et eksempel, hvis:

Godt eksempel:

- Svaret er grade 5 (eksemplarisk) og viser ideel kvalitet.

- Svaret er karakter 4 og viser alle nøglekriterier, selvom det ikke er perfekt.

- Svaret håndterer et komplekst scenarie ekseptionelt godt.

- Du vil styrke specifikke positive funktionsmåder.

Forkert eksempel:

- Svaret er klasse 1 (behov for forbedring) og lever tydeligt ikke op til forventninger.

- Svaret er karakter 2 og viser almindelige fejl, der skal undgås.

- Svaret viser en bestemt faldgrube eller fejltilstand.

- Du vil gerne præcisere, hvordan "ikke acceptabel" ser ud.

Enten:

- Testcasen repræsenterer en kantcase eller et tvetydigt scenarie.

- Der er manglende overensstemmelse mellem AI og menneskelige evalueringer, som hjælper med at tydeliggøre dine standarder.

- Testcasen er særligt repræsentativ for almindelige mønstre.

Hvor mange eksempler skal du markere

- Kvalitet over mængde: Et par velvalgte eksempler er bedre end mange middelmådige.

- Afvej god og dårlig: Medtag begge typer for at angive tydelige grænser.

- Repræsenter variation: Dæk forskellige typer forespørgsler og svar.

Tips

Fokuser på testcases, hvor der er fejljustering. Disse eksempler tydeliggør ofte, hvor rubrikken er tvetydig.

Trin 5: Forstå justering

Sammenligning viser, om AI- og de menneskelige karakterer stemmer overens.

Justering af individuel testcase

For hver testcase:

- Justeret: AI-karakter = Menneskelig vurdering

- Forkert justeret: AI-vurdering ≠ menneskelig karakter

Justeringsberegning for individuelle testcases

For hver testcase skal du beregne justeringen mellem AI-genererede svar og menneskelige forventninger ved hjælp af lineær interpolering fra 100% (perfekt match) til 0% (maksimalt anderledes).

Fortolkning:

- Når AI-vurdering = Menneskelig vurdering, justering = 100%.

- I takt med at bedømmelsesforskellen øges, reduceres justeringen lineært.

- Den maksimale forskel på en 1-5-skala er 4 trin, som er knyttet til 0%.

Formel:

alignment = 100% * (1 - |AI – Human| / 4)

Resultat af justeringsmatrix:

| AI ↓ / Menneske → | 1 | 2 | 3 | 4 | 5 |

|---|---|---|---|---|---|

| 1 | 100% | 75 % | 50% | 25 % | 0% |

| 2 | 75 % | 100% | 75 % | 50% | 25 % |

| 3 | 50% | 75 % | 100% | 75 % | 50% |

| 4 | 25 % | 50% | 75 % | 100% | 75 % |

| 5 | 0% | 25 % | 50% | 75 % | 100% |

Egenskaber:

- Symmetrisk: Justeringen er den samme, uanset hvilken værdi der er AI, og hvilken der er Human.

- Diagonal = 100%: Perfekt justering, når AI- og Human-karakterer matcher.

- Fjernkanter = 0%: Maksimal forskydning, når karaktererne er i modsatte ender af skalaen.

- Jævn, lineær interpolering: Justeringen reduceres ensartet, efterhånden som forskellen øges.

Hvad er god justering?

Der er ingen absolut standard, men brug disse generelle retningslinjer for den gennemsnitlige justeringsprocent for hele forbedringskørsel af rubrikken.

| Justering % | Vurdering | Aktion |

|---|---|---|

| 90-100% | Udmærket | Rubric er meget pålidelig; overveje at skifte til testtilstand. |

| 75-89% | God | Rubric er for det meste justeret. Forfin kanttilfælde. |

| 60-74% | Rimelig | Rubrikken skal forbedres; fokus på fejljusteringmønstre. |

| < 60% | Dårlig | Rubric kræver betydelig afgrænsning eller redesign. |

Analyser uosamstemmelse

Når der opstår fejljustering, skal du undersøge:

Forkert justeringsretning:

- Er kunstig intelligens konsekvent højere eller lavere end mennesker?

- Dette mønster angiver systematisk bias i rubrikken.

Mønstre i forkert justerede tilfælde:

- Medfører visse svartyper fejljusteringer?

- Bliver specifikke kriterier fejlfortolket?

Størrelse på forkert justering:

- Fra med 1 point (f.eks. AI=4, Human=5) → Mindre afgrænsning er nødvendig.

- Fra med 2+ punkter (f.eks. AI=2, Human=5) → Større præcisering er nødvendig.

Læs AI-begrundelser (fuld visning):

- Hvilke kriterier fokuserede AI'en på?

- Hvad missede AI'en, som mennesker bemærkede?

- Fortolker AI'en rubrik-beskrivelsen forkert?

Trin 6: Forbedr og gem bedømmelseskriterier

Når du har angivet menneskelige karakterer, markeret eksempler og analyseret justering, er du klar til at tilpasse rubrikken.

Hvordan fungerer forbedring af rubric

Når du vælger Afgræns rubric, analyserer AI:

Aktuelt rubricindhold:

- Beskrivelse af "Hvordan godt svar ser ud"

- Karakterdefinitioner (1-5)

- Eksisterende eksempler

Menneskelige karakterer og ræsonnering:

- Sådan vurderede du hvert svar

- Dine forklaringer på karakterer

AI-karakterer og -begrundelser:

- Sådan fortolkede AI rubrikken

- Hvor AI-ræsonnering afveg fra mennesker

Markerede eksempler:

- Test ytrings- og svarpar

- Gode eller dårlige betegnelser

- Kontekst om, hvad der gør dem eksemplariske eller fattige

Justeringsmønstre:

- Hvilke kriterier medfører konsekvent forkert justering

- Hvor rubrikken er tvetydig

- Hvad skal præciseres

AI opdaterer derefter rubrikken for at forbedre justeringen ved at:

- Tydeliggør tvetydigt sprog

- Tilføjelse af specificitet til karakterdefinitioner

- Indarbejdelse af eksempler

- Justering af vægt på kriterier

- Fjernelse af modsætninger eller forvirring

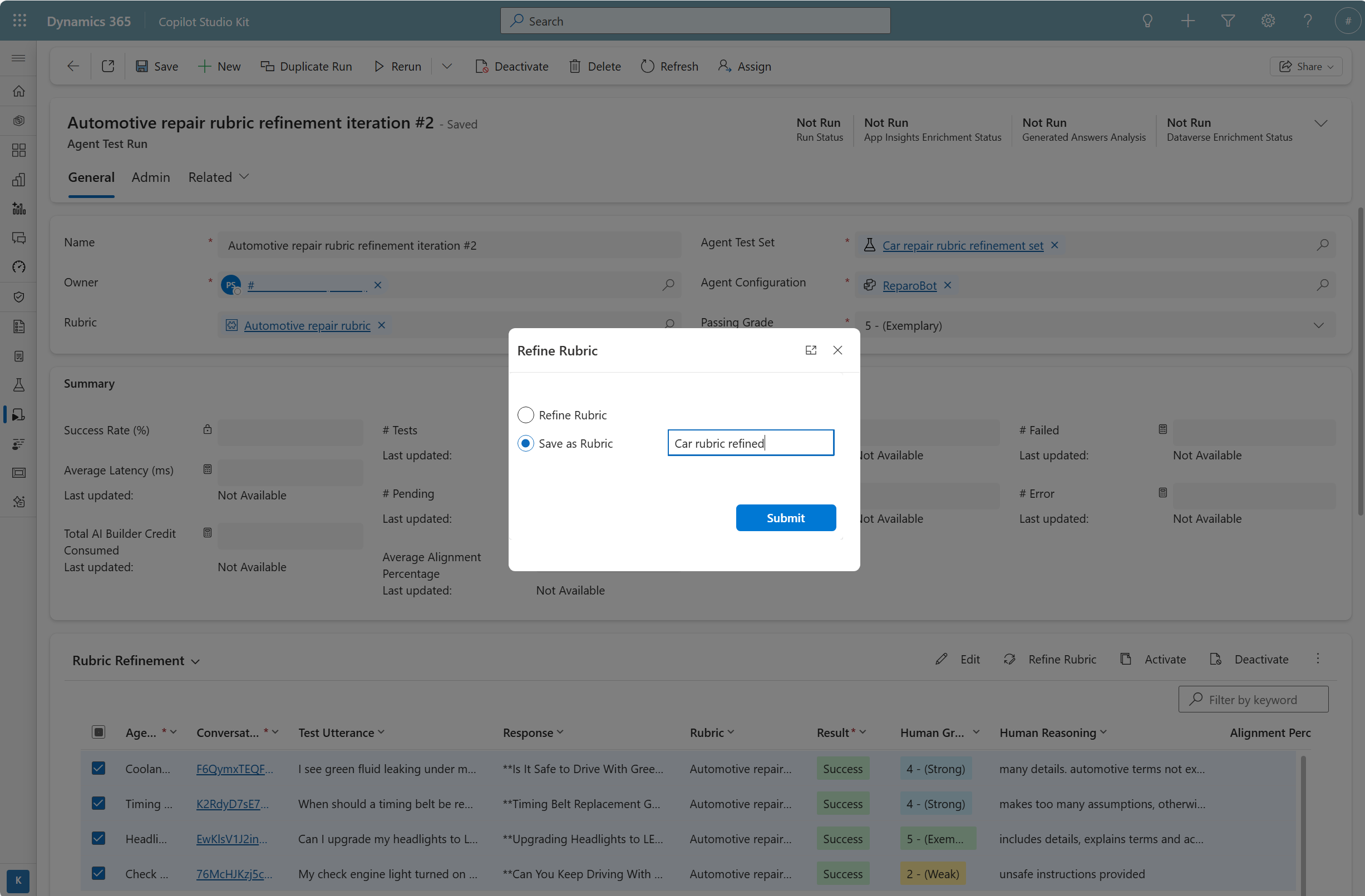

Afgræns en rubric

Sådan finjuster du en rubric:

I visningen til afgrænsning af rubric skal du vælge Afgræns rubric.

Systemet behandler alle klassificeringsdata og genererer afgrænsning.

Gennemse den raffinerede rubric. Systemet kan vise et eksempel.

Vælg en lagringsindstilling:

-

Gem (overskriv): Brug denne indstilling, når du gentagelser på den samme rubric og ikke behøver at bevare historikken.

- Erstatter den eksisterende rubric med den raffinerede version.

- Den oprindelige version går tabt (der er ingen versionshistorik i MVP).

-

Gem som (Opret ny): Brug denne indstilling, når du vil sammenligne versioner eller bevare en oprindelig plan.

- Opretter en ny rubric med et andet navn.

- Bevarer den oprindelige rubric.

Anbefaling: I forbindelse med tidlige gentagelser skal du bruge Gem som for at bevare historikken (f.eks. "IR-rapport v1", "IR-rapport v2"). Når rubriceringen stabiliseres, skal du bruge Gem til iteration.

-

Gem (overskriv): Brug denne indstilling, når du gentagelser på den samme rubric og ikke behøver at bevare historikken.

Trin 7: Kør test igen

Når du har gemt den raffinerede rubric, skal du teste, om justeringen er forbedret:

Dupliker testkørslen:

- Gå til den afsluttede testkørsel.

- Vælg Dupliker kør.

Udfør med den opdaterede rubric:

- Den duplikerede proces bruger den raffinerede rubric.

- Kør den mod det samme testsæt.

Sammenlign justeringsmålepunkter:

- Er justeringsprocenten steget?

- Er tidligere forkert justerede sager nu justeret?

Gennemse resultaterne:

- Brug visningen Fuld afgrænsning til at kontrollere justeringen.

- Bemærk eventuelle resterende fejljusteringer.

Trin 8: Gentagelse

Rubrikforbedring afsluttes sjældent i én cyklus. Fortsæt med at gentage:

Kør → gennemse → → afgræns → Gem → gentag igen.

Følg fremdrift:

- Overvåg justeringsprocenten på tværs af gentagelser.

- Bemærk, hvilke typer fejljustering der reduceres.

Juster strategi:

- Hvis justeringen ikke forbedres, skal du overveje den rubriciske tilgang.

- Tilføj flere eksempler på vedvarende fejljusteringsmønstre.

- Forenkler alt for komplekse kriterier.

Ved, hvornår du skal stoppe:

- Når justeringen når et acceptabelt niveau (typisk 75-90% eller højere).

- Når yderligere gentagelser viser faldende afkast.

- Når rubric pålideligt identificerer kvalitetsproblemer.

Arbejdsprocesoversigt

| Trin | Aktion | Resultat |

|---|---|---|

| 1. Start kørsel | Konfigurer testkørslen med rubric på testkørselsniveau. | AI-karakterer og -rationaler genereret |

| 2. Gennemse | Åbn vinduet Tilpasning af rubric (Standard eller Fuld). | Kontekst for vurdering |

| 3. Klasse (menneskelig) | Angiv karakterer (1-5) og ræsonnering for alle testcases. | Registrerede humane vurderinger |

| 4. Markér eksempler | Vælg gode eller forkerte eksempler. | Eksempler, der er hentet til afgrænsning |

| 5. Forstå justering | Sammenlign AI og menneskelige karakterer; analysere mønstre. | Justeringsprocent og indsigt |

| 6. Afgræns og gem | Vælg Afgræns rubric; vælg en lagringsindstilling. | Opdateret rubrik |

| 7. Kør igen | Kør, udfør og dupliker med forfinet kriteriesæt. | Nye justeringsdata |

| 8. Gentagelse | Gentag, indtil justering er acceptabel. | Pålidelig, troværdig rubric |

Tip til vellykket afgrænsning

Arbejdsprocessen for afgrænsning af rubric kan være kompleks. Her er nogle tip, der kan hjælpe dig med at navigere i processen effektivt.

Start med en rimelig baseline-rubric

Forvent ikke perfektion fra din oprindelige rubric. Fokus på:

- Definér udsagnet 'hvordan en god standard ser ud'

- Grundlæggende karakterdefinitioner med observerbare kriterier

- Raffinering derfra

Brug ensartede testcases

Brug det samme testsæt på tværs af gentagelser til at spore forbedring af justeringen. Ændring af test cases gør det svært at måle fremskridt.

Bedøm ærligt og grundigt

Dine menneskelige vurderinger er "den grundlæggende sandhed" for finjustering. Invester tid i:

- Eftertænksom evaluering

- Detaljeret ræsonnering

- Ensartet anvendelse af standarder

Fokuser på mønstre, ikke individuelle sager

En forkert justeret testcase er ikke en krise. Se efter:

- Systematiske mønstre i fejljustering

- Gentagne fejl på tværs af flere testcases

Brug eksempler strategisk

Eksempler er effektive, men overdrives ikke:

- Fokuser på forkert justerede sager og kantsager

- Afvej gode og dårlige eksempler

Gennemse AI-begrundelser

Ai'ens ræsonnering (Fuld visning) viser, hvordan den fortolker din rubric:

- Hvis AI'en fokuserer på de forkerte kriterier, skal du præcisere rubrikken

- Hvis AI'en savner vigtige punkter, skal du gøre dem mere fremtrædende

- Hvis ai'en bruger ulige logik, skal du tilføje eksempler for at vejlede den

Gentagelse med formål

Målret specifikke forbedringer for hver gentagelse:

- Gentagelse 1: Ret større fejljusteringsmønstre

- Gentagelse 2: Tilføj eksempler på edge-sager

- Gentagelse 3: Finjuster sprog for resterende fejljustering

Søg ikke 100% overensstemmelse

Perfekt justering er sjældent opnåeligt eller nødvendigt. I stedet skal du fokusere på:

- En vis subjektivitet er indbygget i evalueringen

- Faldende afkast efter ~85-90% tilpasning

- Pålidelig bedømmelse, ikke perfektion

Test med nye data til sidst

Efter flere gentagelser skal du teste rubricen på nye testcases for at:

- Sørg for, at rubricen generaliserer ud over dit træningssæt

- Undgå overtilpasning til bestemte eksempler

Fejlfinding af almindelige problemer

Under afgrænsning af rubric kan du støde på almindelige udfordringer. Her er nogle problemer, du kan støde på, sammen med mulige årsager og løsninger.

Justeringen forbedres ikke

Mulige årsager:

- Rubric kriterier er for subjektive eller vage

- Menneskelig klassificering er inkonsekvent

- Eksempler illustrerer ikke tydeligt standarder

Løsninger:

- Forenkler sproget for rubric; brug konkrete, observerbare kriterier

- Ombedøm testtilfælde med ensartede standarder

- Tilføj flere eksempler, især i forbindelse med kantsager

KUNSTIG INTELLIGENS er konsekvent for mild eller for streng

Mulige årsager:

- Karakterdefinitioner skelner ikke klart mellem niveauer

- "Hvad godt ser ud" sætter forkerte forventninger

Løsninger:

- Gør forskellen mellem karakterniveauer skarpere

- Tilføj eksempler, der viser rammeeksempler

- Rediger "hvordan succeskriterier ser ud" for at fastsætte en korrekt referenceniveau

Human og AI fokuserer på forskellige kriterier

Mulige årsager:

- Rubric viser for mange kriterier uden prioritering

- Vigtige kriterier er begravet eller uklare

Løsninger:

- Prioriter kriterier eksplicit i karakterdefinitioner

- Start med de vigtigste kriterier

- Brug eksempler til at demonstrere prioritet

Lange svar er svære at bedømme

Løsninger:

- Brug Detaljeret visning til fuld kontekst

- Opdel evalueringen i dimensioner (nøjagtighed, tone, fuldstændighed) og vurder hver

- Overvej, om rubrikken skal fokusere på specifikke aspekter i stedet for den overordnede kvalitet

Test cases er for meget ens

Løsninger:

- Udvid testsættet, så det omfatter variation

- Tilføj testcases, der dækker edge cases, forskellige forespørgselstyper, komplekse scenarier

- Brug oprettelse af testcase (P1-funktion), når den er tilgængelig