Forstå vigtige begreber

Azure Databricks er en enkelt tjenesteplatform med flere teknologier, der gør det muligt at arbejde med data i stor skala. Når du bruger Azure Databricks, er der nogle vigtige begreber at forstå.

Arbejdsområder

Et arbejdsområde i Azure Databricks er et sikkert samarbejdsmiljø, hvor du kan få adgang til og organisere alle Databricks-aktiver, f.eks. notesbøger, klynger, job, biblioteker, dashboards og eksperimenter.

Du kan åbne et Azure Databricks-arbejdsområde fra Azure Portal ved at vælge Start arbejdsområde.

Det giver en webbaseret brugergrænseflade (UI) samt REST API'er til styring af ressourcer og arbejdsgange. Arbejdsområder kan struktureres i mapper for at organisere projekter, datapipelines eller teamaktiver, og tilladelser kan anvendes på forskellige niveauer for at styre adgangen. De understøtter samarbejde ved at give flere brugere – f.eks. datateknikere, analytikere og dataloger – mulighed for at arbejde sammen på delte notesbøger, spore eksperimenter og administrere afhængigheder.

Derudover er arbejdsområder knyttet til Unity Catalog (når de er aktiveret) til centraliseret datastyring, hvilket sikrer sikker adgang til data på tværs af organisationen. Hvert arbejdsområde er også knyttet til en underliggende Azure-ressourcegruppe (herunder en administreret ressourcegruppe), der indeholder de beregnings-, netværks- og lagerressourcer, som Databricks bruger i baggrunden.

Notebooks

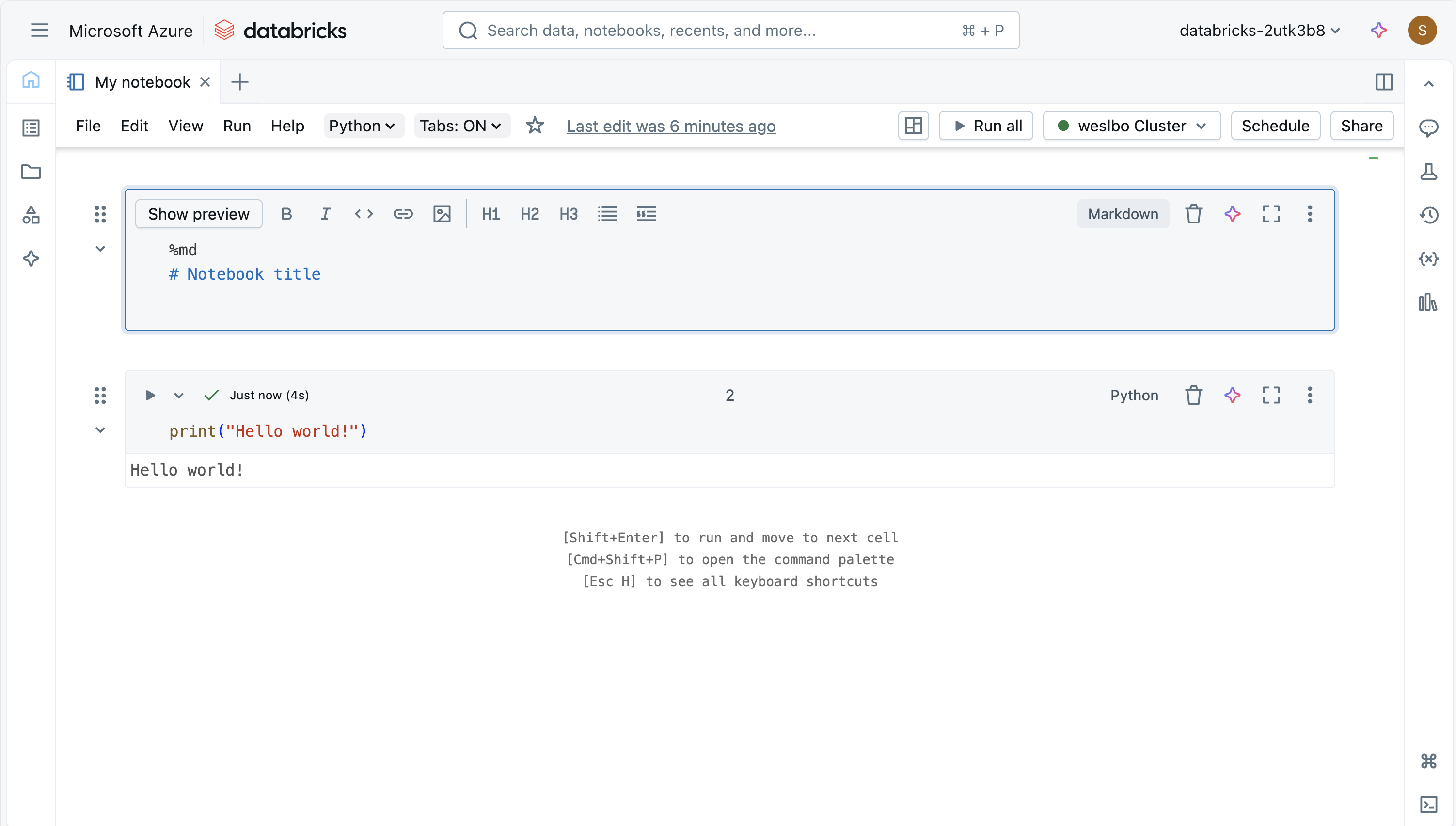

Databricks-notesbøger er interaktive, webbaserede dokumenter, der kombinerer kørbar kode, visualiseringer og fortællende tekst i et enkelt miljø. De understøtter flere sprog – f.eks. Python, R, Scala og SQL – og giver brugerne mulighed for at skifte mellem sprog i den samme notesbog ved hjælp af magiske kommandoer. Denne fleksibilitet gør notesbøger velegnede til udforskende dataanalyse, datavisualisering, eksperimenter med maskinel indlæring og opbygning af komplekse datapipelines.

Notesbøger er også designet til samarbejde: Flere brugere kan redigere og køre celler samtidigt, tilføje kommentarer og dele indsigt i realtid. De integreres tæt med Databricks-klynger, hvilket gør det muligt for brugere at behandle store datasæt effektivt og kan oprette forbindelse til eksterne datakilder via Unity Catalog for styret dataadgang. Derudover kan notesbøger versionsstyres, planlægges som job eller eksporteres til deling uden for platformen, hvilket gør dem centrale for både ad hoc-udforskning og arbejdsgange i produktionskvalitet.

Notesbøger indeholder en samling af to typer celler: kodeceller og Markdown-celler. Kodeceller indeholder kørbar kode. Markdown-celler indeholder Markdown-kode, der gengives som tekst og grafik. Du kan køre en enkelt celle, en gruppe celler eller hele notesbogen.

Klynger

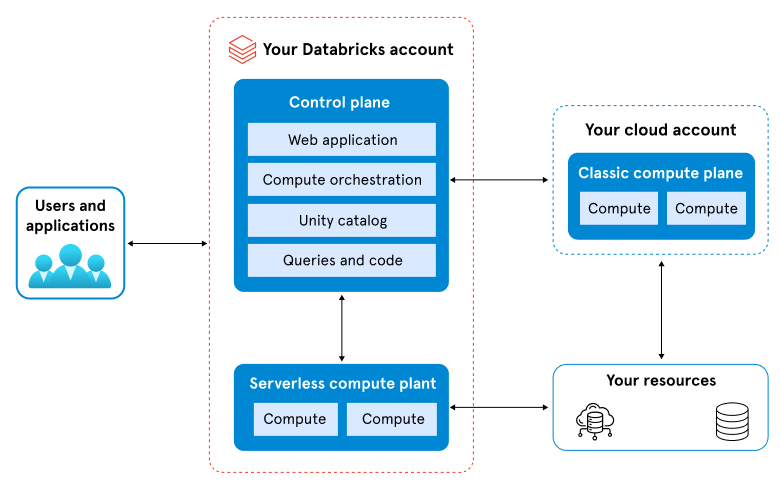

Azure Databricks udnytter en arkitektur i to lag:

- Kontrolplan: Dette interne lag, der administreres af Microsoft, håndterer backend-tjenester, der er specifikke for din Azure Databricks-konto.

- Beregningsplan: Dette er det eksterne lag, der behandler dataene og findes i dit Azure-abonnement.

Klynger er de centrale beregningsprogrammer i Azure Databricks. De leverer den processorkraft, der kræves til at køre data engineering, data science og analyseopgaver. Hver klynge består af en drivernode, der koordinerer udførelsen, og en eller flere arbejdsnoder, som håndterer de distribuerede beregninger. Klynger kan oprettes manuelt med faste ressourcer eller indstilles til automatisk skalering, så Databricks kan tilføje eller fjerne arbejdsnoder afhængigt af arbejdsbelastningsbehovet. Denne fleksibilitet sikrer effektiv ressourceudnyttelse og omkostningskontrol.

Azure Databricks Compute tilbyder et bredt sæt beregningsindstillinger, der er tilgængelige for forskellige arbejdsbelastningstyper:

- Serveruafhængig beregning: Fuldt administreret beregning efter behov, der automatisk skaleres op eller ned for at opfylde arbejdsbelastningsbehov. Ideel til teams, der ønsker hurtige opstartstider, minimale administrationsomkostninger og elastisk skalering.

- Klassisk beregning: Brugerklargjorte og konfigurerede klynger, der giver fuld kontrol over beregningsindstillinger, f.eks. VM-størrelser, biblioteker og kørselsversioner. Bedst til specialiserede arbejdsbelastninger, der kræver tilpasning eller ensartet ydeevne.

- SQL-lagersteder: Beregningsressourcer, der er optimeret til SQL-baserede analyser og BI-forespørgsler. SQL-lagerbygninger kan klargøres som enten serveruafhængige (elastiske, administrerede) eller klassiske (brugerkonfigurerede) afhængigt af krav til styring og ydeevne.

Dette giver dig mulighed for at skræddersy beregning til specifikke behov – fra sonderende analyse i notesbøger til ETL-pipelines i stor skala til dashboards og rapportering med høj ydeevne.

Kørsel af Databricks

Databricks Runtime er et sæt brugerdefinerede builds af Apache Spark, der indeholder forbedringer af ydeevnen og yderligere biblioteker. Disse runtimes gør det nemmere at håndtere opgaver som maskinlæring, grafbehandling og genomik, samtidig med at de understøtter generel databehandling og analyse.

Databricks leverer flere kørselsversioner, herunder LTS-udgivelser (Long-Term Support). Hver udgivelse angiver den underliggende Apache Spark-version, dens udgivelsesdato, og hvornår supporten ophører. Over tid følger ældre kørselsversioner en livscyklus:

- Legacy – tilgængelig, men anbefales ikke længere.

- Udfaset – markeret til fjernelse i en fremtidig version.

- Ophør af support (EoS) – der leveres ingen yderligere rettelser eller rettelser.

- End of Life (EoL) – udgået og ikke længere tilgængelig.

Hvis der udgives en vedligeholdelsesopdatering til en kørselsversion, du bruger, kan du anvende den ved at genstarte klyngen.

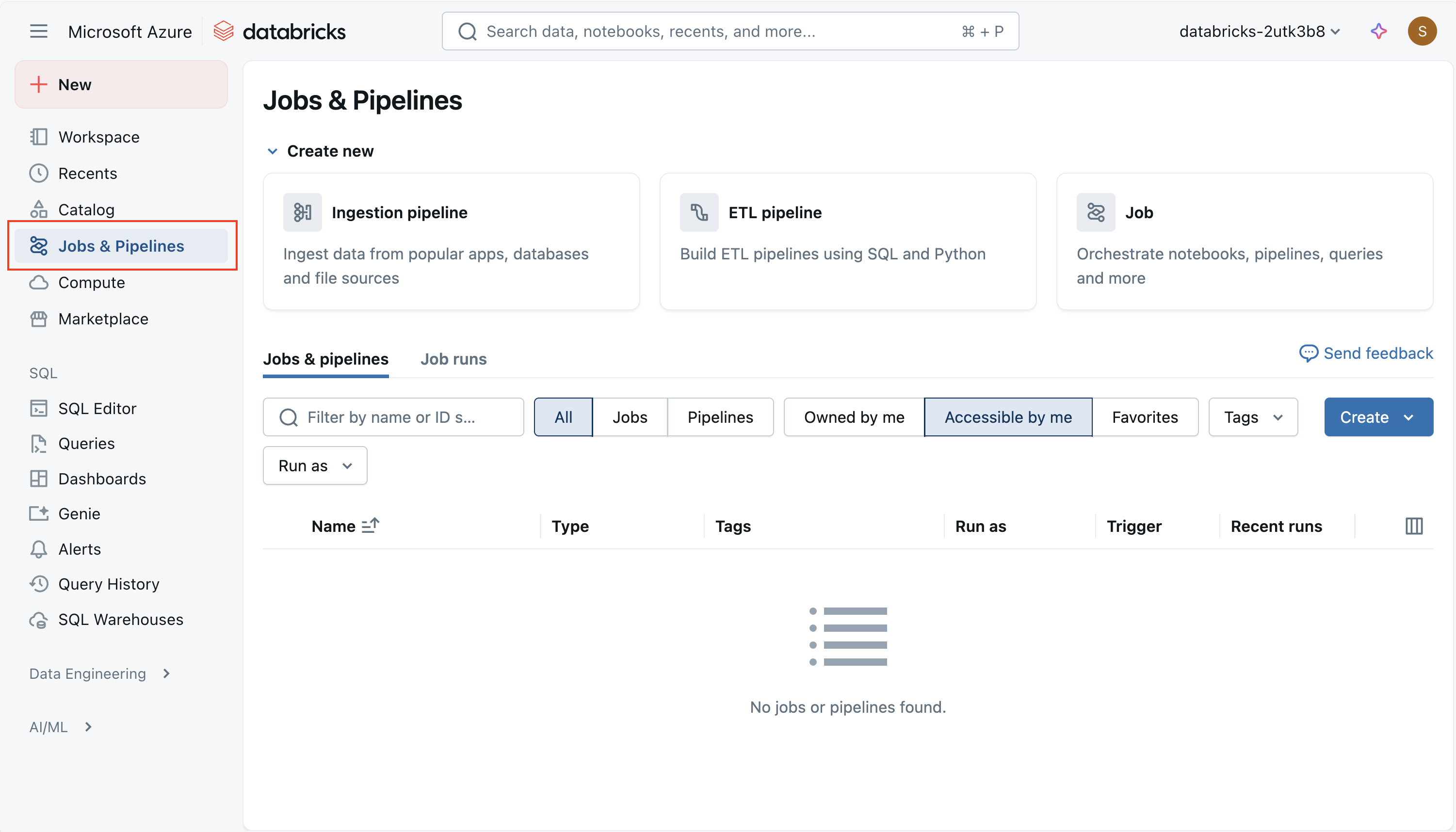

Lakeflow Job

Lakeflow-job leverer automatisering og orkestrering af arbejdsprocesser i Azure Databricks, hvilket gør det muligt at planlægge, koordinere og køre databehandlingsopgaver på en pålidelig måde. I stedet for at køre kode manuelt kan du bruge job til at automatisere gentagne arbejdsbelastninger eller arbejdsbelastninger i produktionsklassen, f.eks. ETL-pipelines, træning i maskinel indlæring eller opdateringer af dashboards.

Et job i Databricks er i bund og grund en objektbeholder til en eller flere opgaver. Opgaver definerer det arbejde, der skal udføres – f.eks. at køre en notesbog, udføre et Spark-job, kalde ekstern kode, ...

Job kan udløses på forskellige måder:

- På en tidsplan (f.eks. hver aften ved midnat).

- Som reaktion på en begivenhed.

- Manuelt, når det er nødvendigt.

Da de kan gentages og administreres, er job afgørende for produktionsarbejdsbelastninger. De sikrer, at datapipelines kører konsekvent, ML-modeller trænes og implementeres på en kontrolleret måde, og downstream-systemer modtager opdaterede, nøjagtige data.

Delta-søen

Delta Lake er en lagerstruktur med åben kildekode, der forbedrer pålideligheden og skalerbarheden af datasøer ved at tilføje transaktionsfunktioner oven på cloudobjektlageret, f.eks. Azure Data Lake Storage. Traditionelle datasøer kan lide af problemer som inkonsekvente data, delvise skrivninger eller problemer med at administrere samtidig adgang. Delta Lake løser disse problemer ved at understøtte:

- ACID-transaktioner (atomicitet, konsistens, isolering, holdbarhed) for pålidelige læsninger og skrivninger.

- Skalerbar metadatahåndtering , så tabeller kan vokse til milliarder af filer uden tab af ydeevne.

- Dataversionering og tilbagerulning, hvilket muliggør tidsrejseforespørgsler og gendannelse af tidligere tilstande.

- Samlet batch- og streamingbehandling, så den samme tabel kan håndtere indtagelse i realtid og historiske batchindlæsninger.

Ud over dette fundament giver Delta-tabeller en velkendt tabelabstraktion, der gør det nemmere at arbejde med strukturerede data ved hjælp af SQL-forespørgsler eller DataFrame API'en. Deltatabeller er standardtabelformatet i Azure Databricks, hvilket sikrer, at nye data gemmes med transaktionsgarantier som standard.

Databricks SQL

Databricks SQL bringer datalagerfunktioner til Databricks Lakehouse, så analytikere og forretningsbrugere kan forespørge på og visualisere data, der er gemt i åbne formater, direkte i datasøen. Den understøtter ANSI SQL, så alle, der er fortrolige med SQL, kan køre forespørgsler, bygge rapporter og oprette dashboards uden at skulle lære nye sprog eller værktøjer.

Databricks SQL er kun tilgængelig på Premium-niveauet af Azure Databricks. Den indeholder:

- En SQL-editor til at skrive og køre forespørgsler.

- Dashboards og visualiseringsværktøjer til deling af indsigt.

- Integration med eksterne BI- og analyseværktøjer.

SQL-varehuse

Alle Databricks SQL-forespørgsler kører på SQL-lagersteder (tidligere kaldet SQL-slutpunkter), som er skalerbare beregningsressourcer, der er afkoblet fra lageret. Forskellige lagertyper er tilgængelige afhængigt af ydeevne, omkostninger og administrationsbehov:

Serveruafhængige SQL-lagre

- Øjeblikkelig og elastisk beregning med hurtig opstart og automatisk skalering.

- Lavt administrationsomkostninger , da Databricks håndterer kapacitet, programrettelser og optimering.

- Omkostningseffektivitet ved at skalere automatisk og undgå inaktive ressourceomkostninger.

Pro SQL-varehuse

- Mere tilpasselig, men langsommere at starte (≈4 minutter).

- Mindre responsiv autoskalering sammenlignet med serveruafhængig.

- Nyttigt, når der kræves konsistente, forudsigelige arbejdsbelastninger.

Klassiske SQL-varehuse

- Beregningsressourcer kører i dit eget Azure-abonnement, ikke i Databricks.

- Mindre fleksibel end serveruafhængig, men kan foretrækkes til specifikke krav til styring eller omkostningsstyring.

MLflow

MLflow er en open source-platform designet til at administrere livscyklussen for maskinlæring (ML) fra start til slut. Det hjælper dataloger og ML-ingeniører med at spore eksperimenter, administrere modeller og strømline processen med at flytte modeller fra udvikling til produktion. MLflow understøtter også generative AI-arbejdsgange og inkluderer værktøjer til evaluering og forbedring af AI-agenter.