Vælg modeller ved hjælp af benchmarks

Før du implementerer en model, vil du forstå, hvordan den præsterer på tværs af forskellige dimensioner. Modelbenchmarks giver objektive, målbare data, der hjælper dig med at sammenligne modeller og træffe informerede valgbeslutninger. Microsoft Foundry-portalen tilbyder omfattende benchmarkingværktøjer organiseret i kvalitets-, sikkerheds-, omkostnings- og præstationsmålinger.

Access-modelbenchmarks

Du kan udforske benchmarks på to måder inden for Microsoft Foundry-portalen:

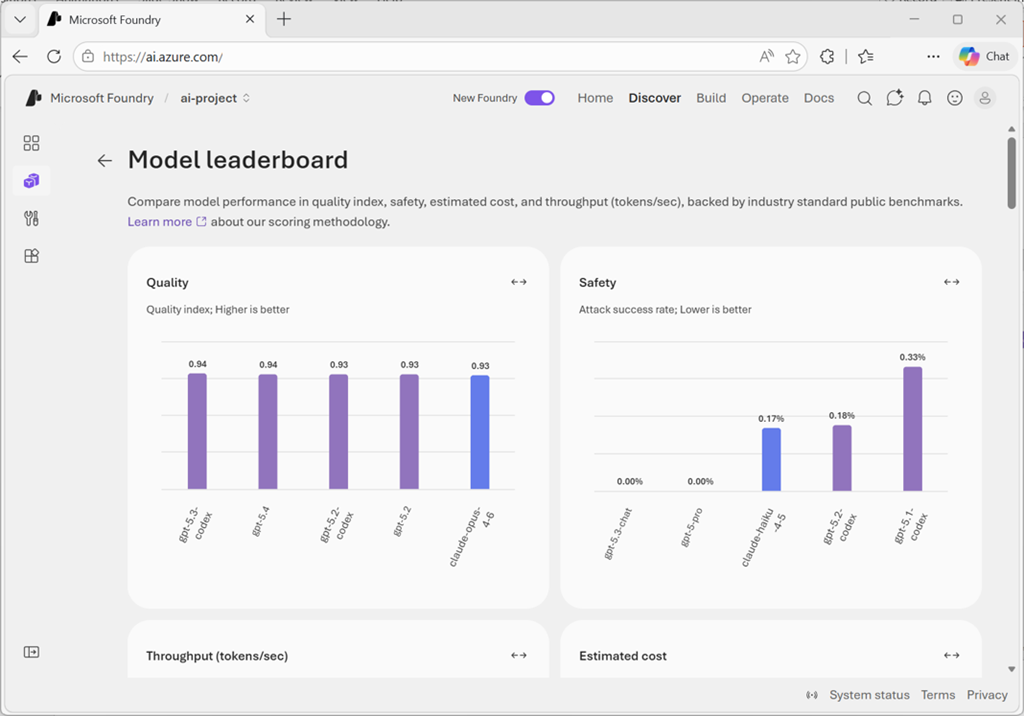

I modelkataloget kan du se model-leaderboardet for at se sammenlignende rangeringer på tværs af alle tilgængelige modeller. Denne visning hjælper dig med at identificere de bedst præsterende modeller for specifikke målinger eller scenarier. Leaderboardet viser topmodeller rangeret efter kvalitet, sikkerhed, estimeret pris og gennemløb.

For detaljerede benchmarks på en specifik model, åbn dens modelkort og vælg fanen Benchmarks . Dette billede viser, hvordan den enkelte model præsterer på tværs af forskellige målinger og datasæt, hvor sammenligningsdiagrammer placerer den i forhold til lignende modeller.

Kvalitetsbenchmarks

Kvalitetsbenchmarks vurderer, hvor godt en model genererer nøjagtige, sammenhængende og kontekstuelt passende svar. Disse målinger bruger offentlige datasæt og standardiserede evalueringsmetoder for at sikre konsistens.

Quality Index giver et overordnet overblik ved at gennemsnitliggøre nøjagtighedsscorer på tværs af flere benchmark-datasæt, der måler ræsonnement, viden, spørgsmålsbesvarelse, matematiske evner og kodningsfærdigheder. Højere kvalitetsindeksværdier indikerer stærkere samlet præstation på tværs af generelle sprogopgaver.

Kvalitetsbenchmarks bruger datasæt såsom:

- Arena-Hard - besvarelse af modsætningsspørgsmål

- BIG-Bench Hård - ræsonnementsevner

- GPQA - kandidatniveau tværfaglige spørgsmål

- HumanEval+ og MBPP+ - kodegenereringsopgaver

- MATEMATIK - matematisk ræsonnement

- MMLU-Pro - almen vidensvurdering

- IFEval - instruktionsfølgning

Benchmark-scorer er normaliserede indeks fra nul til ét, hvor højere værdier indikerer bedre præstation.

Sikkerhedsstandarder

Sikkerhedsmålinger sikrer, at modeller ikke genererer skadeligt, partisk eller upassende indhold. Disse benchmarks er afgørende for applikationer, der er eksponeret for slutbrugere, især i regulerede brancher eller kundeorienterede scenarier.

Microsoft Foundry evaluerer modeller på tværs af flere sikkerhedsdimensioner:

Detektion af skadelig adfærd bruger HarmBench-benchmarken til at måle, hvor godt modeller modstår at generere usikkert indhold. Evalueringen beregner Attack Success Rate (ASR), hvor lavere værdier indikerer sikrere og mere robuste modeller. HarmBench tester tre funktionelle områder:

- Standard skadelig adfærd – cyberkriminalitet, ulovlige aktiviteter, generel skade

- Kontekstuelt skadelige adfærd – misinformation, chikane, mobning

- Ophavsretskrænkelser - gengivelse af ophavsretligt beskyttet materiale

Toksisk indholdsdetektion bruger ToxiGen-datasættet til at måle, hvor godt modeller identificerer modsætning og implicit hadetale. Højere F1-scorer indikerer bedre detektionspræstation på tværs af referencer til minoritetsgrupper.

Sensitiv domæneviden bruger WMDP (Weapons of Mass Destruction Proxy) benchmark til at måle modelviden inden for biosikkerhed, cybersikkerhed og kemisk sikkerhed. Højere WMDP-scorer indikerer større viden om potentielt farlige kapaciteter.

Sikkerhedsscorer hjælper dig med at forstå modellens robusthed, hvilket især er vigtigt for kundeorienterede applikationer, hvor skadelig output udgør betydelige bekymringer.

Omkostningsbenchmarks

At forstå den økonomiske påvirkning af modelbrug hjælper dig med at balancere kvalitetskrav med budgetbegrænsninger. Omkostningsbenchmarks i Microsoft Foundry viser priser for serverløse API-implementeringer og Azure OpenAI-modeller.

Omkostninger pr. inputtokens viser prisen for at behandle 1 million inputtokens (den tekst, du sender til modellen).

Omkostninger pr. output-tokens angiver prisen for at generere 1 million outputtokens (den tekst, modellen producerer).

Estimeret omkostning kombinerer input- og outputomkostninger ved at bruge et typisk 3:1-forhold (tre inputtokens for hver outputtoken), hvilket giver dig et enkelt tal til sammenligning. Lavere værdier indikerer mere omkostningseffektive modeller.

Omkostningsbenchmarks hjælper dig med at identificere modeller, der leverer den kvalitet, du har brug for, til en pris, der passer til din applikations brugsmønstre og budget.

Ydelsesbenchmarks

Præstationsmålinger måler, hvor hurtigt og effektivt modeller reagerer på forespørgsler. Disse benchmarks er vigtige for realtidsapplikationer, hvor brugeroplevelsen afhænger af responsivitet.

Latensmålinger omfatter:

- Latenstid gennemsnit - gennemsnitlig tid i sekunder til at behandle en forespørgsel

- Latenstid P50 (median) - 50% af forespørgsler bliver færdige hurtigere end denne tid

- Latenstid P90 - 90% af forespørgsler gennemføres hurtigere end denne gang

- Latenstid P95 - 95% forespørgsler bliver færdige hurtigere end denne gang

- Latenstid P99 - 99% af forespørgsler bliver færdige hurtigere end denne gang

- Tid til første token (TTFT) - tid indtil det første token ankommer, når man bruger streaming

Gennemstrømningsmålinger omfatter:

- Genererede tokens per sekund (GTPS) - outputtokens genereret pr. sekund

- Samlede tokens per sekund (TTPS) - kombinerede input- og outputtokens behandlet pr. sekund

- Tid mellem tokens - interval mellem modtagende på hinanden følgende tokens

Leaderboardet opsummerer præstationen ved at bruge gennemsnitlig tid til første token (lavere er bedre) og gennemsnitlig genererede tokens pr. sekund (højere er bedre). Høj-gennemløbs, lav-latenstid modeller giver bedre brugeroplevelser i interaktive applikationer. For batchbehandlingsopgaver, hvor hastighed betyder mindre end omkostninger, kan du prioritere andre faktorer.

Brug ranglister og sammenligningsfunktioner

Modelleaderboardet lader dig se topmodeller for specifikke målinger. Du kan sortere efter kvalitet, sikkerhed, estimeret pris og gennemstrømning for at identificere modeller, der bedst matcher dine krav.

Scenarie-leaderboards hjælper dig med at finde modeller optimeret til specifikke anvendelsestilfælde som ræsonnement, kodning, matematik, spørgsmålsbesvarelse eller jordforbindelse. Hvis din applikation er tilpasset et bestemt scenarie, så start med den relevante scenarie-rangliste i stedet for kun at stole på den samlede kvalitetsindeks.

Afvejningsdiagrammer viser to målinger samtidig, såsom kvalitet versus omkostninger eller kvalitet versus gennemstrømning. Disse visualiseringer hjælper dig med at finde den optimale balance til dine behov. Brug dropdown-menuen til at sammenligne kvalitet med omkostninger, gennemstrømning eller sikkerhed. Modeller tættere på øverste højre hjørne af diagrammet klarer sig godt på begge målinger. En model, der er lidt mindre præcis, men betydeligt hurtigere eller billigere, kan måske bedre opfylde dine behov.

Side-om-side sammenligning lader dig vælge to eller tre modeller fra leaderboardet og sammenligne dem på tværs af flere dimensioner:

- Ydelsesbenchmarks (kvalitet, sikkerhed, gennemstrømning)

- Modeldetaljer (kontekstvindue, træningsdata, understøttede sprog)

- Understøttede endepunkter (udrulningsmuligheder)

- Funktionsunderstøttelse (funktionskald, struktureret output, vision)

Vælg modeller ved at sætte kryds ved deres navne, og vælg derefter Sammenlign for at åbne den detaljerede sammenligningsvisning.