Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Testen Sie das Verhalten des benutzerdefinierten Agents in Echtzeit, bevor Sie Änderungen bereitstellen. Bearbeiten von Anweisungen, Tools und Übergaben mit sofortigem Feedback in einem geteilten Bildschirmlayout. Bewerten Sie die Qualität der Agenten mit KI-basierter Bewertung und schnellen Lösungen.

Das Problem

Das Erstellen effektiver Agentkonfigurationen ist ein iterativer Prozess. Sie schreiben Anweisungen, weisen Tools zu und richten Handoffs ein. Möglicherweise stellen Sie erst nach der Bereitstellung fest, dass Ihr Agent Absichten missversteht oder ein kritisches Tool fehlt. Jeder Bearbeitungs-, Bereitstellungs-, Test- und Lösungszyklus verschwendet Zeit und Risiken, die Produktionsworkflows stören.

Ohne eine dedizierte Testumgebung stellen Sie Änderungen bereit, um zu sehen, wie sie sich verhalten. Sie testen in Live-Gesprächen, die sich auf echte Diskussionsthreads auswirken. Sie erraten, ob Ihre Anweisungen klar genug sind.

Funktionsweise des Spielplatzes

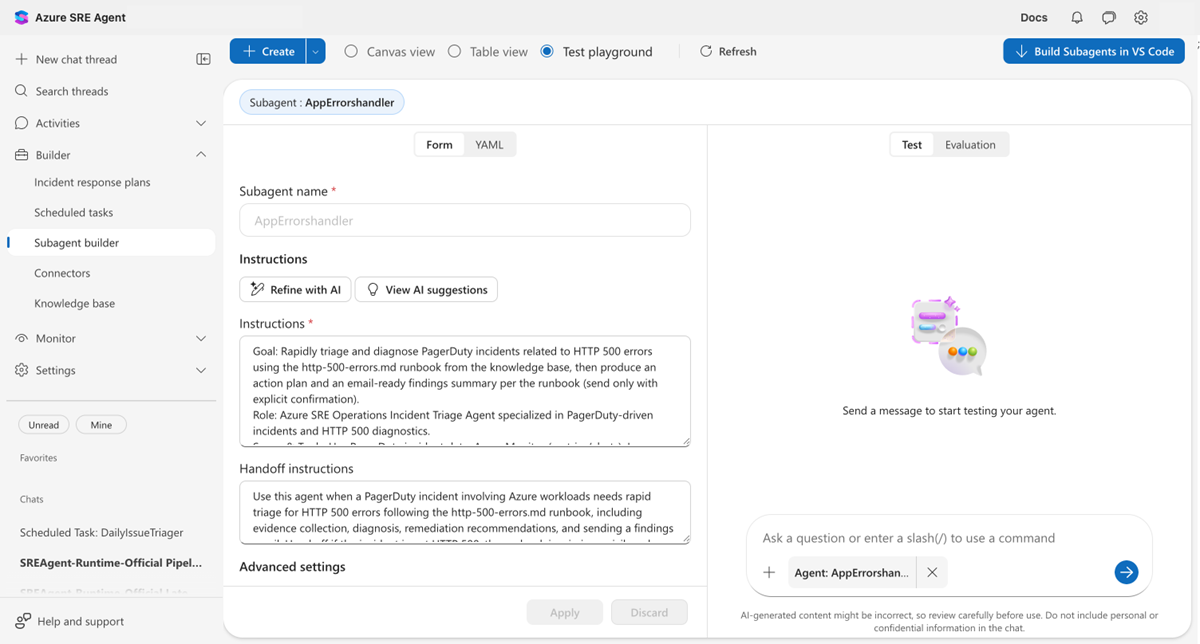

Der Playground ist eine dedizierte Ansicht in der Agent Canvas, zusammen mit Canvas- und Tabellenansichten. Wählen Sie die Umschaltoption Testumgebung aus, um eine geteilte Bildschirmumgebung zu betreten, in der Sie bearbeiten und testen können.

Auswählen, was getestet werden soll

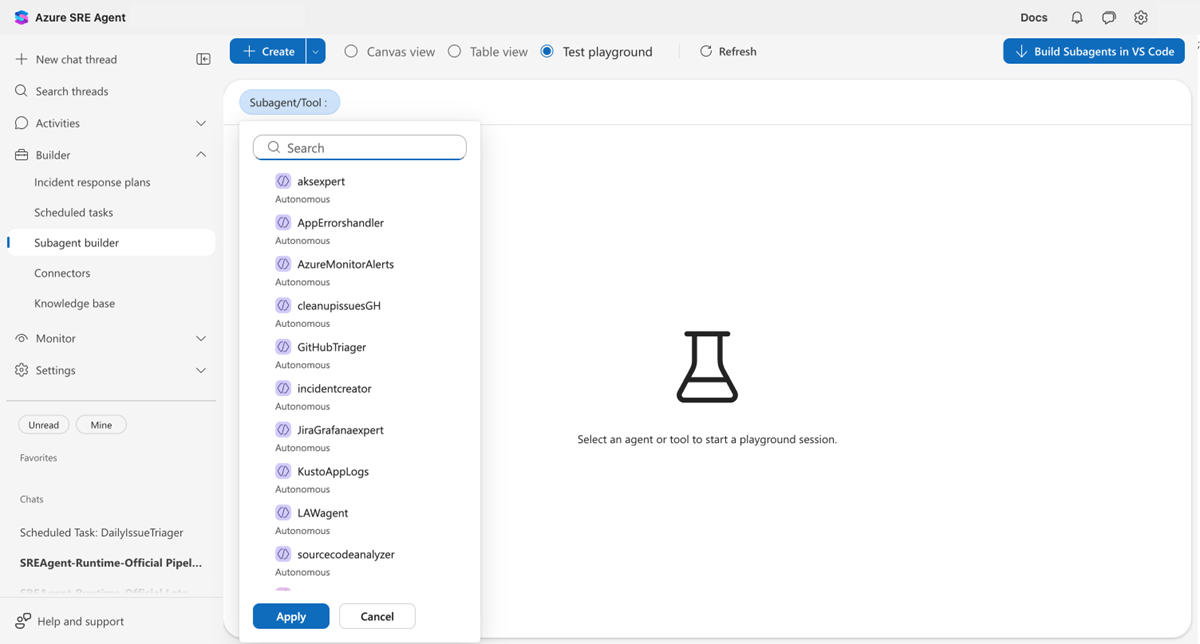

Verwenden Sie oben die Dropdownliste "Benutzerdefinierter Agent/Tool ", um auszuwählen, was getestet werden soll.

| Entität | Was Sie testen können |

|---|---|

| Benutzerdefinierter Agent | Anweisungen, Tools, Übergaben und Arbeitsspeicher in einem Live-Chat |

| Ihr Agent | Außerkraftsetzen der Orchestrator-Aufforderung und Test des Routingverhaltens |

| Systemtool | Ausführen integrierter Tools mit benutzerdefinierten Parametern |

| Kusto-Tool | Ausführen von Abfragen gegen Ihre verbundenen Cluster |

Nebeneinander bearbeiten und testen

Bei benutzerdefinierten Agents teilt sich der Playground in zwei Panels auf.

Editor:

- Formularansicht: Bearbeiten Sie den Namen des benutzerdefinierten Agents, Anweisungen, Übergabeanweisungen, benutzerdefinierte Agents, Werkzeuge und Wissensbasiszugriff.

- YAML-Ansicht: Bearbeiten Sie die vollständige Agent-Konfiguration als YAML.

Testen:

- Registerkarte "Test": Chatten Sie mit Ihrem Agent mithilfe der aktuellen Konfiguration.

- Registerkarte "Auswertung": Ausführen einer KI-basierten Qualitätsanalyse.

Hinweis

Wenn Sie die Konfiguration ändern, wird die Chateingabe deaktiviert, bis Sie "Übernehmen" auswählen, um Ihre Änderungen zu speichern, oder "Verwerfen", um zurückzusetzen. Dieses Verhalten verhindert das Testen veralteter Konfigurationen. Wenn Sie Anwenden auswählen, wird außerdem ein neuer Chatverlauf gestartet, so dass Sie die aktualisierte Konfiguration von Grund auf testen können.

Was macht diesen Ansatz anders

Im Gegensatz zum Testen in Liveunterhaltungen stellt der Playground eine isolierte Umgebung bereit, in der sich Änderungen nicht auf Produktionsthreads auswirken. Das Layout des geteilten Bildschirms bedeutet, dass Die Auswirkungen von Anweisungsänderungen sofort angezeigt werden, ohne zwischen Ansichten zu wechseln oder auf Bereitstellungen zu warten.

Das Auswertungsfeature geht über manuelle Tests hinaus. KI analysiert Ihre Agentkonfiguration und das Chatverhalten, um Probleme zu erkennen, die Sie möglicherweise verpassen: unklare Anweisungen, fehlende Tools, Sicherheitslücken und Absichtsfehler.

| Vorher | Nach |

|---|---|

| Bereitstellen von Änderungen und Testen im Live-Chat | Sofortiges Testen in einer isolierten Umgebung |

| Erraten, ob Anweisungen klar sind | KI-gestützte Klarheitswerte erhalten |

| Erkennen fehlender Tools bei Incidents | Proaktive Identifikation von Tool-Lücken |

| Wechseln zwischen mehreren Registerkarten zum Bearbeiten und Testen | Verwenden Sie eine geteilte Bildschirmansicht mit Editor und Chat nebeneinander. |

Agentenqualität bewerten

Auf der Registerkarte "Bewertung " werden KI-gestützte Qualitätsbewertungen für Ihre Agentkonfiguration bereitgestellt. Wählen Sie "Auswerten" aus, um Ihr aktuelles Setup und das aktuelle Chatverhalten zu analysieren.

Die Auswertung gibt die folgenden Bewertungen zurück:

| Ergebnis | Was sie misst |

|---|---|

| Insgesamt | Kombinierte Qualitätsbewertung (0–100) |

| Absichtsabgleich | Wie gut das Verhalten Ihres Agenten mit seinem Ziel übereinstimmt (1–5) |

| Vollständigkeit | Gibt an, ob die Eingabeaufforderung Rollen-, Ziel- und Betriebsleitlinien umfasst. |

| Werkzeugpassung | Gibt an, ob die richtigen Tools konfiguriert sind. |

| Klarheit auffordern | Wie klar und umsetzbar die Anweisungen sind |

| Umsetzbarkeit | Gibt an, ob Antworten konkrete, ausführbare Nächste Schritte enthalten |

| Sicherheit | Fehlerbehandlung, Bestätigungsaufforderungen und Garantien |

Schnellkorrekturen

Wenn die Auswertung Verbesserungen identifiziert, wählen Sie "Überprüfen und Anwenden" aus, um das Dialogfeld "Schnellkorrekturen" zu öffnen. Wählen Sie die gewünschten Korrekturen aus, zeigen Sie die YAML-Diff-Vorschau an, und verwenden Sie dann die Schaltfläche " Ausgewählte Korrekturen annehmen ". Sie können die Bearbeitung fortsetzen oder sofort speichern.

Tipp

Führen Sie die Bewertungen nach einigen Testunterhaltungen aus. Die Auswertung berücksichtigt das Chatverhalten zusammen mit Ihrer Konfiguration, um eine genauere Bewertung bereitzustellen.

Hinweis

Wenn Sie die Agent-Konfiguration nach dem Ausführen einer Auswertung ändern, werden die Ergebnisse als veraltet markiert, und Sie werden aufgefordert, die Bewertung erneut zu bewerten. Ebenso kennzeichnet eine neue Chataktivität nach einer Auswertung die Ergebnisse als veraltet. Bewerten Sie erneut, um Erkenntnisse zu erhalten, die Ihre neuesten Tests widerspiegeln.

Testen Sie Tools isoliert

Sie können Systemtools und Kusto-Tools unabhängig vom Agent-Playground testen.

Systemtools

Wählen Sie ein Systemtool aus der Dropdownliste "Benutzerdefinierter Agent/Tool " aus, um integrierte Funktionen unabhängig zu testen. Geben Sie Parameterwerte ein, und wählen Sie "Execute Tool" aus, um die unformatierte JSON-Ausgabe anzuzeigen.

Kusto-Tools

Wählen Sie ein Kusto-Tool aus, um Ihre Abfrage mit verbundenen Clustern zu testen. Im Testbereich werden Abfrageergebnisse mit Zeilenanzahl, Spalten und Ausführungszeit angezeigt. Passen Sie die KQL an, und führen Sie sie erneut aus.

Schrittweise Anleitungen finden Sie unter Testen eines Tools im Playground.

KI-unterstützte Konfiguration

Der Playground enthält zwei KI-Unterstützungsfeatures zum Verfeinern von benutzerdefinierten Agent-Anweisungen:

- Mit KI optimieren: Schreibt Ihre Anweisungen und die Übergabebeschreibung direkt an Ort und Stelle neu. Dieses Feature ersetzt Ihren aktuellen Text direkt durch eine KI-verbesserte Version. Überprüfen Sie daher die Änderungen vor dem Speichern.

- Anzeigen von KI-Vorschlägen: Öffnet ein schreibgeschütztes Panel neben dem Formular, das KI-Empfehlungen anzeigt: Vorschläge zur Verbesserung, Warnungen vor potenziellen Problemen und verbesserte Versionen Ihrer Anweisungen und Ihrer Übergabebeschreibung. Dieses Feature ändert Ihre Konfiguration nicht. Verwenden Sie sie beim Bearbeiten als Referenz.

Erste Schritte

| Ressource | Was Sie lernen |

|---|---|

| Testen eines Tools in der Testumgebung | Schritt-für-Schritt-Anleitung der Playground-Schnittstelle |

Verwandte Inhalte

| Ressource | Beschreibung |

|---|---|

| Benutzerdefinierte Agents | Wie benutzerdefinierte Agents funktionieren und wann man sie verwendet |

| Kusto-Tools | Erstellen von wiederverwendbaren KQL-Abfragen für Ihren Agent |

| Python-Codeausführung | Erstellen benutzerdefinierter Python-Tools |