Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Gilt für: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Tipp

Data Factory in Microsoft Fabric ist die nächste Generation von Azure Data Factory mit einer einfacheren Architektur, integrierter KI und neuen Features. Wenn Sie mit der Datenintegration noch nicht vertraut sind, beginnen Sie mit Fabric Data Factory. Vorhandene ADF-Workloads können auf Fabric aktualisiert werden, um auf neue Funktionen in der Datenwissenschaft, Echtzeitanalysen und Berichterstellung zuzugreifen.

Die Switch-Aktivität bietet die gleiche Funktionalität wie eine Switch-Anweisung in Programmiersprachen. Sie wertet einen Satz von Aktivitäten entsprechend einem Fall aus, der mit der Bedingungsauswertung übereinstimmt.

Erstellen einer Switch-Aktivität mit Benutzeroberfläche

Führen Sie die folgenden Schritte aus, um eine Switch-Aktivität in einer Pipeline zu verwenden:

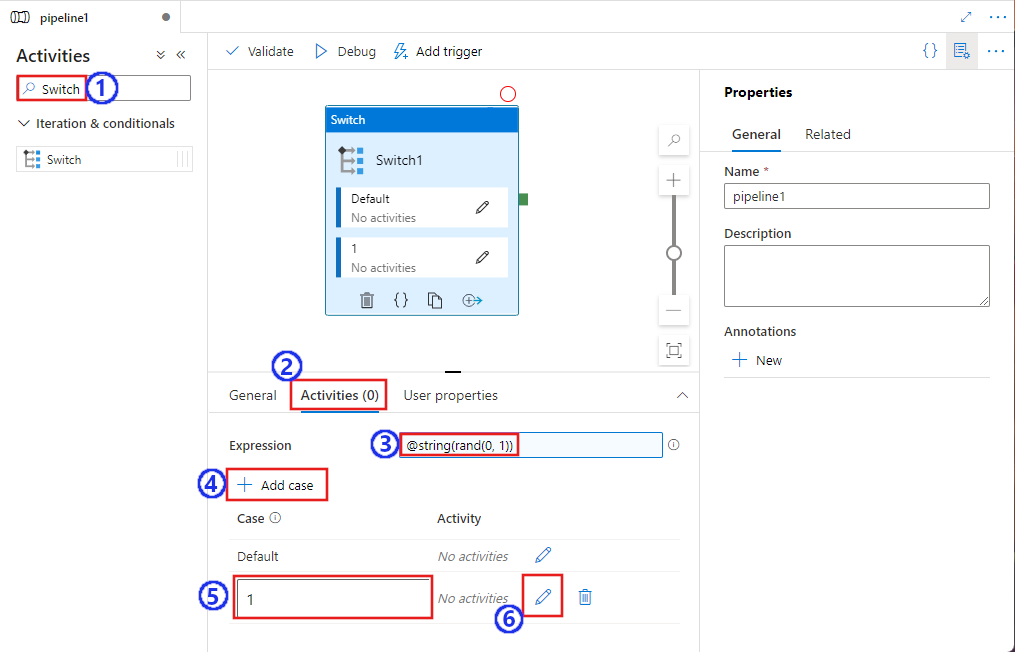

- Suchen Sie im Bereich mit den Pipelineaktivitäten nach Switch, und fügen Sie dem Pipelinebereich eine Switch-Aktivität hinzu.

- Wählen Sie die Aktivität Umschalten auf dem Canvas aus, wenn sie nicht bereits ausgewählt ist, und die Registerkarte Aktivitäten, um ihre Details zu bearbeiten.

- Geben Sie einen Ausdruck zur Auswertung durch die Switch-Aktivität ein. Dies kann eine beliebige Kombination aus dynamischen Ausdrücken, Funktionen, Systemvariablen oder Ausgaben von anderen Aktivitäten sein.

- Wählen Sie Fall hinzufügen, um weitere Fälle hinzuzufügen. Wenn kein Fall passt, wird die Aktivität Standardfall verwendet.

- Geben Sie den Wert für den neuen Fall ein.

- Wählen Sie die Schaltfläche Bearbeiten, um Aktivitäten hinzuzufügen, die ausgeführt werden, wenn der Ausdruck den übereinstimmenden Fall evaluiert.

JSON-Syntax

{

"name": "<Name of the activity>",

"type": "Switch",

"typeProperties": {

"expression": {

"value": "<expression that evaluates to some string value>",

"type": "Expression"

},

"cases": [

{

"value": "<string value that matches expression evaluation>",

"activities": [

{

"<Activity 1 definition>"

},

{

"<Activity 2 definition>"

},

{

"<Activity N definition>"

}

]

}

],

"defaultActivities": [

{

"<Activity 1 definition>"

},

{

"<Activity 2 definition>"

},

{

"<Activity N definition>"

}

]

}

}

Typeigenschaften

| Eigenschaft | Beschreibung | Zulässige Werte | Erforderlich |

|---|---|---|---|

| name | Name der Switch-Aktivität. | String | Ja |

| type | Muss auf Switch* festgelegt werden | String | Ja |

| expression | Ausdruck, der als Zeichenfolgenwert ausgewertet werden muss | Ausdruck mit Ergebnistyp „String“ | Ja |

| cases | Eine Reihe von Fällen, die einen Wert und einen Satz von Aktivitäten enthalten, die ausgeführt werden sollen, wenn der Wert der Ausdrucksauswertung entspricht. Es muss mindestens ein Fall angegeben werden. Es dürfen maximal 25 Fälle angegeben werden. | Array von Case-Objekten | Ja |

| defaultActivities | Aktivitäten, die ausgeführt werden, wenn die Ausdrucksauswertung nicht erfüllt wird. | Array von Aktivitäten | Ja |

Beispiel

Die Pipeline in diesem Beispiel kopiert Daten aus einem Eingabeordner in einen Ausgabeordner. Der Pipeline-Parameter routeSelection bestimmt den Ausgabeordner.

Hinweis

Dieser Abschnitt enthält die JSON-Definitionen und PowerShell-Beispielbefehle zum Ausführen der Pipeline. Eine exemplarische Vorgehensweise mit schrittweisen Anleitungen zum Erstellen einer Data Factory-Pipeline mithilfe von Azure PowerShell- und JSON-Definitionen finden Sie unter tutorial: Erstellen einer Datenfactory mithilfe von Azure PowerShell.

Pipeline mit Switch-Aktivität („Adfv2QuickStartPipeline.json“)

{

"name": "Adfv2QuickStartPipeline",

"properties": {

"activities": [

{

"name": "MySwitch",

"type": "Switch",

"typeProperties": {

"expression": {

"value": "@pipeline().parameters.routeSelection",

"type": "Expression"

},

"cases": [

{

"value": "1",

"activities": [

{

"name": "CopyFromBlobToBlob1",

"type": "Copy",

"inputs": [

{

"referenceName": "BlobDataset",

"parameters": {

"path": "@pipeline().parameters.inputPath"

},

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "BlobDataset",

"parameters": {

"path": "@pipeline().parameters.outputPath1",

},

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "BlobSource"

},

"sink": {

"type": "BlobSink"

}

}

}

]

},

{

"value": "2",

"activities": [

{

"name": "CopyFromBlobToBlob2",

"type": "Copy",

"inputs": [

{

"referenceName": "BlobDataset",

"parameters": {

"path": "@pipeline().parameters.inputPath",

},

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "BlobDataset",

"parameters": {

"path": "@pipeline().parameters.outputPath2",

},

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "BlobSource"

},

"sink": {

"type": "BlobSink"

}

}

}

]

},

{

"value": "3",

"activities": [

{

"name": "CopyFromBlobToBlob3",

"type": "Copy",

"inputs": [

{

"referenceName": "BlobDataset",

"parameters": {

"path": "@pipeline().parameters.inputPath",

},

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "BlobDataset",

"parameters": {

"path": "@pipeline().parameters.outputPath3",

},

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "BlobSource"

},

"sink": {

"type": "BlobSink"

}

}

}

]

},

],

"defaultActivities": []

}

}

],

"parameters": {

"inputPath": {

"type": "String"

},

"outputPath1": {

"type": "String"

},

"outputPath2": {

"type": "String"

},

"outputPath3": {

"type": "String"

},

"routeSelection": {

"type": "String"

}

}

}

}

Azure Storage verbundener Dienst (AzureStorageLinkedService.json)

{

"name": "AzureStorageLinkedService",

"properties": {

"type": "AzureStorage",

"typeProperties": {

"connectionString": "DefaultEndpointsProtocol=https;AccountName=<Azure Storage account name>;AccountKey=<Azure Storage account key>"

}

}

}

Parametrisiertes Azure Blob-Dataset (BlobDataset.json)

Die Pipeline legt für folderPath entweder den Wert des outputPath1-Parameters oder den Wert des outputPath2-Parameters der Pipeline fest.

{

"name": "BlobDataset",

"properties": {

"type": "AzureBlob",

"typeProperties": {

"folderPath": {

"value": "@{dataset().path}",

"type": "Expression"

}

},

"linkedServiceName": {

"referenceName": "AzureStorageLinkedService",

"type": "LinkedServiceReference"

},

"parameters": {

"path": {

"type": "String"

}

}

}

}

JSON-Datei mit Pipelineparametern (PipelineParameters.json)

{

"inputPath": "adftutorial/input",

"outputPath1": "adftutorial/outputCase1",

"outputPath2": "adftutorial/outputCase2",

"outputPath2": "adftutorial/outputCase3",

"routeSelection": "1"

}

PowerShell-Befehle

Hinweis

Es wird empfohlen, das Azure Az PowerShell-Modul für die Interaktion mit Azure zu verwenden. Informationen zu den ersten Schritten finden Sie unter Install Azure PowerShell. Informationen zum Migrieren zum Az PowerShell-Modul finden Sie unter Migrate Azure PowerShell von AzureRM zu Az.

Bei diesen Befehlen wird davon ausgegangen, dass Sie die JSON-Dateien in diesem Ordner gespeichert haben: C:\ADF.

Connect-AzAccount

Select-AzSubscription "<Your subscription name>"

$resourceGroupName = "<Resource Group Name>"

$dataFactoryName = "<Data Factory Name. Must be globally unique>";

Remove-AzDataFactoryV2 $dataFactoryName -ResourceGroupName $resourceGroupName -force

Set-AzDataFactoryV2 -ResourceGroupName $resourceGroupName -Location "East US" -Name $dataFactoryName

Set-AzDataFactoryV2LinkedService -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "AzureStorageLinkedService" -DefinitionFile "C:\ADF\AzureStorageLinkedService.json"

Set-AzDataFactoryV2Dataset -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "BlobDataset" -DefinitionFile "C:\ADF\BlobDataset.json"

Set-AzDataFactoryV2Pipeline -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "Adfv2QuickStartPipeline" -DefinitionFile "C:\ADF\Adfv2QuickStartPipeline.json"

$runId = Invoke-AzDataFactoryV2Pipeline -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -PipelineName "Adfv2QuickStartPipeline" -ParameterFile C:\ADF\PipelineParameters.json

while ($True) {

$run = Get-AzDataFactoryV2PipelineRun -ResourceGroupName $resourceGroupName -DataFactoryName $DataFactoryName -PipelineRunId $runId

if ($run) {

if ($run.Status -ne 'InProgress') {

Write-Host "Pipeline run finished. The status is: " $run.Status -foregroundcolor "Yellow"

$run

break

}

Write-Host "Pipeline is running...status: InProgress" -foregroundcolor "Yellow"

}

Start-Sleep -Seconds 30

}

Write-Host "Activity run details:" -foregroundcolor "Yellow"

$result = Get-AzDataFactoryV2ActivityRun -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -PipelineRunId $runId -RunStartedAfter (Get-Date).AddMinutes(-30) -RunStartedBefore (Get-Date).AddMinutes(30)

$result

Write-Host "Activity 'Output' section:" -foregroundcolor "Yellow"

$result.Output -join "`r`n"

Write-Host "\nActivity 'Error' section:" -foregroundcolor "Yellow"

$result.Error -join "`r`n"

Verwandte Inhalte

Weitere Informationen finden Sie unter anderen Ablaufsteuerungsaktivitäten, die von Data Factory unterstützt werden: