Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Gilt nur für:klassisches Foundry Portal. Dieser Artikel ist für das neue Foundry-Portal nicht verfügbar.

Erfahren Sie mehr über das neue Portal.

Hinweis

Links in diesem Artikel können Inhalte in der neuen Microsoft Foundry-Dokumentation anstelle der jetzt angezeigten Foundry-Dokumentation (klassisch) öffnen.

Wichtig

In diesem Artikel markierte Elemente (Vorschau) befinden sich derzeit in der öffentlichen Vorschau. Diese Vorschau wird ohne Vereinbarung auf Serviceebene bereitgestellt und wird für Produktionsworkloads nicht empfohlen. Bestimmte Features werden möglicherweise nicht unterstützt oder weisen eingeschränkte Funktionen auf. Weitere Informationen finden Sie unter Supplementale Nutzungsbedingungen für Microsoft Azure Previews.

In diesem Artikel erfahren Sie, wie Sie ein Microsoft Foundry Model als serverlose API-Bereitstellung bereitstellen. Bestimmte Modelle im Modellkatalog können als serverlose API-Bereitstellung bereitgestellt werden. Diese Art von Bereitstellung bietet eine Möglichkeit, Modelle als API zu nutzen, ohne sie in Ihrem Abonnement zu hosten, während die Unternehmenssicherheit und Compliance beibehalten werden, die Organisationen benötigen. Für diese Bereitstellungsoption ist kein Kontingent aus Ihrem Abonnement erforderlich.

Obwohl die Serverlose API-Bereitstellung eine Option für die Bereitstellung von Foundry-Modellen ist, empfehlen wir, Foundry Models in Foundry-Ressourcen bereitzustellen.

Hinweis

Es wird empfohlen, Microsoft Foundry Models für Foundry-Ressourcen bereitzustellen, damit Sie Ihre Bereitstellungen in der Ressource über einen einzelnen Endpunkt mit der gleichen Authentifizierung und demselben Schema nutzen können, um Rückschlüsse zu generieren. Der Endpunkt folgt der Azure AI Model Inference-API die alle Foundry Models unterstützen. Informationen zum Bereitstellen eines Foundry-Modells in den Foundry-Ressourcen finden Sie unter Hinzufügen und Konfigurieren von Modellen zu Foundry Models.

Voraussetzungen

Ein Azure-Abonnement mit einer gültigen Zahlungsmethode. Kostenlose oder Testversionen Azure Abonnements funktionieren nicht. Wenn Sie nicht über ein Azure-Abonnement verfügen, erstellen Sie zunächst ein paid Azure Konto.

Wenn Sie über keins verfügen, erstellen Sie ein hubbasiertes Projekt.

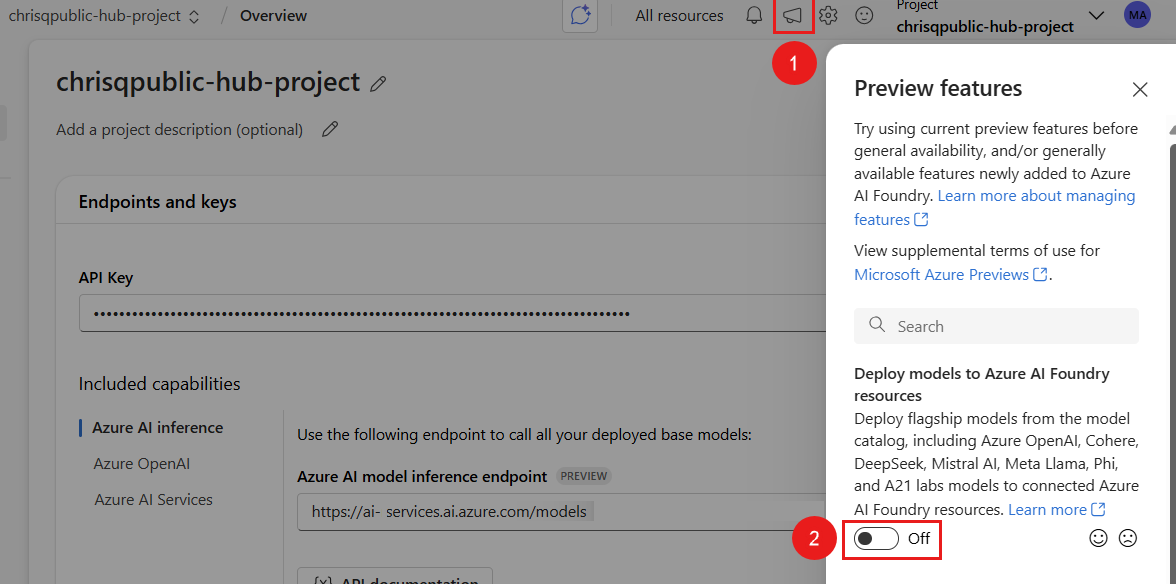

Stellen Sie sicher, dass das Feature "Modelle für Foundry-Ressourcen bereitstellen " (Vorschau) im Foundry-Portal deaktiviert ist. Wenn dieses Feature aktiviert ist, sind serverlose API-Bereitstellungen nicht über das Portal verfügbar.

Foundry Modelle von Partnern und Community erfordern Zugriff auf den Azure Marketplace, während Foundry Modelle, die direkt von Azure verkauft werden, diese Anforderung nicht haben. Stellen Sie sicher, dass Sie über die erforderlichen Berechtigungen zum Abonnieren von Modellangeboten in Azure Marketplace verfügen.

Azure rollenbasierte Zugriffssteuerungen (Azure RBAC) werden verwendet, um Zugriff auf Vorgänge im Foundry-Portal zu gewähren. Um die Schritte in diesem Artikel auszuführen, muss Ihrem Benutzerkonto die Rolle Azure KI-Entwickler in der Ressourcengruppe zugewiesen werden. Weitere Informationen zu Berechtigungen finden Sie unter Rollenbasierte Zugriffssteuerung im Foundry-Portal.

- Sie können jeden kompatiblen Webbrowser verwenden, um in foundry zu navigieren.

Suchen Ihres Modells im Modellkatalog

- Melden Sie sich bei Microsoft Foundry an. Stellen Sie sicher, dass der Umschalter "Neue Gießerei " deaktiviert ist. Diese Schritte beziehen sich auf Foundry (klassisch).

- Wenn Sie noch nicht in Ihrem Projekt arbeiten, wählen Sie es aus.

- Wählen Sie im linken Bereich den Modellkatalog aus.

Wählen Sie die Modellkarte des Modells aus, das Sie bereitstellen möchten. In diesem Artikel wählen Sie ein DeepSeek-R1-Modell aus.

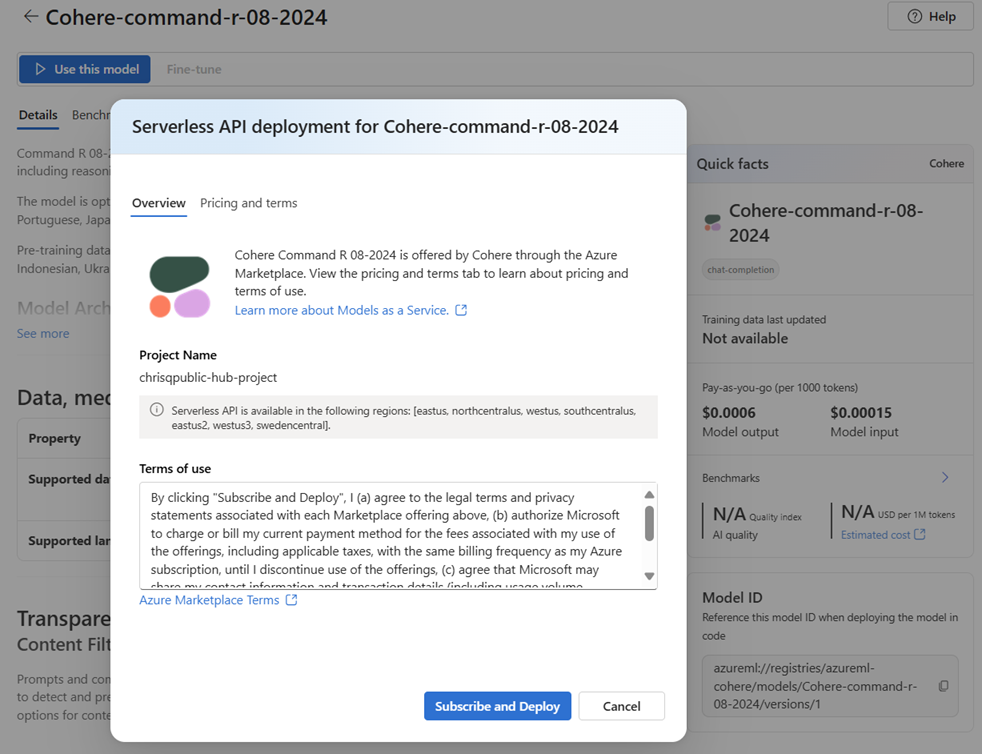

Wählen Sie "Dieses Modell verwenden " aus, um das Bereitstellungsfenster der Serverless-API zu öffnen, in dem Sie die Registerkarte "Preise und Ausdrücke " anzeigen können.

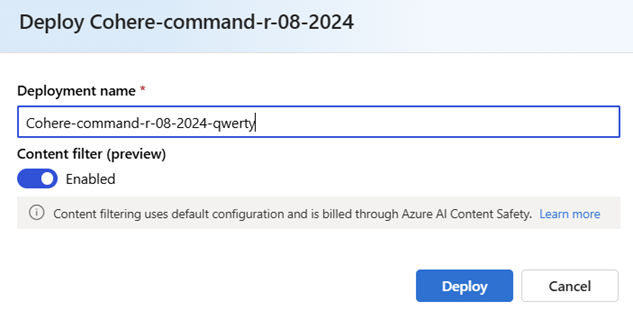

Benennen Sie im Bereitstellungs-Assistenten die Bereitstellung. Die Option "Inhaltsfilter " (Vorschau) ist standardmäßig aktiviert. Lassen Sie die Standardeinstellung für den Dienst, um schädliche Inhalte wie Hass, Selbstschäden, sexuelle und gewalttätige Inhalte zu erkennen. Weitere Informationen zur Inhaltsfilterung finden Sie unter Inhaltsfilterung im Foundry-Portal.

Screenshot mit dem Bereitstellungsassistenten für ein Modell, das direkt von Azure verkauft wurde.

Bereitstellen des Modells in einer serverlosen API

In diesem Abschnitt erstellen Sie einen Endpunkt für Ihr Modell.

Wählen Sie im Bereitstellungs-Assistenten "Bereitstellen" aus. Warten Sie, bis die Bereitstellung bereit ist und Sie zur Seite "Bereitstellungen" umgeleitet werden.

Um die Endpunkte anzuzeigen, die für Ihr Projekt bereitgestellt wurden, wählen Sie im Abschnitt "Meine Objekte" im linken Bereich die Option "Modelle + Endpunkte" aus.

Der erstellte Endpunkt verwendet die Schlüsselauthentifizierung für die Autorisierung. Führen Sie die folgenden Schritte aus, um die Schlüssel abzurufen, die einem bestimmten Endpunkt zugeordnet sind:

Wählen Sie die Bereitstellung aus, und notieren Sie sich den Ziel-URI und den Schlüssel des Endpunkts.

Verwenden Sie diese Anmeldeinformationen, um die Bereitstellung aufzurufen und Vorhersagen zu generieren.

Wenn Sie diese Bereitstellung von einem anderen Projekt oder Hub nutzen müssen oder den Aufforderungsfluss zum Erstellen intelligenter Anwendungen verwenden möchten, müssen Sie eine Verbindung mit der serverlosen API-Bereitstellung erstellen. Informationen zum Konfigurieren einer vorhandenen serverlosen API-Bereitstellung in einem neuen Projekt oder Hub finden Sie unter Nutzen der bereitgestellten serverlosen API-Bereitstellung aus einem anderen Projekt oder aus dem Prompt Flow.

Tipp

Wenn Sie "Prompt flow" im selben Projekt oder Hub verwenden, in dem die Bereitstellung erfolgt ist, müssen Sie die Verbindung dennoch erstellen.

Verwenden der serverlosen API-Bereitstellung

Modelle, die in Azure Machine Learning und Foundry in serverlosen API-Bereitstellungen bereitgestellt werden, unterstützen die Azure AI Model Inference API, die einen allgemeinen Satz von Funktionen für foundationale Modelle verfügbar macht und die von Entwicklern verwendet werden können, um Vorhersagen aus einer vielzahl von Modellen auf einheitliche und konsistente Weise zu nutzen.

Erfahren Sie mehr über die Funktionen dieser API und darüber, wie Sie sie beim Erstellen von Anwendungen verwenden können.

Löschen von Endpunkten und Abonnements

Tipp

Da Sie den linken Bereich customize the left pane im Microsoft Foundry-Portal erstellen können, werden möglicherweise unterschiedliche Elemente angezeigt als in diesen Schritten. Wenn Sie nicht sehen, wonach Sie suchen, wählen Sie ... Mehr am unteren Rand des linken Bereichs.

Sie können Modellabonnements und Endpunkte löschen. Durch das Löschen eines Modellabonnements wird ein zugehöriger Endpunkt als Unhealthy markiert und unbrauchbar.

So löschen Sie eine serverlose API-Bereitstellung:

- Gehen Sie zur Gießerei.

- Wechseln Sie zu Ihrem Projekt.

- Wählen Sie im Abschnitt "Meine Objekte" die Option "Modelle + Endpunkte" aus.

- Öffnen Sie die Bereitstellung, die Sie löschen möchten.

- Wählen Sie "Löschen" aus.

So löschen Sie das zugeordnete Modellabonnement:

- Wechseln Sie zum portal Azure

- Navigieren Sie zu der Ressourcengruppe, zu der das Projekt gehört.

- Wählen Sie im TypfilterSaaS aus.

- Wählen Sie das Abonnement aus, das Sie löschen möchten.

- Wählen Sie "Löschen" aus.

Um mit Foundry zu arbeiten, installieren Sie die Azure CLI und die ml-Erweiterung für Azure Machine Learning.

az extension add -n mlWenn Sie die Erweiterung bereits installiert haben, stellen Sie sicher, dass die neueste Version installiert ist.

az extension update -n mlNachdem die Erweiterung installiert wurde, konfigurieren Sie sie:

az account set --subscription <subscription> az configure --defaults workspace=<project-name> group=<resource-group> location=<location>

Suchen Ihres Modells im Modellkatalog

- Melden Sie sich bei Microsoft Foundry an. Stellen Sie sicher, dass der Umschalter "Neue Gießerei " deaktiviert ist. Diese Schritte beziehen sich auf Foundry (klassisch).

- Wenn Sie noch nicht in Ihrem Projekt arbeiten, wählen Sie es aus.

- Wählen Sie im linken Bereich den Modellkatalog aus.

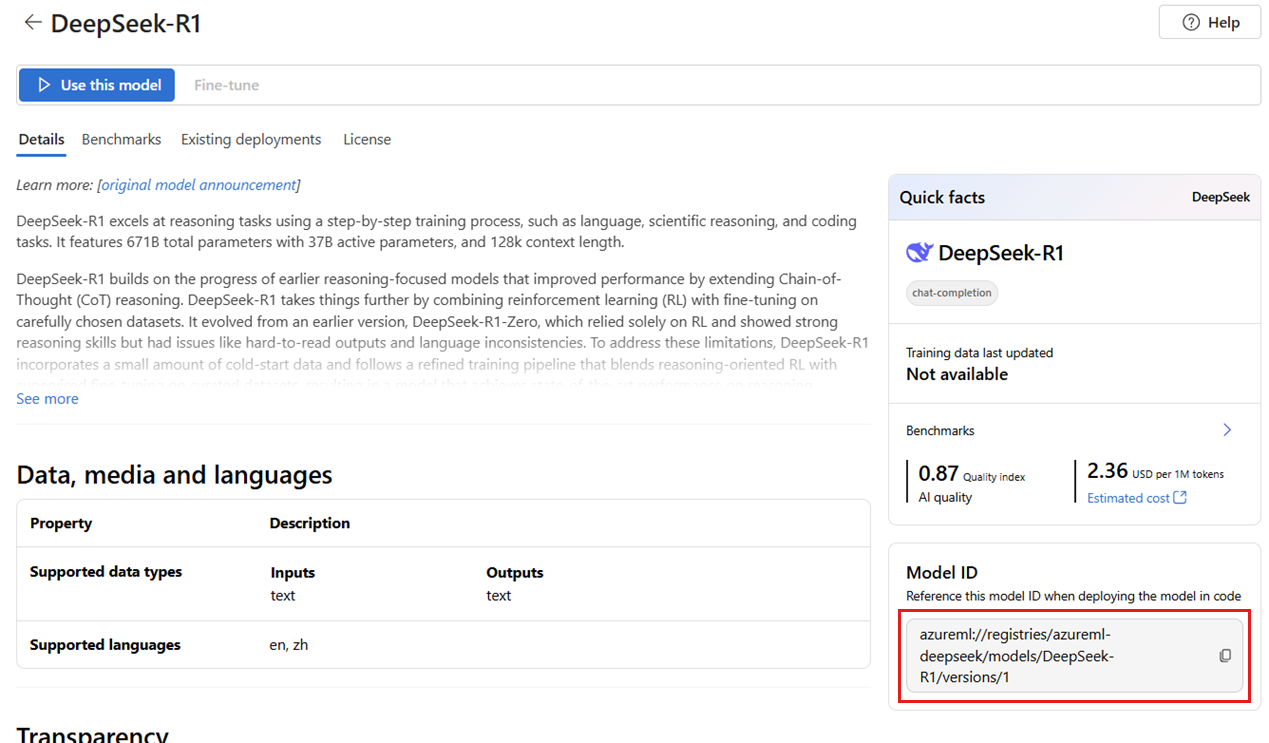

Wählen Sie die Modellkarte des Modells aus, das Sie bereitstellen möchten. In diesem Artikel wählen Sie ein DeepSeek-R1-Modell aus.

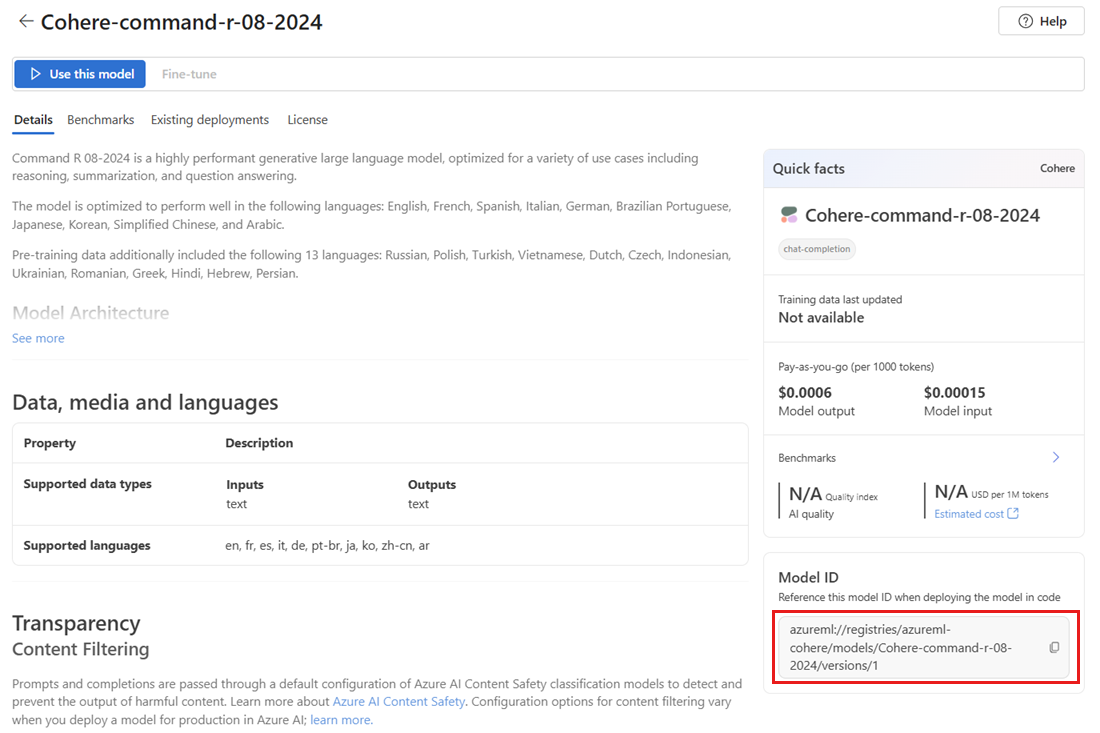

Kopieren Sie die Modell-ID , ohne die Modellversion einzuspeichern, da serverlose API-Bereitstellungen immer die neueste verfügbare Version des Modells bereitstellen. Kopieren Sie z. B.

azureml://registries/azureml-deepseek/models/DeepSeek-R1/versions/1für die Modell-IDazureml://registries/azureml-deepseek/models/DeepSeek-R1.

Die Schritte in diesem Abschnitt des Artikels verwenden das DeepSeek-R1-Modell zur Veranschaulichung. Die Schritte sind identisch, unabhängig davon, ob Sie Foundry Models verwenden, die direkt von Azure oder Foundry Models von Partnern und Community verkauft werden. Wenn Sie z. B. das Cohere-command-r-08-2024-Modell stattdessen bereitstellen möchten, können Sie die Modellanmeldeinformationen in den Codeausschnitten durch die Anmeldeinformationen für Cohere ersetzen.

Bereitstellen des Modells in einer serverlosen API

In diesem Abschnitt erstellen Sie einen Endpunkt für Ihr Modell. Nennen Sie den Endpunkt DeepSeek-R1-qwerty.

Erstellen Sie den serverlosen Endpunkt.

endpoint.yml

name: DeepSeek-R1-qwerty model_id: azureml://registries/azureml-deepseek/models/DeepSeek-R1Verwenden Sie die endpoint.yml-Datei , um den Endpunkt zu erstellen:

az ml serverless-endpoint create -f endpoint.ymlAn jedem Punkt können Sie die Endpunkte sehen, die für Ihr Projekt bereitgestellt wurden:

az ml serverless-endpoint listDer erstellte Endpunkt verwendet die Schlüsselauthentifizierung für die Autorisierung. Führen Sie die folgenden Schritte aus, um die Schlüssel abzurufen, die einem bestimmten Endpunkt zugeordnet sind.

az ml serverless-endpoint get-credentials -n DeepSeek-R1-qwertyWenn Sie diese Bereitstellung von einem anderen Projekt oder Hub nutzen müssen oder den Aufforderungsfluss zum Erstellen intelligenter Anwendungen verwenden möchten, müssen Sie eine Verbindung mit der serverlosen API-Bereitstellung erstellen. Informationen zum Konfigurieren einer vorhandenen serverlosen API-Bereitstellung in einem neuen Projekt oder Hub finden Sie unter Nutzen der bereitgestellten serverlosen API-Bereitstellung aus einem anderen Projekt oder aus dem Prompt Flow.

Tipp

Wenn Sie "Prompt flow" im selben Projekt oder Hub verwenden, in dem die Bereitstellung erfolgt ist, müssen Sie die Verbindung dennoch erstellen.

Verwenden der serverlosen API-Bereitstellung

Modelle, die in Azure Machine Learning und Foundry in serverlosen API-Bereitstellungen bereitgestellt werden, unterstützen die Azure AI Model Inference API, die einen allgemeinen Satz von Funktionen für foundationale Modelle verfügbar macht und die von Entwicklern verwendet werden können, um Vorhersagen aus einer vielzahl von Modellen auf einheitliche und konsistente Weise zu nutzen.

Erfahren Sie mehr über die Funktionen dieser API und darüber, wie Sie sie beim Erstellen von Anwendungen verwenden können.

Löschen von Endpunkten und Abonnements

Sie können Modellabonnements und Endpunkte löschen. Durch das Löschen eines Modellabonnements wird ein zugehöriger Endpunkt als Unhealthy markiert und unbrauchbar.

So löschen Sie eine serverlose API-Bereitstellung:

az ml serverless-endpoint delete \

--name "DeepSeek-R1-qwerty"

So löschen Sie das zugeordnete Modellabonnement:

az ml marketplace-subscription delete \

--name "DeepSeek-R1"

Um mit Foundry zu arbeiten, installieren Sie das Azure Machine Learning SDK für Python.

pip install -U azure-ai-mlImportieren Sie nach der Installation die erforderlichen Namespaces, und erstellen Sie einen Client, der mit Ihrem Projekt verbunden ist:

from azure.ai.ml import MLClient from azure.identity import InteractiveBrowserCredential from azure.ai.ml.entities import MarketplaceSubscription, ServerlessEndpoint client = MLClient( credential=InteractiveBrowserCredential(tenant_id="<tenant-id>"), subscription_id="<subscription-id>", resource_group_name="<resource-group>", workspace_name="<project-name>", )

Suchen Ihres Modells im Modellkatalog

- Melden Sie sich bei Microsoft Foundry an. Stellen Sie sicher, dass der Umschalter "Neue Gießerei " deaktiviert ist. Diese Schritte beziehen sich auf Foundry (klassisch).

- Wenn Sie noch nicht in Ihrem Projekt arbeiten, wählen Sie es aus.

- Wählen Sie im linken Bereich den Modellkatalog aus.

Wählen Sie die Modellkarte des Modells aus, das Sie bereitstellen möchten. In diesem Artikel wählen Sie ein DeepSeek-R1-Modell aus.

Kopieren Sie die Modell-ID , ohne die Modellversion einzuspeichern, da serverlose API-Bereitstellungen immer die neueste verfügbare Version des Modells bereitstellen. Kopieren Sie z. B.

azureml://registries/azureml-deepseek/models/DeepSeek-R1/versions/1für die Modell-IDazureml://registries/azureml-deepseek/models/DeepSeek-R1.

Die Schritte in diesem Abschnitt des Artikels verwenden das DeepSeek-R1-Modell zur Veranschaulichung. Die Schritte sind identisch, unabhängig davon, ob Sie Foundry Models verwenden, die direkt von Azure oder Foundry Models von Partnern und Community verkauft werden. Wenn Sie z. B. das Cohere-command-r-08-2024-Modell stattdessen bereitstellen möchten, können Sie die Modellanmeldeinformationen in den Codeausschnitten durch die Anmeldeinformationen für Cohere ersetzen.

Bereitstellen des Modells in einer serverlosen API

In diesem Abschnitt erstellen Sie einen Endpunkt für Ihr Modell. Nennen Sie den Endpunkt DeepSeek-R1-qwerty.

Erstellen Sie den serverlosen Endpunkt.

endpoint_name="DeepSeek-R1-qwerty" serverless_endpoint = ServerlessEndpoint( name=endpoint_name, model_id=model_id ) created_endpoint = client.serverless_endpoints.begin_create_or_update( serverless_endpoint ).result()An jedem Punkt können Sie die Endpunkte sehen, die für Ihr Projekt bereitgestellt wurden:

endpoint_name="DeepSeek-R1-qwerty" serverless_endpoint = ServerlessEndpoint( name=endpoint_name, model_id=model_id ) created_endpoint = client.serverless_endpoints.begin_create_or_update( serverless_endpoint ).result()Der erstellte Endpunkt verwendet die Schlüsselauthentifizierung für die Autorisierung. Führen Sie die folgenden Schritte aus, um die Schlüssel abzurufen, die einem bestimmten Endpunkt zugeordnet sind.

endpoint_keys = client.serverless_endpoints.get_keys(endpoint_name) print(endpoint_keys.primary_key) print(endpoint_keys.secondary_key)Wenn Sie diese Bereitstellung von einem anderen Projekt oder Hub nutzen müssen oder den Aufforderungsfluss zum Erstellen intelligenter Anwendungen verwenden möchten, müssen Sie eine Verbindung mit der serverlosen API-Bereitstellung erstellen. Informationen zum Konfigurieren einer vorhandenen serverlosen API-Bereitstellung in einem neuen Projekt oder Hub finden Sie unter Nutzen der bereitgestellten serverlosen API-Bereitstellung aus einem anderen Projekt oder aus dem Prompt Flow.

Tipp

Wenn Sie "Prompt flow" im selben Projekt oder Hub verwenden, in dem die Bereitstellung erfolgt ist, müssen Sie die Verbindung dennoch erstellen.

Verwenden der serverlosen API-Bereitstellung

Modelle, die in Azure Machine Learning und Foundry in serverlosen API-Bereitstellungen bereitgestellt werden, unterstützen die Azure AI Model Inference API, die einen allgemeinen Satz von Funktionen für foundationale Modelle verfügbar macht und die von Entwicklern verwendet werden können, um Vorhersagen aus einer vielzahl von Modellen auf einheitliche und konsistente Weise zu nutzen.

Erfahren Sie mehr über die Funktionen dieser API und darüber, wie Sie sie beim Erstellen von Anwendungen verwenden können.

Löschen von Endpunkten und Abonnements

Sie können Modellabonnements und Endpunkte löschen. Durch das Löschen eines Modellabonnements wird ein zugehöriger Endpunkt als Unhealthy markiert und unbrauchbar.

client.serverless_endpoints.begin_delete(endpoint_name).wait()

So löschen Sie das zugeordnete Modellabonnement:

client.marketplace_subscriptions.begin_delete(subscription_name).wait()

Um mit Foundry zu arbeiten, installieren Sie die Azure CLI wie unter Azure CLI beschrieben.

Konfigurieren Sie die folgenden Umgebungsvariablen gemäß Ihren Einstellungen:

RESOURCE_GROUP="serverless-models-dev" LOCATION="eastus2"

Suchen Ihres Modells im Modellkatalog

- Melden Sie sich bei Microsoft Foundry an. Stellen Sie sicher, dass der Umschalter "Neue Gießerei " deaktiviert ist. Diese Schritte beziehen sich auf Foundry (klassisch).

- Wenn Sie noch nicht in Ihrem Projekt arbeiten, wählen Sie es aus.

- Wählen Sie im linken Bereich den Modellkatalog aus.

Wählen Sie die Modellkarte des Modells aus, das Sie bereitstellen möchten. In diesem Artikel wählen Sie ein DeepSeek-R1-Modell aus.

Kopieren Sie die Modell-ID , ohne die Modellversion einzuspeichern, da serverlose API-Bereitstellungen immer die neueste verfügbare Version des Modells bereitstellen. Kopieren Sie z. B.

azureml://registries/azureml-deepseek/models/DeepSeek-R1/versions/1für die Modell-IDazureml://registries/azureml-deepseek/models/DeepSeek-R1.

Die Schritte in diesem Abschnitt des Artikels verwenden das DeepSeek-R1-Modell zur Veranschaulichung. Die Schritte sind identisch, unabhängig davon, ob Sie Foundry Models verwenden, die direkt von Azure oder Foundry Models von Partnern und Community verkauft werden. Wenn Sie z. B. das Cohere-command-r-08-2024-Modell stattdessen bereitstellen möchten, können Sie die Modellanmeldeinformationen in den Codeausschnitten durch die Anmeldeinformationen für Cohere ersetzen.

Bereitstellen des Modells in einer serverlosen API

In diesem Abschnitt erstellen Sie einen Endpunkt für Ihr Modell. Benennen Sie den Endpunkt myserverless-text-1234ss.

Erstellen Sie den serverlosen Endpunkt. Verwenden Sie die folgende Vorlage, um einen Endpunkt zu erstellen:

serverless-endpoint.bicep

param projectName string = 'my-project' param endpointName string = 'myserverless-text-1234ss' param location string = resourceGroup().location param modelId string = 'azureml://registries/azureml-deepseek/models/DeepSeek-R1' var modelName = substring(modelId, (lastIndexOf(modelId, '/') + 1)) // Replace period character which is used in some model names (and is not valid in the subscription name) var sanitizedModelName = replace(modelName, '.', '') var subscriptionName = '${sanitizedModelName}-subscription' resource projectName_endpoint 'Microsoft.MachineLearningServices/workspaces/serverlessEndpoints@2024-04-01-preview' = { name: '${projectName}/${endpointName}' location: location sku: { name: 'Consumption' } properties: { modelSettings: { modelId: modelId } } dependsOn: [ projectName_subscription ] } output endpointUri string = projectName_endpoint.properties.inferenceEndpoint.uriErstellen Sie die Bereitstellung wie folgt:

az deployment group create --resource-group $RESOURCE_GROUP --template-file model-subscription.bicepAn jedem Punkt können Sie die Endpunkte sehen, die für Ihr Projekt bereitgestellt wurden:

Sie können die Ressourcenverwaltungstools verwenden, um die Ressourcen abzufragen. Der folgende Code verwendet Azure CLI:

az resource list \ --query "[?type=='Microsoft.MachineLearningServices/workspaces/serverlessEndpoints']"Der erstellte Endpunkt verwendet die Schlüsselauthentifizierung für die Autorisierung. Rufen Sie die dem angegebenen Endpunkt zugeordneten Schlüssel mithilfe von REST-APIs ab, um diese Informationen abzufragen.

Wenn Sie diese Bereitstellung von einem anderen Projekt oder Hub nutzen müssen oder den Aufforderungsfluss zum Erstellen intelligenter Anwendungen verwenden möchten, müssen Sie eine Verbindung mit der serverlosen API-Bereitstellung erstellen. Informationen zum Konfigurieren einer vorhandenen serverlosen API-Bereitstellung in einem neuen Projekt oder Hub finden Sie unter Nutzen der bereitgestellten serverlosen API-Bereitstellung aus einem anderen Projekt oder aus dem Prompt Flow.

Tipp

Wenn Sie "Prompt flow" im selben Projekt oder Hub verwenden, in dem die Bereitstellung erfolgt ist, müssen Sie die Verbindung dennoch erstellen.

Verwenden der serverlosen API-Bereitstellung

Modelle, die in Azure Machine Learning und Foundry in serverlosen API-Bereitstellungen bereitgestellt werden, unterstützen die Azure AI Model Inference API, die einen allgemeinen Satz von Funktionen für foundationale Modelle verfügbar macht und die von Entwicklern verwendet werden können, um Vorhersagen aus einer vielzahl von Modellen auf einheitliche und konsistente Weise zu nutzen.

Erfahren Sie mehr über die Funktionen dieser API und darüber, wie Sie sie beim Erstellen von Anwendungen verwenden können.

Löschen von Endpunkten und Abonnements

Sie können Modellabonnements und Endpunkte löschen. Durch das Löschen eines Modellabonnements wird ein zugehöriger Endpunkt als Unhealthy markiert und unbrauchbar.

Sie können die Ressourcenverwaltungstools verwenden, um die Ressourcen zu verwalten. Der folgende Code verwendet Azure CLI:

az resource delete --name <resource-name>

Überlegungen zu Kosten und Kontingenten für Foundry Models, die als serverlose API-Bereitstellung bereitgestellt werden

Das Kontingent wird pro Bereitstellung verwaltet. Jede Bereitstellung unterliegt einem Grenzwert von 200.000 Token pro Minute und 1.000 API-Anforderungen pro Minute. Darüber hinaus beschränken wir derzeit eine Bereitstellung pro Modell pro Projekt. Wenden Sie sich an Microsoft Azure Support, wenn die aktuellen Ratenbeschränkungen für Ihre Szenarien nicht ausreichen.

Preisinformationen für Models Sold Directly by Azure finden Sie im Fenster Pricing and terms der Registerkarte Serverless API deployment.

Models von Partnern und Community werden über Azure Marketplace angeboten und in Foundry integriert. Die Preisgestaltung des Azure Marketplace finden Sie während der Bereitstellung oder Feinabstimmung dieser Modelle. Jedes Mal, wenn ein Projekt ein bestimmtes Angebot von Azure Marketplace abonniert, wird eine neue Ressource erstellt, um die Kosten zu verfolgen, die mit ihrem Verbrauch verbunden sind. Die gleiche Ressource wird verwendet, um die Kosten, die mit Inferenzen und Feinabstimmungen verbunden sind, nachzuverfolgen; Es stehen jedoch mehrere Messinstrumente zur Verfügung, um jedes Szenario unabhängig nachzuverfolgen. Weitere Informationen zum Nachverfolgen von Kosten finden Sie unter Monitor-Kosten für Modelle, die über Azure Marketplace angeboten werden.

Zum Abonnieren von Modellangeboten erforderliche Berechtigungen

Azure rollenbasierte Zugriffssteuerungen (Azure RBAC) werden verwendet, um Zugriff auf Vorgänge im Foundry-Portal zu gewähren. Um die Schritte in diesem Artikel auszuführen, muss Ihr Benutzerkonto dem Owner, Contributor oder Azure AI Developer Rolle für das Azure-Abonnement zugewiesen werden. Alternativ kann Ihrem Konto eine benutzerdefinierte Rolle zugewiesen werden, die über die folgenden Berechtigungen verfügt:

Abonnieren Sie im Azure-Abonnement den Arbeitsbereich im Azure Marketplace-Angebot, einmal pro Arbeitsbereich und pro Angebot.

Microsoft.MarketplaceOrdering/agreements/offers/plans/readMicrosoft.MarketplaceOrdering/agreements/offers/plans/sign/actionMicrosoft.MarketplaceOrdering/offerTypes/publishers/offers/plans/agreements/readMicrosoft.Marketplace/offerTypes/publishers/offers/plans/agreements/readMicrosoft.SaaS/register/action

In der Ressourcengruppe: Erstellen und Verwenden der SaaS-Ressource.

Microsoft.SaaS/resources/readMicrosoft.SaaS/resources/write

Im Arbeitsbereich – zum Bereitstellen von Endpunkten (die Rolle Azure Machine Learning Data Scientist enthält diese Berechtigungen bereits):

Microsoft.MachineLearningServices/workspaces/marketplaceModelSubscriptions/*Microsoft.MachineLearningServices/workspaces/serverlessEndpoints/*

Weitere Informationen zu Berechtigungen finden Sie unter Rollenbasierte Zugriffssteuerung im Foundry-Portal.