Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

GILT FÜR:  Python SDK azure-ai-ml v2 (aktuell)

Python SDK azure-ai-ml v2 (aktuell)

In diesem Lernprogramm werden einige der am häufigsten verwendeten Features des Azure Machine Learning-Diensts vorgestellt. Sie erstellen, registrieren und bereitstellen ein Modell. Dieses Tutorial hilft Ihnen dabei, sich mit den Kernkonzepten von Azure Machine Learning und den häufigsten Anwendungsfällen vertraut zu machen.

In dieser Schnellstartanleitung trainieren, registrieren und bereitstellen Sie ein Machine Learning-Modell mit Azure Machine Learning – alles aus einem Python-Notizbuch. Am Ende haben Sie einen funktionierenden Endpunkt, den Sie für Vorhersagen aufrufen können.

Hier erfahren Sie, wie Sie:

- Ausführen eines Schulungsauftrags auf skalierbarem Cloud-Compute

- Registrieren Ihres trainierten Modells

- Bereitstellen des Modells als Onlineendpunkt

- Testen des Endpunkts mit Beispieldaten

Sie erstellen ein Trainingsskript für die Datenaufbereitung sowie das Training und das Registrieren eines Models. Nachdem Sie das Modell trainiert haben, stellen Sie es als Endpunkt bereit, und rufen Sie dann den Endpunkt für die Ableitung auf.

Auszuführende Schritte:

- Einrichten eines Handles für Ihren Azure Machine Learning-Arbeitsbereich

- Erstellen Ihres Trainingsskripts

- Erstellen einer skalierbaren Computeressource, eines Computeclusters

- Erstellen und Ausführen eines Befehlsjobs, der das Schulungsskript auf dem Compute-Cluster ausführt und mit der entsprechenden Auftragsumgebung konfiguriert ist.

- Anzeigen der Ausgabe Ihres Trainingsskripts

- Bereitstellen des neu trainierten Modells als Endpunkt

- Aufrufen des Azure Machine Learning-Endpunkts für Rückschlüsse

Voraussetzungen

-

Für Azure Machine Learning benötigen Sie einen Arbeitsbereich. Wenn Sie noch keinen haben, schließen Sie Erstellen von Ressourcen, die Sie für die ersten Schritte benötigen ab, um einen Arbeitsbereich zu erstellen, und mehr über dessen Verwendung zu erfahren.

Wichtig

Wenn Ihr Azure Machine Learning-Arbeitsbereich mit einem verwalteten virtuellen Netzwerk konfiguriert ist, müssen Sie möglicherweise Ausgangsregeln hinzufügen, um den Zugriff auf die öffentlichen Python-Paketrepositorys zu ermöglichen. Weitere Informationen finden Sie unter Szenario: Zugreifen auf öffentliche Machine Learning-Pakete.

-

Melden Sie sich bei Studio an, und wählen Sie Ihren Arbeitsbereich aus, falls dieser noch nicht geöffnet ist.

-

Öffnen oder erstellen Sie ein neues Notebook in Ihrem Arbeitsbereich:

- Wenn Sie Code kopieren und in Zellen einfügen möchten, erstellen Sie ein neues Notebook.

- Alternativ öffnen Sie im Abschnitt Beispiele von Studio die Datei tutorials/get-started-notebooks/quickstart.ipynb. Wählen Sie dann Klonen aus, um das Notebook zu Ihren Dateien hinzuzufügen. Informationen zum Suchen nach Beispielnotebooks finden Sie unter Lernen anhand von Beispiel-Notebooks.

Kernel festlegen und in Visual Studio Code (VS Code) öffnen

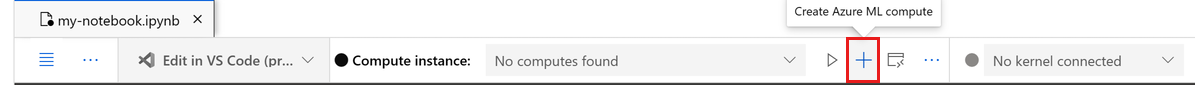

Erstellen Sie auf der oberen Leiste über Ihrem geöffneten Notebook eine Compute-Instanz, falls Sie noch keine besitzen.

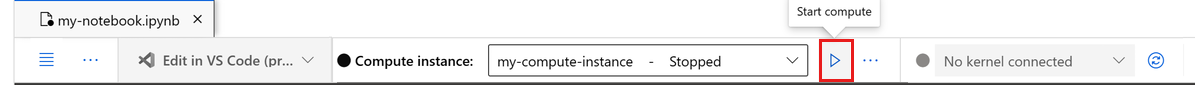

Wenn die Compute-Instanz beendet wurde, wählen Sie Compute starten aus, und warten Sie, bis sie ausgeführt wird.

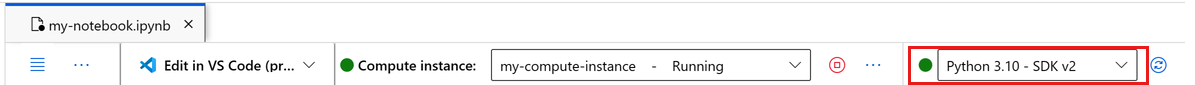

Warten Sie, bis die Compute-Instanz ausgeführt wird. Stellen Sie dann sicher, dass der Kernel rechts oben

Python 3.10 - SDK v2ist. Falls nicht, wählen Sie diesen Kernel in der Dropdownliste aus.Falls dieser Kernel nicht angezeigt wird, überprüfen Sie, ob Ihre Compute-Instanz ausgeführt wird. Falls ja, wählen Sie rechts oben im Notebook die Schaltfläche Aktualisieren aus.

Wenn Sie ein Banner mit dem Hinweis sehen, dass Sie authentifiziert werden müssen, wählen Sie Authentifizieren aus.

Sie können das Notebook hier ausführen oder es in VS Code öffnen, um eine vollständig integrierte Entwicklungsumgebung (Integrated Development Environment, IDE) mit der Leistungsfähigkeit von Azure Machine Learning-Ressourcen nutzen zu können. Wählen Sie In VS Code öffnen und dann entweder die Web- oder die Desktop-Option aus. Wenn Sie VS Code auf diese Weise starten, wird es an Ihre Compute-Instanz, den Kernel und das Dateisystem des Arbeitsbereichs angefügt.

Wichtig

Der Rest dieses Tutorials enthält Zellen des Tutorial-Notebooks. Kopieren Sie diese, und fügen Sie sie in Ihr neues Notebook ein, oder wechseln Sie jetzt zum Notebook, wenn Sie es geklont haben.

Erstellen eines Handles für den Arbeitsbereich

Bevor Sie mit dem Code beginnen, benötigen Sie eine Möglichkeit, auf Ihren Arbeitsbereich zu verweisen. Der Arbeitsbereich ist die Ressource der obersten Ebene für Azure Machine Learning und ein zentraler Ort für die Arbeit mit allen Artefakten, die Sie während der Nutzung von Azure Machine Learning erstellen.

Erstellen Sie ml_client als Handle für Ihren Arbeitsbereich – dieser Client verwaltet alle Ihre Ressourcen und Aufträge.

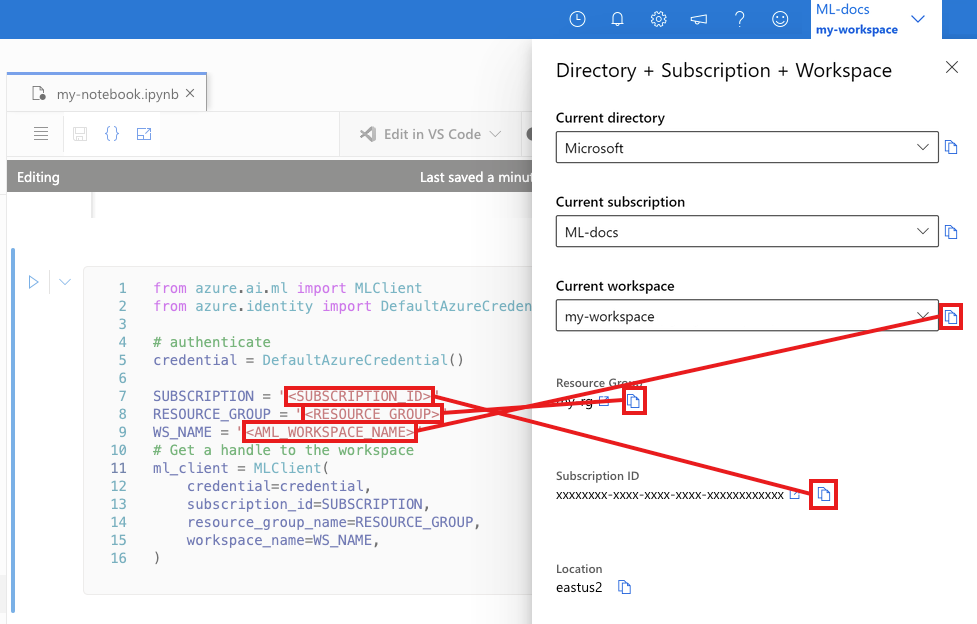

Geben Sie in der nächsten Zelle Ihre Abonnement-ID, den Namen der Ressourcengruppe und den Arbeitsbereichsnamen ein. So finden Sie diese Werte:

- Wählen Sie auf der oben rechts angezeigten Azure Machine Learning Studio-Symbolleiste den Namen Ihres Arbeitsbereichs aus.

- Kopieren Sie den Wert für Arbeitsbereich, Ressourcengruppe und Abonnement-ID in den Code.

- Kopieren Sie einen Wert, schließen Sie den Bereich, und fügen Sie ihn ein. Kehren Sie dann für den nächsten Wert zurück.

from azure.ai.ml import MLClient

from azure.identity import DefaultAzureCredential

# authenticate

credential = DefaultAzureCredential()

SUBSCRIPTION = "<SUBSCRIPTION_ID>"

RESOURCE_GROUP = "<RESOURCE_GROUP>"

WS_NAME = "<AML_WORKSPACE_NAME>"

# Get a handle to the workspace

ml_client = MLClient(

credential=credential,

subscription_id=SUBSCRIPTION,

resource_group_name=RESOURCE_GROUP,

workspace_name=WS_NAME,

)

Hinweis

Das Erstellen von MLClient stellt keine Verbindung mit dem Arbeitsbereich her. Die Clientinitialisierung erfolgt verzögert. Es wird gewartet, bis zum ersten Mal ein Aufruf gemacht werden muss. Diese Aktion erfolgt in der nächsten Codezelle.

# Verify that the handle works correctly.

# If you ge an error here, modify your SUBSCRIPTION, RESOURCE_GROUP, and WS_NAME in the previous cell.

ws = ml_client.workspaces.get(WS_NAME)

print(ws.location, ":", ws.resource_group)

Erstellen des Trainingsskripts

Erstellen Sie das Schulungsskript, das die main.py Python-Datei ist.

Erstellen Sie zunächst einen Quellordner für das Skript:

import os

train_src_dir = "./src"

os.makedirs(train_src_dir, exist_ok=True)

Dieses Skript verarbeitet die Daten vor und teilt sie in Test- und Trainingsdaten auf. Es trainiert ein strukturbasiertes Modell mithilfe dieser Daten und gibt das Ausgabemodell zurück.

Verwenden Sie während der Pipelineausführung MLFlow , um die Parameter und Metriken zu protokollieren.

Die folgende Zelle verwendet IPython Magic, um das Schulungsskript in das Verzeichnis zu schreiben, das Sie gerade erstellt haben.

%%writefile {train_src_dir}/main.py

import os

import argparse

import pandas as pd

import mlflow

import mlflow.sklearn

from sklearn.ensemble import GradientBoostingClassifier

from sklearn.metrics import classification_report

from sklearn.model_selection import train_test_split

def main():

"""Main function of the script."""

# input and output arguments

parser = argparse.ArgumentParser()

parser.add_argument("--data", type=str, help="path to input data")

parser.add_argument("--test_train_ratio", type=float, required=False, default=0.25)

parser.add_argument("--n_estimators", required=False, default=100, type=int)

parser.add_argument("--learning_rate", required=False, default=0.1, type=float)

parser.add_argument("--registered_model_name", type=str, help="model name")

args = parser.parse_args()

# Start Logging

mlflow.start_run()

# enable autologging

mlflow.sklearn.autolog()

###################

#<prepare the data>

###################

print(" ".join(f"{k}={v}" for k, v in vars(args).items()))

print("input data:", args.data)

credit_df = pd.read_csv(args.data, header=1, index_col=0)

mlflow.log_metric("num_samples", credit_df.shape[0])

mlflow.log_metric("num_features", credit_df.shape[1] - 1)

train_df, test_df = train_test_split(

credit_df,

test_size=args.test_train_ratio,

)

####################

#</prepare the data>

####################

##################

#<train the model>

##################

# Extracting the label column

y_train = train_df.pop("default payment next month")

# convert the dataframe values to array

X_train = train_df.values

# Extracting the label column

y_test = test_df.pop("default payment next month")

# convert the dataframe values to array

X_test = test_df.values

print(f"Training with data of shape {X_train.shape}")

clf = GradientBoostingClassifier(

n_estimators=args.n_estimators, learning_rate=args.learning_rate

)

clf.fit(X_train, y_train)

y_pred = clf.predict(X_test)

print(classification_report(y_test, y_pred))

###################

#</train the model>

###################

##########################

#<save and register model>

##########################

# Registering the model to the workspace

print("Registering the model via MLFlow")

# pin numpy

conda_env = {

'name': 'mlflow-env',

'channels': ['conda-forge'],

'dependencies': [

'python=3.10.15',

'pip<=21.3.1',

{

'pip': [

'mlflow==2.17.0',

'cloudpickle==2.2.1',

'pandas==1.5.3',

'psutil==5.8.0',

'scikit-learn==1.5.2',

'numpy==1.26.4',

]

}

],

}

mlflow.sklearn.log_model(

sk_model=clf,

registered_model_name=args.registered_model_name,

artifact_path=args.registered_model_name,

conda_env=conda_env,

)

# Saving the model to a file

mlflow.sklearn.save_model(

sk_model=clf,

path=os.path.join(args.registered_model_name, "trained_model"),

)

###########################

#</save and register model>

###########################

# Stop Logging

mlflow.end_run()

if __name__ == "__main__":

main()

Wenn das Modell trainiert wird, speichert das Skript die Modelldatei und registriert sie im Arbeitsbereich. Sie können das registrierte Modell an Inferencing-Endpunkten verwenden.

Möglicherweise müssen Sie Aktualisieren auswählen, um den neuen Ordner und das Skript in Ihren Dateien anzuzeigen.

Konfigurieren des Befehls

Sie verfügen jetzt über ein Skript, das die gewünschten Aufgaben ausführen kann, und einen Computecluster zum Ausführen des Skripts. Verwenden Sie einen allgemeinen Befehl , der Befehlszeilenaktionen ausführen kann. Diese Befehlszeilenaktion kann direkt Systembefehle aufrufen oder ein Skript ausführen.

Erstellen Sie Eingabevariablen, um die Eingabedaten, das Geteilte Verhältnis, die Lernrate und den registrierten Modellnamen anzugeben. Für das Befehlsskript gilt Folgendes:

- Verwendet eine Umgebung , die Software- und Laufzeitbibliotheken definiert, die für das Schulungsskript erforderlich sind. Azure Machine Learning bietet viele kuratierte oder vordefinierte Umgebungen, die für allgemeine Trainings- und Rückschlussszenarien nützlich sind. Sie nutzen eine der Umgebungen hier. Im Tutorial Training eines Modells in Azure Machine Learning erfahren Sie, wie Sie eine benutzerdefinierte Umgebung erstellen.

- Konfiguriert die Befehlszeilenaktion selbst –

python main.pyin diesem Fall. Auf die Eingaben und Ausgaben kann über die${{ ... }}Schreibweise im Befehl zugegriffen werden. - Greift auf die Daten aus einer Datei im Internet zu.

- Da Sie keine Computeressource angegeben haben, wird das Skript auf einem serverlosen Computecluster ausgeführt, der automatisch erstellt wird.

from azure.ai.ml import command

from azure.ai.ml import Input

registered_model_name = "credit_defaults_model"

job = command(

inputs=dict(

data=Input(

type="uri_file",

path="https://azuremlexamples.blob.core.windows.net/datasets/credit_card/default_of_credit_card_clients.csv",

),

test_train_ratio=0.2,

learning_rate=0.25,

registered_model_name=registered_model_name,

),

code="./src/", # location of source code

command="python main.py --data ${{inputs.data}} --test_train_ratio ${{inputs.test_train_ratio}} --learning_rate ${{inputs.learning_rate}} --registered_model_name ${{inputs.registered_model_name}}",

environment="azureml://registries/azureml/environments/sklearn-1.5/labels/latest",

display_name="credit_default_prediction",

)

Übermitteln des Auftrags

Übermitteln Sie den Auftrag, der in Azure Machine Learning ausgeführt werden soll. Verwenden Sie diesmal create_or_update für ml_client.

ml_client.create_or_update(job)

Anzeigen der Auftragsausgabe und Warten auf den Auftragsabschluss

Zeigen Sie den Auftrag in Azure Machine Learning Studio an, indem Sie den Link in der Ausgabe der vorherigen Zelle auswählen.

Die Ausgabe dieses Auftrags sieht in Azure Machine Learning Studio wie folgt aus. Erkunden Sie die Registerkarten für verschiedene Details wie Metriken, Ausgaben und mehr. Nach Abschluss registriert der Auftrag als Ergebnis des Trainings ein Modell in Ihrem Arbeitsbereich.

Wichtig

Warten Sie, bis der Auftragsstatus "Abgeschlossen" angezeigt wird, bevor Sie fortfahren – in der Regel 2-3 Minuten. Wenn der Compute-Cluster auf Null skaliert wurde, kann es bis zu 10 Minuten dauern, bis die Bereitstellung erfolgt.

Während Sie warten, erkunden Sie die Auftragsdetails im Studio:

- Registerkarte "Metriken": Anzeigen der von MLflow protokollierten Schulungsmetriken

- Registerkarte "Ausgaben + Protokolle": Überprüfen Sie die Schulungsprotokolle

- Registerkarte "Modelle": Sehen Sie das registrierte Modell (nach Abschluss)

Bereitstellen des Modells als Onlineendpunkt

Stellen Sie Ihr Machine Learning-Modell mithilfe eines online endpointWebdiensts in der Azure-Cloud bereit.

Verwenden Sie das modell, das Sie registriert haben, um einen Machine Learning-Dienst bereitzustellen.

Erstellen eines neuen Onlineendpunkts

Nachdem Sie nun ein Modell registriert haben, erstellen Sie Ihren Onlineendpunkt. Der Endpunktname muss innerhalb der Azure-Region eindeutig sein. Erstellen Sie für dieses Lernprogramm einen eindeutigen Namen mithilfe von UUID.

import uuid

# Creating a unique name for the endpoint

online_endpoint_name = "credit-endpoint-" + str(uuid.uuid4())[:8]

Erstellen Sie den Endpunkt.

# Expect the endpoint creation to take a few minutes

from azure.ai.ml.entities import (

ManagedOnlineEndpoint,

ManagedOnlineDeployment,

Model,

Environment,

)

# create an online endpoint

endpoint = ManagedOnlineEndpoint(

name=online_endpoint_name,

description="this is an online endpoint",

auth_mode="key",

tags={

"training_dataset": "credit_defaults",

"model_type": "sklearn.GradientBoostingClassifier",

},

)

endpoint = ml_client.online_endpoints.begin_create_or_update(endpoint).result()

print(f"Endpoint {endpoint.name} provisioning state: {endpoint.provisioning_state}")

Hinweis

Die Erstellung des Endpunkts dauert einige Minuten.

Rufen Sie ihn nach dem Erstellen des Endpunkts ab, wie im folgenden Code dargestellt:

endpoint = ml_client.online_endpoints.get(name=online_endpoint_name)

print(

f'Endpoint "{endpoint.name}" with provisioning state "{endpoint.provisioning_state}" is retrieved'

)

Bereitstellen des Modells für den Endpunkt

Nachdem Sie den Endpunkt erstellt haben, stellen Sie das Modell mithilfe des Eintragsskripts bereit. Jeder Endpunkt kann mehrere Bereitstellungen aufweisen. Sie können Regeln angeben, um den Verkehr zu diesen Bereitstellungen zu leiten. In diesem Beispiel erstellen Sie eine einzelne Bereitstellung, die 100% des eingehenden Datenverkehrs verarbeitet. Wählen Sie einen Farbnamen für die Bereitstellung aus, z. B. Blau, Grün oder Rot. Die Wahl ist beliebig.

Um die neueste Version Ihres registrierten Modells zu finden, überprüfen Sie die Seite " Modelle " im Azure Machine Learning Studio. Verwenden Sie alternativ den folgenden Code, um die neueste Versionsnummer abzurufen.

# Let's pick the latest version of the model

latest_model_version = max(

[int(m.version) for m in ml_client.models.list(name=registered_model_name)]

)

print(f'Latest model is version "{latest_model_version}" ')

Stellen Sie die aktuelle Version des Modells bereit.

# picking the model to deploy. Here we use the latest version of our registered model

model = ml_client.models.get(name=registered_model_name, version=latest_model_version)

# Expect this deployment to take approximately 6 to 8 minutes.

# create an online deployment.

# if you run into an out of quota error, change the instance_type to a comparable VM that is available.

# Learn more on https://azure.microsoft.com/pricing/details/machine-learning/.

blue_deployment = ManagedOnlineDeployment(

name="blue",

endpoint_name=online_endpoint_name,

model=model,

instance_type="Standard_DS3_v2",

instance_count=1,

)

blue_deployment = ml_client.begin_create_or_update(blue_deployment).result()

Hinweis

Die Bereitstellung kann ungefähr 6 bis 8 Minuten in Anspruch nehmen.

Wenn die Bereitstellung abgeschlossen ist, können Sie sie testen.

Testen mit einer Beispielabfrage

Nachdem Sie das Modell auf dem Endpunkt bereitgestellt haben, führen Sie eine Ableitung mithilfe des Modells aus.

Erstellen Sie eine Beispielanforderungsdatei, die dem in der run-Methode des Bewertungsskripts erwarteten Format entspricht.

deploy_dir = "./deploy"

os.makedirs(deploy_dir, exist_ok=True)

%%writefile {deploy_dir}/sample-request.json

{

"input_data": {

"columns": [0,1,2,3,4,5,6,7,8,9,10,11,12,13,14,15,16,17,18,19,20,21,22],

"index": [0, 1],

"data": [

[20000,2,2,1,24,2,2,-1,-1,-2,-2,3913,3102,689,0,0,0,0,689,0,0,0,0],

[10, 9, 8, 7, 6, 5, 4, 3, 2, 1, 10, 9, 8, 7, 6, 5, 4, 3, 2, 1, 10, 9, 8]

]

}

}

# test the blue deployment with some sample data

ml_client.online_endpoints.invoke(

endpoint_name=online_endpoint_name,

request_file="./deploy/sample-request.json",

deployment_name="blue",

)

Bereinigen von Ressourcen

Wenn Sie den Endpunkt nicht benötigen, löschen Sie ihn, um die Verwendung der Ressource zu beenden. Stellen Sie sicher, dass keine anderen Bereitstellungen einen Endpunkt verwenden, bevor Sie ihn löschen.

Hinweis

Der vollständige Löschvorgang dauert ungefähr 20 Minuten.

ml_client.online_endpoints.begin_delete(name=online_endpoint_name)

Beenden der Compute-Instanz

Wenn Sie sie jetzt nicht benötigen, beenden Sie die Computeinstanz:

- Wählen Sie im Studio im linken Bereich "Berechnen" aus.

- Wählen Sie auf den oberen Registerkarten die Option Compute-Instanzen aus.

- Wählen Sie in der Liste die Compute-Instanz aus.

- Wählen Sie auf der oberen Symbolleiste Beenden aus.

Löschen aller Ressourcen

Wichtig

Die von Ihnen erstellten Ressourcen können ggf. auch in anderen Azure Machine Learning-Tutorials und -Anleitungen verwendet werden.

Wenn Sie die erstellten Ressourcen nicht mehr benötigen, löschen Sie diese, damit Ihnen keine Kosten entstehen:

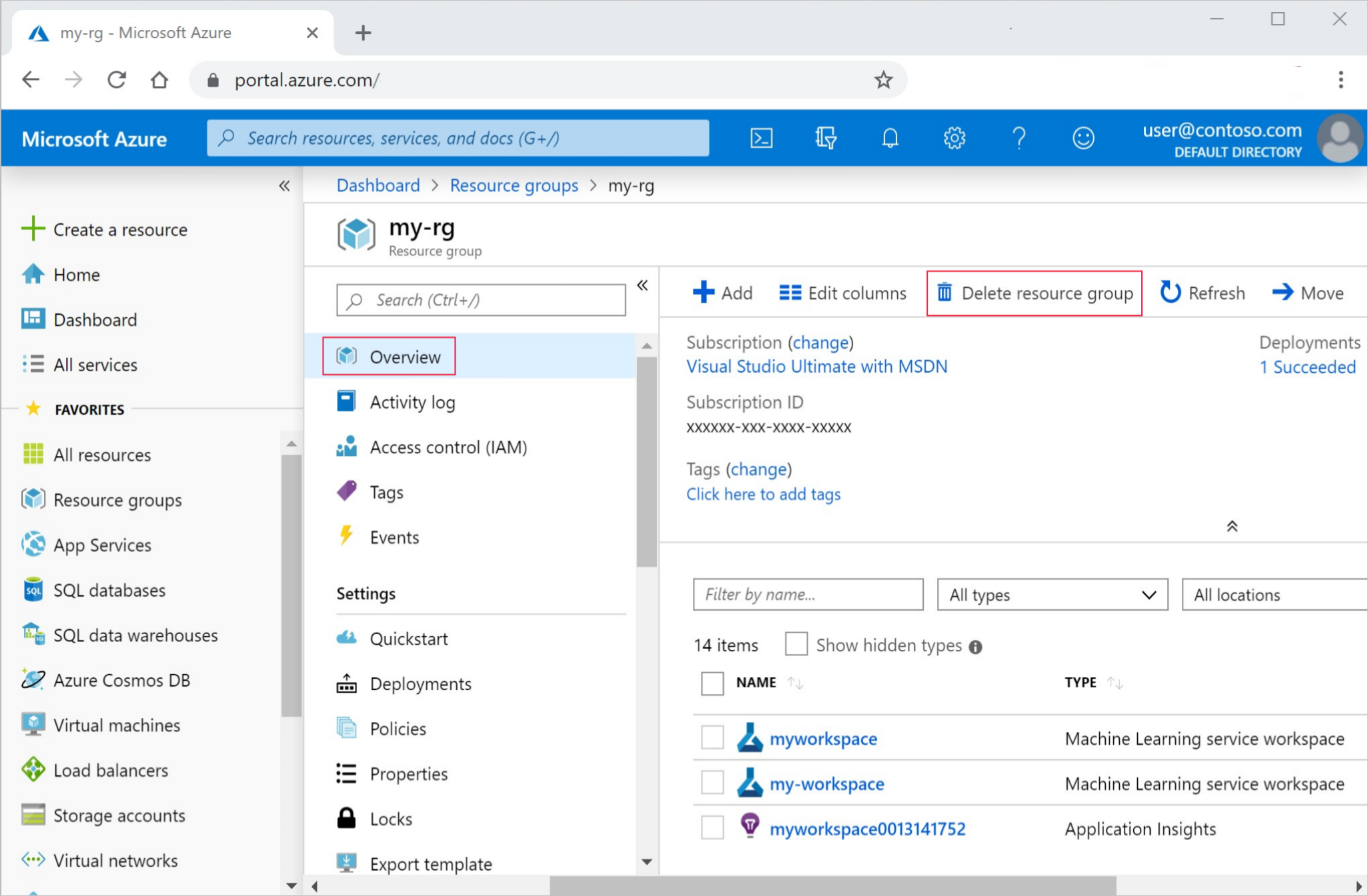

Geben Sie im Suchfeld des Azure-Portals Ressourcengruppen ein, und wählen Sie sie aus den Suchergebnissen aus.

Wählen Sie in der Liste die Ressourcengruppe aus, die Sie erstellt haben.

Wählen Sie auf der Seite Übersicht die Option Ressourcengruppe löschen aus.

Geben Sie den Ressourcengruppennamen ein. Wählen Sie anschließend die Option Löschen.

Nächste Schritte

Entdecken Sie weitere Möglichkeiten zum Erstellen mit Azure Machine Learning:

| Tutorial | BESCHREIBUNG |

|---|---|

| Hochladen, Zugreifen auf und Erkunden Ihrer Daten | Speichern sie große Daten in der Cloud, und greifen Sie über Notizbücher darauf zu. |

| Modellentwicklung in einer Cloudarbeitsstation | Prototypen und Modelle interaktiv entwickeln |

| Bereitstellen eines Modells als ein Onlineendpunkt | Erfahren Sie mehr über erweiterte Bereitstellungskonfigurationen |

| Erstellen von Produktionspipelines | Erstellen automatisierter, wiederverwendbarer ML-Workflows |