Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Der No-Code-Editor erleichtert die Entwicklung eines Stream Analytics-Auftrags, um Ihre Echtzeitstreamingdaten zu verarbeiten. Verwenden Sie Drag-and-Drop-Funktionen, ohne Code zu schreiben. Die Oberfläche bietet eine Canvas, in der Sie eine Verbindung mit Eingabequellen herstellen können, um Ihre Streamingdaten schnell anzuzeigen. Dann können Sie es transformieren, bevor Sie an Ihre Zielinstanzen schreiben.

Mithilfe des No-Code-Editors können Sie ganz einfach:

- Ändern der Eingabeschemas

- Durchführung von Datenvorbereitungsoperationen wie Joins und Filtern.

- Behandeln von erweiterten Szenarien wie Zeitfensteraggregationen (rollierende und springende Fenster sowie Sitzungsfenster) für Gruppierungsvorgänge

Nachdem Sie Ihre Stream Analytics-Aufträge erstellt und ausgeführt haben, können Sie Produktionsworkloads problemlos operationalisieren. Verwenden Sie die richtige Auswahl von integrierten Metriken zur Überwachung und Problembehandlung. Stream Analytics-Aufträge werden gemäß dem Preismodell berechnet, wenn sie ausgeführt werden.

Voraussetzungen

Bevor Sie Ihre Stream Analytics-Aufträge mithilfe des No-Code-Editors entwickeln, stellen Sie sicher, dass Sie diese Anforderungen erfüllen:

- Die Streamingeingabequellen und Zielressourcen für den Stream Analytics-Auftrag müssen öffentlich zugänglich sein und dürfen sich nicht in einem virtuellen Azure-Netzwerk befinden.

- Sie müssen über die erforderlichen Berechtigungen verfügen, um auf die Streamingeingabe- und -ausgaberessourcen zuzugreifen.

- Sie benötigen Berechtigungen zum Erstellen und Ändern von Azure Stream Analytics-Ressourcen.

Hinweis

Der No-Code-Editor ist derzeit nicht in der Region China verfügbar.

Azure Stream Analytics-Auftrag

Ein Stream Analytics-Auftrag basiert auf drei Hauptkomponenten: Streamingeingaben, Transformationen und Ausgaben. Sie können beliebig viele Komponenten einschließen, z. B. mehrere Eingaben, parallele Verzweigungen mit mehreren Transformationen und mehrere Ausgaben. Weitere Informationen finden Sie in der Azure Stream Analytics-Dokumentation.

Hinweis

Die folgenden Funktionen und Ausgabetypen sind nicht verfügbar, wenn Sie den No-Code-Editor verwenden:

- Benutzerdefinierte Funktionen.

- Bearbeiten von Abfragen auf der Azure Stream Analytics-Abfrageseite. Jedoch können Sie die Abfrage anzeigen, die vom No-Code-Editor auf der Abfrageseite generiert wurde.

- Hinzufügen von Eingaben und Ausgaben in Azure Stream Analytics Eingabe- und Ausgabeseiten. Sie können jedoch die Eingaben und Ausgaben anzeigen, die vom No-Code-Editor auf der Eingabe- und Ausgabeseite generiert wurden.

- Die folgenden Ausgabetypen sind nicht verfügbar: Azure Function, Azure Data Lake Storage Gen1, PostgreSQL DB, Service Bus queue/topic, Table storage.

Verwenden Sie einen der folgenden Ansätze, um auf den No-Code-Editor zum Erstellen Ihres Streamanalyseauftrags zuzugreifen:

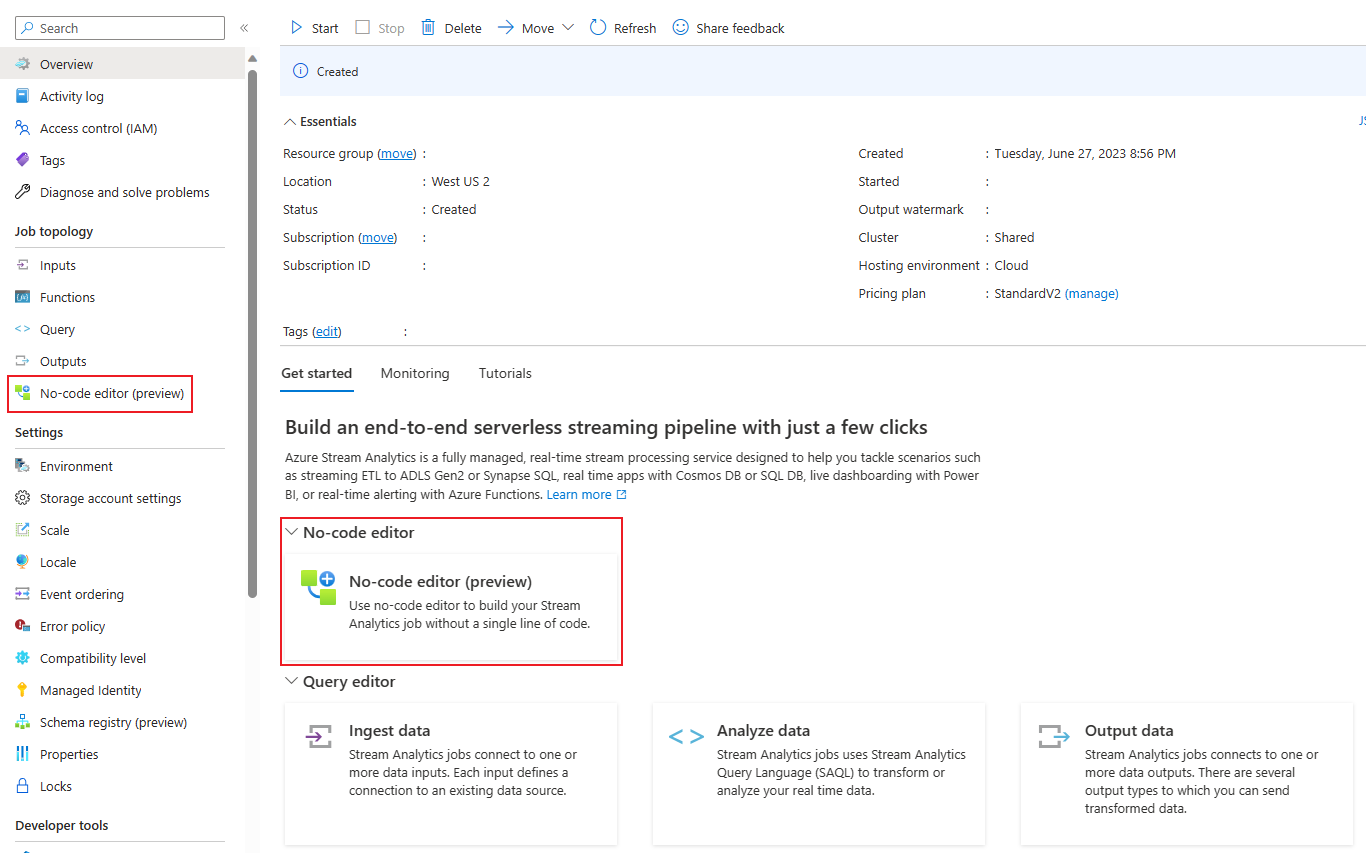

Über das Azure Stream Analytics-Portal (Vorschau): Erstellen Sie einen Stream Analytics-Auftrag, und wählen Sie dann auf der Seite Übersicht den No-Code-Editor auf der Registerkarte Erste Schritte oder im linken Bereich die Option No-Code-Editor aus.

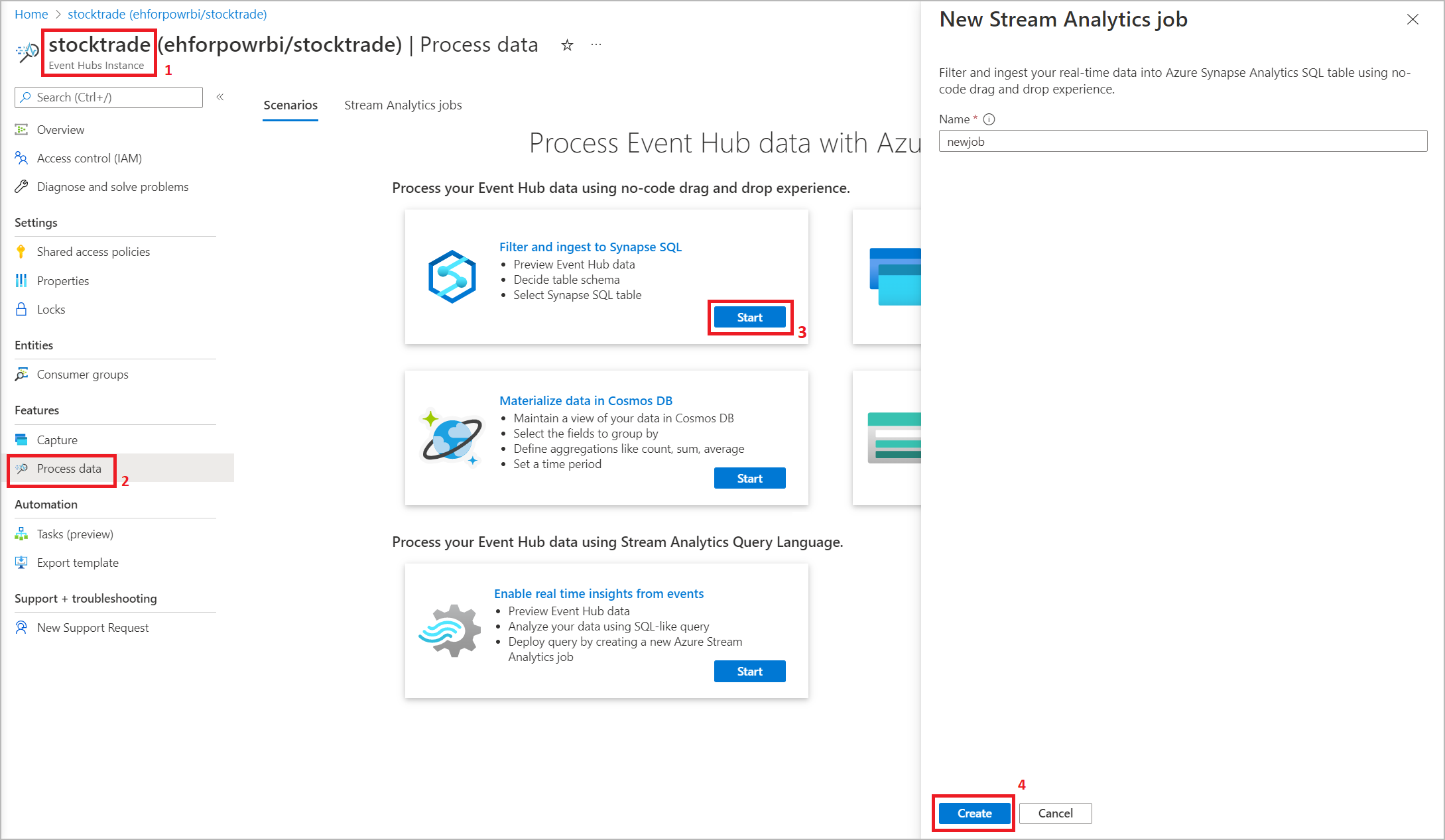

Über das Azure Event Hubs-Portal: Öffnen Sie eine Event Hubs-Instanz. Wählen Sie Daten verarbeiten und dann eine beliebige vordefinierte Vorlage aus.

Mit den vordefinierten Vorlagen können Sie einen Auftrag entwickeln und ausführen, um verschiedene Szenarien zu behandeln, darunter:

- Erfassen von Event Hubs-Daten im Delta Lake-Format (Vorschau)

- Filtern und Erfassen in Azure Synapse SQL

- Erfassung der Event Hubs-Daten im Parquet-Format in Azure Data Lake Storage Gen2

- Materialisieren von Daten in Azure Cosmos DB

- Filtern und Importieren in Azure Data Lake Storage Gen2

- Anreichern von Daten und Übertragen in den Event Hub

- Transformieren und Speichern von Daten in Azure SQL-Datenbank

- Filtern und Eingeben in Azure Data Explorer

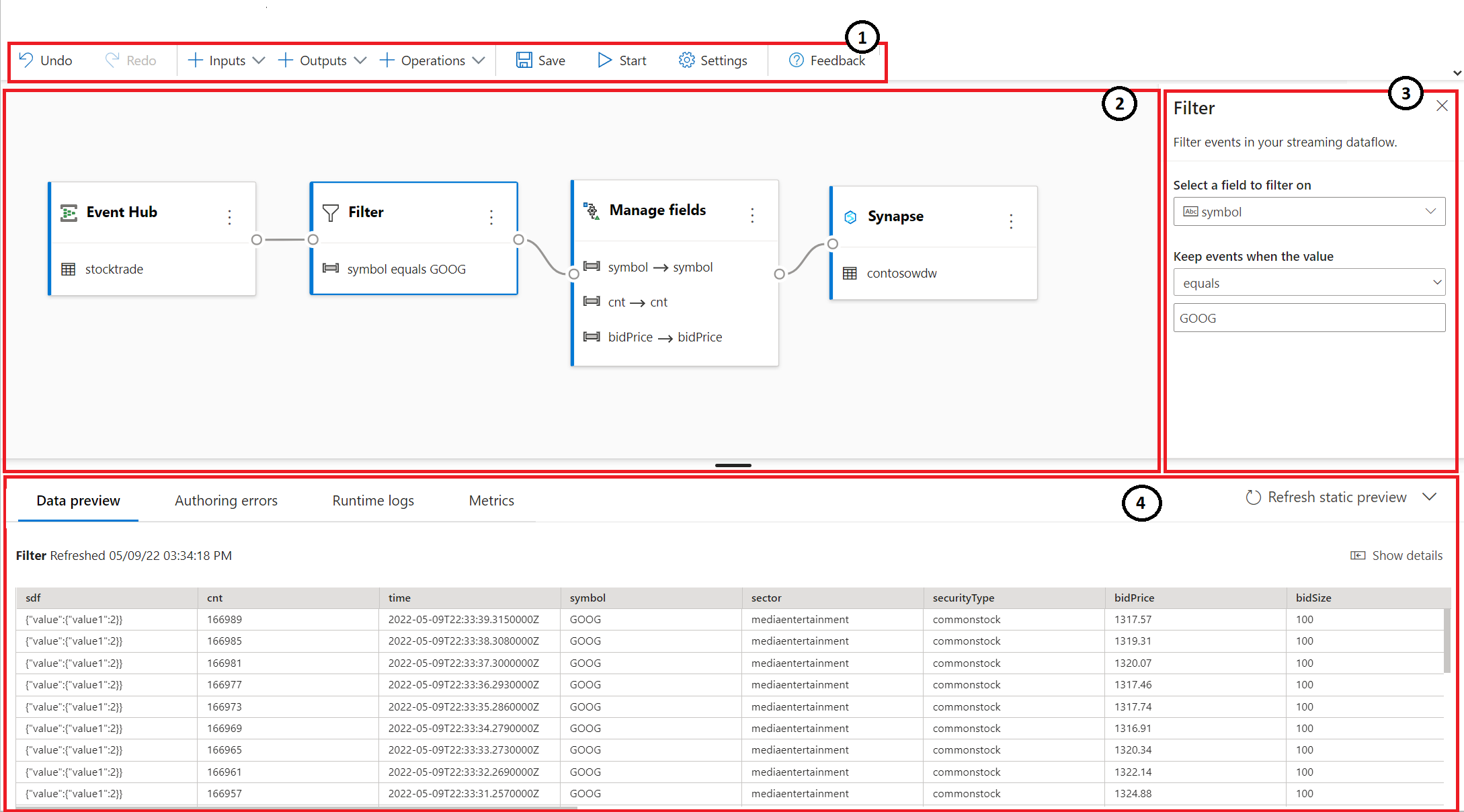

Der folgende Screenshot zeigt einen abgeschlossenen Stream Analytics-Auftrag. Die Abschnitte, die Ihnen beim Erstellen zur Verfügung stehen, sind hervorgehoben.

- Menüband: Im Menüband folgen die Abschnitte der Reihenfolge eines klassischen Analyseprozesses: ein Ereignis-Hub als Eingabe (auch Datenquelle genannt), Transformationen (Streaming von Extraktions-, Transformations- und Ladevorgängen), Ausgaben, eine Schaltfläche zum Speichern des Fortschritts und eine Schaltfläche zum Starten des Auftrags.

- Diagrammansicht: Diese Ansicht ist eine grafische Darstellung Ihres Stream Analytics-Auftrags, von Eingaben zu Vorgängen bis hin zu Ausgaben.

- Seitenbereich: Je nachdem, welche Komponente Sie in der Diagrammansicht auswählen, werden Einstellungen zum Ändern von Eingaben, Transformationen oder Ausgaben angezeigt.

- Registerkarten für Datenvorschau, Erstellungsfehler, Runtimeprotokolle und Metriken: In der Datenvorschau werden für jede Kachel die Ergebnisse für den jeweiligen Schritt angezeigt (live für Eingaben und bei Bedarf für Transformationen und Ausgaben). In diesem Abschnitt werden außerdem alle Erstellungsfehler oder Warnungen bei der Entwicklung Ihres Auftrags zusammengefasst. Durch Auswahl der einzelnen Fehler oder Warnungen wird die entsprechende Transformation ausgewählt. Er stellt Ihnen auch die Auftragsmetrik zur Verfügung, damit Sie die Integrität des ausgeführten Auftrags überwachen können.

Streamingdateneingabe

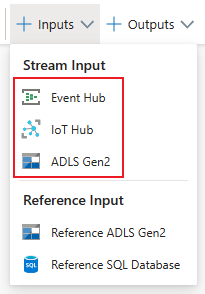

Der No-Code-Editor unterstützt die Eingabe von Streamingdaten von drei Arten von Ressourcen:

- Azure Event Hubs

- Azure IoT Hub

- Azure Data Lake Storage Gen2

Weitere Informationen zu Streamingdateneingaben finden Sie unter Streamen von Daten als Eingabe in Stream Analytics.

Hinweis

Der No-Code-Editor im Azure Event Hubs-Portal hat nur Event Hub als Eingabeoption.

Azure Event Hubs als Streamingeingabe

Bei Azure Event Hubs handelt es sich um eine Big Data-Streamingplattform und einen Ereigniserfassungsdienst. Mit diesem Dienst können Millionen von Ereignissen pro Sekunde empfangen und verarbeitet werden. Sie können Daten transformieren und speichern, die über einen beliebigen Echtzeitanalyseanbieter oder Batch- und Speicheradapter an einen Event Hub gesendet werden.

Wählen Sie zum Konfigurieren eines Event Hubs als Eingabe für Ihren Auftrag das Symbol Event Hub aus. In der Diagrammansicht wird eine Kachel mit einem Seitenbereich für die Konfiguration und die Verbindung angezeigt.

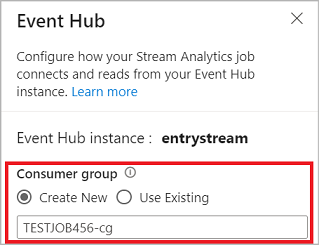

Wenn Sie eine Verbindung mit Ihrem Event Hub im No-Code-Editor herstellen, erstellen Sie eine neue Consumergruppe (die Standardoption). Mit diesem Ansatz wird verhindert, dass der Event Hub das Limit für gleichzeitige Leser erreicht. Weitere Informationen zu Consumergruppen und ob Sie eine vorhandene Consumergruppe auswählen oder eine neue erstellen sollten, finden Sie unter Consumergruppen.

Wenn sich Ihr Event Hub im Basic-Tarif befindet, können Sie nur die vorhandene Consumergruppe $Default verwenden. Wenn sich Ihr Event Hub im Standard- oder Premium-Tarif befindet, können Sie eine neue Consumergruppe erstellen.

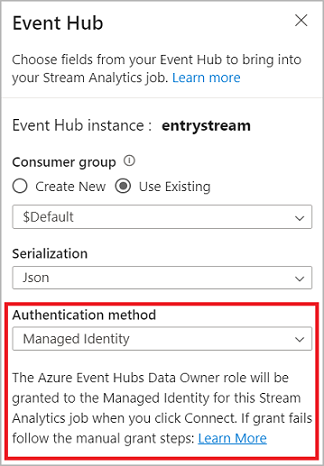

Wenn Sie eine Verbindung mit dem Event Hub herstellen, sollten Sie Managed Identity als Authentifizierungsmodus auswählen; die Rolle Azure Event Hubs Data Owner wird der verwalteten Identität an den Stream Analytics-Auftrag zugewiesen. Weitere Informationen zu verwalteten Identitäten für einen Event Hub finden Sie unter Verwenden verwalteter Identitäten für den Zugriff auf einen Event Hub über einen Azure Stream Analytics-Auftrag.

Verwaltete Identitäten beseitigen die Einschränkungen von benutzerbasierten Authentifizierungsmethoden. Zu diesen Einschränkungen gehört, dass Sie sich neu authentifizieren müssen, wenn sich das Kennwort ändert oder das Benutzertoken alle 90 Tage abläuft.

Nachdem Sie Ihre Event Hub-Angaben eingerichtet und Verbinden ausgewählt haben, können Sie über + Feld hinzufügen Felder manuell hinzufügen. Voraussetzung ist, dass Sie die Feldnamen kennen. Um stattdessen Felder und Datentypen automatisch basierend auf einem Beispiel der eingehenden Nachrichten zu erkennen, wählen Sie Felder automatisch erkennen aus. Über das Zahnradsymbol können Sie bei Bedarf die Anmeldeinformationen bearbeiten.

Wenn Stream Analytics-Aufträge die Felder erkennen, werden sie in der Liste angezeigt. Außerdem sehen Sie eine Livevorschau der eingehenden Nachrichten in der Tabelle Datenvorschau unter der Diagrammansicht.

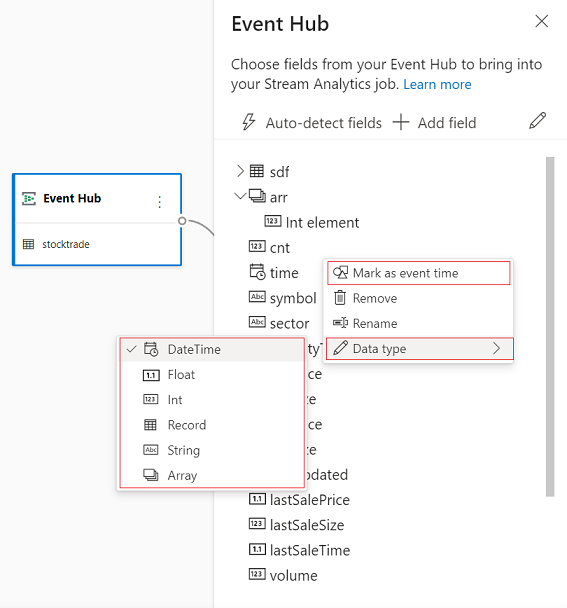

Ändern von Eingabedaten

Sie können die Feldnamen bearbeiten, Felder entfernen, den Datentyp ändern oder die Ereigniszeit (Als Ereigniszeit markieren: TIMESTAMP BY-Klausel, wenn ein Datumstypfeld) ändern, indem Sie das Drei-Punkt-Symbol neben jedem Feld auswählen. Sie können auch geschachtelte Felder aus den eingehenden Nachrichten erweitern, auswählen und bearbeiten, wie in der folgenden Abbildung dargestellt.

Tipp

Dieser Vorgang gilt auch für die Eingabedaten aus Azure IoT Hub und Azure Data Lake Storage Gen2.

Folgende Datentypen sind verfügbar:

- DateTime: Datums- und Uhrzeitfeld im ISO-Format

- Gleitkomma: Dezimalzahl

- Int: Ganzzahl

- Datensatz: Geschachteltes Objekt mit mehreren Datensätzen

- Zeichenfolge: Text

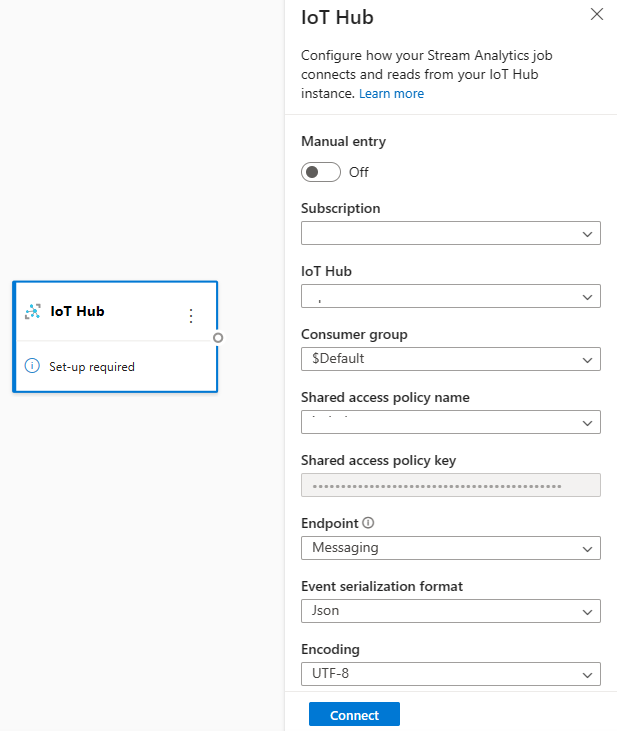

Azure IoT Hub als Streamingeingabe

Azure IoT Hub ist ein verwalteter Dienst, der in der Cloud gehostet wird und als zentraler Nachrichten-Hub für die Kommunikation zwischen einer IoT-Anwendung und deren angeschlossenen Geräten fungiert. Sie können IoT-Gerätedaten verwenden, die an den IoT-Hub gesendet werden, als Eingabe für einen Stream Analytics-Auftrag.

Hinweis

Sie können die Eingabe von Azure IoT Hub im No-Code-Editor von Azure Stream Analytics verwenden.

Um einen IoT Hub als Streamingeingabe für Ihren Auftrag hinzuzufügen, wählen Sie IoT Hub unter Eingaben auf dem Menüband aus. Geben Sie dann die erforderlichen Informationen im rechten Bereich ein, um IoT Hub mit Ihrem Auftrag zu verbinden. Weitere Informationen zu den Details der einzelnen Felder finden Sie unter Streamen von Daten vom IoT Hub zum Stream Analytics-Auftrag.

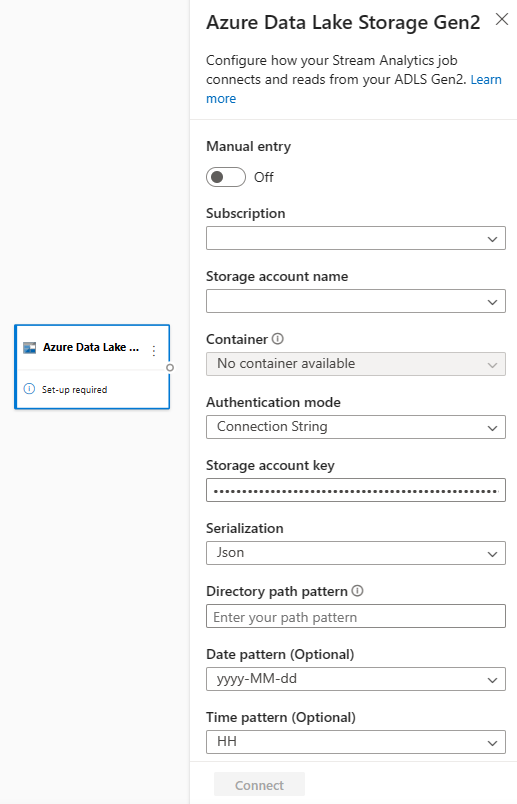

Azure Data Lake Storage Gen2 als Streamingeingabe

Azure Data Lake Storage Gen2 (ADLS Gen2) ist eine cloudbasierte Data Lake-Lösung für Unternehmen. Die Lösung wurde entwickelt, um große Datenmengen in jedem beliebigen Format zu speichern und Big Data-Analyseworkloads zu ermöglichen. Stream Analytics kann die in ADLS Gen2 gespeicherten Daten als Datenstrom verarbeiten. Weitere Informationen zu dieser Art von Eingabe finden Sie unter Stream-Daten aus ADLS Gen2 zum Stream Analytics-Auftrag.

Hinweis

Sie können die Azure Data Lake Storage Gen2-Daten im Editor ohne Code auf dem Azure Stream Analytics-Portal verwenden.

Um einen ADLS Gen2 als Streamingeingabe für Ihren Auftrag hinzuzufügen, wählen Sie auf dem Menüband die Option ADLS Gen2 unter Eingaben aus. Geben Sie dann die erforderlichen Informationen im rechten Bereich ein, um ADLS Gen2 mit Ihrem Auftrag zu verbinden. Weitere Informationen zu den Details der einzelnen Felder finden Sie unter Stream-Daten aus ADLS Gen2 zum Stream Analytics-Auftrag.

Eingaben von Referenzdaten

Die Verweisdaten sind statisch oder ändern sich im Laufe der Zeit langsam. In der Regel verwenden Sie sie, um eingehende Datenströme zu bereichern und Nachschlagevorgänge in Ihrem Auftrag zu erledigen. Beispielsweise können Sie Datenstromeingaben mit Verweisdaten verknüpfen – ähnlich wie bei einer SQL-Verknüpfung zum Suchen statischer Werte. Weitere Informationen zu Verweisdateneingaben finden Sie unter Verwenden von Verweisdaten für Suchvorgänge in Stream Analytics.

Der No-Code-Editor unterstützt jetzt zwei Verweisdatenquellen:

- Azure Data Lake Storage Gen2

- Azure SQL-Datenbank

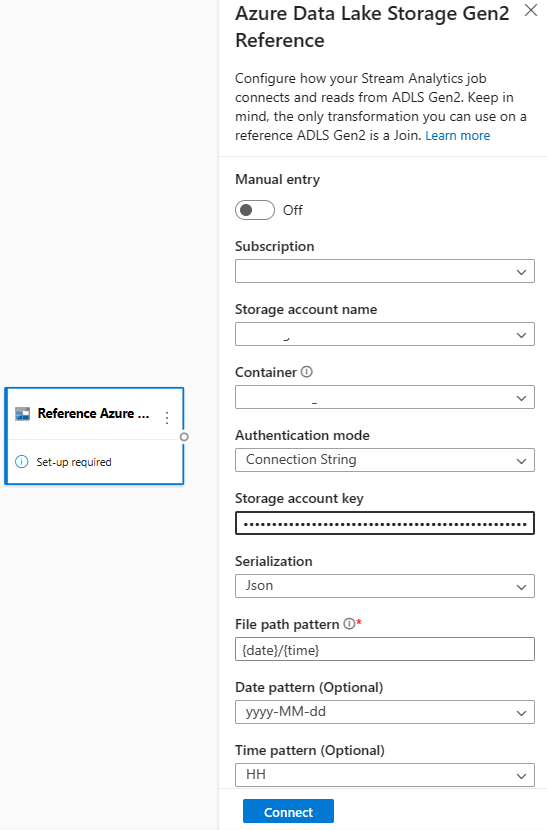

Azure Data Lake Storage Gen2 als Verweisdaten

Modellverweisdaten als Abfolge von Blobs in aufsteigender Reihenfolge der datums- und uhrzeitkombination, die im Blobnamen angegeben ist. Sie können Blobs nur am Ende der Sequenz hinzufügen, indem Sie ein Datum und eine Uhrzeit verwenden, die größer ist als die, die das letzte blob in der Sequenz angegeben hat. Definieren sie Blobs in der Eingabekonfiguration.

Wählen Sie zunächst im Menüband unter dem Abschnitt Eingaben die Option Verweis auf ADLS Gen2 aus. Weitere Informationen zu den einzelnen Feldern finden Sie im Abschnitt über Azure Blob Storage unter Verwenden von Verweisdaten für Suchvorgänge in Stream Analytics.

Dann laden Sie eine JSON-Arraydatei hoch. Das System erkennt die Felder. Verwenden Sie diese Verweisdaten, um Transformationen mit Streamingeingabedaten von Event Hubs durchzuführen.

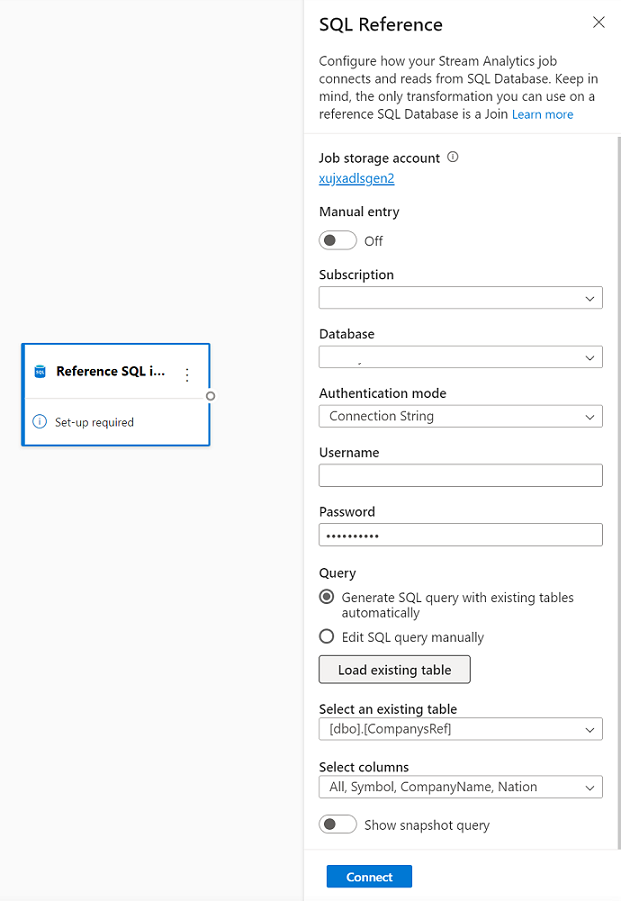

Azure SQL-Datenbank als Verweisdaten

Sie können Azure SQL-Datenbank als Verweisdaten für Ihren Stream Analytics-Auftrag im No-Code-Editor verwenden. Weitere Informationen finden Sie im Abschnitt zu SQL-Datenbank in Verwenden von Verweisdaten für Suchvorgänge in Stream Analytics.

Um SQL-Datenbank als Referenzdateneingabe zu konfigurieren, wählen Sie Referenz-SQL-Datenbank unter Eingaben im Ribbon aus. Geben Sie dann die Informationen für die Verbindung mit Ihrer Referenzdatenbank ein, und wählen Sie die Tabelle mit den von Ihnen benötigten Spalten aus. Sie können die Verweisdaten auch aus Ihrer Tabelle abrufen, indem Sie die SQL-Abfrage manuell bearbeiten.

Transformationen

Streamingdatentransformationen unterscheiden sich grundsätzlich von Batchdatentransformationen. Nahezu alle Streamingdaten haben eine Zeitkomponente, die Einfluss auf alle beteiligten Datenaufbereitungsaufgaben hat.

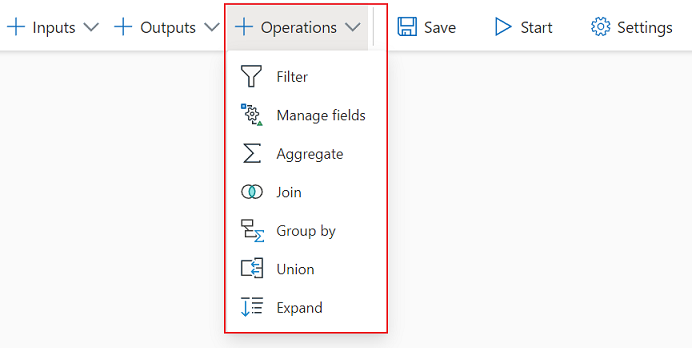

Wählen Sie zum Hinzufügen einer Streamingdatentransformation zu Ihrem Auftrag im Menüband das Transformationssymbol unter dem Abschnitt Vorgänge für die jeweilige Transformation aus. Die entsprechende Kachel wird der Diagrammansicht hinzugefügt. Nachdem Sie die Auswahl getroffen haben, sehen Sie den Seitenbereich dieser Transformation, um sie zu konfigurieren.

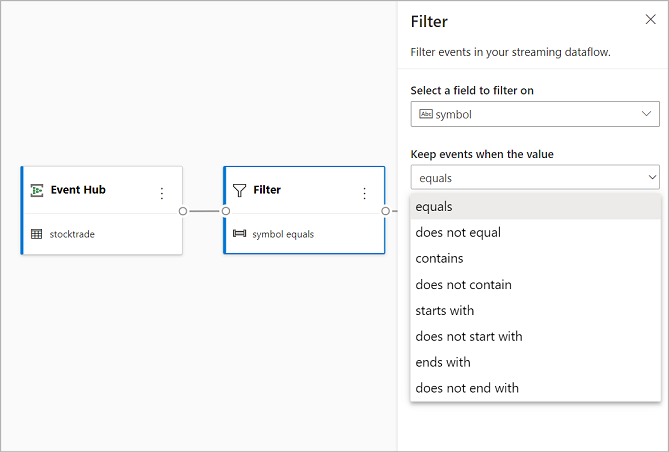

Filter

Verwenden Sie die Filter-Transformation, um Ereignisse basierend auf dem Wert eines Felds in der Eingabe zu filtern. Abhängig vom Datentyp (Zahl oder Text) werden bei der Transformation die Werte beibehalten, die der ausgewählten Bedingung entsprechen.

Hinweis

In jeder Kachel sehen Sie Informationen darüber, was die Transformation noch braucht, um bereit zu sein. Wenn Sie beispielsweise eine neue Kachel hinzufügen, wird eine Erforderliche Setupmeldung angezeigt. Wenn Ein Knotenconnector fehlt, wird entweder eine Fehlermeldung oder eine Warnmeldung angezeigt.

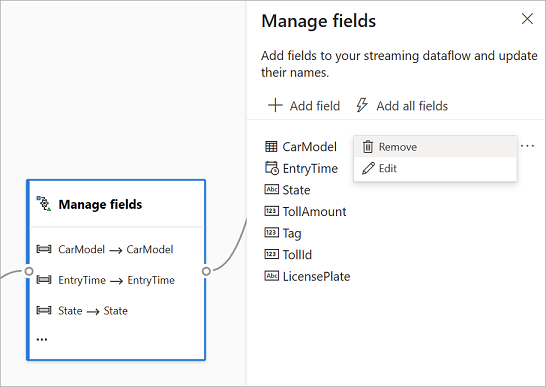

Verwalten von Feldern

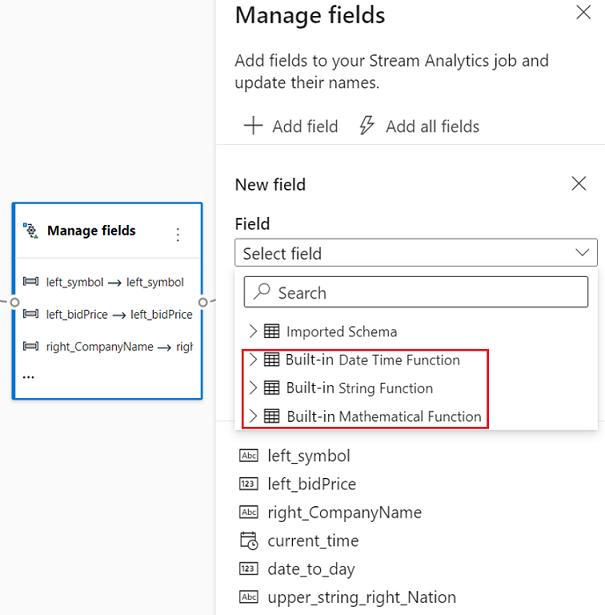

Mit der Transformation Verwalten von Feldern können Sie Felder, die aus einer Eingabe oder einer anderen Transformation stammen, hinzufügen, entfernen oder umbenennen. Mit den Einstellungen im Seitenbereich können Sie ein neues Feld hinzufügen, indem Sie "Feld hinzufügen " auswählen oder alle Felder gleichzeitig hinzufügen.

Sie können auch ein neues Feld hinzufügen, indem Sie die integrierten Funktionen verwenden, um die Daten aus dem Upstream zu aggregieren. Derzeit handelt es sich um die unterstützten integrierten Funktionen um einige der Funktionen in String Functions, Datums- und Uhrzeitfunktionen und mathematische Funktionen. Weitere Informationen zu den Definitionen dieser Funktionen finden Sie unter Integrierte Funktionen (Azure Stream Analytics).

Tipp

Nachdem Sie eine Kachel konfiguriert haben, erhalten Sie in der Diagrammansicht einen Überblick über die Einstellungen auf der Kachel. Beispielsweise können Sie im Bereich Felder verwalten der vorherigen Abbildung sehen, wie die ersten drei Felder verwaltet werden und welche neuen Namen ihnen zugewiesen wurden. Jede Kachel enthält für sie relevante Informationen.

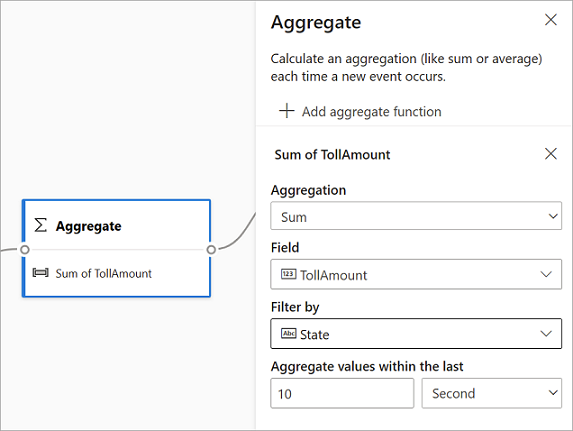

Aggregat

Mithilfe der Aggregattransformation können Sie jedes Mal, wenn in einem Zeitraum ein neues Ereignis eintritt, eine Aggregation (Summe, Minimum, Maximum oder Durchschnitt) berechnen. Mit diesem Vorgang können Sie die Aggregation außerdem basierend auf anderen Dimensionen in Ihren Daten filtern oder segmentieren. Sie können eine oder mehrere Aggregationen in dieselbe Transformation einschließen.

Wählen Sie das Transformationssymbol aus, um eine Aggregation hinzuzufügen. Verbinden Sie dann eine Eingabe, wählen Sie die Aggregation aus, fügen Sie filter- oder Segmentabmessungen hinzu, und wählen Sie den Zeitraum aus, über den die Aggregation berechnet wird. In diesem Beispiel berechnen Sie die Summe des Mautwerts nach dem Zustand, in dem das Fahrzeug in den letzten 10 Sekunden liegt.

Um der gleichen Transformation eine weitere Aggregation hinzuzufügen, wählen Sie Aggregatfunktion hinzufügen aus. Der Filter oder Segment gilt für alle Aggregationen in der Transformation.

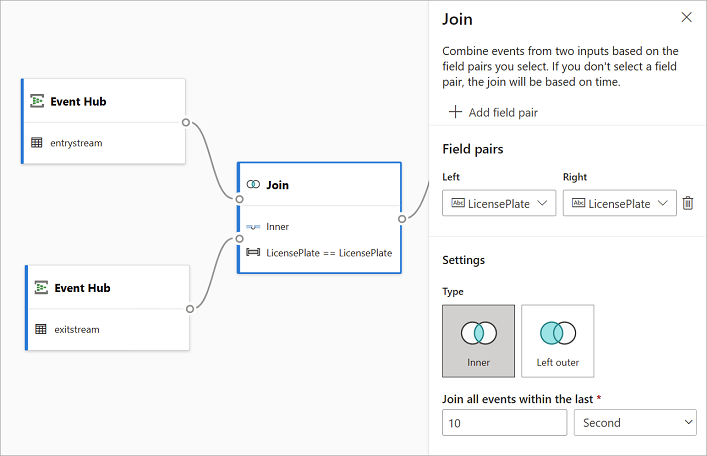

Beitreten

Verwenden Sie die Join-Transformation, um Ereignisse aus zwei Eingaben basierend auf den von Ihnen ausgewählten Feldpaaren zu kombinieren. Wenn Sie kein Feldpaar auswählen, basiert der Join standardmäßig auf der Zeit. Die Standardeinstellung ist das, was diese Transformation von einer Batch-Verarbeitung unterscheidet.

Wie bei regulären Joins haben Sie Optionen für Ihre Verknüpfungslogik:

- Innerer Join: Enthält nur Datensätze aus beiden Tabellen, in denen das Paar übereinstimmt. In diesem Beispiel handelt es sich um die Fälle, in denen das Nummernschild mit beiden Eingaben übereinstimmt.

- Linkes äußeres Join: Eingeschlossen sind alle Datensätze aus der linken (ersten) Tabelle und nur die Datensätze aus der zweiten, die mit dem Feldpaar übereinstimmen. Wenn keine Übereinstimmung besteht, sind die Felder aus der zweiten Eingabe leer.

Um den Verbindungstyp auszuwählen, wählen Sie im Seitenbereich das Symbol für den gewünschten Typ aus.

Wählen Sie schließlich den Zeitraum aus, über den die Verknüpfung berechnet werden soll. In diesem Beispiel berücksichtigt der Join die letzten 10 Sekunden. Je länger der Zeitraum ist, desto seltener ist die Ausgabe, und je mehr Verarbeitungsressourcen Sie für die Transformation verwenden.

Standardmäßig enthält die Ausgabe alle Felder aus beiden Tabellen. Präfixe links (erster Knoten) und rechts (zweiter Knoten) helfen Ihnen, die Quelle zu unterscheiden.

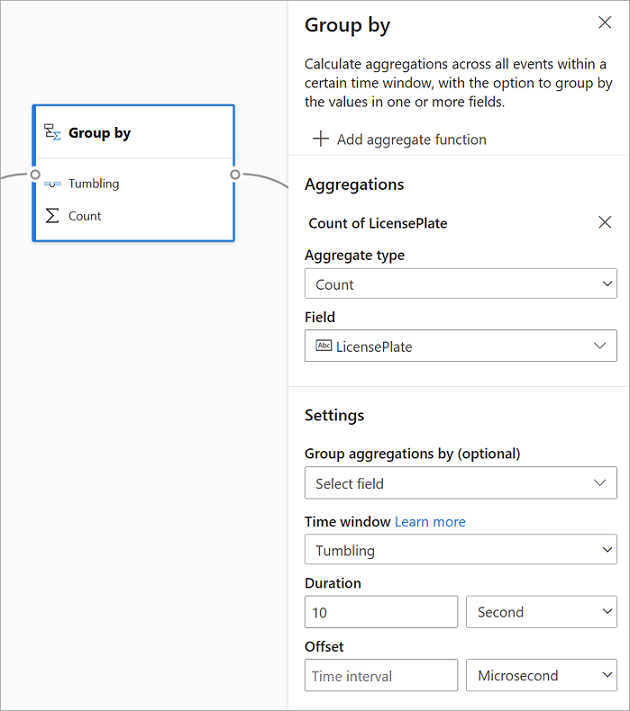

Gruppieren nach

Verwenden Sie die Gruppieren nach-Transformation, um Aggregationen für alle Ereignisse innerhalb eines bestimmten Zeitfensters zu berechnen. Sie können nach den Werten in einem oder mehreren Feldern gruppieren. Dies ähnelt der Transformation Aggregat, bietet jedoch mehr Optionen für Aggregationen. Sie enthält auch komplexere Optionen für Zeitfenster. Ebenfalls ähnlich wie bei Aggregat können Sie pro Transformation mehrere Aggregationen hinzufügen.

Für die Transformation sind folgende Aggregationen verfügbar:

- Average

- Count

- Maximum

- Mindestanforderungen

- Perzentil (kontinuierlich und diskret)

- Standardabweichung

- Summe

- Varianz

So konfigurieren Sie die Transformation:

- Wählen Sie Ihre bevorzugte Aggregation aus.

- Wählen Sie das Feld aus, für das Sie die Aggregation durchführen möchten.

- Wählen Sie ein optionales Feld für „Gruppieren nach“ aus, wenn Sie die Aggregatberechnung für eine andere Dimension oder Kategorie durchführen möchten. Beispiel: Zustand.

- Wählen Sie Ihre Funktion für die Zeitfenster aus.

Um der gleichen Transformation eine weitere Aggregation hinzuzufügen, wählen Sie Aggregatfunktion hinzufügen aus. Denken Sie daran, dass das Gruppieren nach-Feld und die Fensterfunktion auf alle Aggregationen in der Transformation angewendet werden.

Ein Zeitstempel für das Ende des Zeitfensters wird zur Referenz als Teil der Transformationsausgabe angezeigt. Weitere Informationen zu den von Stream Analytics-Aufträgen unterstützten Zeitfenstern finden Sie unter Windowingfunktionen (Azure Stream Analytics).

Union

Verwenden Sie die Union-Transformation , um zwei oder mehr Eingaben zu verbinden. Fügen Sie Ereignisse mit gemeinsam genutzten Feldern (mit demselben Namen und Datentyp) in eine Tabelle hinzu. Die Ausgabe schließt Felder aus, die nicht übereinstimmen.

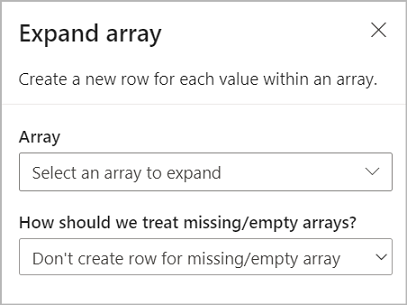

Array erweitern

Verwenden Sie die Transformation Array erweitern, um eine neue Zeile für jeden Wert in einem Array zu erstellen.

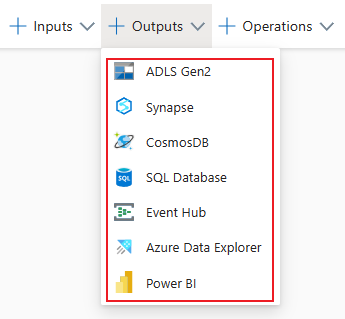

Streaming-Ausgaben

Die No-Code-Drag & Drop-Benutzeroberfläche unterstützt derzeit verschiedene Ausgabesenken zum Speichern Ihrer verarbeiteten Echtzeitdaten.

Azure Data Lake Storage Gen2

Mit Data Lake Storage Gen2 wird Azure Storage zur Grundlage für das Erstellen von Enterprise Data Lakes in Azure. Diese SKU ist darauf ausgelegt, mehrere Petabyte an Informationen bereitzustellen und gleichzeitig Hunderte von Gigabyte an Durchsatz zu unterstützen. Sie ermöglicht Ihnen die einfache Verwaltung großer Datenmengen. Azure Blob Storage bietet eine kostengünstige und skalierbare Lösung zum Speichern von großen Mengen unstrukturierter Daten in der Cloud.

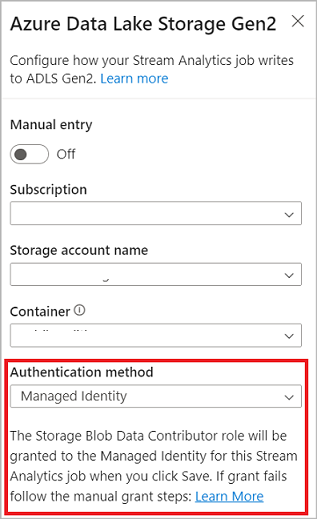

Wählen Sie im Menüband im Bereich Ausgaben die Option ADLS Gen2 als Ausgabe für Ihren Stream Analytics-Auftrag aus. Wählen Sie dann den Container aus, in den Sie die Ausgabe des Auftrags senden möchten. Weitere Informationen zur Azure Data Lake Gen2-Ausgabe für einen Stream Analytics-Auftrag finden Sie unter Blob Storage- und Azure Data Lake Gen2-Ausgabe von Azure Stream Analytics.

Wenn Sie eine Verbindung mit Azure Data Lake Storage Gen2 herstellen und Managed Identity als Authentifizierungsmodus auswählen, wird die Rolle "Speicher-Blob-Daten-Mitwirkender" der verwalteten Identität für den Stream Analytics-Auftrag zugewiesen. Weitere Informationen über verwaltete Identitäten für Azure Data Lake Storage Gen2 finden Sie unter Verwenden verwalteter Identitäten zum Authentifizieren Ihres Azure Stream Analytics-Auftrags für Azure Blob Storage.

Verwaltete Identitäten beseitigen die Einschränkungen von benutzerbasierten Authentifizierungsmethoden. Zu diesen Einschränkungen gehört, dass Sie sich neu authentifizieren müssen, wenn sich das Kennwort ändert oder das Benutzertoken alle 90 Tage abläuft.

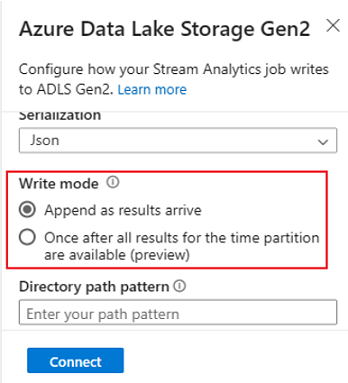

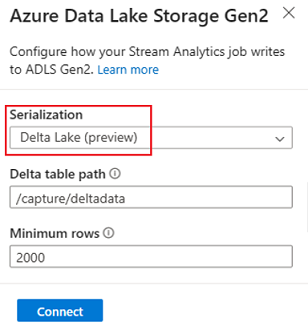

Zustellung vom Typ „Genau einmal“ (Vorschau) wird in ADLS Gen2 als Ausgabe des No-Code-Editors unterstützt. Das Feature kann im Abschnitt Schreibmodus der ADLS Gen2-Konfiguration aktiviert werden. Weitere Informationen zu diesem Feature finden Sie unter Exactly once delivery (preview) in Azure Data Lake Gen2.

Schreiben in eine Delta Lake-Tabelle (Vorschau) wird in ADLS Gen2 als Ausgabe des No-Code-Editors unterstützt. Auf diese Option kann im Abschnitt Serialisierung der ADLS Gen2-Konfiguration zugegriffen werden. Weitere Informationen zu diesem Feature finden Sie unter Azure Stream Analytics: Schreiben in eine Delta Lake-Tabelle.

Azure Synapse Analytics

Azure Stream Analytics-Aufträge können die Ausgabe an eine spezielle SQL-Pooltabelle in Azure Synapse Analytics senden und Durchsatzraten von bis zu 200 MB pro Sekunde verarbeiten. Stream Analytics unterstützt die anspruchsvollsten Echtzeitanalysen und Datenverarbeitungsanforderungen für den langsamsten Pfad für Workloads wie Berichterstellung und Dashboarding.

Wichtig

Die dedizierte SQL-Pooltabelle muss vorhanden sein, bevor Sie sie Ihrem Stream Analytics-Auftrag als Ausgabe hinzufügen können. Das Schema der Tabelle muss den Feldern und deren Typen in der Ausgabe Ihres Jobs entsprechen.

Wählen Sie im Menüband im Bereich Ausgaben die Option Synapse als Ausgabe für Ihren Stream Analytics-Auftrag aus. Wählen Sie dann die SQL-Pooltabelle aus, in die Sie die Ausgabe des Auftrags senden möchten. Weitere Informationen zur Azure Synapse-Ausgabe für einen Stream Analytics-Auftrag finden Sie unter Azure Synapse Analytics-Ausgabe für Azure Stream Analytics.

Azure Cosmos DB

Azure Cosmos DB ist ein global verteilter Datenbankdienst, der eine unbegrenzte elastische Skalierung rund um den Globus bietet. Außerdem bietet es umfangreiche Abfragen und automatische Indizierung über schemaunabhängige Datenmodelle.

Wählen Sie im Menüband im Bereich Ausgaben die Option CosmosDB als Ausgabe für Ihren Stream Analytics-Auftrag aus. Weitere Informationen zur Azure Cosmos DB-Ausgabe für einen Stream Analytics-Auftrag finden Sie unter Azure Cosmos DB-Ausgabe von Azure Stream Analytics.

Wenn Sie eine Verbindung mit Azure Cosmos DB herstellen und Managed Identity als Authentifizierungsmodus auswählen, wird der verwalteten Identität die Rolle "Mitwirkender" für den Stream Analytics-Auftrag gewährt. Weitere Informationen über verwaltete Identitäten für Azure Cosmos DB finden Sie unter Verwenden von verwalteten Identitäten für den Zugriff auf Azure Cosmos DB aus einem Azure Stream Analytics-Auftrag (Vorschau).

Die Azure Cosmos DB Ausgabe im No-Code-Editor unterstützt auch die Authentifizierungsmethode für verwaltete Identitäten. Diese Methode bietet dieselben Vorteile wie in der ADLS Gen2-Ausgabe.

Azure SQL-Datenbank

Azure SQL-Datenbank ist eine vollständig verwaltete Plattform als PaaS-Datenbankmodul, mit der Sie in Azure eine hoch verfügbare und leistungsstarke Datenspeicherebene für Anwendungen und Lösungen erstellen können. Mithilfe des No-Code-Editors können Sie Azure Stream Analytics-Aufträge so konfigurieren, dass die verarbeiteten Daten in eine bestehende Tabelle in der SQL-Datenbank geschrieben werden.

Um Azure SQL-Datenbank als Ausgabe zu konfigurieren, wählen Sie SQL-Datenbank unter dem Abschnitt Ausgaben im Menüband aus. Geben Sie dann die informationen ein, die zum Herstellen einer Verbindung mit Ihrer SQL-Datenbank erforderlich sind, und wählen Sie die Tabelle aus, in die Sie Daten schreiben möchten.

Wichtig

Die Azure SQL-Datenbank-Tabelle muss vorhanden sein, bevor Sie sie Ihrem Stream Analytics-Auftrag als Ausgabe hinzufügen können. Das Schema der Tabelle muss den Feldern und deren Typen in der Ausgabe Ihres Jobs entsprechen.

Weitere Informationen zur Azure SQL-Datenbank-Ausgabe für einen Stream Analytics-Auftrag finden Sie unter Azure SQL-Datenbank-Ausgabe für Azure Stream Analytics.

Event Hubs

Mit Echtzeitdaten, die an ASA weitergeleitet werden, kann der No-Code-Editor die Daten transformieren und anreichern und dann die Daten an einen anderen Event Hub ausgeben. Sie können die Event Hub-Ausgabe auswählen, wenn Sie Ihren Azure Stream Analytics-Auftrag konfigurieren.

Um Event Hubs als Ausgabe zu konfigurieren, wählen Sie " Event Hub " unter dem Abschnitt "Ausgaben " im Menüband aus. Geben Sie dann die Informationen ein, die zum Herstellen einer Verbindung mit Ihrem Event Hub erforderlich sind, in den Sie Daten schreiben möchten.

Weitere Informationen zur Event Hubs-Ausgabe für einen Stream Analytics-Auftrag finden Sie unter Event Hubs-Ausgabe für Azure Stream Analytics.

Azure-Daten-Explorer

Azure Data Explorer ist eine vollständig verwaltete, leistungsstarke Big Data-Analyseplattform, die das Analysieren großer Datenmengen vereinfacht. Sie können Azure Data Explorer auch als Ausgabe für Ihren Azure Stream Analytics Auftrag verwenden, indem Sie den no-code Editor verwenden.

Um Azure Data Explorer als Ausgabe zu konfigurieren, wählen Sie Azure Data Explorer unter dem Abschnitt Outputs im Menüband aus. Geben Sie dann die erforderlichen Informationen ein, um eine Verbindung mit Ihrer Azure Data Explorer-Datenbank herzustellen, und geben Sie die Tabelle an, in die Sie Daten schreiben möchten.

Wichtig

Die Tabelle muss in der von Ihnen gewählten Datenbank existieren und das Schema der Tabelle muss genau mit den Feldern und deren Typen in der Ausgabe Ihres Auftrags übereinstimmen.

Weitere Informationen zur Azure Data Explorer-Ausgabe für einen Stream Analytics-Auftrag finden Sie unter Azure Data Explorer-Ausgabe von Azure Stream Analytics (Vorschau).

Power BI

Power BI bietet eine umfassende Visualisierungsumgebung für die Ergebnisse Ihrer Datenanalyse. Wenn Sie die Power BI-Ausgabe für Stream Analytics verwenden, werden die verarbeiteten Streamingdaten in ein Power BI-Streaming-Dataset geschrieben, und anschließend können Sie es verwenden, um das nahezu echtzeitbasierte Power BI-Dashboard zu erstellen.

Um Power BI als Ausgabe zu konfigurieren, wählen Sie Power BI unter dem Abschnitt Outputs im Menüband aus. Geben Sie dann die erforderlichen Informationen ein, um eine Verbindung mit Ihrem Power BI Arbeitsbereich herzustellen, und geben Sie die Namen für das Streaming-Dataset und die Tabelle an, in die Sie die Daten schreiben möchten. Mehr über die Details der einzelnen Felder erfahren Sie unter Power BI-Ausgabe für Azure Stream Analytics.

Datenvorschau, Erstellungsfehler, Runtimeprotokolle und Metriken

Die No-Code-Drag & Drop-Benutzeroberfläche bietet Tools, mit denen Sie Ihre Analysepipeline für Streamingdaten erstellen, Probleme beheben sowie die Leistung der Pipeline bewerten können.

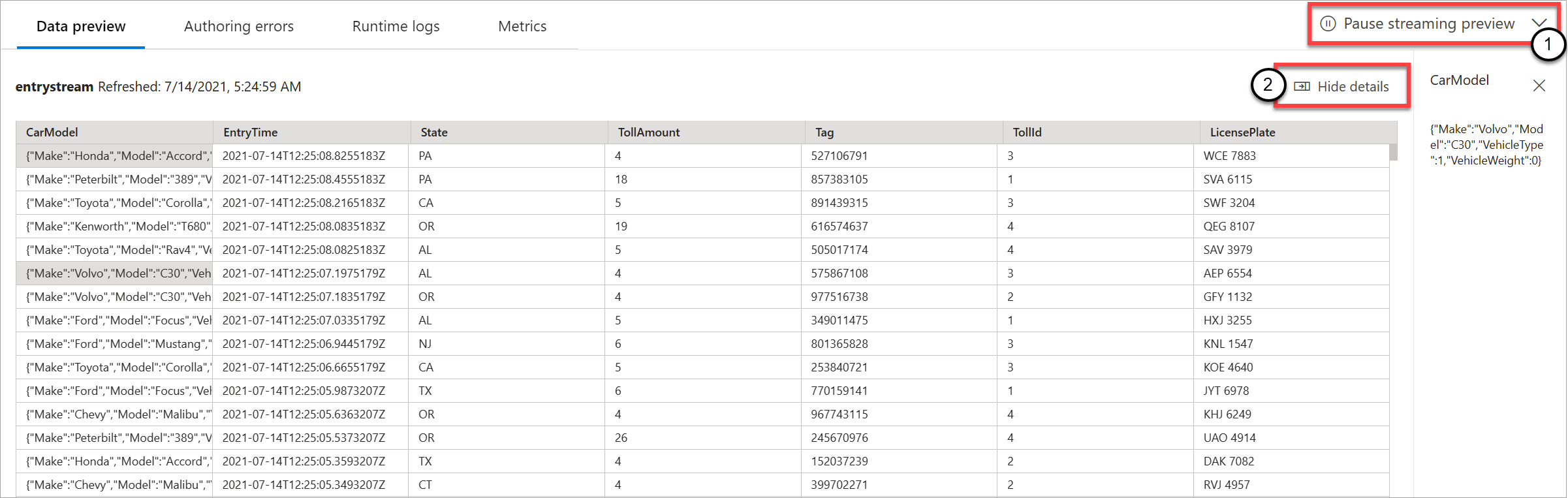

Livedatenvorschau für Eingaben

Wenn Sie eine Verbindung mit einer Eingabequelle herstellen, z. B. einem Event Hub, und wählen Sie die Kachel in der Diagrammansicht (registerkarte " Datenvorschau ") aus, wird eine Livevorschau der eingehenden Daten angezeigt, wenn alle folgenden Bedingungen zutreffen:

- Daten werden per Push übertragen.

- Die Eingabe ist ordnungsgemäß konfiguriert.

- Felder werden hinzugefügt.

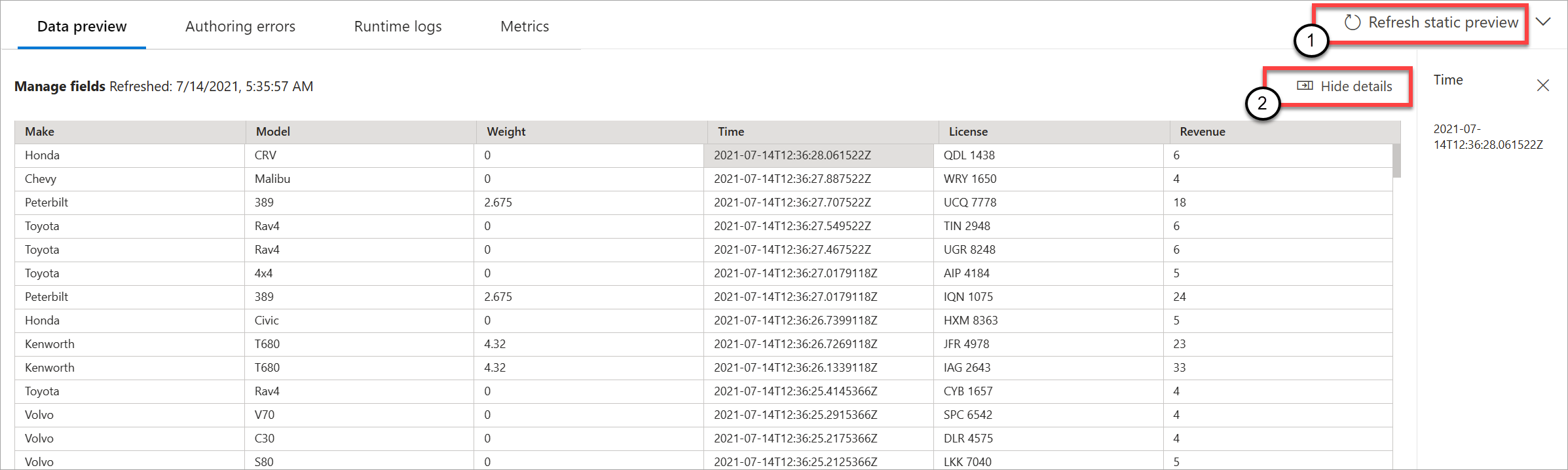

Wie im folgenden Screenshot zu sehen, können Sie die Vorschau (1) anhalten, wenn Sie etwas Bestimmtes anzeigen oder einen Drilldown ausführen möchten. Oder Sie können sie erneut starten, wenn Sie fertig sind.

Sie können auch die Details eines bestimmten Datensatzes, d. h. einer Zelle in der Tabelle, anzeigen, indem Sie ihn auswählen und dann Details anzeigen/ausblenden (2) auswählen. Der Screenshot zeigt die detaillierte Ansicht eines geschachtelten Objekts in einem Datensatz.

Statische Vorschau für Transformationen und Ausgaben

Nachdem Sie Schritte in der Diagrammansicht hinzugefügt und eingerichtet haben, können Sie deren Verhalten testen, indem Sie die Schaltfläche Statische Vorschau abrufen auswählen.

Wenn Sie die Schaltfläche auswählen, wertet der Stream Analytics-Auftrag alle Transformationen und Ausgaben aus, um sicherzustellen, dass sie ordnungsgemäß konfiguriert sind. Stream Analytics zeigt die Ergebnisse dann wie in der folgenden Abbildung gezeigt in der statischen Datenvorschau an.

Sie können die Vorschau aktualisieren, indem Sie Statische Vorschau aktualisieren (1) auswählen. Wenn Sie die Vorschau aktualisieren, übernimmt der Stream Analytics-Auftrag neue Daten aus der Eingabe und wertet alle Transformationen aus. Dann sendet sie die Ausgabe erneut mit allen Aktualisierungen, die Sie möglicherweise vorgenommen haben. Die Option Details ein-/ausblenden ist ebenfalls verfügbar (2).

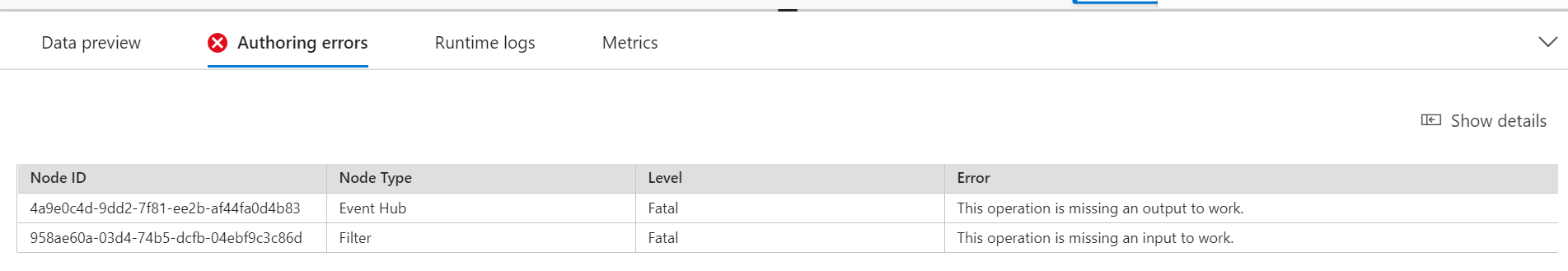

Erstellungsfehler

Wenn Sie Erstellungsfehler oder Warnungen haben, werden diese auf der Registerkarte Autorenfehler aufgelistet, wie im folgenden Screenshot gezeigt. Die Liste enthält Details zum Fehler bzw. zur Warnung, zum Kartentyp (Eingabe, Transformation oder Ausgabe) und zur Fehlerstufe sowie eine Beschreibung des Fehlers bzw. der Warnung.

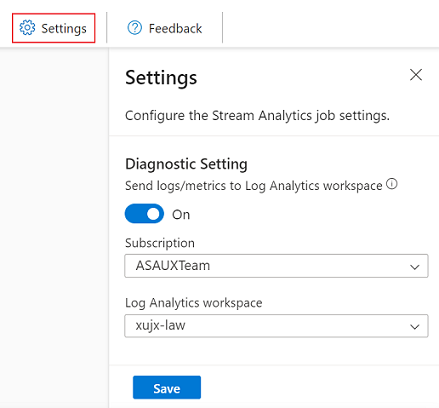

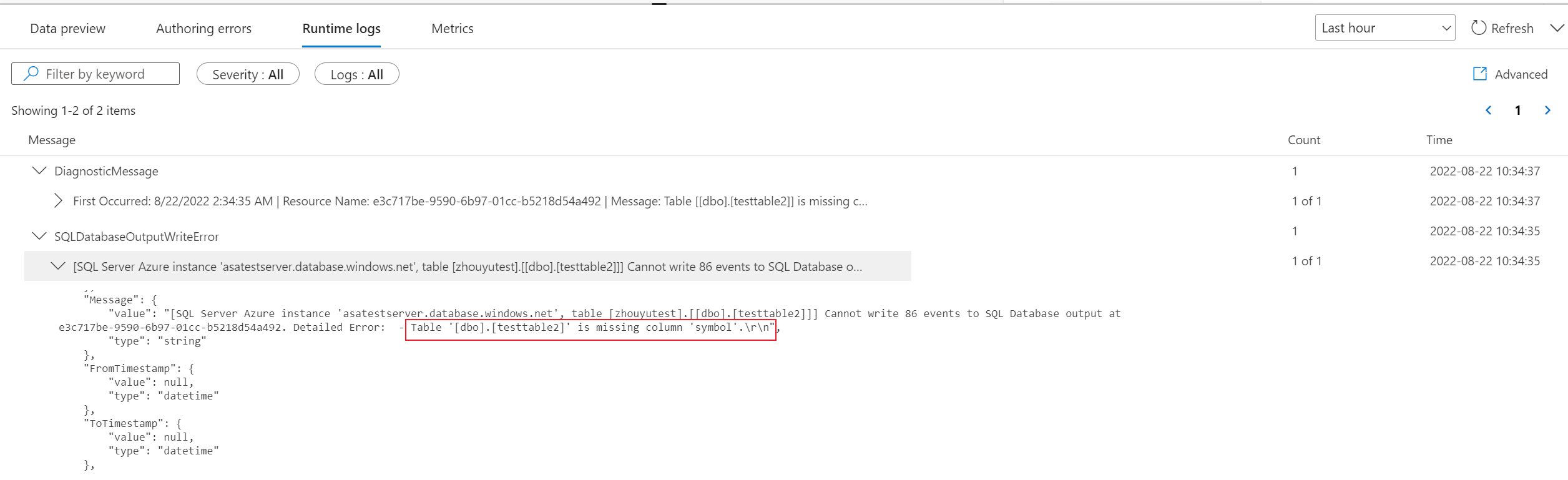

Runtimeprotokolle

Laufzeitprotokolle werden auf der Warn-, Fehler- oder Informationsebene angezeigt, wenn ein Auftrag ausgeführt wird. Diese Protokolle sind hilfreich, wenn Sie die Topologie oder Konfiguration Ihres Stream Analytics-Auftrags für die Problembehandlung bearbeiten möchten. Aktivieren Sie Diagnoseprotokolle, und senden Sie sie an Log Analytics Arbeitsbereich in Settings, um weitere Einblicke in Ihre ausgeführten Aufträge zum Debuggen zu erhalten.

Im folgenden Screenshotbeispiel konfiguriert der Benutzer die SQL-Datenbankausgabe mit einem Tabellenschema, das nicht mit den Feldern der Auftragsausgabe übereinstimmt.

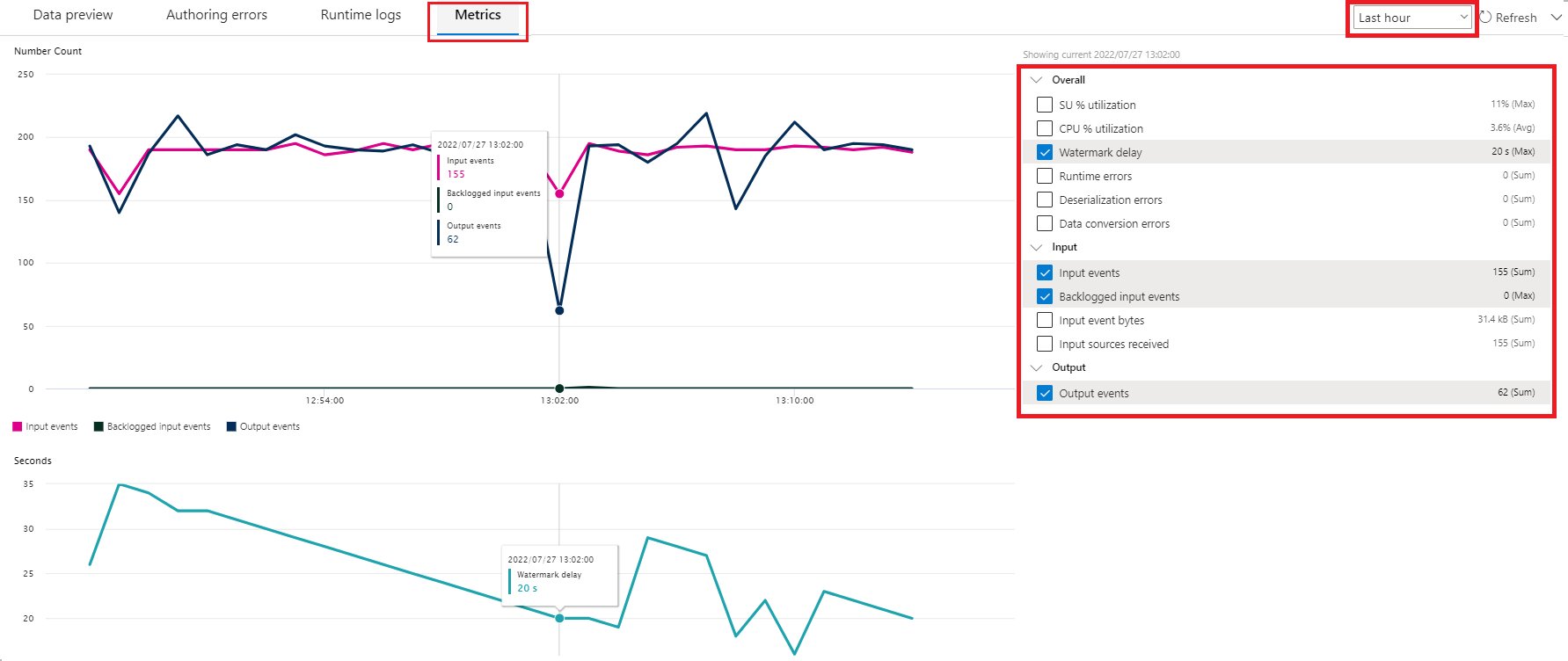

Metriken

Wenn der Auftrag ausgeführt wird, können Sie die Integrität Ihres Auftrags auf der Registerkarte Metriken überwachen. Die vier standardmäßig angezeigten Metriken sind Wasserzeichenverzögerung, Eingabeereignisse, Noch nicht verarbeitete Eingabeereignisse und Ausgabeereignisse. Verwenden Sie diese Metriken, um zu verstehen, ob die Ereignisse ohne Rückstau in der Eingabe in den und aus dem Einzelvorgang fließen.

Sie können weitere Metriken aus der Liste auswählen. Informationen zu allen Metriken im Detail finden Sie unter Azure Stream Analytics-Auftragsmetriken.

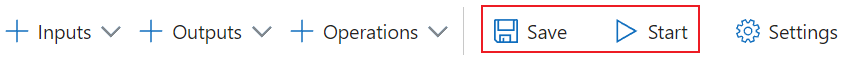

Starten eines Stream Analytics-Auftrags

Sie können den Auftrag beim Erstellen jederzeit speichern. Nachdem Sie die Streamingeingaben, Transformationen und die Streamingausgaben für den Auftrag konfiguriert haben, können Sie den Auftrag starten.

Hinweis

Obwohl sich der No-Code-Editor im Azure Stream Analtyics-Portal noch in der Vorschau befindet, ist der Azure Stream Analytics-Dienst allgemein verfügbar.

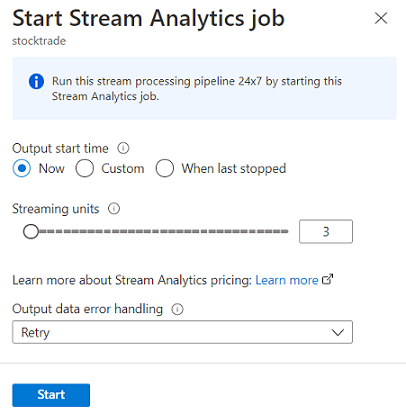

Sie können folgende Optionen konfigurieren:

-

Ausgabeanfangszeit: Wenn Sie einen Auftrag starten, wählen Sie eine Zeit für den Auftrag aus, um mit dem Erstellen der Ausgabe zu beginnen.

- Jetzt: Mit dieser Option wird der Startpunkt des Ausgabeworkflows auf den gleichen Zeitpunkt wie der Beginn des Jobs festgesetzt.

- Benutzerdefiniert: Wählen Sie den Ausgangspunkt der Ausgabe aus.

- Zeitpunkt der letzten Beendigung: Diese Option ist verfügbar, wenn der Auftrag bereits gestartet wurde, jedoch entweder manuell oder durch einen Fehler beendet wurde. Wenn Sie diese Option auswählen, wird die letzte Ausgabezeit verwendet, um den Auftrag neu zu starten, sodass keine Daten verloren gehen.

- Streamingeinheiten: Streamingeinheiten (SUs) repräsentieren die zugewiesene Menge an Rechen- und Arbeitsspeicher, die einem Auftrag während seiner Ausführung zur Verfügung steht. Wenn Sie nicht sicher sind, wie viele SUs sie auswählen sollen, beginnen Sie mit drei, und passen Sie sie nach Bedarf an.

- Fehlerbehandlung für Ausgabedaten: Richtlinien für die Fehlerbehandlung für Ausgabedaten gelten nur, wenn das von einem Stream Analytics-Auftrag generierte Ausgabeereignis nicht dem Schema der Zielsenke entspricht. Konfigurieren Sie die Richtlinie, indem Sie entweder "Wiederholen" oder "Ablegen" auswählen. Weitere Informationen finden Sie unter Azure Stream Analytics-Ausgabefehlerrichtlinie.

- Start: Mit dieser Schaltfläche starten Sie den Stream Analytics-Auftrag.

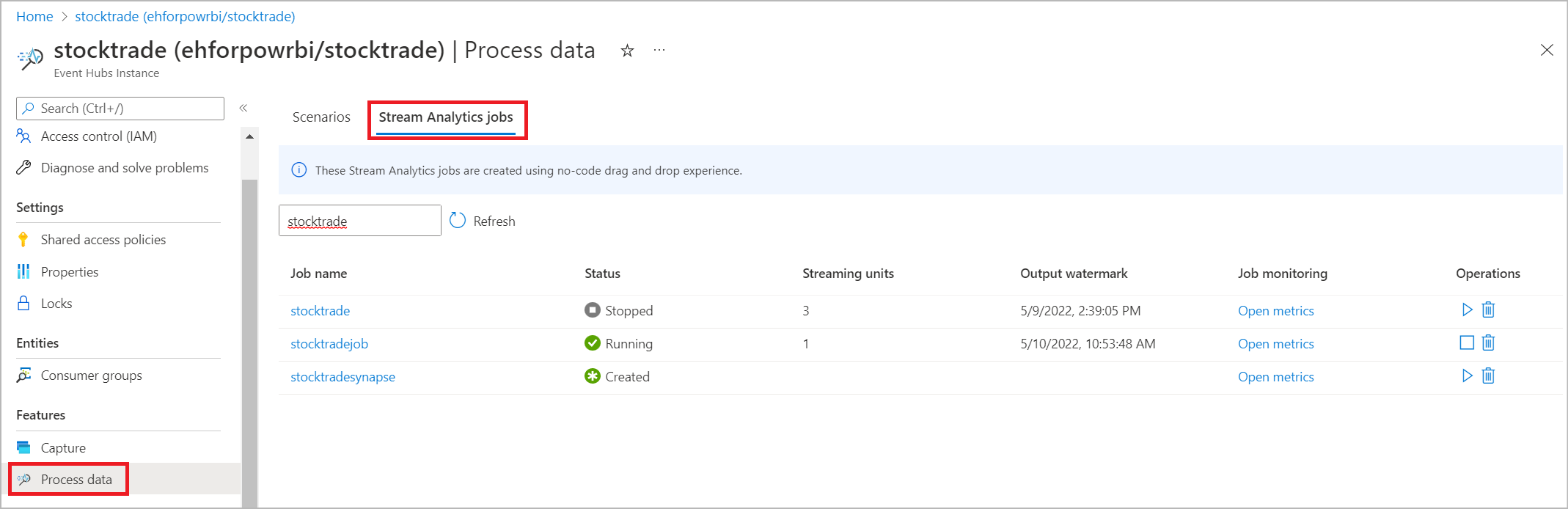

Stream Analytics-Auftragsliste in Azure Event Hubs-Portal

Um eine Liste aller Stream Analytics-Aufträge anzuzeigen, die Sie mithilfe der Drag & Drop-Funktion ohne Code im Azure Event Hubs-Portal erstellt haben, wählen Sie Daten verarbeiten>Stream Analytics-Aufträge aus.

Hier sind die Elemente der Registerkarte "Stream Analytics-Aufträge ":

- Filter: Filtern Sie die Liste nach Auftragsname.

- Aktualisieren: Derzeit wird die Liste nicht automatisch aktualisiert. Verwenden Sie die Schaltfläche Aktualisieren, um die Liste zu aktualisieren und den aktuellen Status anzuzeigen.

- Auftragsname: Der Name in diesem Bereich ist der Name, den Sie im ersten Schritt der Auftragserstellung angeben. Du kannst es nicht bearbeiten. Wählen Sie den Auftragsnamen aus, um den Auftrag in der No-Code-Drag & Drop-Benutzeroberfläche zu öffnen, wo Sie ihn beenden, bearbeiten und erneut starten können.

- Status: Dieser Bereich zeigt den Status des Auftrags an. Wählen Sie oben in der Liste die Option Aktualisieren aus, um den aktuellen Status anzuzeigen.

- Streamingeinheiten: In diesem Bereich wird die Anzahl der Streamingeinheiten angezeigt, die Sie beim Starten des Auftrags auswählen.

- Ausgabewasserzeichen: Dieser Bereich bietet einen Indikator für die Aktualität der Daten, die der Einzelvorgang erzeugt hat. Alle Ereignisse vor dem Zeitstempel sind bereits berechnet.

- Auftragsüberwachung: Wählen Sie Metriken öffnen aus, um die Metriken im Zusammenhang mit dem Stream Analytics-Auftrag anzuzeigen. Weitere Informationen zu den Metriken, die Sie zum Überwachen Ihres Stream Analytics-Auftrags verwenden können, finden Sie unter Azure Stream Analytics-Auftragsmetriken.

- Vorgänge: Sie können den Auftrag starten, beenden oder löschen.

Nächste Schritte

Erfahren Sie, wie Sie den No-Code-Editor mit vordefinierten Vorlagen für gängige Szenarien verwenden: