Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

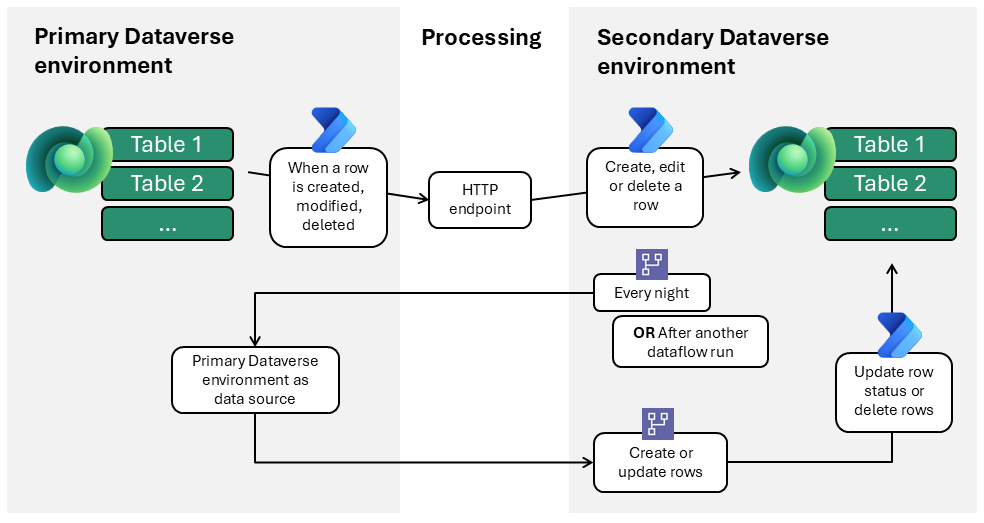

Diese Referenzarchitektur zeigt, wie Masterdaten zwischen zwei Dataverse-Umgebungen mithilfe von Power Automate und Datenflüssen in Power Platform synchronisiert werden. Es veranschaulicht ein 1:1-Synchronisierungsmuster, bei dem eine Umgebung als autoritative Quelle fungiert und eine andere Daten empfängt.

Tip

Dieser Artikel enthält ein Beispielszenario und eine generalisierte Beispielarchitektur, um zu veranschaulichen, wie Masterdaten in einer Dataverse-Umgebung verwaltet und mit einer anderen synchronisiert werden. Das Architekturbeispiel kann für viele verschiedene Szenarien und Branchen modifiziert werden.

Architekturdiagramm

Arbeitsablauf

In den folgenden Schritten wird der Workflow im Beispielarchitekturdiagramm beschrieben:

Event-gesteuerte Synchronisierung über Power Automate

CRUD-Vorgänge (Erstellen, Lesen, Aktualisieren, Löschen) in der primären Dataverse-Umgebung lösen Power Automate Flows aus.

Die ereignisgesteuerte Synchronisierung verwendet eine Ablaufkette in zwei Schritten:

- Ein Cloudfluss sendet einen HTTP POST an einen veröffentlichten Endpunkt.

- Ein Abonnenten-Cloudfluss wird durch den Webhook ausgelöst, verarbeitet die Nutzlast und wendet das Update in der sekundären Dataverse-Umgebung in nahezu Echtzeit an.

Endpunkte werden für die Anwendungslebenszyklusverwaltung (APPLICATION Lifecycle Management, ALM) parametrisiert, und Sicherheitsgruppen verwalten den Zugriff.

Massensynchronisierung über Datenflüsse

Die sekundäre Dataverse-Umgebung enthält die Datenflüsse.

Jeder Datenfluss stellt eine Verbindung mit der primären Dataverse-Umgebung als Datenquelle bereit.

Datenflüsse werden in einem festen Zeitplan ausgeführt (z. B. nachts oder nach erfolgreicher Ausführung eines anderen Datenflusses) oder bei Bedarf (z. B. für die ersteinrichtung).

Upserts werden mithilfe eines alternativen Schlüssels ausgeführt, um Duplikate zu vermeiden. Diese Methode aktualisiert vorhandene Daten und fügt neue Datensätze ein, wenn keine Übereinstimmung vorhanden ist.

Statusfelder werden über eine dedizierte Spalte "Synchronisierungsstatus" verwaltet. Ein Power Automate-Flow aktualisiert das tatsächliche Statusfeld entsprechend. Dieser Fluss wird nach dem Datenfluss ausgeführt und ist erforderlich, da ein Datenfluss Zeilenstatus nicht ändern oder Datensätze löschen kann, die in der primären Dataverse-Umgebung entfernt (nicht vorhanden) werden.

Fehlerbehandlung und Datenabgleich

Nächtliche Datenflüsse in der sekundären Umgebung korrigieren verpasste oder fehlgeschlagene ereignisgesteuerte Aktualisierungen.

Ein manueller Eingriff kann für Probleme mit der Datenqualität erforderlich sein (z. B. fehlende Schlüssel).

Komponenten

Microsoft Dataverse: Unterstützt die Anforderung aus zwei Umgebungen.

Datenflüsse für Power Platform: Ideal für Massenvorgänge, z. B. anfängliche Datenpopulation und Synchronisierung. Verwenden Sie die Massenextraktion, Transformation und den Ladevorgang (ETL) für die geplante Synchronisierung, die in der sekundären Umgebung konfiguriert ist.

Power Automate Cloud flows: Bereitstellen schneller, datensatzspezifischer Updates und Ausgleich von Einschränkungen von Datenflüssen. Cloudflüsse können einen Datenfluss auslösen, wenn ein anderer Datenfluss erfolgreich abgeschlossen wird (z. B. wenn eine Tabelle ein Nachschlagefeld enthält, und dieser referenzierte Datensatz muss bereits in der sekundären Dataverse-Umgebung vorhanden sein), eine Fehlermeldung senden, wenn ein Datenfluss fehlschlägt, Datensatzstatus aktualisiert und Datensätze gelöscht wird.

Sicherheitsgruppen und Dienstkonten: Sorgen für Zugriffsverwaltung und Eigentumskontrolle.

Details zum Szenario

Diese Architektur ist für eine 1:1-Beziehung konzipiert: eine einzelne Master Data Management (MDM)-Umgebung, die mit einer anderen einzelnen Umgebung verknüpft ist. Szenarien, in denen eine Masterumgebung mit mehreren anderen Umgebungen synchronisiert werden muss, erfordern eine skalierbarere oder verteilte Lösung.

Geschäftsproblem

Diese Lösung behebt die Herausforderung, mehrere Tabellen zwischen zwei unterschiedlichen Dataverse-Umgebungen zu synchronisieren. Die primäre Umgebung fungiert als autoritative Quelle, während die sekundäre Umgebung vorhandene Tabellen enthält, die Sie mit Masterdaten auffüllen und aktualisieren müssen.

Die Verwendung virtueller Tabellen ist nicht machbar, wenn die Tabellen des sekundären Systems bereits vorhanden sind und die Sicherheit auf Zeilenebene erfordern.

Exemplarischer Anwendungsfall

Eine Freizeit- und Gastgewerbeorganisation verwaltet ihre Kernstammdaten wie Hotels und Rauminventaren in einer dedizierten Dataverse-Umgebung. Die primäre Umgebung umfasst eine modellgesteuerte App, die das Stammdatenverwaltungsteam ausschließlich verwendet, um genaue und aktuelle betriebliche Informationen zu pflegen.

Eine separate Abteilung innerhalb derselben Organisation ist für mehrere Finanz- und Abstimmungsprozesse verantwortlich. Um diese Prozesse zu optimieren, möchte die Abteilung eine eigene modellgesteuerte App in einer isolierten Dataverse-Umgebung erstellen. Ihre Anwendung erfordert jedoch weiterhin Zugriff auf grundlegende Stammdaten wie Hotel- und Raumdetails.

Das Team lehnte virtuelle Tabellen ab, da das Finanzteam Datensätze mit abteilungsspezifischen Attributen anreichern musste, die von strenger Sicherheit auf Zeilenebene gesteuert werden.

Das Einbetten der Finanz-App in die primäre MDM-Umgebung ist auch keine Option. Wenn Finanzentwickler oder -administratoren Zugang zur MDM-Umgebung erhalten, werden Connectors, Lösungen, API-Berechtigungen und vertrauliche Daten offengelegt, die auf das MDM-Entwicklungsteam beschränkt sein müssen.

Diese Anforderungen führten die Organisation dazu, die in diesem Artikel beschriebene Synchronisierungsarchitektur zu übernehmen.

Erstellter Wert

Diese Architektur bietet eine robuste, wartungsfähige Lösung zum Synchronisieren von Masterdaten zwischen zwei Dataverse-Umgebungen, wenn virtuelle Tabellen keine Option sind. Das direkte Auffüllen und Aktualisieren vorhandener Tabellen in der sekundären Umgebung sorgt für Konsistenz und Betriebssicherheit.

Der Ansatz verwendet nur Power Platform-Komponenten, z. B. Datenflüsse und Power Automate, was zu einer lösung führt, die einfach bereitzustellen, einfach zu verwalten ist und unnötige Komplexität vermeidet.

Da die Architektur auf eine 1:1-Umgebungsbeziehung zugeschnitten ist, wird der Aufwand minimiert und die Transparenz maximiert. Es ist ideal für Organisationen, die eine einfache, zuverlässige Masterdatensynchronisierung ohne umfangreiche Verwaltung mit mehreren Umgebungen benötigen.

Considerations

Diese Überlegungen implementieren die Säulen von Power Platform Well-Architected, eine Reihe von Leitprinzipien, welche die Qualität einer Workload verbessern. Weitere Informationen finden Sie in Microsoft Power Platform Well-Architected.

Reliability

Nächtliche Datenflüsse sorgen für Konsistenz.

Ereignisgesteuerte Abläufe liefern schnelle Updates.

Die manuelle Überwachung erkennt Probleme mit der Datenqualität.

Sicherheit

Dienstkonten und Sicherheitsgruppen für die Zugriffssteuerung. Wenn Sie Datenflüsse verwenden, können Sie Dienstprinzipalen nicht als Besitzer zuweisen.

Parametrisierte HTTP-Endpunkte für ALM-Kompatibilität.

Datenflüsse in isolierten Lösungen, um unnötige manuelle Arbeit zu vermeiden. Es gibt einen bestimmten Grund zum Isolieren von Datenflüssen in einer dedizierten Lösung: Nach jeder Bereitstellung müssen Sie die Datenflussverbindung manuell neu einrichten. Indem Sie Datenflüsse in eine separate Lösung einfügen, die Sie nur bereitstellen, wenn Sie die Datenflüsse ändern, vermeiden Sie unnötige manuelle Arbeit beim Bereitstellen anderer Komponenten der Hauptlösung.

Betriebliche Effizienz

Automatisierte Planung und Orchestrierung von Datenflüssen.

Überwachung und Warnung für fehlgeschlagene Synchronisierungen.

Leistungseffizienz

Datenflüsse, die für Massenvorgänge optimiert sind.

Ereignisgesteuerte Power Automate Flüsse minimieren die Latenz für kritische Aktualisierungen auf Datensatzebene. Stellen Sie beim Entwerfen ereignisgesteuerter Flüsse sicher, dass das Aktionsvolumen und die Parallelität innerhalb der Power Automate Dienstgrenzen bleiben. Hochfrequenz-CRUD-Aktivität kann Drosselung auslösen, insbesondere in Szenarien, in denen Flüsse zehntausende Aktionen pro Tag ausführen. Wenden Sie für unternehmenskritische Integrationen oder solche mit hohem Durchsatz eine geeignete Power Automate-Lizenzierung an, um die Durchsatzgrenzwerte zu erhöhen und eine unerwartete Drosselung zu vermeiden. Dieser Ansatz reduziert Eskalationsrisiken und sorgt für vorhersehbare Leistung.

Erlebnisoptimierung

Erfordert einen minimalen manuellen Eingriff.

Trennt Massensynchronisierungen und ereignisgesteuerte Synchronisierungen eindeutig.

Beitragende

Microsoft verwaltet diesen Artikel. Die folgenden Mitwirkenden haben diesen Artikel geschrieben.

Hauptautoren:

- Lothar van Diessen, Solution Architect

Zugehörige Ressourcen

- Was sind Datenflüsse?

- Power Automate Vorlagen für den Datenfluss-Connector

- Dataverse als Stammdatensystem

- Plattformgrenzen verstehen und Drosselung vermeiden

- CRM-Datenmigration zu Dataverse: Wichtige Erkenntnisse und bewährte Methoden

- Migrieren Sie Daten zwischen Microsoft Dataverse-Umgebungen mithilfe des OData-Konnektors für Dataflows