Implementación de consultas para predicciones de intención

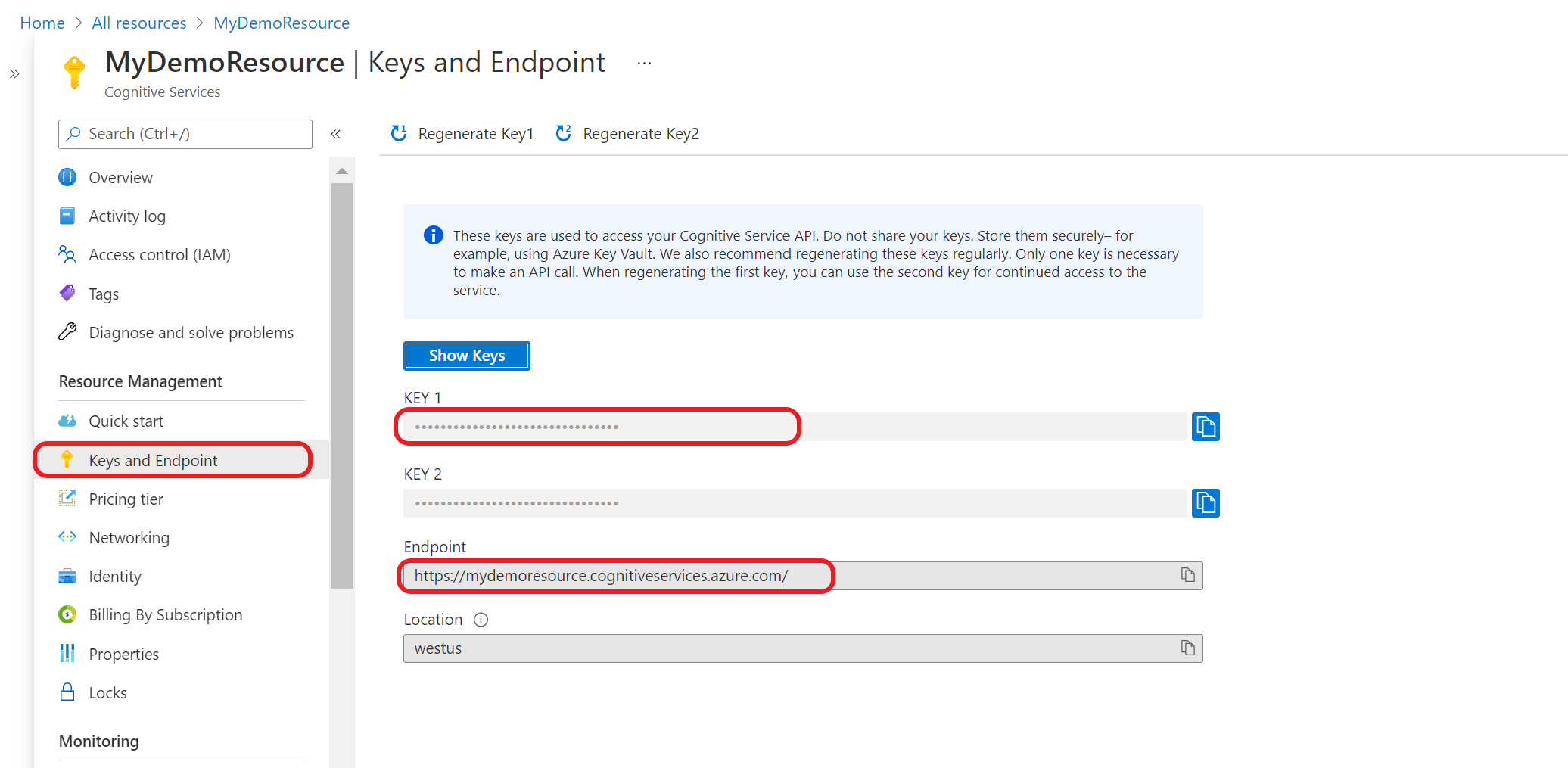

Después de agregar la implementación correctamente, puede consultar la implementación predicciones de intención y de entidades de la expresión en función del modelo asignado a dicha implementación. Para consultarla, puede hacerlo mediante programación usando la Prediction API o a través de bibliotecas de cliente (SDK de Azure).

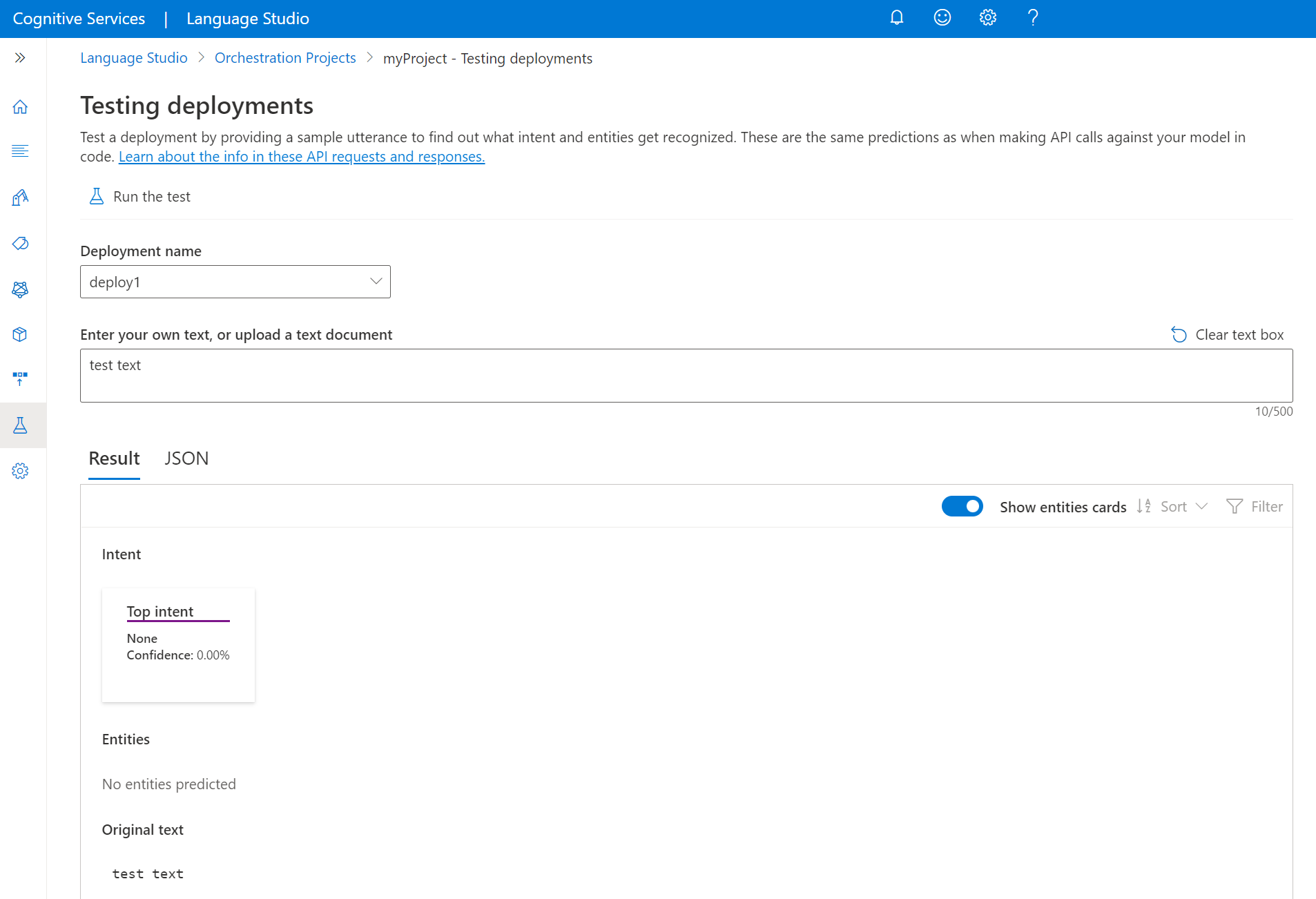

Puede usar Language Studio para enviar una expresión, obtener predicciones y visualizar los resultados.

Para probar el modelo desde Language Studio

Seleccione Prueba de implementaciones en el menú lateral izquierdo.

Seleccione el modelo que quiera probar. Solo se pueden probar modelos que estén asignados a implementaciones.

En la lista desplegable nombre de implementación, seleccione el nombre de la implementación.

En el cuadro de texto, escriba una expresión que se va a probar.

En el menú superior, seleccione Ejecutar la prueba.

Después de ejecutar la prueba, debería ver la respuesta del modelo en el resultado. Puede ver los resultados en la vista de tarjetas de entidades o verlo en formato JSON.

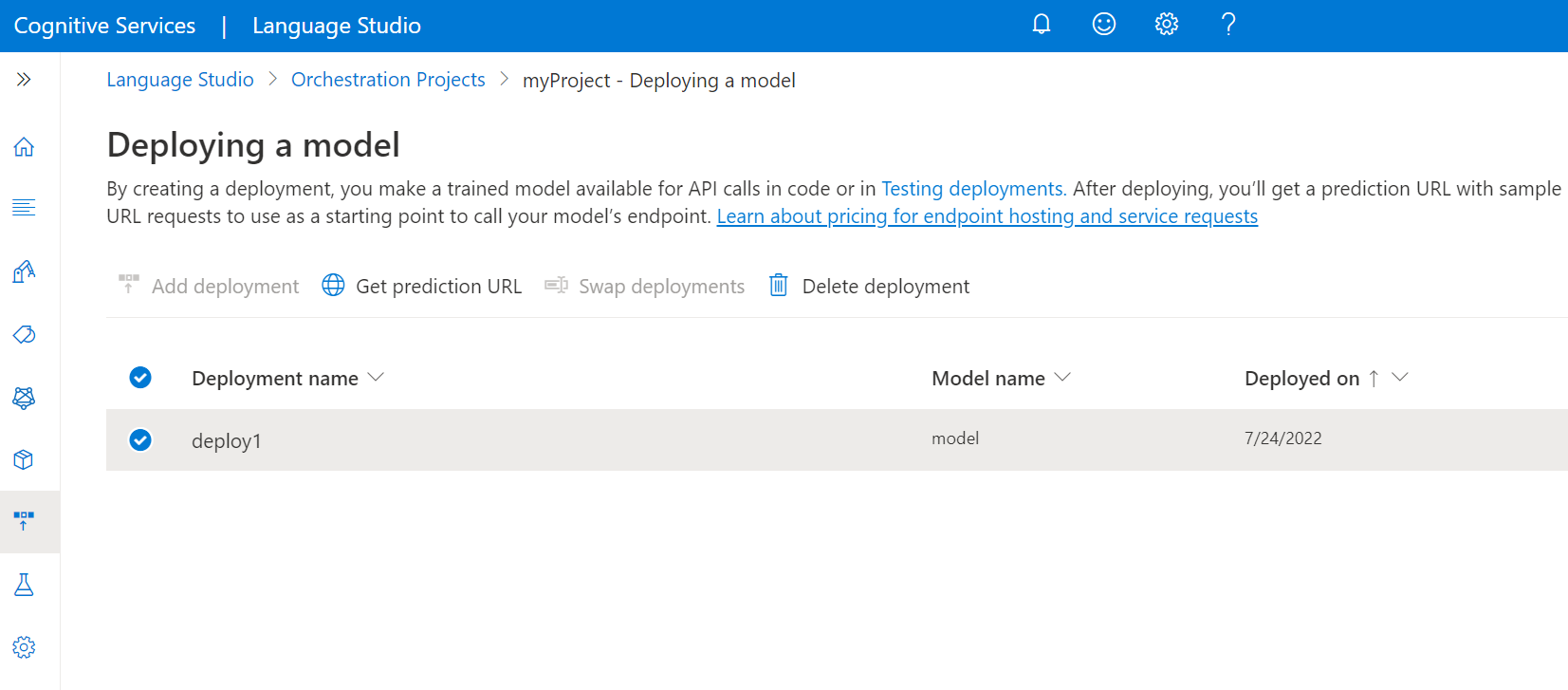

Cuando el trabajo de implementación finalice correctamente, seleccione la implementación que desea usar y, en el menú superior, seleccione Get prediction URL (Obtener dirección URL de predicción).

En la ventana que aparece, copie la URL y el cuerpo de la solicitud de ejemplo en la línea de comandos. Reemplace

<YOUR_QUERY_HERE>por el texto real que desea enviar para extraer intenciones y entidades.Envíe la solicitud cURL

POSTen el terminal o en el símbolo del sistema. Recibirá una respuesta 202 con los resultados de la API si la solicitud se ha realizado correctamente.