Nota

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

SE APLICA A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Sugerencia

Data Factory en Microsoft Fabric es la próxima generación de Azure Data Factory, con una arquitectura más sencilla, inteligencia artificial integrada y nuevas características. Si no está familiarizado con la integración de datos, comience con Fabric Data Factory. Las cargas de trabajo de ADF existentes pueden actualizarse a Fabric para acceder a nuevas funcionalidades en ciencia de datos, análisis en tiempo real e informes.

En este tutorial, usará el portal de Azure para crear una factoría de datos. Luego, usará la herramienta Copiar datos para crear una canalización que copie incrementalmente solo los archivos nuevos y modificados desde una instancia de Azure Blob Storage a otro. Usa LastModifiedDate para determinar qué archivos se van a copiar.

Después de completar los pasos que se indican aquí, Azure Data Factory examinará todos los archivos del almacén de origen, aplicará el filtro de archivos LastModifiedDate y copiará en el almacén de destino solo los archivos que son nuevos o se actualizaron desde la última vez. Tenga en cuenta que si Data Factory examina un gran número de archivos, debe esperar largos períodos. El análisis de archivos tarda mucho tiempo, incluso cuando se reduce la cantidad de datos copiados.

Nota

Si no está familiarizado con Data Factory, consulte Introducción a Azure Data Factory.

En este tutorial va a completar estas tareas:

- Creación de una factoría de datos.

- Uso de la herramienta Copy Data para crear una canalización.

- Supervisión de las ejecuciones de canalización y actividad.

Requisitos previos

- Azure suscripción: si no tiene una suscripción de Azure, cree una cuenta free antes de comenzar.

- Cuenta de Azure Storage: use Blob Storage para los almacenes de datos de origen y receptor. Si no tiene una cuenta de Azure Storage, siga las instrucciones de Crear una cuenta de almacenamiento.

Crear dos contenedores en Azure Blob Storage

Complete estos pasos para preparar su instancia de Blob Storage para el tutorial:

Cree un contenedor denominado source. Puede usar varias herramientas para realizar esta tarea, como Explorador de Azure Storage.

Cree un contenedor denominado destination.

Crear una factoría de datos

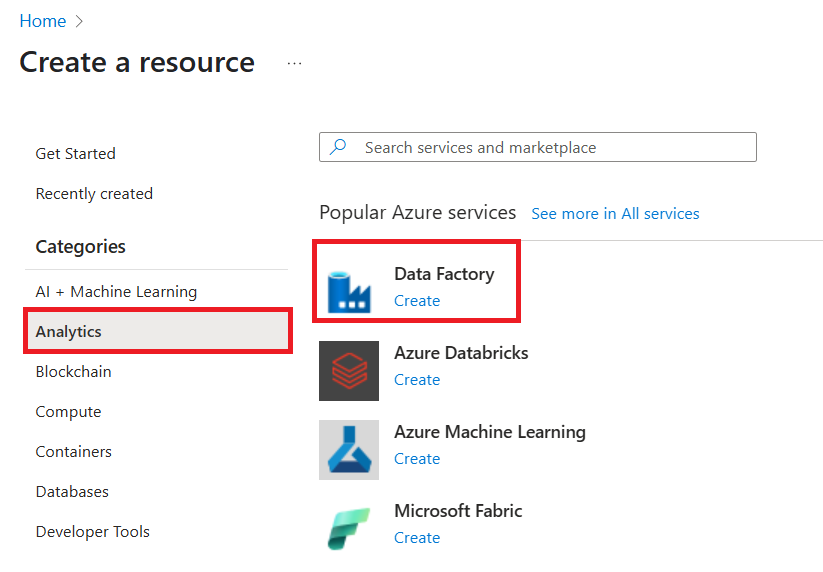

En el menú superior, seleccione Crear un recurso>Analytics>Data Factory :

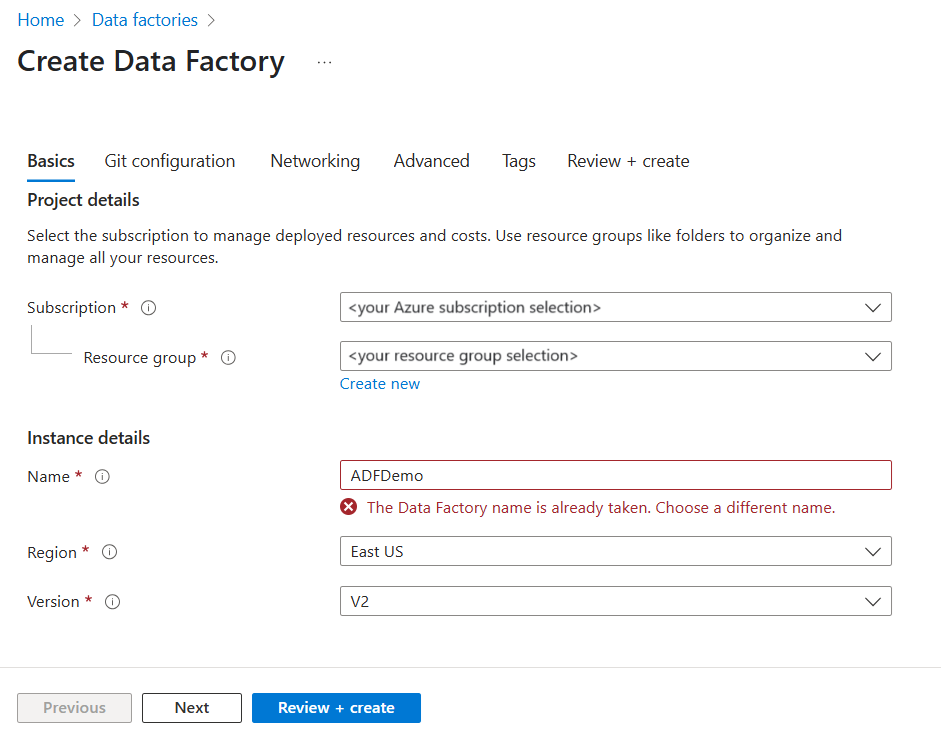

En la página Nueva factoría de datos, en Nombre, escriba ADFTutorialDataFactory.

El nombre de la factoría de datos debe ser globalmente único. Es posible que reciba este mensaje de error:

Si recibe un mensaje de error sobre el valor de nombre, escriba un nombre diferente para la factoría de datos. Por ejemplo, utilice suNombreADFTutorialDataFactory. Para conocer las reglas de nomenclatura de los artefactos de Data Factory, consulte Data Factory: reglas de nomenclatura.

En Subscription, seleccione la suscripción Azure en la que creará la nueva factoría de datos.

En Grupo de recursos, complete uno de estos pasos:

Seleccione Usar existente y, luego, seleccione un grupo de recursos existente de la lista.

Seleccione Crear nuevo y escriba un nombre para el grupo de recursos.

Para obtener información sobre los grupos de recursos, consulte Use grupos de recursos para administrar los recursos de Azure.

En Versión, seleccione V2.

En Ubicación, seleccione la ubicación de la factoría de datos. Solo las ubicaciones admitidas aparecen en la lista. Los almacenes de datos (por ejemplo, Azure Storage y Azure SQL Database) y los procesos (por ejemplo, Azure HDInsight) que usa la factoría de datos pueden estar en otras ubicaciones y regiones.

Seleccione Crear.

Una vez creada la factoría de datos, aparece la página principal de Data Factory.

Para abrir la interfaz de usuario (UI) de Azure Data Factory en una pestaña independiente, seleccione Abrir en la Abrir Azure Data Factory Studio icono:

Página de inicio del Azure Data Factory, con el recuadro de Open Azure Data Factory Studio.

Uso de la herramienta Copy Data para crear una canalización

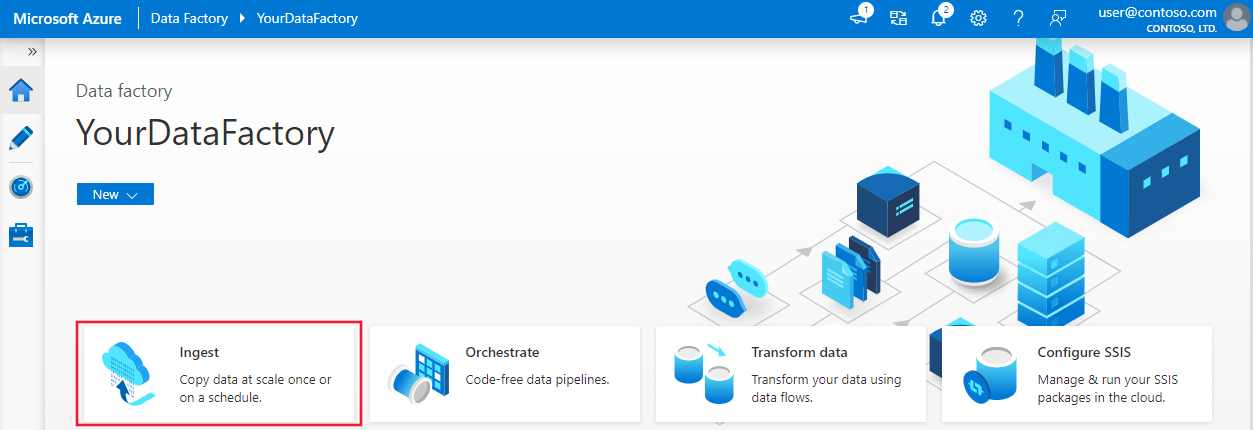

En la página principal de Azure Data Factory, seleccione el icono Ingest para abrir la herramienta Copiar datos:

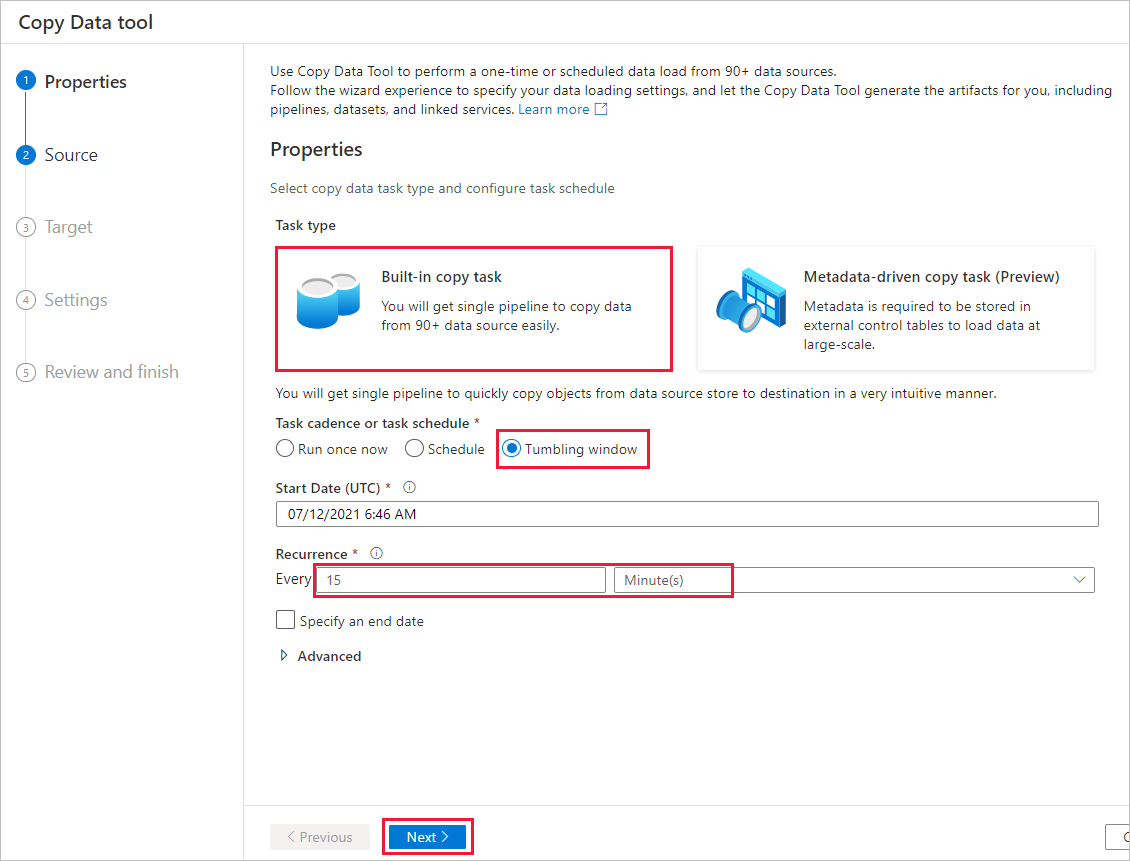

En la página Propiedades, realice los pasos siguientes:

En Tipo de tarea, seleccione Built-in copy task (Tarea de copia integrada).

En Task cadence or task schedule (Cadencia de tareas o programación de tareas), seleccione Ventana de saltos de tamaño constante.

En Recurrence (Periodicidad), establezca 15 minutos.

Seleccione Siguiente.

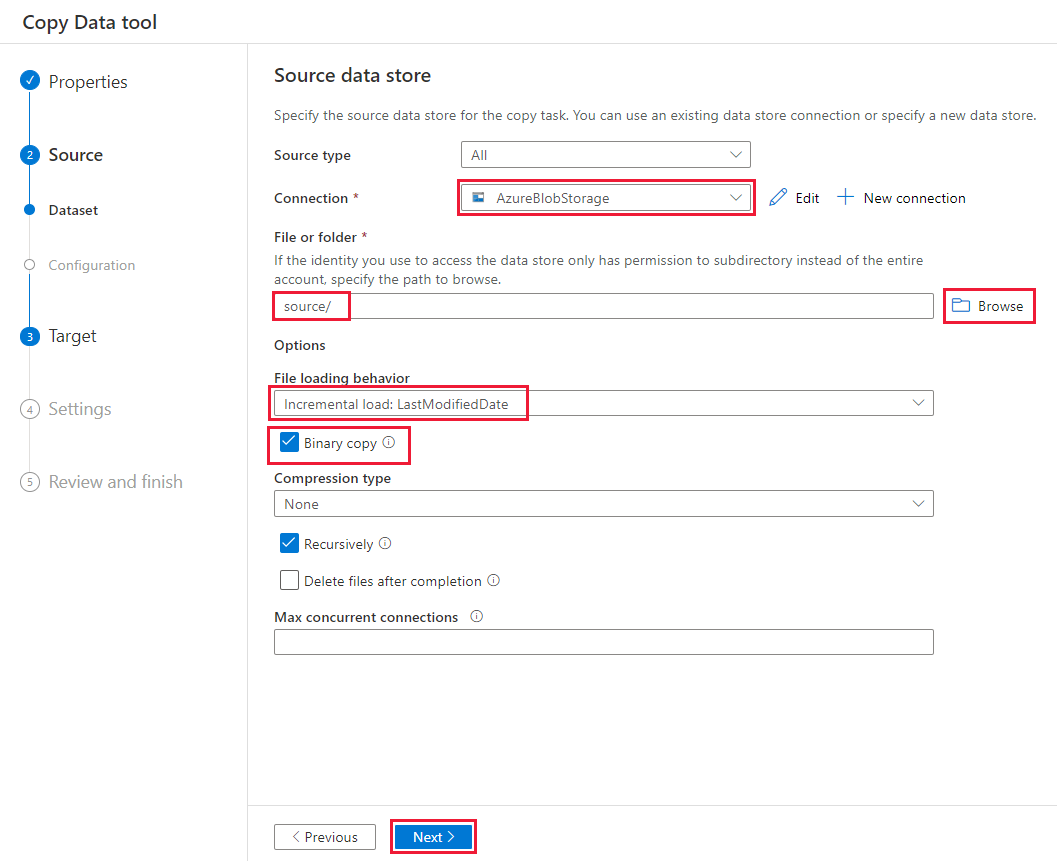

En la página Almacén de datos de origen, complete estos pasos:

Seleccione + Nueva conexión para agregar una conexión.

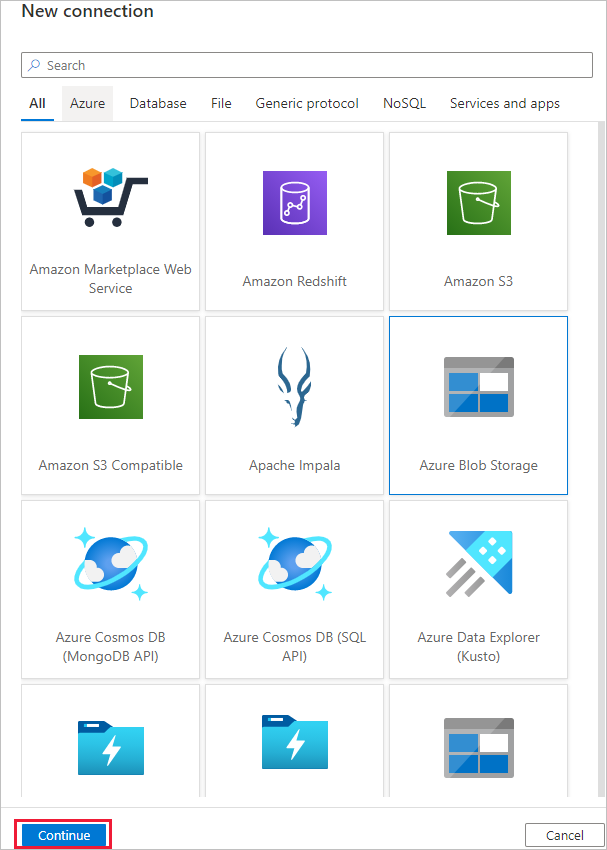

Seleccione Azure Blob Storage en la galería y, a continuación, seleccione Continue:

En la página Nueva conexión (Azure Blob Storage), seleccione su suscripción de Azure de la lista Suscripción de Azure y su cuenta de almacenamiento de la lista Nombre de cuenta de almacenamiento. Pruebe la conexión y seleccione Crear.

Seleccione la conexión recién creada en el bloque Conexión.

En la sección Archivo o carpeta, busque y seleccione la carpeta source y, luego, seleccione Aceptar.

En File loading behavior (Comportamiento de la carga de archivos), seleccione Incremental load: LastModifiedDate (Carga incremental: fecha de última modificación) y, luego, Binary copy (Copia binaria).

Seleccione Siguiente.

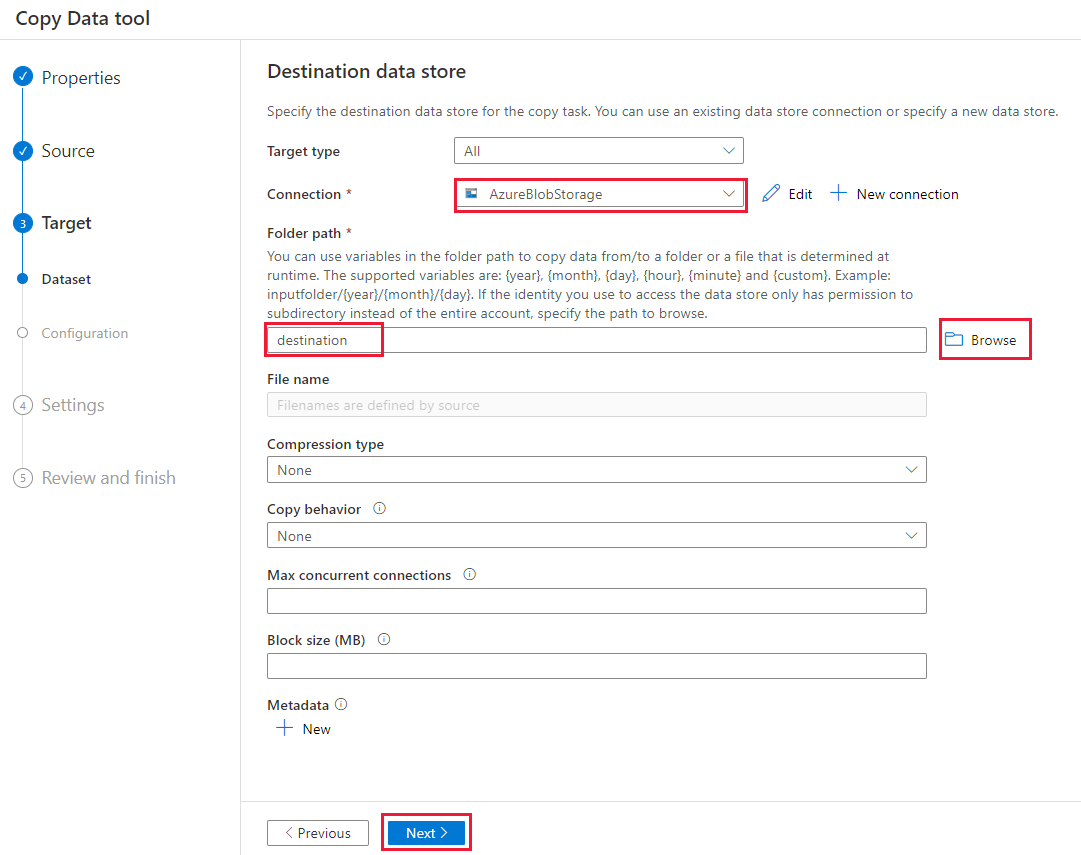

En la página Destination data store (Almacén de datos de destino), haga lo siguiente:

Seleccione la conexión AzureBlobStorage que creó. Se trata de la misma cuenta de almacenamiento que el almacén de datos de origen.

En la sección Ruta de la carpeta, busque y seleccione la carpeta destination y, luego, seleccione Aceptar.

Seleccione Siguiente.

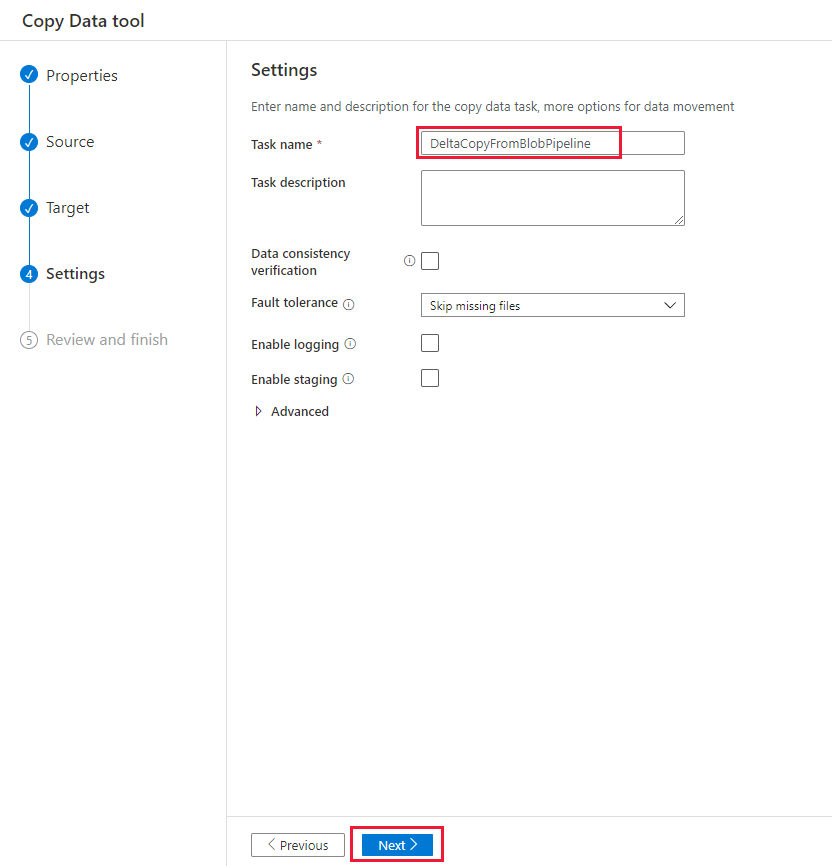

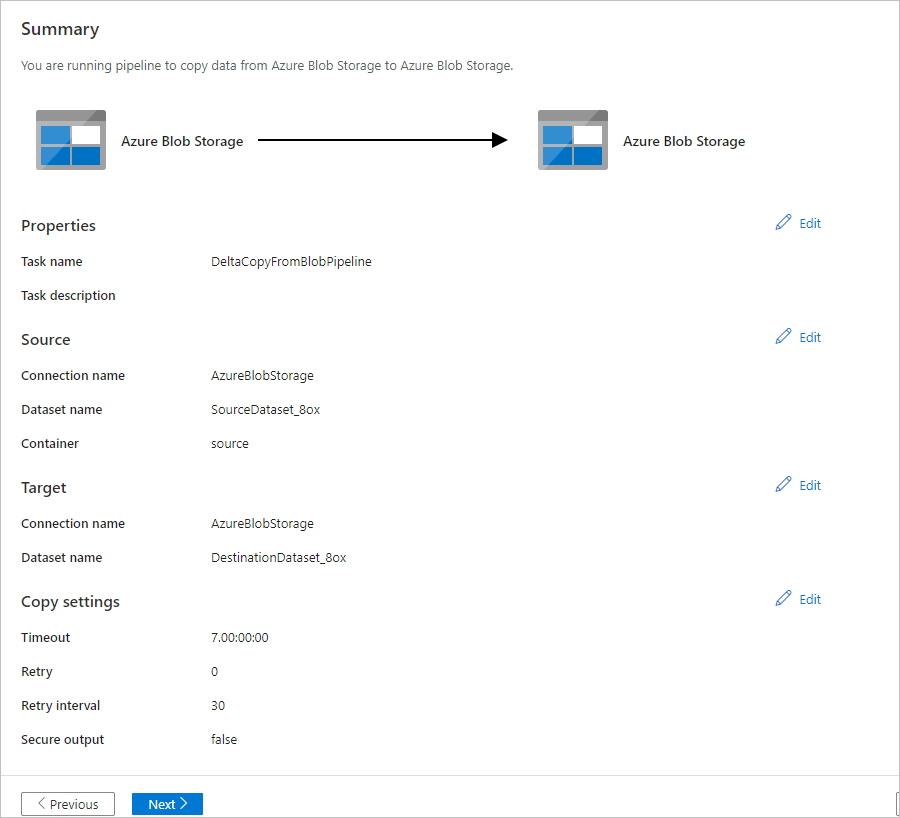

En la página Configuración, en Nombre de tarea, escriba DeltaCopyFromBlobPipeline y, luego, seleccione Siguiente. Data Factory crea una canalización con el nombre de tarea especificado.

En la página Summary (Resumen), revise la configuración y seleccione Next (Siguiente).

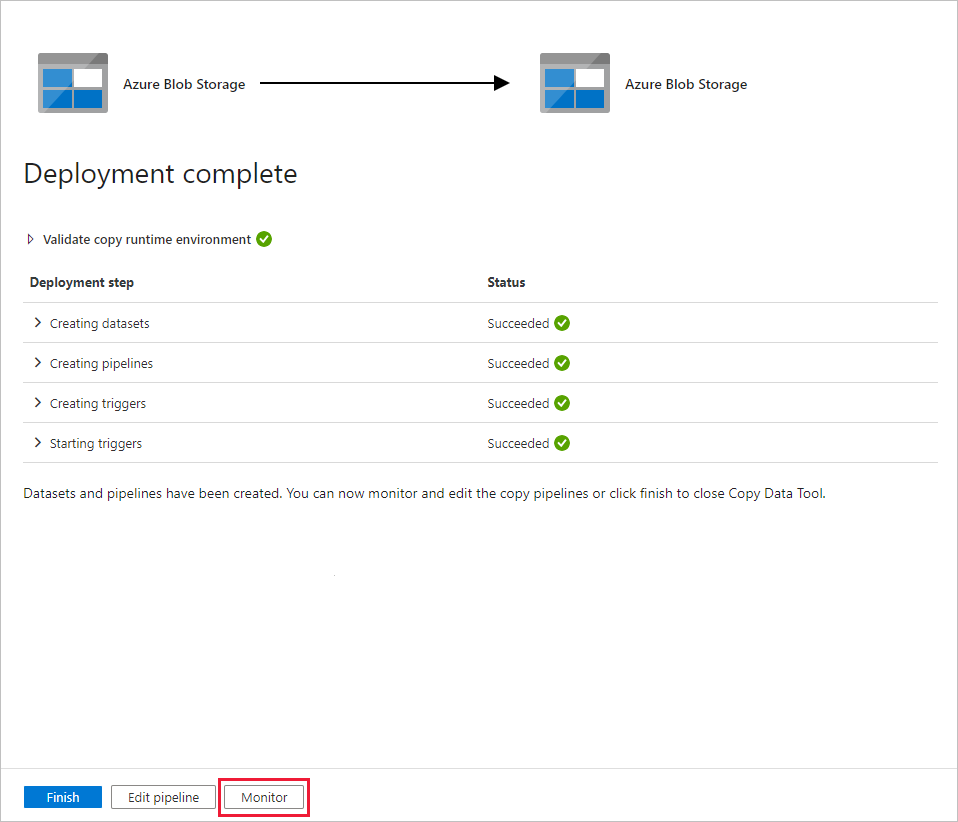

En la página Implementación, seleccione Monitor para supervisar la canalización (tarea).

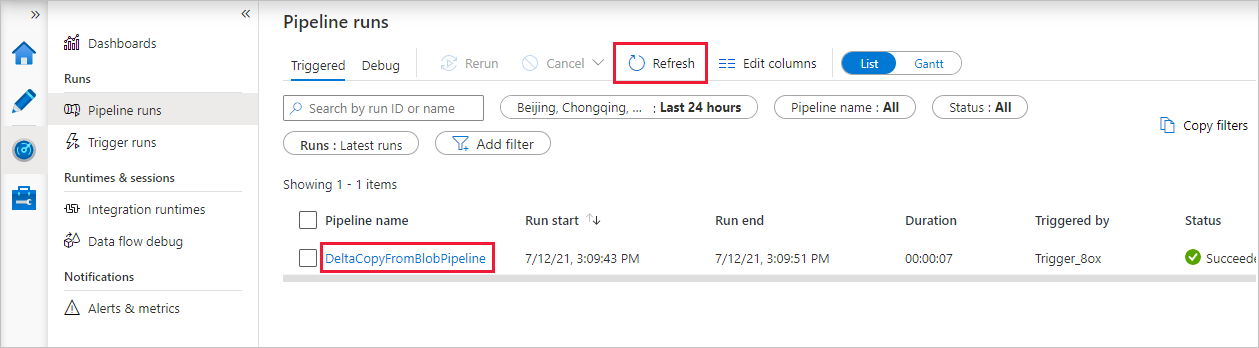

Observe que la pestaña Monitor (Supervisión) de la izquierda se selecciona automáticamente. La aplicación cambia a la pestaña Monitor (Supervisión). Verá el estado de la canalización. Seleccione Refresh (Actualizar) para actualizar la lista. Seleccione el vínculo bajo Nombre de canalización para ver los detalles de la ejecución de actividad o para volver a ejecutar la canalización.

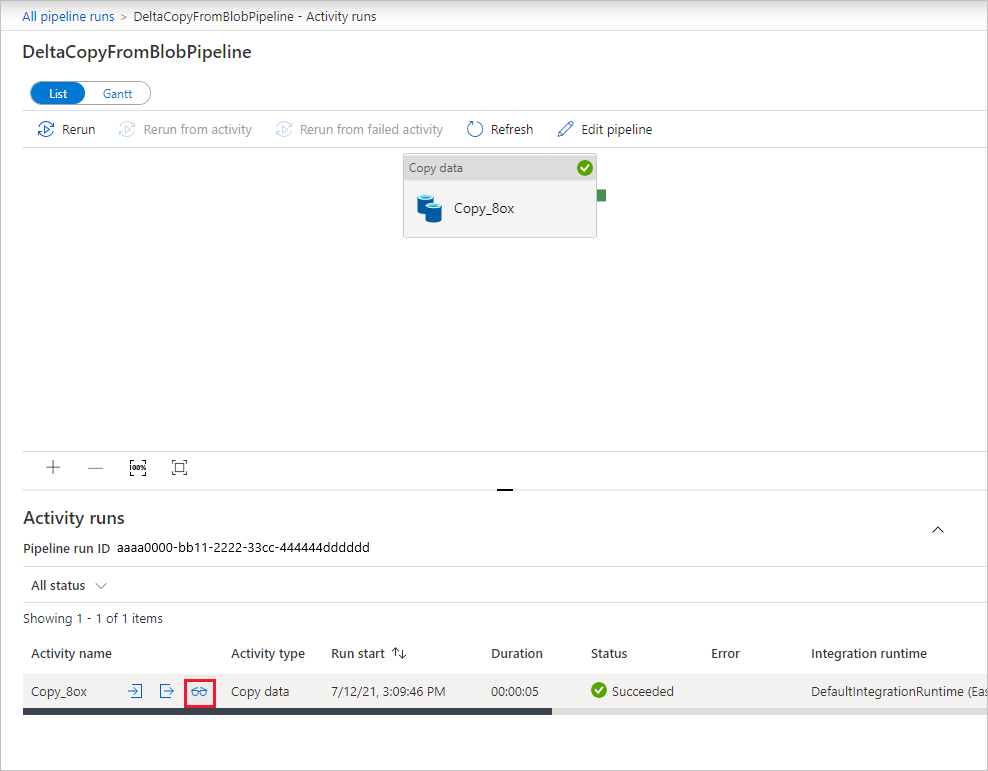

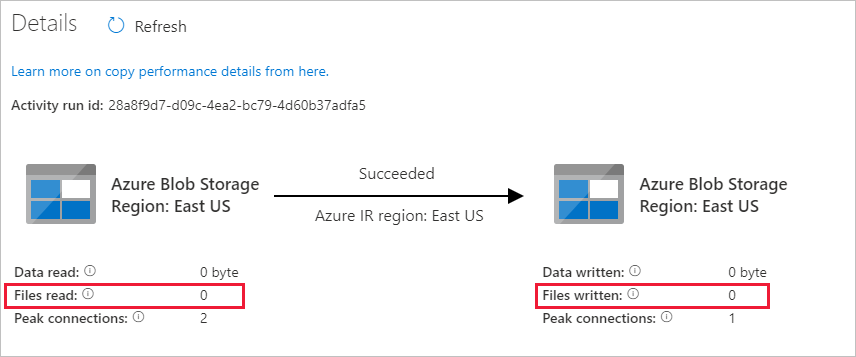

Como solo hay una actividad (actividad de copia) en la canalización, solo verá una entrada. Para ver detalles sobre la operación de copia, en la página Ejecuciones de actividad, seleccione el vínculo Detalles (el icono de gafas) en la columna Nombre de actividad. Para obtener más información sobre las propiedades, consulte Información general sobre la actividad de copia.

Como no hay archivos en el contenedor de origen de la cuenta de Blob Storage, no verá ningún archivo copiado en el contenedor de destino en la cuenta:

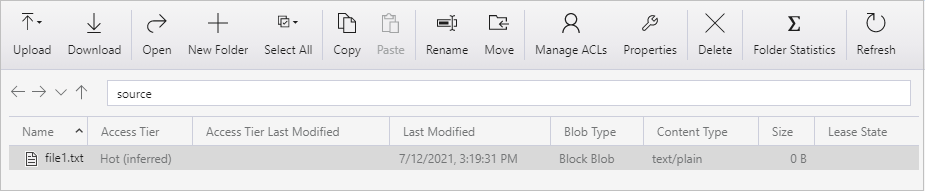

Cree un archivo de texto vacío y asígnele el nombre file1.txt. Cargue este archivo de texto en el contenedor de origen en su cuenta de almacenamiento. Puede usar varias herramientas para realizar estas tareas, como Explorador de Azure Storage.

Para volver a la vista Ejecuciones de canalizaciones, seleccione el vínculo Todas las ejecuciones de la canalización en el menú de la ruta de navegación de la página Ejecuciones de actividad y espere a que la misma canalización se desencadene de nuevo automáticamente.

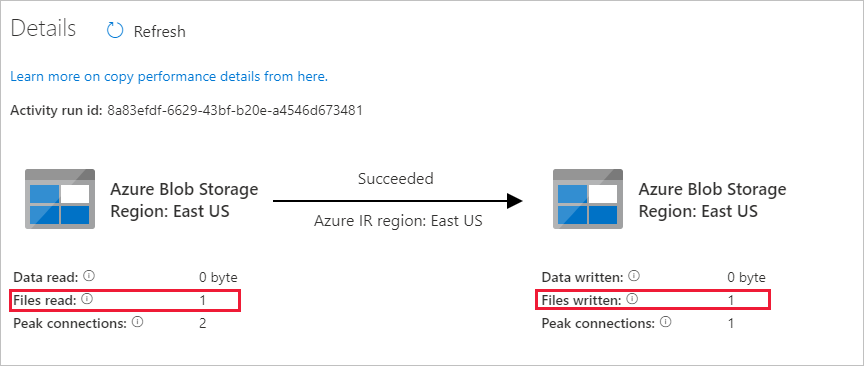

Cuando se complete la segunda ejecución de canalización, siga los mismos pasos mencionados anteriormente para revisar los detalles de la ejecución de actividad.

Verá que un archivo (file1.txt) se copió del contenedor de origen al contenedor de destino de la cuenta de Blob Storage:

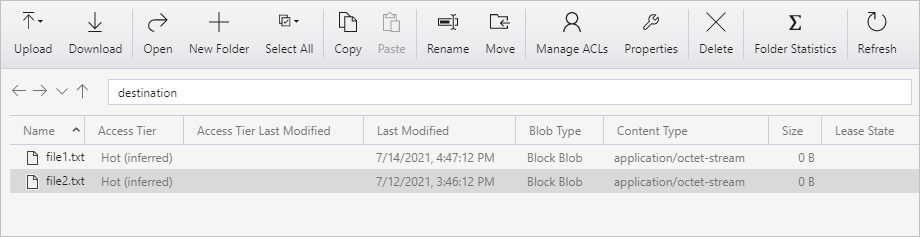

Cree otro archivo de texto vacío y asígnele el nombre file2.txt. Cargue este archivo de texto en el contenedor de origen en su cuenta de Blob Storage.

Repita los pasos 11 y 12 con el segundo archivo de texto. Verá que solamente un archivo (file2.txt) se copió del contenedor de origen al contenedor de destino de la cuenta de almacenamiento durante la ejecución de canalización.

También puede comprobar que solo se ha copiado un archivo mediante Explorador de Azure Storage para examinar los archivos:

Contenido relacionado

Vaya al siguiente tutorial para aprender a transformar datos mediante un clúster de Apache Spark en Azure: