Mallin suorituskyvyn arviointi

Käyttöönoton mallin arviointi varmistaa, että se täyttää laatustandardit, tarjoaa tarkat vastaukset ja paranee jatkuvasti ajan myötä. Microsoft Foundryn portaali tarjoaa useita lähestymistapoja arviointiin, manuaalisesta testauksesta automatisoituihin mittareihin ja kattaviin arviointiprosesseihin.

Miksi arvioida malleja

Arviointi palvelee useita keskeisiä tarkoituksia generatiivisen tekoälysovelluksen kehityksessä:

Laadunvarmistus tunnistaa ongelmat ja varmistaa, että mallisi tarjoaa tarkkoja ja relevantteja vastauksia. Ongelmien havaitseminen arvioinnin aikana tuotannon sijaan suojaa käyttäjiäsi ja organisaatiosi mainetta.

Käyttäjätyytyväisyys paranee, kun mallit tarjoavat johdonmukaisesti hyödyllisiä ja asianmukaisia vastauksia. Arviointi auttaa ymmärtämään, miten käyttäjät kokevat sovelluksesi ja missä parannukset vaikuttavat eniten.

Jatkuva parantaminen syntyy arviointitulosten analysoinnista parantamismahdollisuuksien tunnistamiseksi. Säännöllinen arviointi, kun päivität kehotuksia, lisäät ominaisuuksia tai koulutat malleja uudelleen, takaa jatkuvan laadun.

Vaatimustenmukaisuuden ja turvallisuuden varmistaminen vahvistaa, että mallisi noudattaa käytäntöjä, välttää haitallisen sisällön tuottamisen ja kunnioittaa käyttäjien yksityisyys- ja tietosuojavaatimuksia.

Manuaaliset arviointimenetelmät

Manuaalinen arviointi sisältää ihmisarvioijia, jotka arvioivat mallivasteita. Vaikka manuaalinen arviointi vie aikaa, se tarjoaa oivalluksia, joita automaattiset mittarit eivät pysty tallentamaan.

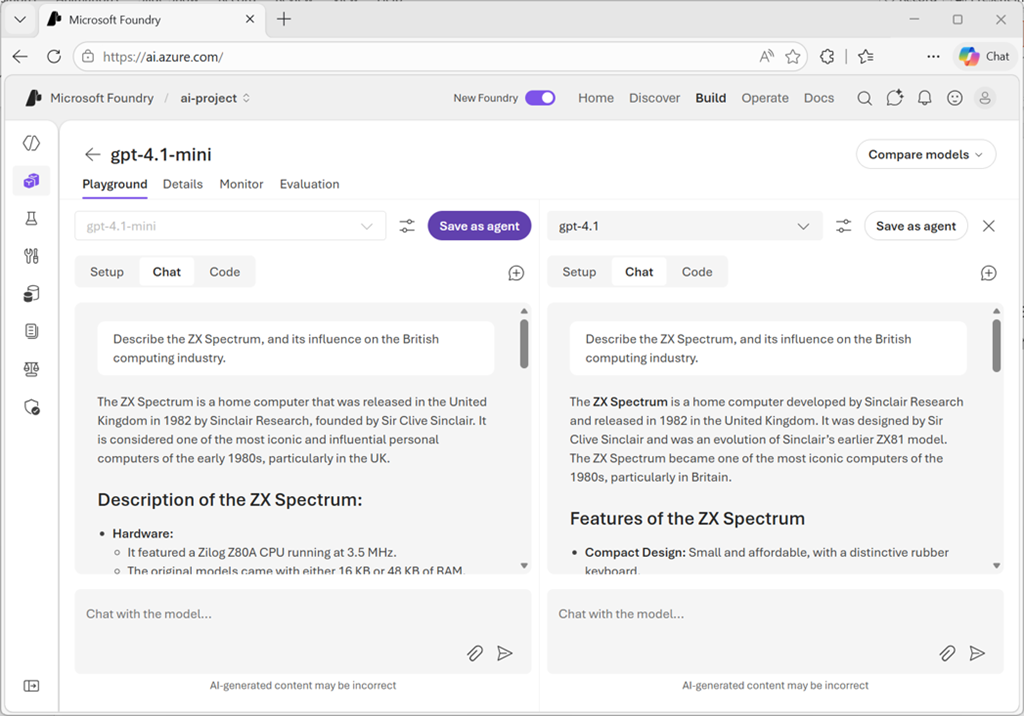

Interaktiivinen testaus leikkikentällä antaa mahdollisuuden tutkia mallikäyttäytymistä laadullisesti. Syötät erilaisia kehotuksia, tarkkailet vastauksia ja merkitset ongelmia kuten virheelliset tiedot, sopimaton sävy tai ohjeiden noudattamatta jättäminen. Tämä kokeileva testaus auttaa sinua ymmärtämään mallin vahvuudet ja rajoitukset.

Sovellussuunnittelun optimoimiseksi voit testata malleja rinnakkain leikkikentällä, synkronoiden järjestelmän ohjeet ja kehotteet vertaillaksesi niiden vastauksia.

Rakenteellinen tarkastus tarkoittaa testitapausten luomista, jotka edustavat sovelluksesi käyttötapauksia. Ihmisarvioijat arvioivat vastauksia seuraavien kriteerien perusteella:

- Merkityksellisyys: Vastaako vastaus kysymykseen tai pyyntöön?

- Informatiivisuus: Tarjoaako se riittävästi yksityiskohtia ja hyödyllistä tietoa?

- Sitoutuminen: Onko vastaus mielenkiintoinen ja sopivan keskusteleva?

- Tarkkuus: Ovatko faktat ja väitteet oikeita?

- Turvallisuus: Välttääkö vastaus haitallisen, puolueellisen tai sopimattoman sisällön?

Arvioijat käyttävät tyypillisesti arviointiasteikkoja (esim. 1–5) jokaiselle kriteerille. Yhteenlasketut arviot useista testitapauksista tarjoavat määrällisiä mittareita kokonaislaadusta.

Käyttäjätutkimukset keräävät palautetta todellisilta tai edustavilta käyttäjiltä, jotka ovat vuorovaikutuksessa sovelluksesi kanssa. Käyttäjäpalaute paljastaa todellisia ongelmia, jotka saattavat jäädä hallitussa testauksessa huomaamatta, kuten sekavan sanamuodon, kontekstin puuttumisen tai odotusten täyttymättömyyden vuoksi.

Manuaalinen arviointi täydentää automatisoituja menetelmiä tallentamalla subjektiivisia laadun tekijöitä, kuten käyttäjätyytyväisyyttä, kontekstuaalista sopivuutta ja brändin yhdenmukaisuutta, joita pelkät mittarit eivät pysty mittaamaan.

Automaattiset arviointimittarit

Automaattinen arviointi käyttää standardoituja mittareita arvioidakseen mallin tuloksia automaattisesti. Nämä arvioinnit skaalautuvat tehokkaasti ja tarjoavat johdonmukaisia, objektiivisia mittauksia.

Microsoft Foundryn portaali tukee useita arviointimittareiden kategorioita, mukaan lukien:

Generointilaadun mittarit arvioivat kokonaisvastauksen laatua:

- Maanläheisyys: Määrittää, perustuvatko vastaukset annettuun kontekstiin eikä spekulaatioon. Groundedness Pro tarjoaa binäärisen arvioinnin (maadoitettu tai ei), joka on hyödyllistä faktatarkkuusvaatimuksissa.

- Relevanssi: Mittaa, vastaavatko vastaukset käyttäjän kysymykseen tai pyyntöön asianmukaisesti.

- Koherenssi: Arvioi, virtaavatko vastaukset loogisesti ja ylläpitävätkö ajatukset johdonmukaisina.

- Sujuvuus: Arvioi kielellisen oikeellisuuden ja luonnollisen kielen laadun.

Riski- ja turvallisuusmittarit tunnistavat mahdollisen haitallisen sisällön:

- Itsensä vahingoittamiseen liittyvä sisältö: Havaitsee reaktiot, joissa käsitellään tai rohkaistaan itsevahingoittamiseen

- Vihamielinen ja epäreilu sisältö: Tunnistaa ennakkoluuloja, syrjintää tai vihamielisiä lausuntoja

- Väkivaltainen sisältö: Merkitsee väkivaltaa sisältävät tai edistävät vastaukset

- Seksuaalinen sisältö: Havaitsee sopimatonta seksuaalista sisältöä

- Suojattu materiaali: Tunnistaa mahdollisen tekijänoikeuden tai omistusoikeudellisen sisällön jäljentämisen

- Epäsuora hyökkäys (jailbreak): Arvioi haavoittuvuutta manipulointiyrityksille

Sisältövahinkomittareiden osalta tulokset yhdistetään virheprosenttina – vasteiden prosenttiosuutena, joka ylittää vakavuusrajan (tyypillisesti keskitaso). Suojatun materiaalin ja epäsuoran hyökkäyksen osalta vikaprosentti lasketaan muodossa (true instances / total instances) × 100.

Kun käytät tekoälyavustettua arviointia, määrität GPT-mallin arvioinnin suorittamista varten. Tämä arvioijamalli analysoi käyttöön otetun mallisi vastaukset ja antaa pisteet valittujen kriteerien perusteella.

Luonnollisen kielen käsittelyn mittarit

NLP-mittarit tarjoavat matemaattisesti perustuvan arvioinnin ilman arviointimallia. Nämä mittarit tarvitsevat usein totuusdataa—odotettuja tai oikeita vastauksia vertailua varten.

F1-score mittaa jaettujen sanojen suhdetta generoitujen ja perustotuusvastausten välillä, tasapainottaen tarkkuutta (virheellisten sanojen välttäminen) ja muistamista (mukaan lukien tärkeät sanat). F1-pisteet ovat arvokkaita tehtävissä, kuten tekstin luokittelussa ja tiedon haussa.

BLEU (Bilingual Evaluation Understudy) vertaa n-grammeja (sanajonoja) generoitujen ja viitetekstien välillä, joita käytetään yleisesti konekäännösten arvioinnissa.

METEOR (Metric for Evaluation of Translation with Explicit Ordering) laajentaa BLEU:ta ottamalla huomioon synonyymit, stemmauksen ja parafraasien, tarjoten joustavampaa vertailua.

ROUGE (Recall-Oriented Understudy for Gisting Evaluation) korostaa muistamista tarkkuuden sijaan, mikä tekee siitä erityisen hyödyllisen yhteenvetotehtävissä, joissa keskeisten kohtien kattaminen on tärkeämpää kuin ylimääräisten sanojen välttäminen.

GLEU (Google-BLEU) on BLEU:n muunnelma, joka on suunniteltu lausetason arviointiin.

NLP-mittarit toimivat hyvin, kun sinulla on selkeät oikeat vastaukset tai viitetekstit. Ne eivät sovellu avoimeen generointiin, jossa on paljon päteviä vastauksia.

Laadi kattavat arvioinnit

Microsoft Foundryn portaalin Arviointi-ominaisuus mahdollistaa systemaattisten arviointien suorittamisen testiaineistojen ja useiden mittareiden avulla samanaikaisesti.

Voit perustaa arviosi johonkin seuraavista:

- Malli: Arvioi käytössä oleva malli määrittämilläsi kehotteista. Järjestelmä tuottaa tuloksia arvioinnin aikana.

- Agentti: Arvioi agentin vastaukset käyttäjän määrittelemien kehotteiden avulla.

- Aineisto: Arvioi testiaineistossasi jo valmiiksi luodut tulokset.

Kun arvioit mallia tai agenttia, tarvitset aineiston, joka tarjoaa syötteitä arviointia varten. Käytössä on kolme vaihtoehtoa:

- Lataa uusi dataset: Anna CSV- tai JSONL-tiedosto, joka sisältää testitapauksia paikallisesta storage.

- Käytä olemassa olevaa aineistoa: Valitse aiemmin lataamistasi aineistoista project.

- Luo synteettinen aineisto: Jos testidata puuttuu, järjestelmä voi tuottaa näytedataa antamasi aihekuvauksen perusteella. Määrität datan tuottamiseen tarkoitetun resurssin, rivien määrän ja kehotteen, joka kuvaa halutun datan. Voit myös ladata tiedostoja, jotka parantavat niiden merkityksellisyyttä juuri sinun tehtävääsi varten.

Tietoaineiston arviointiin, jossa tulokset ovat valmiiksi, valitse tai lataa aineistosi, joka sisältää sekä syötteet että mallin tuottamat vastaukset.

Kun olet konfiguroinut laskettavat mittarit, arviointidatan kenttäkartoitukset ja mallin järjestelmäkehotteen; Voit aloittaa arviointityön – sen suorittaminen asynkronisesti voi viedä jonkin aikaa, käsitellen jokaisen rivin testiaineistossasi valittuja mittareita vastaan.

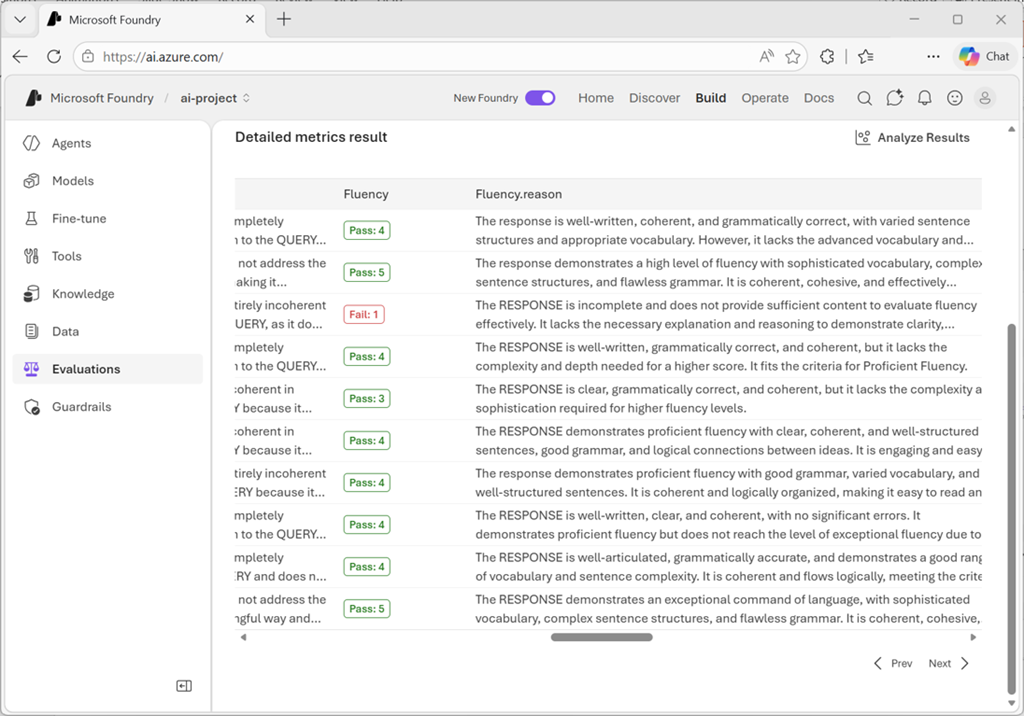

Arviointitulokset

Kun arviointi on valmis, tulokset näyttävät yhteenlasketut pisteet valitsemistasi mittareista sekä kunkin testikehotteen yksityiskohdat.

Tutustu arvioijakirjastoon

Arvioijakirjasto tarjoaa keskitetyn paikan kaikkien saatavilla olevien arvioijien tarkasteluun ja hallintaan. Access se project sivulta Evaluation valitsemalla Evaluator-kirjasto-välilehden.

Arvioijakirjastossa voit:

- Katso Microsoftin kuratoidut arvioijat laadun, turvallisuuden ja suorituskyvyn osalta

- Tutki arvioijan tiedot, mukaan lukien nimi, kuvaus, parametrit ja niihin liittyvät tiedostot

- Arvosteluannotaatiopyynnöt laadunarvioijille ymmärtääkseen, miten mittarit lasketaan

- Tarkista turvallisuusarvioijien määritelmät ja vakavuustasot

- Hallinnoi räätälöityjä arvioijia, jotka olet luonut tiettyihin tilanteisiin

Kirjasto tukee versionhallintaa, jolloin voit vertailla eri versioita, palauttaa vanhoja versioita tarvittaessa ja tehdä yhteistyötä muiden kanssa räätälöidyissä arvioijissa.

Iteroi arvioinnin perusteella

Arviointitulokset ohjaavat seuraavia askeleitasi:

Kun pisteet ovat vaadittua alhaisempia, harkitse seuraavia:

- Kehotteiden suunnittelu: Käskyjen ja järjestelmäviestien hiominen

- Eri mallit: Kokeile käyttötarkoitukseen optimoituja malleja

- RAG-integraatio: Hakutoimintojen lisääminen maapohjaisiin vastuksiin datassasi

- Hienosäätö: Mallin kouluttaminen omalla toimialallasi (jos sitä tuetaan)

Jokainen näistä vaiheista voi kasvaa monimutkaisuudeltaan (ja joskus myös kustannuksiltaan), joten ota tämä huomioon suunnittelussa parannuksia.

Kun turvallisuusmittarit osoittavat huolia:

- Content filters: Azure AI Content Safety palveluiden toteuttaminen

- Prompt hardening: Turvaohjeiden lisääminen järjestelmäviesteihin

- Tulostuksen validointi: Vastaukset tarkistetaan ennen niiden näyttämistä käyttäjille

Säännöllinen arviointi muutosten yhteydessä seuraa parannuksia ja varmistaa, ettei laatu heikkene. Määritä arviointikriteerit varhaisessa vaiheessa kehitysvaiheessa ja tee arvioinnit uudelleen muutosten jälkeen vaikutuksen objektiivisen mittaamisen varmistamiseksi.

Yhdistämällä manuaalisen testauksen, automatisoidut mittarit ja kattavat arviointiprosessit rakennat luottamusta siihen, että mallisi toimii hyvin, palvelee käyttäjiä turvallisesti ja täyttää sovelluksesi laatuvaatimukset.