Données, confidentialité et sécurité pour l’utilisation de modèles via le catalogue de modèles dans le portail Azure AI Foundry

Important

Les éléments marqués (préversion) dans cet article sont actuellement en préversion publique. Cette préversion est fournie sans contrat de niveau de service, nous la déconseillons dans des charges de travail de production. Certaines fonctionnalités peuvent être limitées ou non prises en charge. Pour plus d’informations, consultez Conditions d’Utilisation Supplémentaires relatives aux Évaluations Microsoft Azure.

Cet article décrit la façon dont les données que vous fournissez sont traitées, utilisées et stockées lorsque vous déployez des modèles du catalogue de modèles. Consultez également l'Addenda sur la protection des données des produits et services Microsoft, qui régit le traitement des données par les services Azure.

Important

Pour plus d’informations sur l’IA responsable dans Azure OpenAI et les services IA, consultez Utilisation responsable de l’IA.

Quelles données sont traitées pour les modèles déployés dans le portail Azure AI Foundry ?

Lorsque vous déployez des modèles dans le portail Azure AI Foundry, les types de données suivants sont traités pour fournir le service :

Prompts et contenu généré. Un utilisateur envoie un prompt et le modèle génère du contenu (sortie) via les opérations prises en charge par le modèle. Les prompts peuvent inclure du contenu ajouté via la génération augmentée de récupération (RAG), des métaprompts ou d’autres fonctionnalités incluses dans une application.

Données chargées. Pour les modèles qui prennent en charge l’optimisation, les clients peuvent charger leurs données dans un magasin de données pour l’optimisation.

Génération des sorties d’inférence avec un calcul managé

Le déploiement de modèles sur des calculs managés déploie les poids du modèle sur des machines virtuelles dédiées et expose une API REST pour l’inférence en temps réel. Pour en savoir plus sur le déploiement de modèles à partir du catalogue de modèles vers le calcul managé, consultez Catalogue de modèles et collections dans le portail Azure AI Foundry.

Vous gérez l’infrastructure pour ces ressources de calcul managées. Les engagements en matière de données, de confidentialité et de sécurité Azure s’appliquent. Pour en savoir plus sur les offres de conformité Azure applicables à Azure AI Foundry, consultez la page Offres de conformité Azure.

Même si les conteneurs des modèles Curés par Azure AI sont analysés pour détecter des vulnérabilités susceptibles d’exfiltrer des données, les modèles disponibles dans le catalogue de modèles ne sont pas tous analysés. Pour réduire le risque d’exfiltration des données, vous pouvez aider à protéger votre déploiement en utilisant des réseaux virtuels. Vous pouvez également utiliser Azure Policy pour réglementer les modèles que vos utilisateurs peuvent déployer.

Génération des sorties d’inférence en tant qu’API serverless

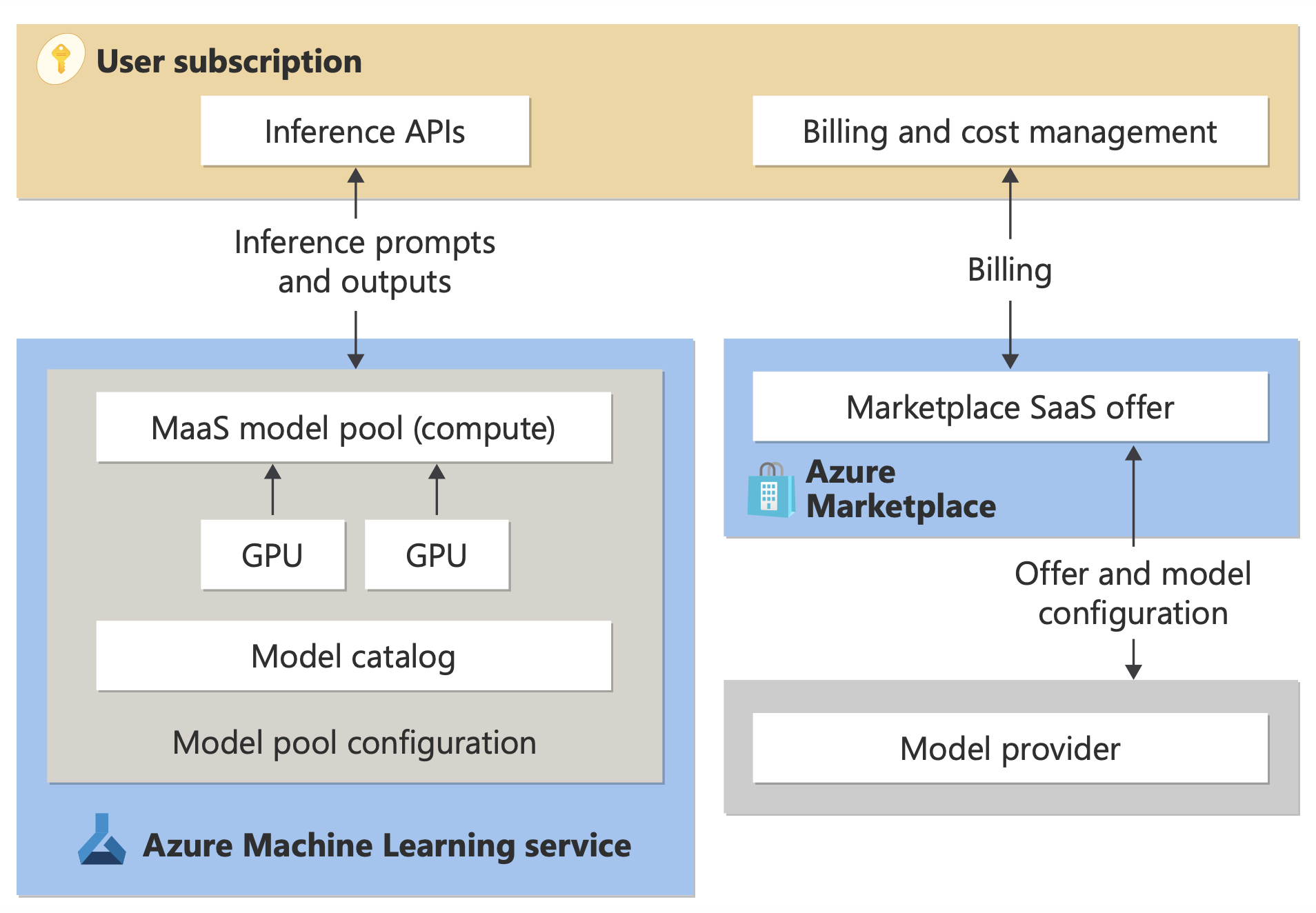

Lorsque vous déployez un modèle à partir du catalogue de modèles (de base ou optimisé) à l’aide d’API serverless avec une facturation de paiement à l’utilisation pour inférence, une API est approvisionnée. L’API vous donne accès au modèle qu’Azure Machine Learning service héberge et gère. Explorez plus en détail les API serverless dans Catalogue de modèles et collections.

Le modèle traite vos prompts d’entrée et génère des sorties en fonction de ses fonctionnalités, comme décrit dans les détails du modèle. Votre utilisation du modèle (ainsi que la responsabilité du fournisseur pour le modèle et ses sorties) est soumise aux termes du contrat de licence pour le modèle. Microsoft fournit et gère l’infrastructure d’hébergement et le point de terminaison d’API. Les modèles hébergés dans ce modèle en tant que service (MaaS) sont soumis à des engagements en matière de données, de confidentialité et de sécurité Azure. En savoir plus sur les offres de conformité Azure applicables à Azure AI Foundry.

Microsoft agit en tant que processeur de données pour les prompts et les sorties envoyées à, et générées par, un modèle déployé pour l’inférence de paiement à l’utilisation (MaaS). Microsoft ne partage pas ces prompts et sorties avec le fournisseur de modèles. En outre, Microsoft n’utilise pas ces prompts et sorties pour entraîner ou améliorer les modèles Microsoft, les modèles du fournisseur de modèles ou les modèles de tiers.

Les modèles sont sans état et ne stockent pas de prompts ni de sorties. Si le filtrage de contenu (préversion) est activé, le service Azure AI Content Safety affiche des prompts et des sorties pour certaines catégories de contenu dangereux en temps réel. En savoir plus sur la façon dont Azure AI Content Safety traite les données.

Les prompts et les sorties sont traités dans la zone géographique spécifiée pendant le déploiement, mais peuvent être traités entre les régions de la zone géographique à des fins opérationnelles. Les objectifs opérationnels incluent la gestion de la capacité et du niveau de performance.

Remarque

Comme expliqué lors du processus de déploiement pour MaaS, Microsoft peut partager les coordonnées des clients et les détails des transactions (y compris le volume d’utilisation associé à l’offre) avec l’éditeur du modèle afin que l’éditeur puisse contacter les clients concernant le modèle. Explorez plus en détail les informations à la disposition des éditeurs de modèles dans Insights sur l’accès pour la Place de marché commerciale Microsoft dans l’Espace partenaires.

Optimiser le réglage d’un modèle pour le déploiement de paiement à l’utilisation (MaaS)

Si un modèle disponible pour les API serverless prend en charge l’optimisation, vous pouvez charger des données sur (ou désigner des données qui sont déjà dans) un magasin de données pour optimiser le modèle. Vous pouvez ensuite créer un déploiement d’API serverless pour le modèle optimisé. Le modèle optimisé ne peut pas être téléchargé, mais :

- Il est disponible exclusivement pour votre utilisation.

- Vous pouvez utiliser un double chiffrement au repos : le chiffrement Microsoft AES-256 par défaut et une clé gérée par le client facultative.

- Vous pouvez le supprimer à tout moment.

Les données d’apprentissage chargées pour l’optimisation ne sont pas utilisées pour effectuer l’apprentissage, réentraîner ou améliorer les modèles de Microsoft ou non-Microsoft, sauf si vous le demandez ces activités dans le cadre du service.

Traitement des données pour les modèles téléchargés

Si vous téléchargez un modèle à partir du catalogue de modèles, vous choisissez où déployer le modèle. Vous êtes responsable de la façon dont les données sont traitées lorsque vous utilisez le modèle.