Remarque

L’accès à cette page requiert une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page requiert une autorisation. Vous pouvez essayer de modifier des répertoires.

Microsoft Foundry Models est votre destination unique pour découvrir, évaluer et déployer de puissants modèles IA, que vous construisiez un copilote personnalisé, un agent, améliorant une application existante ou explorant de nouvelles fonctionnalités d’IA.

Avec les modèles Foundry, vous pouvez :

- Explorez un catalogue riche de modèles de pointe de Microsoft, OpenAI, DeepSeek, Hugging Face, Meta, etc.

- Comparez et évaluez des modèles côte à côte à l’aide de tâches réelles et de vos propres données.

- Déployez avec confiance, grâce à des outils intégrés pour l’optimisation, l’observabilité et l’IA responsable.

- Choisissez votre chemin d’accès : apportez votre propre modèle, utilisez un modèle hébergé ou intégrez-en toute transparence à Azure services.

Que vous soyez développeur, data scientist ou architecte d'entreprise, Foundry Models vous offre la flexibilité et le contrôle nécessaires pour créer des solutions IA qui s'adaptent de manière sécurisée, responsable et rapide.

Foundry propose un catalogue complet de modèles IA. Il existe plus de 1 900 modèles qui vont des modèles de base, des modèles de raisonnement, des modèles de petite langue, des modèles modals, des modèles spécifiques au domaine et des modèles industriels.

Le catalogue de modèles est organisé en deux catégories principales :

La compréhension de la distinction entre ces catégories vous aide à choisir les modèles appropriés pour vos besoins spécifiques et vos objectifs stratégiques.

Note

Pour tous les modèles, les clients restent responsables des opérations suivantes :

- Respecter la loi dans son utilisation d’un modèle ou d’un système

- Examen des descriptions de modèle dans le catalogue de modèles, cartes de modèle rendues disponibles par le fournisseur de modèles et d’autres documents pertinents

- Sélection d’un modèle approprié pour leur cas d’usage

- Mise en œuvre de mesures appropriées (y compris l'utilisation de Azure AI Content Safety) pour garantir que l'utilisation des Outils Foundry est conforme à la stratégie d'utilisation acceptable selon les conditions des produits Microsoft et le Code de Conduite des Services d'IA de Microsoft Enterprise.

Modèles vendus directement par Azure

Également appelées modèles direct Azure ou Direct à partir de modèles Azure, ces modèles sont hébergés et vendus par Microsoft en vertu des conditions du produit Microsoft. Microsoft a évalué ces modèles et ils sont profondément intégrés à l'écosystème ia de Azure. Les modèles proviennent d’un large éventail de fournisseurs et offrent une intégration améliorée, des performances optimisées et un support direct de Microsoft, notamment des accords de niveau de service de niveau entreprise (SLA).

Caractéristiques des modèles vendus directement par Azure :

- Support disponible auprès de Microsoft.

- Haut niveau d’intégration avec les services et l’infrastructure Azure.

- Sous réserve d’une révision interne basée sur les normes d’IA responsable de Microsoft.

- Les rapports de documentation et de transparence des modèles fournissent une visibilité des clients sur les risques, les atténuations et les limitations du modèle.

- Scalabilité, fiabilité et sécurité de niveau entreprise.

Certains de ces modèles offrent également un débit provisionné fongible, ce qui signifie que vous pouvez utiliser de manière flexible votre quota et vos réservations sur l’un de ces modèles. Pour savoir comment Foundry gère les données que vous fournissez aux modèles Foundry vendus directement par Azure, consultez Data, confidentialité et sécurité des modèles directs Azure dans Microsoft Foundry.

Modèles des partenaires et de la communauté

Ces modèles constituent la grande majorité des modèles de Foundry et sont fournis par des organisations tierces approuvées, des partenaires, des laboratoires de recherche et des contributeurs communautaires. Ces modèles offrent des fonctionnalités d’IA spécialisées et diversifiées, couvrant un large éventail de scénarios, d’industries et d’innovations. Les exemples de modèles de la part des partenaires et de la communauté incluent la famille de modèles de langage de grande taille développés par Anthropic et les modèles ouverts du hub Hugging Face.

Anthropic comprend la famille Claude de modèles de langage de pointe qui prennent en charge l’entrée de texte et d’image, la sortie de texte, les fonctionnalités multilingues et la vision. Pour obtenir de l’aide sur les modèles anthropices, utilisez Microsoft Support. Pour en savoir plus sur la confidentialité, consultez Données, confidentialité et sécurité pour les modèles Claude dans Microsoft Foundry (préversion) et politique de confidentialité anthropice. Pour connaître les conditions d’utilisation, consultez Conditions d’utilisation commerciales. Pour savoir comment utiliser des modèles anthropices, consultez Déployer et utiliser des modèles Claude dans Microsoft Foundry.

Hugging Face Hub comprend des centaines de modèles pour l’inférence en temps réel avec le calcul managé. Hugging Face crée et gère les modèles listés dans cette collection. Pour obtenir de l’aide sur les modèles Hugging Face, utilisez le forum Hugging Face ou le support Hugging Face. Découvrez comment déployer des modèles Hugging Face dans Comment déployer et inférer avec un déploiement de calcul géré (classique).

Important

Pour travailler avec des modèles qui sont déployables sur des infrastructures gérées, tels que les modèles Hugging Face, utilisez un projet basé sur un hub dans le portail Foundry (classique). Pour en savoir plus sur les portails Foundry disponibles, consultez Qu’est-ce que Microsoft Foundry ?.

Caractéristiques des modèles des partenaires et de la communauté :

- Développé et pris en charge par des partenaires externes et des contributeurs communautaires

- Diverses gammes de modèles spécialisés qui s’adressent à des niches ou à des cas d’usage larges

- Généralement validé par les fournisseurs eux-mêmes, avec des instructions d’intégration fournies par Azure

- Innovation pilotée par la communauté et disponibilité rapide des modèles de pointe

- Intégration standard Azure IA, avec prise en charge et maintenance gérées par les fournisseurs respectifs

Les modèles des partenaires et de la communauté sont déployables grâce aux options de calcul géré ou de déploiement sans serveur. Le fournisseur de modèles sélectionne la façon dont les modèles sont déployables. Pour en savoir plus sur les types de déploiement disponibles sous l’option de déploiement serverless, consultez Types de déploiement pour les modèles Microsoft Foundry.

Demander à un modèle d’être inclus dans le catalogue de modèles

Demandez-nous d’ajouter un modèle au catalogue de modèles directement à partir de la page du catalogue de modèles dans le portail Foundry.

- Accédez à la page du catalogue de modèles.

- Dans la barre de recherche, recherchez un modèle qui n’existe pas dans le catalogue, tel que mymodel.

- Sélectionnez Demander un modèle pour partager des détails sur le modèle que vous souhaitez demander.

Choix entre les modèles vendus directement par Azure et les modèles des partenaires et de la communauté

Lorsque vous sélectionnez les modèles Foundry à utiliser, tenez compte des éléments suivants :

- Use cas et exigences : les modèles vendus directement par Azure sont idéaux pour les scénarios nécessitant une intégration approfondie Azure, un support garanti et des contrats SLA d’entreprise. Les modèles des partenaires et de la communauté excellent dans les cas d’usage spécialisés et les scénarios axés sur l'innovation.

- Attentes de support : les modèles vendus directement par Azure sont fournis avec un support et une maintenance robustes fournis par Microsoft. Les modèles partenaires et communautaires sont pris en charge par leurs fournisseurs, avec différents niveaux de contrat SLA et de structures de support.

- Innovation et spécialisation : les modèles des partenaires et de la communauté offrent un accès rapide aux innovations spécialisées et aux capacités de niche, souvent développées par des laboratoires de recherche de pointe et des fournisseurs d’Intelligence Artificielle émergents.

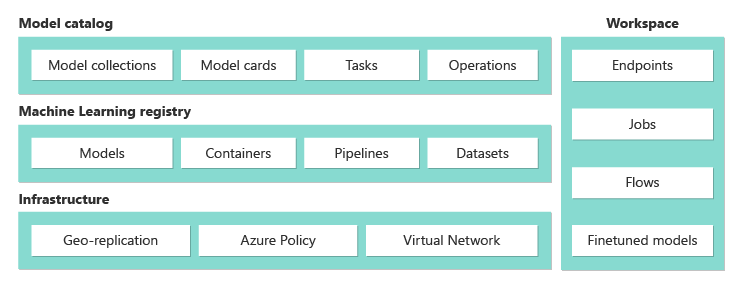

Vue d’ensemble des fonctionnalités du catalogue de modèles

Le catalogue de modèles dans le portail Foundry est le hub pour la découverte et l’utilisation d’un large éventail de modèles pour créer des applications IA génératives. Le catalogue de modèles comprend des centaines de modèles parmi les fournisseurs de modèles tels que Azure OpenAI, Mistral, Meta, Cohere, NVIDIA et Hugging Face, y compris les modèles que Microsoft a entraînés. Les modèles provenant de fournisseurs autres que Microsoft ne sont pas des produits Microsoft, tels que définis dans les conditions générales des produits Microsoft, et sont soumis aux conditions fournies avec les modèles.

Recherchez et découvrez des modèles qui répondent à vos besoins par le biais de la recherche et des filtres de mots clés. Le catalogue de modèles offre également le classement des performances du modèle et les métriques de benchmark pour les modèles sélectionnés. Access-les en sélectionnant View leaderboard et Compare models. Les données de benchmark sont également disponibles sous l’onglet Benchmarks de la carte de modèle.

Voici quelques-uns des filtres disponibles dans le catalogue de modèles :

- Collection : filtrez les modèles en fonction de la collection de fournisseurs de modèles.

- Industrie : filtrez les modèles formés sur un jeu de données spécifique au secteur.

- Fonctionnalités : filtrez les fonctionnalités de modèle uniques telles que le raisonnement et l’appel d’outils.

- Tâches d’inférence : filtrez les modèles en fonction du type de tâche d’inférence.

Voici quelques-uns des détails disponibles dans la carte de modèle :

- Faits rapides : informations clés sur le modèle en un coup d’œil rapide

- Onglet Détails : informations détaillées sur le modèle, telles que la description, les informations de version et le type de données pris en charge

- Onglet Benchmarks : Métriques d’évaluation des performances pour les modèles sélectionnés

- Onglet Déploiements : liste des déploiements existants pour le modèle

- Onglet Licence : Informations légales relatives aux licences de modèle

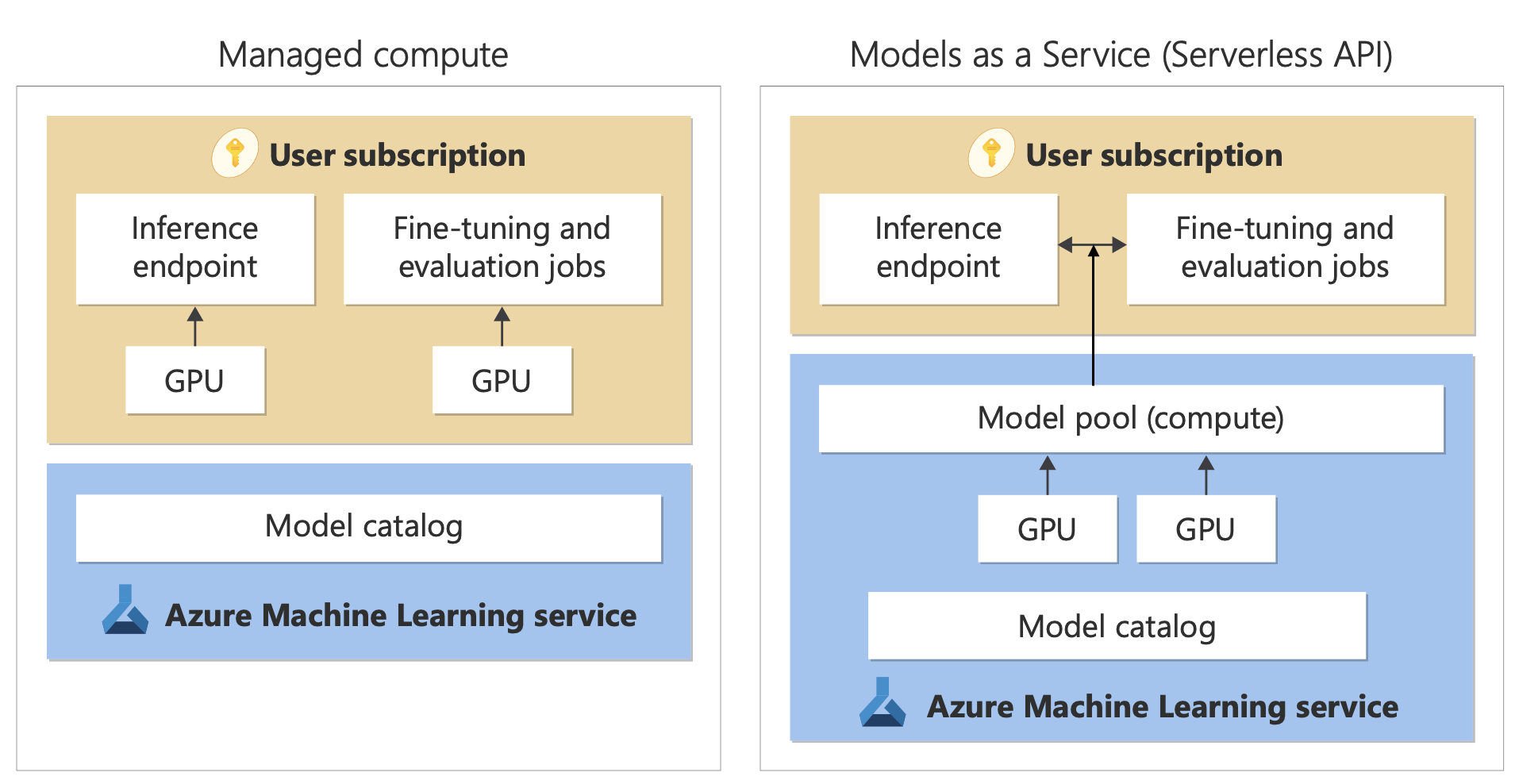

Options de déploiement de modèle : déploiements de calcul managé et serverless

Le catalogue de modèles offre deux options distinctes pour déployer des modèles pour votre utilisation : le calcul managé et les déploiements serverless. Pour en savoir plus sur le traitement des données avec les options de déploiement, consultez Données, confidentialité et sécurité pour l’utilisation de modèles via le catalogue de modèles dans le portail Microsoft Foundry (classique). Pour savoir comment Foundry gère les données que vous fournissez aux modèles Foundry vendus directement par Azure, consultez Data, confidentialité et sécurité des modèles directs Azure dans Microsoft Foundry.

Fonctionnalités des options de déploiement de modèle

Les options et fonctionnalités de déploiement disponibles pour chaque modèle varient, comme décrit dans le tableau suivant :

| Fonctionnalités | Calcul managé | Déploiement sans serveur |

|---|---|---|

| Expérience de déploiement et facturation | Les poids des modèles sont déployés sur des machines virtuelles dédiées avec des capacités de calcul managées. Un calcul managé, qui peut avoir un ou plusieurs déploiements, met à disposition une API REST pour l’inférence. Vous êtes facturé pour les heures principales de la machine virtuelle que les déploiements utilisent. | Accéder aux modèles par un déploiement qui configure une API. L’API fournit access au modèle que Microsoft héberge et gère pour l’inférence. Vous êtes facturé pour les entrées et sorties vers les API, généralement en jetons. Les informations de tarification sont fournies avant le déploiement. |

| Authentification des API | Clés et authentification Microsoft Entra. | Clés et authentification Microsoft Entra. |

| Sécurité du contenu | Utilisez les API du service Azure AI Content Safety. | Les filtres Azure AI Content Safety sont intégrés aux API d'inférence. Azure AI Content Safety filtres sont facturés séparément. |

| Isolation du réseau | Configurez un réseau managé pour les hubs Microsoft Foundry (classique). | Les réseaux managés suivent le paramètre d'indicateur d'accès au réseau public (PNA) pour votre ressource Foundry. Pour plus d’informations, consultez la section Isolation réseau pour les modèles déployés via des déploiements serverless plus loin dans cet article. |

Calcul managé

La possibilité de déployer des modèles en tant que calcul managé s’appuie sur les fonctionnalités de plateforme de Azure Machine Learning pour permettre l’intégration transparente de la large collection de modèles dans le catalogue de modèles dans l’ensemble du cycle de vie des opérations LLM (Large Language Model).

Important

Pour travailler avec des modèles déployables sur des infrastructures gérées, utilisez un projet centralisé dans le portail Foundry (classique). Pour en savoir plus sur les portails Foundry disponibles, consultez Qu’est-ce que Microsoft Foundry ?.

Disponibilité des modèles pour le déploiement en tant que calcul managé

Les modèles sont mis à disposition via des registres Azure Machine Learning. Ces registres permettent une approche d’apprentissage automatique pour hébergement et distribution de ressources Azure Machine Learning. Ces ressources incluent les pondérations de modèle, les runtimes de conteneurs pour l’exécution des modèles, les pipelines pour l’évaluation et l’affinage des modèles, et les jeux de données pour les benchmarks et les exemples.

Ces registres s’appuient sur une infrastructure hautement évolutive et prête pour l’entreprise qui :

Offre un accès à faible latence aux artefacts de modèle dans toutes les régions Azure avec géoréplication intégrée.

Prend en charge les exigences de sécurité d’entreprise, telles que la limitation des access aux modèles à l’aide de Azure Policy et le déploiement sécurisé à l’aide de réseaux virtuels managés.

Déploiement de modèles pour l’inférence avec le calcul managé

Les modèles disponibles pour le déploiement vers le calcul managé peuvent être déployés sur Azure Machine Learning calcul managé pour l’inférence en temps réel. Pour effectuer un déploiement sur un calcul managé, vous avez besoin d’un quota de machines virtuelles dans votre abonnement Azure pour que les produits spécifiques exécutent le modèle de manière optimale. Certaines versions vous permettent de déployer sur un quota temporairement partagé pour tester les modèles.

Découvrez-en davantage sur le déploiement de modèles :

- Pour déployer des modèles ouverts sur un calcul managé, consultez Guide pratique pour déployer et déduire un déploiement de calcul managé (classique).

- Pour déployer des modèles Foundry protégés sur des calculs gérés avec facturation avec paiement à l’utilisation, consultez Déployer des modèles Microsoft Foundry pour gérer le calcul avec facturation avec paiement à l’utilisation (classique) .

Création d’applications d’IA générative avec le calcul managé

La fonctionnalité de flux prompt dans Azure Machine Learning offre une expérience idéale pour le prototypage. Utilisez des modèles déployés avec le calcul managé dans le flux de requête avec l’outil Open Model LLM. Vous pouvez également utiliser l’API REST exposée par le calcul managé dans des outils LLM populaires comme LangChain avec l’extension Azure Machine Learning.

Sécurité du contenu pour les modèles déployés en tant que calcul managé

Le service Azure AI Content Safety est disponible pour une utilisation avec un calcul géré pour détecter différentes catégories de contenu nuisible, comme le contenu sexuel, la violence, la haine et les dommages. Vous pouvez également utiliser le service pour détecter des menaces avancées telles que la détection des risques de jailbreak et la détection de texte matériel protégé.

Pour obtenir une intégration de référence avec Azure AI Sécurité du Contenu pour Llama 2, consultez ce notebook. Vous pouvez également utiliser l’outil Content Safety (Text) dans le flux d’invite pour transmettre des réponses du modèle à Azure AI Content Safety pour le filtrage. Vous êtes facturé séparément pour une telle utilisation, comme décrit dans Azure AI Content Safety tarification.

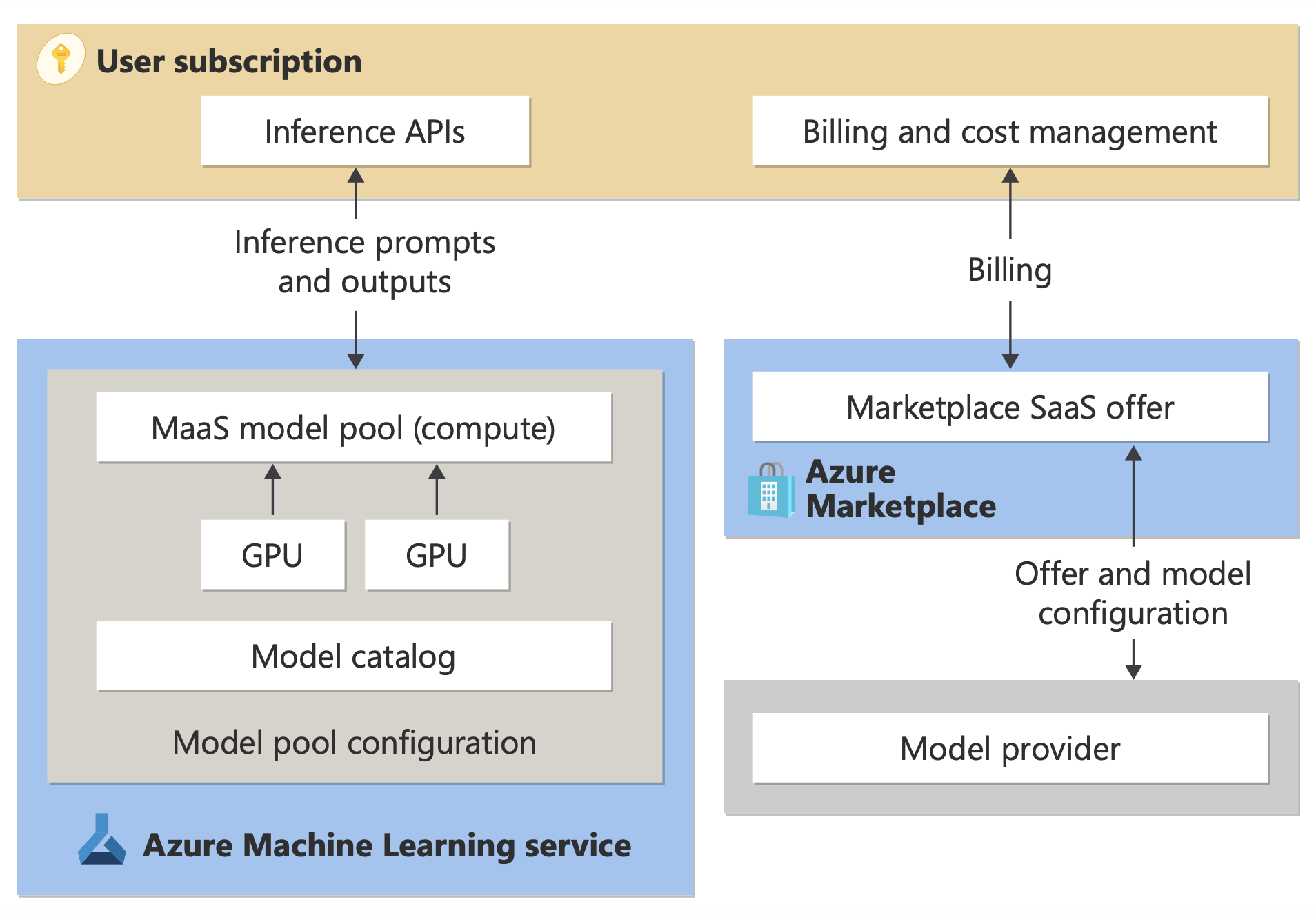

Déploiements sans serveur

Les déploiements serverless permettent de consommer des modèles Foundry en tant qu’API sans les héberger sur votre abonnement. Les modèles sont hébergés dans une infrastructure gérée par Microsoft, ce qui permet un accès basé sur l'API au modèle du fournisseur. Les access basées sur l’API peuvent réduire considérablement le coût d’accès à un modèle et simplifier l’expérience d’installation.

Les modèles disponibles pour les déploiements serverless sont proposés par le fournisseur de modèles, mais ils sont hébergés dans une infrastructure Azure gérée par Microsoft et accessibles via l'API. Les fournisseurs de modèles définissent les termes du contrat de licence et définissent le prix d’utilisation de leurs modèles. Service Azure Machine Learning :

- Gère l’infrastructure d’hébergement.

- Met à disposition les API d’inférence.

- Agit comme processeur de données pour les prompts envoyés et la génération de contenu des déploiements serverless.

Types de déploiement serverless

L’option de déploiement serverless pour les modèles Foundry offre deux catégories de déploiement principales : standard (paiement par jeton) et provisionné (capacité réservée). Dans chaque catégorie, vous pouvez choisir un traitement global, une zone de données ou un traitement régional en fonction de vos exigences de conformité.

Les types de déploiement serverless disponibles sont les suivants : Global Standard, Global Provisioned, Global Batch, Data Zone Standard, Data Zone Provisioned, Data Zone Batch, Standard, Regional Provisioned et Developer. Pour en savoir plus sur ces types de déploiement et sur la façon de choisir celui qui convient à votre utilisation, consultez Types de déploiement pour les modèles Microsoft Foundry.

Facturation des déploiements sans serveur

L’expérience de découverte, d’abonnement et de consommation pour les modèles déployés en tant que déploiements serverless se trouve dans le portail Foundry et Azure Machine Learning studio. Les utilisateurs acceptent les termes du contrat de licence régissant l’utilisation des modèles. Les informations de tarification pour la consommation sont disponibles pendant le déploiement.

Les modèles foundry des partenaires et de la communauté sont facturés via Azure Marketplace, conformément aux Conditions d’utilisation de la Place de marché commercialeMicrosoft.

Les modèles Foundry vendus directement par Azure sont facturés via les compteurs Azure en tant que services de consommation de première partie. Comme décrit dans les termes du produit, vous achetez des services de consommation de première partie à l'aide des compteurs Azure, mais ils ne sont pas soumis aux conditions de service d'Azure. L’utilisation de ces modèles est soumise aux termes du contrat de licence fourni.

Réglage des modèles

Certains modèles prennent également en charge le réglage précis. Pour ces modèles, vous pouvez utiliser des déploiements managés ou sans serveur pour affiner les modèles avec les données que vous fournissez. Pour plus d’informations, consultez Ajuster les modèles avec Microsoft Foundry (classique).

RAG avec des modèles déployés en mode sans serveur

Dans le portail Foundry, utilisez des index vectoriels et une génération augmentée par récupération (RAG) avec des modèles déployés via des déploiements serverless pour générer des incorporations et inférer en fonction des données personnalisées. Ces incorporations et inférences peuvent ensuite générer des réponses spécifiques à votre cas d’utilisation. Pour plus d’informations, consultez Générer et consommer des index vectoriels dans le portail Microsoft Foundry (classique).

Disponibilité régionale des offres et des modèles

La facturation par jeton est disponible uniquement pour les utilisateurs dont l’abonnement Azure appartient à un compte de facturation dans un pays ou une région où le fournisseur de modèle a rendu l’offre disponible. Si l’offre est disponible dans la région appropriée, l’utilisateur doit disposer d’une ressource project dans la région Azure où le modèle est disponible pour le déploiement ou le réglage précis, le cas échéant. Pour des informations plus détaillées, consultez la disponibilité par région pour les modèles dans les déploiements serverless (classiques).

Sécurité du contenu pour les modèles déployés via des architectures sans serveur

Pour les modèles de langage déployés via l’API serverless, Azure IA implémente une configuration par défaut de Azure AI Content Safety filtres de modération de texte qui détectent du contenu dangereux tel que la haine, l’auto-préjudice, le contenu sexuel et violent. Pour en savoir plus sur le filtrage de contenu, consultez Gardes-fous et contrôles pour les modèles vendus directement par Azure.

Conseil / Astuce

Le filtrage de contenu n’est pas disponible pour certains types de modèles déployés via l’API serverless. Ces types de modèles incluent des modèles d’incorporation et des modèles de série chronologique.

Le filtrage de contenu se produit de façon synchrone lorsque le service traite les invites pour générer du contenu. Vous pouvez être facturé séparément en fonction de Azure AI Content Safety tarification pour cette utilisation. Vous pouvez désactiver le filtrage de contenu pour des points de terminaison serverless individuels :

- Au moment où vous déployez un modèle de langage pour la première fois

- Ultérieurement, en sélectionnant le bouton bascule de filtrage du contenu dans la page des détails du déploiement

Supposons que vous décidez d'utiliser une API autre que l'API d'inférence Model pour utiliser un modèle déployé via une API serverless. Dans ce cas, le filtrage de contenu n'est pas activé, sauf si vous l'implémentez séparément à l'aide de Azure AI Content Safety.

Pour commencer avec Azure AI Content Safety, consultez Démarrage rapide : Analyser le contenu texte. Si vous n’utilisez pas de filtrage de contenu lors de l’utilisation de modèles déployés via l’API serverless, vous risquez davantage d’exposer les utilisateurs à du contenu dangereux.

Isolation réseau pour les modèles déployés via des déploiements serverless

Les points de terminaison des modèles déployés en tant que déploiements serverless suivent le paramètre d’indicateur d’accès réseau public du hub Foundry qui contient le projet où le déploiement existe. Pour sécuriser votre déploiement serverless, désactivez l’indicateur d'accès au réseau public sur votre hub Foundry. Vous pouvez sécuriser la communication entrante d’un client vers votre point de terminaison à l’aide d’un point de terminaison privé pour le hub.

Pour définir l’indicateur de access réseau public pour le hub Foundry :

- Accédez au Azure portal.

- Recherchez le groupe de ressources auquel appartient le hub, puis sélectionnez votre hub Foundry dans les ressources répertoriées pour ce groupe de ressources.

- Dans la page de présentation du hub, dans le volet de gauche, accédez à Paramètres>Mise en réseau.

- Sous l’onglet Public access, configurez les paramètres de l’indicateur de access réseau public.

- Enregistrez vos modifications. La propagation des modifications peut prendre jusqu’à cinq minutes.

Limites

Si vous disposez d’un hub Foundry avec un point de terminaison privé créé avant le 11 juillet 2024, les déploiements serverless ajoutés à des projets dans ce hub ne suivent pas la configuration réseau du hub. Au lieu de cela, créez un point de terminaison privé pour le hub et un nouveau déploiement serverless dans le project afin que les nouveaux déploiements puissent suivre la configuration réseau du hub.

Si vous disposez d’un hub Foundry avec des déploiements serverless créés avant le 11 juillet 2024 et que vous activez un point de terminaison privé sur ce hub, les déploiements serverless existants ne suivent pas la configuration réseau du hub. Pour que les déploiements serverless dans le hub suivent la configuration réseau du hub, créez à nouveau les déploiements.

Actuellement, Azure OpenAI On Your Data le support n'est pas disponible pour les déploiements serverless dans des hubs privés, car les hubs privés ont l'indicateur d'accès au réseau public désactivé.

Toute modification de configuration réseau (par exemple, l’activation ou la désactivation de l’indicateur de access réseau public) peut prendre jusqu’à cinq minutes pour se propager.

Cycle de vie des modèles : Dépréciation et retrait

Les modèles IA évoluent rapidement et lorsqu’une nouvelle version ou un nouveau modèle avec des fonctionnalités mises à jour dans la même famille de modèles devient disponible, les modèles plus anciens peuvent être supprimés dans le catalogue de modèles Foundry. Pour permettre une transition fluide vers une version plus récente du modèle, certains modèles permettent aux utilisateurs d’activer les mises à jour automatiques. Pour en savoir plus sur le cycle de vie des différents modèles, les dates de mise hors service des modèles à venir et les modèles de remplacement suggérés et les versions, consultez :

- Dépréciations et retraits de modèles dans Azure OpenAI associés à Microsoft Foundry

- Dépréciation et mise hors service des modèles Microsoft Foundry