Remarque

L’accès à cette page requiert une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page requiert une autorisation. Vous pouvez essayer de modifier des répertoires.

Le traitement prioritaire offre des performances à faible latence avec la flexibilité du paiement à l’utilisation. Dans cet article, vous activez le traitement prioritaire sur un déploiement de modèle, vérifiez le niveau de service qui a traité vos demandes et surveillez les coûts associés.

Conditions préalables

- Un abonnement Azure - Create one gratuitement.

- Projet Microsoft Foundry avec un modèle de type de déploiement

GlobalStandardouDataZoneStandard. - Versions de modèle

2025-12-01ou ultérieures.

Cas d’usage clés

- Latence cohérente et faible pour les expériences utilisateur réactives.

- Simplicité de paiement à l’utilisation sans engagement à long terme.

- Trafic pendant les heures ouvrables ou en rafales qui tire parti des performances évolutives et rentables. Si vous le souhaitez, vous pouvez combiner le traitement prioritaire avec des unités de débit approvisionnées (PTU) pour une capacité à état stable et une optimisation des coûts.

Cible de latence

| Modèle | Valeur cible de latence2 |

|---|---|

| gpt-5.4, 2026-03-051 | 99% > 50 jetons par seconde |

| gpt-5.2, 2025-12-11 | 99% > 50 jetons par seconde |

| gpt-5.1, 2025-11-13 | 99% > 50 jetons par seconde |

| gpt-4.1, 2025-04-141 | 99% > 80 jetons par seconde |

1 Demandes de contexte long (autrement dit, les demandes estimées à plus de 128 000 jetons d’invite) seront rétrogradées au traitement standard et vous serez facturé au taux de niveau standard.

2 Calculé en tant que latence de requête p50 sur une base de 5 minutes.

Disponibilité du traitement prioritaire par type de déploiement

Le traitement de priorité peut être activé dans les déploiements standard globaux ou les déploiements standard de la zone de données (ÉTATS-Unis). Pour plus d’informations sur la tarification, consultez la page de tarification Azure OpenAI.

Disponibilité globale du modèle standard

| Région | gpt-5.5, 2026-04-24 | gpt-5.4-mini, 2026-03-17 | gpt-5.4, 2026-03-05 | gpt-5.2, 2025-12-11 | gpt-5.1, 2025-11-13 | gpt-4.1, 2025-04-14 |

|---|---|---|---|---|---|---|

| australiaeast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| brazilsouth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| canadacentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| canadaeast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| centralus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| eastus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| eastus2 | ✅ | ✅ | ✅ | ✅ | ✅ | - |

| francecentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| allemagnewestcentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| italynorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| japaneast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| koreacentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| northcentralus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| norwayeast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| polognecentral | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| southafricanorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| southcentralus | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| sud-estasia | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| sud de l'Inde | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| spaincentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| Sweden Central | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| Suisse-Nord | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| switzerlandwest | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| uaenorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| uksouth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westeurope | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westus3 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

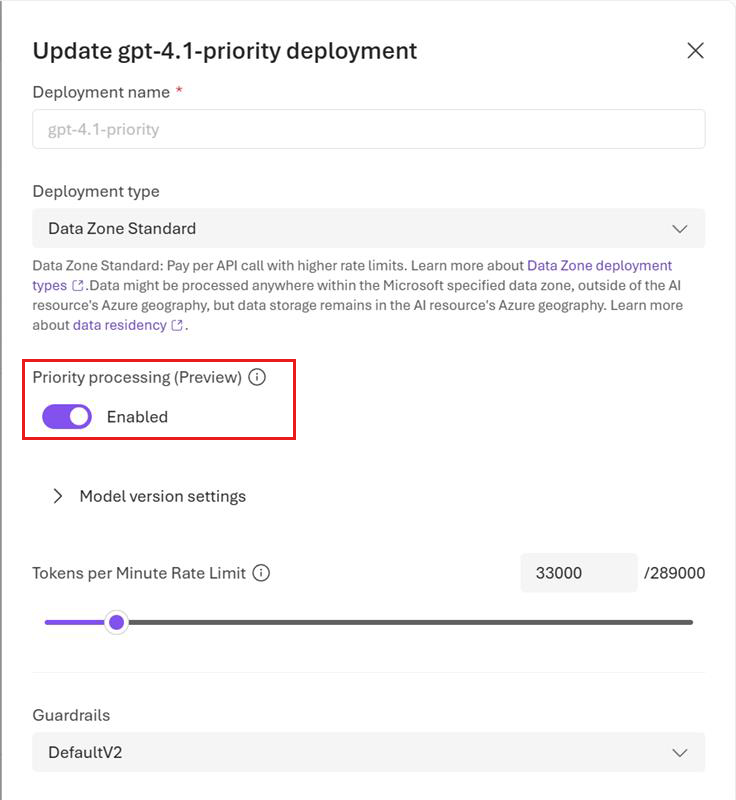

Activer le traitement de priorité au niveau du déploiement

Vous pouvez activer le traitement de priorité au niveau du déploiement et (éventuellement) au niveau de la requête.

Note

Le traitement de priorité peut être activé dans les déploiements standard global ou de zone de données (ÉTATS-Unis). Le traitement de priorité utilise le même quota que le traitement standard.

Dans le portail Microsoft Foundry, activez le traitement Priority basculez sur la page des détails du déploiement lors de la création du déploiement ou mettez à jour le paramètre d’un modèle déployé en modifiant les détails du déploiement.

Note

Si vous préférez utiliser du code pour activer le traitement de priorité au niveau du déploiement, vous pouvez le faire via l’API REST pour le déploiement en définissant l’attribut service_tier comme suit : "properties" : {"service_tier" : "priority"} Les valeurs autorisées pour l’attribut service_tier sont default et priority.

default implique un traitement standard, tandis qu’il priority active le traitement prioritaire.

Une fois qu’un déploiement de modèle est configuré pour utiliser le traitement de priorité, vous pouvez commencer à envoyer des demandes au modèle.

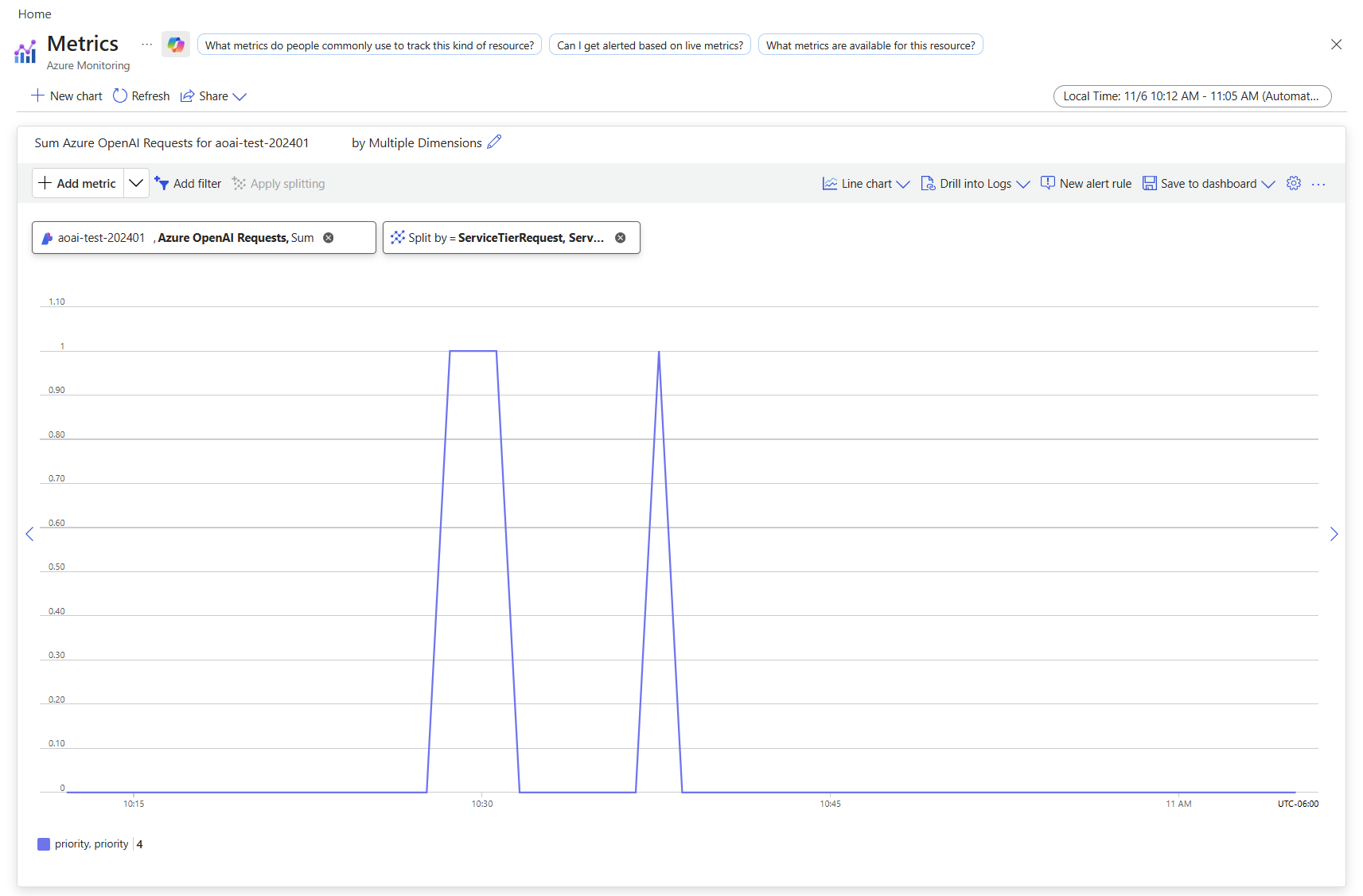

Afficher les métriques d’utilisation

Vous pouvez afficher la mesure d’utilisation de votre ressource dans la section Azure Monitor du portail Azure.

Pour afficher le volume de demandes traitées par traitement standard par rapport à un traitement par priorité, répartie selon le niveau de service (standard ou priorité) inclus dans la requête d’origine :

- Connectez-vous à https://portal.azure.com.

- Accédez à votre ressource OpenAI Azure et sélectionnez l’option Metrics dans le volet de navigation gauche.

- Dans la page des métriques, ajoutez la métrique des requêtes Azure OpenAI. Vous pouvez également sélectionner d’autres métriques telles que la latence Azure OpenAI, l’utilisation Azure OpenAI et d’autres.

- Sélectionnez Ajouter un filtre pour sélectionner le déploiement standard pour lequel les demandes de traitement prioritaire ont été traitées.

- Sélectionnez Appliquer le fractionnement pour fractionner les valeurs par ServiceTierRequest et ServiceTierResponse.

Pour plus d’informations sur la surveillance de vos déploiements, consultez Monitor Azure OpenAI.

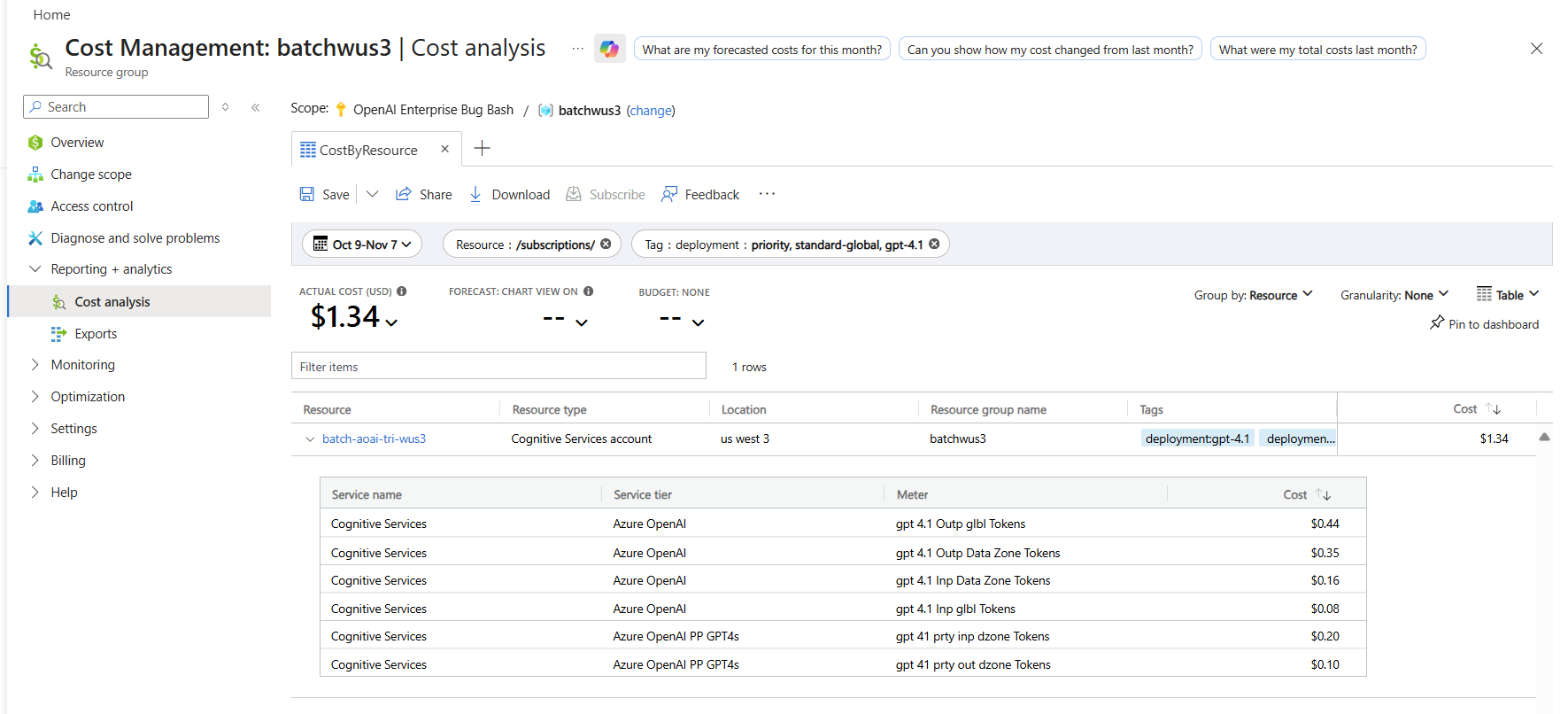

Surveiller les coûts

Vous pouvez voir une répartition des coûts pour les demandes prioritaires et standard dans la page d'analyse des coûts du portail Azure en filtrant les balises de nom de déploiement et de facturation comme suit :

- Accédez à la page Analyse des coûts dans le portail Azure.

- (Facultatif) Filtrez par ressource.

- Pour filtrer par nom de déploiement : ajoutez un filtre pour la balise de facturation, sélectionnez le déploiement comme valeur, puis choisissez votre nom de déploiement.

Pour plus d’informations sur la tarification du traitement prioritaire, consultez la Azure OpenAI Service vue d’ensemble des tarifs.

Activer le traitement de priorité au niveau de la demande

L’activation du traitement de priorité au niveau de la requête est facultative. L’API de saisie semi-automatique de conversation et l’API réponses ont un attribut service_tier facultatif qui spécifie le type de traitement à utiliser lors du traitement d’une demande. L'exemple suivant montre comment définir service_tier à priority dans une demande de réponse.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

Utilisez l’attribut service_tier pour remplacer le paramètre au niveau du déploiement.

service_tier peut prendre les valeurs auto, defaultet priority.

Si vous ne définissez pas l’attribut, il est défini par défaut sur

auto.service_tier = autosignifie que la requête utilise le niveau de service configuré dans le déploiement.service_tier = defaultsignifie que la requête utilise la tarification et les performances standard pour le modèle sélectionné.service_tier = prioritysignifie que la requête utilise le niveau de service de traitement prioritaire.

Le tableau suivant récapitule le niveau de service qui traite vos demandes en fonction des paramètres au niveau du déploiement et des requêtes pour service_tier.

| Paramètre au niveau du déploiement | Paramètre au niveau de la requête | Demande traitée par le niveau de service |

|---|---|---|

| Par défaut | auto, par défaut | Standard |

| Par défaut | Priorité | Traitement prioritaire |

| Priorité | auto, priorité | Traitement prioritaire |

| Priorité | Par défaut | Standard |

Limitations

Actuellement, le service ne prend pas en charge les déploiements standard régionaux et les déploiements standard de zone de données de l’UE.

Le service peut réacheminer certaines demandes prioritaires vers un traitement standard* dans les scénarios suivants :

- Si des augmentations rapides de vos jetons de traitement prioritaires par minute entraînent l’atteinte des limites de débit de rampe. Actuellement, la limite de taux d’augmentation graduelle est définie comme une augmentation du trafic de plus de 50 % de jetons par minute en moins de 15 minutes.

- Pendant les périodes de pic de demandes de traitement prioritaire.

- Demandes de contextes longs envoyées à certains modèles répertoriés dans le tableau cible de latence.

Conseil

Si vous rencontrez régulièrement des limites d’augmentation graduelle, envisagez d’acheter des PTU à la place ou en complément du traitement prioritaire.

* Le service facture les demandes traitées par le niveau de service standard aux tarifs standard. Les demandes traitées par le niveau de service standard incluent

service_tier = defaultdans la réponse, tandis que les demandes traitées par le niveau de traitement prioritaire sont inclusservice_tier = prioritydans la réponse.

Dépannage

| Problème | Cause | Résolution |

|---|---|---|

| Demandes rétrogradées au niveau standard | L’une de ces situations : - Trafic augmenté de plus de 50 % en jetons par minute en moins de 15 minutes, atteignant la limite du taux de montée en charge. - Demandes envoyées pendant les périodes de pic de demandes au traitement prioritaire. - Demandes de contexte longues envoyées à certains modèles répertoriés dans la table cible de latence. |

- Augmentez progressivement le trafic si vous avez rencontré des limites de débit de rampe. - Envisagez d’acheter des PTU pour une capacité en régime permanent. |