Optimiser des modèles Meta Llama dans Azure AI Studio

Important

Certaines des fonctionnalités décrites dans cet article peuvent uniquement être disponibles en préversion. Cette préversion est fournie sans contrat de niveau de service, nous la déconseillons dans des charges de travail de production. Certaines fonctionnalités peuvent être limitées ou non prises en charge. Pour plus d’informations, consultez Conditions d’Utilisation Supplémentaires relatives aux Évaluations Microsoft Azure.

Azure AI Studio vous permet d’adapter des modèles de langage volumineux à vos jeux de données personnels à l’aide d’un processus appelé affinage.

L’affinage offre une valeur significative en activant la personnalisation et l’optimisation de tâches et d’applications spécifiques. Cela aboutit sur des performances améliorées, une optimisation des coûts, une latence réduite et des sorties personnalisées.

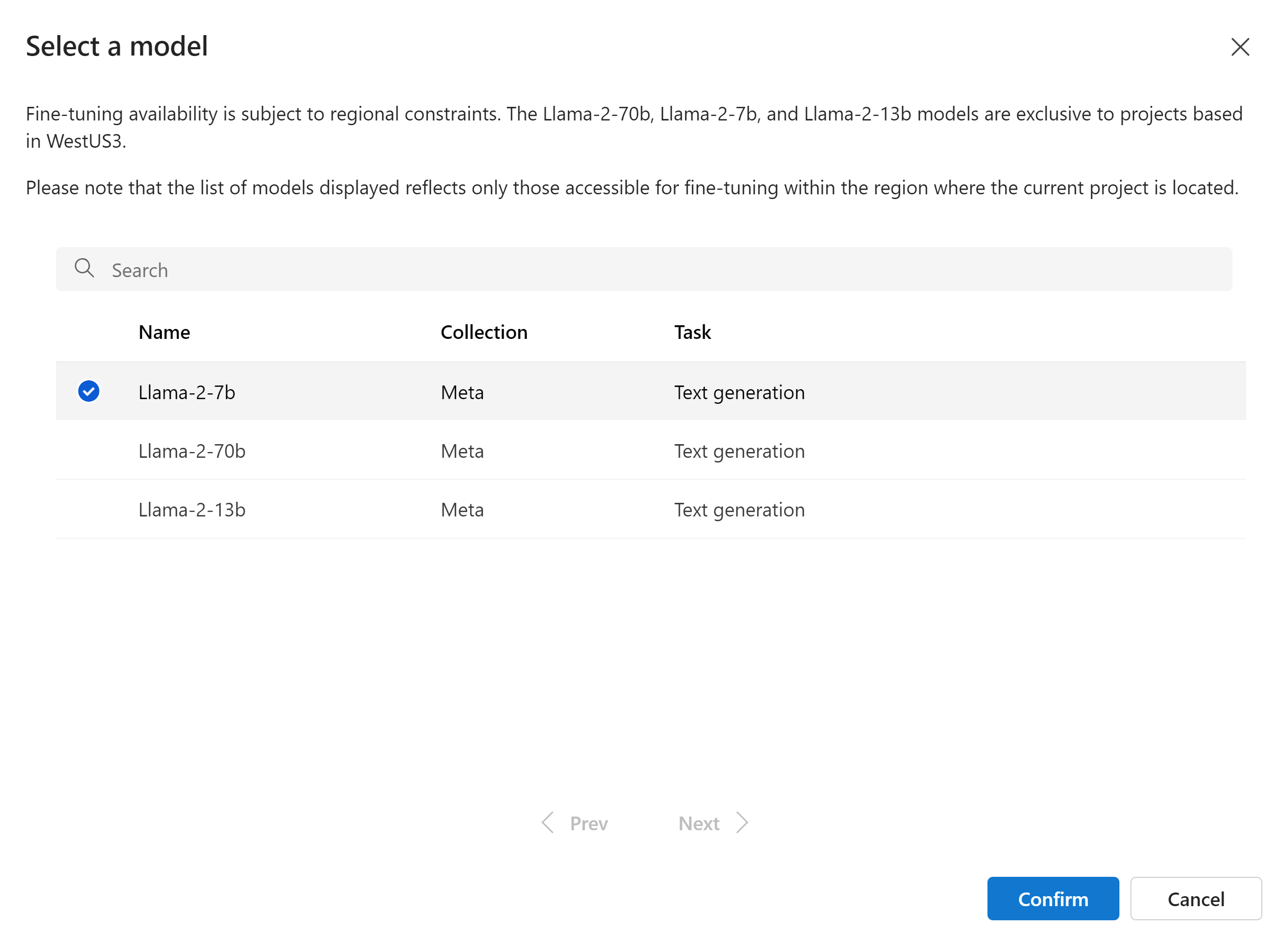

Dans cet article, vous découvrez comment optimiser des modèles Meta Llama dans Azure AI Studio.

La famille Meta Llama de grands modèles de langage (LLM) est une collection de modèles texte génératifs préentraînés et optimisés dont l’échelle varie de 7 à 70 milliards de paramètres. La famille de modèles inclut également des versions affinées optimisées pour les cas d’usage de dialogue avec un apprentissage par renforcement à partir de la rétroaction humaine (RLHF), appelée Llama-2-chat.

Modèles

L’optimisation des modèles Llama 3 n’est actuellement pas prise en charge.

Prérequis

L’optimisation des modèles Llama 3 n’est actuellement pas prise en charge.

Inscription du fournisseur d’abonnement

Vérifiez que l’abonnement est inscrit auprès du fournisseur de ressources Microsoft.Network.

Connectez-vous au portail Azure.

Sélectionnez Abonnements dans le menu de gauche.

Sélectionnez l’abonnement que vous souhaitez utiliser.

Sélectionnez Paramètres>Fournisseurs de ressources dans le menu de gauche.

Vérifiez que Microsoft.Network figure dans la liste des fournisseurs de ressources. Sinon, ajoutez-le.

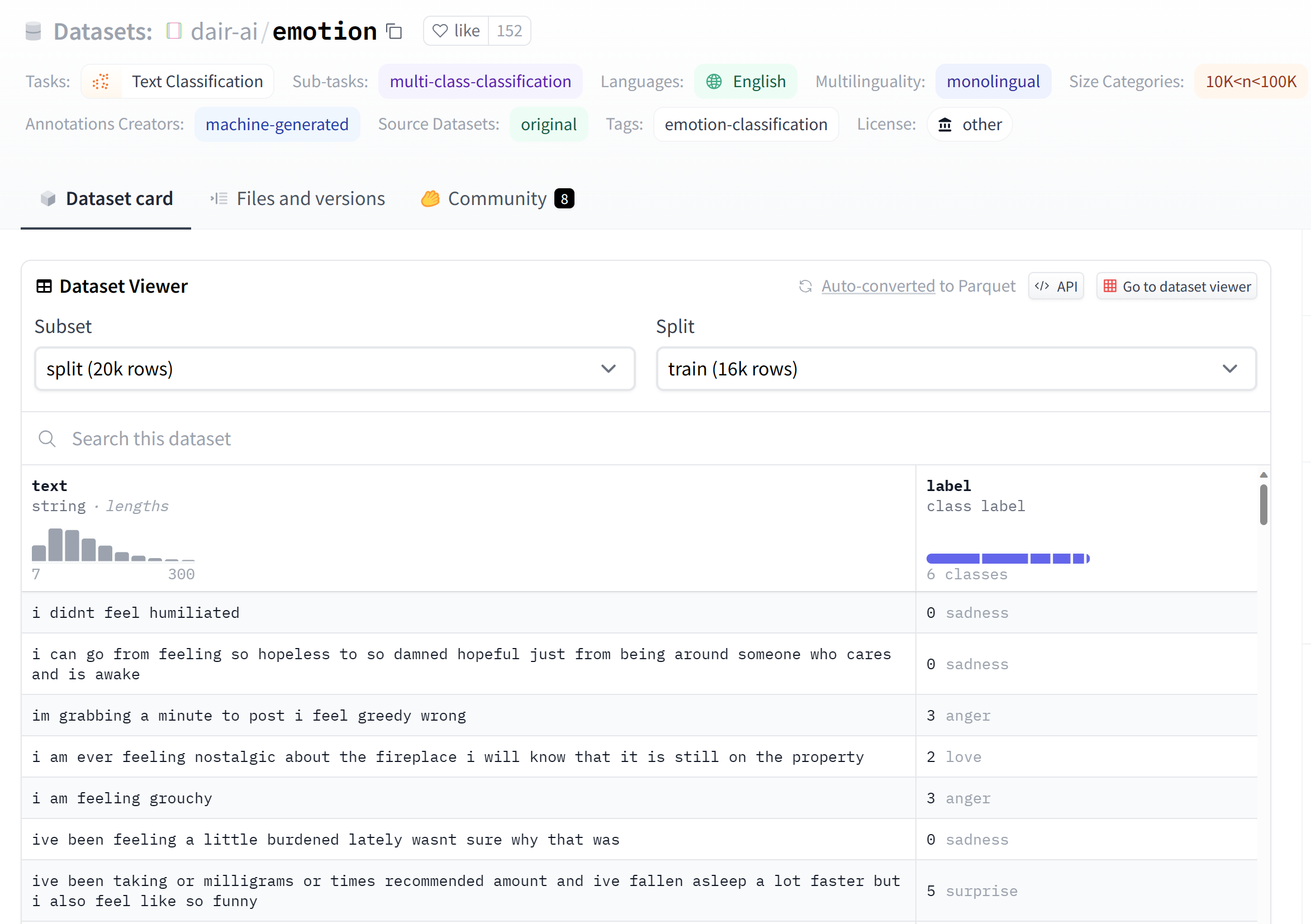

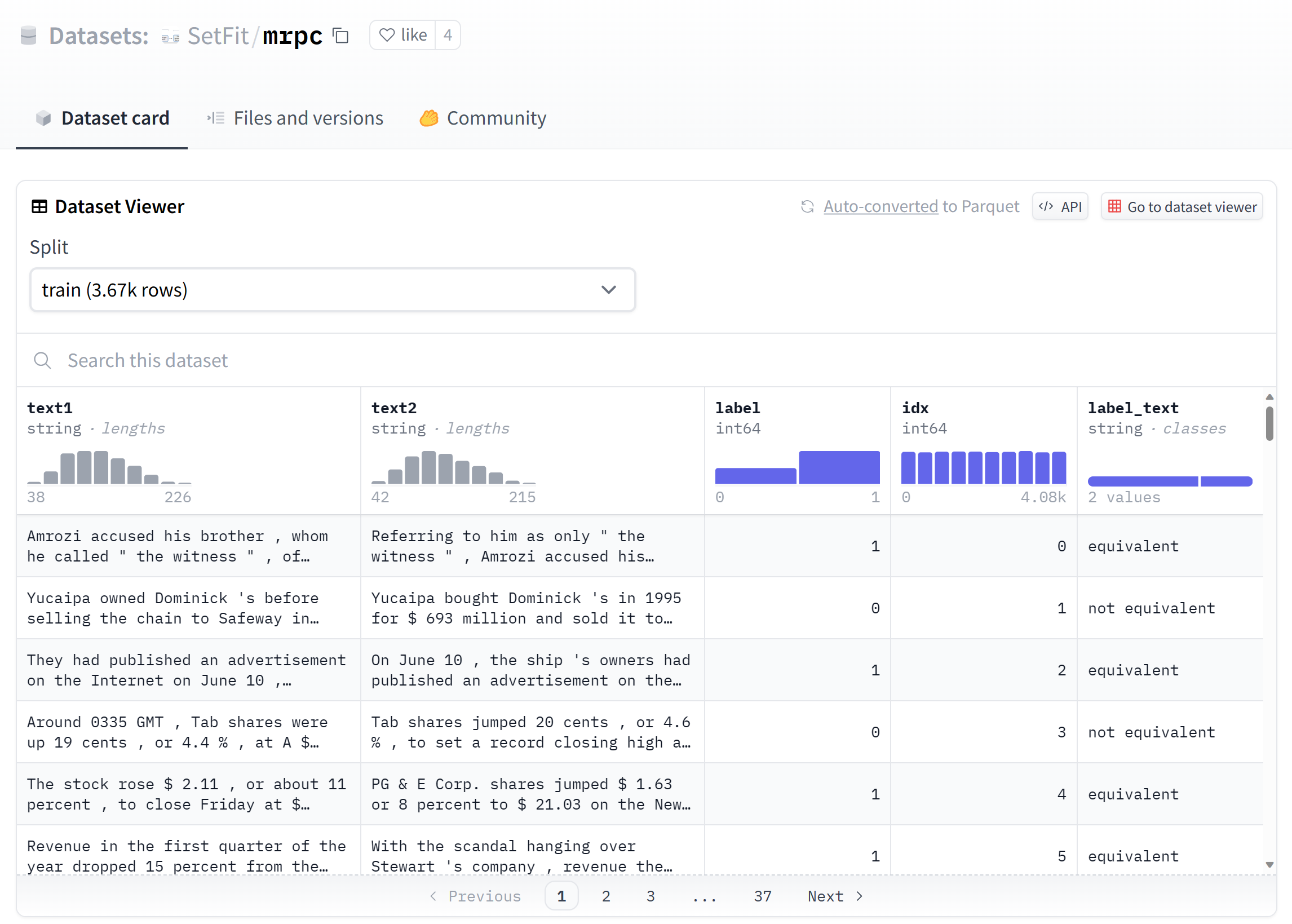

Préparation des données

Préparez vos données d’entraînement et de validation pour affiner votre modèle. Vos données d’apprentissage et vos jeux de données de validation se composent d’exemples d’entrée et de sortie de la façon dont vous souhaitez que le modèle fonctionne.

Assurez-vous que vos exemples d’apprentissage suivent le format attendu pour l’inférence. Pour affiner efficacement des modèles, assurez-vous de disposer d’un jeu de données équilibré et diversifié.

Cela implique la maintenance de l’équilibre des données, y compris différents scénarios, et l’affinage périodique des données d’apprentissage afin de les aligner sur les attentes réelles, ce qui aboutit à des réponses de modèle plus précises et équilibrées.

Différents types de modèles nécessitent un format différent de données d’entraînement.

Les données d’entraînement et de validation que vous utilisez doivent être mises en forme en tant que document JSON Lines (JSONL). Pour Llama-3-80B-chat, le jeu de données d’optimisation doit être mis en forme au format conversationnel utilisé par l’API des complétions de conversation.

Exemple de format de fichier

{"messages": [{"role": "system", "content": "You are an Xbox customer support agent whose primary goal is to help users with issues they are experiencing with their Xbox devices. You are friendly and concise. You only provide factual answers to queries, and do not provide answers that are not related to Xbox."}, {"role": "user", "content": "Is Xbox better than PlayStation?"}, {"role": "assistant", "content": "I apologize, but I cannot provide personal opinions. My primary job is to assist you with any issues related to your Xbox device. Do you have any Xbox-related issues that need addressing?"}]}

{"messages": [{"role": "system", "content": "You are an Xbox customer support agent whose primary goal is to help users with issues they are experiencing with their Xbox devices. You are friendly and concise. You only provide factual answers to queries, and do not provide answers that are not related to Xbox."}, {"role": "user", "content": "Can I play PC games on my Xbox?"}, {"role": "assistant", "content": "While Xbox consoles don't natively support PC games, they can play an array of Xbox games, many of which are also available on PC. Can I assist you with finding games compatible with your Xbox device?"}]}

{"messages": [{"role": "system", "content": "You are an Xbox customer support agent whose primary goal is to help users with issues they are experiencing with their Xbox devices. You are friendly and concise. You only provide factual answers to queries, and do not provide answers that are not related to Xbox."}, {"role": "user", "content": "I'm having trouble connecting my Xbox to the Wi-Fi."}, {"role": "assistant", "content": "No worries, let's go through the network settings on your Xbox. Can you please tell me what happens when you try to connect it to the Wi-Fi?"}]}

Le type de fichier pris en charge est JSON Lines. Les fichiers sont chargés dans le magasin de données par défaut et mis à disposition dans votre projet.

Optimiser un modèle Meta Llama

L’optimisation des modèles Llama 3 n’est actuellement pas prise en charge.

Nettoyage de vos modèles affinés

Vous pouvez supprimer un modèle affiné de la liste des modèles d’affinage dans Azure AI Studio ou depuis la page des détails du modèle. Sélectionnez le modèle affiné à supprimer de la page Affinage, puis sélectionnez le bouton Supprimer pour le supprimer.

Remarque

Vous ne pouvez pas supprimer un modèle personnalisé si un déploiement de ce modèle existe. Vous devez d’abord supprimer le déploiement de votre modèle avant de pouvoir supprimer votre modèle personnalisé.

Coûts et quotas

Considérations relatives aux coûts et aux quotas pour les modèles Meta Llama optimisés en tant que service

Les modèles Meta Llama optimisés en tant que service sont offerts par Meta via la Place de marché Azure et intégrés à Azure AI Studio pour y être utilisés. Vous trouverez la tarification de la Place de marché Azure lors du déploiement ou de l’optimisation des modèles.

Chaque fois qu’un projet s’abonne à une offre donnée à partir de la Place de marché Azure, une nouvelle ressource est créée pour suivre les coûts associés à sa consommation. La même ressource est utilisée pour suivre les coûts associés à l’inférence et à l’optimisation ; plusieurs compteurs sont cependant disponibles pour suivre chaque scénario indépendamment.

Pour plus d’informations sur le suivi des coûts, consultez Surveiller les coûts des modèles proposés dans la Place de marché Azure.

Filtrage du contenu

Les modèles déployés en tant que service avec paiement à l’utilisation sont protégés par Azure AI Content Safety. Quand ils sont déployés sur des points de terminaison en temps réel, vous pouvez ne pas accepter cette fonctionnalité. Avec Azure AI Sécurité du Contenu activé, l’invite et la complétion sont soumises à un ensemble de modèles de classification visant à détecter et à empêcher la production d’un contenu nuisible. Le système de filtrage du contenu détecte les catégories spécifiques de contenu potentiellement nuisible dans les invites d’entrée et les achèvements de sortie et prend des mesures correspondantes. En savoir plus sur Azure AI Sécurité du Contenu.

Étapes suivantes

Commentaires

Bientôt disponible : Tout au long de 2024, nous allons supprimer progressivement GitHub Issues comme mécanisme de commentaires pour le contenu et le remplacer par un nouveau système de commentaires. Pour plus d’informations, consultez https://aka.ms/ContentUserFeedback.

Envoyer et afficher des commentaires pour