Remarque

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

Important

Le serveur RStudio hébergé par Databricks est déprécié et n’est disponible que sur databricks Runtime versions 15.4 et antérieures. Pour d’autres options, consultez Alternatives au serveur RStudio Server hébergé.

Utilisez votre navigateur Web pour vous connecter à votre espace de travail Azure Databricks, puis vous connecter à une capacité de calcul Azure Databricks sur laquelle RStudio Server est installé, au sein de cet espace de travail.

Pour RStudio Server hébergé, vous pouvez utiliser l’édition Open Source (OS) ou RStudio Workbench (précédemment RStudio Server Pro) sur Azure Databricks. Si vous souhaitez utiliser RStudio Workbench (RStudio Server Pro), vous devez transférer votre licence RStudio Workbench (RStudio Server Pro) existante vers Azure Databricks. Consultez RStudio Workbench (anciennement RStudio Server Pro).

Databricks recommande d’utiliser Databricks Runtime pour Machine Learning (Databricks Runtime ML) sur des clusters Azure Databricks avec RStudio Server afin de réduire les temps de démarrage de la capacité de calcul. Databricks Runtime ML contient une version non modifiée du package de l’édition Open Source de RStudio Server. Le code source de ce package est disponible sur GitHub. Le tableau suivant indique la version de l’édition Open Source de RStudio Server préinstallée sur les versions ML de Databricks Runtime.

| Version de Databricks Runtime pour ML | Version RStudio Server |

|---|---|

| Databricks Runtime 9.1 LTS ML et 10.4 LTS ML | 1.4 |

RStudio Server Open Source (SYSTÈME d’exploitation)

RStudio Server Open Source est préinstallé sur des clusters Azure Databricks qui utilisent Databricks Runtime pour Machine Learning (Databricks Runtime ML).

Exigences

- Le cluster doit être un cluster polyvalent.

- Vous devez avoir l’autorisation PEUT ATTACHER À pour ce cluster. L’administrateur de cluster peut vous accorder cette autorisation. Consultez Autorisations de calcul.

- Le cluster ne doit pas être doté de contrôle d’accès à la table, d’arrêt automatique, ou de transmission des informations d'identification activées.

- Le cluster ne doit pas utiliser le mode d’accèsStandard.

- Le cluster ne doit pas avoir la configuration Spark

spark.databricks.pyspark.enableProcessIsolationdéfinie surtrue. - Vous devez disposer d’une licence Pro flottante RStudio Server pour utiliser l’édition Pro.

Note

Bien que le cluster puisse utiliser un mode d’accès prenant en charge Unity Catalog, vous ne pouvez pas utiliser RStudio Server à partir de ce cluster pour accéder aux données dans Unity Catalog.

Ouvrir RStudio Server

Pour ouvrir le système d’exploitation RStudio Server sur un cluster Databricks, procédez comme suit :

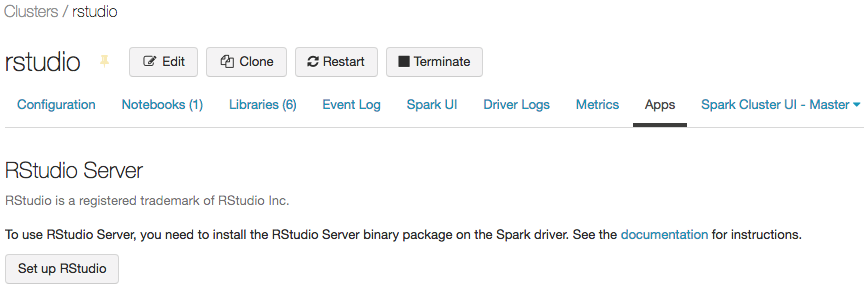

Ouvrez la page des détails du cluster.

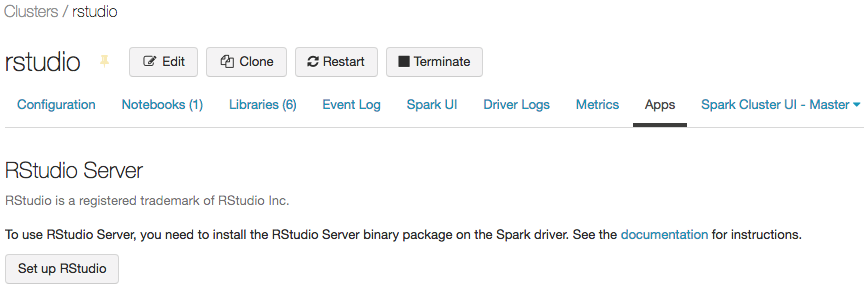

Démarrez le cluster, puis cliquez sur l’onglet Apps :

Dans l’onglet Applications, cliquez sur le bouton Configurer RStudio. Cela génère un mot de passe à usage unique pour vous. Cliquez sur le lien Afficher pour l’afficher et copiez le mot de passe.

Cliquez sur le lien Ouvrir RStudio pour ouvrir l’interface utilisateur dans un nouvel onglet. Entrez votre nom d’utilisateur et votre mot de passe dans le formulaire de connexion, puis connectez-vous.

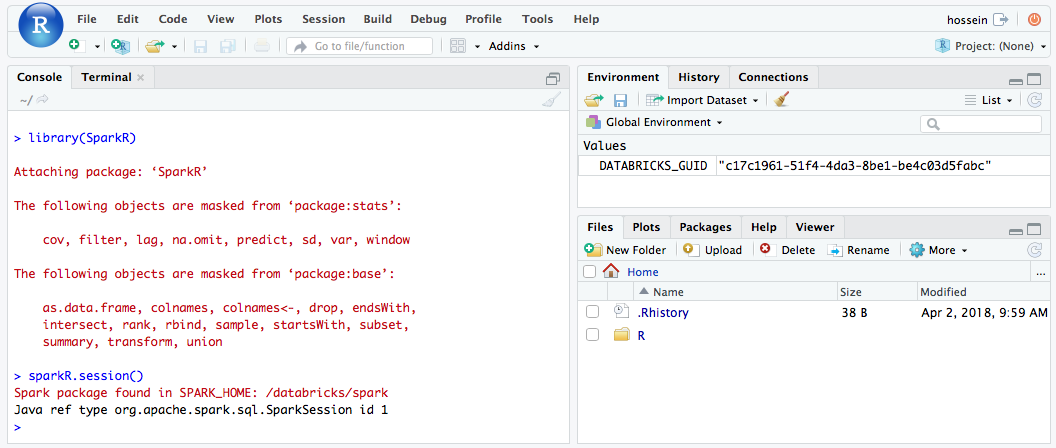

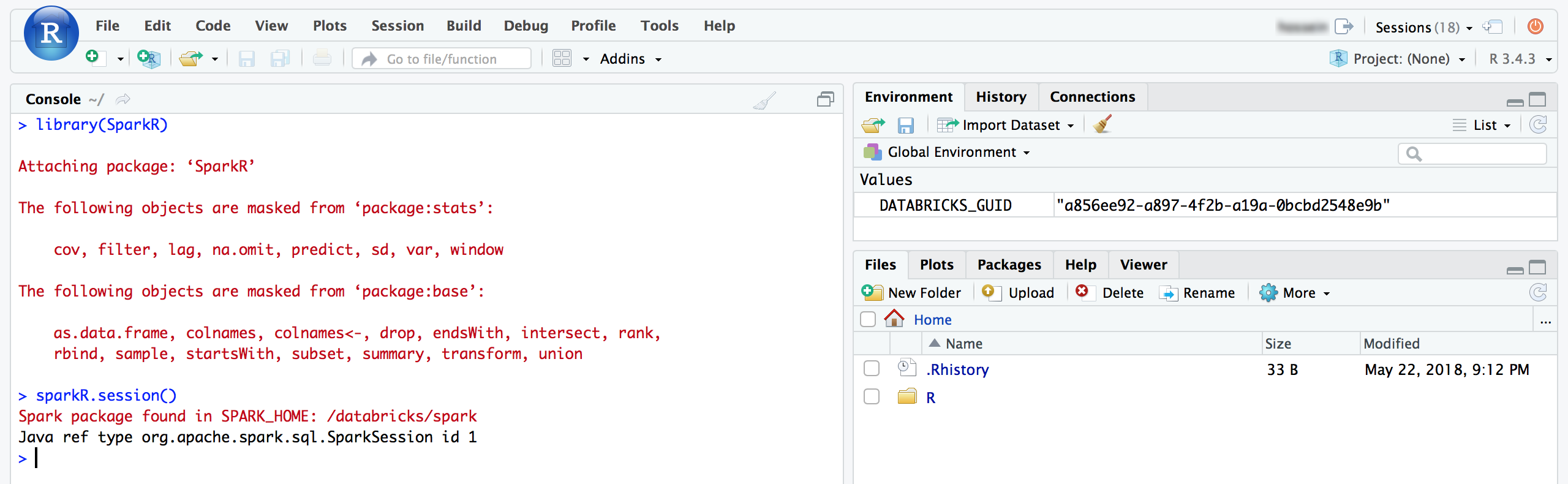

À partir de l’interface utilisateur RStudio, vous pouvez importer le package

SparkRet configurer une sessionSparkRpour lancer des travaux Spark sur votre cluster.library(SparkR) sparkR.session() # Query the first two rows of a table named "diamonds" in a # schema (database) named "default" and display the query result. df <- SparkR::sql("SELECT * FROM default.diamonds LIMIT 2") showDF(df)

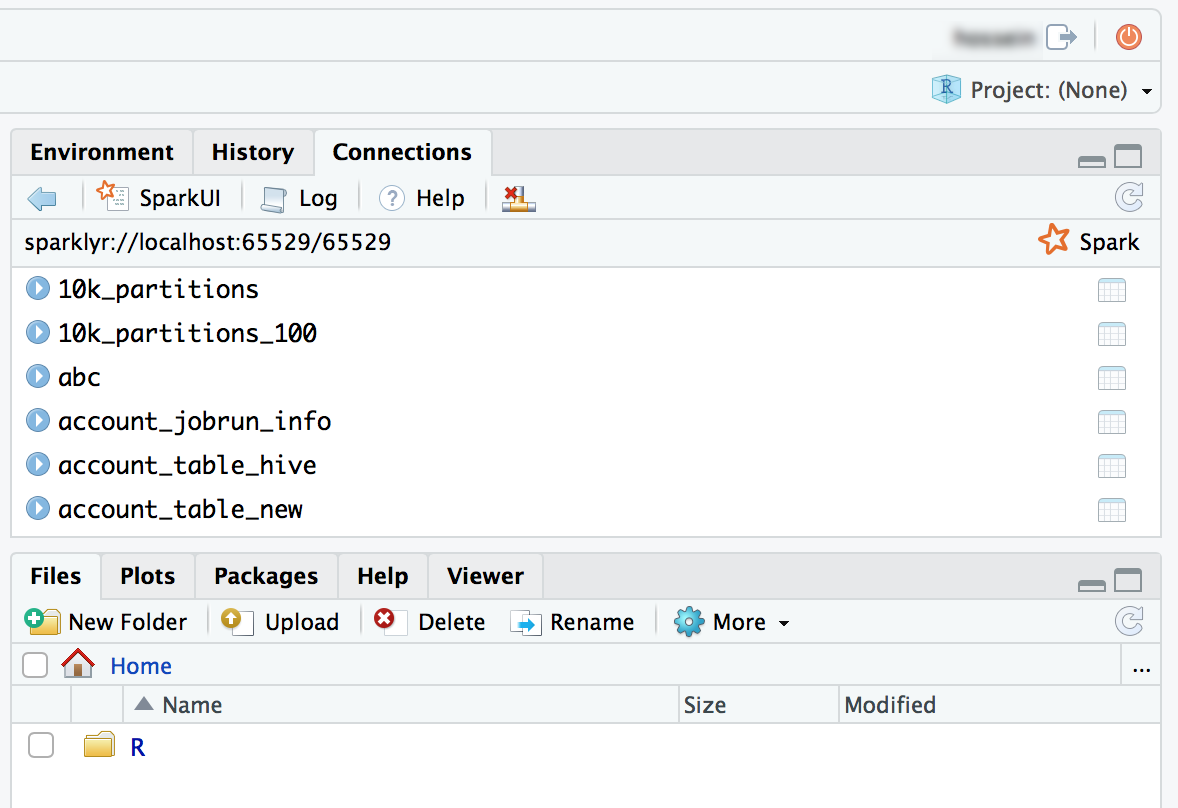

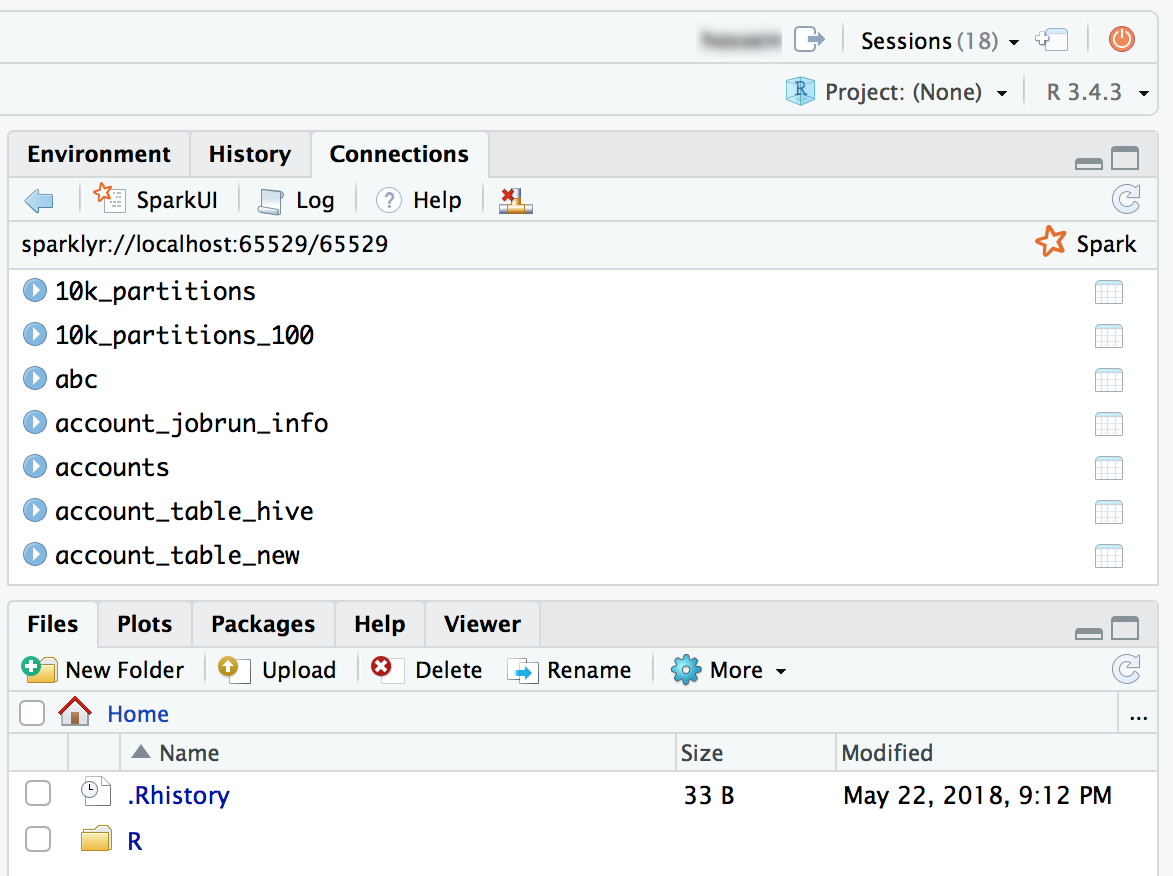

Vous pouvez également attacher le package sparklyr et configurer une connexion Spark.

library(sparklyr) sc <- spark_connect(method = "databricks") # Query a table named "diamonds" and display the first two rows. df <- spark_read_table(sc = sc, name = "diamonds") print(x = df, n = 2)

Intégration de RStudio Server

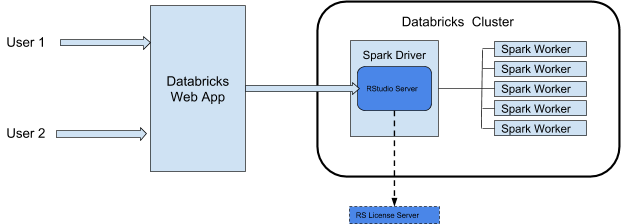

Lorsque vous utilisez RStudio Server sur Azure Databricks, le démon RStudio Server s’exécute sur le nœud de pilote d’un cluster Azure Databricks. L’interface utilisateur web RStudio est transmise par proxy via webapp Azure Databricks, ce qui signifie que vous n’avez pas besoin d’apporter de modifications à la configuration réseau de votre cluster. Ce diagramme illustre l’architecture du composant d’intégration RStudio.

Avertissement

Azure Databricks sert de proxy pour le service web RStudio à partir du port 8787 sur le pilote Spark du cluster. Ce proxy web est destiné à être utilisé uniquement avec RStudio. Si vous lancez d’autres services web sur le port 8787, vous pouvez exposer vos utilisateurs à de potentielles failles de sécurité. Ni Databricks ni Microsoft ne sont responsables des problèmes résultant de l’installation de logiciels non pris en charge sur un cluster.

RStudio Workbench (anciennement RStudio Server Pro)

Cette section vous montre comment configurer et commencer à utiliser RStudio Workbench (anciennement RStudio Server Pro) sur un cluster Azure Databricks. Selon votre licence, RStudio Workbench peut inclure RStudio Server Pro.

Configurer le serveur de licences RStudio

Pour utiliser RStudio Workbench sur Azure Databricks, vous devez convertir votre licence Pro en licence flottante. Pour obtenir de l'aide, contactez help@rstudio.com. Lorsque votre licence est convertie, vous devez configurer un serveur de licences pour RStudio Workbench.

Pour configurer un serveur de licences :

- Lancez une petite instance sur votre réseau de fournisseur de cloud ; le démon du serveur de licences est léger.

- Téléchargez et installez la version correspondante de RStudio License Server sur votre instance, puis démarrez le service. Pour obtenir des instructions détaillées, consultez le Guide d’administration de RStudio Workbench.

- Vérifiez que le port du serveur de licences est ouvert aux instances Azure Databricks.

Installer RStudio Workbench

Pour installer RStudio Workbench sur un cluster Azure Databricks, vous devez créer un script init pour installer le package binaire Rstudio Workbench et le configurer de façon à utiliser votre serveur de licences pour le bail de la licence.

Note

Si vous envisagez d’installer RStudio Workbench sur une version de Databricks Runtime qui comprend déjà le package de l’édition Open Source de RStudio Server, vous devez d’abord désinstaller ce package pour que l’installation aboutisse.

Le fichier .sh suivant est un exemple que vous pouvez stocker comme script d’initialisation dans un emplacement tel que dans votre répertoire d’accueil comme fichier d’espace de travail, dans un volume Unity Catalog ou dans un stockage d’objets. Pour plus d’informations, consultez Scripts d'initialisation à portée de cluster. Le script effectue également des configurations d’authentification supplémentaires qui uniformisent l’intégration avec Azure Databricks.

Avertissement

Les scripts init à portée de cluster sur DBFS atteignent la fin de leur cycle de vie. Le stockage de scripts d’initialisation dans DBFS existe dans certains espaces de travail pour prendre en charge des charges de travail héritées et n’est pas recommandé. Tous les scripts init stockés dans DBFS doivent être migrés. Pour obtenir les instructions de migration, consultez Migrer des scripts init depuis DBFS.

#!/bin/bash

set -euxo pipefail

if [[ $DB_IS_DRIVER = "TRUE" ]]; then

sudo apt-get update

sudo dpkg --purge rstudio-server # in case open source version is installed.

sudo apt-get install -y gdebi-core alien

## Installing RStudio Workbench

cd /tmp

# You can find new releases at https://rstudio.com/products/rstudio/download-commercial/debian-ubuntu/.

wget https://download2.rstudio.org/server/bionic/amd64/rstudio-workbench-2022.02.1-461.pro1-amd64.deb -O rstudio-workbench.deb

sudo gdebi -n rstudio-workbench.deb

## Configuring authentication

sudo echo 'auth-proxy=1' >> /etc/rstudio/rserver.conf

sudo echo 'auth-proxy-user-header-rewrite=^(.*)$ $1' >> /etc/rstudio/rserver.conf

sudo echo 'auth-proxy-sign-in-url=<domain>/login.html' >> /etc/rstudio/rserver.conf

sudo echo 'admin-enabled=1' >> /etc/rstudio/rserver.conf

sudo echo 'export PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin' >> /etc/rstudio/rsession-profile

# Enabling floating license

sudo echo 'server-license-type=remote' >> /etc/rstudio/rserver.conf

# Session configurations

sudo echo 'session-rprofile-on-resume-default=1' >> /etc/rstudio/rsession.conf

sudo echo 'allow-terminal-websockets=0' >> /etc/rstudio/rsession.conf

sudo rstudio-server license-manager license-server <license-server-url>

sudo rstudio-server restart || true

fi

- Remplacez

<domain>par votre URL Azure Databricks et<license-server-url>par l’URL de votre serveur de licence flottante. - Stockez ce fichier

.shcomme script d’initialisation dans un emplacement tel que dans votre répertoire d’accueil comme fichier d’espace de travail, dans un volume Unity Catalog ou dans un stockage d’objets. Pour plus d’informations, consultez Scripts init à étendue au réseau en cluster. - Avant de lancer un cluster, ajoutez ce fichier

.shcomme script d’initialisation à partir de l’emplacement associé. Pour obtenir des instructions, consultez les scripts d'initialisation à l'échelle du cluster. - Lancez le cluster.

Ouvrir RStudio Workbench

Ouvrez la page des détails du cluster.

Démarrez le cluster et cliquez sur l'onglet "Applications" :

Dans l’onglet Applications, cliquez sur le bouton Configurer RStudio.

Vous n’avez pas besoin du mot de passe à usage unique. Cliquez sur le lien Ouvrir l’interface utilisateur RStudio et ouvre une session RStudio Pro authentifiée pour vous.

À partir de l’interface utilisateur RStudio, vous pouvez attacher le package

SparkRet configurer une sessionSparkRpour lancer des travaux Spark sur votre cluster.library(SparkR) sparkR.session() # Query the first two rows of a table named "diamonds" in a # schema (database) named "default" and display the query result. df <- SparkR::sql("SELECT * FROM default.diamonds LIMIT 2") showDF(df)

Vous pouvez également attacher le package sparklyr et configurer une connexion Spark.

library(sparklyr) sc <- spark_connect(method = "databricks") # Query a table named "diamonds" and display the first two rows. df <- spark_read_table(sc = sc, name = "diamonds") print(x = df, n = 2)

FAQ sur le serveur RStudio

Quelle est la différence entre l’édition Open Source de RStudio Server et RStudio Workbench ?

RStudio Workbench prend en charge un large éventail de fonctionnalités d’entreprise qui ne sont pas disponibles dans l’édition Open Source. Vous pouvez voir la comparaison des fonctionnalités sur le site web de RStudio.

En outre, l’édition Open Source de RStudio Server est distribué dans le cadre de la licence publique générale GNU Affero (AGPL), tandis que la version Pro est fournie avec une licence commerciale pour les organisations qui ne sont pas en mesure d’utiliser le logiciel AGPL.

Pour finir, RStudio Workbench est fourni avec le support professionnel et d’entreprise de RStudio, PBC, tandis que l’édition Open Source de RStudio Server est fourni sans support.

Puis-je utiliser ma licence RStudio Workbench (RStudio Server Pro) sur Azure Databricks ?

Oui, si vous disposez déjà d’une licence Pro Enterprise pour RStudio Server, vous pouvez utiliser cette licence sur Azure Databricks. Consultez RStudio Workbench (anciennement RStudio Server Pro) pour savoir comment configurer RStudio Workbench sur Azure Databricks.

Où s’exécute RStudio Server ? Dois-je gérer des services/serveurs supplémentaires ?

Comme vous pouvez le voir sur le diagramme de l’intégration de RStudio Server, le démon RStudio Server s’exécute sur le nœud pilote (maître) de votre cluster Azure Databricks. Avec RStudio Server Open Source Edition, vous n’avez pas besoin d’exécuter de serveurs ou de services supplémentaires. Toutefois, pour RStudio Workbench, vous devez gérer une instance distincte qui exécute RStudio License Server.

Puis-je utiliser RStudio Server sur un cluster standard ?

Note

Cette page décrit l’interface utilisateur des anciens clusters. Pour plus d’informations sur la nouvelle interface utilisateur des clusters, notamment les modifications de terminologie pour les modes d’accès au cluster, consultez la référence de configuration de calcul. Pour une comparaison entre les nouveaux types de clusters et les clusters hérités, voir les modifications apportées à l’interface utilisateur des clusters et les modes d’accès au cluster.

Oui, c’est possible.

Puis-je utiliser RStudio Server sur un cluster avec arrêt automatique ?

Non, vous ne pouvez pas utiliser RStudio lorsque l’arrêt automatique est activé. L’arrêt automatique peut purger les scripts et données utilisateur non enregistrés dans une session RStudio. Pour protéger les utilisateurs contre ce scénario de perte de données involontaire, RStudio est désactivé par défaut sur ces clusters.

Pour les clients qui requièrent le nettoyage des ressources de cluster lorsqu’elles ne sont pas utilisées, Databricks recommande d’utiliser des API de cluster pour nettoyer les clusters RStudio en fonction d’une planification.

Comment conserver mon travail sur RStudio ?

Databricks vous recommande de conserver votre travail à l’aide d’un système de contrôle de version de RStudio. RStudio prend en charge différents systèmes de contrôle de version et vous permet d’archiver et de gérer vos projets. Si vous ne conservez pas votre code à l’aide de l’une des options suivantes, vous risquez de perdre votre travail si un administrateur de l’espace de travail redémarre ou termine le cluster.

L’une des options consiste à enregistrer vos fichiers (code ou données) dans l’espace de travail ou un volume. Par exemple, si vous enregistrez un fichier sous /Workspace/, les fichiers ne seront pas supprimés lorsque votre cluster sera arrêté ou redémarré.

Une autre option consiste à enregistrer le notebook R dans votre système de fichiers local en l’exportant comme Rmarkdown, puis en important ultérieurement le fichier dans l’instance RStudio. Le blog Partager les notebooks R avec RMarkdown décrit les étapes plus en détail.

Comment démarrer une session SparkR ?

Important

SparkR dans Databricks est déconseillé dans Databricks Runtime 16.0 et versions ultérieures.

SparkR est contenu dans Databricks Runtime, mais vous devez le charger dans RStudio. Exécutez le code suivant dans RStudio pour initialiser une session SparkR.

library(SparkR)

sparkR.session()

En cas d’erreur lors de l’importation du package SparkR, exécutez .libPaths() et vérifiez que /home/ubuntu/databricks/spark/R/lib est inclus dans le résultat.

S’il n’est pas inclus, vérifiez le contenu de /usr/lib/R/etc/Rprofile.site. Répertoriez /home/ubuntu/databricks/spark/R/lib/SparkR dans le pilote pour vérifier que le paquet SparkR est installé.

Comment démarrer une session sparklyr ?

Le package sparklyr doit être installé sur le cluster. Utilisez une des méthodes suivantes pour installer le package sparklyr :

- En tant que bibliothèque Azure Databricks

- Commande

install.packages() - Interface utilisateur de gestion des packages RStudio

library(sparklyr)

sc <- spark_connect(method = “databricks”)

Comment RStudio s’intègre-t-il avec les notebooks R Azure Databricks ?

Vous pouvez déplacer votre travail entre les notebooks et RStudio à l’aide de la gestion de version.

Qu’est-ce que le répertoire de travail ?

Quand vous démarrez un projet dans RStudio, vous choisissez un répertoire de travail. Par défaut, il s’agit du répertoire de base sur le conteneur du pilote (master) où RStudio Server est en cours d’exécution. Vous pouvez modifier ce répertoire si vous le souhaitez.

Puis-je lancer Shiny Apps à partir de RStudio qui s’exécute sur Azure Databricks ?

Oui, vous pouvez développer et afficher des applications Shiny dans RStudio Server sur Databricks.

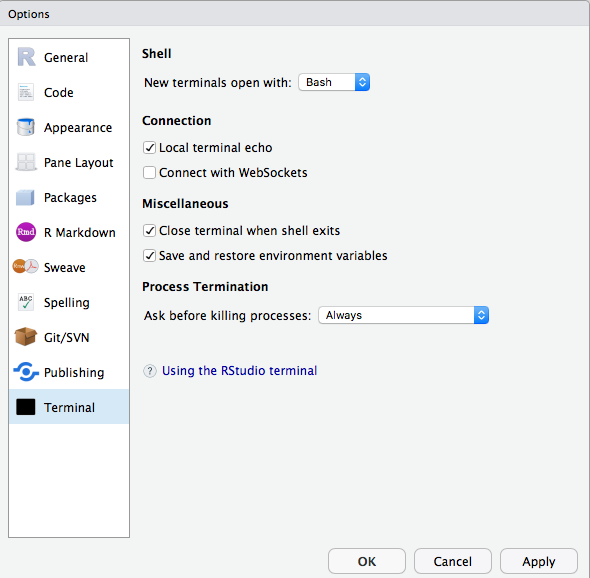

Je ne peux pas utiliser le terminal ou git dans RStudio sur Azure Databricks. Comment puis-je résoudre ce problème ?

Assurez-vous que vous avez désactivé Websocket. Dans l’édition Open Source de RStudio Server, vous pouvez le faire à partir de l’interface utilisateur.

Dans RStudio Server Pro, vous pouvez ajouter allow-terminal-websockets=0 à /etc/rstudio/rsession.conf pour désactiver Websocket pour tous les utilisateurs.

Je ne vois pas l’onglet Applications sous les détails du cluster.

Cette fonctionnalité n’est pas disponible pour tous les clients. Vous devez être sur le Plan Premium.

Alternatives à la version hébergée de RStudio Server

Databricks continuera à prendre en charge RStudio Server hébergé sur les Databricks Runtimes 15.4 et antérieurs jusqu’à leur fin de support. Par exemple, Databricks Runtime 15.4 LTS continuera de prendre en charge RStudio Server hébergé jusqu’au 19 août 2027.

Si vous avez besoin de plus de temps pour migrer, vous pouvez continuer à utiliser le serveur RStudio Server hébergé jusqu’à la date de fin de support de votre runtime. La mise à niveau vers un runtime LTS plus récent, comme la version 15.4, étendra votre période de support.

Alternative 1 : Posit Workbench

En partenariat avec Databricks, Posit PBC fournit une intégration native Posit Workbench pour Databricks.

L’intégration vous permet de vous connecter au calcul via Databricks à partir de RStudio Pro, et inclut des fonctionnalités telles que la prise en charge du Unity Catalog et la gestion des identifiants Databricks OAuth.

Alternative 2 : RStudio Desktop

Connectez RStudio Desktop à une ressource de capacité de calcul Azure Databricks ou à un entrepôt SQL à partir de votre ordinateur de développement local.

Vous pouvez utiliser Databricks Connect via sparklyr ou le pilote ODBC Databricks via le package ODBC R. Cette méthode prend également en charge le catalogue Unity.

Alternative 3 : Notebooks de Databricks

Utilisez R sur les notebooks Databricks pour une expérience de développement interactive intégrée au reste de la plateforme Databricks.