Déployer des modèles en tant que points de terminaison d’API serverless

Dans cet article, vous apprenez à déployer un modèle depuis le catalogue de modèles en tant qu’API serverless, avec facturation basée sur l’utilisation et les jetons.

Certains modèles du catalogue de modèles peuvent être déployés en tant qu’API serverless avec facturation avec paiement à l’utilisation. Ce type de déploiement permet de consommer des modèles en tant qu’API sans les héberger sur votre abonnement, tout en conservant la sécurité et la conformité de l’entreprise dont les organisations ont besoin. Cette option de déploiement ne nécessite pas de quota à partir de votre abonnement.

Cet article utilise un déploiement de modèle Meta Llama en guise d’illustration. Toutefois, vous pouvez utiliser les mêmes étapes pour déployer l’un des modèles du catalogue de modèles disponibles pour le déploiement d’API serverless.

Prérequis

Un abonnement Azure avec un moyen de paiement valide. Les abonnements Azure gratuits ou d’essai ne fonctionnent pas. Si vous ne disposez pas d’un abonnement Azure, commencez par créer un compte Azure payant.

Les contrôles d’accès en fonction du rôle Azure (Azure RBAC) sont utilisés pour accorder l’accès aux opérations dans Azure Machine Learning. Pour effectuer les étapes décrites dans cet article, votre compte d’utilisateur doit avoir le Rôle de développeur Azure AI sur le groupe de ressources. Pour plus d’informations sur les autorisations, consultez Contrôle d’accès en fonction du rôle dans Azure Machine Learning.

Vous devez installer les logiciels suivants pour utiliser Azure Machine Learning :

Vous pouvez utiliser n’importe quel navigateur web compatible pour naviguer dans Azure Machine Learning.

Rechercher votre modèle et votre ID de modèle dans le catalogue de modèles

Connectez-vous à Azure Machine Learning Studio.

Pour les modèles proposés par le biais de la Place de marché Azure, vérifiez que votre compte dispose des autorisations de rôle Azure AI Developer sur le groupe de ressources, ou que vous respectez les autorisations requises pour s’abonner aux offres de modèle.

Les modèles proposés par des fournisseurs non-Microsoft (par exemple, les modèles Llama et Mistral) sont facturés via la Place de marché Azure. Pour ces modèles, vous devez vous abonner à votre espace de travail à l’offre de modèle spécifique. Les modèles proposés par Microsoft (par exemple, les modèles Phi-3) n’ont pas cette exigence, car la facturation est effectuée différemment. Pour plus d’informations sur la facturation pour le déploiement serverless de modèles dans le catalogue de modèles, consultez Facturation pour les API serverless.

Accédez à votre espace de travail. Pour utiliser l’offre de déploiement de modèle d’API serverless, votre espace de travail doit appartenir à l’une des régions prises en charge pour le déploiement serverless pour le modèle particulier que vous souhaitez déployer.

Sélectionnez Catalogue de modèles dans la barre latérale gauche et recherchez la carte de modèle du modèle que vous voulez déployer. Dans cet article, vous sélectionnez un modèle Meta-Llama-3-8B-Instruct.

- Si vous déployez le modèle en utilisant Azure CLI, le kit de développement logiciel (SDK) Python ou ARM, copiez l’ID de modèle.

Important

N’incluez pas la version lors de la copie de l’ID de modèle. Les points de terminaison d’API serverless déploient toujours la version du modèle la plus récente disponible. Par exemple, pour l’ID de modèle

azureml://registries/azureml-meta/models/Meta-Llama-3-8B-Instruct/versions/3, copiezazureml://registries/azureml-meta/models/Meta-Llama-3-8B-Instruct.

La section suivante décrit les étapes d’abonnement de votre espace de travail à une offre de modèle. Vous pouvez ignorer cette section et accéder à Déployer le modèle sur un point de terminaison d’API serverless, si vous déployez un modèle Microsoft.

Abonnez votre espace de travail à l’offre de modèles

Les points de terminaison d’API serverless peuvent déployer des modèles Microsoft et non-Microsoft proposés. Pour les modèles Microsoft (tels que les modèles Phi-3), vous n’avez pas besoin de créer un abonnement Place de marché Azure et vous pouvez les déployer directement vers des points de terminaison d’API Serverless pour consommer leurs prévisions. Pour les modèles non-Microsoft, vous devez d’abord créer l’abonnement. Si c’est la première fois que vous déployez le modèle dans l’espace de travail, vous devez abonner votre espace de travail à l’offre de modèle spécifique depuis la Place de marché Azure. Chaque espace de travail a son propre abonnement à l’offre de modèle spécifique de la Place de marché Azure, ce qui vous permet de contrôler et d’analyser les dépenses.

Remarque

Les modèles proposés via la Place de marché Azure peuvent être déployés vers des points de terminaison d’API serverless dans des régions spécifiques. Vérifiez disponibilité des régions pour les modèles dans les points de terminaison d’API serverless pour vérifier quels modèles et régions sont disponibles. Si celle dont vous avez besoin n’est pas listée, vous pouvez déployer sur un espace de travail d’une région prise en charge, puis utiliser des points de terminaison d’API serverless depuis un autre espace de travail.

Créer l’abonnement à la Place de marché du modèle. Lorsque vous créez un abonnement, vous acceptez les conditions générales associées à l’offre de modèle. Retenez bien que vous n’êtes pas obligé d’effectuer cette étape pour les modèles proposés par Microsoft (comme Phi-3).

Dans la page Détails du modèle, sélectionnez Déployer. Une fenêtre Options de déploiement s’ouvre et vous donne le choix entre un déploiement d’API serverless et un déploiement utilisant un calcul managé.

Remarque

Pour les modèles qui peuvent être déployés uniquement via un déploiement d’API serverless, l’Assistant Déploiement d’API serverless s’ouvre juste après que vous avez sélectionné Déployer dans la page des détails du modèle.

Sélectionnez API serverless avec Azure AI Sécurité du Contenu (préversion) pour ouvrir l’Assistant Déploiement d’API serverless.

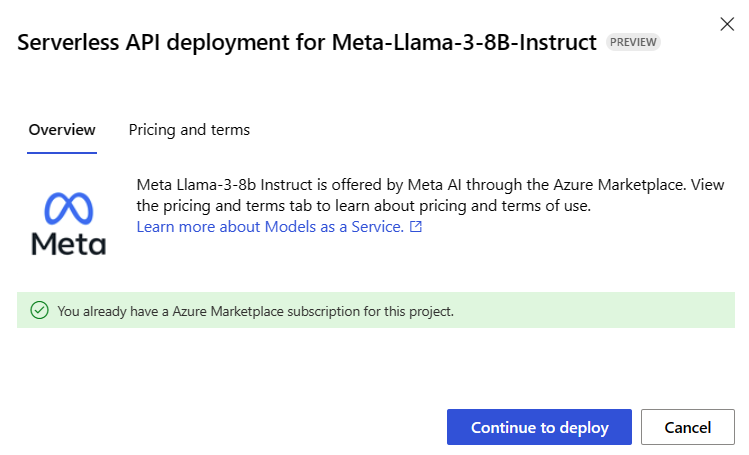

Cochez la case pour confirmer que vous avez pris connaissance de la stratégie d’achat Microsoft.

Si vous voyez la note Vous disposez déjà d’un abonnement à la Place de marché Azure pour cet espace de travail, vous n’avez pas besoin de créer l’abonnement, car vous en avez déjà un. Vous pouvez continuer vers Déployer le modèle sur un point de terminaison d’API serverless.

Dans l’Assistant Déploiement, sélectionnez le lien vers les Conditions d’utilisation de la Place de marché Azure pour en savoir plus sur les conditions d’utilisation. Vous pouvez également sélectionner l’onglet Tarification et conditions pour en savoir plus sur la tarification du modèle sélectionné.

Dans l’Assistant Déploiement, sélectionnez le lien vers Conditions d’utilisation de la Place de marché Azure pour en savoir plus sur les conditions d’utilisation. Vous pouvez également sélectionner l’onglet Détails de l’offre de la Place de marché pour en savoir plus sur la tarification du modèle sélectionné.

Sélectionnez S’abonner et se Déployer.

Une fois que vous souscrivez l’espace de travail à l’offre particulière de la Place de marché Azure, les déploiements suivants de la même offre dans le même espace de travail ne nécessitent pas de s’abonner à nouveau.

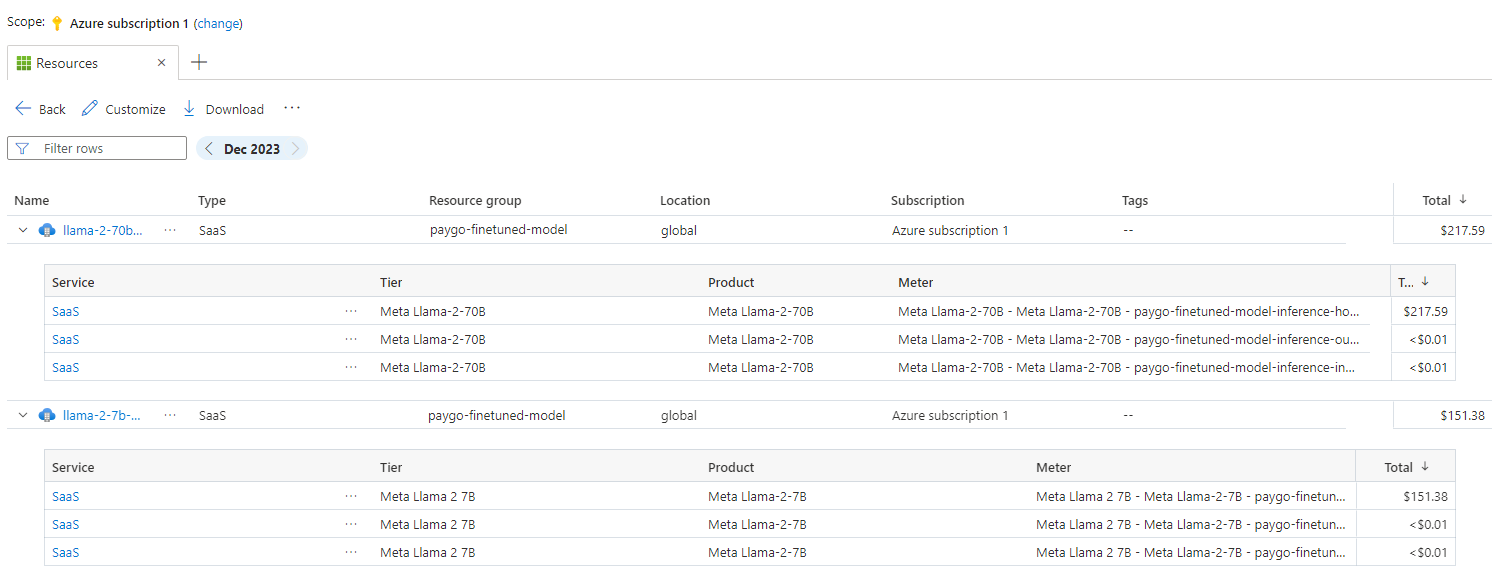

À tout moment, vous pouvez consulter les offres de modèle auxquelles votre espace de travail est actuellement abonné :

Accédez au Portail Azure.

Accédez au groupe de ressources auquel appartient l’espace de travail.

Dans le filtre Type, sélectionnez SaaS.

Vous voyez toutes les offres auxquelles vous êtes actuellement abonné.

Sélectionnez n’importe quelle ressource pour en afficher les détails.

Déployer le modèle sur un point de terminaison d’API serverless

Une fois que vous avez créé un abonnement pour un modèle autre que Microsoft, vous pouvez déployer le modèle associé sur un point de terminaison d’API serverless. Pour les modèles Microsoft (tels que les modèles Phi-3), vous n’avez pas besoin de créer d’abonnement.

Le point de terminaison d’API serverless fournit un moyen d’utiliser des modèles en tant qu’API sans les héberger dans votre abonnement, tout en conservant le niveau de sécurité professionnel et la conformité dont les organisations ont besoin. Cette option de déploiement ne nécessite pas de quota à partir de votre abonnement.

Dans cette section, vous allez créer un point de terminaison portant le nom meta-llama3-8b-qwerty.

Créer le point de terminaison serverless

Pour déployer un modèle Microsoft qui ne nécessite pas d’abonnement à une offre de modèle, sélectionnez Déployer, puis sélectionnez API serverless avec Azure AI Content Safety (préversion) pour ouvrir l’Assistant Déploiement.

Sinon, pour un modèle autre que Microsoft qui nécessite un abonnement de modèle, si vous venez d’abonner votre espace de travail à l’offre de modèle dans la section précédente, continuez à sélectionner Déployer. Vous pouvez également sélectionner Continuer à déployer (si votre Assistant déploiement avait la note Vous disposez déjà d’un abonnement Place de marché Azure pour cet espace de travail).

Donnez un nom au déploiement. Ce nom va faire partie de l’URL de l’API de déploiement. Cette URL doit être unique dans chaque région Azure.

Conseil

L’option Filtre de contenu (préversion) est activée par défaut. Conservez le paramètre par défaut pour le service afin de détecter des contenus dangereux tels que la haine, l’automutilation, le contenu sexuel et la violence. Pour plus d’informations sur le filtrage de contenu (préversion), consultez Sécurité du contenu pour les modèles déployés via des API serverless.

Sélectionnez Déployer. Une fois que le déploiement est prêt, vous êtes redirigé vers la page Déploiements.

À tout moment, vous pouvez voir les points de terminaison déployés sur votre espace de travail :

Accédez à votre espace de travail.

Sélectionnez Points de terminaison.

Sélectionnez l’onglet Points de terminaison serverless pour afficher les points de terminaison d’API serverless.

Le point de terminaison créé utilise une authentification par clé pour l’autorisation. Procédez comme suit pour obtenir les clés associées à un point de terminaison donné.

- Pour revenir à la page du déploiement, sélectionnez le nom du point de terminaison dans la liste des points de terminaison serverless.

- Notez l’URI cible et la Clédu point de terminaison. Utilisez-les pour appeler le déploiement et générer des prédictions.

Remarque

Lorsque vous utilisez le Portail Azure, les points de terminaison d’API serverless ne sont pas affichés par défaut sur le groupe de ressources. Utilisez l’option Afficher les types masqués pour les afficher sur le groupe de ressources.

À ce stade, votre point de terminaison est prêt à être utilisé.

Si vous devez utiliser ce déploiement depuis un autre espace de travail ou si vous envisagez d’utiliser un flux d’invite pour créer des applications intelligentes, vous devez créer une connexion au déploiement d’API serverless. Pour savoir comment configurer un point de terminaison d’API serverless existant sur un nouvel espace de travail ou un hub, consultez Consommer des points de terminaison d’API serverless déployés à partir d’un autre espace de travail ou d’un flux d’invite.

Conseil

Si vous utilisez un flux d’invite dans le même espace de travail que celui où le déploiement a été déployé, vous devez toujours créer la connexion.

Utiliser le point de terminaison d’API serverless

Les modèles déployés dans Azure Machine Learning et Azure AI Studio dans des points de terminaison d’API serverless prennent en charge l’API Azure AI Model Inference qui expose un ensemble commun de fonctionnalités pour les modèles fondamentaux et qui peuvent être utilisées par les développeurs pour utiliser des prédictions depuis un ensemble diversifié de modèles de manière uniforme et cohérente.

En savoir plus sur les fonctionnalités de cette API et découvrir comment vous pouvez l’utiliser lors de la création d’applications.

Supprimer des points de terminaison et des abonnements

Vous pouvez supprimer les abonnements et les points de terminaison de modèle. La suppression d’un abonnement à un modèle rend tout point de terminaison associé Non sain et inutilisable.

Pour supprimer un point de terminaison d’API serverless :

Accédez à Azure Machine Learning Studio.

Sélectionnez Points de terminaison dans la barre latérale gauche.

Sélectionnez l’onglet Points de terminaison serverless pour afficher les points de terminaison d’API serverless.

Sélectionnez le point de terminaison que vous voulez supprimer.

Sélectionnez Supprimer.

Pour supprimer l’abonnement au modèle associé :

Accédez au Portail Azure.

Accédez au groupe de ressources auquel appartient l’espace de travail.

Dans le filtre Type, sélectionnez SaaS.

Sélectionnez l’abonnement à supprimer.

Sélectionnez Supprimer.

Considérations relatives aux coûts et aux quotas pour les modèles déployés en tant que points de terminaison d’API serverless

Le quota est géré par déploiement. Chaque déploiement a une limite de débit de 200 000 jetons par minute et 1 000 requêtes d’API par minute. Toutefois, nous limitons actuellement à un déploiement par modèle par espace de travail. Contactez le Support Microsoft Azure si les limites de débit actuelles ne suffisent pas pour vos scénarios.

Coût des modèles Microsoft

Vous trouverez les informations de tarification sous l’onglet Tarification et conditions de l’Assistant Déploiement lors du déploiement de modèles Microsoft (tels que les modèles Phi-3) en tant que points de terminaison d’API serverless.

Coût pour les modèles autres que Microsoft

Les modèles autres que Microsoft déployés en tant que points de terminaison d’API serverless sont proposés via la Place de marché Azure et intégrés à Azure AI Studio pour une utilisation. Vous trouverez la tarification de la Place de marché Azure lors du déploiement ou de l’optimisation de ces modèles.

Chaque fois qu’un espace de travail s’abonne à une offre donnée depuis la Place de marché Azure, une nouvelle ressource est créée pour suivre les coûts associés à sa consommation. La même ressource est utilisée pour suivre les coûts associés à l’inférence et à l’optimisation ; plusieurs compteurs sont cependant disponibles pour suivre chaque scénario indépendamment.

Pour plus d’informations sur le suivi des coûts, consultez Surveiller les coûts des modèles proposés via la Place de marché Azure.

Autorisations requises pour s’abonner aux offres de modèles

Les contrôles d’accès en fonction du rôle Azure (Azure RBAC) sont utilisés pour accorder l’accès aux opérations dans Azure Machine Learning. Pour effectuer les étapes de cet article, votre compte d’utilisateur doit avoir le rôle Propriétaire,Contributeur ou Développeur Azure AI attribué pour l’abonnement Azure. Une autre possibilité est que votre compte dispose d’un rôle personnalisé avec les autorisations suivantes :

Sur l’abonnement Azure – pour abonner l’espace de travail à l’offre de la Place de marché Azure, une fois pour chaque espace de travail, par offre :

Microsoft.MarketplaceOrdering/agreements/offers/plans/readMicrosoft.MarketplaceOrdering/agreements/offers/plans/sign/actionMicrosoft.MarketplaceOrdering/offerTypes/publishers/offers/plans/agreements/readMicrosoft.Marketplace/offerTypes/publishers/offers/plans/agreements/readMicrosoft.SaaS/register/action

Sur le groupe de ressources – pour créer et utiliser la ressource SaaS :

Microsoft.SaaS/resources/readMicrosoft.SaaS/resources/write

Sur l’espace de travail – pour déployer des points de terminaison (le rôle Scientifique des données Azure Machine Learning a déjà ces autorisations) :

Microsoft.MachineLearningServices/workspaces/marketplaceModelSubscriptions/*Microsoft.MachineLearningServices/workspaces/serverlessEndpoints/*

Pour plus d’informations sur les autorisations, consultez Gérer l’accès à un espace de travail Azure Machine Learning.