Remarque

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

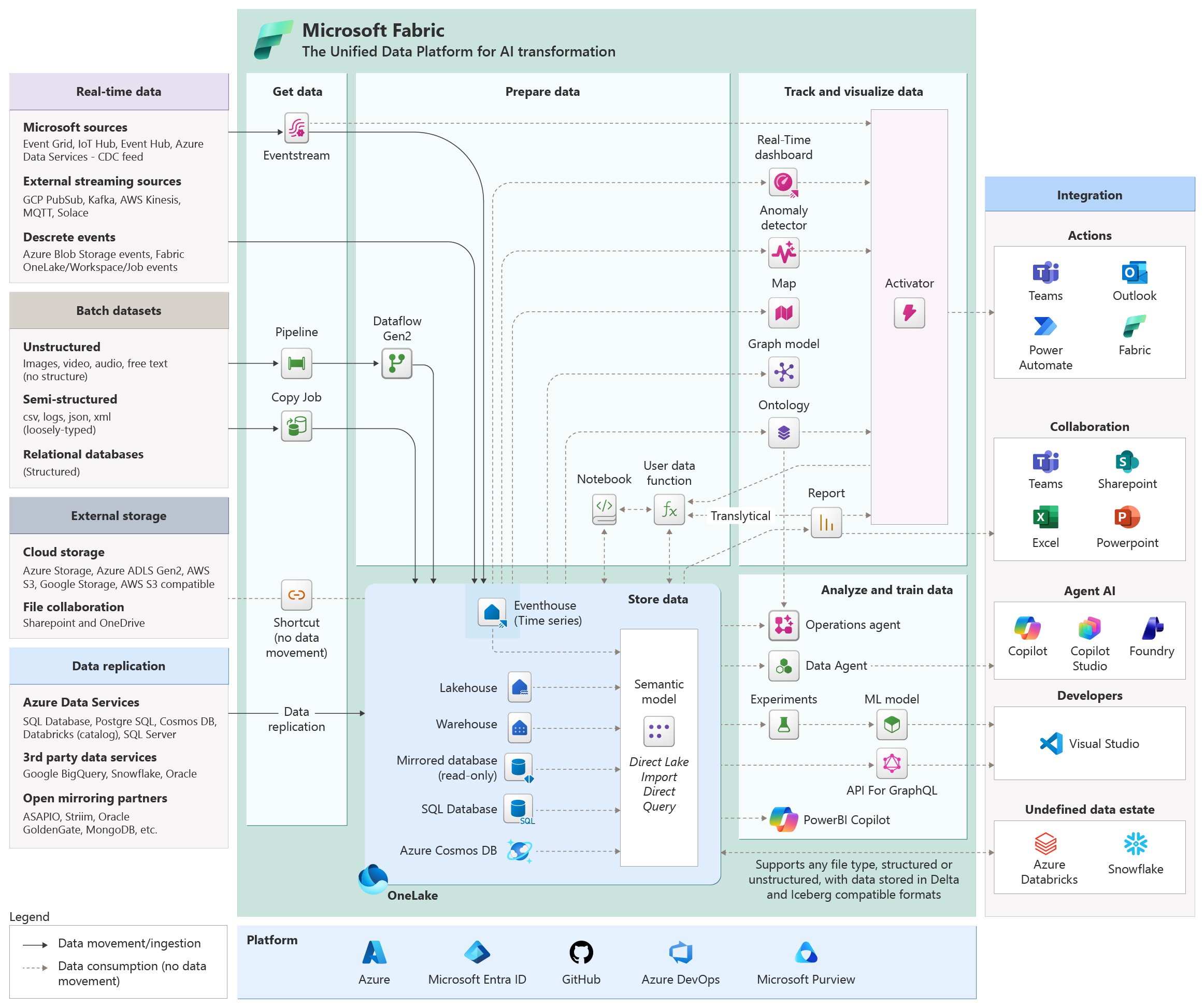

Les organisations s’appuient généralement sur plusieurs services déconnectés pour ingérer, stocker, transformer, analyser et visualiser des données. Cette fragmentation crée des silos de données, augmente la surcharge d’intégration et ralentit le temps d’insight. Microsoft Fabric répond à ces défis en unifiant chaque étape du cycle de vie des données en une plateforme unique basée sur une base partagée.

Au centre de cette architecture est OneLake, un lac de données d’organisation unique qui stocke toutes les données au format Delta Parquet ouvert. OneLake est provisionné automatiquement avec chaque locataire Fabric. Étant donné que chaque charge de travail Fabric lit et écrit dans OneLake, les données ne se déplacent pas entre les moteurs. Un jeu de données ingéré par le biais d’un pipeline, affiné dans un notebook et visualisé dans un rapport Power BI reste dans un seul endroit tout au long de son parcours.

Le cycle de vie des données se compose de six phases, et Fabric fournit des outils conçus pour chacun d’eux :

Obtenir des données : faites entrer des données dans OneLake à partir de centaines de sources en temps réel, selon une planification, par le biais de la réplication continue de base de données ou en référençant le stockage externe en place.

Stocker des données : conserver des données dans des formats de stockage optimisés pour votre charge de travail, qu’il s’agisse d’analyses de Big Data flexibles, de requêtes SQL structurées, d’analyse d’événements en temps réel, de traitement transactionnel ou de rapports métier régis.

Préparer et transformer : Nettoyer, remodeler et enrichir des données à l’aide de transformations visuelles à faible code ou de notebooks code-first et fonctions réutilisables, sans déplacer les données hors de OneLake.

Analysez et entraînez : Créez et operationalisez des modèles Machine Learning, exécutez des analyses avancées, interrogez des données par programmation et explorez des insights par le biais d’agents IA en langage naturel.

Suivez et visualisez : Insights Surface via des rapports interactifs, surveillez les flux de données en direct sur des tableaux de bord en temps réel et déclenchez des actions automatisées lorsque des conditions sont remplies.

Intégration externe : Connectez-vous en toute sécurité aux services externes pour l’automatisation, la collaboration, la gouvernance, les outils de développement et CI/CD.

Le diagramme suivant montre comment ces étapes se connectent et quels éléments Fabric participent à chaque étape. Chaque étape est abordée en détail dans un article dédié. Utilisez les liens de chaque section pour explorer les fonctionnalités et les outils disponibles à ce stade.

Obtenir des données

Différents types de jeux de données proviennent d’une grande variété de sources de données dans différents scénarios de données, notamment la réplication des données, les références de stockage externe, les jeux de données batch et les flux de données en temps réel. Vous ingérez et transformez ces jeux de données via les outils d’intégration de Fabric. Les données atterrissent dans OneLake, le stockage centralisé des données pour l’ensemble de Fabric. Les méthodes d’ingestion clés sont les suivantes :

- Flux d’événements pour l’ingestion et le routage d’événements en temps réel.

- Pipelines de données pour le déplacement de données en mode batch et planifié avec plus de 200 connecteurs.

- Mise en miroir pour la réplication continue à partir de bases de données opérationnelles sans générer de pipelines ETL.

- Raccourcis pour la virtualisation des données sans copie à partir d’un stockage externe comme Azure Data Lake, Amazon S3 ou Google Cloud Storage.

Pour plus d’informations, consultez Obtenir des données dans Microsoft Fabric.

Stocker des données

Une fois ingérées, toutes les données sont stockées dans OneLake au format Delta Parquet ouvert. OneLake fournit un lac de données unique pour l’ensemble de votre organisation sans provisionnement distinct nécessaire. Fabric offre plusieurs éléments de stockage optimisés pour différentes charges de travail :

- Lakehouse pour un stockage Big Data flexible qui combine des fichiers et des tables Delta managées avec un point de terminaison SQL automatique.

- Entrepôt pour analytique structurée et relationnelle avec prise en charge complète de T-SQL, procédures stockées et transactions ACID.

- Eventhouse pour l’analytique en temps réel sur la diffusion en continu et les données de télémétrie à l’aide du langage de requête Kusto (KQL).

- SQL Database pour les charges de travail transactionnelles et l’analytique opérationnelle.

- Modèles sémantiques pour la logique métier, les mesures et les hiérarchies organisées qui alimentent les rapports et l’IA.

Pour plus d’informations, consultez Stocker des données dans Microsoft Fabric.

Préparer et transformer des données

Une fois dans OneLake, vous pouvez transformer davantage les données à l’aide de moteurs code-first ou d’outils à faible code, dans Fabric sans déplacement de données entre les moteurs :

- Dataflow Gen2 fournit une interface Power Query à faible code pour le nettoyage, la transformation et l’enrichissement des données.

- Les notebooks offrent un environnement jupyter-like pour Python, T-SQL et l’ingénierie des données scalaires.

- Les fonctions de données utilisateur vous permettent d’incorporer une logique Python personnalisée réutilisable qui peut être appelée à partir de pipelines, de notebooks et de règles d’activateur.

Pour plus d’informations, consultez Préparer et transformer des données.

Analyser des données et entraîner des modèles

Utilisez les données préparées pour entraîner des modèles ML et effectuer des analyses avancées. La charge de travail Data Science de Fabric fournit un environnement permettant de créer, d’entraîner et d’opérationnaliser des modèles ML :

- Les expériences MLflow effectuent le suivi des exécutions d’entraînement de modèle avec la journalisation automatique des hyperparamètres, des métriques et des éléments.

- Les modèles ML sont inscrits dans un registre MLflow pour le contrôle de version, le suivi des métadonnées et la reproductibilité.

- Les agents de données et les agents d’opérations vous permettent d’interagir avec les données à l’aide du langage naturel et d’agir sur les conditions et les modèles trouvés.

- Les API GraphQL fournissent une couche d’accès aux données flexible pour permettre aux développeurs d’interroger plusieurs sources de données Fabric via un seul point de terminaison.

- Copilot pour Power BI utilise l’IA générative pour l’analyse ad hoc, la génération DAX et l’exploration des données en langage naturel.

Pour plus d’informations, consultez Analyser et entraîner des données dans Microsoft Fabric.

Suivre et visualiser les données

Utilisez les données préparées et modélisées pour créer des rapports, des tableaux de bord et des alertes en temps réel :

- Les rapports Power BI fournissent une visualisation interactive des données basée sur des modèles sémantiques, avec une distribution entre des applications Microsoft 365 telles que Teams, SharePoint, PowerPoint et Excel.

- Les flux de tâches translyticaux permettent aux utilisateurs de prendre des mesures directement à partir de rapports Power BI en appelant des fonctions de données utilisateur.

- Tableaux de bord d'intelligence en temps réel surveillent les données de streaming avec une latence de moins d'une seconde en utilisant des requêtes KQL et l'édition visuelle.

- L’activateur détecte les conditions dans les données de diffusion en continu et déclenche des actions automatisées telles que les alertes Teams, les e-mails ou les flux Power Automate.

- Fabric IQ mappe les données d’entreprise à une ontologie d’entreprise partagée et permet aux agents IA de raisonner sur vos données avec un contexte métier complet.

Pour plus d’informations, consultez Suivre et visualiser les données.

Intégration externe

Fabric s’intègre à des systèmes externes pour l’ingestion des données et la distribution des insights :

- Power Automate et l’activateur de données permettent l’automatisation de flux de travail en temps réel en fonction des conditions de données.

- L’intégration de Microsoft 365 expose des insights dans Teams, SharePoint, PowerPoint et Excel.

- Les API REST et les bibliothèques clientes fournissent un accès programmatique aux ressources Fabric.

- Microsoft Entra ID gère l’authentification, l’accès conditionnel et la prise en charge du service principal.

- L’intégration de Git à Azure DevOps et GitHub active le contrôle de version et CI/CD pour les éléments Fabric.

- Microsoft Purview fournit une gouvernance unifiée des données, un catalogage et une conformité dans le patrimoine de données Fabric.

Pour plus d’informations, consultez Intégration externe et connectivité de plateforme.

Prise en charge du langage naturel et de l’IA

La prise en charge du langage naturel se présente sous la forme de Power BI Copilot, d’agents de données et d’agents d’exploitation, qui peuvent raisonner sur les données d’entreprise dans OneLake et produire des réponses basées sur les éléments de données auxquels les utilisateurs peuvent accéder. Vous pouvez intégrer Des agents de données dans Microsoft 365 Copilot, Microsoft Foundry et Copilot Studio afin que les utilisateurs puissent obtenir des insights à partir de OneLake au sein de leurs flux de travail existants dans différentes applications.