Notes

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

Important

Les traductions non anglaises sont fournies uniquement pour des raisons pratiques. Veuillez consulter la version EN-US de ce document pour la version faisant foi.

Cet article fournit des détails sur la façon dont les données fournies par vous au service Azure OpenAI sont traitées, utilisées et stockées. Azure OpenAI stocke et traite les données pour fournir le service et surveiller les utilisations qui violent les conditions de produit applicables. Consultez également l’Addenda sur la protection des données des produits et services Microsoft, qui régit le traitement des données par Azure OpenAI Service. Azure OpenAI est un service Azure ; En savoir plus sur les offres de conformité Azure applicables.

Important

Vos requêtes (entrées) et réponses (sorties), vos incorporations et vos données d’apprentissage :

- ne sont pas disponibles pour d’autres clients.

- ne sont pas disponibles pour OpenAI.

- ne sont pas utilisés pour améliorer les modèles OpenAI.

- ne sont pas utilisés pour entraîner, réentraîner ou améliorer les modèles de base du service Azure OpenAI.

- ne sont pas utilisés pour améliorer les produits ou services Microsoft ou tiers sans votre autorisation ou instruction.

- Vos modèles Azure OpenAI affinés sont disponibles exclusivement pour votre utilisation.

Le service Azure OpenAI est géré par Microsoft en tant que service Azure ; Microsoft héberge les modèles OpenAI dans l’environnement Azure de Microsoft et le service n’interagit pas avec les services gérés par OpenAI (par exemple, ChatGPT ou l’API OpenAI).

Quelles données le service Azure OpenAI traite-t-il ?

Azure OpenAI traite les types de données suivants :

- Requêtes et contenu généré. Les requêtes sont envoyées par l’utilisateur et le contenu est généré par le service, via les réponses, réponses de conversation, images et opérations d’incorporation.

- Données chargées. Vous pouvez fournir vos propres données à utiliser avec certaines fonctionnalités de service (par exemple, réglage précis, API Assistants, traitement par lots) à l’aide de l’API Fichiers ou du magasin vectoriel.

- Données pour les entités avec état. Lorsque vous utilisez certaines fonctionnalités facultatives du service Azure OpenAI, telles que la fonctionnalité Threads de l’API Assistants et les achèvements stockés, le service crée un magasin de données pour conserver l’historique des messages et d’autres contenus, conformément à la configuration de la fonctionnalité.

- Données augmentées incluses avec ou via des requêtes. Quand vous utilisez des données associées à des entités avec état, le service récupère les données pertinentes à partir d’un magasin de données configuré et augmente la requête pour produire des générations qui sont ancrées avec vos données. Les instructions peuvent également être augmentées avec les données récupérées à partir d’une source incluse dans l’instruction elle-même, comme une URL.

- Données de formation et de validation. Vous pouvez fournir vos propres données d’apprentissage composées de paires requête-réponse à des fins de réglage fin d’un modèle OpenAI.

Comment Azure OpenAI Service traite-t-il les données ?

Le diagramme ci-dessous illustre la façon dont vos données sont traitées. Ce diagramme couvre plusieurs types de traitement :

- Comment le service Azure OpenAI traite vos invites via l’inférence pour générer du contenu (y compris lorsque des données supplémentaires d’une source de données désignée sont ajoutées à une invite à l’aide d’Azure OpenAI sur vos données, assistants ou traitement par lots).

- Comment la fonctionnalité Assistants stocke les données en connexion avec les messages, les threads et les exécutions.

- Comment la fonctionnalité Batch traite vos données chargées.

- Comment le service Azure OpenAI crée un modèle affiné (personnalisé) avec vos données chargées.

- Comment le service Azure OpenAI et le personnel Microsoft analysent les invites et les achèvements (texte et image) pour le contenu dangereux et pour les modèles qui suggèrent l’utilisation du service d’une manière qui enfreint le Code de conduite ou d’autres conditions de produit applicables.

Comme illustré dans le diagramme ci-dessus, les clients sous gestion peuvent demander à modifier la surveillance des abus.

Génération de complétions, d’images ou de représentations via l’inférence

Les modèles, qu'ils soient de base ou ajustés, sont déployés dans vos ressources pour traiter vos invites d'entrée et générer des réponses avec du texte, des images ou des incorporations. Les interactions client avec le modèle sont logiquement isolées et sécurisées à l’aide de mesures techniques, y compris, mais pas limitées au chiffrement de transport tls1.2 ou supérieur, au périmètre de sécurité de calcul, à la tokenisation du texte et à l’accès exclusif à la mémoire GPU allouée. Les invites et les complétions sont contrôlées en temps réel pour détecter des contenus nocifs, et la génération de contenu est filtrée selon les seuils configurés. En savoir plus sur le filtrage de contenu du service Azure OpenAI.

Les invites et les réponses sont traitées dans la zone géographique spécifiée par le client (sauf si vous utilisez un type de déploiement global), mais peuvent être traitées entre les régions de la zone géographique à des fins opérationnelles (y compris la gestion des performances et de la capacité). Consultez ci-dessous pour plus d’informations sur l’emplacement du traitement lors de l’utilisation d’un type de déploiement global.

Les modèles sont sans état : aucune requête ni génération n’est stockée dans le modèle. En outre, les incitations et les générations ne sont pas utilisées pour entraîner, réentraîner ou améliorer les modèles de base.

Comprendre l’emplacement du traitement pour les types de déploiement « Global » et « Zone de données »

Outre les déploiements standard, Azure OpenAI Service propose des options de déploiement étiquetées « Global » et « DataZone ». Pour les types de déploiement étiquetés « Global », vous pouvez traiter les requêtes et réponses dans n’importe quelle zone géographique où le modèle Azure OpenAI est déployé (en savoir plus à propos de la disponibilité régionale des modèles). Pour tous les types de déploiement étiquetés « DataZone », vous pouvez traiter les requêtes et réponses dans n’importe quelle zone géographique au sein de la zone de données spécifiée, comme défini par Microsoft. Si vous créez un déploiement DataZone dans une ressource Azure OpenAI située aux États-Unis, vous pouvez traiter les requêtes et réponses n’importe où aux États-Unis. Si vous créez un déploiement DataZone dans une ressource Azure OpenAI située chez une nation membre de l’Union européenne, vous pouvez traiter les requêtes et réponses dans celle-ci ou toute autre nation membre de l’Union européenne. Pour les types de déploiement Global et DataZone, toutes les données stockées au repos, telles que les données chargées, sont stockées dans la zone géographique désignée. Seul l’emplacement de traitement est affecté quand un client utilise un type de déploiement Global ou DataZone dans Azure OpenAI Service. Les engagements de conformité et de traitement de données Azure restent applicables.

Augmenter les requêtes pour « ancrer » les résultats générés « sur vos données »

La fonctionnalité Azure OpenAI « sur vos données » vous permet de connecter des sources de données pour baser les résultats générés avec vos données. Les données restent stockées dans la source de données et l’emplacement que vous désignez ; Azure OpenAI Service ne crée pas de magasin de données en double. Lorsqu’une invite utilisateur est reçue, le service récupère les données pertinentes de la source de données connectée et augmente l’invite. Le modèle traite cette invite augmentée et le contenu généré est retourné comme décrit ci-dessus. En savoir plus sur l’utilisation sécurisée de la fonctionnalité Sur vos données.

Stockage de données pour les fonctionnalités du service Azure OpenAI

Certaines fonctionnalités Azure OpenAI Service stockent des données dans le service. Ces données sont soit chargées par le client, à l’aide de l’API Fichiers ou du magasin de vecteurs, soit stockées automatiquement en lien avec certaines entités avec état, telles que la fonctionnalité Threads de l’API Assistants et des réponses stockées. Données stockées pour les fonctionnalités Azure OpenAI Service :

- Est stocké au repos dans la ressource Azure OpenAI dans le locataire Azure du client, dans la même zone géographique que la ressource Azure OpenAI ;

- Est toujours chiffré au repos avec le chiffrement AES-256 de Microsoft par défaut, avec l’option d’utilisation d’une clé gérée par le client (certaines fonctionnalités en préversion peuvent ne pas prendre en charge les clés gérées par le client).

- Peuvent être supprimées par le client à tout moment.

Remarque

Les fonctionnalités Azure OpenAI en préversion peuvent ne pas prendre en charge toutes les conditions ci-dessus.

Les données stockées peuvent être utilisées avec les fonctionnalités/fonctionnalités de service suivantes :

- Création d’un modèle personnalisé (affiné). En savoir plus sur le fonctionnement de l’optimisation. Les modèles affinés sont exclusivement disponibles pour le client dont les données ont été utilisées pour créer le modèle affiné, sont chiffrés au repos (lorsqu’ils ne sont pas déployés pour inférence) et peuvent être supprimés par le client à tout moment. Les données d’apprentissage chargées pour le réglage précis ne sont pas utilisées pour entraîner, réentraîner ou améliorer les modèles de base Microsoft ou tiers.

- Traitement par lots. En savoir plus sur le fonctionnement du traitement par lots. Le traitement par lots est un type de déploiement global ; les données stockées au repos restent dans la zone géographique Azure désignée jusqu’à ce que la capacité de traitement soit disponible ; le traitement peut se produire dans n’importe quelle zone géographique où le modèle Azure OpenAI approprié est déployé (en savoir plus sur la disponibilité des régions des modèles).

- API Assistants (préversion). En savoir plus sur le fonctionnement de l’API Assistants. Certaines fonctionnalités d’Assistants, telles que threads, stockent l’historique des messages et d’autres contenus.

- Réponses stockées (préversion). Les complétions stockées conservent les paires entrée-sortie issues des modèles Azure OpenAI déployés par le client, tels que GPT-4o, via l’API des complétions de conversation et affichent les paires dans le portail Azure AI Foundry. Cela permet aux clients de créer des jeux de données avec leurs données de production, qui peuvent ensuite être utilisés pour évaluer ou affiner les modèles (comme autorisé dans les conditions du produit applicables).

Prévention des abus et de la génération de contenu nuisible

Pour réduire le risque d’utilisation dangereuse du service Azure OpenAI, le service Azure OpenAI inclut à la fois les fonctionnalités de filtrage de contenu et de surveillance des abus. Pour en savoir plus sur le filtrage de contenu, consultez le filtrage de contenu Azure OpenAI Service. Pour en savoir plus sur la surveillance des abus, consultez la surveillance des abus.

Le filtrage de contenu se produit de façon synchrone lorsque le service traite les invites pour générer du contenu comme décrit ci-dessus et ici. Aucune invite ou contenu généré n’est stocké dans les modèles de classifieur de contenu, et les invites et les sorties ne sont pas utilisées pour entraîner, réentraîner ou améliorer les modèles classifieur sans votre consentement.

Les évaluations de sécurité des modèles affinés évaluent un modèle affiné pour les réponses potentiellement dangereuses à l’aide des métriques de risque et de sécurité d’Azure. Seule l’évaluation résultante (déployable ou non déployable) est journalisée par le service.

Le système de surveillance des abus Azure OpenAI est conçu pour détecter et atténuer les instances de contenu périodique et/ou de comportements qui suggèrent l’utilisation du service d’une manière qui peut violer le code de conduite ou d’autres conditions de produit applicables. Comme décrit ici, le système utilise des algorithmes et des heuristiques pour détecter les indicateurs d’abus potentiels. Quand ces indicateurs sont détectés, un exemple de requêtes et de réponses du client peut être sélectionné pour révision. La révision est effectuée par LLM par défaut, avec des révisions supplémentaires par les réviseurs humains si nécessaire. Des informations détaillées sur l’IA et la révision humaine sont disponibles sur la surveillance des abus de service Azure OpenAI.

Pour une évaluation par l’IA, les requêtes et réponses du client ne sont pas stockées par le système ni utilisées pour entraîner le LLM ou d’autres systèmes. Pour une vérification humaine, le stockage de données où les invites et les résultats sont stockés est logiquement séparé par ressource client (chaque requête inclut l’identifiant de la ressource Azure OpenAI du client). Un magasin de données distinct se trouve dans chaque zone géographique dans laquelle le service Azure OpenAI est disponible, et les invites et le contenu généré d’un client sont stockés dans la zone géographique Azure où la ressource de service Azure OpenAI du client est déployée, dans la limite du service Azure OpenAI. Les réviseurs humains qui évaluent les abus potentiels peuvent accéder aux invites et aux données d’achèvement uniquement lorsque ces données ont déjà été signalées par le système de surveillance des abus. Les réviseurs humains sont des employés Microsoft autorisés qui accèdent aux données via des requêtes ponctuelles à l’aide des ID de requête, des stations de travail d’accès sécurisé (SAW) et des demandes d’approbation juste à temps (JIT) octroyées par les responsables d’équipe. Pour le service Azure OpenAI déployé dans l’Espace économique européen, les employés de Microsoft autorisés se trouvent dans l’Espace économique européen.

Si le client a été approuvé pour la surveillance des abus modifiés (en savoir plus sur la surveillance des abus de service Azure OpenAI), Microsoft ne stocke pas les invites et les achèvements associés aux abonnements Azure approuvés, et le processus de révision humaine décrit ci-dessus n’est pas possible et n’est pas effectué. Toutefois, l’examen de l’IA peut toujours être effectué, en tirant parti des grands modèles linguistiques qui évaluent les requêtes et les réponses au moment elles sont fournies ou générées, selon le cas.

Remarque

Les fonctionnalités Azure Preview, y compris les modèles Azure OpenAI en préversion, peuvent utiliser différentes pratiques de confidentialité, notamment en ce qui concerne la surveillance des abus. Les préversions peuvent être soumises à des conditions supplémentaires à l’adresse : Conditions d’utilisation supplémentaires pour les préversions Microsoft Azure.

Comment un client peut-il vérifier si le stockage des données pour la surveillance des abus est désactivé ?

Il existe deux façons pour les clients, une fois approuvés pour désactiver la surveillance des abus, afin de vérifier que le stockage des données pour la surveillance des abus a été désactivé dans leur abonnement Azure approuvé :

- Utilisation du portail Azure ou

- Azure CLI (ou toute API de gestion).

Remarque

La valeur « false » pour l’attribut « ContentLogging » s’affiche uniquement si le stockage des données pour la surveillance des abus est désactivé. Sinon, cette propriété n’apparaît pas dans le portail Azure ou la sortie d’Azure CLI.

Conditions préalables

- Connexion à Azure

- Sélectionnez l’abonnement Azure qui héberge la ressource Azure OpenAI Service.

- Accédez à la page Vue d’ensemble de la ressource Azure OpenAI Service.

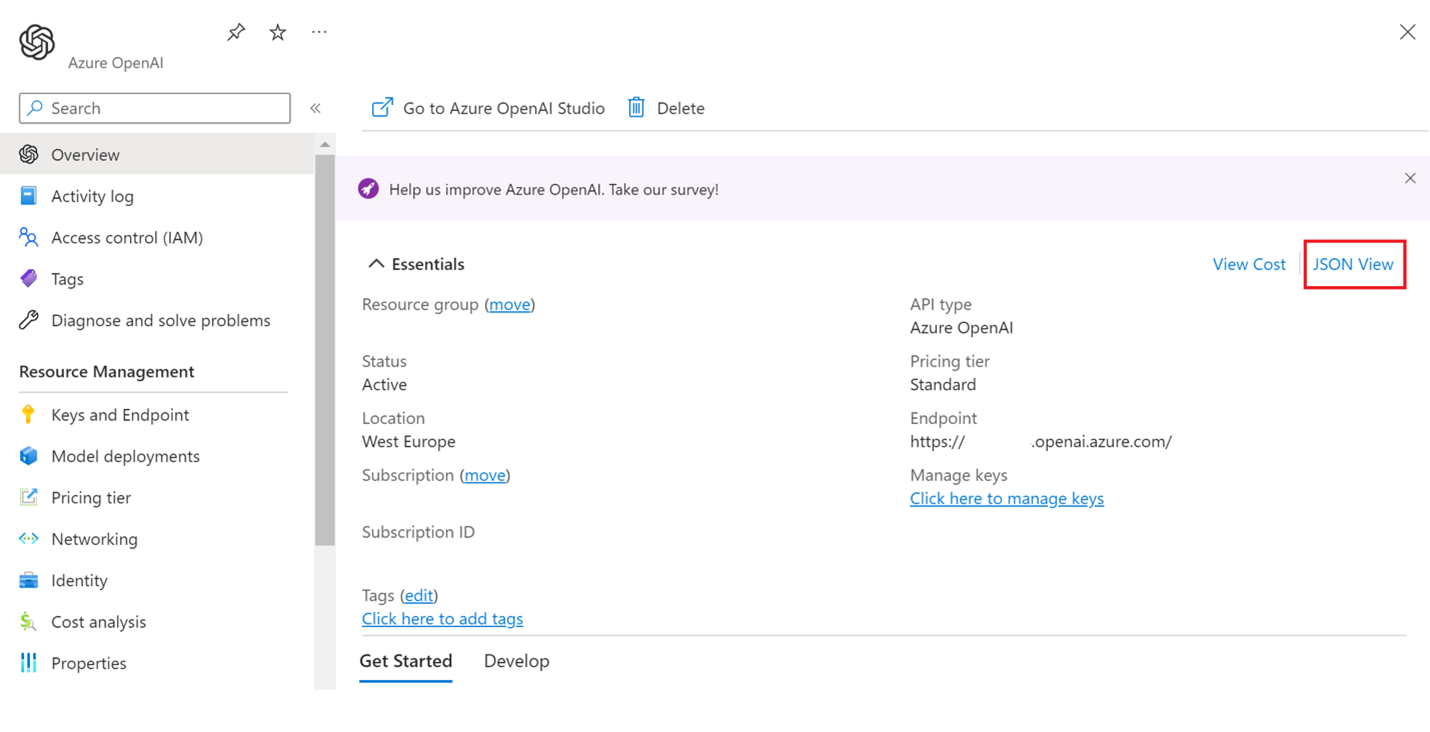

Accédez à la page Vue d’ensemble des ressources

Cliquez sur le lien d’affichage JSON en haut à droite, comme illustré dans l’image ci-dessous.

Il y aura une valeur dans la liste des fonctionnalités appelée « ContentLogging » qui apparaîtra et sera définie sur FALSE lors de la journalisation pour la surveillance des abus est désactivée.

{

"name":"ContentLogging",

"value":"false"

}

Pour en savoir plus sur les engagements de confidentialité et de sécurité de Microsoft, consultez le Centre de gestion de la confidentialité Microsoft.

Journal des modifications

| Date | Modifications |

|---|---|

| 17 décembre 2024 | Ajout d’informations sur le traitement et le stockage des données en connexion avec la nouvelle fonctionnalité d’achèvements stockés ; ajout d’une langue indiquant que les fonctionnalités Azure OpenAI en préversion peuvent ne pas prendre en charge toutes les conditions de stockage des données ; suppression de la désignation « préversion » pour le traitement par lots |

| 18 novembre 2024 | Ajout d’informations sur l’emplacement du traitement des données pour les nouveaux types de déploiement « Zone de données » ; ajout d’informations sur la nouvelle révision de l’IA des invites et des achèvements dans le cadre de la prévention des abus et de la génération de contenu dangereux |

| 4 septembre 2024 | Ajout d’informations (et révision du texte existant en conséquence) sur le traitement des données pour les nouvelles fonctionnalités, notamment l’API Assistants (préversion), Batch (préversion) et les déploiements globaux ; langue révisée liée à l’emplacement du traitement des données, conformément aux principes de résidence des données Azure ; ajout d’informations sur le traitement des données pour les évaluations de sécurité des modèles affinés ; clarification des engagements liés à l’utilisation d’invites et d’achèvements ; révisions mineures pour améliorer la clarté |

| 23 juin 2023 | Ajout d’informations sur le traitement des données pour la nouvelle fonctionnalité Azure sur vos données ; suppression d’informations sur la surveillance des abus qui est désormais disponible dans la surveillance des abus du service Azure OpenAI. Ajout d’une note récapitulative. Contenu mis à jour et simplifié et diagrammes mis à jour pour plus de clarté. ajout du journal des modifications |

Voir aussi

- Code de conduite pour les intégrations du service Azure OpenAI

- Vue d’ensemble des pratiques d’une IA responsable pour les modèles Azure OpenAI

- Note de transparence et cas d’usage pour le service Azure OpenAI

- Résidence des données dans Azure

- Comparer Azure OpenAI dans Azure Government

- Accès limité à Azure OpenAI Service

- Signaler l’abus d’Azure OpenAI Service via le portail d’abus de rapports

- Signaler un problème à cscraireport@microsoft.com