הבנת מושגים עיקריים

Azure Databricks היא פלטפורמת שירות אחת עם טכנולוגיות מרובות המאפשרות עבודה עם נתונים בקנה מידה גדול. בעת שימוש ב- Azure Databricks, יש כמה מושגים עיקריים שיש להבין.

סביבות עבודה

סביבת עבודה ב- Azure Databricks היא סביבה מאובטחת ושיתופית שבה אתה יכול לגשת ולארגן את כל נכסי Databricks, כגון מחשבים ניידים, אשכולות, עבודות, ספריות, לוחות מחוונים וניסויים.

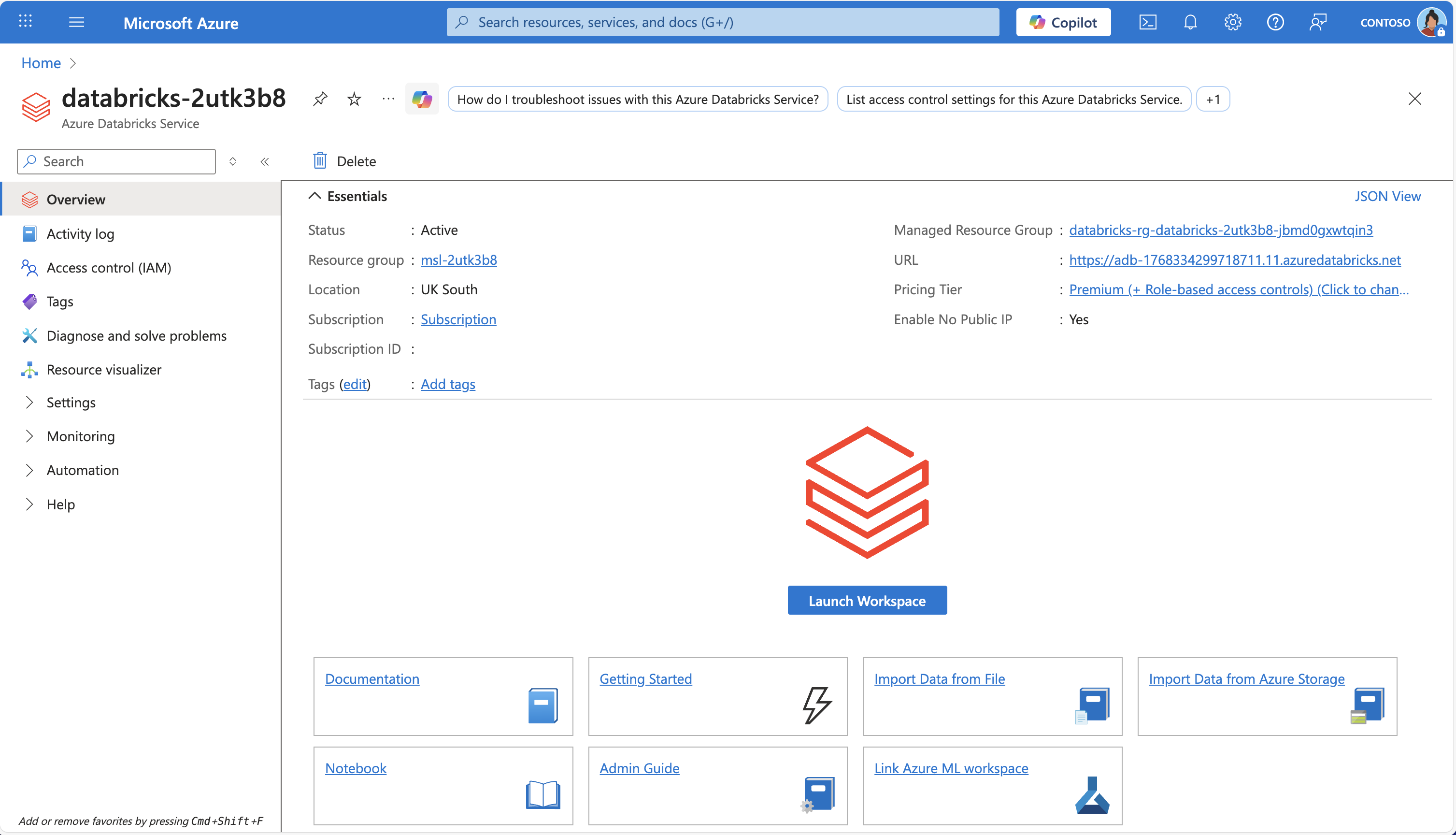

באפשרותך לפתוח סביבת עבודה של Azure Databricks מפורטל Azure, על-ידי בחירה באפשרות הפעל סביבת עבודה.

הוא מספק ממשק משתמש מבוסס אינטרנט (UI) וכן ממשקי API של REST לניהול משאבים וזרימות עבודה. ניתן לבנות סביבות עבודה בתיקיות כדי לארגן פרויקטים, צינורות נתונים או נכסי צוות, וניתן להחיל הרשאות ברמות שונות כדי לשלוט בגישה. הם תומכים בשיתוף פעולה בכך שהם מאפשרים למשתמשים מרובים - כגון מהנדסי נתונים, אנליסטים ומדעני נתונים - לעבוד יחד על מחברות משותפות, לעקוב אחר ניסויים ולנהל יחסי תלות.

בנוסף, סביבות עבודה קשורות ל-Unity Catalog (כאשר מופעל) לפיקוח מרכזי על נתונים, מה שמבטיח גישה מאובטחת לנתונים ברחבי הארגון. כל סביבת עבודה מקושרת גם לקבוצת משאבים בסיסית של Azure (כולל קבוצת משאבים מנוהלים) שמחזיקה את משאבי המחשוב, הרשת והאחסון שבהם Databricks משתמשת מאחורי הקלעים.

מחשבים ניידים

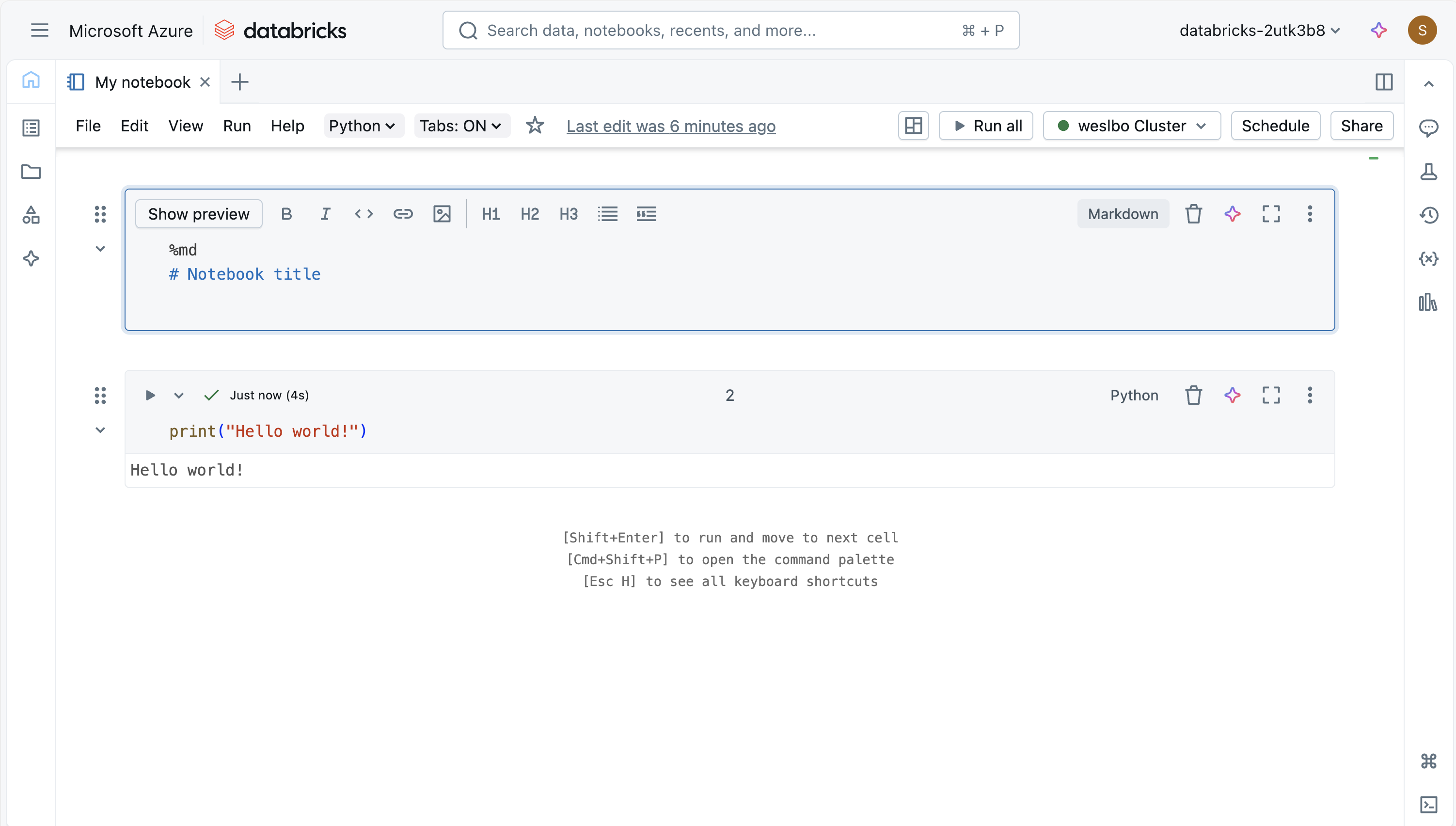

מחברות Databricks הן מסמכים אינטראקטיביים מבוססי אינטרנט המשלבים קוד הניתן להפעלה, הדמיות וטקסט נרטיבי בסביבה אחת. הם תומכים במספר שפות - כגון Python, R, Scala ו- SQL - ומאפשרים למשתמשים לעבור בין שפות באותה מחברת באמצעות פקודות קסם. גמישות זו הופכת את המחברות למתאימות היטב לניתוח נתונים חקרניים, תצוגה חזותית של נתונים, ניסויי למידת מכונה ובניית צינורות נתונים מורכבים.

מחברות מיועדות גם לשיתוף פעולה: משתמשים מרובים יכולים לערוך ולהפעיל תאים בו-זמנית, להוסיף הערות ולשתף תובנות בזמן אמת. הם משתלבים היטב עם אשכולות Databricks, ומאפשרים למשתמשים לעבד מערכי נתונים גדולים ביעילות, ויכולים להתחבר למקורות נתונים חיצוניים באמצעות Unity Catalog לגישה לנתונים מנוהלים. בנוסף, ניתן לשלוט בגרסאות, לתזמן אותם כעבודות או לייצא אותם לשיתוף מחוץ לפלטפורמה, מה שהופך אותם למרכזיים הן בחיפוש אד-הוק והן בתהליכי עבודה ברמת ייצור.

מחברות מכילות אוסף של שני סוגים של תאים: תאי קודותאי סימון. תאי קוד מכילים קוד הניתן להפעלה. תאי סימון מכילים קוד Markdown המעובד כטקסט וגרפיקה. באפשרותך להפעיל תא בודד, קבוצת תאים או את המחברת כולה.

אשכולות

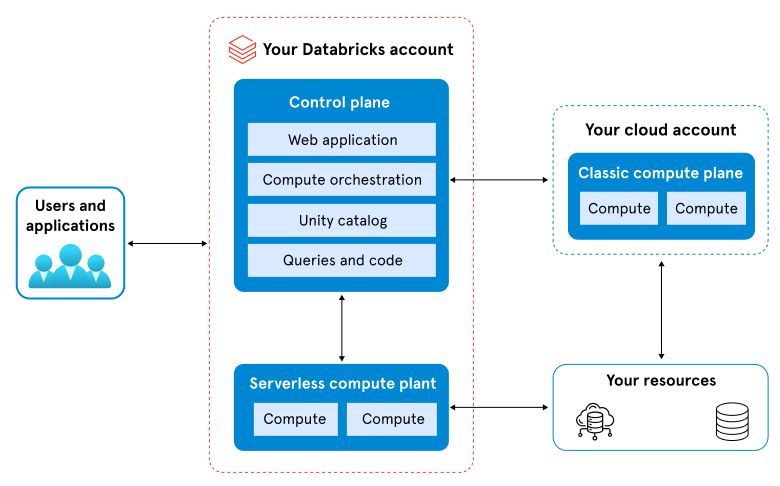

Azure Databricks ממנף ארכיטקטורה דו-שכבתית:

- מישור בקרה: שכבה פנימית זו, המנוהלת על-ידי Microsoft, מטפלת בשירותים עורפיים ספציפיים לחשבון Azure Databricks שלך.

- מישור מחשוב: זוהי השכבה החיצונית שמעבדת את הנתונים וחיה במנוי Azure שלך.

אשכולות הם מנועי החישוב המרכזיים ב- Azure Databricks. הם מספקים את כוח העיבוד הנדרש להפעלת משימות הנדסת נתונים, מדעי נתונים וניתוח. כל אשכול מורכב מצומת דרייבר, המתאם את הביצוע, וצומת עובד אחד או יותר, המטפלים בחישובים מבוזרים. ניתן ליצור אשכולות באופן ידני עם משאבים קבועים או להגדיר לקנה מידה אוטומטי, מה שמאפשר ל-Databricks להוסיף או להסיר צמתי עובדים בהתאם לדרישת עומס העבודה. גמישות זו מבטיחה שימוש יעיל במשאבים ובקרת עלויות.

Azure Databricks Compute מציע קבוצה רחבה של אפשרויות מחשוב הזמינות עבור סוגי עומסי עבודה שונים:

- מחשוב ללא שרת: מחשוב מנוהל במלואו לפי דרישה שמתרחב או מוקטן באופן אוטומטי כדי לענות על צורכי עומסי העבודה. אידיאלי לצוותים שרוצים זמני אתחול מהירים, תקורה ניהולית מינימלית וקנה מידה גמיש.

- מחשוב קלאסי: אשכולות שהוקצו על-ידי המשתמש ותצורתם נקבעו כדי להציע שליטה מלאה בהגדרות המחשוב, כגון גדלים של מחשבים וירטואליים, ספריות וגירסאות זמן ריצה. מתאים במיוחד לעומסי עבודה מיוחדים הדורשים התאמה אישית או ביצועים עקביים.

- מחסני SQL: חשב משאבים הממוטבים לניתוח מבוסס SQL ולשאילתות BI. ניתן להקצות מחסני SQL כמחסני SQL ללא שרת (אלסטיים, מנוהלים) או קלאסיים (מוגדרים על-ידי המשתמש) בהתאם לדרישות הפיקוח והביצועים.

זה מאפשר לך להתאים את המחשוב לצרכים ספציפיים - החל מניתוח גישוש במחשבים ניידים, דרך צינורות ETL בקנה מידה גדול ועד לוחות מחוונים ודיווח בעלי ביצועים גבוהים.

Databricks Runtime

Databricks Runtime הוא קבוצה של מבנים מותאמים אישית של Apache Spark הכוללים שיפורי ביצועים וספריות נוספות. זמני ריצה אלה מקלים על הטיפול במשימות כגון למידת מכונה, עיבוד גרפיםוגנומיקה, תוך תמיכה בעיבוד נתונים כללי וניתוח.

Databricks מספקת גרסאות זמן ריצה מרובות, כולל מהדורות תמיכה לטווח ארוך (LTS). כל מהדורה מציינת את גרסת Apache Spark הבסיסית, תאריך השחרור שלה ומתי תסתיים התמיכה. עם הזמן, גירסאות זמן ריצה ישנות יותר עוקבות אחר מחזור חיים:

- מדור קודם – זמין אך אינו מומלץ עוד.

- הוצא משימוש - מסומן להסרה במהדורה עתידית.

- סיום התמיכה (EoS) – לא יסופקו תיקונים או תיקונים נוספים.

- סוף החיים (EoL) - יצא לגמלאות ואינו זמין עוד.

אם מופץ עדכון תחזוקה עבור גירסת זמן ריצה שבה אתה משתמש, באפשרותך להחיל אותו על-ידי הפעלה מחדש של האשכול שלך.

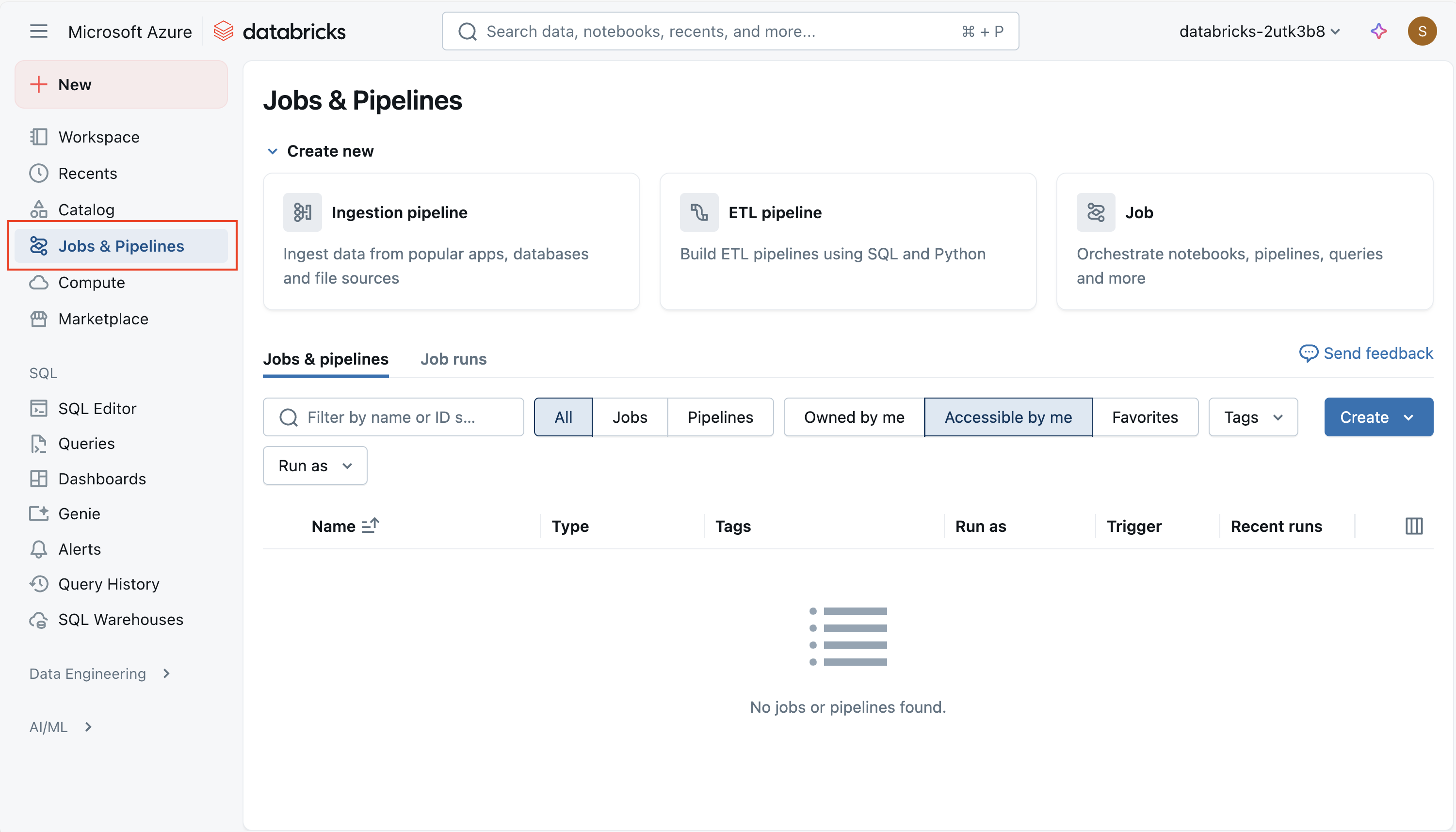

משרות Lakeflow

Lakeflow Jobs מספק אוטומציה ותיאום של זרימת עבודה ב- Azure Databricks, מה שמאפשר לתזמן, לתאם ולהפעיל משימות עיבוד נתונים באופן מהימן. במקום להפעיל קוד באופן ידני, אתה יכול להשתמש בעבודות כדי להפוך עומסי עבודה חוזרים או ברמת ייצור לאוטומטיים כגון צינורות ETL, הדרכת למידת מכונה או רענון לוח מחוונים.

עבודה ב-Databricks היא בעצם מיכל למשימה אחת או יותר. משימות מגדירות את העבודה שיש לבצע - לדוגמה, הפעלת מחברת, ביצוע משימת Spark, קריאה לקוד חיצוני, ...

ניתן להפעיל משימות בדרכים שונות:

- לפי לוח זמנים (למשל, כל לילה בחצות).

- בתגובה לאירוע.

- באופן ידני, בעת הצורך.

מכיוון שהן ניתנות לחזרה ומנוהלות, עבודות הן קריטיות לעומסי עבודה של ייצור. הם מבטיחים שצינורות נתונים פועלים באופן עקבי, מודלים של ML מאומנים ונפרסים בצורה מבוקרת, ומערכות במורד הזרם מקבלות נתונים מעודכנים ומדויקים.

אגם דלתא

Delta Lake היא מסגרת אחסון בקוד פתוח המשפרת את המהימנות והמדרגיות של אגמי נתונים על ידי הוספת תכונות טרנזקציות על גבי אחסון אובייקטים בענן, כגון Azure Data Lake Storage. אגמי נתונים מסורתיים יכולים לסבול מבעיות כמו נתונים לא עקביים, כתיבה חלקית או קשיים בניהול גישה בו-זמנית. דלתא לייק מטפלת בבעיות אלה על ידי תמיכה:

- עסקאות ACID (אטומיות, עקביות, בידוד, עמידות) לקריאה וכתיבה אמינות.

- טיפול מדרגי במטה-נתונים כך שטבלאות יכולות לגדול למיליארדי קבצים ללא אובדן ביצועים.

- ניהול גירסאות נתונים והחזרה למצב קודם, המאפשר שאילתות מסע בזמן ושחזור של מצבים קודמים.

- עיבוד אצווה וזרימה מאוחד, כך שאותה טבלה יכולה להתמודד עם קליטה בזמן אמת ועומסי אצווה היסטוריים.

על גבי בסיס זה, טבלאות דלתא מספקות הפשטת טבלאות מוכרת המקלה על העבודה עם נתונים מובנים באמצעות שאילתות SQL או ה- API של DataFrame. טבלאות דלתא הן פורמט הטבלה המוגדר כברירת מחדל ב- Azure Databricks, ומבטיח שנתונים חדשים מאוחסנים עם ערבויות טרנזקציות כברירת מחדל.

Databricks SQL

Databricks SQL מביאה יכולות אחסון נתונים ל-Databricks Lakehouse, ומאפשרת לאנליסטים ולמשתמשים עסקיים לבצע שאילתות ולדמיין נתונים המאוחסנים בפורמטים פתוחים ישירות באגם הנתונים. הוא תומך ב-ANSI SQL, כך שכל מי שמכיר את SQL יכול להריץ שאילתות, לבנות דוחות וליצור לוחות מחוונים ללא צורך בלימוד שפות או כלים חדשים.

Databricks SQL זמין רק בשכבת הפרימיום של Azure Databricks. היא כוללת:

- עורך SQL לכתיבה והפעלה של שאילתות.

- לוחות מחוונים וכלי תצוגה חזותית לשיתוף תובנות.

- אינטגרציה עם כלי BI וניתוח חיצוניים.

מחסני SQL

כל שאילתות ה-SQL של Databricks פועלות על מחסני SQL (שנקראו בעבר נקודות קצה של SQL), שהם משאבי מחשוב ניתנים להרחבה המנותקים מהאחסון. סוגי מחסנים שונים זמינים בהתאם לביצועים, עלות וצרכי ניהול:

מחסני SQL ללא שרת

- מחשוב מיידי ואלסטי עם אתחול מהיר וקנה מידה אוטומטי.

- תקורה ניהולית נמוכה מכיוון ש-Databricks מטפלת בקיבולת, תיקון ואופטימיזציה.

- יעילות עלות-תועלת על-ידי שינוי קנה מידה אוטומטי והימנעות מעלויות משאבים לא פעילות.

מחסני SQL מקצועיים

- ניתן להתאמה אישית יותר אך איטי יותר להתחלה (≈4 דקות).

- שינוי קנה מידה אוטומטי פחות רספונסיבי בהשוואה ללא שרת.

- שימושי כאשר נדרשים עומסי עבודה עקביים וצפויים.

מחסני SQL קלאסיים

- משאבי מחשוב פועלים במנוי Azure שלך, לא ב- Databricks.

- פחות גמיש מאשר ללא שרתים, אך עשוי להיות מועדף עבור דרישות פיקוח או ניהול עלויות ספציפיות.

מגל תות

MLflow היא פלטפורמת קוד פתוח שנועדה לנהל את מחזור החיים של למידת מכונה (ML) מקצה לקצה. זה עוזר למדעני נתונים ומהנדסי ML לעקוב אחר ניסויים, לנהל מודלים ולייעל את תהליך העברת המודלים מפיתוח לייצור. MLflow תומך גם בתהליכי עבודה של בינה מלאכותית גנרטיבית וכולל כלים להערכה ושיפור של סוכני בינה מלאכותית.