Megjegyzés

Az oldalhoz való hozzáféréshez engedély szükséges. Megpróbálhat bejelentkezni vagy módosítani a címtárat.

Az oldalhoz való hozzáféréshez engedély szükséges. Megpróbálhatja módosítani a címtárat.

Fontos

Az Azure Content Moderator 2024 februárjától elavult, és 2027. március 15-én megszűnik. Ezt az Azure AI Content Safety váltja fel, amely fejlett AI-funkciókat és továbbfejlesztett teljesítményt kínál.

Az Azure AI Content Safety egy átfogó megoldás, amely a felhasználók által létrehozott és AI által létrehozott tartalmak észlelésére szolgál az alkalmazásokban és szolgáltatásokban. Az Azure AI Content Safety számos forgatókönyvre alkalmas, például online piacterekre, játékvállalatokra, közösségi üzenetkezelési platformokra, nagyvállalati médiavállalatokra és K-12 oktatási megoldásszolgáltatókra. Az alábbiakban áttekintjük a funkcióit és képességeit:

- Szöveg- és képészlelési API-k: Több súlyossági szinttel vizsgálhat szöveget és képeket szexuális tartalmak, erőszak, gyűlölet és önkárosítás esetén.

- Content Safety Studio: Egy online eszköz, amely a legújabb ML-modelleinket használva a tartalommérsékléshez potenciálisan sértő, kockázatos vagy nemkívánatos tartalmak kezelésére szolgál. Sablonokat és testreszabott munkafolyamatokat biztosít, amelyek lehetővé teszik a felhasználók számára, hogy saját tartalommoderáló rendszereket építsenek.

- Nyelvi támogatás: Az Azure AI Content Safety több mint 100 nyelvet támogat, és kifejezetten angol, német, japán, spanyol, francia, olasz, portugál és kínai nyelven van betanítva.

Az Azure AI Content Safety robusztus és rugalmas megoldást kínál a tartalom moderálási igényekhez. A Content Moderatorról az Azure AI Content Safetyre való váltással kihasználhatja a legújabb eszközöket és technológiákat, hogy a tartalmak mindig a pontos specifikációknak megfelelően legyenek moderálva.

Tudjon meg többet az Azure AI Content Safety-ről, és ismerje meg, hogyan támogathatja a tartalom moderálási stratégiáját.

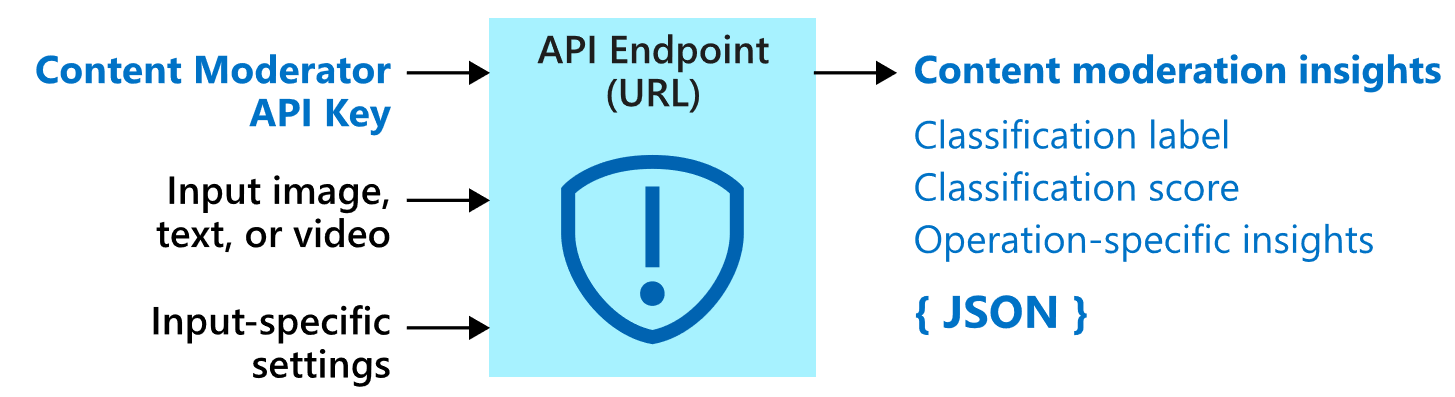

Az Azure Content Moderator egy AI-szolgáltatás, amely lehetővé teszi a potenciálisan sértő, kockázatos vagy más módon nemkívánatos tartalmak kezelését. Magában foglalja az AI-alapú tartalom moderálás szolgáltatást, amely vizsgálja a szöveget, a képeket és a videókat, és automatikusan alkalmazza a tartalmi jelzéseket.

Érdemes lehet tartalomszűrési szoftvereket létrehozni az alkalmazásba, hogy megfeleljen a szabályzatoknak, vagy fenntartsa a felhasználók számára a kívánt környezetet.

Ez a dokumentáció a következő cikktípusokat tartalmazza:

- A rövid útmutatók kezdő lépésekhez nyújtanak útmutatást, amelyek segítenek a szolgáltatással kapcsolatos kérések megfogalmazásában.

- Az útmutatók konkrétabb vagy testre szabottabb módon tartalmazzák a szolgáltatás használatára vonatkozó utasításokat.

- A fogalmak részletesen ismertetik a szolgáltatás funkcióit és funkcióit.

Strukturáltabb megközelítésért kövesse a Content Moderator betanítási modulját.

- Bevezetés a Content Moderator-be

- Szöveg osztályozása és moderálása az Azure Content Moderator használatával

A használat helye

Az alábbiakban néhány olyan forgatókönyvet látunk, amelyekben egy szoftverfejlesztő vagy -csapatnak tartalommoderálásra van szüksége:

- Online piacterek, amelyek moderálják a termékkatalógusokat és más, felhasználó által létrehozott tartalmakat.

- Játékvállalatok, amelyek moderálják a felhasználó által létrehozott játékelemeket és csevegőszobákat.

- Közösségi üzenetkezelési platformok, amelyek moderálják a felhasználók által hozzáadott képeket, szöveget és videókat.

- A tartalom központosított moderálását megvalósító nagyvállalati médiavállalatok.

- A K-12 oktatási megoldásszolgáltatók kiszűrik a diákok és oktatók számára nem megfelelő tartalmakat.

Fontos

A Content Moderator nem használható illegális gyermek-kizsákmányolási képek észlelésére. A minősített szervezetek azonban a PhotoDNA felhőszolgáltatással is képernyőre helyezhetik az ilyen típusú tartalmakat.

Mit tartalmaz?

A Content Moderator szolgáltatás számos webszolgáltatás API-t tartalmaz, amelyek REST-hívásokkal és .NET SDK-val is elérhetőek.

Moderálási API-k

A Content Moderator szolgáltatás moderálási API-kat tartalmaz, amelyek ellenőrzik, hogy a tartalom esetleg nem megfelelő vagy kifogásolható-e.

Az alábbi táblázat a moderálási API-k különböző típusait ismerteti.

| API-csoport | Leírás |

|---|---|

| Szövegmoderálás | Beolvassa a sértő tartalmakat, a szexuálisan explicit vagy szuggesztív tartalmakat, a trágárságot és a személyes adatokat. |

| Egyéni kifejezéslista | Ellenőrzi a szöveget egy egyéni kifejezéslista és a beépített kifejezések alapján. Az egyéni listákkal a saját tartalomházirendjének megfelelően tilthatja le vagy engedélyezheti a tartalmakat. |

| Képmoderálás | Kiszűri a felnőtteknek szóló és kényes tartalmakat ábrázoló képeket, észleli a képeken található szövegeket az optikai karakterfelismerés (OCR) segítségével, valamint arcokat ismer fel. |

| Egyéni képlisták | Egyéni képlista alapján szűri a képeket. Egyéni képlistákkal szűrheti ki az olyan gyakran ismétlődő tartalmakat, amelyeket nem szeretne ismét besorolni. |

| Videomoderálás | Felnőtteknek szóló és kényes tartalmakat keres a videókban, és az ilyen tartalmakhoz időjelölőket ad vissza. |

Adatvédelem és biztonság

Az Összes Azure AI-szolgáltatáshoz hasonlóan a Content Moderator szolgáltatást használó fejlesztőknek is tisztában kell lenniük a Microsoft ügyféladatokra vonatkozó szabályzataival. További információért tekintse meg az Azure AI-szolgáltatások oldalát a Microsoft Adatvédelmi központban.

Következő lépések

- Egészítse ki az ügyfélkönyvtár vagy a REST API gyorsindítását az alapvető forgatókönyvek kódban történő megvalósítására.