Eseményüzenetek írása az Azure Data Lake Storage Gen2-be az Apache Flink® DataStream API-val

Fontos

Ez a szolgáltatás jelenleg előzetes kiadásban elérhető. A Microsoft Azure Előzetes verzió kiegészítő használati feltételei további jogi feltételeket tartalmaznak, amelyek a bétaverzióban, előzetes verzióban vagy egyébként még nem általánosan elérhető Azure-funkciókra vonatkoznak. Erről az adott előzetes verzióról az Azure HDInsight az AKS előzetes verziójában tájékozódhat. Ha kérdése vagy funkciójavaslata van, küldjön egy kérést az AskHDInsightban a részletekkel együtt, és kövessen minket további frissítésekért az Azure HDInsight-közösségről.

Az Apache Flink fájlrendszereket használ az adatok felhasználására és tartós tárolására, mind az alkalmazások eredményei, mind a hibatűrés és a helyreállítás érdekében. Ebből a cikkből megtudhatja, hogyan írhat eseményüzeneteket az Azure Data Lake Storage Gen2-be a DataStream API-val.

Előfeltételek

- Apache Flink-fürt a HDInsighton az AKS-en

- Apache Kafka-fürt a HDInsighton

- Az MSI használata az ADLS Gen2 eléréséhez

- IntelliJ az Azure-beli virtuális gépen való fejlesztéshez a HDInsightban az AKS virtuális hálózaton

Apache Flink FileSystem-összekötő

Ez a fájlrendszer-összekötő ugyanazokat a garanciákat biztosítja a BATCH és a STREAM esetében is, és úgy lett kialakítva, hogy pontosan egyszer szemantikát biztosítson a STREAM-végrehajtáshoz. További információ: Flink DataStream Filesystem.

Apache Kafka Csatlakozás or

Az Flink egy Apache Kafka-összekötőt biztosít az adatok Kafka-témakörökből való olvasásához és a Kafka-témakörökbe való írásához pontosan egyszer. További információ: Apache Kafka Csatlakozás or.

Az Apache Flink projektjének létrehozása

pom.xml az IntelliJ IDEA-n

<properties>

<maven.compiler.source>1.8</maven.compiler.source>

<maven.compiler.target>1.8</maven.compiler.target>

<flink.version>1.17.0</flink.version>

<java.version>1.8</java.version>

<scala.binary.version>2.12</scala.binary.version>

<kafka.version>3.2.0</kafka.version>

</properties>

<dependencies>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-java</artifactId>

<version>${flink.version}</version>

</dependency>

<!-- https://mvnrepository.com/artifact/org.apache.flink/flink-streaming-java -->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-java</artifactId>

<version>${flink.version}</version>

</dependency>

<!-- https://mvnrepository.com/artifact/org.apache.flink/flink-clients -->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-clients</artifactId>

<version>${flink.version}</version>

</dependency>

<!-- https://mvnrepository.com/artifact/org.apache.flink/flink-connector-files -->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-files</artifactId>

<version>${flink.version}</version>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-kafka</artifactId>

<version>${flink.version}</version>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-assembly-plugin</artifactId>

<version>3.0.0</version>

<configuration>

<appendAssemblyId>false</appendAssemblyId>

<descriptorRefs>

<descriptorRef>jar-with-dependencies</descriptorRef>

</descriptorRefs>

</configuration>

<executions>

<execution>

<id>make-assembly</id>

<phase>package</phase>

<goals>

<goal>single</goal>

</goals>

</execution>

</executions>

</plugin>

</plugins>

</build>

</project>

Program az ADLS Gen2 fogadóhoz

abfsGen2.java

Feljegyzés

Cserélje le az Apache Kafka-t a HDInsight-fürt bootStrapServers rendszerindítási kiszolgálóira a Kafka 3.2 saját közvetítőire

package contoso.example;

import org.apache.flink.api.common.eventtime.WatermarkStrategy;

import org.apache.flink.api.common.serialization.SimpleStringEncoder;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.configuration.MemorySize;

import org.apache.flink.connector.file.sink.FileSink;

import org.apache.flink.connector.kafka.source.KafkaSource;

import org.apache.flink.connector.kafka.source.enumerator.initializer.OffsetsInitializer;

import org.apache.flink.core.fs.Path;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.api.functions.sink.filesystem.rollingpolicies.DefaultRollingPolicy;

import java.time.Duration;

public class KafkaSinkToGen2 {

public static void main(String[] args) throws Exception {

// 1. get stream execution env

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

Configuration flinkConfig = new Configuration();

flinkConfig.setString("classloader.resolve-order", "parent-first");

env.getConfig().setGlobalJobParameters(flinkConfig);

// 2. read kafka message as stream input, update your broker ip's

String brokers = "<update-broker-ip>:9092,<update-broker-ip>:9092,<update-broker-ip>:9092";

KafkaSource<String> source = KafkaSource.<String>builder()

.setBootstrapServers(brokers)

.setTopics("click_events")

.setGroupId("my-group")

.setStartingOffsets(OffsetsInitializer.earliest())

.setValueOnlyDeserializer(new SimpleStringSchema())

.build();

DataStream<String> stream = env.fromSource(source, WatermarkStrategy.noWatermarks(), "Kafka Source");

stream.print();

// 3. sink to gen2, update container name and storage path

String outputPath = "abfs://<container-name>@<storage-path>.dfs.core.windows.net/flink/data/click_events";

final FileSink<String> sink = FileSink

.forRowFormat(new Path(outputPath), new SimpleStringEncoder<String>("UTF-8"))

.withRollingPolicy(

DefaultRollingPolicy.builder()

.withRolloverInterval(Duration.ofMinutes(2))

.withInactivityInterval(Duration.ofMinutes(3))

.withMaxPartSize(MemorySize.ofMebiBytes(5))

.build())

.build();

stream.sinkTo(sink);

// 4. run stream

env.execute("Kafka Sink To Gen2");

}

}

Csomagolja be a jart, és küldje el az Apache Flinknek.

Töltse fel az üveget az ABFS-be.

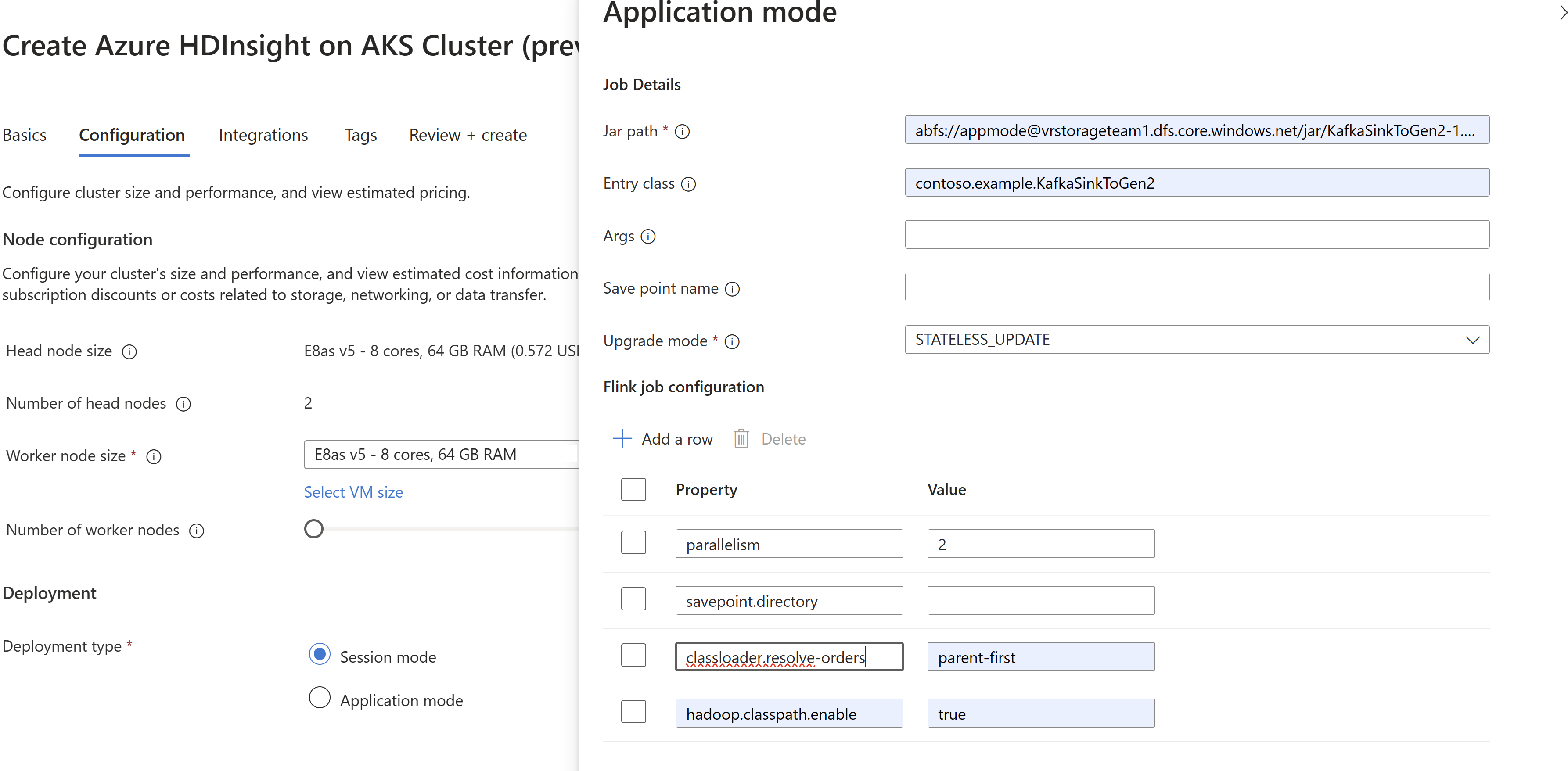

Adja át a feladat jar-adatait a fürt létrehozásakor

AppMode.Feljegyzés

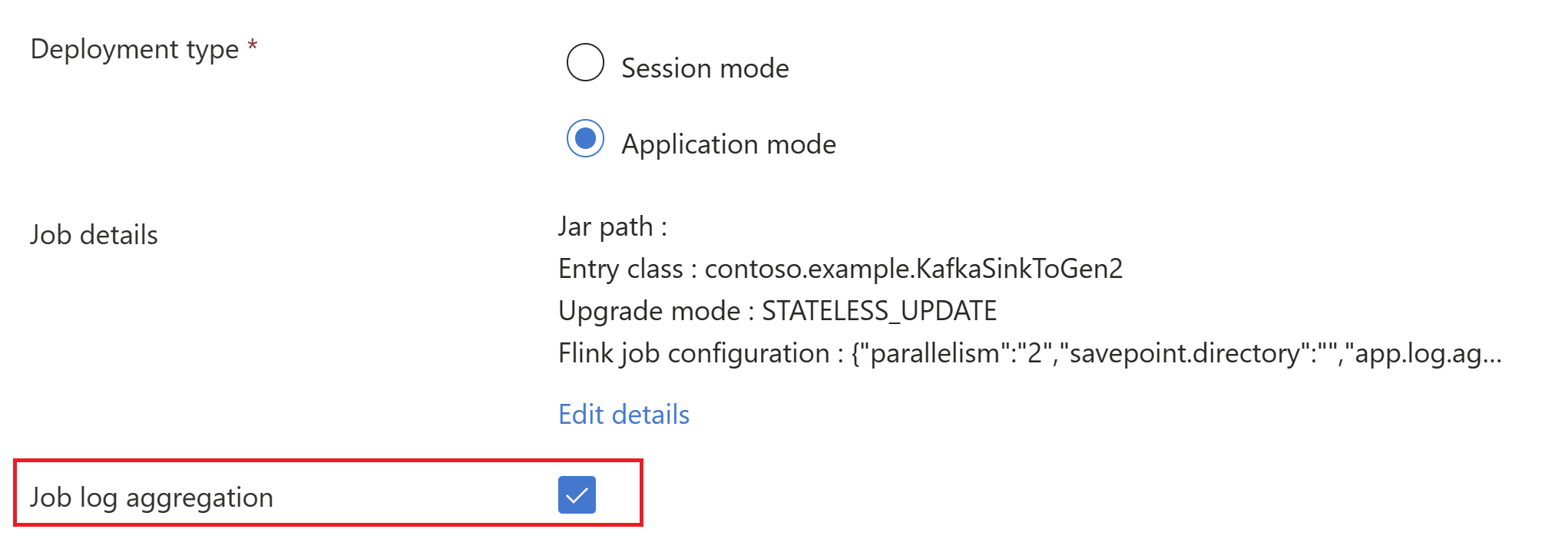

Mindenképpen adja hozzá a classloader.resolve-order parancsot "parent-first" és hadoop.classpath.enable as

trueVálassza a Feladatnapló-összesítés lehetőséget a feladatnaplók tárfiókba való leküldéséhez.

Láthatja, hogy a feladat fut.

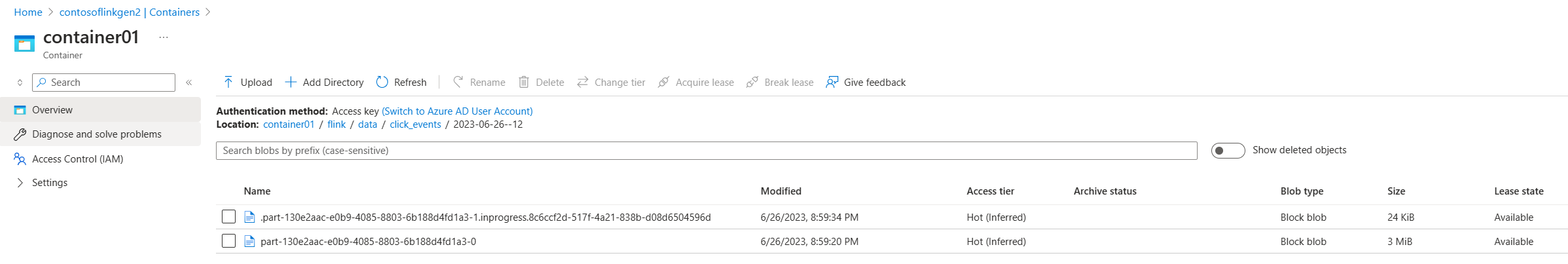

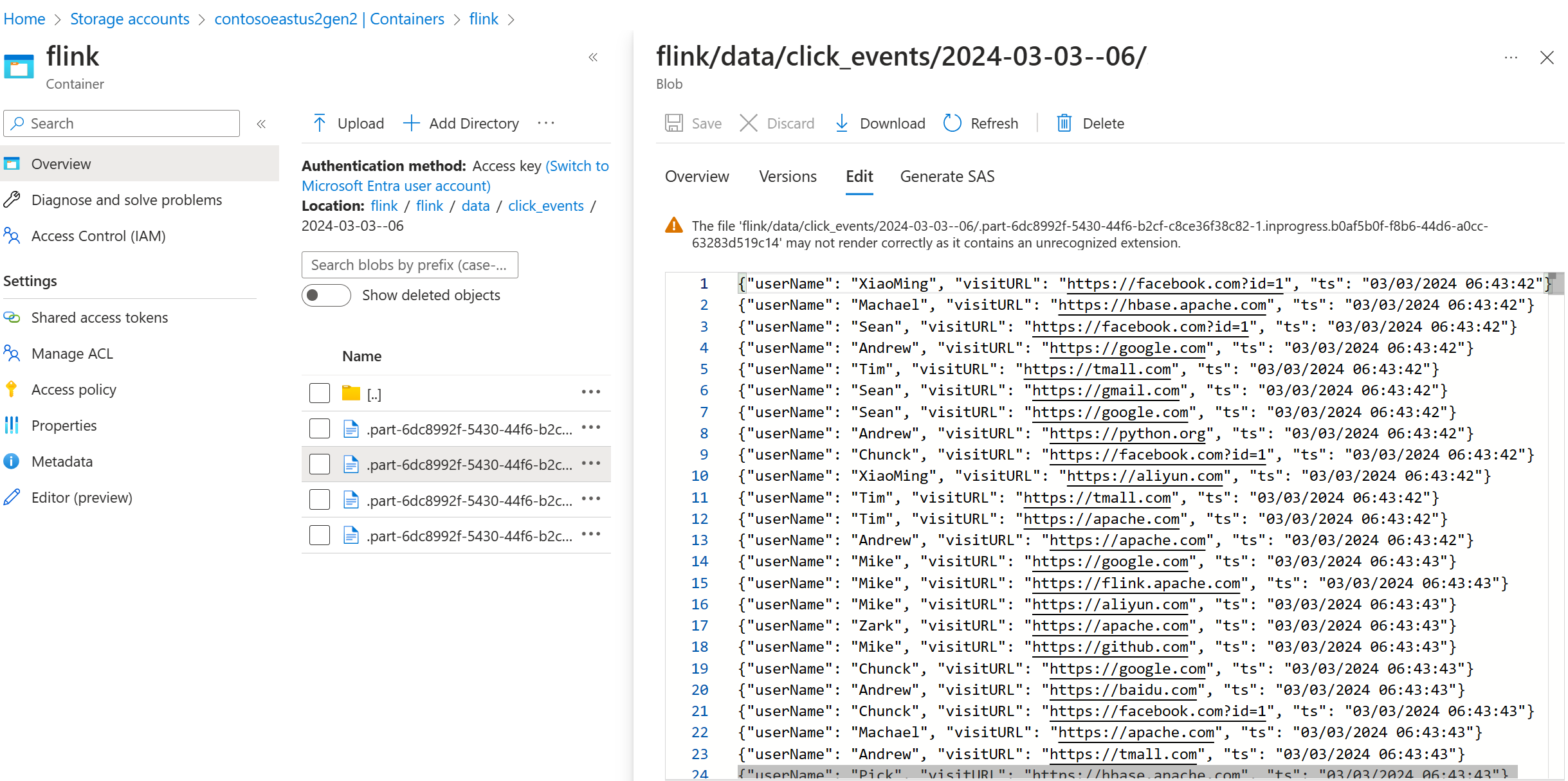

Streamelési adatok ellenőrzése az ADLS Gen2-ben

Az ADLS Gen2-be való streamelést látjuk click_events .

Megadhat egy gördülő szabályzatot, amely a folyamatban lévő részfájlt az alábbi három feltétel bármelyikén görgeti:

.withRollingPolicy(

DefaultRollingPolicy.builder()

.withRolloverInterval(Duration.ofMinutes(5))

.withInactivityInterval(Duration.ofMinutes(3))

.withMaxPartSize(MemorySize.ofMebiBytes(5))

.build())

Referencia

- Apache Kafka Csatlakozás or

- Adatfolyam-fájlrendszer összekapcsolása

- Apache Flink webhely

- Az Apache, az Apache Kafka, a Kafka, az Apache Flink, a Flink és a kapcsolódó nyílt forráskód projektnevek az Apache Software Foundation (ASF) védjegyei.