Megjegyzés

Az oldalhoz való hozzáféréshez engedély szükséges. Megpróbálhat bejelentkezni vagy módosítani a címtárat.

Az oldalhoz való hozzáféréshez engedély szükséges. Megpróbálhatja módosítani a címtárat.

ÉRVÉNYES: Azure CLI ml-bővítmény v2 (aktuális)

Azure CLI ml-bővítmény v2 (aktuális) Python SDK azure-ai-ml v2 (aktuális)

Python SDK azure-ai-ml v2 (aktuális)

A felelős mesterséges intelligencia (Responsible AI) az AI-rendszerek biztonságos, etikai és bizalmi fejlesztésének, értékelésének és üzembe helyezésének egyik megközelítése. Az AI-rendszerek számos, az alkotók által hozott döntésből erednek. A felelős AI segít e döntések irányításában – a rendszer céljának meghatározásától a felhasználói interakcióig – a előnyösebb és méltányosabb eredmények felé. A tervezés középpontjában tartja az embereket és céljaikat, és tiszteletben tartja az olyan értékeket, mint a méltányosság, a megbízhatóság és az átláthatóság.

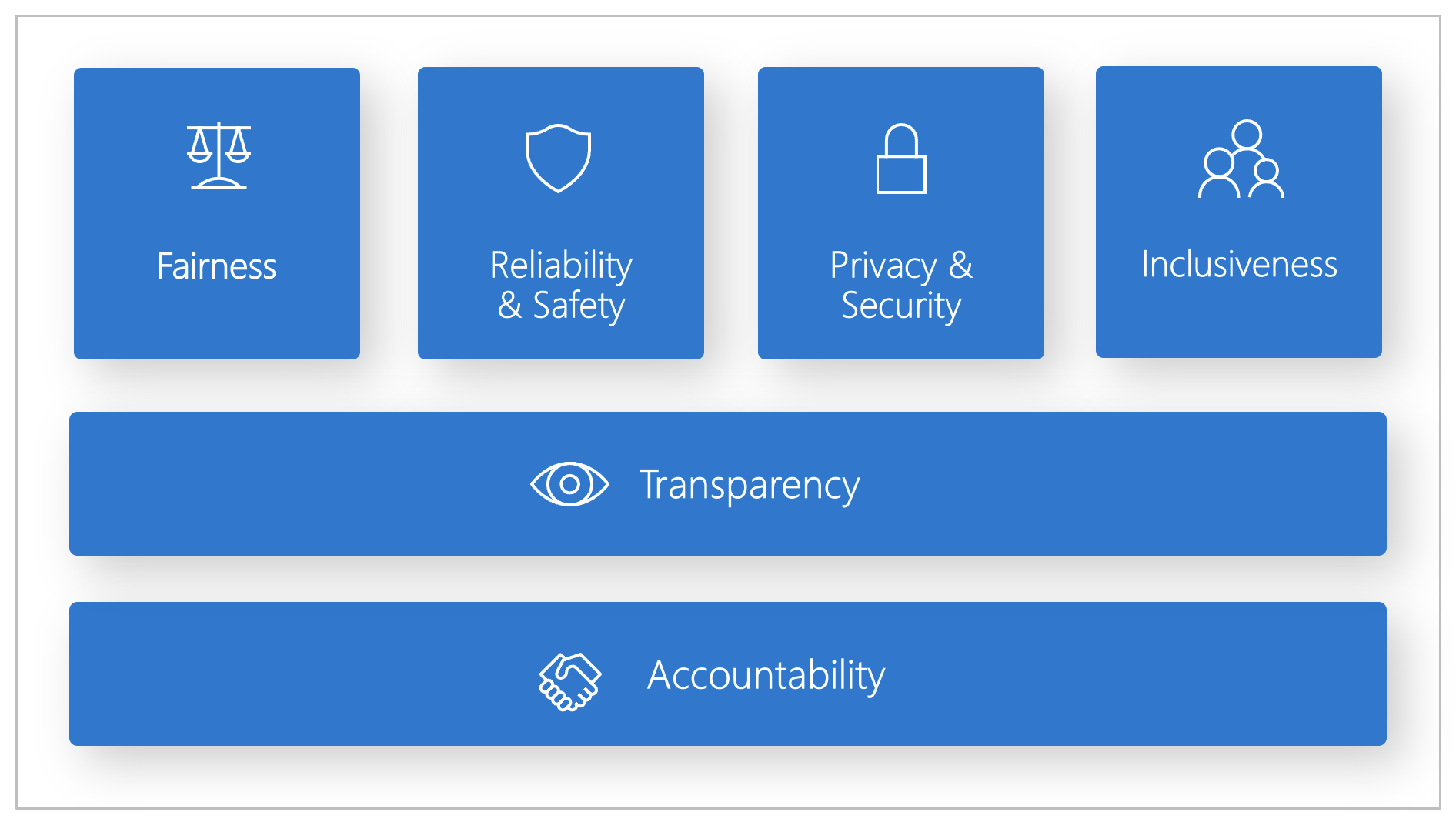

A Microsoft létrehozott egy felelős AI-szabványt, amely hat alapelven alapuló MI-rendszerek kiépítésére használható: méltányosság, megbízhatóság és biztonság, adatvédelem és biztonság, befogadás, átláthatóság és elszámoltathatóság. Ezek az alapelvek a mesterséges intelligencia felelős és megbízható megközelítésének alapjai, különösen mivel az intelligens technológia egyre gyakoribbá válik a mindennapi termékekben és szolgáltatásokban.

Ez a cikk bemutatja, hogyan nyújt az Azure Machine Learning eszközöket a fejlesztők és az adattudósok számára e hat alapelv implementálásához és implementálásához.

Méltányosság és befogadás

Az AI-rendszereknek mindenkit tisztességesen kell kezelnie, és kerülnie kell a hasonló csoportok eltérő befolyásolását. Ha például az AI-rendszerek útmutatást nyújtanak az orvosi kezeléssel, a hiteligényléssel vagy a foglalkoztatással kapcsolatban, ugyanazokat a javaslatokat kell tenniük a hasonló tünetekkel, pénzügyi körülményekkel vagy képesítéssel rendelkező személyeknek.

Méltányosság és befogadás az Azure Machine Learningben: A Felelős AI-irányítópultméltányossági felmérési összetevője segít felmérni a modell méltányosságát a különböző érzékeny csoportokban, például a nem, az etnikum, az életkor és más jellemzők tekintetében.

Megbízhatóság és biztonság

A bizalom kiépítéséhez az AI-rendszereknek megbízhatóan, biztonságosan és következetesen kell működnie. Tervezett módon kell működniük, biztonságosan kell reagálniuk a váratlan körülményekre, és ellen kell állniuk a káros manipulációnak. Viselkedésük és a különböző feltételek kezelésére való képességük tükrözi a fejlesztők által a tervezés és tesztelés során várható helyzetek körét.

Megbízhatóság és biztonság az Azure Machine Learningben: A Felelős AI-irányítópulthibaelemzési összetevője segít:

- Részletes ismereteket szerezhet a hibák modellhez való elosztásáról.

- Azonosítsa az adatok kohorszait (részhalmazait) a teljes teljesítménymutatónál magasabb hibaarányú adatokkal.

Ezek az eltérések akkor fordulhatnak elő, ha a rendszer vagy a modell adott demográfiai csoportoknál vagy ritkán megfigyelt bemeneti feltételeknél alulteljesül a betanítási adatokban.

Átláthatóság

Amikor az AI-rendszerek tájékoztatják az emberek életét befolyásoló döntéseket, kritikus fontosságú, hogy az emberek megértsék, hogyan születnek ezek a döntések. Előfordulhat például, hogy egy bank AI-rendszert használ annak eldöntésére, hogy egy személy hitelképes-e, vagy egy vállalat használhat egyet az állásjelöltek kiválasztásához.

Az átláthatóság fontos része az értelmezhetőség: az AI-rendszer viselkedésének hasznos magyarázata. Az érthetőség javítása segít az érintetteknek megérteni az AI-rendszerek működését és működését, hogy azonosítani tudják a teljesítményproblémákat, a méltányossági aggályokat, a kizáró gyakorlatokat vagy a nem várt eredményeket.

Átláthatóság az Azure Machine Learningben: A felelősségteljes AI-irányítópultmodellértelmezhetősége és az ellenfaktuális lehetőségösszetevők segítenek a modellelőjelzések emberi-érthető leírásának létrehozásában.

A modell értelmezhetőségi összetevője több nézetet is biztosít a modell viselkedéséhez:

- Globális magyarázatok. Milyen funkciók befolyásolják például a hitelkiosztási modell általános viselkedését?

- Helyi magyarázatok. Például miért hagytak jóvá vagy utasítottak el egy ügyfél hitelkérelmét?

- Modellmagyarázatok az adatpontok kiválasztott kohorszához. Milyen funkciók befolyásolják például az alacsony jövedelmű kérelmezők hitelkiosztási modelljének általános viselkedését?

Az ellenfaktuális lehetőségösszetevő segít megérteni és hibakeresésre használni egy gépi tanulási modellt azáltal, hogy bemutatja, hogyan reagál a funkciók változásaira és zavarára.

Az Azure Machine Learning egy felelős AI-scorecardot is támogat. A scorecard egy testreszabható PDF-jelentés, amelyet a fejlesztők konfigurálhatnak, hozhatnak létre, tölthetnek le és oszthatnak meg a műszaki és nem technikai érdekelt felekkel. Segít az érdekelt feleknek az adathalmazok és a modellek állapotának megismertetésében, a megfelelőség elérésében és a bizalom kiépítésében. A scorecard a gépi tanulási modell jellemzőinek feltárásával is támogatja a naplózási felülvizsgálatokat.

Adatvédelem és biztonság

Ahogy az MI egyre gyakoribbá válik, a magánélet védelme, valamint a személyes és üzleti információk védelme sokkal fontosabb és összetettebb. Az adatvédelem és az adatbiztonság fokozott figyelmet igényel, mivel az AI-rendszereknek adatokra van szükségük a pontos előrejelzések és döntések meghozatalához. Az AI-rendszereknek meg kell felelniük a következő adatvédelmi törvényeknek:

- Átláthatóságot igényel az adatok gyűjtéséről, használatáról és tárolásáról.

- Kötelezzék a fogyasztókat arra, hogy megfelelő vezérlőkkel rendelkezzenek adataik felhasználásának kiválasztásához.

Adatvédelem és biztonság az Azure Machine Learningben: Az Azure Machine Learning lehetővé teszi a rendszergazdák és fejlesztők számára, hogy biztonságos konfigurációkat hozzanak létre , amelyek megfelelnek a vállalati szabályzatoknak. Az Azure Machine Learning és az Azure platform segítségével a következőket teheti:

- Erőforrásokhoz és műveletekhez való hozzáférés korlátozása felhasználói fiók vagy csoport szerint.

- A bejövő és kimenő hálózati kommunikáció korlátozása.

- Az átvitel alatt lévő és inaktív adatok titkosítása.

- Keresse meg a biztonsági réseket.

- Konfigurációs szabályzatok alkalmazása és naplózása.

A Microsoft két nyílt forráskódú csomagot is létrehozott az adatvédelmi és biztonsági alapelvek implementálásához:

SmartNoise: A differenciált adatvédelem olyan rendszerek és eljárások készlete, amelyek segítenek az egyének adatainak biztonságos és privát állapotban tartásában. A gépi tanulási megoldásokban a jogszabályi megfelelőséghez szükség lehet a differenciált adatvédelemre. A SmartNoise egy nyílt forráskódú projekt (amelyet a Microsoft fejlesztett ki), amely olyan összetevőket tartalmaz, amelyek különböző, globális magánrendszerek létrehozásához szükségesek.

Counterfit: Counterfit egy nyílt forráskódú projekt, amely egy parancssori eszközből és egy általános automatizálási rétegből áll, amely lehetővé teszi a fejlesztők számára, hogy kibertámadásokat szimuláljanak az AI-rendszereken. Az eszközt bárki letöltheti és üzembe helyezheti az Azure Cloud Shellen keresztül, hogy böngészőben fusson, vagy helyileg helyezze üzembe Anaconda Python-környezetben. Felmérheti a különböző felhőkörnyezetekben, a helyszínen vagy a peremhálózaton üzemeltetett AI-modelleket. Az eszköz agnosztikus az AI-modellek számára, és különböző adattípusokat támogat, például szöveget, képeket vagy általános bemeneteket.

Elszámoltathatóság

Az AI-rendszereket tervező és üzembe helyező személyeknek elszámoltathatónak kell lenniük a rendszerek működéséért. A szervezeteknek iparági szabványokat kell használniuk az elszámoltathatósági normák kidolgozásához. Ezek a normák segítenek biztosítani, hogy az AI-rendszerek ne legyenek a végső hatalom az emberek életét érintő döntésekben, és hogy az emberek értelmes ellenőrzést gyakorolhassanak a nagymértékben autonóm rendszerek felett.

Az Azure Machine Learning: Machine Learning-műveletek (MLOps) az AI-munkafolyamat hatékonyságát javító DevOps-alapelveken és gyakorlatokon alapulnak. Az Azure Machine Learning ezeket az MLOps-képességeket biztosítja a jobb elszámoltathatóság érdekében:

- Modellek regisztrálása, csomagolása és üzembe helyezése bárhonnan. A modell használatához szükséges kapcsolódó metaadatokat is nyomon követheti.

- Rögzítse a teljes körű gépi tanulási életciklus szabályozási adatait. A naplózott életútadatok tartalmazhatják a modellek közzétételének, a módosítások okainak, valamint a modellek üzembe helyezésének vagy éles környezetben való felhasználásának a adatait.

- Értesítés és riasztás a gépi tanulási életciklus eseményeiről. Ilyen például a kísérlet befejezése, a modellregisztráció, a modell üzembe helyezése és az adateltolódás észlelése.

- Alkalmazások monitorozása a gépi tanulással kapcsolatos működési problémák és problémák esetén. Hasonlítsa össze a modell bemeneteit a betanítás és a következtetés között, vizsgálja meg a modellspecifikus metrikákat, és biztosítson monitorozást és riasztásokat a gépi tanulási infrastruktúrán.

Emellett az Azure Machine Learning felelős AI scorecardja elszámoltathatóságot hoz létre az érdekelt felek közötti kommunikáció engedélyezésével. A scorecard lehetővé teszi a fejlesztők számára a modellállapot-elemzések konfigurálását, letöltését és megosztását műszaki és nem technikai érdekelt felekkel egyaránt. Ezeknek az elemzéseknek a megosztása segít a bizalom kiépítésében.

Az Azure Machine Learning a döntéshozatalt is támogatja azáltal, hogy tájékoztatja az üzleti döntéseket az alábbiakon keresztül:

- Adatvezérelt elemzések, amelyek segítenek az érdekelt feleknek megérteni az eredményekre gyakorolt ok-okozati kezelési hatásokat, csak az előzményadatok használatával. Például: "Hogyan befolyásolná egy gyógyszer a beteg vérnyomását?" Ezek az elemzések a Felelős AI-irányítópultoksági következtetési összetevőjéből származnak.

- Modellalapú elemzések, amelyek választ adnak a felhasználói kérdésekre (például "Mit tehetek, hogy legközelebb más eredményt kapjak az AI-től?"), hogy meg tudják tenni a szükséges lépéseket. Ezeket az elemzéseket a Felelős AI-irányítópultnem megfelelő mi-ha összetevője biztosítja.

Következő lépések

- A Felelős AI Azure Machine Learningben való implementálásáról további információt a Felelős AI-irányítópulton talál.

- Megtudhatja, hogyan hozhatja létre a Felelős AI-irányítópultot a parancssori felület és az SDK vagy az Azure Machine Learning Studio felhasználói felületén keresztül.

- Megtudhatja, hogyan hozhat létre felelős AI scorecardot a Felelős AI-irányítópulton megfigyelt megállapítások alapján.

- Ismerje meg a felelős AI-szabványt , amely az AI-rendszerek hat fő alapelv szerint történő kiépítéséhez használható.