Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Memori memungkinkan agen AI mengingat informasi dari sebelumnya dalam percakapan atau dari percakapan sebelumnya. Ini memungkinkan agen memberikan respons sadar konteks dan membangun pengalaman yang dipersonalisasi dari waktu ke waktu. Gunakan Databricks Lakebase, database Postgres OLTP yang dikelola sepenuhnya, untuk mengelola status dan riwayat percakapan.

Persyaratan

- Aktifkan Aplikasi Databricks di ruang kerja Anda. Lihat Menyiapkan ruang kerja dan lingkungan pengembangan Databricks Apps Anda.

- Instans Lakebase, lihat Membuat dan mengelola instans database.

Memori jangka pendek vs. jangka panjang

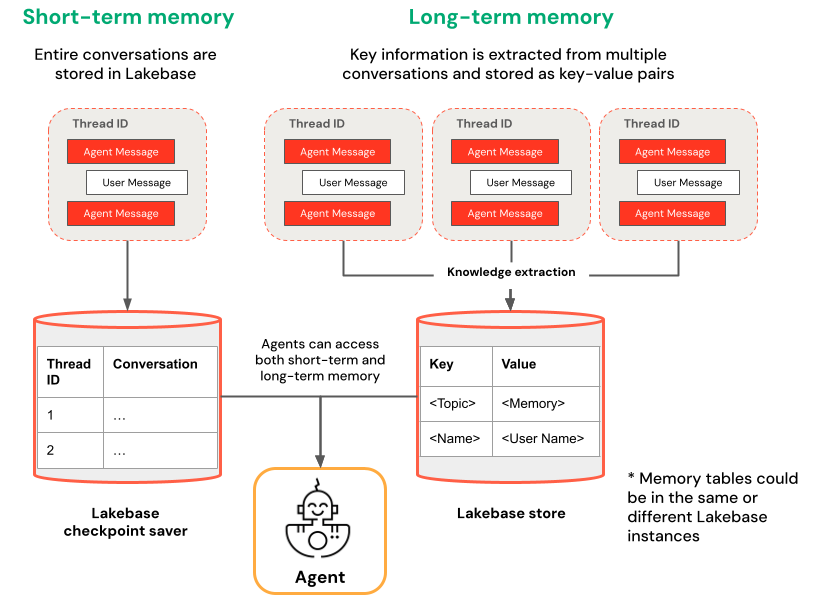

Memori jangka pendek menangkap konteks dalam satu sesi percakapan sementara memori jangka panjang mengekstrak dan menyimpan informasi utama di beberapa percakapan. Anda dapat membangun agen Anda dengan salah satu atau kedua jenis memori.

| Memori jangka pendek | Memori jangka panjang |

|---|---|

| Menangkap konteks dalam satu sesi percakapan menggunakan ID utas dan titik pemeriksaan Mempertahankan konteks untuk pertanyaan tindak lanjut dalam sesi |

Mengekstrak dan menyimpan wawasan utama secara otomatis di beberapa sesi Mempersonalisasi interaksi berdasarkan preferensi sebelumnya Membangun pangkalan pengetahuan tentang pengguna yang meningkatkan respons dari waktu ke waktu |

Get started

Untuk membuat agen dengan memori di Aplikasi Databricks, kloning templat aplikasi bawaan dan ikuti alur kerja pengembangan yang dijelaskan dalam Menulis agen AI dan menyebarkannya di Aplikasi. Templat berikut menunjukkan cara menambahkan memori jangka pendek dan jangka panjang ke agen menggunakan kerangka kerja populer.

LangGraph

Kloning templat agent-langgraph-advanced untuk membangun agen LangGraph dengan memori jangka pendek dan jangka panjang. Templat ini menggunakan checkpointing bawaan LangGraph dengan Lakebase untuk pengelolaan status yang tahan lama, termasuk konteks percakapan berbasis utas dan wawasan pengguna yang persisten di seluruh sesi.

git clone https://github.com/databricks/app-templates.git

cd app-templates/agent-langgraph-advanced

OpenAI Agents SDK

Mengkloning templat agent-openai-advanced untuk membangun agen menggunakan OpenAI Agents SDK dengan memori jangka pendek. Templat ini menggunakan Lakebase untuk manajemen status yang tangguh, memungkinkan percakapan multi-giliran dengan status yang dipertahankan dan manajemen riwayat percakapan otomatis.

git clone https://github.com/databricks/app-templates.git

cd app-templates/agent-openai-advanced

Eksekusi latar belakang untuk agen yang berjalan lama

Aplikasi Databricks memberlakukan batas waktu koneksi HTTP sekitar 300 detik. Eksekusi latar belakang memungkinkan tugas agen yang melebihi batas ini terus berjalan setelah koneksi ditutup; klien mengambil hasil dari titik akhir terpisah atau terhubung kembali untuk melanjutkan streaming.

Templat tingkat lanjut — agent-langgraph-advanced dan agent-openai-advanced - memperluas templat dasar dengan memori jangka pendek dan eksekusi latar belakang yang berjalan lama melalui LongRunningAgentServer dari databricks-ai-bridge, yang menyediakan:

-

Mode latar belakang: Atur

background=truedalam isi permintaan untuk segera mengembalikan ID respons dan menjalankan agen secara asinkron. -

Mengambil titik akhir: Kirim

GET /responses/{id}untuk mengambil hasil akhir, atau untuk membuka koneksi streaming ke eksekusi yang sedang berlangsung. -

Streaming yang dapat diulang: Setiap peristiwa yang dikirim server menyertakan

sequence_number. Jika koneksi terputus, sambungkan kembali denganstarting_after=Nuntuk melanjutkan ke peristiwa berikutnya. - TASK_TIMEOUT_SECONDS Variabel lingkungan yang membatasi durasi tugas latar belakang. Ini terlepas dari batas waktu koneksi HTTP Databricks Apps 120 detik, yang hanya berlaku untuk satu permintaan HTTP. (default: 1 jam)

README templat tingkat lanjut menunjukkan contoh permintaan untuk lima mode klien:

- Pemanggilan: POST standar non-streaming.

- Streaming: POST streaming standar.

-

Latar belakang, lalu polling: POST dengan

background=true, lalu pollingGET /responses/{id}hingga selesai. -

Streaming latar belakang, lanjutkan melalui streaming: POST dengan

background=truedanstream=true; jika koneksi terputus, sambungkan kembali keGET /responses/{id}denganstream=true. -

Streaming latar belakang, lanjutkan melalui polling: Kickoff yang sama; jika koneksi turun, polling

GET /responses/{id}untuk hasil akhir.

Menyebarkan dan menjalankan kueri pada agen Anda

Setelah mengonfigurasi agen dengan memori, ikuti langkah-langkah dalam Menulis agen AI dan menyebarkannya di Aplikasi untuk menjalankan agen Anda secara lokal, mengevaluasinya, dan menyebarkannya ke Aplikasi Databricks.