Apa itu Azure Content Moderator?

Penting

Azure Content Moderator tidak digunakan lagi pada Februari 2024 dan akan dihentikan pada Februari 2027. Ini digantikan oleh Azure AI Content Safety, yang menawarkan fitur AI tingkat lanjut dan performa yang ditingkatkan.

Azure AI Content Safety adalah solusi komprehensif yang dirancang untuk mendeteksi konten yang dihasilkan pengguna dan buatan AI yang berbahaya dalam aplikasi dan layanan. Azure AI Content Safety cocok untuk banyak skenario seperti marketplace online, perusahaan game, platform pesan sosial, perusahaan media perusahaan, dan penyedia solusi pendidikan K-12. Berikut adalah gambaran umum fitur dan kemampuannya:

- API Deteksi Teks dan Gambar: Memindai teks dan gambar untuk konten seksual, kekerasan, kebencian, dan membahayakan diri sendiri dengan beberapa tingkat keparahan.

- Content Safety Studio: Alat online yang dirancang untuk menangani konten yang berpotensi menyinggung, berisiko, atau tidak diinginkan menggunakan model ML kon mode tenda rasi terbaru kami. Ini menyediakan templat dan alur kerja yang disesuaikan yang memungkinkan pengguna untuk membangun sistem con mode tenda ration mereka sendiri.

- Dukungan bahasa: Azure AI Content Safety mendukung lebih dari 100 bahasa dan secara khusus dilatih dalam bahasa Inggris, Jerman, Jepang, Spanyol, Prancis, Italia, Portugis, dan Cina.

Azure AI Content Safety menyediakan solusi yang kuat dan fleksibel untuk kebutuhan kon mode tenda rasi Anda. Dengan beralih dari Content Moderator ke Azure AI Content Safety, Anda dapat memanfaatkan alat dan teknologi terbaru untuk memastikan bahwa konten Anda selalu dimoderasi sesuai spesifikasi Anda.

Pelajari selengkapnya tentang Keamanan Konten Azure AI dan jelajahi cara meningkatkan strategi kon mode tenda rasi Anda.

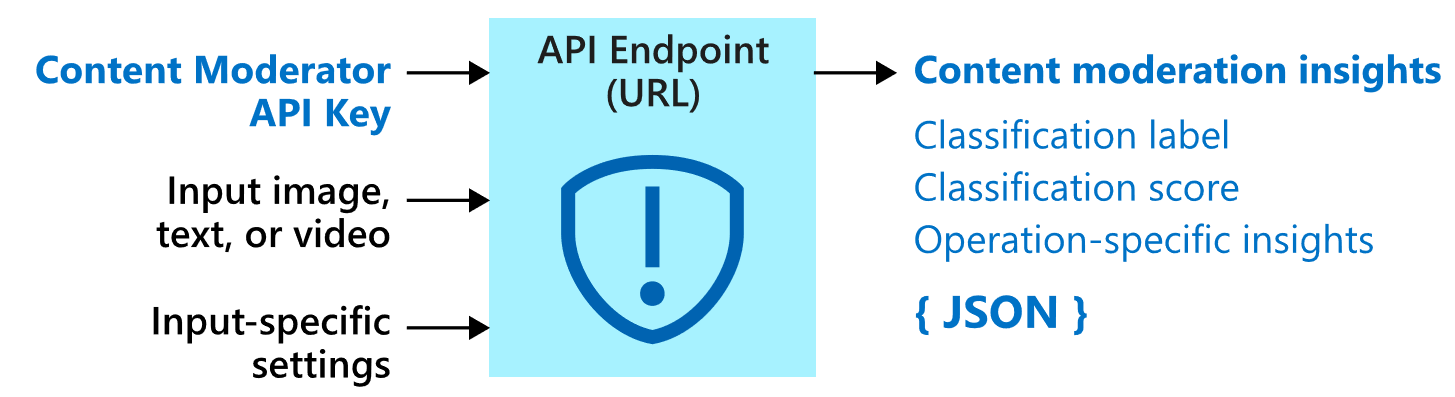

Azure Content Moderator adalah layanan AI yang memungkinkan Anda menangani konten yang berpotensi menyinggung, berisiko, atau tidak diinginkan. Ini termasuk layanan moderasi konten bertenaga AI yang memindai teks, gambar, dan video serta memberi konten bendera secara otomatis.

Anda mungkin ingin membangun perangkat lunak pemfilteran konten dalam aplikasi Anda untuk mematuhi peraturan atau mempertahankan lingkungan yang diinginkan untuk pengguna Anda.

Dokumentasi ini berisi jenis artikel berikut:

- Mulai cepat adalah instruksi awal untuk memandu Anda dalam membuat permintaan ke layanan.

- Panduan berisi instruksi untuk menggunakan layanan dengan cara yang lebih spesifik atau disesuaikan.

- Konsep memberikan penjelasan mendalam tentang fungsionalitas dan fitur layanan.

Untuk pendekatan yang lebih terstruktur, ikuti modul Pelatihan untuk Content Moderator.

Tempat penggunaan

Berikut ini adalah beberapa skenario di mana pengembang atau tim perangkat lunak memerlukan layanan moderasi konten:

- Pasar online yang memoderasi katalog produk dan konten buatan pengguna lainnya.

- Perusahaan game yang memoderasi artefak game buatan pengguna dan ruang obrolan.

- Platform pesan sosial yang memoderasi gambar, teks, dan video yang ditambahkan oleh penggunanya.

- Perusahaan media enterprise yang mengimplementasikan moderasi terpusat untuk konten mereka.

- Penyedia solusi pendidikan K-12 yang memfilter konten yang tidak sesuai untuk siswa dan pendidik.

Penting

Anda tidak dapat menggunakan Content Moderator untuk mendeteksi gambar eksploitasi anak yang ilegal. Namun, organisasi yang memenuhi syarat dapat menggunakan Layanan Cloud PhotoDNA untuk menyaring jenis konten ini.

Apa yang termasuk

Layanan Content Moderator terdiri dari beberapa API layanan web yang tersedia melalui panggilan REST dan .NET SDK.

API Moderasi

Layanan Content Moderator mencakup API Moderasi, yang memeriksa konten untuk materi yang berpotensi tidak pantas atau tidak menyenangkan.

Tabel berikut ini menjelaskan berbagai jenis API moderasi.

| Grup API | Deskripsi |

|---|---|

| Moderasi teks | Memindai teks untuk konten yang menyinggung, konten seksual eksplisit atau sugestif, kata-kata kotor, dan data pribadi. |

| Daftar istilah kustom | Memindai teks menggunakan daftar istilah kustom serta dengan istilah bawaan. Gunakan daftar kustom untuk memblokir atau mengizinkan konten sesuai dengan kebijakan konten Anda sendiri. |

| Moderasi gambar | Memindai gambar untuk konten dewasa atau cabul, mendeteksi teks dalam gambar dengan kemampuan Pengenalan Karakter Optik (OCR), dan mendeteksi wajah. |

| Daftar gambar kustom | Memindai gambar menggunakan daftar gambar kustom. Gunakan daftar gambar kustom untuk memfilter instans konten berulang yang umumnya tidak ingin Anda klasifikasi lagi. |

| Moderasi video | Memindai video untuk konten dewasa atau cabul dan mengembalikan penanda waktu untuk konten tersebut. |

Privasi dan keamanan data

Seperti semua layanan Azure AI, pengembang yang menggunakan layanan Content Moderator harus mengetahui kebijakan Microsoft tentang data pelanggan. Lihat halaman layanan Azure AI di Pusat Kepercayaan Microsoft untuk mempelajari selengkapnya.

Langkah berikutnya

- Selesaikan pustaka klien atau mulai cepat REST API untuk menerapkan skenario dasar dalam kode.