Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Petunjuk

Data Factory di Microsoft Fabric adalah generasi Azure Data Factory berikutnya, dengan arsitektur yang lebih sederhana, AI bawaan, dan fitur baru. Jika Anda baru menggunakan integrasi data, mulailah dengan Fabric Data Factory. Beban kerja ADF yang ada dapat ditingkatkan ke Fabric untuk mengakses kemampuan baru di seluruh ilmu data, analitik real time, dan pelaporan.

Aktivitas Jar Azure Databricks dalam pipeline menjalankan Spark Jar di kluster Azure Databricks Anda. Artikel ini membangun artikel aktivitas transformasi data, yang menyajikan gambaran umum tentang transformasi data dan aktivitas transformasi yang didukung. Azure Databricks adalah platform terkelola untuk menjalankan Apache Spark.

Untuk pengenalan dan demonstrasi sebelas menit dari fitur ini, tonton video berikut:

Menambahkan aktivitas Jar untuk Azure Databricks ke alur dengan UI

Untuk menggunakan aktivitas Jar untuk Azure Databricks dalam alur, selesaikan langkah-langkah berikut:

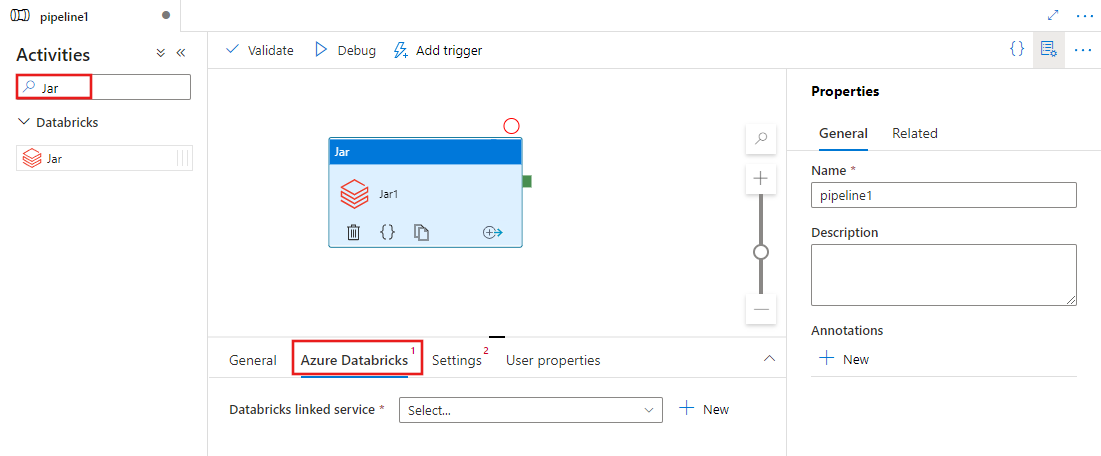

Cari Jar di panel Aktivitas Pipeline, dan seret aktivitas Jar ke kanvas pipeline.

Pilih aktivitas Jar baru di kanvas jika belum dipilih.

Pilih tab Azure Databricks untuk memilih atau membuat layanan tertaut Azure Databricks baru yang akan menjalankan aktivitas Jar.

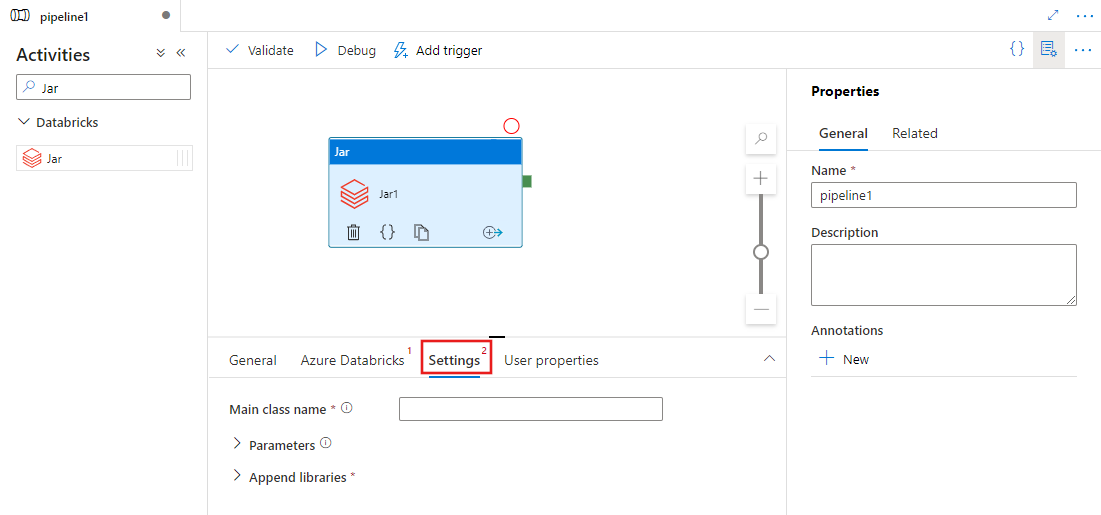

Pilih tab Settings dan tentukan nama kelas yang akan dijalankan pada Azure Databricks, parameter opsional untuk diteruskan ke Jar, dan pustaka yang akan diinstal pada kluster untuk menjalankan pekerjaan.

Definisi aktivitas Databricks Jar

Berikut contoh definisi JSON dari Aktivitas Jar Databricks:

{

"name": "SparkJarActivity",

"type": "DatabricksSparkJar",

"linkedServiceName": {

"referenceName": "AzureDatabricks",

"type": "LinkedServiceReference"

},

"typeProperties": {

"mainClassName": "org.apache.spark.examples.SparkPi",

"parameters": [ "10" ],

"libraries": [

{

"jar": "dbfs:/docs/sparkpi.jar"

}

]

}

}

Sifat aktivitas Databricks Jar

Tabel berikut menjelaskan properti JSON yang digunakan dalam definisi JSON:

| Properti | Deskripsi | Wajib |

|---|---|---|

| nama | Nama aktivitas dalam pipeline. | Ya |

| deskripsi | Teks yang menjelaskan apa yang dilakukan aktivitas. | Tidak |

| jenis | Untuk Databricks Jar Activity, jenis aktivitasnya adalah DatabricksSparkJar. | Ya |

| NamaLayananTertaut | Nama Layanan Tertaut Databricks tempat aktivitas Jar berjalan. Untuk mempelajari layanan tertaut ini, lihat artikel Layanan tertaut komputasi. | Ya |

| mainClassName | Nama lengkap kelas yang berisi metode utama yang akan dijalankan. Kelas ini harus terkandung dalam JAR yang disediakan sebagai pustaka. File JAR dapat berisi beberapa kelas. Masing-masing kelas dapat berisi metode utama. | Ya |

| parameter | Parameter yang akan diteruskan ke metode utama. Properti ini adalah array string. | Tidak |

| pustaka | Daftar perpustakaan yang akan diinstal di kluster untuk menjalankan pekerjaan. Daftar ini dapat berupa array <string, objek> | Ya (setidaknya satu berisi metode mainClassName) |

Catatan

Masalah Yang Diketahui - Ketika menggunakan Kluster interaktif yang sama untuk menjalankan aktivitas Databricks Jar bersamaan (tanpa menghidupkan ulang kluster), ada masalah yang diketahui dalam Databricks tempat parameter aktivitas pertama akan digunakan dengan mengikuti kegiatan juga. Oleh karena itu mengakibatkan parameter yang salah diteruskan ke pekerjaan berikutnya. Untuk mengurangi hal ini, gunakan kluster pekerjaan sebagai pengganti.

Pustaka yang didukung untuk aktivitas Databricks

Dalam definisi aktivitas Databricks sebelumnya, Anda menentukan jenis pustaka ini: jar, egg, maven, pypi, cran.

{

"libraries": [

{

"jar": "dbfs:/mnt/libraries/library.jar"

},

{

"egg": "dbfs:/mnt/libraries/library.egg"

},

{

"maven": {

"coordinates": "org.jsoup:jsoup:1.7.2",

"exclusions": [ "slf4j:slf4j" ]

}

},

{

"pypi": {

"package": "simplejson",

"repo": "http://my-pypi-mirror.com"

}

},

{

"cran": {

"package": "ada",

"repo": "https://cran.us.r-project.org"

}

}

]

}

Untuk informasi selengkapnya, lihat Dokumentasi Databricks untuk mengetahui jenis pustaka.

Cara mengunggah pustaka di Databricks

Anda dapat menggunakan antarmuka pengguna Ruang Kerja:

Untuk mendapatkan jalur DBFS dari pustaka yang ditambahkan menggunakan UI, Anda dapat menggunakan Databricks CLI.

Biasanya, pustaka Jar disimpan di bawah dbfs:/FileStore/jars saat menggunakan antarmuka pengguna. Anda dapat mencantumkan semuanya melalui CLI: databricks fs ls dbfs:/FileStore/job-jars

Atau, Anda dapat menggunakan Databricks CLI:

Menggunakan Databricks CLI (langkah penginstalan)

Sebagai contoh, untuk menyalin JAR ke dbfs:

dbfs cp SparkPi-assembly-0.1.jar dbfs:/docs/sparkpi.jar

Konten terkait

Untuk pengenalan dan demonstrasi sebelas menit fitur ini, tonton video.