Gambaran HBv3-series virtual machine

Berlaku untuk: ✔️ Mesin virtual Linux ✔️ Mesin virtual Windows ✔️ Set skala fleksibel ✔️ Set skala seragam

Server HBv3-series memiliki 2 * CPU EPYC 7V73X 64-core dengan total 128 core "Zen3" fisik dengan AMD 3D V-Cache. Simultaneous Multithreading (SMT) dinonaktifkan pada HBv3. 128 core ini dibagi menjadi 16 bagian (8 per soket), setiap bagian berisi 8 core prosesor dengan akses seragam ke cache L3 96 MB. Server Azure HBv3 juga menjalankan pengaturan AMD BIOS berikut:

Nodes per Socket (NPS) = 2

L3 as NUMA = Disabled

NUMA domains within VM OS = 4

C-states = Enabled

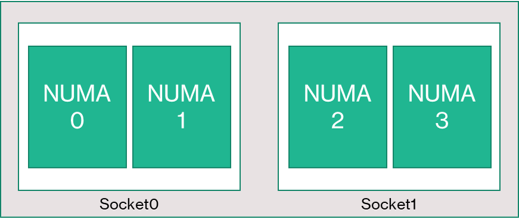

Akibatnya, server melakukan booting dengan 4 domain NUMA (2 per soket). Setiap domain berukuran 32 inti. Setiap NUMA memiliki akses langsung ke 4 saluran DRAM fisik yang beroperasi pada 3.200 MT/dtk.

Untuk menyediakan ruang bagi Azure hypervisor untuk beroperasi tanpa mengganggu VM, kami mencadangkan 8 core fisik per server.

topologi VM

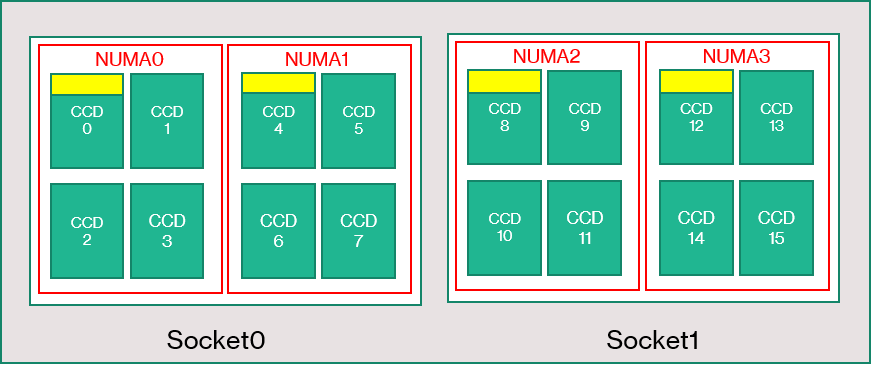

Diagram berikut menunjukkan topologi server. Kami mencadangkan 8 core host hypervisor (kuning) ini secara simetris di kedua soket CPU, mengambil 2 core pertama dari Core Complex Dies (CCD) tertentu pada setiap domain NUMA, dengan inti yang tersisa untuk HBv3-series VM (hijau).

Batas CCD tidak setara dengan batas NUMA. Pada HBv3, sekelompok empat CCD berturut-turut (4) dikonfigurasi sebagai domain NUMA, baik di tingkat server host maupun dalam VM tamu. Dengan demikian, semua ukuran VM HBv3 mengekspos 4 domain NUMA yang muncul ke OS dan aplikasi seperti yang ditunjukkan. 4 domain NUMA yang seragam, masing-masing dengan jumlah core yang berbeda tergantung pada ukuran VM HBv3 tertentu.

Setiap ukuran HBv3 VM serupa dalam tata letak fisik, fitur, dan kinerja CPU yang berbeda dari seri AMD EPYC 7003, sebagai berikut:

| Ukuran HBv3-series VM | Domain NUMA | Core per domain NUMA | Kemiripan dengan AMD EPYC |

|---|---|---|---|

| Standard_HB120rs_v3 | 4 | 30 | Soket ganda EPYC 7773X |

| Standard_HB120-96rs_v3 | 4 | 24 | Soket ganda EPYC 7643 |

| Standard_HB120-64rs_v3 | 4 | 16 | Soket ganda EPYC 7573X |

| Standard_HB120-32rs_v3 | 4 | 8 | Soket ganda EPYC 7373X |

| Standard_HB120-16rs_v3 | 4 | 4 | Soket ganda EPYC 72F3 |

Catatan

Ukuran core VM yang dibatasi hanya mengurangi jumlah core fisik yang diekspos ke VM. Semua aset global bersama (RAM, bandwidth memori, cache L3, konektivitas GMI dan xGMI, InfiniBand, jaringan Ethernet Azure, SSD lokal) tetap konstan. Hal ini memungkinkan pelanggan untuk memilih ukuran VM yang paling sesuai dengan serangkaian beban kerja atau kebutuhan lisensi perangkat lunak tertentu.

Pemetaan virtual NUMA dari setiap ukuran HBv3 VM dipetakan ke topologi fisik NUMA yang mendasarinya. Tidak ada abstraksi yang berpotensi menyesatkan dari topologi perangkat keras.

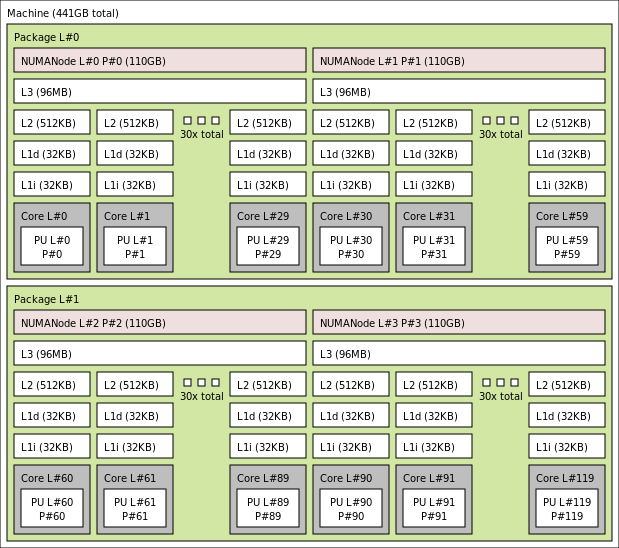

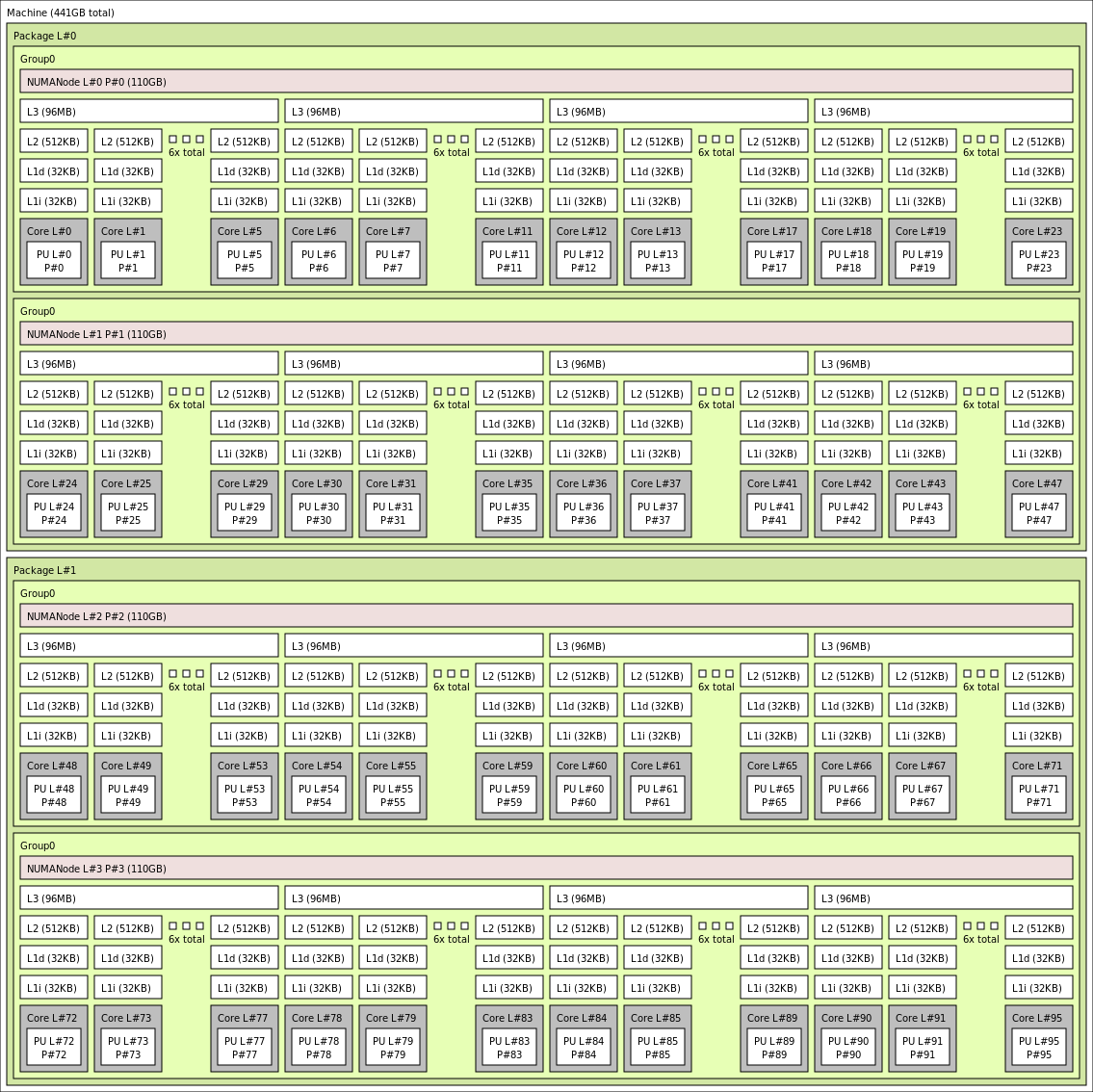

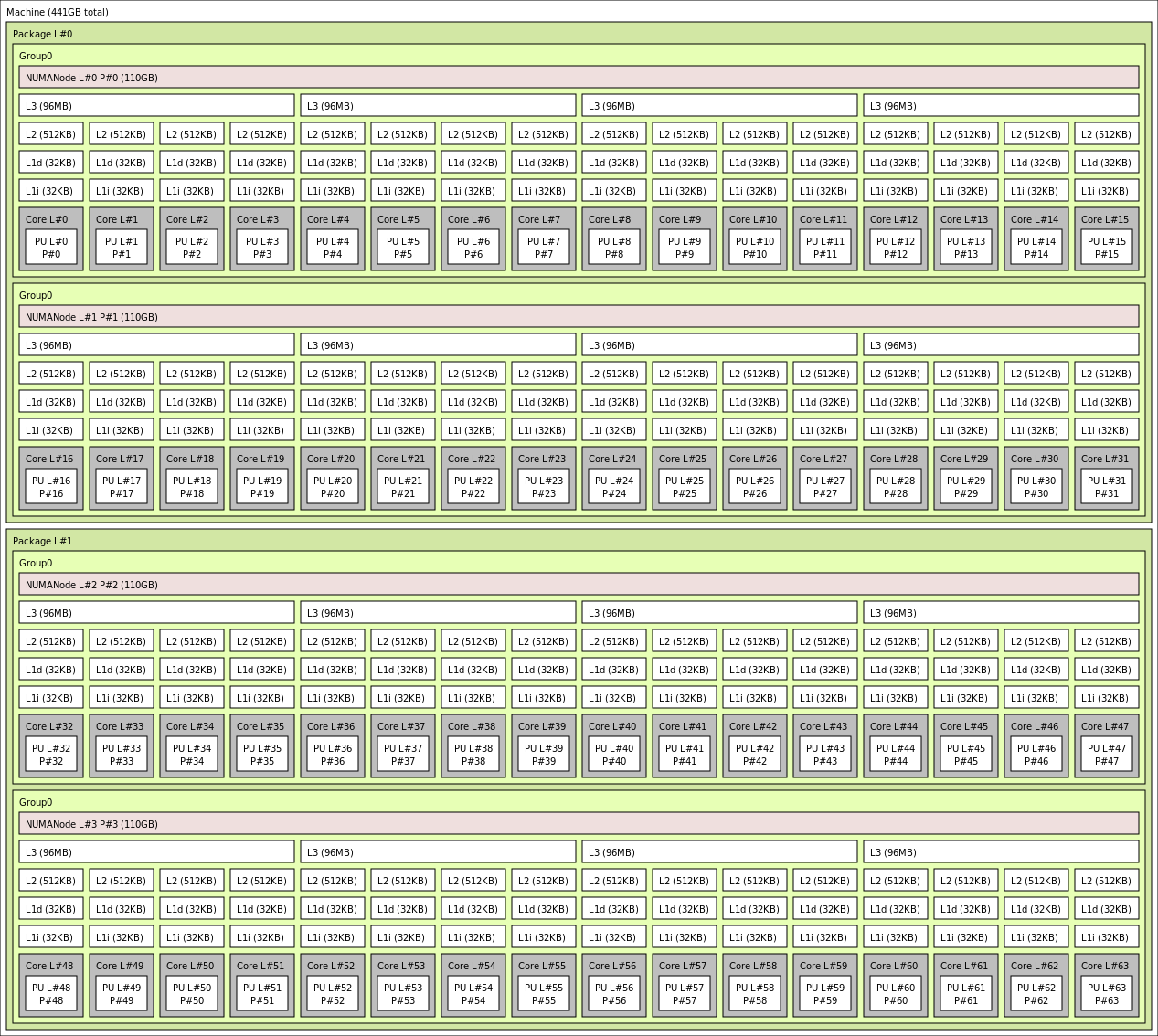

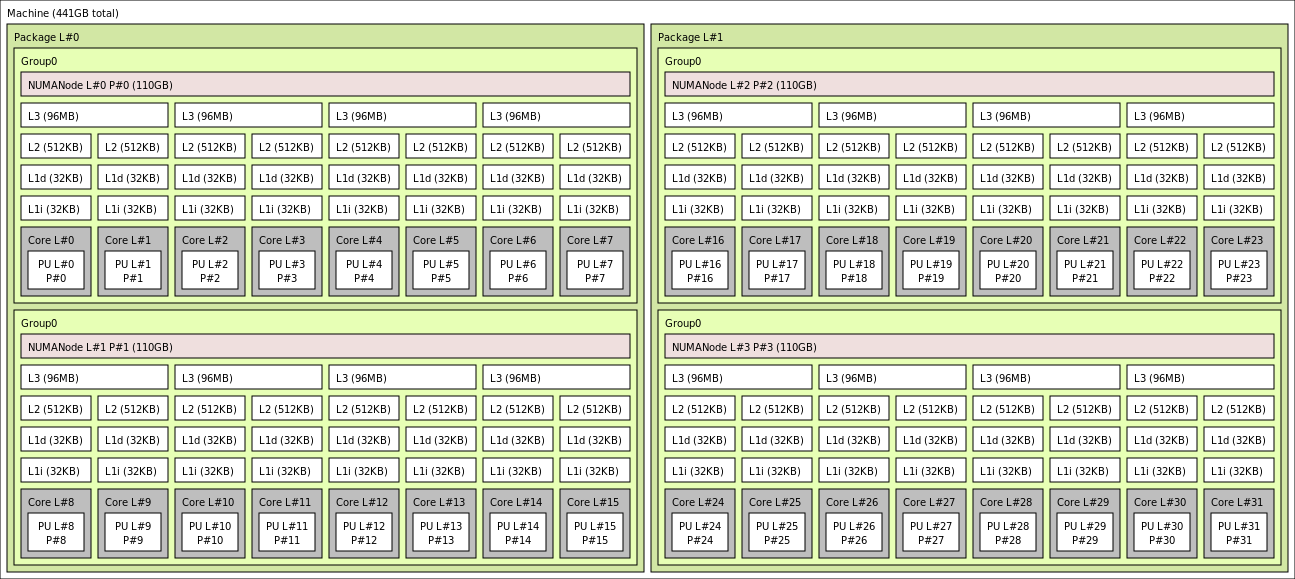

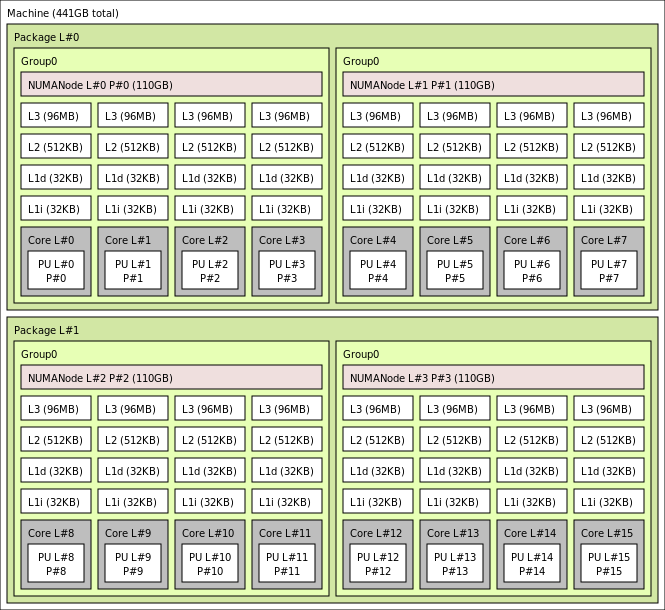

Topologi yang tepat untuk berbagai ukuranHBv3 VMyang menggunakan output lstopomuncul sebagai berikut:

lstopo-no-graphics --no-io --no-legend --of txt

Klik untuk melihat output lstopo untuk Standard_HB120rs_v3

Klik guna melihat output lstopo untuk Standard_HB120rs-96_v3

Klik guna melihat output lstopo untuk Standard_HB120rs-64_v3

Klik untuk melihat keluaran lstopo untuk Standard_HB120rs-32_v3

Klik guna melihat output lstopo untuk Standard_HB120rs-16_v3

Jaringan InfiniBand

HBv3 VM juga dilengkapi adapter jaringan Nvidia Mellanox HDR InfiniBand (ConnectX-6) yang beroperasi hingga 200 Gigabit/dtk. NIC diteruskan ke VM melalui SRIOV, memungkinkan lalu lintas jaringan untuk melewati hypervisor. Akibatnya, pelanggan memuat driver Mellanox OFED standar pada HBv3 VMs seperti halnya kondisi bare metal.

VM HBv3 mendukung Perutean Adaptif, Dynamic Connected Transport (DCT, bersama dengan transportasi RC dan UD standar), dan offload kolektif MPI berbasis perangkat keras ke prosesor onboard adaptor ConnectX-6. Fitur-fitur ini meningkatkan performa aplikasi, skalabilitas, dan konsistensi, dan penggunaannya direkomendasikan.

Penyimpanan Sementara

HBv3 VM menampilkan 3 perangkat SSD lokal secara fisik. Satu perangkat telah diformat sebelumnya untuk berfungsi sebagai file halaman dan muncul dalam VM Anda sebagai perangkat "SSD" generik.

Dua SSD lain yang lebih besar disediakan sebagai perangkat NVMe blok yang tidak diformat melalui NVMeDirect. Karena perangkat NVMe blok melewati hypervisor, perangkat ini memiliki bandwidth yang lebih tinggi, IOPS yang lebih tinggi, dan latensi yang lebih rendah per IOP.

Saat dipasangkan dalam striped array, NVMe SSD menyediakan hingga 7 GB/s baca dan 3 GB/s tulis, dan hingga 186.000 IOPS (baca) dan 201.000 IOPS (tulis) untuk kedalaman antrian yang dalam.

Spesifikasi perangkat keras

| Spesifikasi perangkat keras | HBv3-series VMs |

|---|---|

| Core | 120, 96, 64, 32, atau 16 (SMT dinonaktifkan) |

| CPU | AMD EPYC 7V73X |

| Frekuensi CPU (non-AVX) | 3.0 GHz (semua core), 3.5 GHz (hingga 10 core) |

| Memori | 448 GB (RAM per core tergantung pada ukuran VM) |

| Disk Lokal | 2 * 960 GB NVMe (block), 480 GB SSD (page file) |

| Infiniband | 200 Gb/s Mellanox ConnectX-6 HDR InfiniBand |

| Jaringan | Ethernet 50 Gb/dtk (dapat digunakan 40 Gb/dtk) SmartNIC Gen kedua Azure |

Spesifikasi perangkat lunak

| Spesifikasi perangkat lunak | HBv3-series VMs |

|---|---|

| Ukuran Max Pekerjaan MPI | 36.000 core (300 VM dalam satu Virtual Machine Scale Set dengan singlePlacementGroup=true) |

| Dukungan MPI | HPC-X, Intel MPI, OpenMPI, MVAPICH2, MPICH |

| Kerangka Kerja Tambahan | UCX, libfabric, PGAS |

| Dukungan Microsoft Azure Storage | Disk Standar dan Premium (maksimal 32 disk) |

| Dukungan OS untuk SRIOV RDMA | RHEL 7.9+, Ubuntu 18.04+, SLES 15.4, WinServer 2016+ |

| OS direkomendasikan untuk Performa | Windows Server 2019+ |

| Dukungan Orchestrator | Azure CycleCloud, Azure Batch, AKS; opsi cluster configuration |

Catatan

Windows Server 2012 R2 tidak didukung pada HBv3 dan VM lain dengan lebih dari 64 inti (virtual atau fisik). Untuk detail selengkapnya, lihat Sistem operasi tamu Windows yang didukung untuk Hyper-V di Windows Server.

Penting

Dokumen ini mereferensikan versi rilis Linux yang mendekati atau di, End of Life(EOL). Harap pertimbangkan untuk memperbarui ke versi yang lebih baru.

Langkah berikutnya

- Membaca tentang pengumuman terbaru, contoh beban kerja HPC, dan hasil performa di Blog Komunitas Teknologi Azure Compute.

- Untuk tampilan arsitektur tingkat yang lebih tinggi dari beban kerja HPC yang berjalan, lihat Komputasi Kinerja Tinggi (HPC) pada Azure.