Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Titik akhir analitik SQL memberikan antarmuka kueri T-SQL hanya-baca atas tabel Delta di lakehouse Anda. Setiap lakehouse yang dibuat menyediakan titik akhir analitik SQL secara otomatis — tidak ada hal tambahan yang perlu disiapkan. Di balik layar, titik akhir analitik SQL berjalan pada mesin yang sama dengan Fabric Data Warehouse, sehingga Anda mendapatkan kueri SQL berkinerja tinggi dan latensi rendah tanpa mengelola infrastruktur.

Titik akhir analitik SQL tidak unik untuk lakehouse. Item Fabric lainnya — termasuk gudang data, database mirror, database SQL, dan Azure Cosmos DB — juga secara otomatis menyediakan titik akhir analitik SQL. Pengalaman dan batasannya sama di semuanya.

Apa yang dapat Anda lakukan

Titik akhir analitik SQL beroperasi dalam mode baca-saja melalui tabel Delta — Anda tidak dapat menyisipkan, memperbarui, atau menghapus data melaluinya. Untuk memodifikasi data, beralihlah ke lakehouse dan gunakan Apache Spark.

Dalam batas baca-saja tersebut, Anda dapat:

- Kueri Tabel Delta dengan T-SQL — Jalankan pernyataan SELECT terhadap tabel Delta apa pun di lakehouse Anda, termasuk tabel yang diekspos melalui shortcuts ke Azure Data Lake Storage eksternal atau Amazon S3.

- Buat tampilan, fungsi, dan prosedur tersimpan — Merangkum logika bisnis dan pola kueri yang dapat digunakan kembali di objek T-SQL yang bertahan di titik akhir analitik SQL.

- Terapkan keamanan tingkat baris dan tingkat objek — Gunakan izin terperinci SQL untuk mengontrol pengguna mana yang dapat melihat tabel, kolom, atau baris mana.

- Buat laporan Power BI — Model semantik Power BI dapat tersambung ke titik akhir analitik SQL melalui titik akhir Aliran Data Tabular (TDS), sehingga Anda dapat membuat laporan melalui data lakehouse Anda.

- Kueri di seluruh ruang kerja — Gunakan pintasan OneLake untuk mereferensikan tabel Delta di lakehouse atau gudang lain, lalu gabungkan dalam satu kueri. Untuk skenario lintas ruang kerja lainnya, lihat Bersama-sama lebih baik: lakehouse dan gudang.

Nota

Tabel Delta eksternal yang dibuat dengan kode Spark tidak terlihat oleh titik akhir analitik SQL. Gunakan pintasan di bagian Tabel untuk membuat tabel Delta eksternal terlihat. Untuk mempelajari caranya, lihat Membuat pintasan.

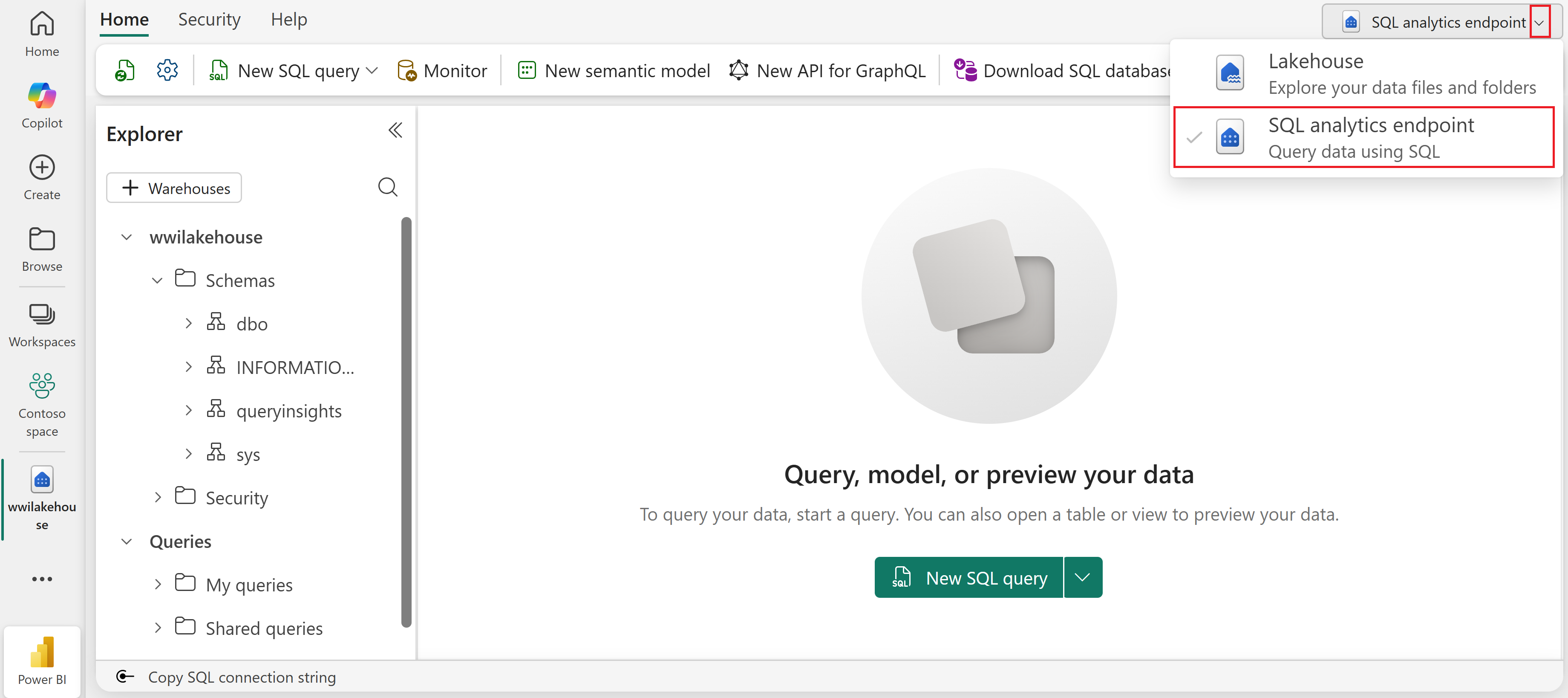

Akses titik akhir analitik SQL

Anda dapat membuka titik akhir analitik SQL dengan dua cara:

- Dari ruang kerja — Di daftar item ruang kerja Anda, temukan item endpoint analitik SQL (yang memiliki nama yang sama dengan lakehouse Anda) dan pilih.

- Dari penjelajah Lakehouse — Di area kanan atas toolbar, gunakan menu dropdown untuk beralih ke tampilan endpoint analitik SQL.

Bagaimanapun, query editor terbuka di mana Anda dapat menulis dan menjalankan kueri T-SQL terhadap tabel Delta Anda.

Keamanan

Aturan keamanan SQL yang ditetapkan pada titik akhir analitik SQL hanya berlaku saat data diakses melalui titik akhir. Mereka tidak berlaku saat data yang sama diakses melalui Spark atau alat lainnya.

Untuk mengamankan data Anda:

- Atur izin terperinci SQL pada titik akhir analitik SQL untuk mengontrol access ke tabel, kolom, atau baris tertentu.

- Atur peran dan izin workspace untuk mengontrol siapa yang dapat mengakses lakehouse dan datanya melalui jalur lain.

Untuk informasi selengkapnya tentang model keamanan, lihat Keamanan OneLake untuk titik akhir analitik SQL.

Sinkronisasi metadata otomatis

Saat Anda membuat atau memperbarui tabel Delta di lakehouse Anda, titik akhir analitik SQL secara otomatis mendeteksi perubahan dan memperbarui metadata SQL-nya — definisi tabel, jenis kolom, dan statistik. Tidak ada langkah impor dan tidak diperlukan sinkronisasi manual.

Proses latar belakang ini membaca log Delta dari /Tables folder di OneLake dan menjaga skema SQL tetap terbarui. Untuk detail tentang cara kerja sinkronisasi ini dan faktor-faktor yang memengaruhi latensi sinkronisasi, lihat Pertimbangan performa titik akhir analitik SQL.

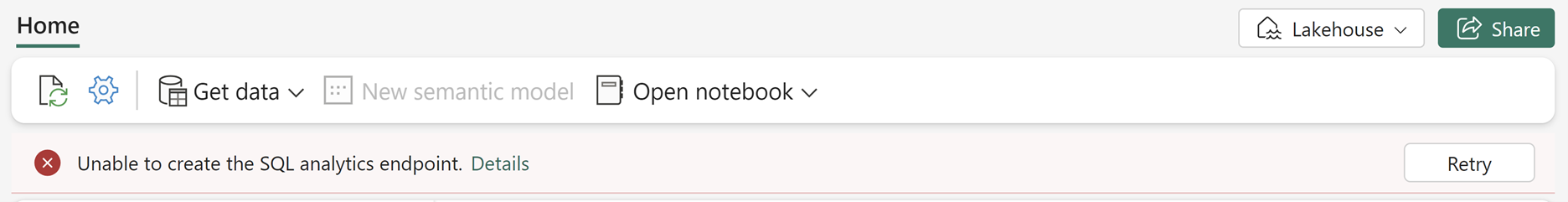

Penyediaan ulang

Jika titik akhir analitik SQL gagal memprovisikan saat membuat lakehouse, Anda dapat mencoba kembali langsung dari halaman beranda Lakehouse tanpa membuat ulang lakehouse.

Nota

Provisi ulang masih dapat gagal, sama seperti provisi awal. Jika upaya berulang gagal, hubungi dukungan.

Keterbatasan

Titik akhir analitik SQL berbagi mesinnya dengan Fabric Data Warehouse, dan mereka memiliki batasan yang sama. Untuk daftar lengkapnya, lihat Batasan titik akhir analitik SQL.