Cara menggunakan Data Wrangler pada Spark DataFrames (Pratinjau)

Data Wrangler, alat berbasis notebook untuk analisis data eksploratif, sekarang mendukung Spark DataFrames dan pandas DataFrames, menghasilkan kode PySpark selain kode Python. Untuk gambaran umum Data Wrangler, yang mencakup cara menjelajahi dan mengubah Pandas DataFrames, lihat tutorial utama. Tutorial berikut menunjukkan cara menggunakan Data Wrangler untuk menjelajahi dan mengubah Spark DataFrames.

Penting

Fitur ini dalam pratinjau.

Prasyarat

Dapatkan langganan Microsoft Fabric. Atau, daftar untuk uji coba Microsoft Fabric gratis.

Masuk ke Microsoft Fabric.

Gunakan pengalih pengalaman di sisi kiri halaman beranda Anda untuk beralih ke pengalaman Ilmu Data Synapse.

Meluncurkan Data Wrangler dengan Spark DataFrame

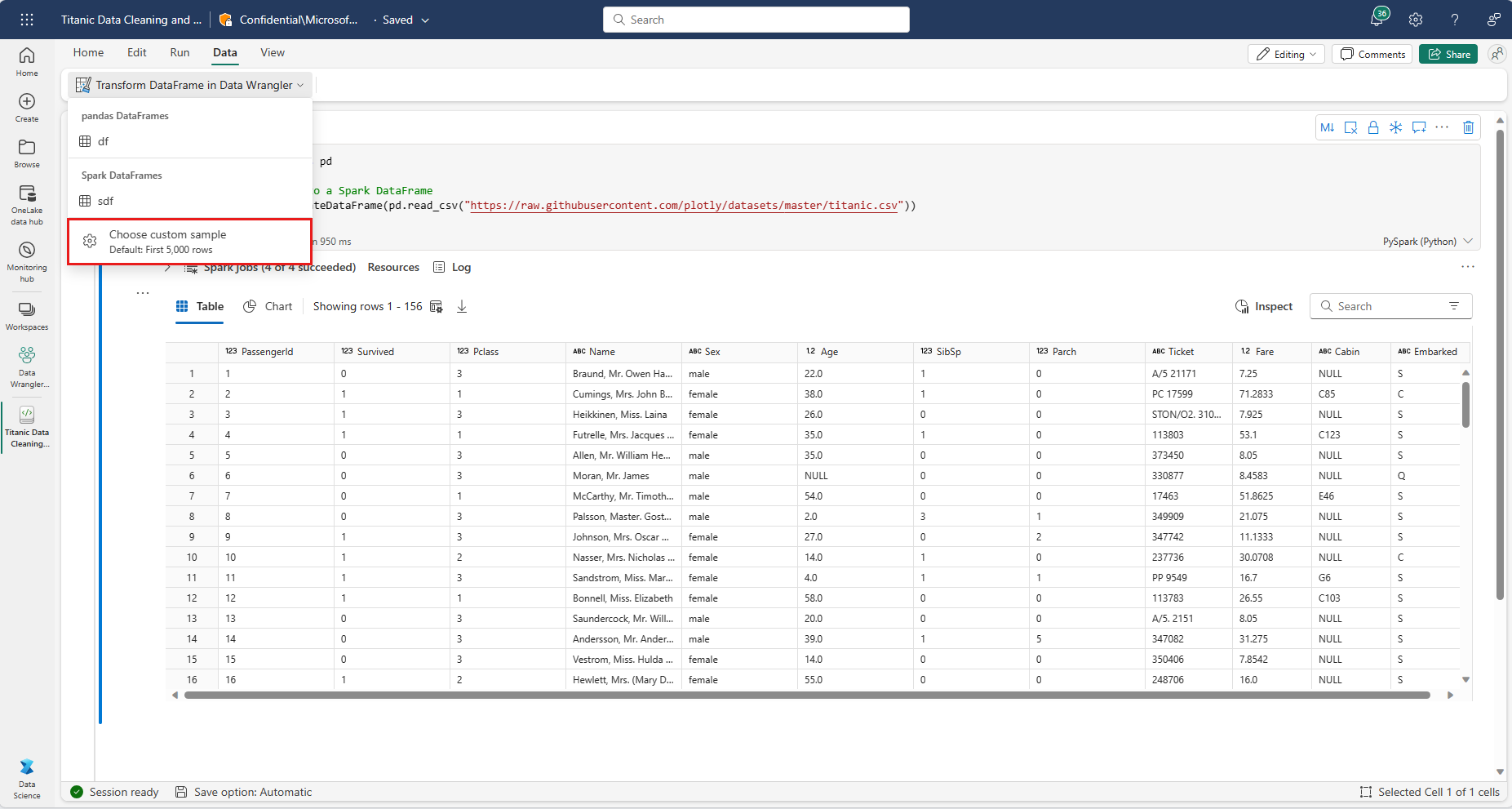

Pengguna dapat membuka Spark DataFrames di Data Wrangler langsung dari notebook Microsoft Fabric, dengan menavigasi ke perintah dropdown yang sama tempat Pandas DataFrames ditampilkan. Daftar Spark DataFrames aktif muncul di menu dropdown di bawah daftar variabel panda aktif.

Cuplikan kode berikutnya membuat Spark DataFrame dengan data sampel yang sama yang digunakan dalam tutorial pandas Data Wrangler:

import pandas as pd

# Read a CSV into a Spark DataFrame

df = spark.createDataFrame(pd.read_csv("https://raw.githubusercontent.com/plotly/datasets/master/titanic.csv"))

display(df)

Di bawah tab "Data" pita buku catatan, gunakan perintah dropdown Wrangler Data untuk menelusuri DataFrame aktif yang tersedia untuk pengeditan. Pilih yang ingin Anda buka di Data Wrangler.

Tip

Wrangler Data tidak dapat dibuka saat kernel notebook sibuk. Sel yang dieksekusi harus menyelesaikan eksekusinya sebelum Data Wrangler dapat diluncurkan.

Memilih sampel kustom

Data Wrangler secara otomatis mengonversi Spark DataFrames ke sampel panda karena alasan performa. Namun, semua kode yang dihasilkan oleh alat pada akhirnya diterjemahkan ke PySpark ketika diekspor kembali ke notebook. Seperti halnya panda DataFrame apa pun, Anda dapat menyesuaikan sampel default dengan memilih "Pilih sampel kustom" dari menu dropdown Data Wrangler. Melakukannya meluncurkan pop-up dengan opsi untuk menentukan ukuran sampel yang diinginkan (jumlah baris) dan metode pengambilan sampel (rekaman pertama, rekaman terakhir, atau set acak).

Menampilkan statistik ringkasan

Ketika Data Wrangler dimuat, spanduk informasi di atas kisi pratinjau mengingatkan Anda bahwa Spark DataFrames untuk sementara dikonversi ke sampel panda, tetapi semua kode yang dihasilkan pada akhirnya dikonversi ke PySpark. Menggunakan Data Wrangler pada Spark DataFrames sebaliknya tidak berbeda dengan menggunakannya pada Pandas DataFrames. Gambaran umum deskriptif di panel Ringkasan menampilkan informasi tentang dimensi sampel, nilai yang hilang, dan banyak lagi. Memilih kolom apa pun di kisi Data Wrangler meminta panel Ringkasan untuk memperbarui dan menampilkan statistik deskriptif tentang kolom tertentu tersebut. Wawasan cepat tentang setiap kolom juga tersedia di header-nya.

Tip

Statistik dan visual khusus kolom (baik di panel Ringkasan maupun di header kolom) bergantung pada jenis data kolom. Misalnya, histogram terikat kolom numerik akan muncul di header kolom hanya jika kolom ditransmisikan sebagai jenis numerik. Gunakan panel Operasi untuk memprakirakan ulang jenis kolom untuk tampilan yang paling akurat.

Menelusuri operasi pembersihan data

Daftar langkah-langkah pembersihan data yang dapat dicari dapat ditemukan di panel Operasi. (Pilihan operasi yang sama yang lebih kecil juga tersedia di menu kontekstual setiap kolom.) Dari panel Operasi, memilih langkah pembersihan data meminta Anda untuk menyediakan kolom atau kolom target, bersama dengan parameter yang diperlukan untuk menyelesaikan langkah tersebut. Misalnya, permintaan untuk menskalakan kolom secara numerik memerlukan rentang nilai baru.

Mempratinjau dan menerapkan operasi

Hasil operasi yang dipilih secara otomatis dipratinjau di kisi tampilan Data Wrangler, dan kode yang sesuai secara otomatis muncul di panel di bawah kisi. Untuk menerapkan kode yang dipratinjau, pilih "Terapkan" di salah satu tempat. Untuk menyingkirkan kode yang dipratinjau dan mencoba operasi baru, pilih "Buang."

Setelah operasi diterapkan, kisi tampilan Data Wrangler dan ringkasan pembaruan statistik untuk mencerminkan hasilnya. Kode muncul dalam daftar operasi yang dijalankan, yang terletak di panel Langkah-langkah pembersihan.

Tip

Anda selalu dapat membatalkan langkah yang terakhir diterapkan dengan ikon sampah di sampingnya, yang muncul jika Anda mengarahkan kursor ke langkah tersebut di panel Langkah pembersihan.

Tabel berikut ini meringkas operasi yang saat ini didukung Data Wrangler untuk Spark DataFrames:

| Operasi | Keterangan |

|---|---|

| urutkan | Mengurutkan kolom dalam urutan naik atau turun |

| Filter | Memfilter baris berdasarkan satu atau beberapa kondisi |

| Pengodean satu panas | Buat kolom baru untuk setiap nilai unik di kolom yang sudah ada, yang menunjukkan ada atau tidak adanya nilai tersebut per baris |

| Pengodean satu panas dengan pemisah | Memisahkan dan mengodekan data kategoris satu panas menggunakan pemisah |

| Ubah tipe kolom | Mengubah tipe data kolom |

| Jatuhkan kolom | Menghapus satu atau beberapa kolom |

| Pilih kolom | Pilih satu atau beberapa kolom untuk disimpan, dan hapus kolom lainnya |

| Ganti nama kolom | Mengganti nama kolom |

| Hilangkan nilai yang hilang | Menghapus baris dengan nilai yang hilang |

| Jatuhkan baris duplikat | Letakkan semua baris yang memiliki nilai duplikat dalam satu atau beberapa kolom |

| Isi nilai yang hilang | Ganti sel dengan nilai yang hilang dengan nilai baru |

| Temukan dan ganti | Ganti sel dengan pola pencocokan yang tepat |

| Kelompokkan menurut kolom dan agregat | Mengelompokkan menurut nilai kolom dan hasil agregat |

| Spasi kosong strip | Menghapus spasi kosong dari awal dan akhir teks |

| Pisahkan teks | Memisahkan kolom menjadi beberapa kolom berdasarkan pemisah yang ditentukan pengguna |

| Mengonversi teks menjadi huruf kecil | Mengonversi teks menjadi huruf kecil |

| Mengonversi teks menjadi huruf besar | Mengonversi teks menjadi HURUF BESAR |

| Menskalakan nilai min/maks | Menskalakan kolom numerik antara nilai minimum dan maksimum |

| Isian Flash | Membuat kolom baru secara otomatis berdasarkan contoh yang berasal dari kolom yang sudah ada |

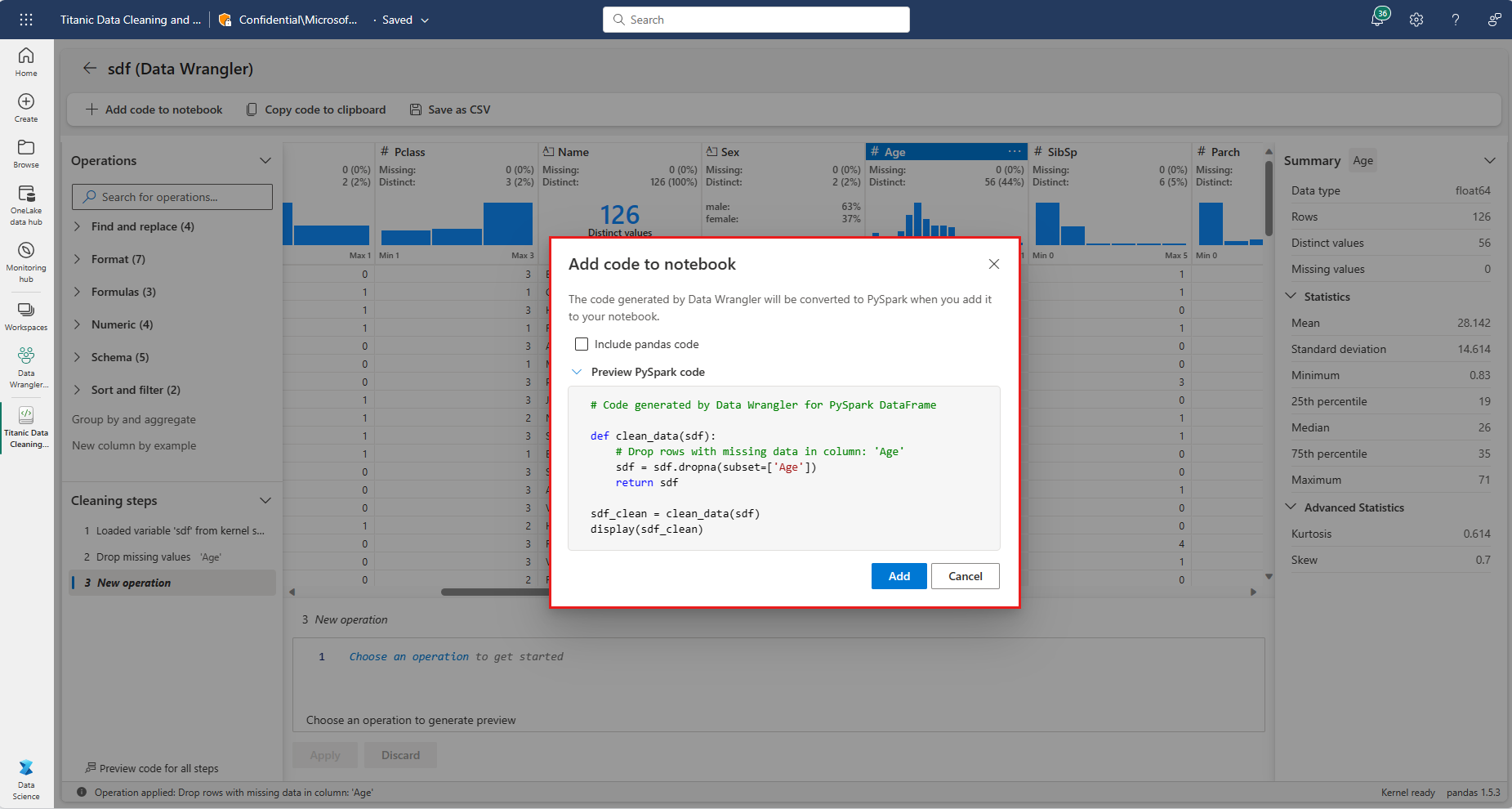

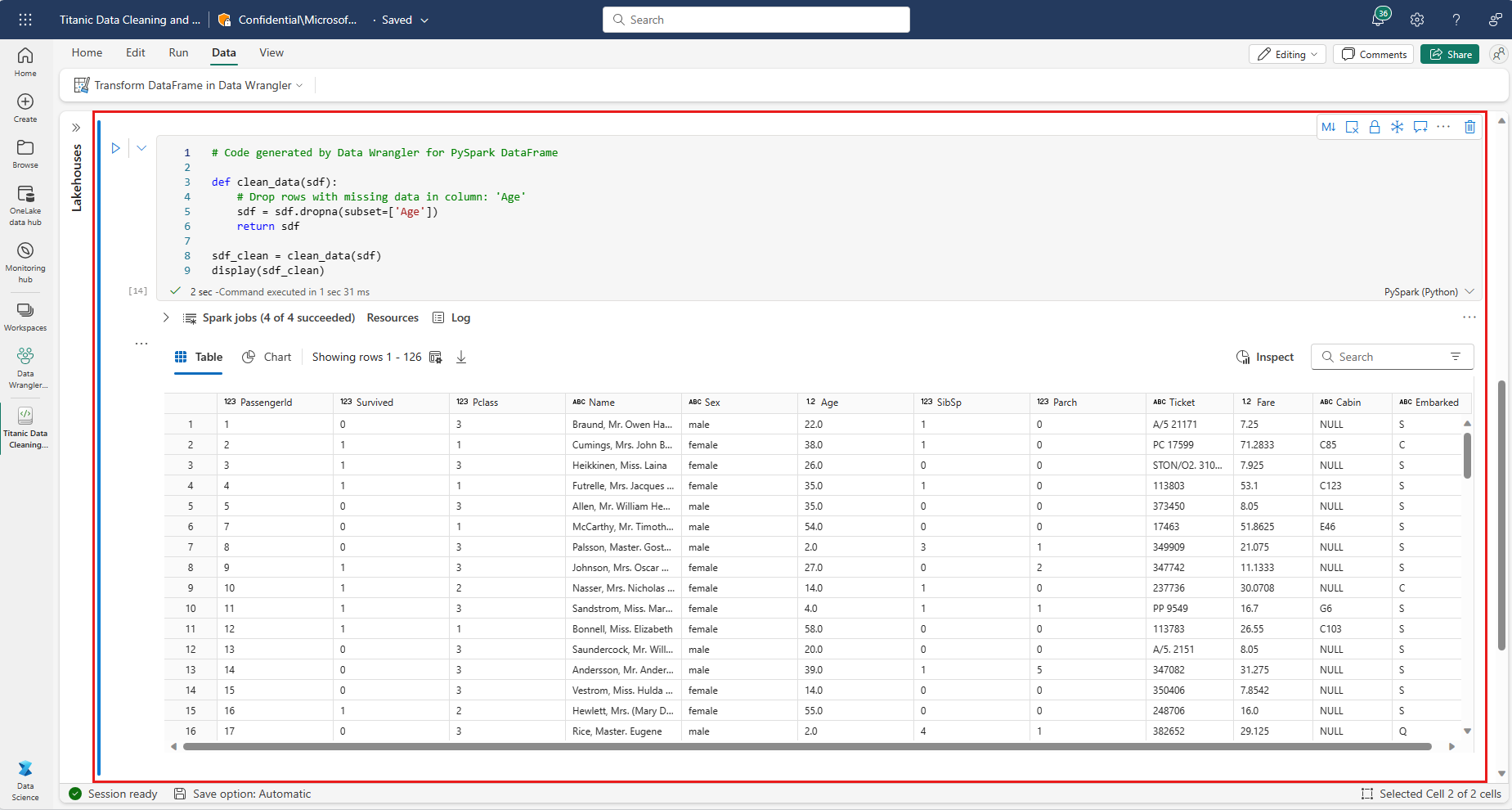

Menyimpan dan mengekspor kode

Toolbar di atas kisi tampilan Data Wrangler menyediakan opsi untuk menyimpan kode yang dihasilkan. Anda dapat menyalin kode ke clipboard atau mengekspornya ke buku catatan sebagai fungsi. Untuk Spark DataFrames, semua kode yang dihasilkan pada sampel panda diterjemahkan ke PySpark sebelum mendarat kembali di notebook. Sebelum Data Wrangler ditutup, alat ini menampilkan pratinjau kode PySpark yang diterjemahkan dan menyediakan opsi untuk mengekspor kode panda perantara juga.

Tip

Kode yang dihasilkan oleh Data Wrangler tidak akan diterapkan sampai Anda menjalankan sel baru secara manual, dan tidak akan menimpa DataFrame asli Anda.

Konten terkait

- Untuk mendapatkan gambaran umum Tentang Data Wrangler, lihat artikel pendamping ini.

- Untuk mencoba Data Wrangler di VISUAL Code, lihat Data Wrangler di VISUAL Code.

Saran dan Komentar

Segera hadir: Sepanjang tahun 2024 kami akan menghentikan penggunaan GitHub Issues sebagai mekanisme umpan balik untuk konten dan menggantinya dengan sistem umpan balik baru. Untuk mengetahui informasi selengkapnya, lihat: https://aka.ms/ContentUserFeedback.

Kirim dan lihat umpan balik untuk